论文总结

1、有开源代码https://github.com/hrlblab/CS-MIL

2、针对 以往的研究未考虑不同分辨率之间的尺度间关系,且病理图像WSL具有金字塔形特性(也就是不同的放大倍数下的图像呈现金字塔式的结构),所以作者引入了跨尺度注意力机制。通过跨尺度注意力图识别重要区域,并通过乘以跨尺度注意力评分来诊断病理图像,将跨尺度特征聚合为跨尺度表示。采用跨尺度注意力机制将跨尺度特征与不同注意力评分合并。将不同群体的跨尺度表示串联进行病理分类。

3、多实例学习(Multi-instance learning)相当于是,对于病理图像,我们只知道这张图有没有患病,但并不知道是哪个区域是病灶。因此,可以将病理图像切成不同的小块(patch),也就是实例,然后来用弱监督学习,如果这个病理图像是患病的,那么多个实例中至少有一个是阳性的。如果没有患病,那么多个实例中全部是阴性的。

MIL可以通过学习从大图像中提取重要区域,进行病理预测。

摘要

在数字病理学中,分析高分辨率的整片图像(WSI)是一项重大挑战。多实例学习(MIL)是一种常见的解决方案,用于处理高分辨率图像,通过对物体袋(即较小的图像块集合)进行分类。然而,这种处理通常只在单一比例尺(例如20×倍)的 WSI 上进行,忽略了对人体病理学家诊断至关重要的尺度间信息。本研究提出一种新型跨尺度MIL算法,明确将尺度间关系聚合到单一MIL网络中,用于病理图像诊断。本文的贡献有三方面:(1)提出一种新颖的跨尺度MIL算法,整合多尺度信息和尺度间关系;(2)创建并发布具有尺度特异形态特征的玩具数据集,用于检查和可视化跨尺度注意力的差异;(3) 我们简单的跨规模MIL策略证明了在内部和公共数据集上的卓越表现。官方实现版本已公开于 https://github.com/hrlblab/CS-MIL 。

引言

病理学是诊断炎症性肠病(如克罗恩病)的黄金标准(Gubatan等,2021;Yeshi 等,2020)。在当前临床实践中,病理学家通过显微镜观察多尺度的形态模式(Bejnordi 等,2017),这是一个繁琐的过程。随着全片影像和深度学习技术的快速进步,数字病理学中计算机辅助临床诊断和探索的潜力(Kraszewski 等,2021;Con 等,2021;清川等,2022;Syed 和 Stidham,2020)正在迅速增长,使其成为一个充满希望的作品研究领域。然而,对标准监督式深度学习系统来说,按像素或按补丁标注图像计算成本高(Hou 等,2016;Mousavi 等,2015;Maksoud 等,2020;Dimitriou 等,2019)。为了从带有弱注释的图像(例如按患者进行诊断)中获得准确诊断,多实例学习(MIL)已成为数字病理学任务中流行的弱监督学习范式(Wang 等,2019;Skrede 等,2020;Chen 等,2021;Lu 等,2021b,a)。例如,DeepAttnMISL(Yao等,2020)利用MIL将图像贴片聚集成不同的"袋子",以建模和聚合多样化的局部特征,以实现患者层面的诊断。 尽管取得了成功,之前的努力------尤其是"自然图像驱动"MIL算法------大多忽视了多尺度(即WSI的金字塔形特性,可以由 的尺度组成,从而使病理学家能够同时考察局部和整体形态特征(Bejnordi 等,2015;Gao 等,2016;Tokunaga 等,2019)。近年来,研究人员尝试通过使用多尺度图像模拟人类病理评估(WSI)(Hashimoto等,2020a;Li 等,2021)。这些方法通常在每个尺度独立提取特征,然后进行"晚融合"步骤。本研究探讨了在更早期阶段引入不同尺度间相互作用作为基于注意力的"早期融合"范式的可行性。 与当前的"多尺度"MIL策略不同,我们提出了一种新的"跨尺度"注意力机制。关键创新是引入一种以注意力为导向的MIL方案,以显式模拟特征提取过程中的尺度间交互(见图1)。

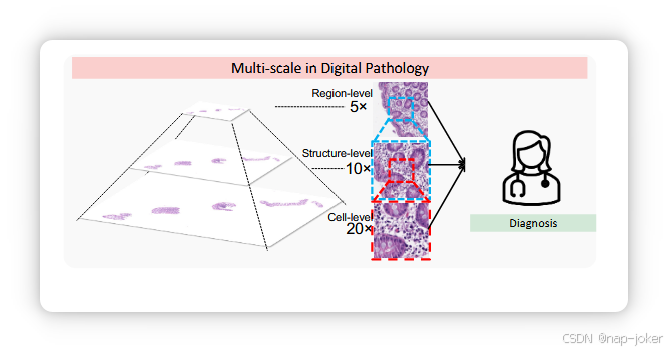

图1:多尺度示意图。鉴于不同分辨率下的组织样本结构模式异质性,人体病理学家需要在整张幻灯片图像中仔细检查多尺度活检,以捕捉疾病诊断所需的形态学模式。

该方法不仅利用不同尺度(不同视野)的形态特征,还作为"早期融合"学习范式学习它们的尺度间相互作用。通过实证验证,我们的跨尺度MIL方法在曲线下面积(AUC)得分和平均精度(AP)得分上均优于其他多尺度MIL基准。本研究基于我们早期的工作(Deng等,2022),提供了更全面和详尽的方法论说明、新发布的玩具数据集以及通过公开数据集进行的新验证。 本研究的贡献有三方面:(1)提出了一种新颖的跨尺度MIL(CS-MIL)算法,用于显式建模特征提取过程中的尺度间关系;(2)具有尺度特异形态特征的玩具数据集,用于检查和可视化跨尺度注意力的差异;(3) 我们简单的跨规模MIL策略证明了在内部和公共数据集上的卓越表现。该代码已在 https://github.com/hrlblab/ CS-MIL公开公开。 本研究扩展了我们的会议论文(Deng 等,2022),新增了以下努力和贡献:(1)开展新实验,使用三个数据集(一个TCGA数据集和两个玩具数据集)及较新的基准方法,以实现更严谨的评估;(2)本文中对所提方法进行了更全面和详细的介绍和示意;(3)我们发布端到端的Docker容器用于病理图像分析,便于结果的有效复现。

相关工作

数字病理学中的多实例学习

在临床数字病理领域,疾病相关组织区域可能仅局限于整个组织样本的较小部分,从而形成大量无病斑块。病理学家利用显微镜仔细检查不同放大倍数的组织,以发现疾病相关区域,并随后仔细分析形态学模式。然而,由熟练病理学家对疾病相关区域进行贴片级注释是一项繁重的任务,在放大到吉像素大尺度图像时存在挑战。为应对这一挑战,几项近期研究(Hou 等,2016;Campanella 等,2019;Hashimoto 等,2020b;Wang 等,2019;Skrede 等,2020;Lu 等,2021b,a)在贴片级分析中展示了弱监督技术------多实例学习(MIL)------一种广泛使用的弱监督学习范式------的前景,其中基于贴片的分类器(例如按患者进行诊断)仅基于幻灯片级标签进行训练。在MIL的语境下,每一张全幻灯片图像(WSI)都被视为一个包含多个补丁实例的袋子。如果WSI袋中的任何斑块(即实例)表现出疾病相关特征(如病变、肿瘤、异常组织),则该袋被标记为疾病相关。分类器通过细化、提取并聚合斑块级特征或评分,以预测幻灯片级别的标签(Li 等,2021)。近年来基于MIL的方法极大地受益于深度神经网络进行特征提取和聚合(Ilse等,2018;Wang 等,2016;Oquab 等,2015)。例如,Yao等人(Yao等,2020)采用了袋级方法,将图像斑块聚集成不同的"袋子",以建模和聚合多样化的局部特征,以实现患者层面的诊断。类似地,Hou 等人(Hou 等,2016)提出了一种决策融合模型,汇总了由斑块级 CNN 生成的片段级预测。Hashimoto 等人(Hashimoto 等,2020b)提出了一种基于 CNN 的新型癌症亚型分类技术,通过在斑块层面有效融合多实例、领域对抗性和多尺度学习框架。

数字病理学中的多尺度

数字病理学则是金字塔结构的千兆像素图像。不同分辨率在组织样本上呈现不同层次的异质结构模式。因此,病理学家需要通过数字病理学在多个尺度上仔细检查活检,以捕捉疾病诊断所需的形态学模式(Gordon 等,2020)。这一过程劳动密集,且会导致连续放大/缩放操作的空间相关性丧失。使用AI模型分析多尺度图像,不仅通过利用尺度感知知识提升模型性能,还利用模型学习的空间一致性尺度间关系。此前的研究考虑了多个尺度的形态特征。Hashimoto 等人(Hashimoto 等,2020a)提出了一种创新的基于CNN的癌症亚型方法分类,有效整合多实例、领域对抗和多尺度学习框架,将不同尺度的知识结合起来。Li 等人(Li 等,2021)采用了特征连接策略,将不同尺度的各区域高层特征合并,纳入由 CNN 特征提取器获得的跨尺度形态模式。Barbano 等人(Barbano 等,2021a)提出了一种多分辨率的发育异常分级方法。

视觉变换器(ViT)因其能够利用位置注意力,成为从大尺度图像中进行特征学习的有前景方法。Chen 等人(Chen 等,2022)最近提出了一种新的 ViT 架构,利用两层自监督学习利用 WSI 固有的层级结构来学习高分辨率图像表示。然而,这些方法都无法从多个尺度,即尺度间关系中整体学习知识。为解决这一局限性,我们提出了一种基于注意力的"早期融合"范式,为早期阶段建模尺度间关系提供了有前景的方法。

方法

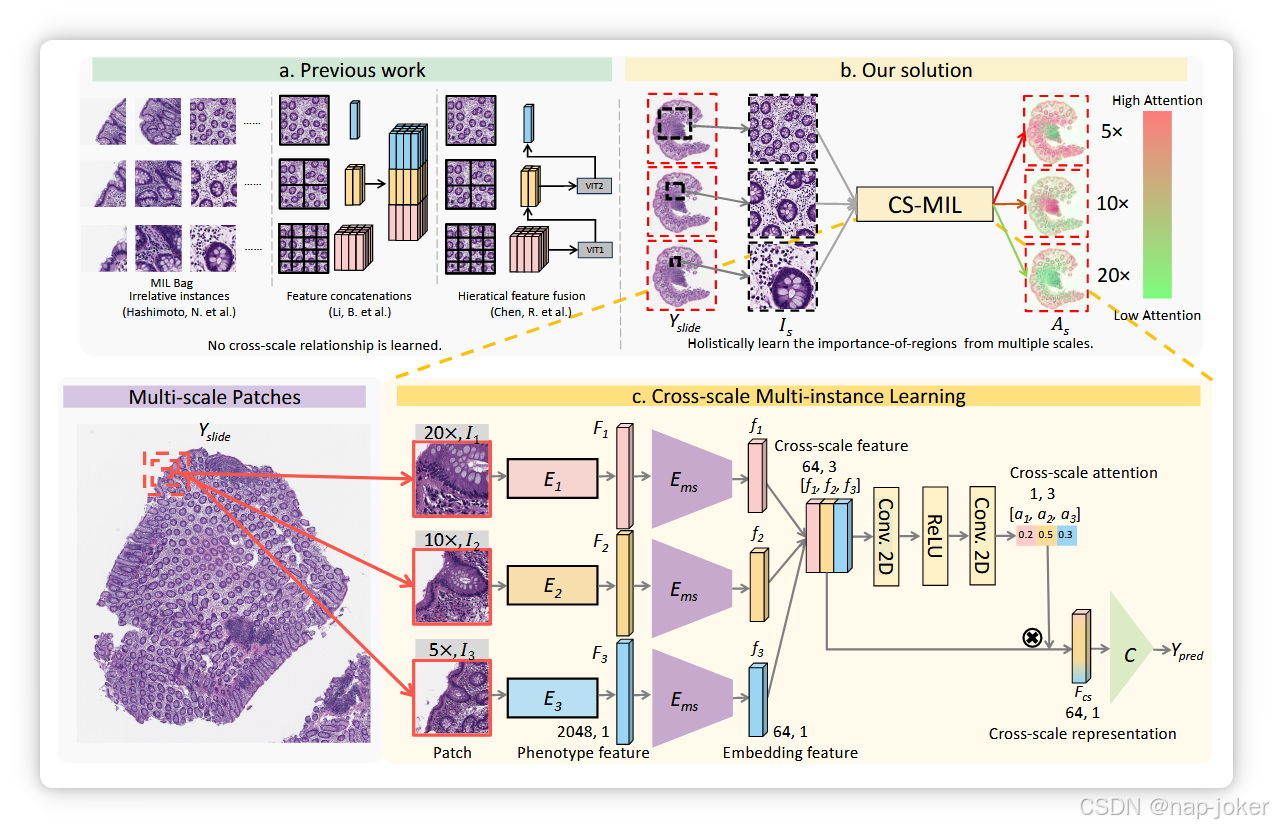

图2:多实例学习MIL设计。 a. 以往的研究未考虑不同分辨率之间的尺度间关系。 b. 我们的解决方案使得通过跨尺度注意力图识别重要区域,并通过乘以跨尺度注意力评分来诊断病理图像,将跨尺度特征聚合为跨尺度表示。c. 采用跨尺度注意力机制将跨尺度特征与不同注意力评分合并。将不同群体的跨尺度表示串联进行病理分类。

拟议CS-MIL的整体流程如图2.c所示。我们提出了一种基于注意力的新"早期融合"范式,旨在以整体方式捕捉尺度间的关系。首先,中心坐标相似但尺度不同的块块会从WSI中联合铺砌。然后,利用自监督模型提取各位的表型特征。每个 WSI 应用基于局部特征的聚类,将表型模式分配到每个 MIL 袋中。接下来,进行跨尺度注意力引导MIL以汇总跨多尺度和多聚类环境的特征。最后,生成一个跨尺度注意力图供人类视觉检查。

特征嵌入与表型聚类

在MIL社区,大多数组织病理图像分析方法分为两个阶段(Schirris等,2021;Dehaene等,2020):(1)自监督特征嵌入阶段,(2)弱监督特征学习阶段。我们的方法采用类似设计,利用我们的数据集训练对比学习模型SimSiam(Chen 和 He,2021),作为表型编码器(Es),用于从补丁(I)中提取高级表型特征(Fs),即如方程1所示。SimSiam通过最大化不同图像增强在无标签的情况下的样本内相似性,展现出优于其他骨干的特征提取性能。

其中S为WSI上的刻度数量。三个预训练编码器(E)分别由不同尺度的补丁训练。这一自监督学习阶段对于在随后的弱监督特征学习阶段前有效提取特征至关重要。所有补丁随后嵌入低维特征向量中,用于第二阶段的分类。受(Yao等,2020)启发,k均值聚类用于根据患者层面的自监督嵌入(20×倍率)对患者层面的斑块进行聚类。值得注意的是,高层特征在表现表型方面比低分辨率缩略图更为全面(Zhu等,2017)。每个袋子中不同簇均等收集了补丁,然后更适合MIL模型的袋子根据WSI上稀疏分布的独特表型模式进行组织。另一方面,具有相似高层特征的斑块会被聚合进行分类,且不受空间限制。

跨尺度的注意力机制

我们的方法基于MIL相关文献的前述,结合了跨尺度注意力机制,在整张幻灯片图像(WSIs)中捕捉跨尺度的模式。具体来说,我们利用基于CNN的编码器从相应表型簇中精炼贴片嵌入。然后将实例级特征聚合以实现患者分类,从而在使用WSIs的生存预测中获得更优异的性能。虽然此前的研究中曾提出注意力机制以增强模型在WSI中跨空间位置模式的使用(Ilse等,2018;Lu等,2021b),但它们并未充分利用WSI中跨尺度的模式。其他方法则将多尺度特征从WSI中聚合到深度学习模型中(Hashimoto等,2020a;Li 等,2021),但已证明其在利用同一位置内多个分辨率相互作用的能力上存在局限性。为解决这一问题,我们提出了一种新颖的跨尺度注意力机制,用于在骨干不同尺度上表示意识。首先,来自表型编码器(E)的嵌入跨尺度特征(fs)通过多尺度编码器(EMS)与DeepAttnMISL(Yao等,2020)的暹罗多实例全卷积网络(MI-FCN)在不同尺度间进一步处理(Yao等,2020):

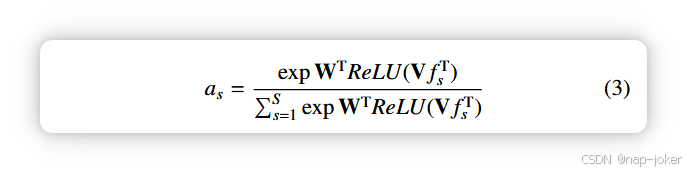

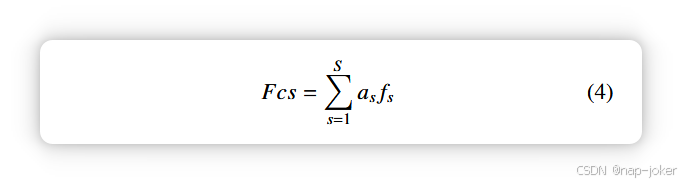

其中 S 是 WSI 上尺度的数量。所有多尺度编码器(EMS)在不同尺度之间权重共享。接下来,应用跨尺度注意力机制,考虑同一位置跨尺度注意力中每个尺度的重要性。跨尺度特征(fs)同时输入跨尺度多实例学习网络(CS-MIL),该网络包含两个核大小为1×1的全卷积层和一个ReLU激活函数。CS-MIL的输出是通过整体考虑跨尺度特征的跨尺度注意力得分集合(as)。这通过方程3实现:

其中W ∈RL×1,V ∈RL×M为CS-MIL中可训练参数,L为EMS输出fs的大小,M为CS-MIL第一层的输出信道,tanh(.)为切向单元非线性激活函数,S为WSI上刻度的数量。跨尺度注意力评分(as)随后与跨尺度特征相乘,得到融合的跨尺度表示(见方程4):

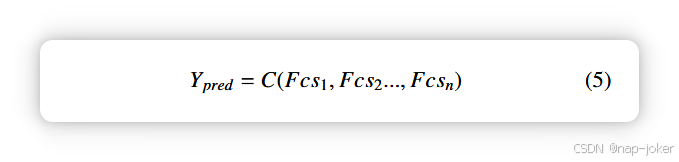

最后,基于注意力的实例级池化算子(C)(Yao等,2020)被部署,实现按患者分类,实现跨尺度嵌入5个,袋大小为n。

跨尺度注意力机制可视化

跨尺度注意力机制基于CS-MIL的跨尺度特征(fs)为每个区域(I)生成注意力评分(as)。这些注意力评分反映了不同尺度表型特征在合并跨尺度表示(Fcs)进行最终分类(C)时的相对重要性。通过将这些分数填回WSI对应位置,我们得到一个结合尺度和位置信息的注意力地图(As)。该地图为疾病引导探索提供了多种情境下的见解,突出了跨尺度机制的多样性和实用性。

实验

数据集

**内部CD数据集:**来自(Bao等,2021)的50份H&E染色上行结肠(AC)病变活检样本,来自20名CD患者及30名健康对照组进行训练。染色组织以20×倍扫描。病理诊断方面,CD患者的20张切片被评为正常、静止、轻度、中度或重度,其余健康对照的组织切片被评为正常。染色并扫描了116条AC活检,采用上述训练集相同的程序进行测试。活检样本来自72名与训练数据中患者无重叠的CD患者。

**TCGA-GBMLGG数据集:**为展示我们提出架构的普遍性,我们进行了实验基于来自癌症基因组图谱(TCGA)的胶质细胞瘤数据集(GBMLGG)。该数据集包含613个患者样本,其中330名患者携带异构酸盐脱氢酶(IDH)突变,其余患者为正常。

实验配置

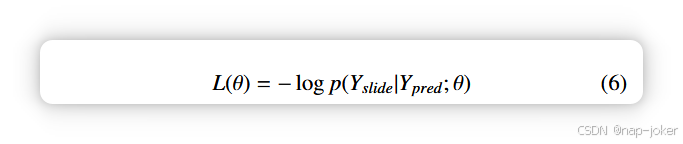

内部CD数据集:将两个数据集中的所有WSI裁剪成4096×4096像素的区域,以公平比较MIL方法与ViT方法在20×中的性能。对于20×个补丁,每个像素等于0。 5微米。然后,在三个比例尺(20×、10×和5×)上铺设了256×256像素的补丁。三个独立模型采用官方SimSiam模型,采用ResNet-50骨干,在三种不同比例下训练,所有补丁(504,444、256×256个前景补丁)。训练在200个时代进行,批次规模为128,使用SimSiam官方设置。所有补丁均获得了2048通道嵌入矢量。表型聚类在单一尺度特征内进行,采用k均值聚类(类别编号为8)以三分辨率进行,并生成包含每位患者所有分辨率的跨尺度特征。在HIPT特征提取中(Chen 等,2022),官方预训练实现在1650,4096×4096个区域。训练数据集采用"留一"策略随机组织为10个数据分割,测试数据集则被划分为10个,数字平衡。MIL模型为每位患者收集每个袋子,并从临床医生中以按幻灯片标记的不同表型聚类类别(Yslide)相等选择。训练的超参数与DeepAttnMISL一致(Yao等,2020)。采用负对数似然损失(Yao等,2019)比较了6中弱标签袋子的幻灯片预测(Ypred)。

其中θ代表模型参数。所有模型每四个纪元更新一次,以平滑收敛损失,并在共100个时代进行训练。每个数据分割的最优模型基于验证损耗选定,同时使用10个数据分割的平均性能来评估测试结果。测试阶段随机生成100个图像袋,每个袋大小为8,以覆盖每个全幻灯片图像(WSI)的大部分区域,袋子得分的平均值作为幻灯片层级的最终预测值计算。每个模型的性能通过接收器工作特征(ROC)曲线(含曲线下面积(AUC)评分、精度-召回(PR)曲线(平均精度)评分和分类精度进行估算。所有模型均在NVIDIA RTX5000 GPU上训练。

**TCGA-GBMLGG 数据集:**由于计算限制,从每个 WSI 中随机选取 10% 区域,最终数据集为 5132,4096 × 4096 个区域。在预训练阶段,仅使用了 15% 的区域(582,666,256 ×256 个前景斑块,分布于三个尺度,来自 755,4096 × 4096 个区域),用于使用 ResNet-50 骨干网训练 SimSiam 模型。测试阶段使用了官方预训练参数和超参数,因为 HIPT 已包含包含 TCGA-GBMLGG 数据集(含 54,158 个区域)。训练、验证和测试样本在患者层面以 6:1:3 比例分离。测试阶段,每个 WSI 随机生成 500 个尺寸为 32 的图像袋,计算袋分的平均值作为患者层面的最终预测值。所有模型均使用 NVIDIA RTXA6000 GPU 训练

结果

实验验证

我们实现了三个相同的单尺度DeepAttnMISL(Yao等,2020)模型,用于对应尺度的斑块。我们同时训练了(4)门控注意力(GA)模型(Ilse等,2018)和(5)DeepAttnMISL模型,使用多尺度补丁,未对尺度信息进行区分。多尺度的补丁在处理MIL袋的表型聚类和斑块选择时被视为实例。此外,我们采用了多种多尺度方法,包括(6)多尺度特征聚合(MS-DA-MIL),将不同尺度同一位置的嵌入特征共同添加到每个MIL袋中(Hashimoto等,2020a);(7)不同尺度的特征连接(DS-MIL)(Li等,2021);(8)在聚合多尺度和多地点特征时的双层特征蒸纯(Zhang等,2022);(9)带有自监督学习的层级图像金字塔变换器(HIPT)(Chen等,2022);(10)层级注意力引导MIL(Xiong等,2023)(HAGMIL)以及提出的方法(11)CS-MIL。我们沿用上述多尺度聚合,将表型特征输入DeepAttnMISL骨干,以评估基础多尺度MIL模型及我们提出的方法。所有模型均在相同的超参数设置和数据分割下训练和验证。

分类结果

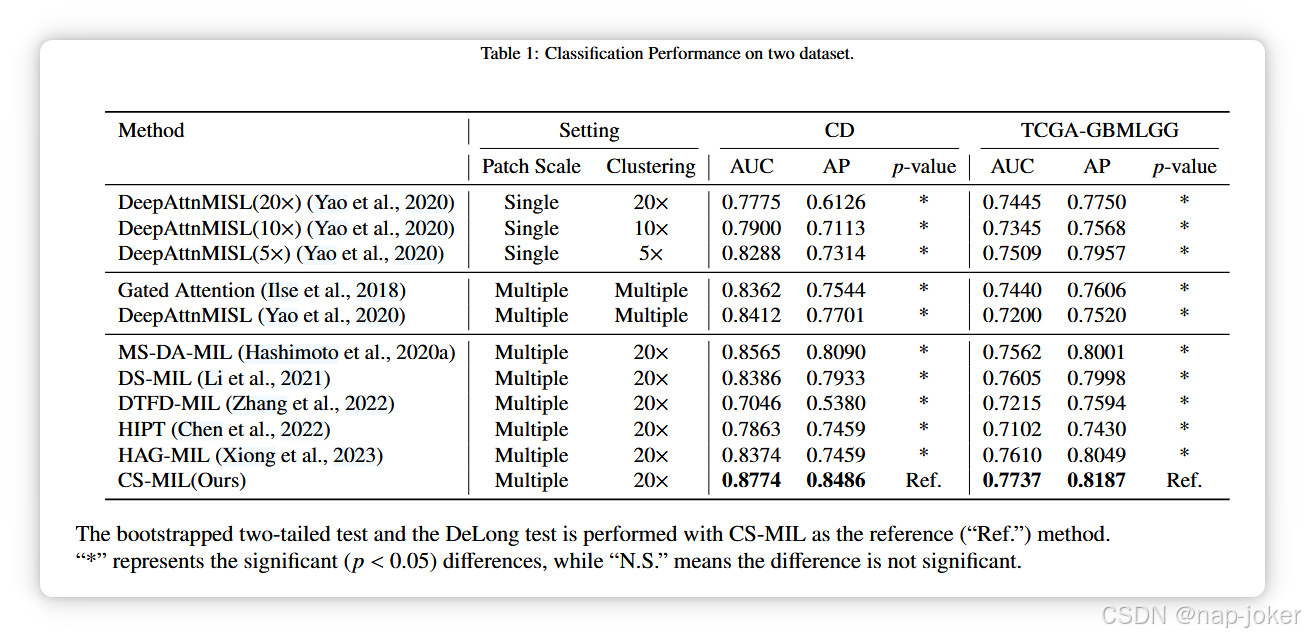

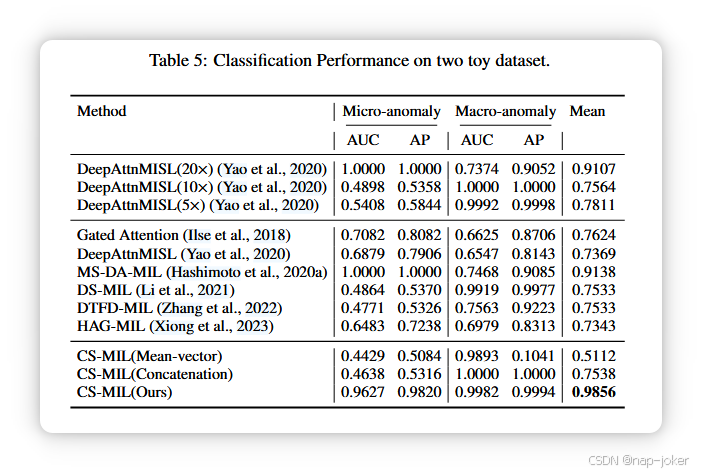

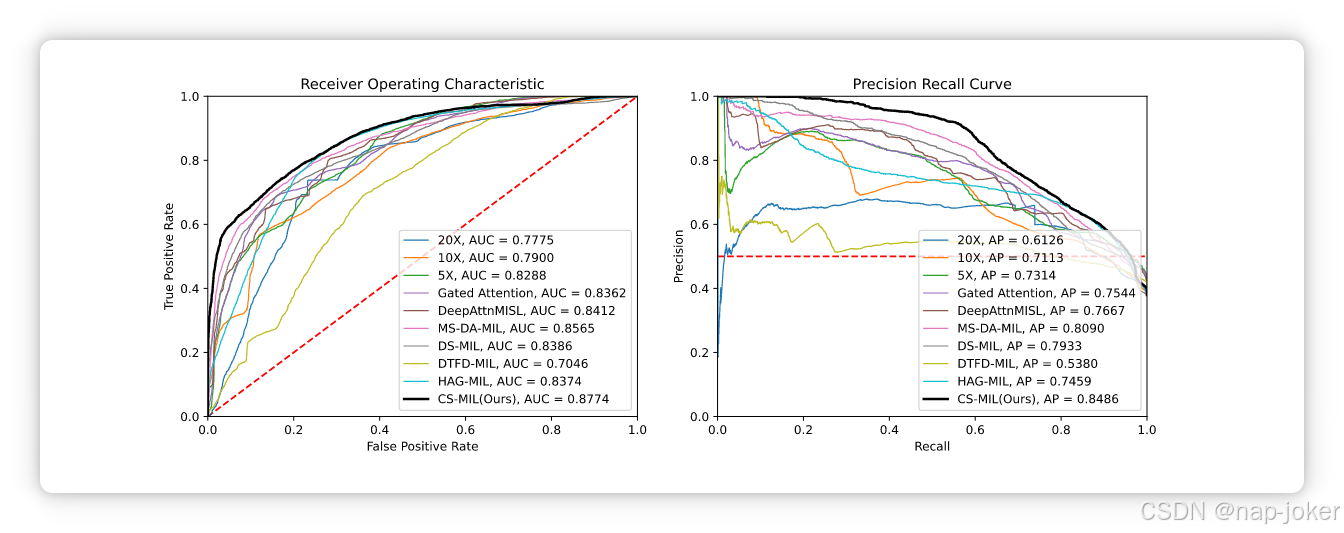

表1和图3显示了在CD分类任务中直接将模型应用于测试数据集时的分类表现,无需重新训练。表1还显示了TCGA-GBMLGG数据集上的IDH状态分类。总体而言,拟议的CS-MIL在大多数评估指标中得分较好,展示了跨尺度关注探索MIL不同尺度间关系的益处。

跨尺度注意力可视化

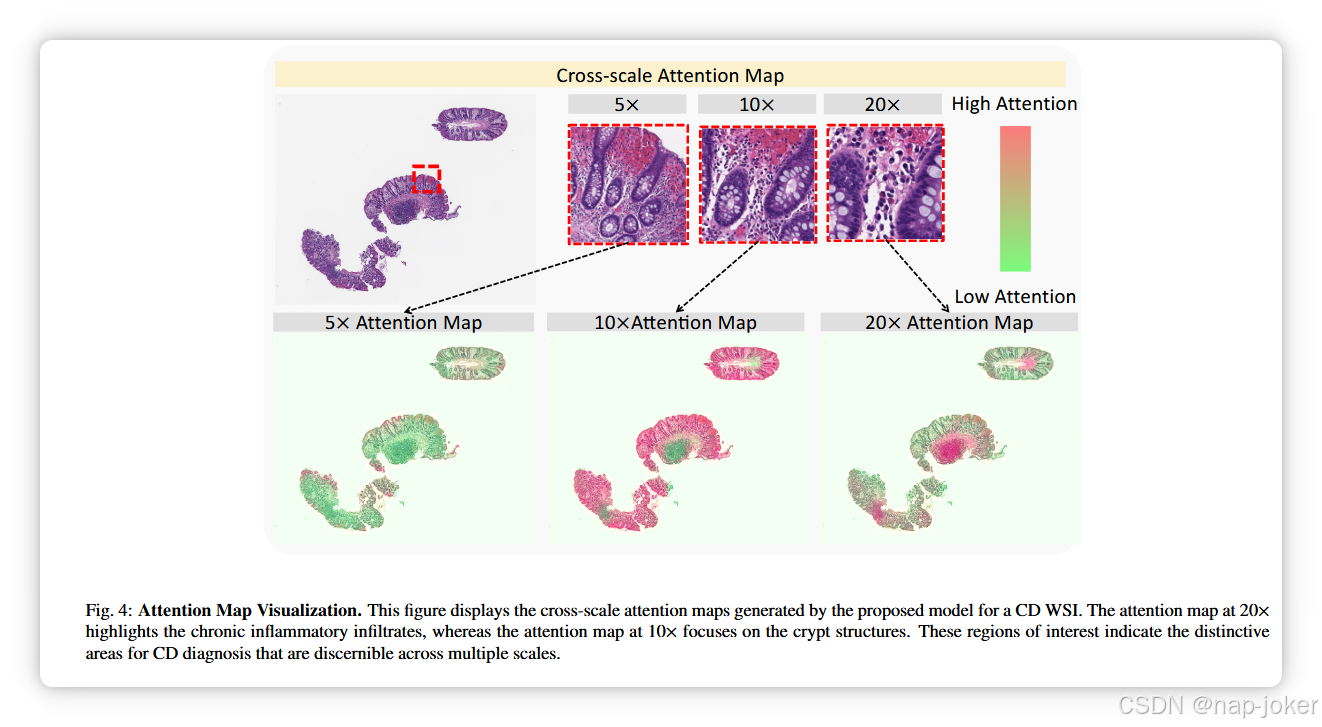

图4展示了拟议CS-MIL在CD中WSI上生成的跨尺度注意力图。拟议的CS-MIL在不同尺度的WSI上呈现了区域的重要性,融合了多尺度和多区域可视化。因此,20×注意力图突出慢性炎症浸润,而10×注意力图则聚焦于隐蔽结构。这些关注区域解释了多个尺度上CD诊断的判别区域。

图4:注意力图可视化。本图展示了CD内心病WSI所提出模型生成的跨尺度注意力图。20×的注意力图突出了慢性炎症浸润,而10×的注意力图则聚焦于隐穴结构。这些关注区域显示了CD诊断中在多个尺度上可识别的独特区域。

消融实验

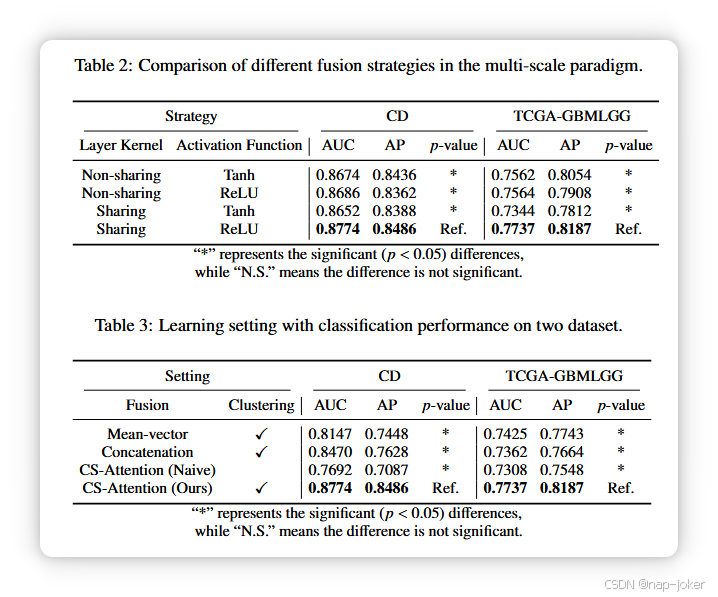

受(Yao等,2020)和(Ilse等,2018)启发,我们探索了MIL中的多种注意力机制设计,利用不同的激活函数,并在两个数据集上评估了这些设计。我们将CS-MIL方法分为两种策略,区分它们在多个尺度的嵌入特征学习过程中是否共享核权重。如表2分类表现所示,CS-MIL策略中共享核权重,配合ReLU激活函数(Agarap,2018),在各指标上表现更佳且值更高。总体而言,所提CS-MIL设计在与其他基线方法中持续表现出优异性能。使用DeLong检验对各基线方法(表中参考)的AUC差异进行了统计评估。显著差异(p < 0.05)标为"*",非显著差异标为"N.S."。在表中。3,我们进一步评估拟议跨尺度注意力机制的有效性,采用均向量和连接设计,CS-MIL骨干在固定1:1:1注意力评分设置下。此外,我们比较去除表型嵌入时的分类表现,以评估投射的贡献。结果,配备跨尺度注意力机制和表型聚类的CS-MIL管道在两个实证数据集上表现更佳。

模拟

为评估跨尺度注意力机制的有效性,我们使用两个玩具数据集评估了CS-MIL在不同尺度上不同尺度的形态模式。这些数据集被选用来模拟不同场景并测试我们方法的功能性。

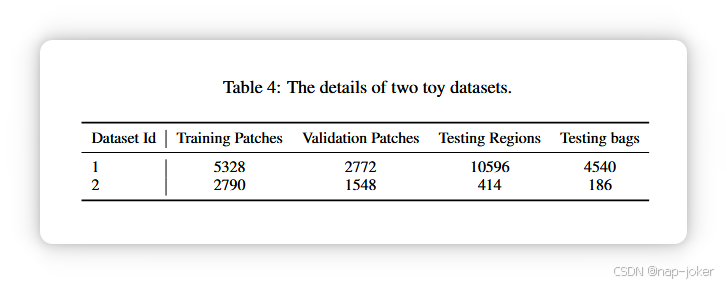

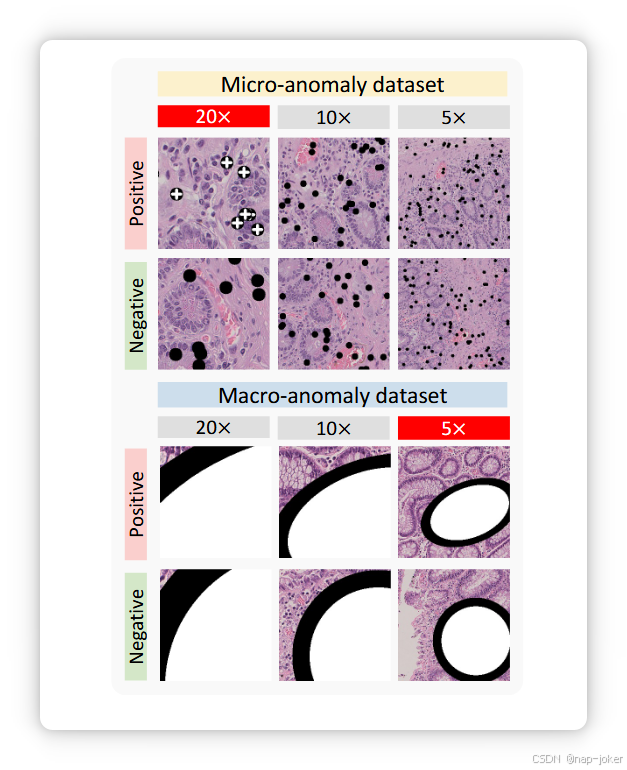

**数据:**图5显示了两个数据集(微型异常数据集和宏异常数据集)中用于训练的补丁。微型异常数据集中,微白色交叉图案仅出现在20×的正性斑块上,而宏异常(椭圆)在宏异常数据集中视野较大时×在5易于识别。所有斑块均从Unitopatho数据集的正常组织样本中提取(Barbano 等,2021b)。发布了两个数据集,用于测量数字病理社区跨尺度设计的推广性。两个玩具数据集的详细信息见表4.

方法:CS-MIL利用ResNet-18骨干从补丁中提取特征。我们的实现方式,包括超参数,遵循了DeepAttnMISL(Yao等,2020)。测试过程中,每个补丁被随机捕获10次,分别放入不同尺寸为8的图像袋中,以获得多重注意力评分。最终注意力分数是通过取这些分数的平均值计算得出的。

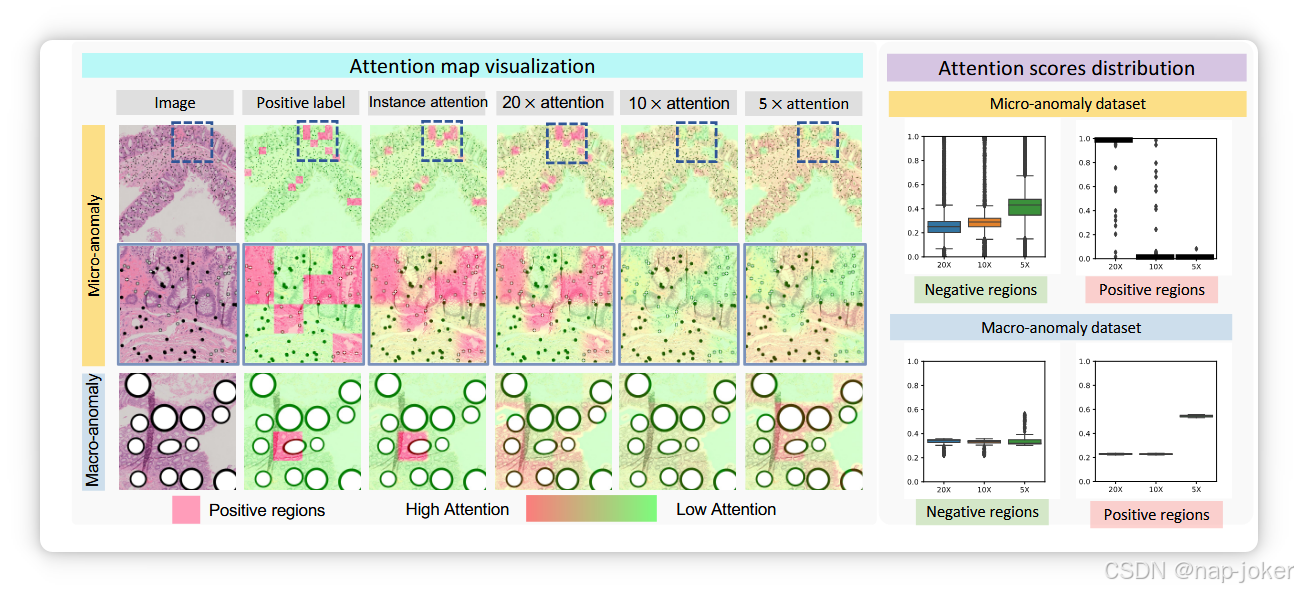

**结果:**表5展示了两套玩具数据集在袋级分类的表现。所提出的方法在不同尺度上以稳定的方式区分不同的模式。图6展示了实例层面和多尺度的跨尺度注意力图。对于微型异常数据集,实例注意力成功突出显示了在相应区域注意力分数较高的正向区域,即20×。对于宏观异常数据集,实例注意力在5×处定位了注意力分数较高的椭圆而非圆圈。右侧面板的箱形图展示了不同尺度下的注意力分数分布,证明了跨尺度注意力机制在提供不同尺度评分方面的可靠性,并展示了其在局部化尺度特定知识的能力。跨尺度关注还可用于未来病理图像中基于人工智能的知识探索指导,使其区别于其他方法。

讨论

表1和图3显示多尺度模型优于单尺度模型,表明多尺度数据外部信息在WSIS上的价值。提出的CS-MIL模型在大多数评估指标中优于其他模型,凸显跨尺度注意力的有效性,该方法从多个尺度学习信息,并考虑MIL中的跨尺度关系。

图3:ROC曲线与AUC评分,PR曲线与AP评分。该图说明了基线模型和所提出模型的受试者工作特征( ROC )曲线和精确率-召回率( PR )曲线,以及相应的曲线下面积( AUC )分数和平均精度( AP )分数。结果表明,本文提出的跨尺度注意力模型在两个指标上都优于基准模型。

图5:两个玩具数据集。该图展示了两个玩具数据集,以评估跨尺度注意力机制的功能。在微异常数据集中,仅在20 ×处观察到白色十字花纹。在宏观异常数据集中,5 ×处容易识别出异常形状(椭圆)。

从图6可以看出,CS - MIL模型使用实例得分定位正区域,而跨尺度注意力图则识别出不同模式出现的正确尺度。在宏观异常数据集中,圆形较大的区域在5 ×处被突出的更多,进一步证明了模型区分了椭圆和视野较大的圆形的形状模式。为了进一步研究跨尺度注意力机制的有效性,我们通过均值向量和级联设计进行了整合跨尺度特征的实验,以保持1:1:1的注意力分数比例。相反,级联策略( DS - MIL、均值向量、级联等。)在跨尺度的模式聚合中更有效,从而在宏观异常数据集上获得了更优越的性能。基于蒸馏的(基于层次的)方法( DTFD - MIL、HAG - MIL等。)在宏观异常数据集的特征可继承和跨层次尺度的区域一致时取得较好的性能,而在微观异常数据集的不同尺度上缺乏一致性,无法识别特定尺度的模式。实验结果表明,所提出的跨尺度注意力机制是高效和灵活的,能够改进特定尺度知识的模式定位,并增强不同尺度间层次化知识的模式集成。 这些发现强调了我们提出的跨尺度注意力机制在处理数字病理中不同形态模式的多功能性。表6报告了不同多尺度模式下最先进模型的参数数量和GPU内存使用情况。所提出的方法仅通过增加较低的计算复杂度就实现了较好的分类性能。我们的研究存在一定的局限性和改进的空间。在本模型中,对3个不同规模的模型分别执行预训练过程,在自监督学习过程中,需要耗费大量的计算资源,且不需要捕获尺度间的知识。使用来自多个尺度的图像训练的Omni模型,并在特征嵌入中充满尺度感知知识是很有前途的。此外,当前管道的最大视野为1024 × 1024像素,在WSIs中仍然是一个相对较小的区域。然而,最近ViTs的进展提供了一个机会,通过在更大的视野中纳入更大的空间关系和更多的区域信息来增强管道,使其能够直接接收幻灯片级别的所有信息。

图6:玩具数据集的结果该图展示了在实例级别和多个尺度上的注意力图。在Micro - anomaly数据集的情况下,实例注意力对其对应区域中的正区域在20 ×处产生更高的注意力分数。同样,对于宏观异常数据集,实例注意力识别出注意力分数较高的椭圆而不是5 ×处的圆。此外,右面板中的箱线图显示了不同尺度下的注意力分数分布,证实了跨尺度注意力机制在多尺度下生成分数的可靠性。

总结

在这项研究中,我们介绍了一种新颖的跨尺度MIL方法,该方法有效地将多尺度特征和尺度间知识集成在一起。此外,所提方法利用跨尺度注意力分数生成重要性图,增强了CS - MIL模型的可解释性和可理解性。实验和仿真结果表明,所提出的方法优于现有的多尺度MIL基准。跨尺度注意力的可视化产生具有尺度特异性的重要性图,潜在帮助临床医生解释基于图像的疾病表型。这项贡献突出了跨尺度MIL在数字病理学中的潜力,并鼓励该领域的进一步研究。