TL;DR(三行:场景/结论/产出)

- 场景:数据工程师需要调度复杂的 ETL 任务和定时任务

- 结论:Airflow 以 Python 代码定义 DAG,支持分布式执行和可视化监控,适合大规模任务调度

- 产出:完整的 Airflow DAG 示例、核心概念说明、错误速查卡

版本矩阵

| 功能 | 状态 | 说明 |

|---|---|---|

| DAG 有向无环图 | ✅ 已验证 | Python 代码定义任务依赖关系 |

| BashOperator | ✅ 已验证 | 执行 Bash 命令 |

| PythonOperator | ✅ 已验证 | 调用 Python 函数 |

| EmailOperator | ✅ 已验证 | 发送邮件通知 |

| HTTPOperator | ✅ 已验证 | HTTP 请求集成 |

| SqlOperator | ✅ 已验证 | SQL 命令执行 |

| CeleryExecutor | ✅ 已验证 | 分布式任务执行 |

| KubernetesExecutor | ✅ 已验证 | K8s 容器化执行 |

| Web UI 监控 | ✅ 已验证 | 任务状态可视化和日志查看 |

| 定时调度 | ✅ 已验证 | Cron 表达式配置 |

任务集成部署

Airflow 基本介绍

Apache Airflow 是一个开源的任务调度和工作流管理工具,用于编排复杂的数据处理任务。最初由 Airbnb 开发,于 2016 年捐赠给 Apache 软件基金会。Airflow 的主要特点是以代码方式定义任务及其依赖关系,支持任务的调度和监控,适合处理复杂的大数据任务。

Airflow 的特点

- 以代码为中心:Airflow 使用 Python 定义 DAG,提供灵活性和可编程性。

- 扩展性强:用户可以自定义 Operator 和 Hook,集成各种数据源和工具。

- 强大的 UI 界面:提供可视化界面监控任务状态、查看日志、重试失败任务等。

- 丰富的调度选项:支持基于时间 (Time-based) 和事件 (Event-based) 的调度。

- 高可用性:配合 Celery 和 Kubernetes 等执行器,支持分布式架构,适合处理大规模任务。

使用场景

数据管道调度

用于管理数据从源到目标的 ETL 流程。 如每天从数据库中抽取数据、清洗后存入数据仓库。

机器学习工作流管理

调度数据预处理、模型训练和模型部署任务。

数据验证

自动化检查数据的质量和一致性。

定期任务自动化

定时清理日志、归档数据或生成报告。

Airflow核心概念

DAGs

有向无环图(Directed Acyclic Graph),将所有需要运行的tasks按照依赖关系组织起来,描述的是所有tasks执行的顺序

Operators

Airflow内置了很多Operators

- BashOperator 执行一个Bash命令

- PythonOperator 调用任意的Python函数

- EmailOperator 用于发送邮件

- HTTPOperator 用于发送HTTP请求

- SqlOperator 用于执行SQL命令

- 自定义 Operator

Task

Task:Task是Operator的一个实例

Task Instance

Task Instance:由于Task会被重复调度,每次Tasks的运行就是不同的Task Instance,Task Instance 有自己的状态,包括 success、running、failed、skipped、up_for_rechedule、up_for_retry、queued、no_status等

Task Relationships

Task Relationships:DAGs中的不同Tasks之间可以有依赖关系

核心交易调度任务集成

核心交易分析

之前我们已经写了很多脚本,可以在这里调度

shell

# 加载ODS数据(DataX迁移数据)

/opt/wzk/hive/ods_load_trade.sh

# 加载DIM层数据

/opt/wzk/hive/dim_load_product_cat.sh

/opt/wzk/hive/dim_load_shop_org.sh

/opt/wzk/hive/dim_load_payment.sh

/opt/wzk/hive/dim_load_product_info.sh

# 加载DWD层数据

/opt/wzk/hive/dwd_load_trade_orders.sh

# 加载DWS层数据

/opt/wzk/hive/dws_load_trade_orders.sh

# 加载ADS层数据

/opt/wzk/hive/ads_load_trade_order_analysis.sh备注:depeds_on_past,设置为True时,上一次调度成功时,才可以触发

编写脚本

shell

vim $AIRFLOW_HOME/dags/trade_test.py写入的内容如下所示:

python

import datetime

from datetime import timedelta, date

from airflow import DAG

from airflow.operators.bash_operator import BashOperator

from airflow.utils.dates import days_ago

# 定义 DAG 的缺省参数

default_args = {

'owner': 'airflow',

'depends_on_past': False,

'start_date': datetime.datetime(2020, 6, 20),

'email': ['airflow@example.com'],

'email_on_failure': False,

'email_on_retry': False,

'retries': 1,

'retry_delay': timedelta(minutes=5),

}

# 定义 DAG

coretradedag = DAG(

'coretrade',

default_args=default_args,

description='Core trade analyze',

schedule_interval='30 0 * * *', # 每天00:30运行

)

# 获取昨天的日期

today = date.today()

oneday = timedelta(days=1)

yesterday = (today - oneday).strftime("%Y-%m-%d")

# 定义任务

odstask = BashOperator(

task_id='ods_load_data',

depends_on_past=False,

bash_command=f'sh /opt/wzk/hive/ods_load_trade.sh {yesterday}',

dag=coretradedag,

)

dimtask1 = BashOperator(

task_id='dimtask_product_cat',

depends_on_past=False,

bash_command=f'sh /opt/wzk/hive/dim_load_product_cat.sh {yesterday}',

dag=coretradedag,

)

dimtask2 = BashOperator(

task_id='dimtask_shop_org',

depends_on_past=False,

bash_command=f'sh /opt/wzk/hive/dim_load_shop_org.sh {yesterday}',

dag=coretradedag,

)

dimtask3 = BashOperator(

task_id='dimtask_payment',

depends_on_past=False,

bash_command=f'sh /opt/wzk/hive/dim_load_payment.sh {yesterday}',

dag=coretradedag,

)

dimtask4 = BashOperator(

task_id='dimtask_product_info',

depends_on_past=False,

bash_command=f'sh /opt/wzk/hive/dim_load_product_info.sh {yesterday}',

dag=coretradedag,

)

dwdtask = BashOperator(

task_id='dwd_load_data',

depends_on_past=False,

bash_command=f'sh /opt/wzk/hive/dwd_load_trade_orders.sh {yesterday}',

dag=coretradedag,

)

dwstask = BashOperator(

task_id='dws_load_data',

depends_on_past=False,

bash_command=f'sh /opt/wzk/hive/dws_load_trade_orders.sh {yesterday}',

dag=coretradedag,

)

adstask = BashOperator(

task_id='ads_load_data',

depends_on_past=False,

bash_command=f'sh /opt/wzk/hive/ads_load_trade_order_analysis.sh {yesterday}',

dag=coretradedag,

)

# 定义任务依赖关系

odstask >> dimtask1

odstask >> dimtask2

odstask >> dimtask3

odstask >> dimtask4

odstask >> dwdtask

dimtask1 >> dwstask

dimtask2 >> dwstask

dimtask3 >> dwstask

dimtask4 >> dwstask

dwdtask >> dwstask

dwstask >> adstask执行的结果如下图所示:

查看结果

检查脚本的问题:

shell

# 执行命令检查脚本是否有错误。如果命令行没有报错,就表示没问题

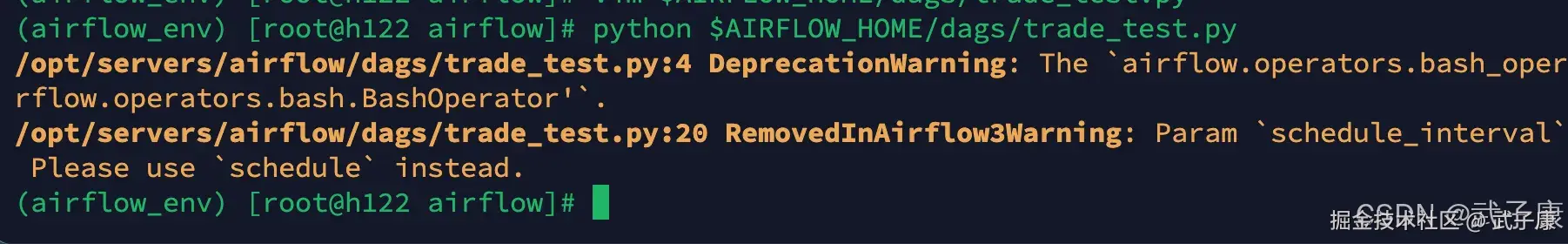

python $AIRFLOW_HOME/dags/trade_test.py执行结果如下图所示:

列出所有的内容

shell

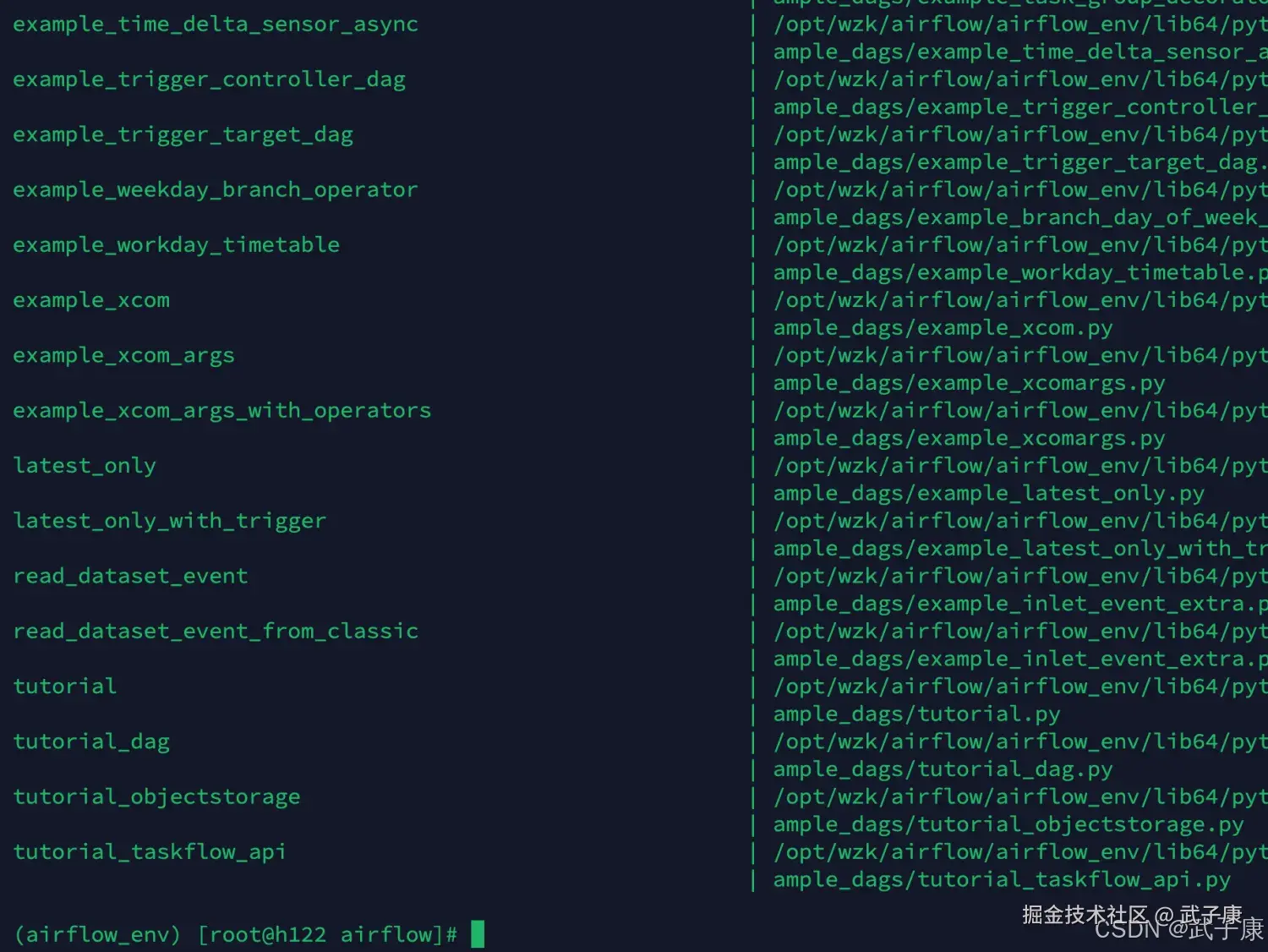

airflow dags list运行结果如下图所示:

列出树形结构:

shell

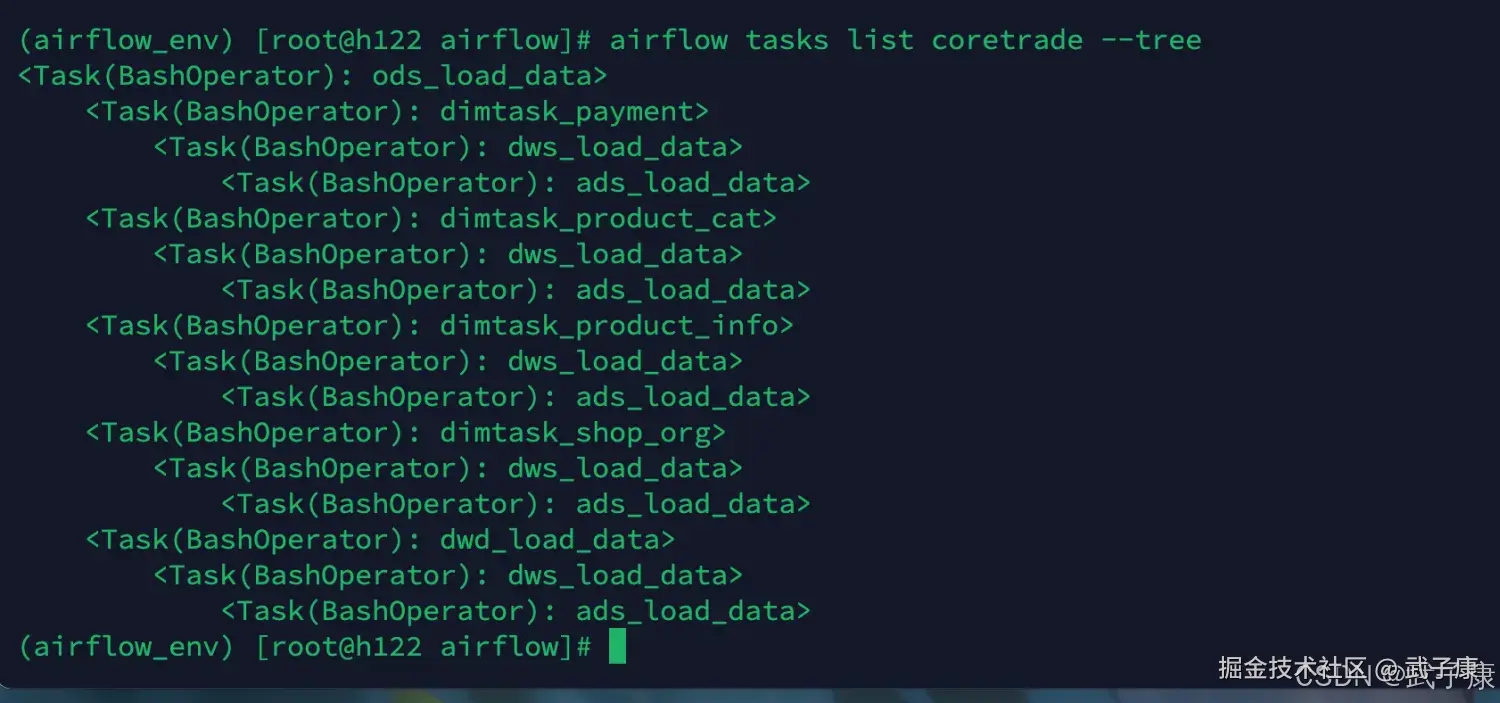

airflow tasks list coretrade --tree执行结果如下图所示:

shell

(airflow_env) [root@h122 airflow]# airflow tasks list coretrade --tree

<Task(BashOperator): ods_load_data>

<Task(BashOperator): dimtask_payment>

<Task(BashOperator): dws_load_data>

<Task(BashOperator): ads_load_data>

<Task(BashOperator): dimtask_product_cat>

<Task(BashOperator): dws_load_data>

<Task(BashOperator): ads_load_data>

<Task(BashOperator): dimtask_product_info>

<Task(BashOperator): dws_load_data>

<Task(BashOperator): ads_load_data>

<Task(BashOperator): dimtask_shop_org>

<Task(BashOperator): dws_load_data>

<Task(BashOperator): ads_load_data>

<Task(BashOperator): dwd_load_data>

<Task(BashOperator): dws_load_data>

<Task(BashOperator): ads_load_data>

(airflow_env) [root@h122 airflow]#对应的截图如下:

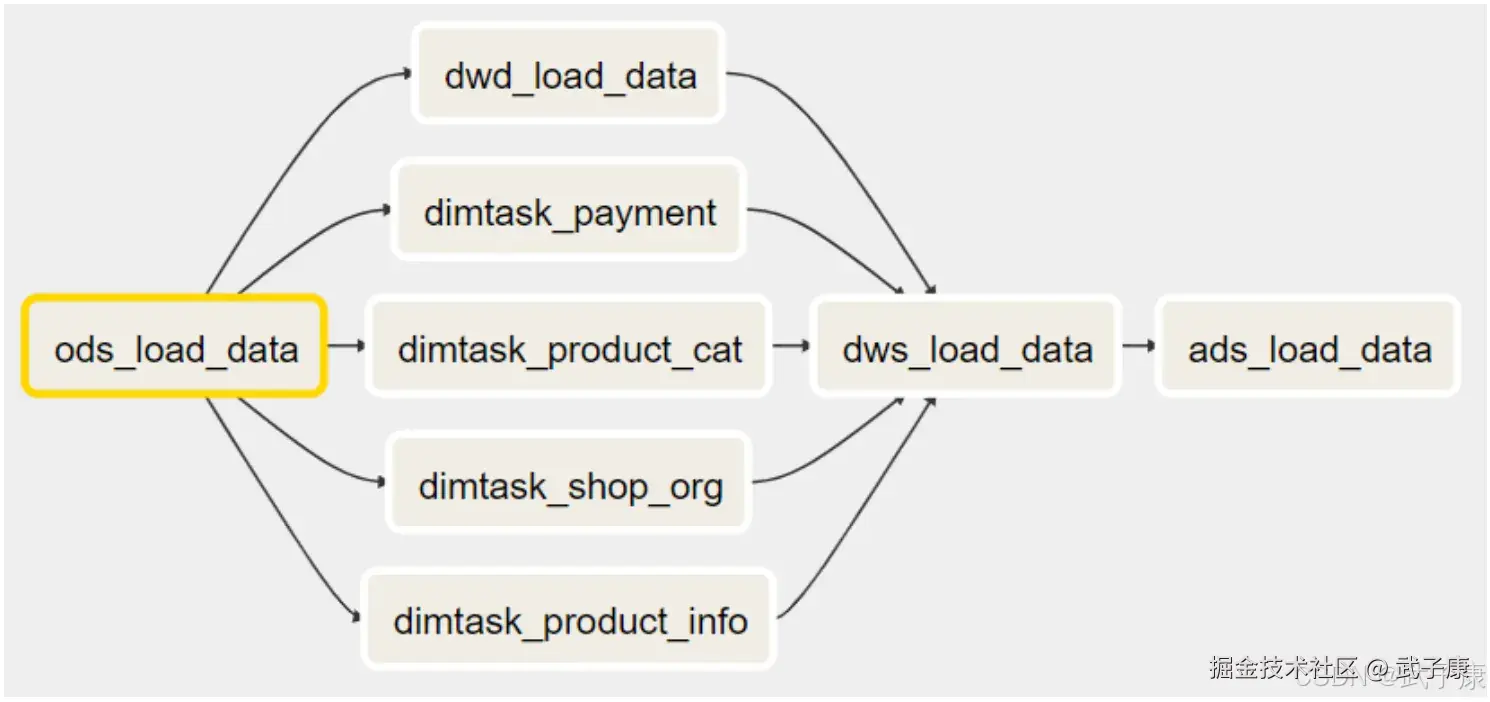

关系图如下:

错误速查卡

| 症状 | 根因 | 定位 | 修复 | |

|---|---|---|---|---|

| DAG 语法检查报错 | Python 代码存在语法错误 | 运行 python $AIRFLOW_HOME/dags/dag_file.py |

检查 Python 语法,确保 import 正确 | |

| 任务一直处于 queued 状态 | Celery worker 未启动或连接失败 | 检查 Celery executor 和 Redis 连接 | 启动 worker:airflow celery worker |

|

| 任务失败后不重试 | retries 参数为 0 或 email_on_failure 配置错误 |

查看任务日志中的重试次数 | 设置 retries: 1 并配置正确邮箱 |

|

| 任务依赖未生效 | depends_on_past 设置错误或时间窗口冲突 |

检查 DAG 中任务的依赖链 | 确保依赖任务已完成再触发下游任务 | |

| schedule_interval 不生效 | start_date 设置在未来或时区问题 |

检查 start_date 和时区配置 |

修正 start_date 为过去时间或检查时区 |

|

| Web UI 无法访问 | Airflow webserver 未启动或端口被占用 | 检查进程:`ps aux | grep airflow` | 启动 webserver:airflow webserver -p 8080 |