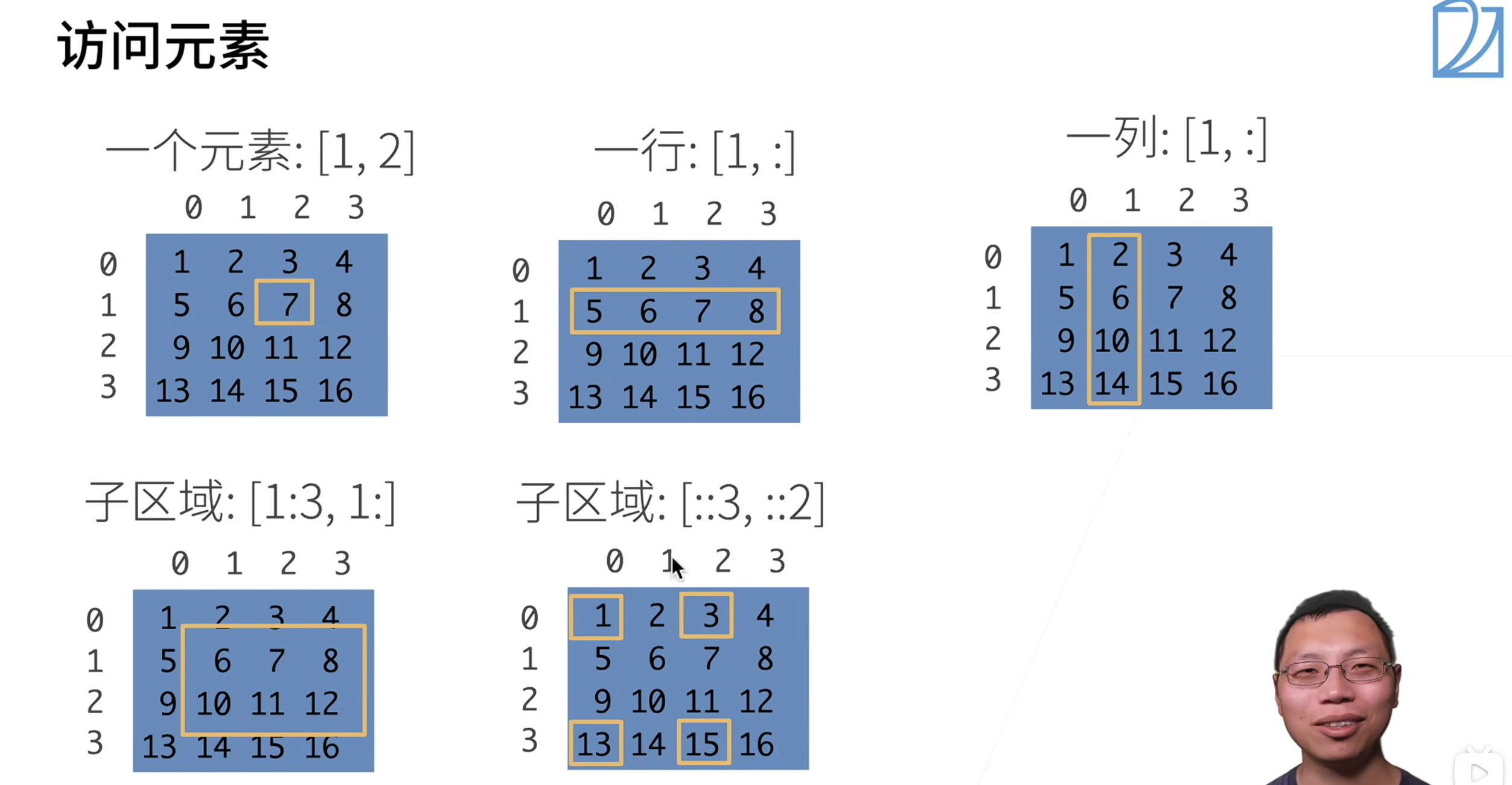

数据操作

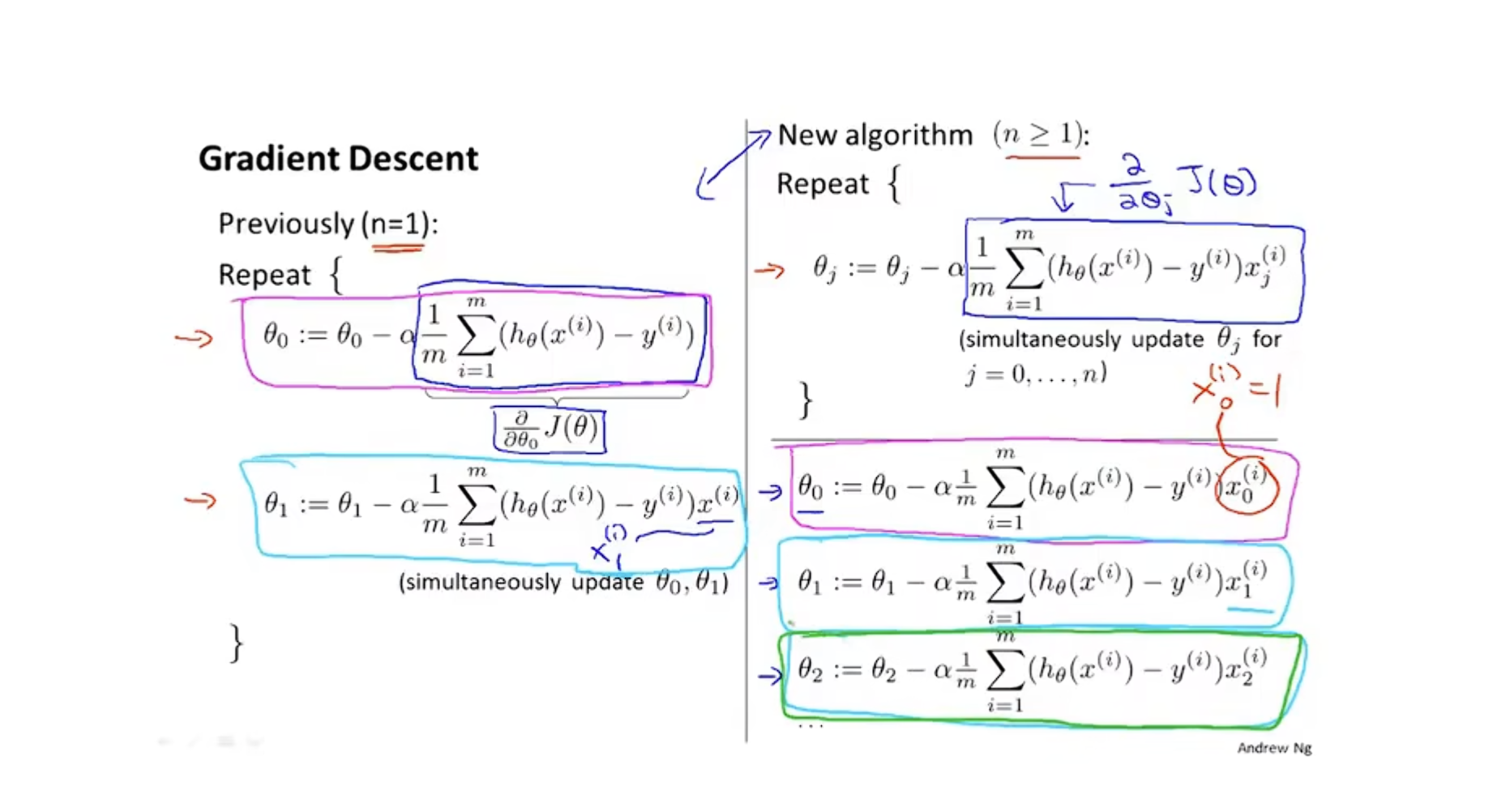

梯度下降算法

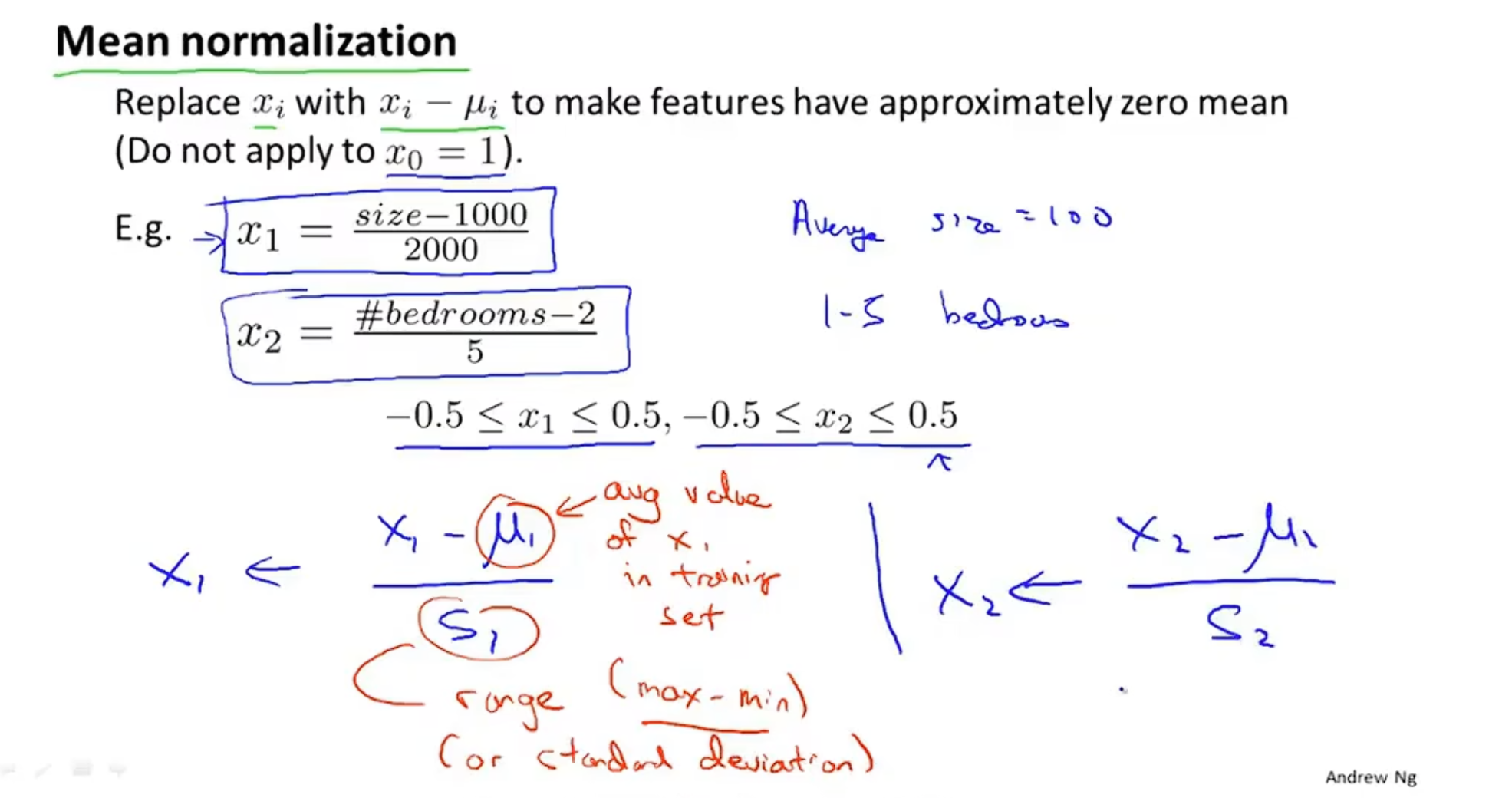

特征值取值范围越接近,梯度下降越快

所以我们将特征值约束到-1,1的范围内

特征缩放

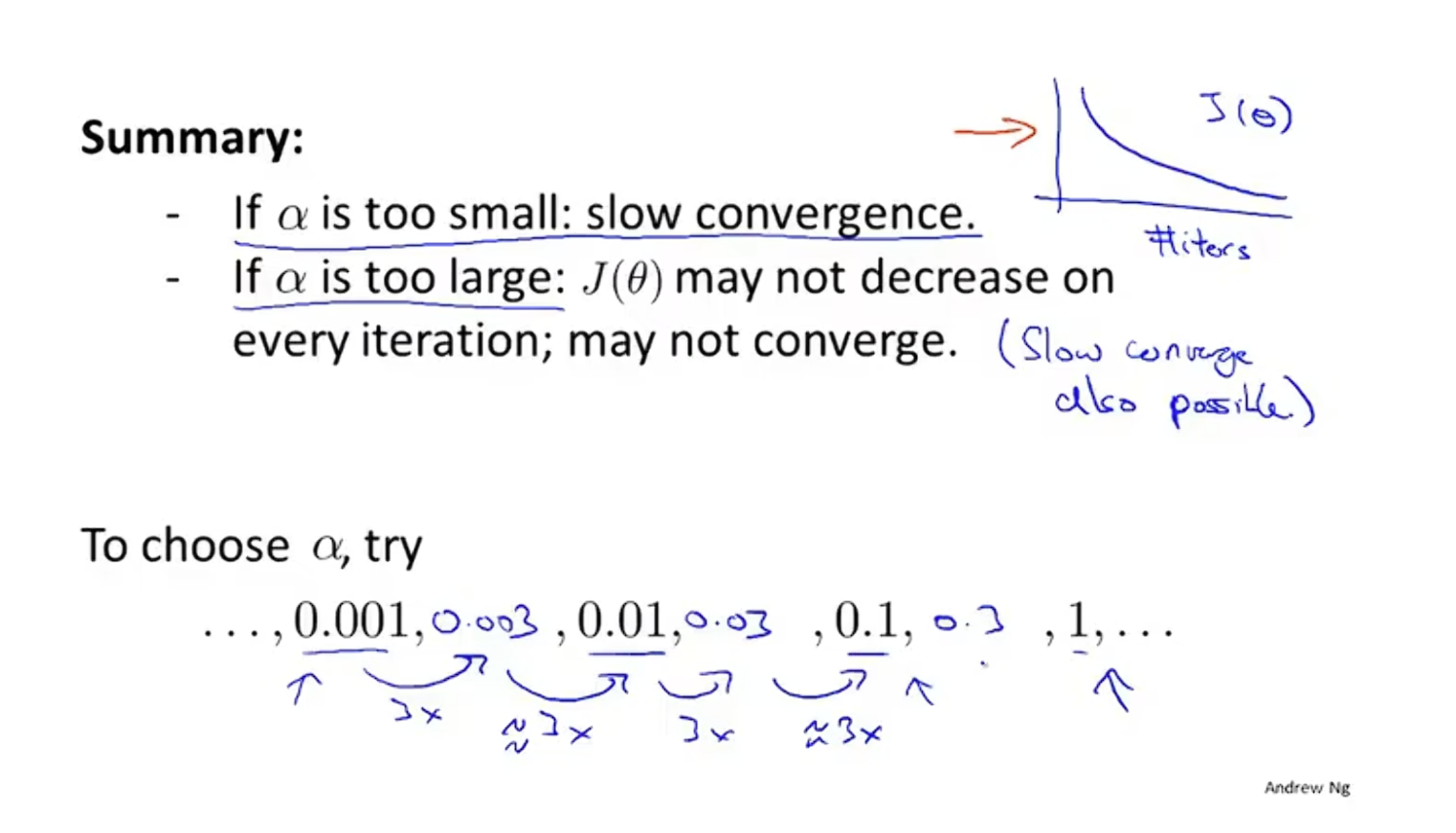

学习率太大,收敛快,但是可能导致损失函数迭代后升高,学习率小,收敛太慢

学习率一般取3的倍数

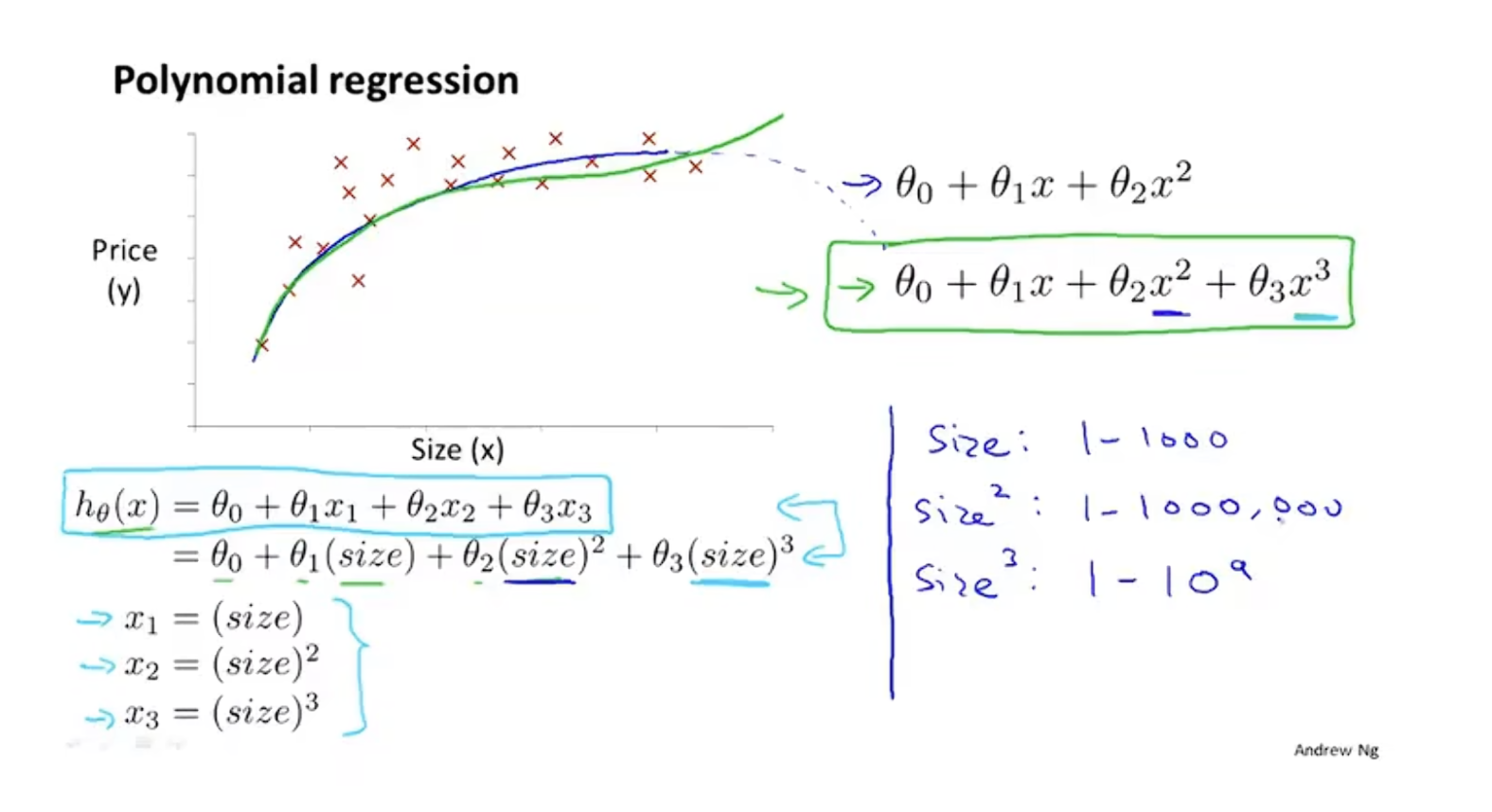

多元线性回归,我们的回归式不只是单一的一元函数,也可采取二次方,三次方等式子

高次的时候,特征缩放就很重要了,合适特征

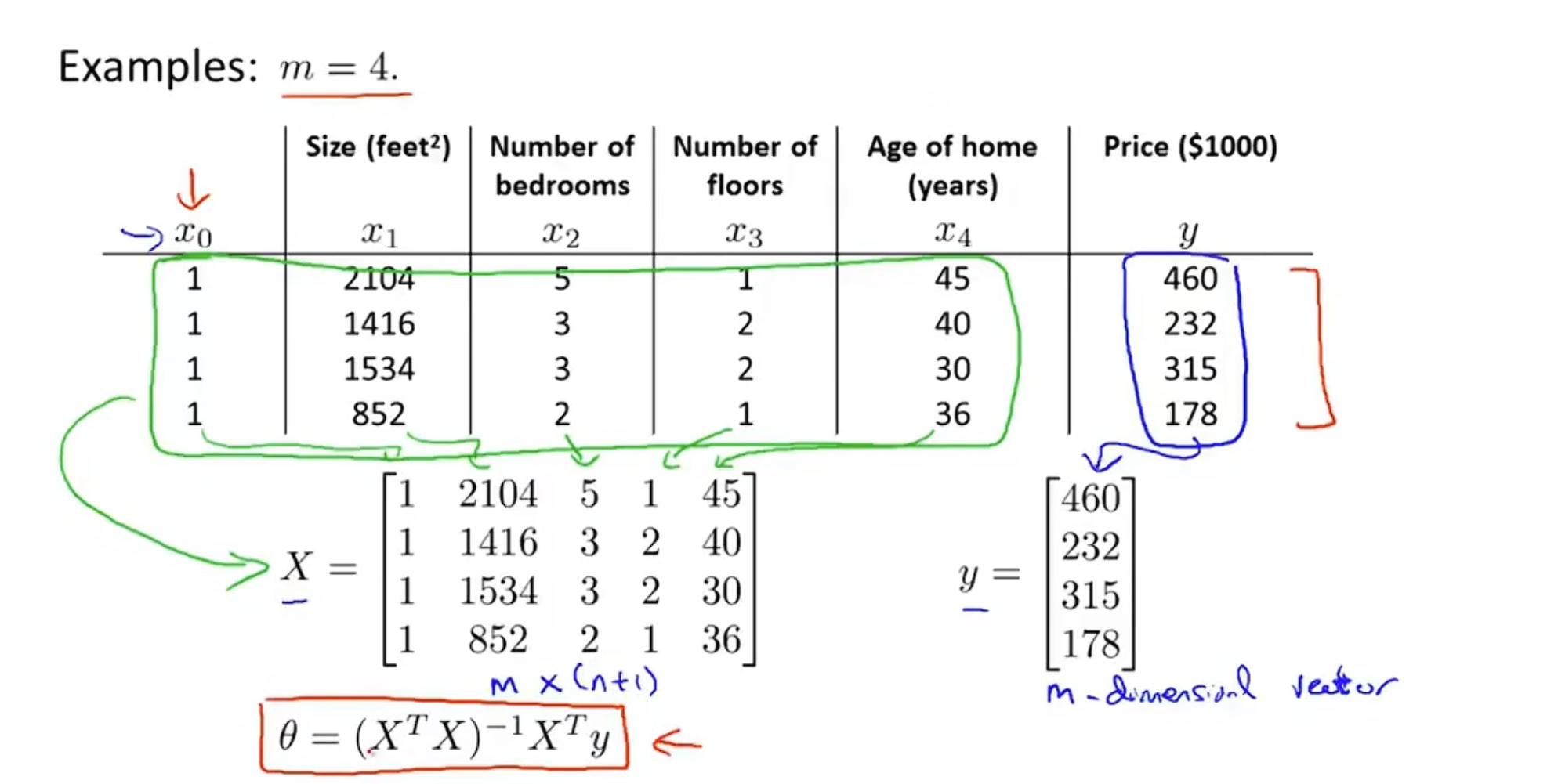

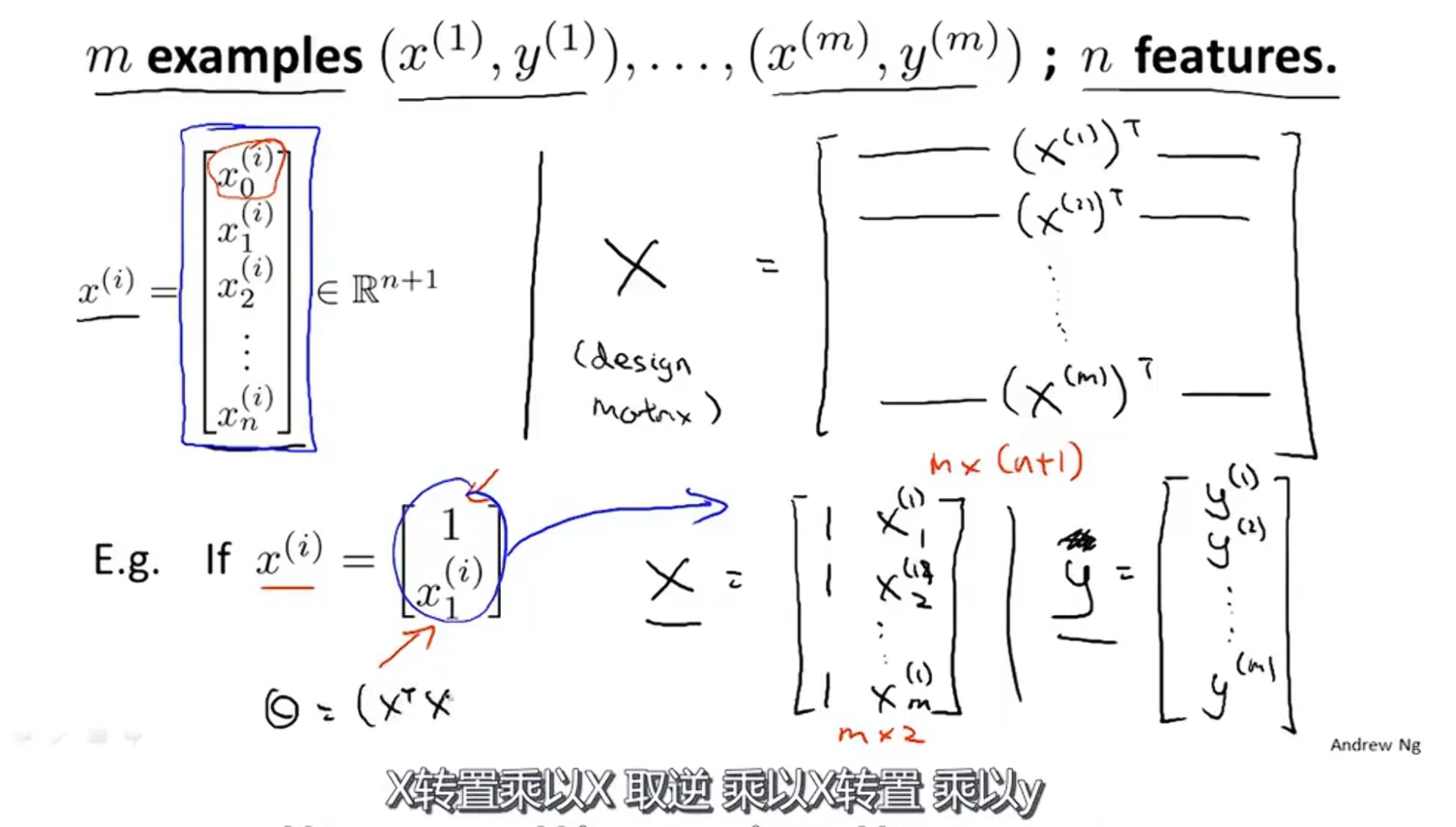

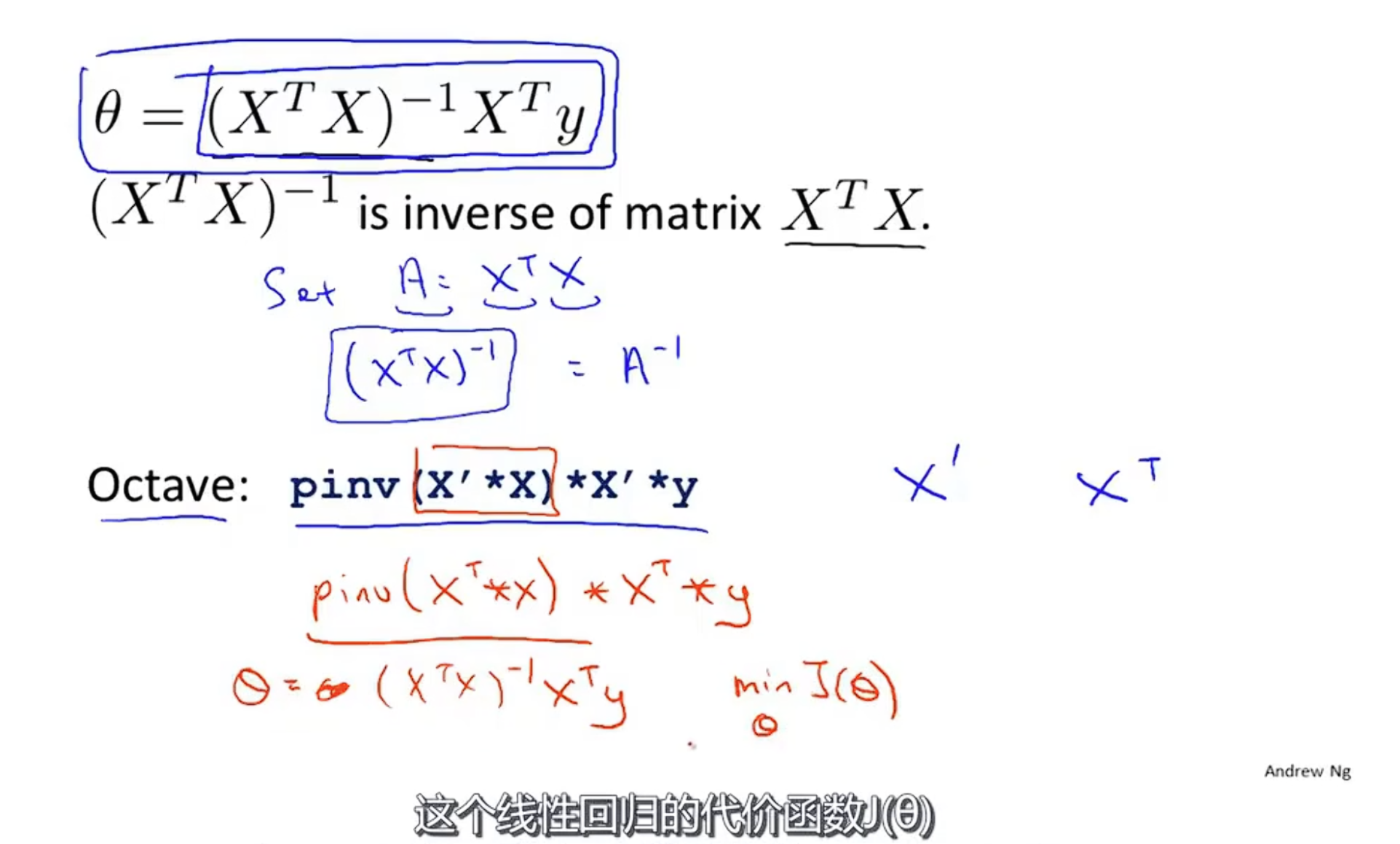

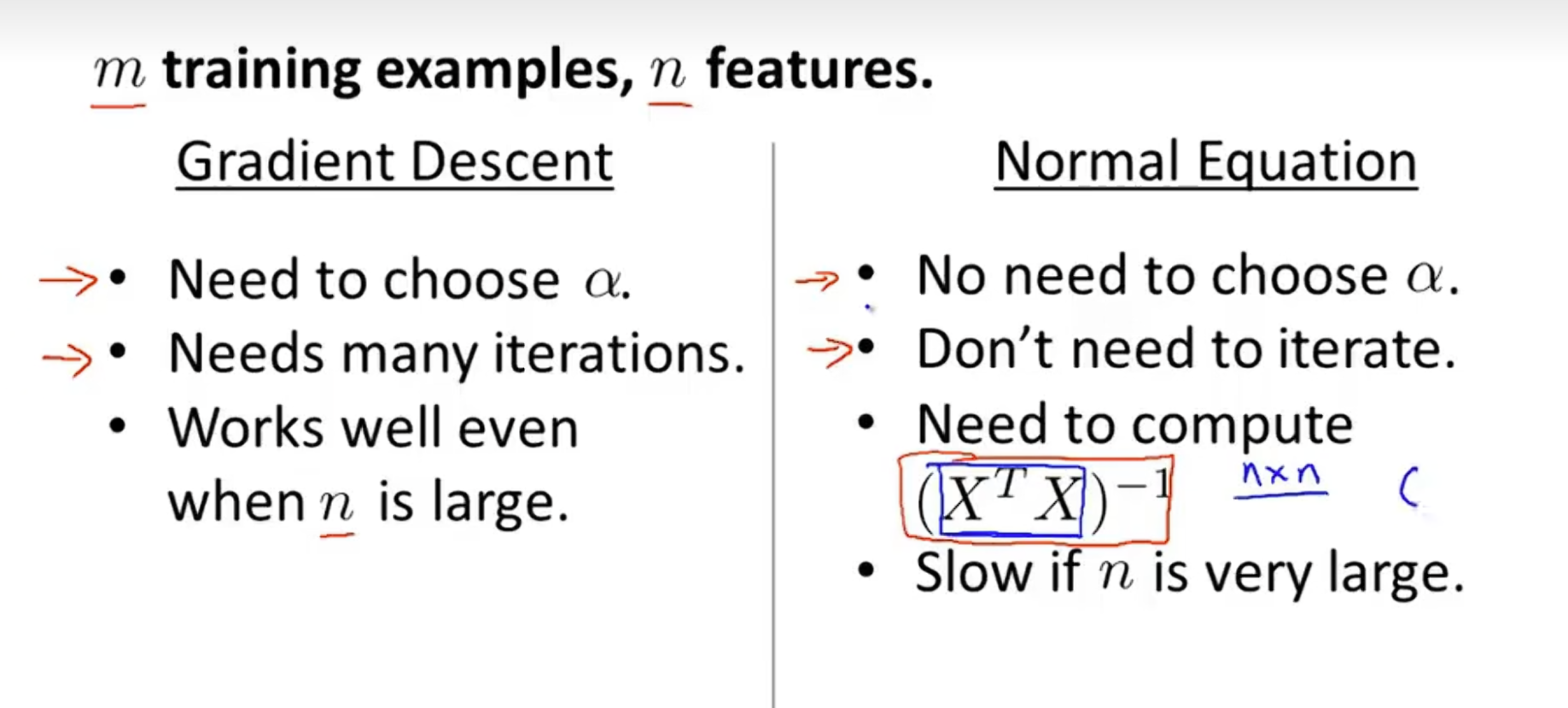

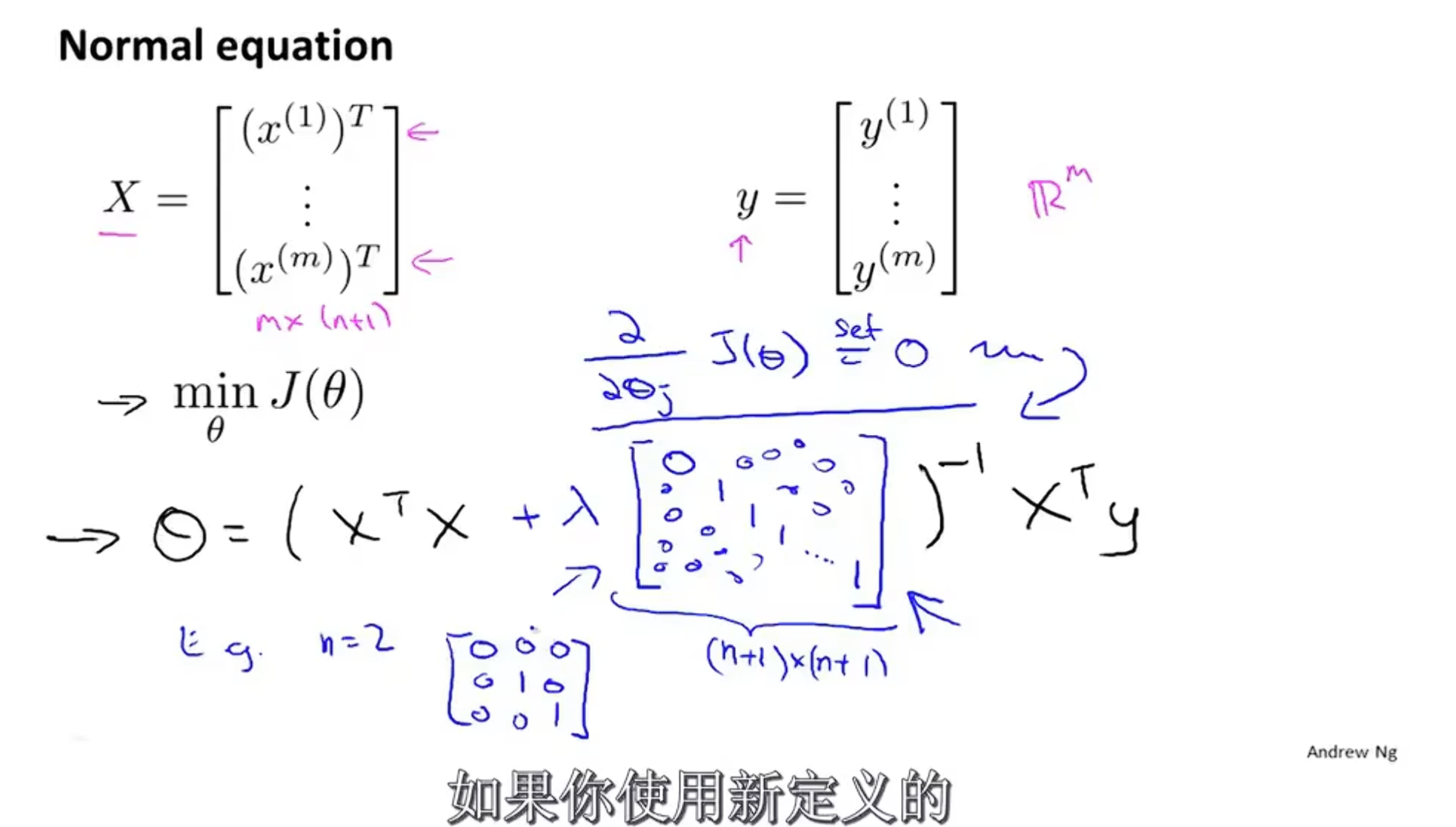

正规方程求解,无需考虑学习率和导数

在高维时,不用逐个求导置零,只需要列出矩阵

可以求得代价函数最小值

二者的差别

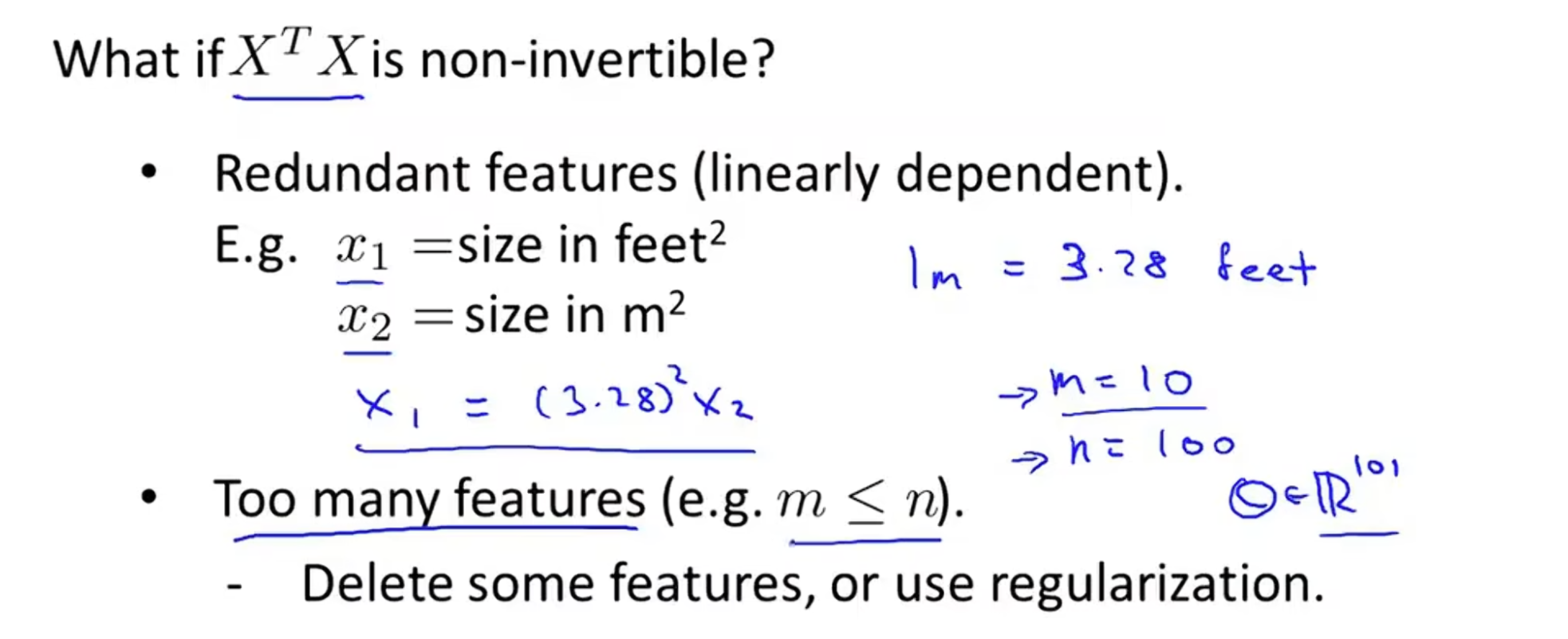

不可逆的原因:重复特征(线性相关)或者特征数大于量本数(正则化)

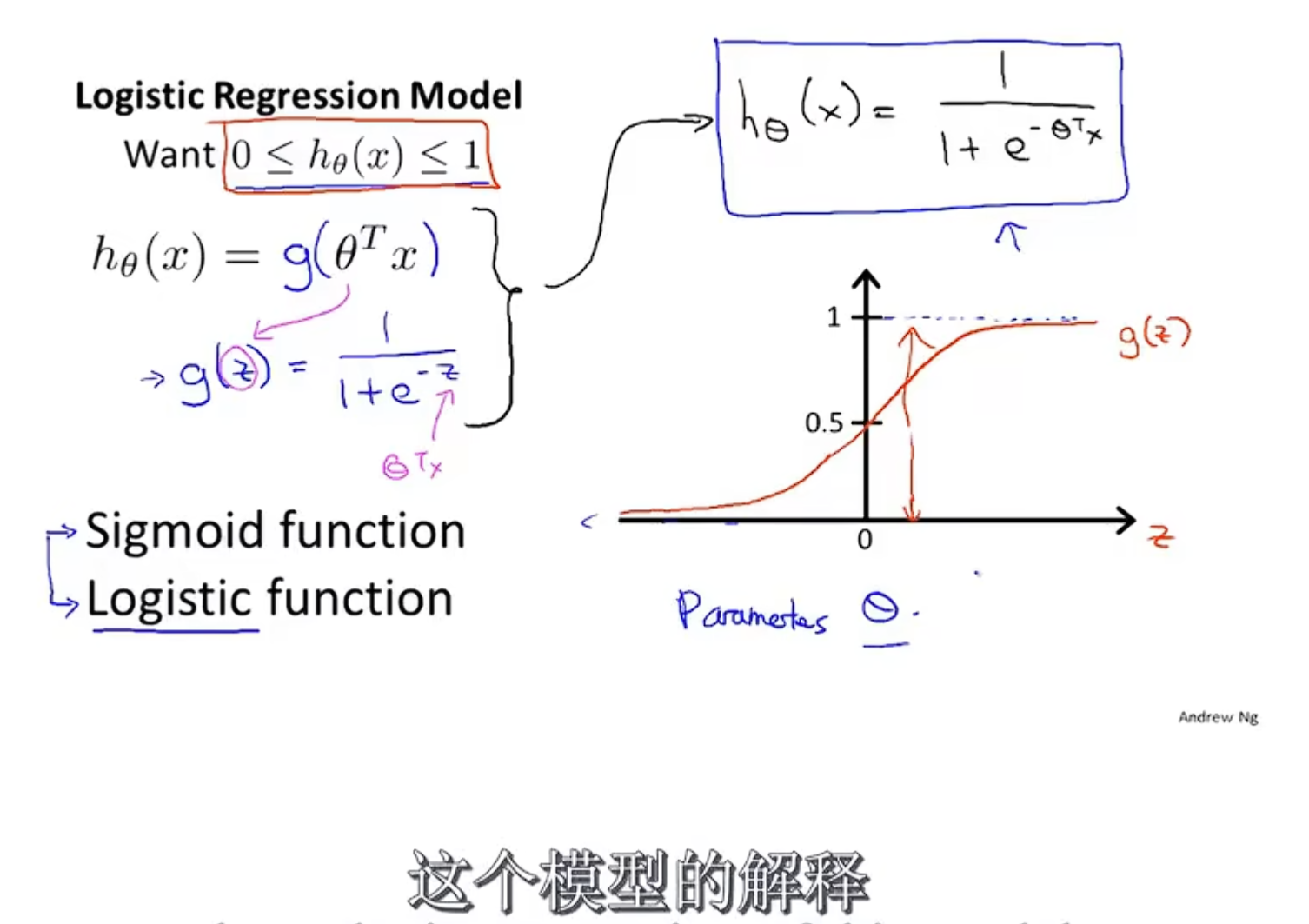

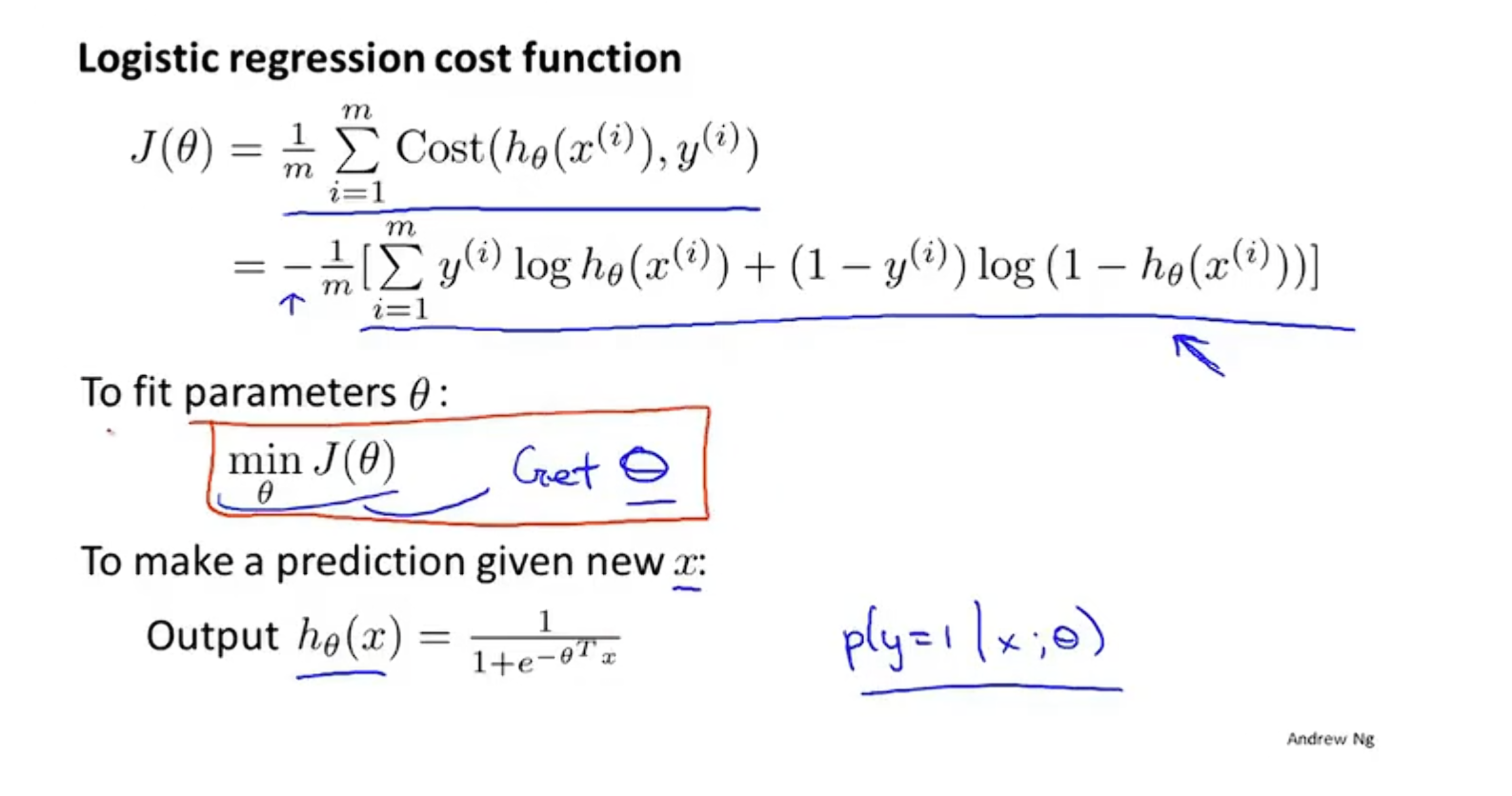

算法1:logistic回归\sigmod,二元0或1

算法详解

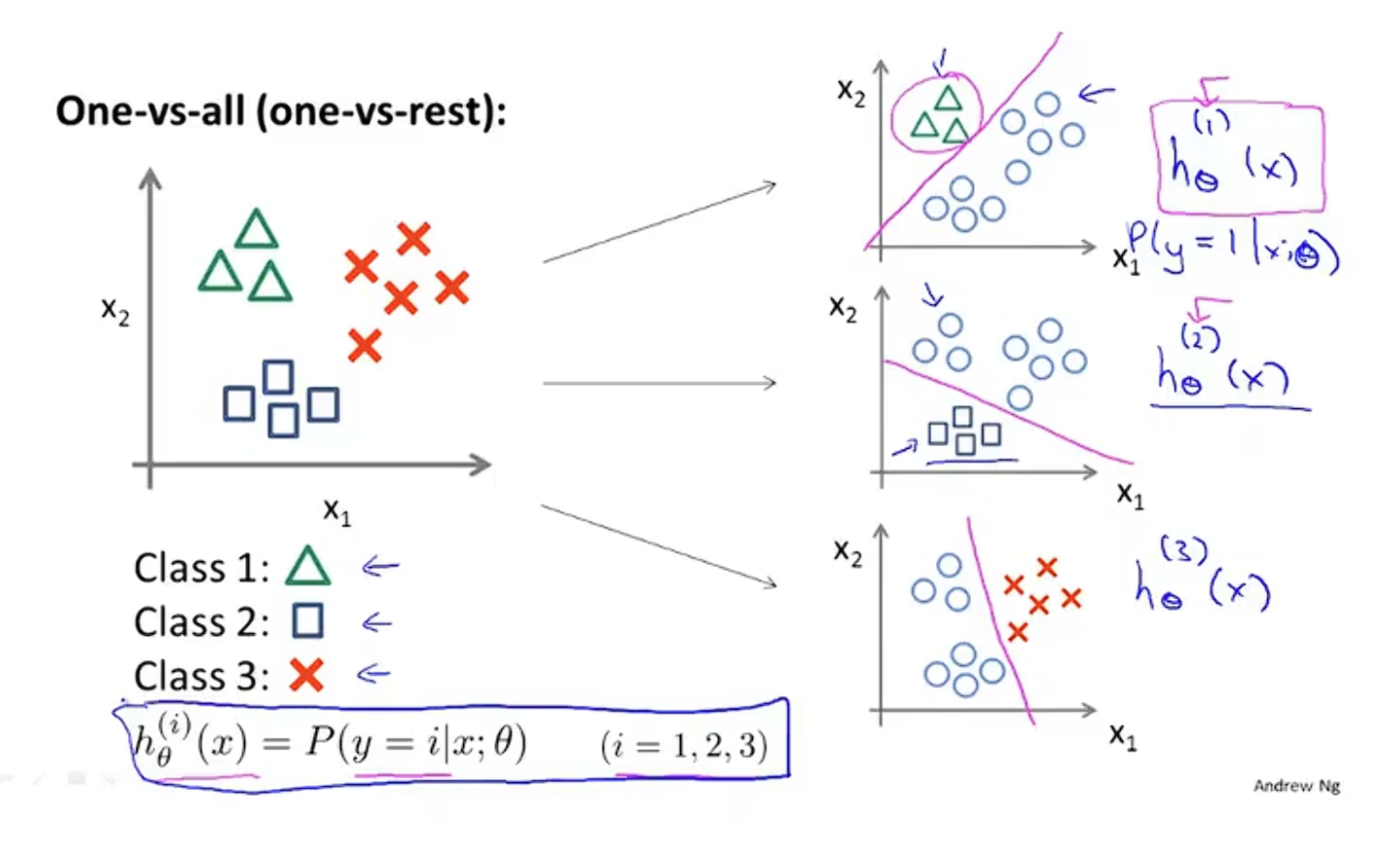

一对多问题:

将多个对象转化为一个和其他

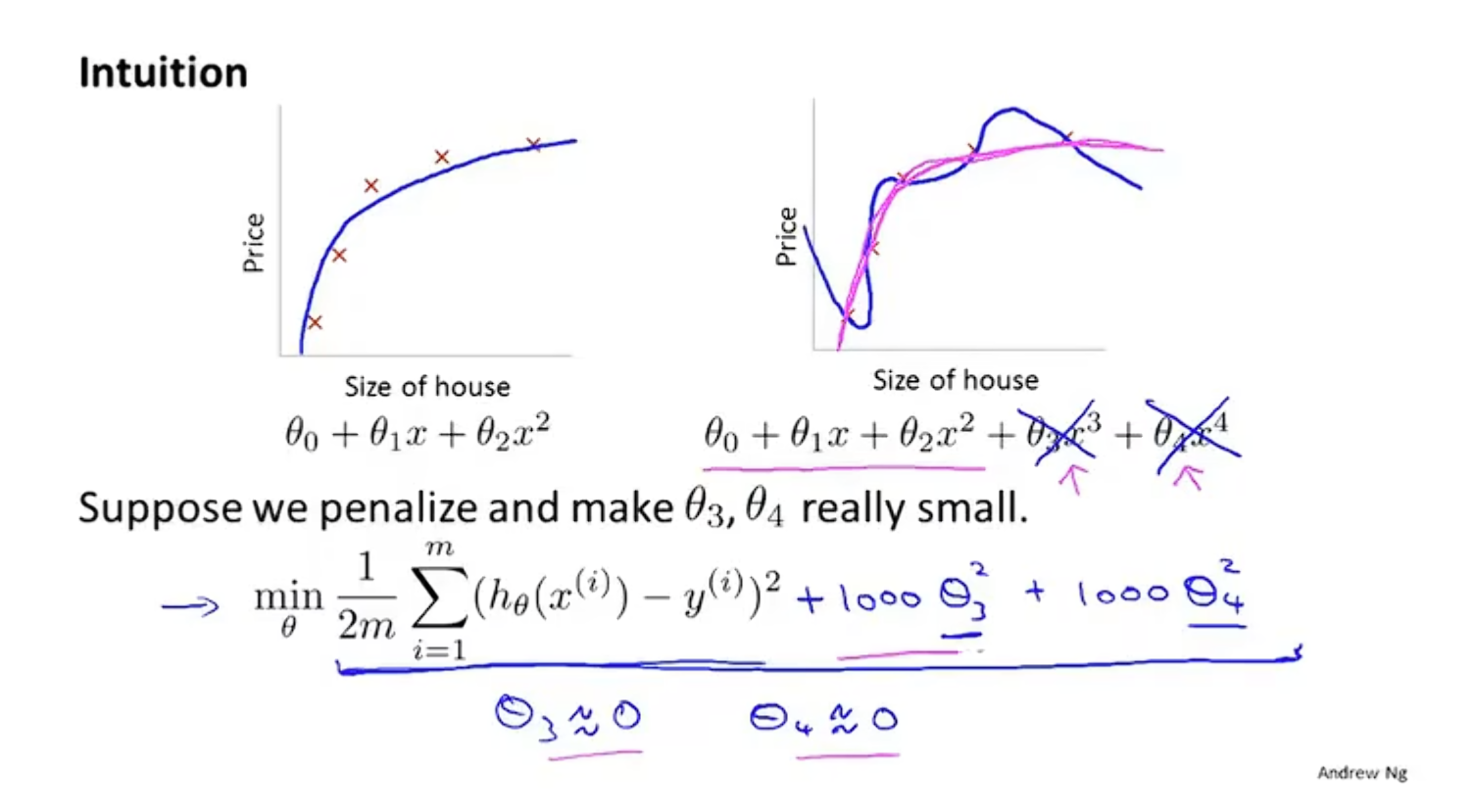

过拟合问题

方法1:减少选取变量的数量,缺点,舍弃了一些有用的变量

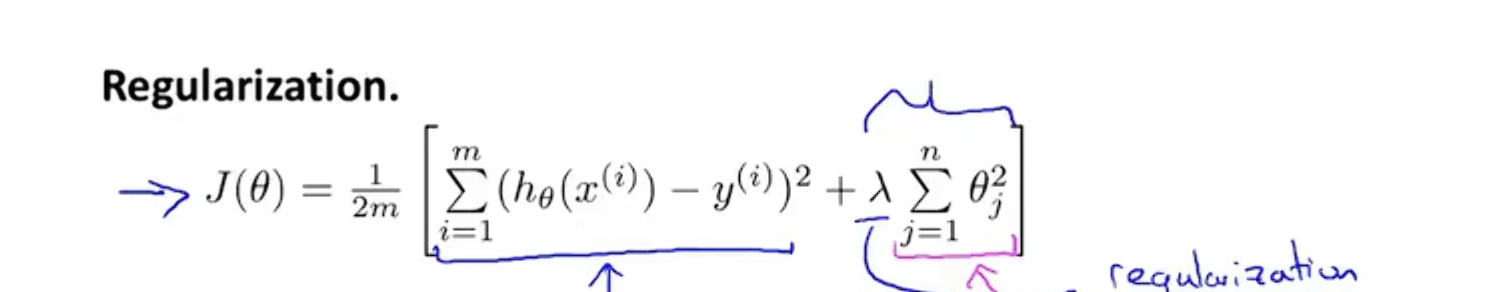

方法2:正则化,保留所有的变量,但降低次幂,或者改变参数theta_j的大小

正则化,令高阶的参数很小,加入正则化项(惩罚项)

注意lamda数值,过大则导致所有项都趋于零,欠拟合,拟合成一条直线

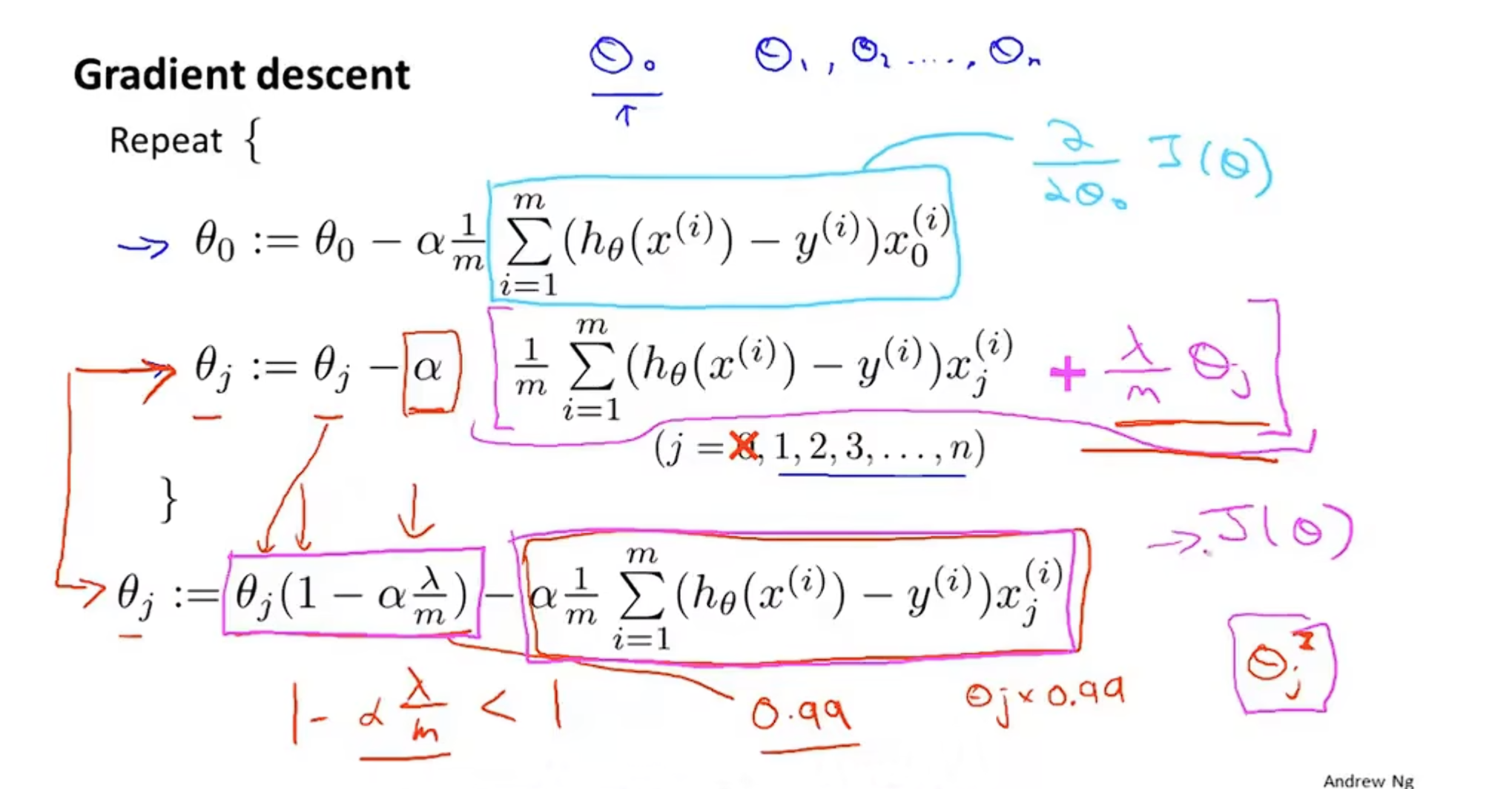

梯度下降正则化:

正规方程正则化

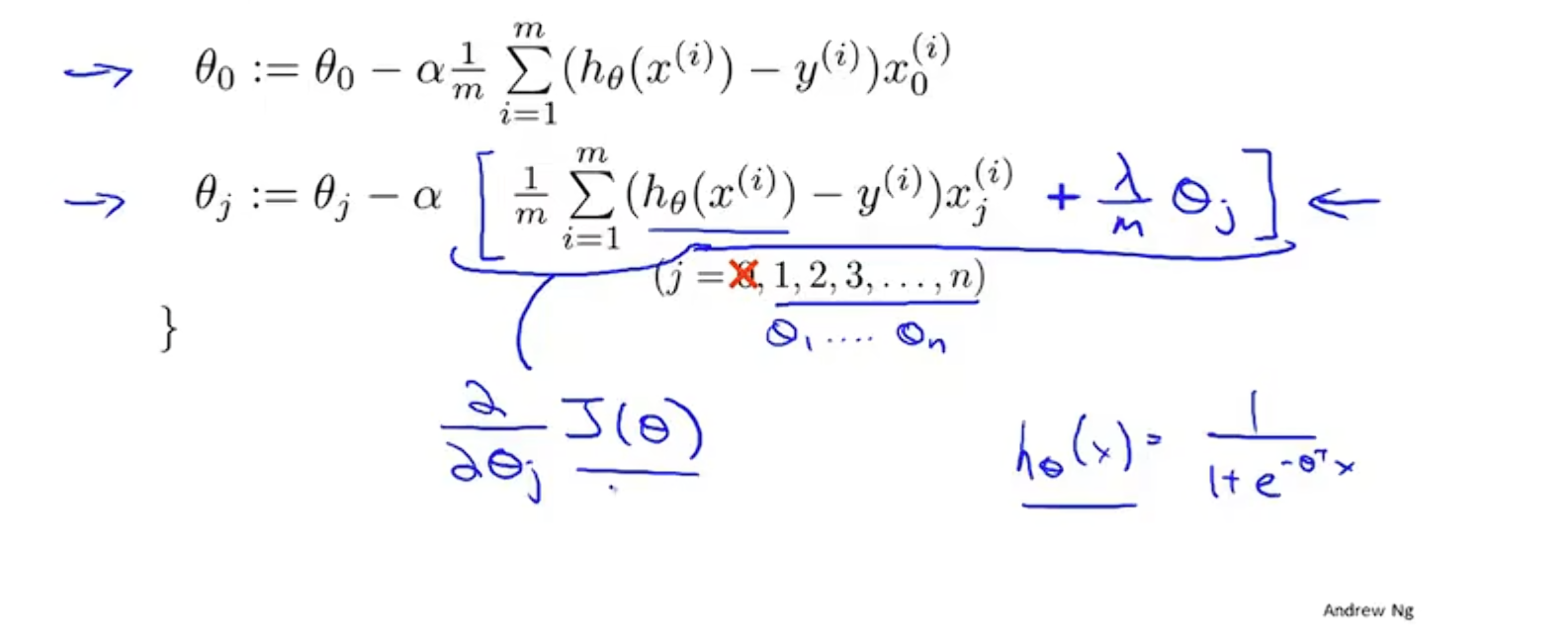

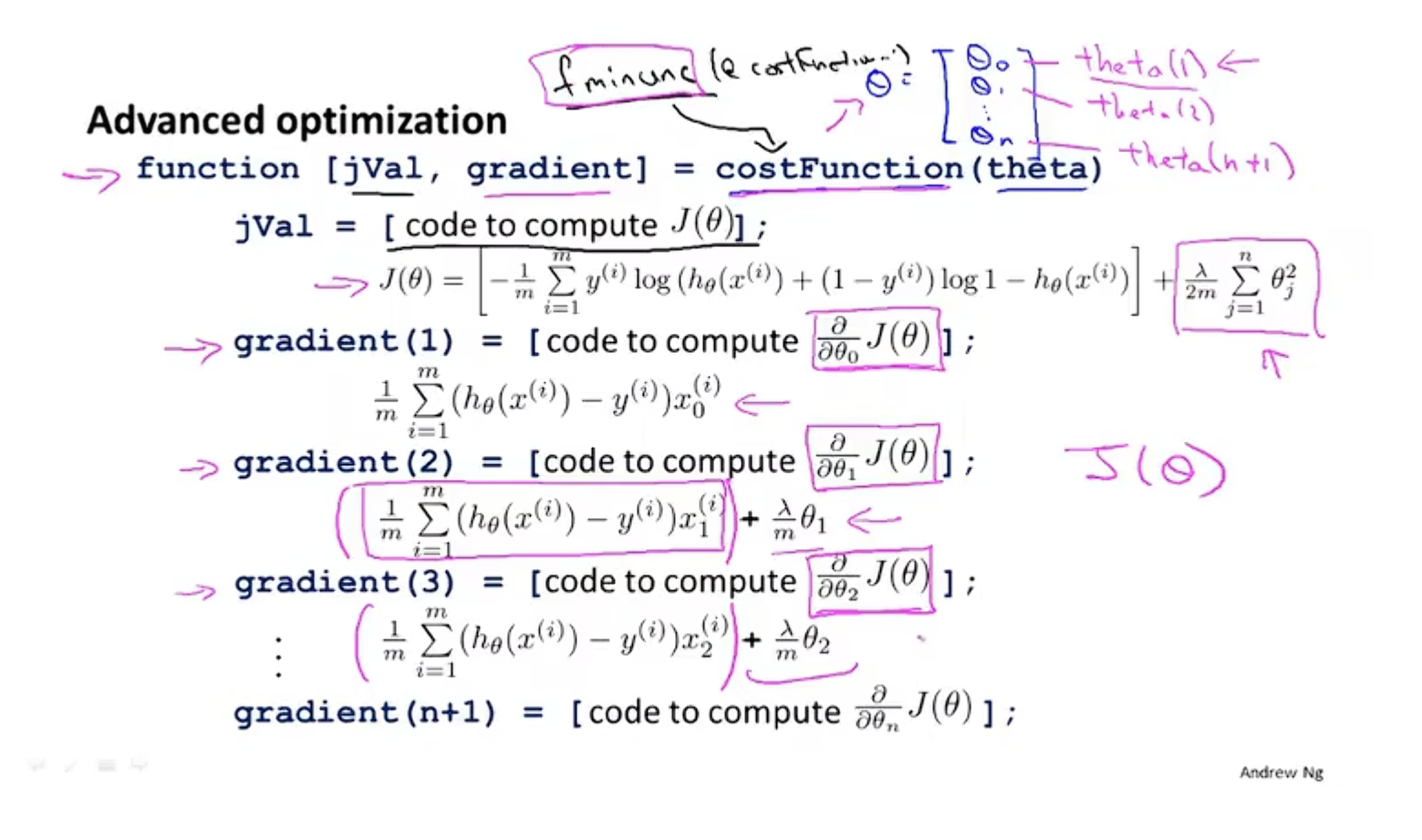

logistic正则化

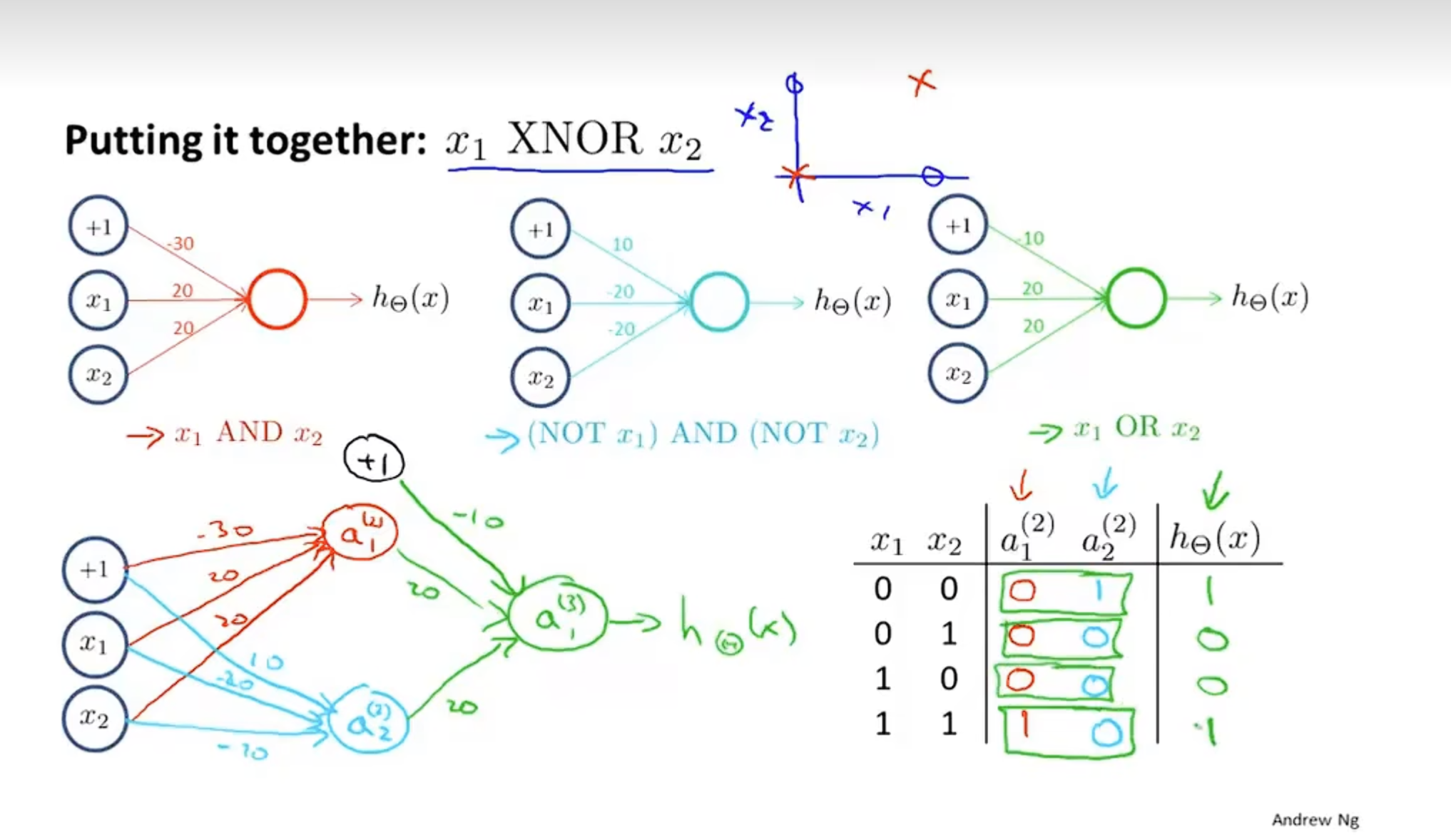

非线性假设

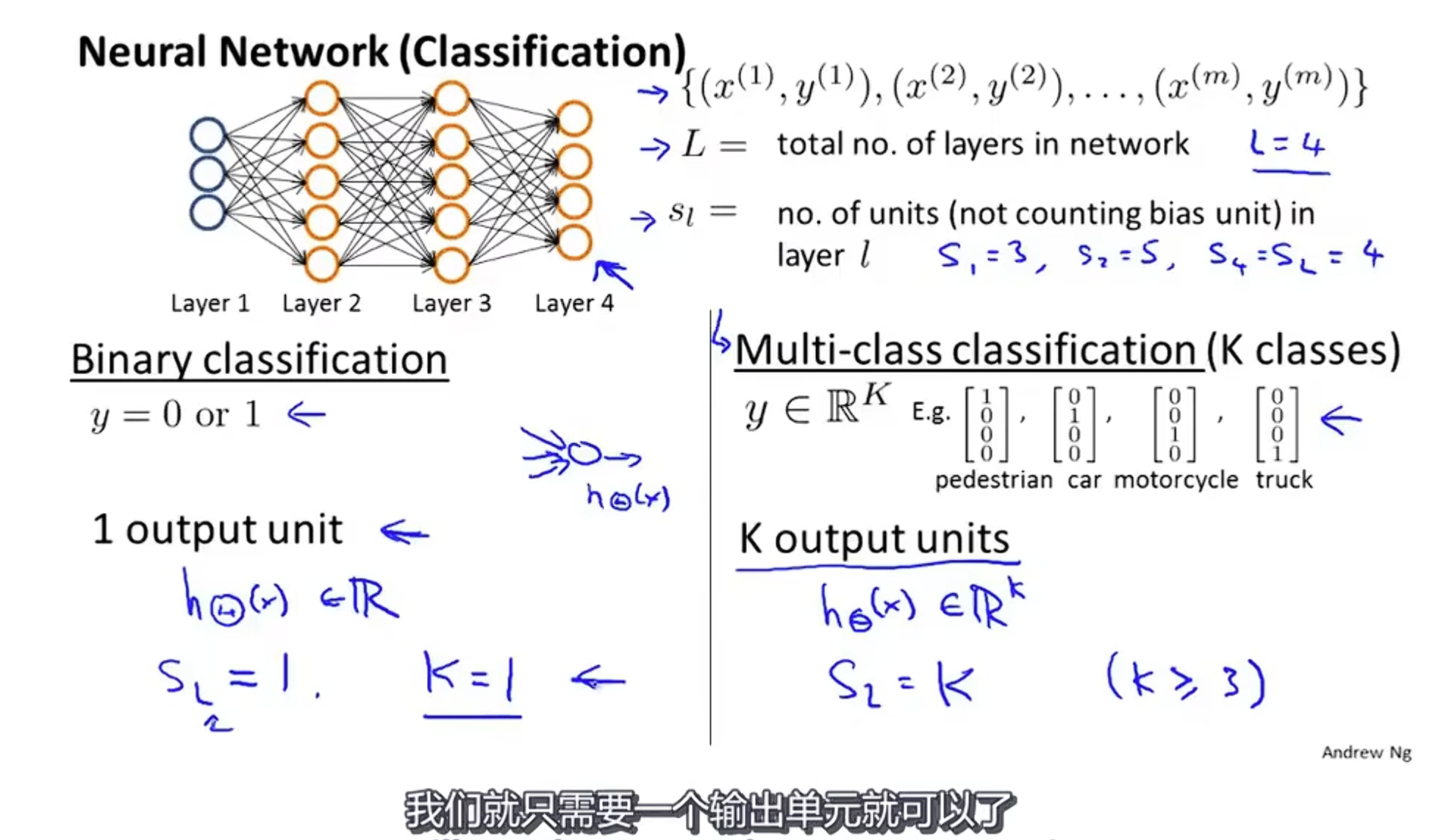

神经网络多分类方法

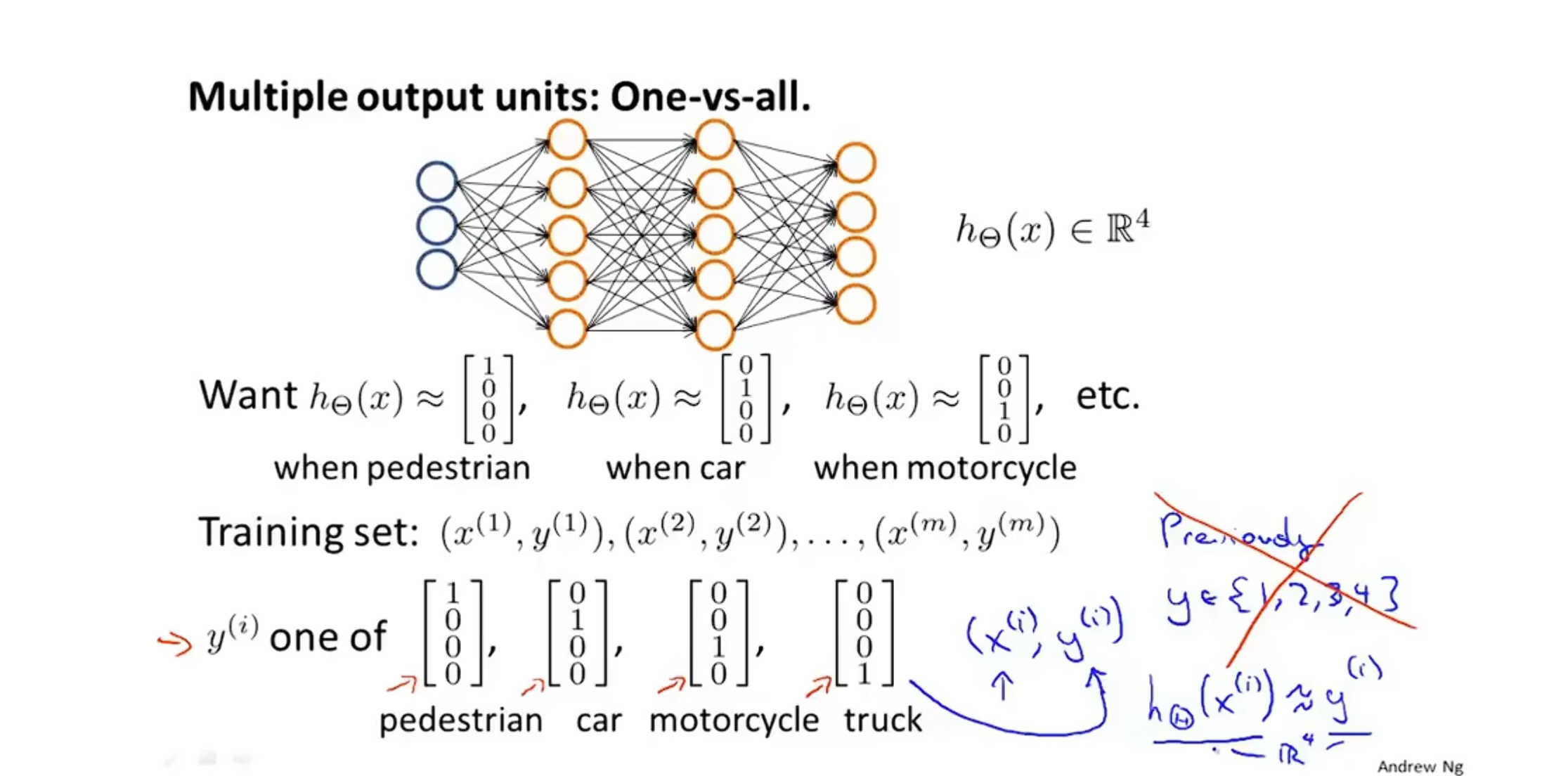

神经网络多元输出问题

二元分类,只有一个输出

当K元分类(K>=3),有K个输出