文章目录

一、什么是BatchNorm?

BatchNorm(Batch Normalization,批标准化)是2015年谷歌提出的深度学习"训练加速器+稳定器" ,像给每层神经网络数据"洗个标准化澡" 。它在mini-batch维度 上强制输入特征变成均值0、方差1 的"乖乖分布",再用可调参数 γ , β \gamma,\beta γ,β让网络** "化妆"恢复表达力** ,完美解决 "前层一改参数,后层全乱套"的 内部协变量偏移 问题,让深层网络 从训练地狱变训练天堂 ! ppl-ai-file-upload.s3.amazonaws

形象比喻:

原始数据 → [1.0, 2.0, 3.0, 100.0] # 分布畸形,像醉汉

BatchNorm后 → $[-0.5, -0.3, -0.1, +1.9]$ # 标准正态,像仪仗队1、Mini-batch是什么?

mini-batch 是训练时从大数据集中随机抽取的小批量样本 (32、64、128等),是BatchNorm统计的基础单位。

张量形状 : ( N , C , H , W ) (N,C,H,W) (N,C,H,W)

N: mini-batch大小 = 32张图片

C: 通道数 = 64个特征图

H,W: 空间尺寸BatchNorm统计维度 :在N维度上 ,对每个通道C统计32个样本的均值 μ B \mu_B μB和方差 σ B 2 \sigma_B^2 σB2。

2、为什么需要?"前层作妖,后层遭殃"

第1层学聪明 → 输出分布全变

第2层懵逼:"你这输入啥玩意?" → 重新学

第50层直接:NaN!训练崩!BatchNorm :我来管教,每层输入都规规矩矩!

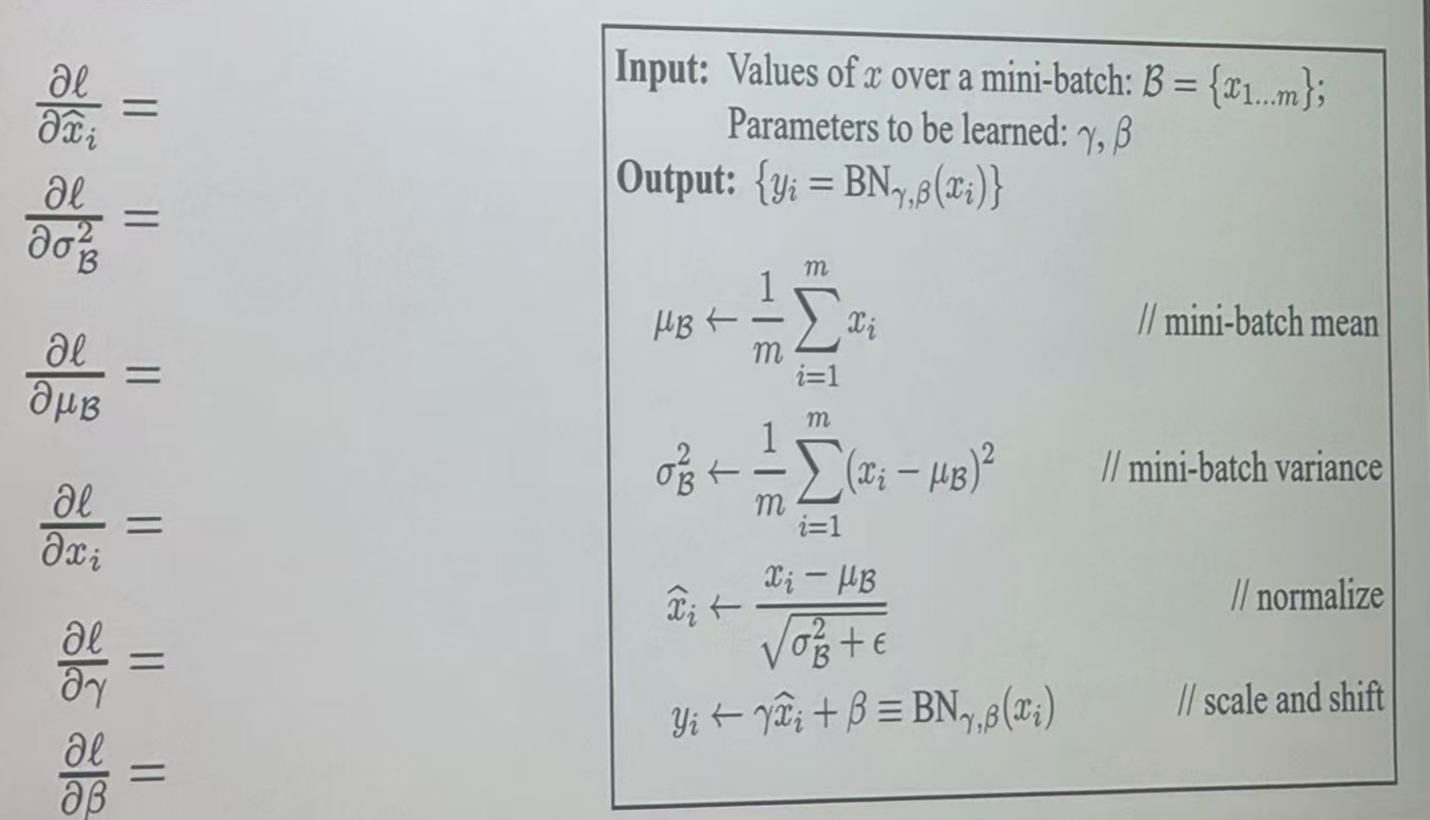

二、前向计算:4步"洗澡+化妆"流程

第1步:量体温(批均值)

μ B = 1 m ∑ i = 1 m x i \mu_B = \frac{1}{m}\sum_{i=1}^m x_i μB=m1i=1∑mxi

干啥 :统计32张猫图每个特征通道的平均体温,去整体偏移。

第2步:测体胖(批方差)

σ B 2 = 1 m ∑ i = 1 m ( x i − μ B ) 2 \sigma_B^2 = \frac{1}{m}\sum_{i=1}^m (x_i - \mu_B)^2 σB2=m1i=1∑m(xi−μB)2

干啥 :看这批数据胖瘦程度,方差大=变化剧烈。

第3步:洗澡(标准化)★核心

x ^ i = x i − μ B σ B 2 + ϵ \hat{x}_i = \frac{x_i - \mu_B}{\sqrt{\sigma_B^2 + \epsilon}} x^i=σB2+ϵ xi−μB

三板斧:

- 减均值:全体"减肥"到0

- 除方差:全体"塑形"到标准身材(方差=1)

- 防除零 : ϵ = 10 − 5 \epsilon=10^{-5} ϵ=10−5

第4步:化妆(仿射变换)★关键

y i = γ x ^ i + β y_i = \gamma \hat{x}_i + \beta yi=γx^i+β

为什么需要化妆?前3步把网络"洗傻了"!

没化妆场景:

标准化后 → [-0.3, 0.1, -1.2, 0.4] # 太规矩!

ReLU([-0.3, 0.1, -1.2, 0.4]) = [0, 0.1, 0, 0.4] # 表达力被锁死化妆后:

γ=[2.1, 0.8, 0.5, 1.5], β=[0.5, 0.5, 0.5, 0.5]

y = [-0.13, 0.58, -0.5, 1.1] # 分布自由!

ReLU(y) = [0, 0.58, 0, 1.1] # 网络能学复杂关系γ , β \gamma,\beta γ,β作用:

- γ \gamma γ :放大/缩小特征重要性

- β \beta β :调整最终分布

- 比喻:从"标准化工服"到"个性化西装"

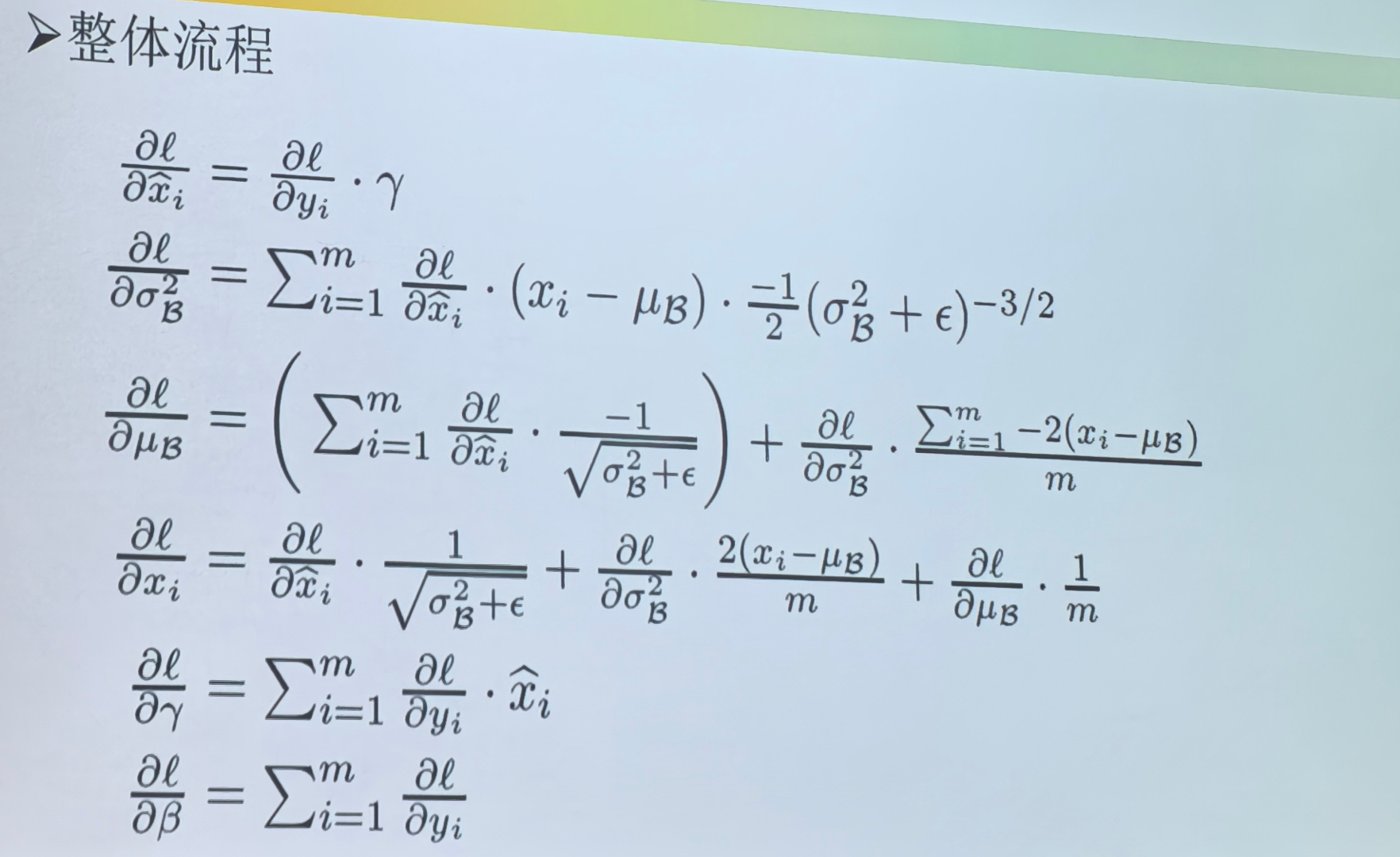

三、反向传播:6步梯度推导

工程神式 :

∂ ℓ ∂ x i = γ m σ B 2 + ϵ ∂ ℓ / ∂ y i − 批均值 − x \^ i ⋅ 批协方差 \frac{\partial \ell}{\partial x_i} = \frac{\gamma}{m\sqrt{\sigma_B^2+\epsilon}} \\partial \\ell/\\partial y_i - \\text{批均值} - \\hat{x}_i \\cdot \\text{批协方差} ∂xi∂ℓ=mσB2+ϵ γ∂ℓ/∂yi−批均值−x\^i⋅批协方差

推导精髓 :每个 x i x_i xi影响3条路径 ,batch内梯度均值0,方差1!