Windows系统使用Ollama本地化部署Qwen3.5-9B模型教程

在 Windows 系统上使用 Ollama 本地化部署 Qwen3.5-9B 大语言模型的教程,通过自定义安装路径实现灵活的磁盘空间管理。部署流程涵盖两种模型获取方式:一是通过魔塔社区下载 GGUF 格式量化模型,利用 Modelfile 配置文件执行命令完成本地模型构建;二是直接通过命令拉取官方仓库镜像。本教程适用于需要本地私有化部署,且对数据隐私有严格要求的 AI 应用场景。

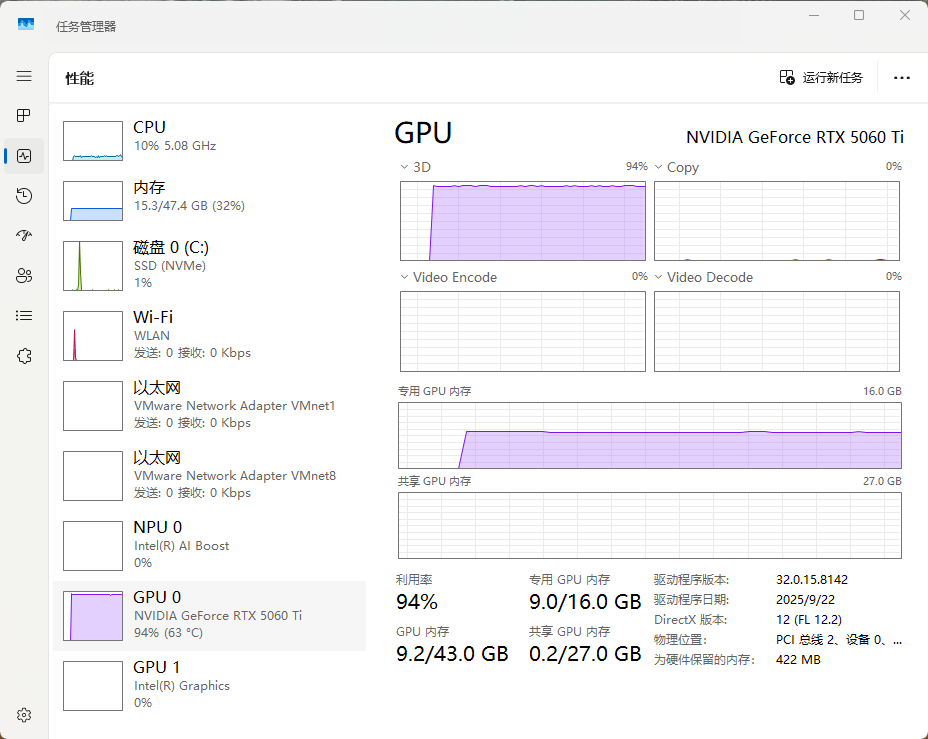

硬件配置:

- CPU:Intel® Core™ Ultra 7 265K

- 内存:DDR5 8000MHz 48GB

- 显卡:RTX 5060Ti 16GB

- 硬盘:SSD 2TB

一、Ollama 安装与环境配置

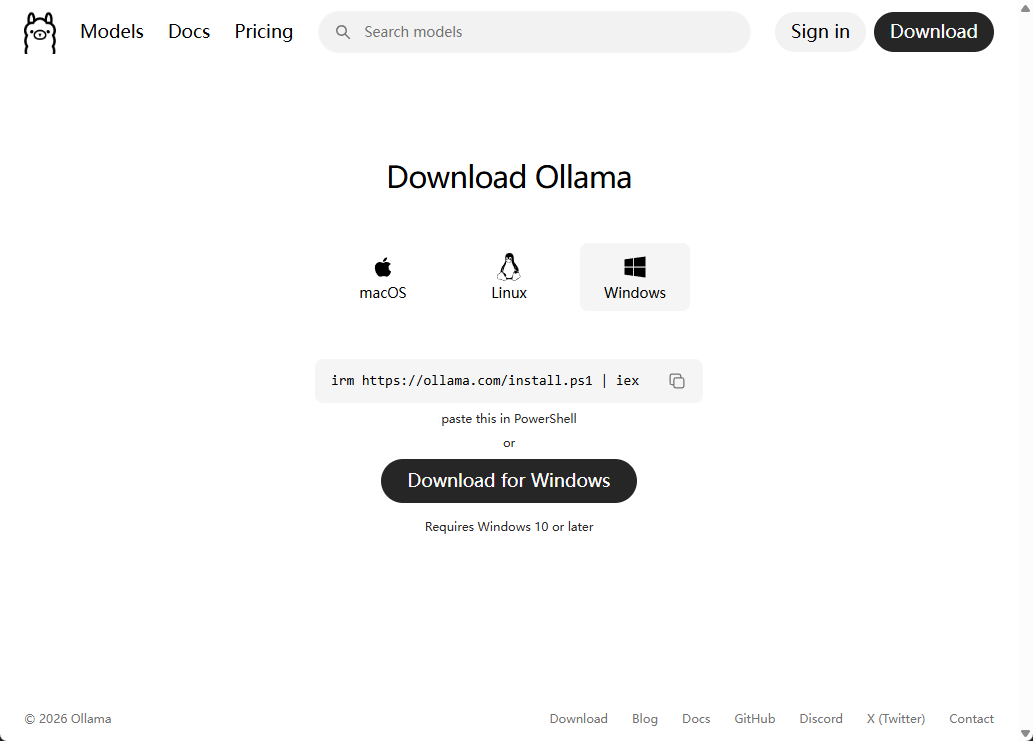

(一)下载Ollama

- Ollama官网下载链接:https://ollama.com/download

- github下载链接: https://github.com/ollama/ollama/releases

选择适合操作系统的版本进行下载:

(二)安装Ollama

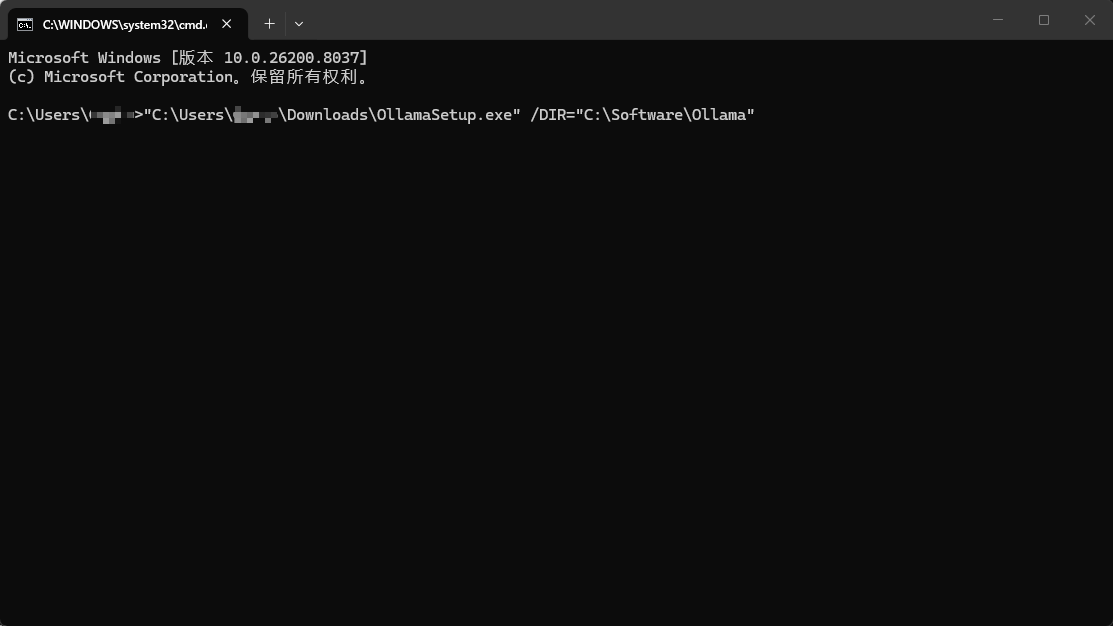

1. 安装路径切换

Ollama的默认安装位置为: C:\Users\xxx\AppData\Local\Programs\Ollama

安装 Ollama 时,需要先切换到目标安装路径,再执行安装操作。

键盘按下:win + R,然后输入:cmd,打开命令提示窗口。

输入命令:

bash

"C:\Users\用户名\Downloads\OllamaSetup.exe" /DIR="C:\Software\Ollama"Downloads\OllamaSetup.exe: 安装包的位置C:\Software\Ollama: 要安装的目标位置

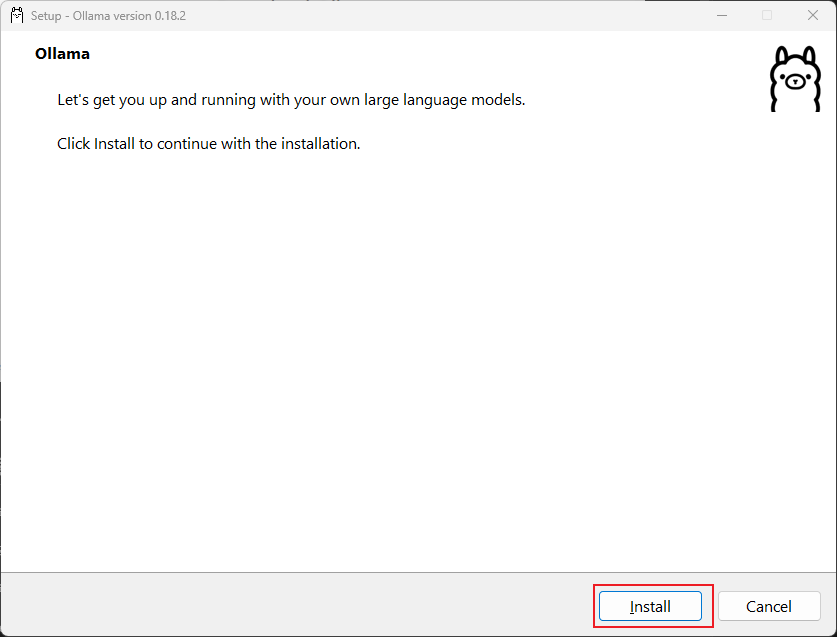

2. 运行Ollama安装程序

运行命令后,会弹出Ollama的安装窗口,点击Install。

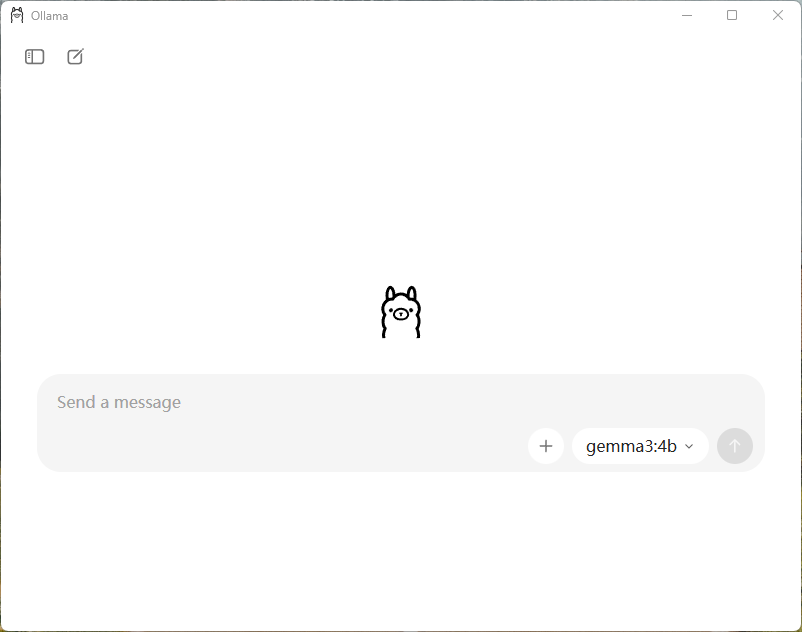

安装完成后的界面:

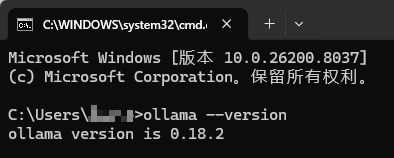

3. 验证Ollama安装

在命令行输入:

bash

ollama --version输出版本信息,说明安装成功。

4. 关闭开机自启

打开设置,选择应用,选择启动。

选择ollama,设置为关。

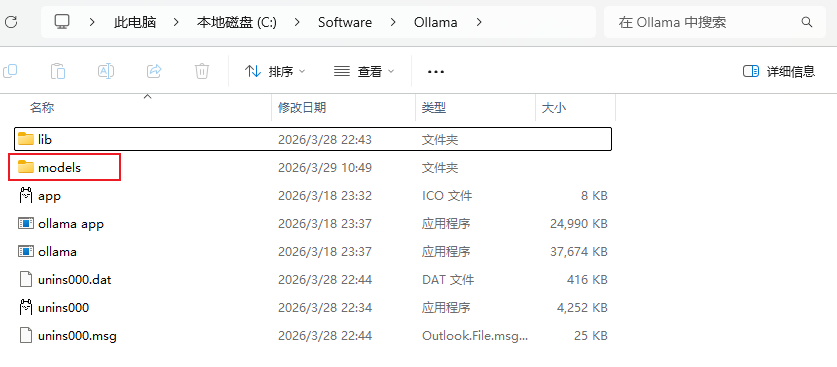

5. 自定义模型存放位置

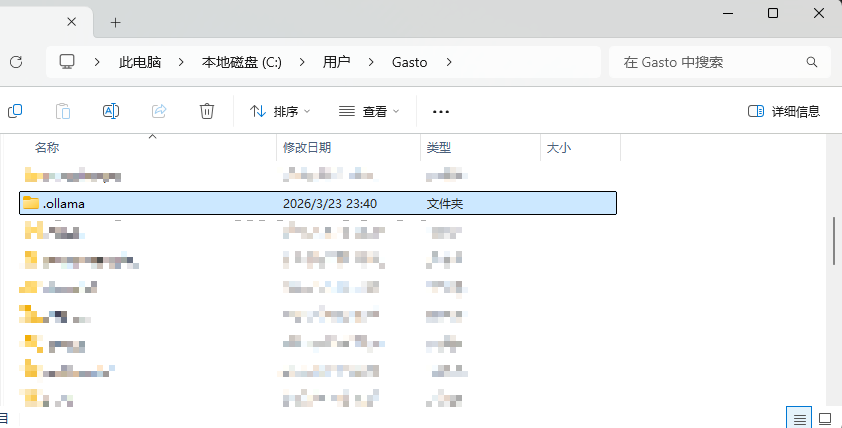

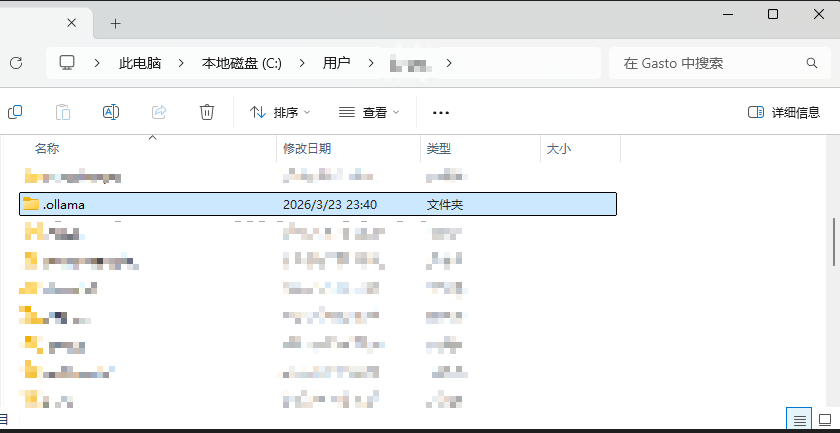

Ollama 默认模型存放路径为:C:\Users\用户名\.ollama\models

新建一个models文件夹:

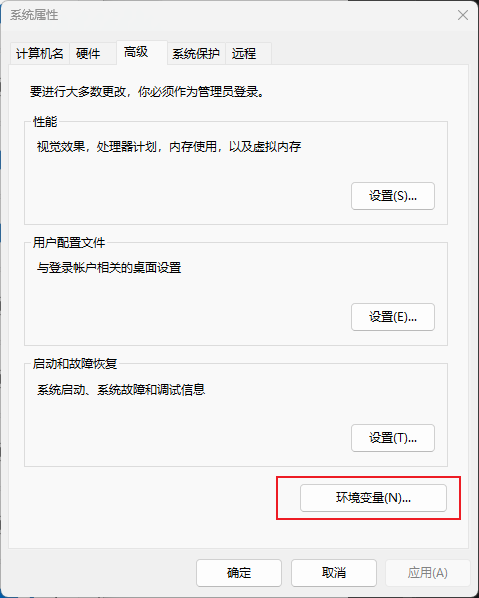

搜索环境变量:

选择环境变量:

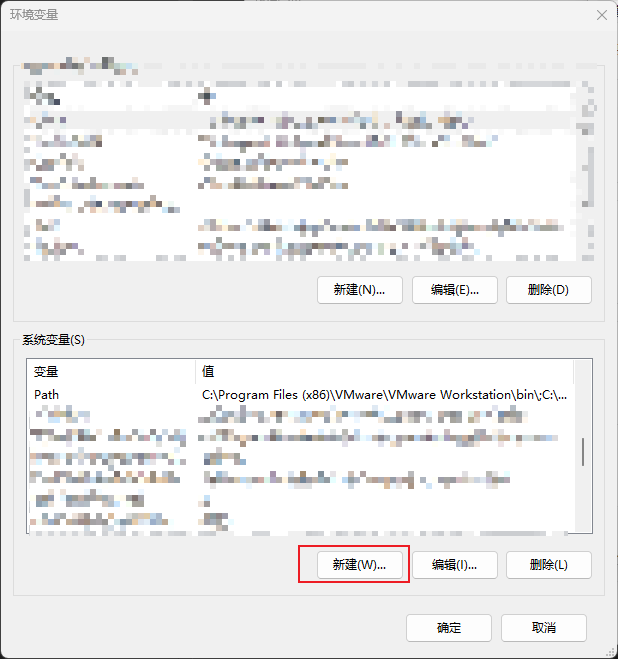

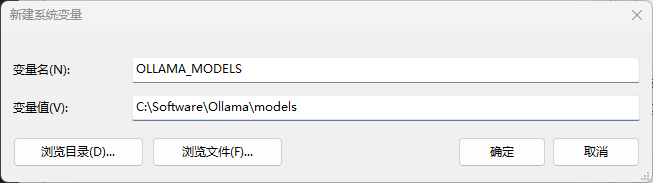

在系统变量下边,点击新建

填入信息:

变量名:OLLAMA_MODELS(必须完全一致,区分大小写)

变量值:C:\Software\Ollama\models (目标模型存放路径)

一路点击确定保存配置。

重启电脑,让Ollama的环境变量生效。

将C:\Users\用户名\.ollama\models下的所有文件,剪切到新的模型文件夹中,避免重复下载。

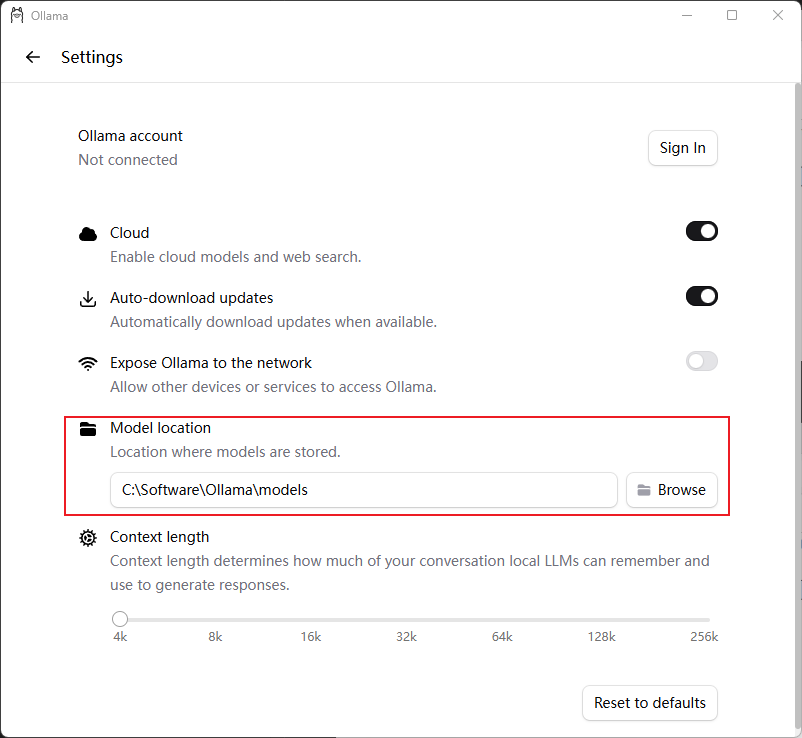

打开Ollama的设置,将模型存放位置进行修改:

二、下载并安装Qwen3.5-9B模型

(一)自行下载指定量化方式的Qwen3.5-9B模型

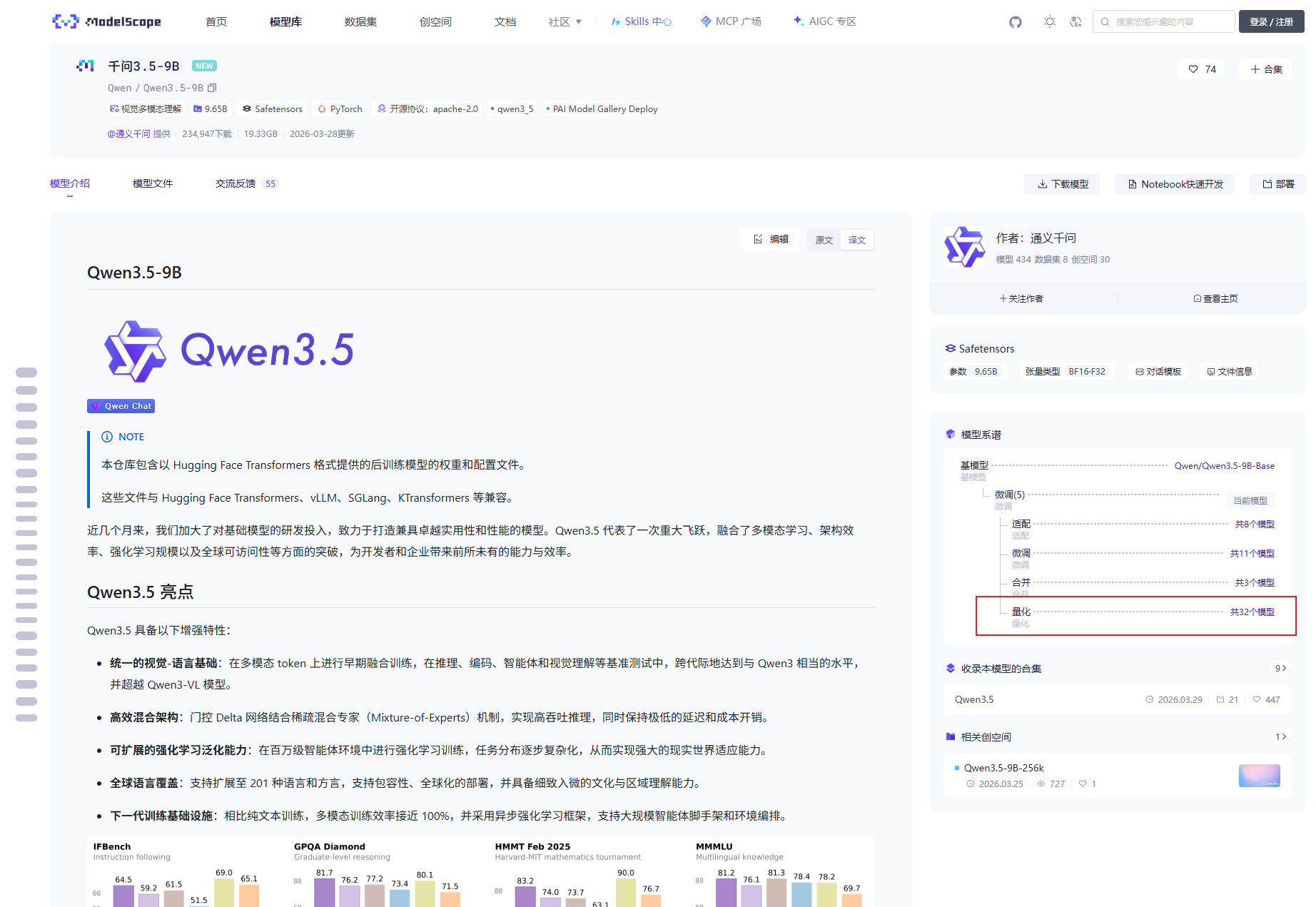

打开魔塔社区,找到Qwen3.5-9B,然后选择右侧的量化模型。

网址:https://www.modelscope.cn/models/Qwen/Qwen3.5-9B

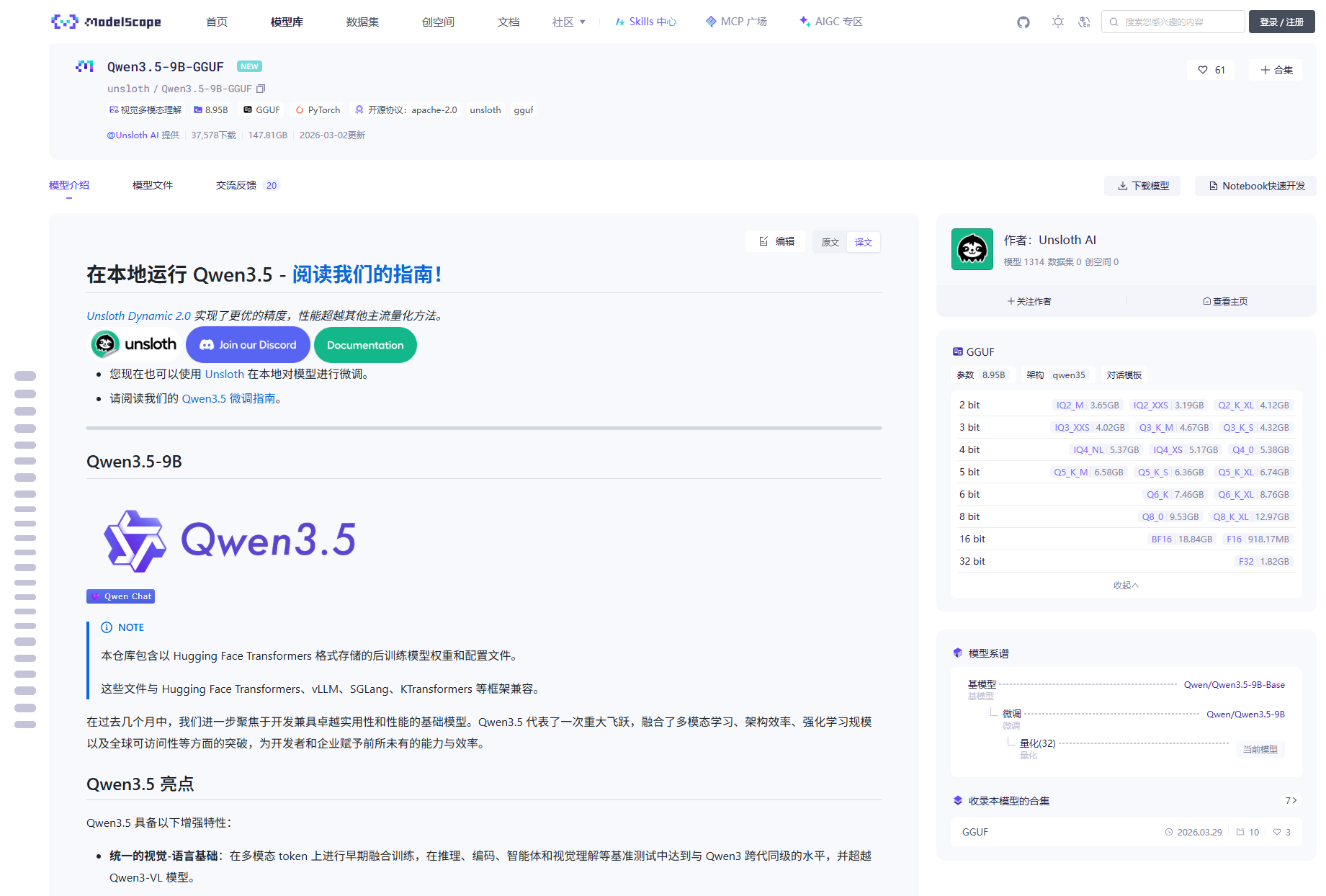

选择GGUF格式的量化模型,作者为:unsloth。

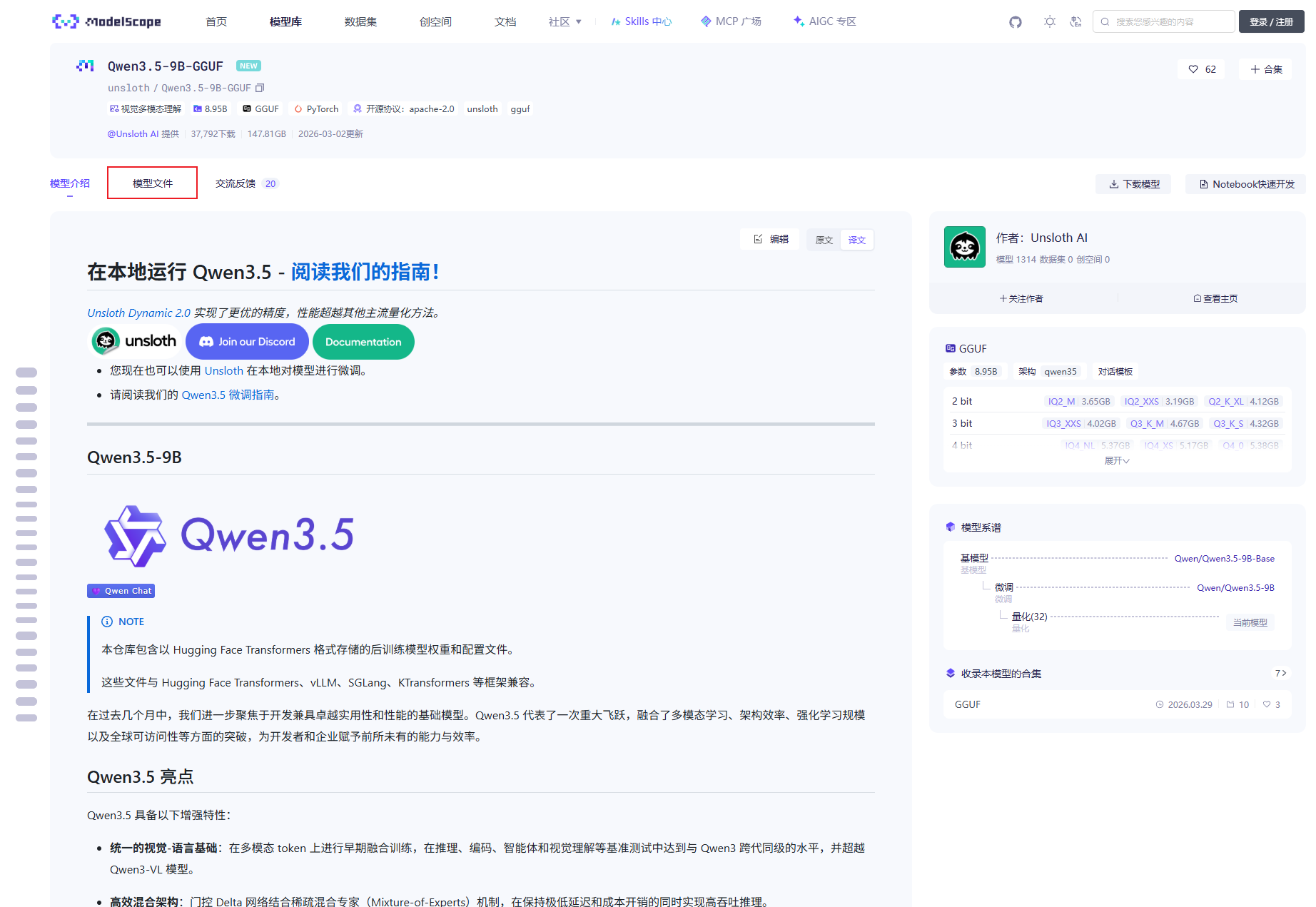

点击模型文件:

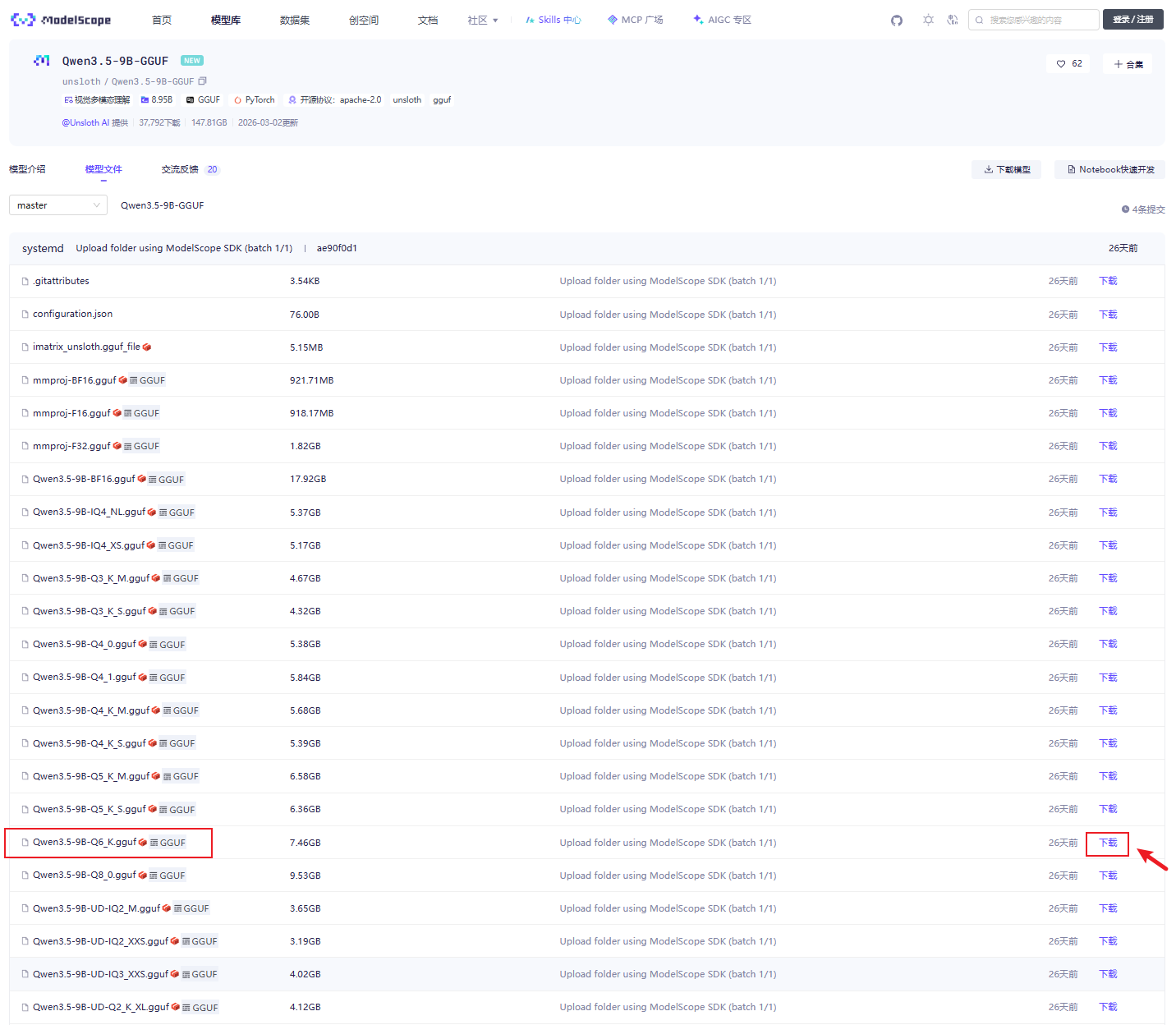

选择Qwen3.5-9B-Q6_K.gguf,点击右侧下载。

这里有多个模型,代表不同精度的量化,需要根据自己的设备进行选择。

需要注意的是:较小的模型在高量化等级下,通常比较大的模型在低量化等级下表现更好。例如:7B模型@Q6通常优于13B模型@Q2,且运行更快!

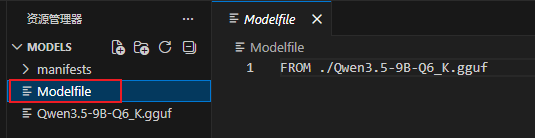

打开任意编译器,在跟下载的gguf同一路径下,创建一个文件(不带有后缀),命名为:Modelfile。

填入内容:

bash

FROM ./Qwen3.5-9B-Q6_K.gguf

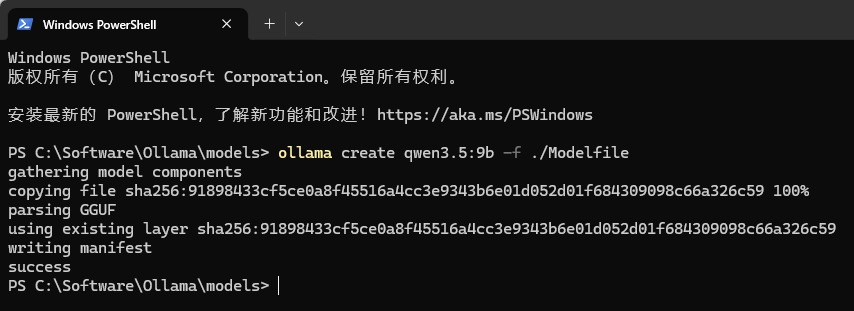

在存放 Modelfile 的目录的文件夹中右键,点击在 终端中打开 ,输入命令:

bash

ollama create qwen3.5:9b -f ./Modelfile

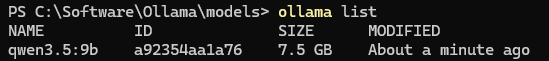

构建完成后,可通过以下命令查看所有本地模型:

bash

ollama list

可以看到这时所安装的模型已经出现在文件夹之中。

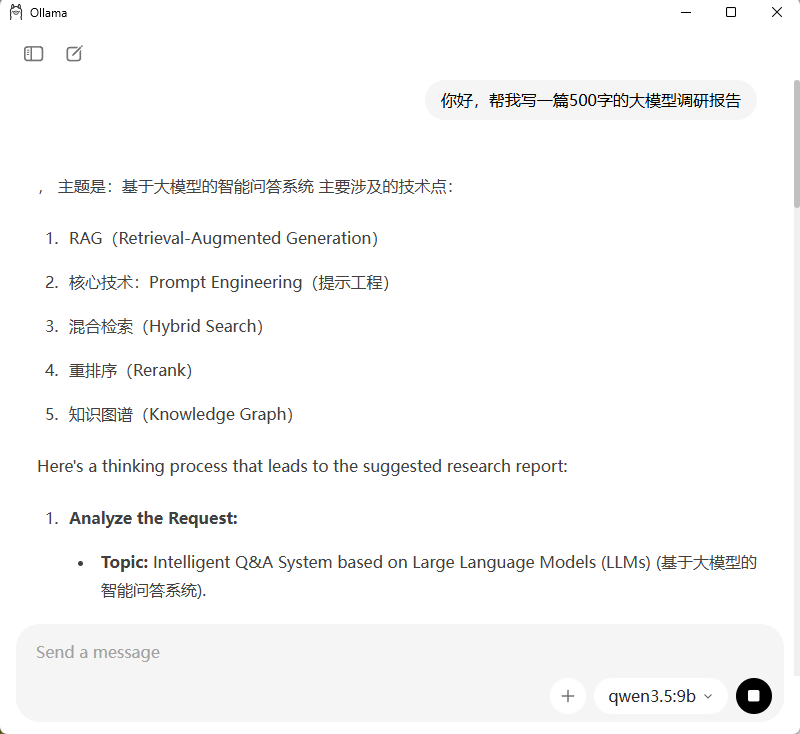

在Ollama中,选中qwen3.5:9b模型,就可以问问题了。

运行模型后,硬件占用情况:

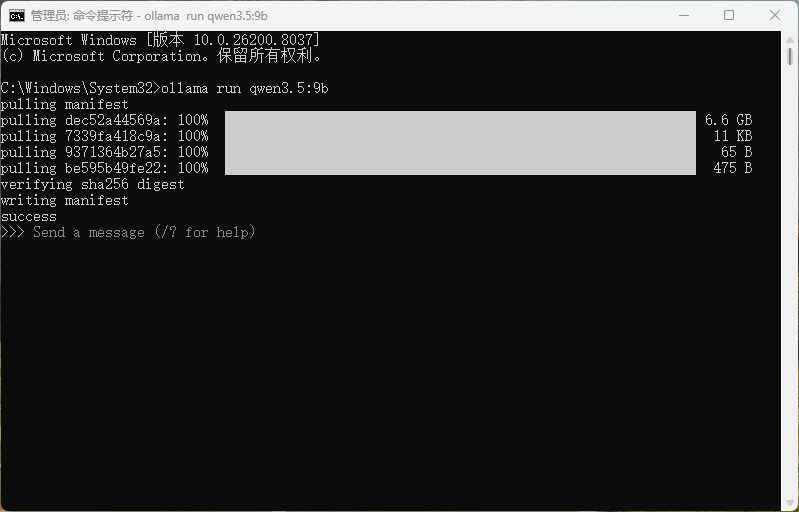

(二)使用默认方式安装模型

以管理员身份打开命令行,然后输入:

bash

ollama pull qwen3.5:9b

ollama run qwen3.5:9b出现scuccess,说明安装成功。

(三)卸载安装的Qwen3.5-9B模型

以管理员身份打开命令行,然后输入:

bash

ollama rm qwen3.5:9b结束~