前几天 Google 正式发布了 AppFunctions 这项新技术,看起来 Android 要认真往 AI 智能体方向走了。简单说,它让手机上的 App 可以把自己的功能直接"告诉"系统里的 AI(主要是 Gemini),这样用户说一句话,AI 就能直接去操作 App 完成事情,不用再自己一层一层点界面。

这事儿让我想起了最近挺火的 OpenClaw(大家常叫它"养龙虾")。OpenClaw 的玩法就是让 AI 真正动手干事儿,现在 Google 在手机系统层面也给了类似的支持,移动端的 AI 代理感觉要开始落地了。

AppFunctions 到底是干嘛的?

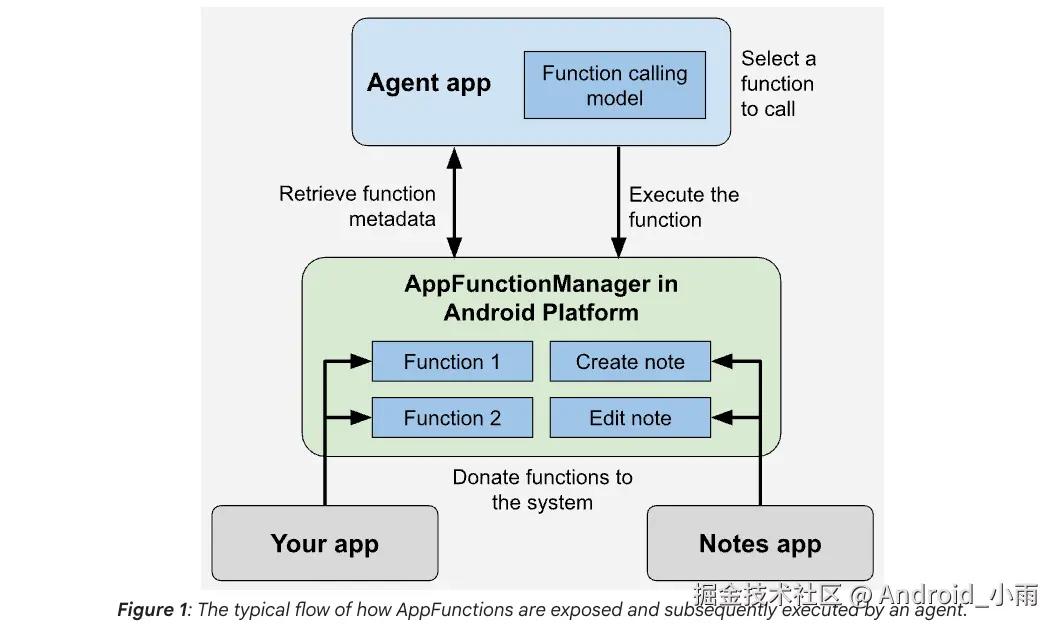

以前 AI 想帮你操作 App,要么靠猜,要么靠模拟点击,经常出问题。现在 AppFunctions 让开发者可以主动把 App 里的具体功能暴露出来,带上清楚的说明和参数。系统会把这些功能都记下来,AI 用的时候就能精准找到并调用。

举几个实际能用上的场景:

- 你跟 Gemini 说:"下周二上午 10 点的团队会议加到我的任务清单里,优先级调高一点,提前 15 分钟提醒我准备材料。" AI 直接在任务 App 里新建一条,时间、优先级、提醒都自动填好。

- "把我今天收到的外卖优惠券有效期提取出来,加到待办事项里,到期前一天再提醒我一次。" 系统可能先帮你读信息,然后自动加到任务列表。

- "把我这周所有高优先级的任务按截止日期排个序,总结一下有哪些。" AI 直接调用查询功能,把列表整理好给你看。

目前这个功能已经在 Galaxy S26 系列和部分 Pixel 10 手机上开了早期预览,主要通过长按电源键唤起 Gemini 来用。等到 Android 17 正式推送,应该会有更多机型支持。

开发者要怎么接?

其实上手不算太难,主要用 Jetpack 库,加上几个注解就行。核心是把功能写清楚,让 AI 能看懂。

下面是一个任务管理 App 的简单例子(不是完整代码,只是示意):

Kotlin

kotlin

class TaskFunctions(private val repo: TaskRepository) {

@AppFunction

suspend fun getTasks(

context: AppFunctionContext,

priority: String? = null, // high / medium / low

dueAfter: Long? = null

): List<Task>? {

return repo.getTasks(priority, dueAfter).ifEmpty { null }

}

@AppFunction

suspend fun addTask(

context: AppFunctionContext,

title: String,

desc: String? = null,

dueTime: Long? = null,

priority: String = "medium"

): Task {

return repo.createTask(title, desc, dueTime, priority)

}

@AppFunction

suspend fun updateTask(

context: AppFunctionContext,

taskId: Int,

newTitle: String? = null,

newDesc: String? = null,

completed: Boolean? = null

): Task? {

return repo.updateTask(taskId, newTitle, newDesc, completed)

}

}

@AppFunctionSerializable

data class Task(

val id: Int,

val title: String,

val description: String?,

val dueTimeMillis: Long?,

val priority: String,

val isCompleted: Boolean

)写注解的时候,描述越清楚自然,AI 用起来就越顺手。想深入了解的可以去官方文档看看。

下面这张图展示了 AppFunctions 大致的调用流程:

这跟"养龙虾"有什么关系?

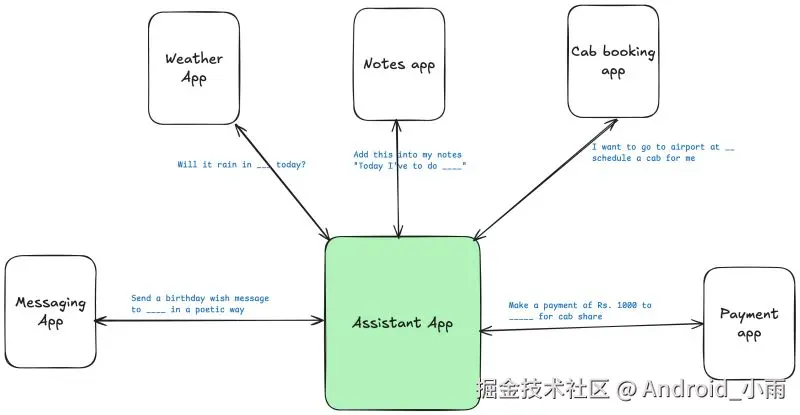

OpenClaw 的核心就是让 AI 有权限去操作各种东西,真正帮人办事。Google 的 AppFunctions 就是在手机系统里给这种能力搭了个框架,让 AI 能更安全、更直接地调用 App 功能。

另外 Google 还在搞 Intelligent UI Automation,就是当 App 还没接 AppFunctions 的时候,AI 可以自己模拟点击、滑动来操作(现在外卖、打车这类场景已经在试)。这两样东西放在一起,手机上的 AI 代理就更靠谱了。

更有意思的是,苹果下一代的 Apple Intelligence 也打算用 Gemini 驱动。这样一来,Gemini 可能变成 Android 和 iOS 共用的 AI 底层,而 AppFunctions 的方式说不定会慢慢变成移动端智能体的通用玩法。

这事儿到底有多大影响?

对普通用户来说,最大的变化是以后用手机不用再那么"手动"了。很多日常琐事------记任务、整理清单、跨 App 倒腾信息------都可以直接扔给 AI,自己省点精力干正事儿。

对开发者而言,现在得开始想想:自己的 App 里哪些功能最值得让 AI 调用?界面还是要做好,但以后"能力"可能比界面更重要。谁先适配好,谁在 AI 时代就多点优势。

当然,现在还只是早期阶段,很多功能还在完善,实际体验会随着后续更新越来越好。Google 也反复强调隐私,所有操作都在手机本地跑,有严格的权限控制。

总的来说,智能手机正在慢慢变成个人 AI 的执行工具,而不是单纯的屏幕和 App 集合。移动端真正能"养龙虾"的日子,看起来不远了。

欢迎评论区聊聊你的想法,或者你已经开始试着集成 AppFunctions 了吗?