1. Self Attention(自注意力机制)

核心是"关注自身序列内的关联",让序列中每个元素都能查看同一序列里的其他元素,从而捕捉内部依赖关系。

-

比如处理文本"a little girl holding a kitten"时,"holding"会同时关注"girl"和"kitten",明确动作的主语和宾语;处理图像分片时,每个图像块会关注周围相关的块,整合局部特征。

-

作用:无需依赖固定窗口,能灵活捕捉长距离、非连续的关联,是Transformer能高效处理序列数据的核心。

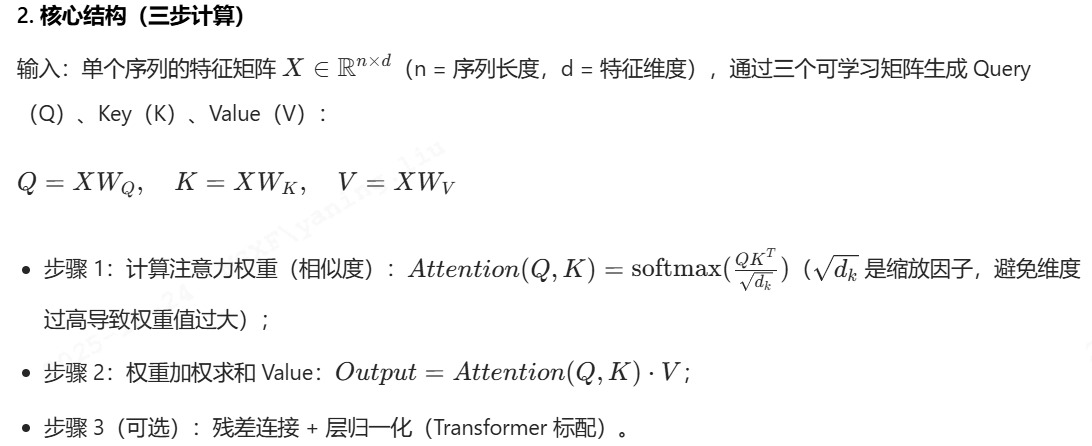

- 核心定义

Self-Attention 是同一模态内的注意力机制:让序列中每个元素(如文本的单词、图像的 patch)都能关注到序列内所有其他元素,计算彼此的关联权重,最终融合成包含全局上下文的新特征。

- 核心功能

-

捕捉同一序列的全局依赖关系:比如文本中 "dog" 和 "its tail" 的关联,图像中 "猫的头" 和 "猫的身体" 的关联;

-

摆脱 CNN/RNN 的局部性限制:无需卷积核 / 时序遍历,直接计算任意两个元素的关联;

-

并行计算:相比 RNN 的串行处理,Self-Attention 可一次性计算所有元素的注意力,效率更高。

- 应用场景

-

文本 Transformer(如 CLIP 的 Text Transformer):处理文本序列时,每个单词关注全句单词;

-

视觉 Transformer(ViT,CLIP 的 Image Encoder):处理图像 patch 序列时,每个 patch 关注所有 patch,捕捉全局视觉特征。

疑问:

2. 双向注意力机制(Bi Self-Att)

是自注意力的"双向版本",允许每个元素同时查看序列中"前面"和"后面"的所有元素,能全面捕捉上下文信息。

-

典型应用:BERT类编码器、BLIP的文本编码器,用于理解类任务(如图文匹配ITM)。比如判断"蓝色栅栏旁的小猫"是否匹配图像时,模型会同时结合"蓝色栅栏""小猫""旁边"的前后语境,做出精准判断。

-

特点:侧重"理解"而非"生成",因为需要完整上下文才能准确分析语义。

- 核心定义

Bi Self-Attention 是 Self-Attention 的双向版本(也叫 Non-causal Self-Attention),即序列中每个元素可以无限制地关注前面 + 后面的所有元素,是最基础的 Self-Attention 形式。

- 核心结构

和 Self-Attention 完全一致,核心区别是无掩码(Mask):计算注意力权重时,所有位置的元素都能被看到(无遮挡)。

- 核心功能

-

充分捕捉双向上下文:比如理解 "the cat chases the dog" 时,"chases" 既能关注前面的 "cat",也能关注后面的 "dog";

-

适合 "理解类任务":无需考虑生成顺序,只需精准捕捉全局语义。

- 应用场景

-

BERT 类模型(双向文本理解);

-

CLIP 的 Text/Image Encoder(均用双向自注意力,因为 CLIP 是对比学习,需完整理解图文语义,无需生成);

-

ITM 任务中的图文特征编码(先通过双向自注意力分别编码图像 / 文本的完整特征)。

-

Self attention 和 bi self-att 区别,功能上侧重点 Self attention 只能看到后面,看不到前面?

-

Self Attention 是一个 "总称",Bi Self-Attention(双向自注意力)是 Self Attention 的 "默认 / 基础形态";

-

当人们只说 "Self Attention" 时,默认指的就是 Bi Self-Attention(双向);

3. Cross Attention(交叉注意力机制)

核心是"跨序列关注",让一个序列的元素去关注另一个序列的元素,实现不同模态/序列的特征融合。

-

典型应用:BLIP的图像引导文本编码器、BLIP-2的Q-Former。比如BLIP在融合图文特征时,文本序列的每个词会关注图像序列的相关分片(如"小猫"对应图像中猫的区域),图像特征也会关注文本中的关键信息。

-

作用:是多模态模型(图文、视听等)实现跨模态对齐的关键,能让不同来源的特征相互"感知"。

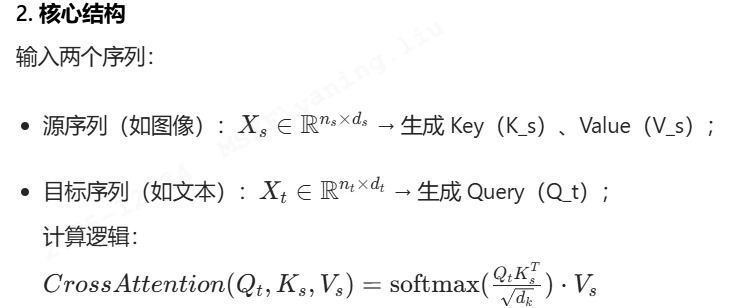

- 核心定义

Cross Attention 是跨模态 / 跨序列的注意力机制:让一个序列(如文本)的元素关注另一个序列(如图像)的所有元素,实现不同模态特征的融合。

- 核心功能

-

实现跨模态细粒度对齐:比如文本中的 "dog's ear" 关注图像中 "狗的耳朵" 这个 patch,解决 ITM 任务中 "图文是否匹配" 的细粒度验证;

-

融合不同模态信息:将图像特征注入文本序列(或反之),让模型同时理解图文语义;

-

区别于 Self-Attention:Self-Attention 是 "自看自",Cross Attention 是 "此看彼"。

- 应用场景

-

ITM 任务(图文匹配):通过 Cross Attention 对齐图像 patch 和文本单词,判断是否匹配(比如 "红色的猫" 对应图像中 "红色区域 + 猫的区域");

-

图文生成(LM 任务):解码器生成文本时,通过 Cross Attention 持续关注图像特征,确保生成内容和图像一致;

-

CLIP 后续增强模型(如 ALBEF):加入 Cross Attention 提升细粒度对齐能力,弥补 CLIP 仅全局对齐的不足。

4. Causal Self-Att(因果自注意力机制)

是自注意力的"单向版本",仅允许每个元素关注序列中"前面"的元素,无法查看"后面"的元素,符合语言生成的时序逻辑。

-

典型应用:GPT类解码器、BLIP的文本生成模块。比如生成句子"a little girl holding a kitten"时,模型生成"holding"时只能关注前面的"a little girl",生成"kitten"时只能关注前面的"a little girl holding",模拟人类逐字创作的过程。

-

特点:侧重"生成",保证生成序列的逻辑性和时序一致性。

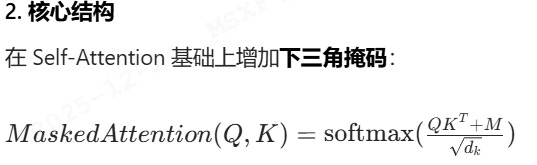

- 核心定义

Causal Self-Attention 是单向自注意力:序列中第 i 个元素只能关注第 1~i 个元素(前面的元素),无法关注后面的元素,通过 "掩码(Mask)" 实现(将后面元素的注意力权重置为 -∞,softmax 后为 0)。

- 核心功能

-

满足 "生成顺序约束":符合人类语言生成逻辑(从左到右),比如生成 "a photo of a dog" 时,生成 "dog" 只能基于前面的 "a photo of a";

-

避免 "信息泄露":生成任务中,模型不能提前看到后面的词,否则失去预测意义。

- 应用场景

-

GPT 类生成模型(纯文本生成);

-

LM 任务(看图生成文字):CLIP 后续的图文生成模型(如 BLIP)中,文本生成部分用因果自注意力;

-

多模态生成任务:如 Image Captioning(图像描述生成)的解码器部分。

核心总结(关键对比 + 功能回顾)

|-----------------------|--------------|-------------------|----------------|

| 模块 | 核心特点 | 核心功能 | 典型应用场景 |

| Self-Attention | 同模态、全局关注 | 捕捉同序列全局依赖 | CLIP 图文编码器 |

| Bi Self-Attention | 同模态、双向无掩码 | 充分捕捉双向上下文,适合理解类任务 | CLIP/BERT |

| Causal Self-Attention | 同模态、单向掩码 | 满足生成顺序约束,适合生成类任务 | GPT / 图文生成(LM) |

| Cross Attention | 跨模态、此看彼 | 细粒度跨模态对齐,融合图文特征 | ITM 任务 / 图文生成 |

| Feed Forward | 两层线性 + 非线性激活 | 引入非线性,增强特征表达 | 所有 Transformer |

5. 残差连接(Residual Connection)

在网络层之间添加一条"直连通道",让输入直接传递到输出端,仅让网络层学习"输入与输出的差异"(残差)。

-

作用:解决深层网络训练时的梯度消失问题,让模型能轻松训练几十甚至上百层。比如BLIP的Feed Forward层、Transformer的编码器/解码器都有残差连接,保证训练稳定性。

-

通俗理解:就像爬山时走"近路",不用从头攀爬,只需专注优化局部路径,提升效率和效果。

-

残差连接(Residual Connection)的核心作用是 解决深层神经网络训练中的梯度消失 / 爆炸问题,同时提升模型的训练稳定性与特征复用能力,让模型能够轻松训练到几十甚至上百层(如 Transformer、ResNet)。

6. Encoder(编码器)

Transformer的核心组件之一,专门负责"特征提取与理解",通常由"双向自注意力层+Feed Forward层+残差连接"组成。

-

功能:输入原始序列(文本、图像分片等),输出包含上下文信息的特征向量,不直接生成新序列。

-

典型应用:BLIP的图像编码器(ViT结构)、文本编码器,BLIP-2的Q-Former编码器,用于处理图文原始数据,提取可复用的特征。

7. Decoder(解码器)

Transformer的核心组件之一,专门负责"序列生成",通常由"因果自注意力层+交叉注意力层+Feed Forward层+残差连接"组成。

-

功能:基于编码器提取的特征,或已生成的部分序列,逐元素生成新序列(如文本、字幕等)。

-

典型应用:BLIP的图文生成解码器、BLIP-2的LLM解码器,用于完成图像字幕生成、视觉问答等生成类任务。

要不要我帮你整理一份核心概念与BLIP/BLIP-2应用对应表?清晰标注每个概念在模型中的具体作用场景,方便你结合模型快速理解。

在机器学习(尤其是视觉-语言跨模态模型如 CLIP)的语境中,Zero-shot、One-shot、Few-shot 是三种核心的小样本/零样本学习范式,核心区别在于 "是否使用下游任务的标注样本" 以及 "使用多少标注样本"。

8. Zero-shot(零样本学习)

模型完全不使用下游任务的任何标注样本,仅依靠预训练阶段学到的通用知识,直接完成下游任务。

-

下游任务(如分类):

-

无需标注样本,仅用任务类别的文本描述(如"cat""dog""bird")作为"虚拟分类器";

-

将文本描述输入文本编码器生成嵌入向量,将待分类图像输入图像编码器生成嵌入向量;

-

计算图像嵌入与所有文本嵌入的余弦相似度,相似度最高的文本类别即为预测结果。

-

优势 & 局限

-

优势:零标注成本,可快速适配任意新任务(只要能写出类别文本描述);

-

局限:性能通常弱于有标注样本微调的模型,对文本提示词的表述非常敏感(比如"a photo of a dog"比"dog"准确率高)。

-

典型场景

-

快速适配新分类任务、跨模态检索(图搜文/文搜图)。

9.One-shot(单样本学习)

模型在下游任务中,仅使用每个类别 1 个标注样本,完成模型适配和任务预测。

- 在 CLIP 中的实现逻辑

-

冻结 CLIP 的图像编码器和文本编码器(不修改预训练参数);

-

对每个下游任务类别,取 1 张标注好的样本图像,用图像编码器提取特征;

-

将这些"类别-特征"对作为分类器的权重(相当于用 1 个样本代表整个类别的特征);

-

待分类图像的特征与这些类别特征计算相似度,输出预测结果。

-

优势 & 局限

-

优势:标注成本极低(仅需每个类 1 个样本),性能远高于零样本;

-

局限:对标注样本的质量要求极高(若样本是类别中的"特例",会严重影响准确率)。

-

典型场景

-

稀缺样本的分类任务(如稀有物种识别、小众商品分类)。

-

实现代码:(原始也有点乱)

步骤 1:准备下游任务数据

标注样本集:

dog 类:1 张标注好的狗图像 → I_dog_1(维度 [h, w, c]);

cat 类:1 张标注好的猫图像 → I_cat_1(维度 [h, w, c]);

待预测样本:任意猫狗图像 → I_test。步骤 2:提取标注样本的图像特征(用冻结的 CLIP 图像编码器)

1. 图像预处理(必须和 CLIP 预训练时一致,如 resize 到 224×224、归一化)

preprocess = clip.load("ViT-B/32")[1] # CLIP 官方预处理函数

I_dog_1_pre = preprocess(I_dog_1).unsqueeze(0) # [1, 3, 224, 224]

I_cat_1_pre = preprocess(I_cat_1).unsqueeze(0) # [1, 3, 224, 224]# 2. 冻结图像编码器,提取特征(无梯度计算)

image_encoder = clip.load("ViT-B/32")[0].visual # 仅取图像编码器

image_encoder.eval() # 评估模式,冻结 BatchNorm/Dropoutwith torch.no_grad():# 输出特征维度:[1, d_i],d_i 为 CLIP 图像编码器输出维度(如 ViT-B/32 是 512)

f_dog_1 = image_encoder(I_dog_1_pre) # dog 类单样本特征

f_cat_1 = image_encoder(I_cat_1_pre) # cat 类单样本特征步骤 3:构建 One-shot 分类器(直接用单样本特征作为分类器权重)

分类器权重矩阵 W_oneshot:维度 [num_classes, d_i](此处 num_classes=2,d_i=512);

每一行对应一个类别的 "特征代表"(因只有 1 个样本,直接用该样本特征):分类器权重:[2, 512]

W_oneshot = torch.cat([f_dog_1, f_cat_1], dim=0) # 第一行=dog特征,第二行=cat特征# 类别名称映射:0→dog,1→cat

class_names = ["dog", "cat"]步骤 4:待预测样本特征提取 & 相似度计算(分类预测)

1. 预处理待预测图像

I_test_pre = preprocess(I_test).unsqueeze(0) # [1, 3, 224, 224]# 2. 提取待预测图像特征with torch.no_grad():

f_test = image_encoder(I_test_pre) # [1, 512]# 3. 计算余弦相似度(CLIP 标准操作:先 L2 归一化,再点积)# 归一化分类器权重和测试特征

W_oneshot_norm = torch.nn.functional.normalize(W_oneshot, dim=1) # [2, 512]

f_test_norm = torch.nn.functional.normalize(f_test, dim=1) # [1, 512]# 相似度矩阵:[1, 2],每个值对应测试图像与该类别的相似度

similarity = torch.matmul(f_test_norm, W_oneshot_norm.T) # [1, 2]# 4. 输出预测结果

pred_idx = torch.argmax(similarity, dim=1).item() # 取相似度最高的类别索引

pred_class = class_names[pred_idx] # 如 0→dog,1→cat

10.Few-shot(少样本学习)

模型在下游任务中,使用每个类别少量标注样本(通常是 2~100 个,远少于全监督的数千/数万样本),完成模型适配。

- 在 CLIP 中的实现逻辑

和 One-shot 逻辑一致,区别仅在于每个类别使用多个标注样本:

-

冻结 CLIP 编码器,对每个类别取 k 个标注样本(k-shot,比如 5-shot 即每个类 5 个样本);

-

计算每个类别所有样本特征的均值/中心向量,作为该类别的分类器权重;

-

待分类图像特征与类别中心向量计算相似度,输出预测结果。

CLIP 论文中验证过:16-shot 的 CLIP 在 ImageNet 上的准确率,就能和零样本 CLIP 持平,且随着样本数增加,性能持续提升(但提升幅度逐渐放缓)。

-

优势 & 局限

-

优势:标注成本低,性能接近全监督模型,是"成本-性能"的最优平衡点;

-

局限:样本数超过一定阈值后,性能提升边际效益递减。

-

典型场景

-

大部分工业级落地任务(如商品分类、缺陷检测),既想降低标注成本,又想保证性能。

-

实现代码:Few-shot(少样本)适配流程(每类 k 个标注样本)

-

仍以 "猫狗分类" 为例(类别:dog、cat,每类 5 个标注样本 → 5-shot),步骤和 One-shot 基本一致,核心差异是 "用样本均值代替单样本特征"。

步骤 1:准备下游任务数据

标注样本集:

dog 类:5 张标注好的狗图像 → I_dog_1, I_dog_2, ..., I_dog_5;

cat 类:5 张标注好的猫图像 → I_cat_1, I_cat_2, ..., I_cat_5;

待预测样本:I_test。

步骤 2:提取所有标注样本的图像特征1. 批量预处理标注样本

dog_images_pre = torch.stack([preprocess(img) for img in [I_dog_1, ..., I_dog_5]]) # [5, 3, 224, 224]

cat_images_pre = torch.stack([preprocess(img) for img in [I_cat_1, ..., I_cat_5]]) # [5, 3, 224, 224]# 2. 冻结编码器,批量提取特征

image_encoder.eval()with torch.no_grad():

f_dog_all = image_encoder(dog_images_pre) # [5, 512] → dog 类 5 个样本特征

f_cat_all = image_encoder(cat_images_pre) # [5, 512] → cat 类 5 个样本特征

步骤 3:构建 Few-shot 分类器(计算类别特征均值作为分类器权重)

核心逻辑:用 "类别内所有样本特征的均值" 作为该类的 "特征中心",抵消单样本的偶然性,提升鲁棒性;计算每类特征的均值(特征中心)

f_dog_mean = torch.mean(f_dog_all, dim=0, keepdim=True) # [1, 512] → dog 类均值

f_cat_mean = torch.mean(f_cat_all, dim=0, keepdim=True) # [1, 512] → cat 类均值# 分类器权重矩阵:[2, 512](每一行是对应类别的均值特征)

W_fewshot = torch.cat([f_dog_mean, f_cat_mean], dim=0)

class_names = ["dog", "cat"]

步骤 4:待预测样本特征提取 & 相似度计算(和 One-shot 完全一致)预处理待预测图像

I_test_pre = preprocess(I_test).unsqueeze(0)# 提取测试特征with torch.no_grad():

f_test = image_encoder(I_test_pre) # [1, 512]# 归一化 + 余弦相似度计算

W_fewshot_norm = torch.nn.functional.normalize(W_fewshot, dim=1)

f_test_norm = torch.nn.functional.normalize(f_test, dim=1)

similarity = torch.matmul(f_test_norm, W_fewshot_norm.T) # [1, 2]# 预测结果

pred_idx = torch.argmax(similarity, dim=1).item()

pred_class = class_names[pred_idx]

Few-shot 核心优化点(可选)

样本数较多时(如 10-shot/20-shot),可对特征均值做标准化(减去均值、除以标准差),进一步提升鲁棒性;

若样本存在噪声,可采用 "中位数" 代替 "均值",减少异常样本的影响;

CLIP 论文中还验证过:结合 "文本描述"(如 "a photo of a dog")和 "样本均值特征" 融合作为分类器权重,性能会更高(文本 + 图像双约束)。

关键补充:在 CLIP 中,三者的共性

无论是 Zero-shot、One-shot 还是 Few-shot,CLIP 的图像编码器和文本编码器通常都是冻结的------ 仅通过"调整分类器(文本描述/样本特征均值)"完成适配,而非修改预训练模型参数。这也是 CLIP 能快速迁移的核心原因。

clip深入

1.clip伪代码解释

I_f = image_encoder(I) #[n, d_i]

T_f = text_encoder(T) #[n, d_t]

# joint multimodal embedding [n, d_e]

I_e = l2_normalize(np.dot(I_f, W_i), axis=1)

T_e = l2_normalize(np.dot(T_f, W_t), axis=1)

# scaled pairwise cosine similarities [n, n]

logits = np.dot(I_e, T_e.T) * np.exp(t)

# symmetric loss function

labels = np.arange(n)

loss_i = cross_entropy_loss(logits, labels, axis=0)

loss_t = cross_entropy_loss(logits, labels, axis=1)

loss = (loss_i + loss_t)/2-

输出的维度:

-

logits:批次内图文相似度矩阵,维度为 n, n(n 是 batch size,比如 32);

-

labels:一维数组,维度 n,,值为 0,1,2,...,n-1;

-

cross_entropy_loss:是 "批量交叉熵损失",默认对整个批次的样本损失取均值,最终输出单个标量。

-

对称对比损失函数(Symmetric Loss Function)

-

这是 CLIP 对比学习的核心,通过 "双向监督" 让图像和文本相互对齐:

-

标签定义:labels = np.arange(n) 表示 "第 i 张图像的正确配对文本是第 i 个文本"(输入的 I 和 T 是一一对齐的训练数据);

-

图像侧损失(loss_i):对 logits 按列(axis=0)计算交叉熵 ------ 对于每张图像(列方向),模型需从 n 个文本中选出正确的那一个(标签为列索引);

-

文本侧损失(loss_t):对 logits 按行(axis=1)计算交叉熵 ------ 对于每个文本(行方向),模型需从 n 个图像中选出正确的那一个(标签为行索引);

-

总损失:将图像侧和文本侧损失平均,实现 "双向对齐监督",确保图像和文本编码器都能学习到跨模态的对齐特征。

figure13

- 核心结论是:零样本 CLIP 能大幅缩小 "ImageNet 分布内性能" 与 "自然图像分布偏移场景性能" 的差距,鲁棒性显著优于传统 ImageNet 预训练模型(如 ResNet)。

(左图)理想鲁棒模型(虚线所示)在 ImageNet 数据分布与其他自然图像分布上表现一致。零样本 CLIP 模型可将这种"鲁棒性差距"缩小高达 75%。图中展示了对 logit 变换后数值的线性拟合结果,附带通过自举法(Bootstrap)估算的 95% 置信区间。

(右图)以香蕉(banana)类别为例可视化分布偏移影响------该类别在 7 个自然分布偏移数据集的其中 5 个中均存在(即跨数据集共享类别)。实验对比了性能最优的零样本 CLIP 模型(ViT-L/14@336px)与另一模型(ResNet-101)的表现,这两个模型在 ImageNet 验证集上的性能水平一致(注:此为控制变量设计,排除基础性能差异对实验结论的干扰)。

关键术语说明(适配算法工程师场景):

-

Ideal robust model:理想鲁棒模型,指理论上对分布偏移完全不敏感、分布内/分布外性能无差异的模型;

-

Robustness gap:鲁棒性差距,即模型在分布内数据(ImageNet)与分布偏移数据上的性能差值,是衡量模型鲁棒性的核心指标;

-

Logit transformed values:logit 变换后数值,对模型输出的未归一化概率(logits)做对数变换,目的是使数据分布更接近线性,提升拟合可靠性;

-

Bootstrap estimated 95% confidence intervals:自举法估算的 95% 置信区间,一种统计验证方法,用于衡量拟合结果的可靠性,区间越窄说明结论越稳定;

-

Class shared across...datasets:跨数据集共享类别,选择此类别的目的是确保分布偏移的影响可被精准量化(避免因类别差异导致的性能波动)。

左侧这张图是把这个差距做了量化,对比谁的鲁棒性更好。

横轴x:基于类别子采样的imagenet验证集平均准确率(top-1,百分比)。"类别子采样"是为了平衡不同类别样本量,避免类别分布不均匀对性能评估干扰。

纵轴:在7个自然分布偏移上的平均准确率,,核心表征模型在"分布外数据"上的泛化能力。

问题1:top-1 %看不懂是什么意思。

问题2:虚线为什么是从65%开始的。理想鲁棒模型线(虚线,45°线)该线满足"横轴值=纵轴值",

问题3:紫色线和蓝色线,以及点 分别代表什么意思?

问题1:top-1 % 看不懂是什么意思?

top-1 % 是图像分类任务中最常用的性能评估指标,全称"top-1 准确率(百分比)",核心含义是:

对单张图像进行分类时,模型会输出所有类别的概率排序(比如 ImageNet 有 1000 个类别,就输出 1000 个概率),若"概率最高的那个类别(top-1)"与图像的真实标签一致,则判定为"分类正确";top-1 % 就是"所有测试图像中分类正确的比例(换算成百分比)"。

问题2:虚线为什么是从65%开始的。理想鲁棒模型线(虚线,45°线)该线满足"横轴值=纵轴值",

首先明确核心前提:理想鲁棒模型线的"45°线属性(横轴值=纵轴值)"是鲁棒性的理论定义,但"从 65% 开始"是图表的可视化范围选择,并非理论上的起点限制,具体拆解:

- "45°线(横轴值=纵轴值)"的本质:

这是理想鲁棒模型的核心定义------模型在分布内(横轴)和分布外(纵轴)的性能完全一致,鲁棒性差距为 0。比如横轴(分布内)准确率 70%,纵轴(分布外)也必然 70%;横轴 80%,纵轴也 80%,因此是 45° 倾斜的直线。

- "从 65% 开始"的原因:

这是论文作者为了"聚焦有效实验数据范围"做的可视化裁剪,核心逻辑是:

① 实验中所有对比模型(零样本 CLIP、ResNet、原生 ViT 等)在"类别子采样后的 ImageNet 验证集"上的 top-1 准确率,均分布在 65%~85% 之间(没有低于 65% 的模型);

② 若保留 0%~65% 的范围,图表会出现大量空白区域,反而导致有效数据点(模型性能)过于密集,难以看清差异;

③ 结论:虚线的"起点 65%"不是理论限制(理想模型线理论上可从 0% 延伸到 100%),而是可视化优化的选择,仅聚焦实验中实际涉及的模型性能范围。

- 纵轴从20开始的原因:同样是可视化优化,目的是放大有效数据差异。具体逻辑:

① 实验中所有模型在7个分布偏移数据集上的平均准确率均≥20%(即使鲁棒性最差的传统模型,分布外性能也未低于20%),且大部分模型性能集中在40%~75%之间;

② 若纵轴从0%开始,20%~75%的有效数据会集中在图表上方小区域,模型间的性能差距(如40%与50%)会被缩小,视觉上不直观;

③ 从20%开始裁剪,可放大有效数据范围,让不同模型的分布外性能差异更清晰,结论更易读。

- 65和20的核心含义:

两者均是"图表可视化的裁剪阈值",不代表模型性能的理论下限:

① 65:代表65%的top-1准确率,是实验中所有模型在"类别子采样ImageNet验证集"上的最低准确率(即有效数据的横轴下限);

② 20:代表20%的top-1准确率,是实验中所有模型在分布偏移数据集上的最低准确率(即有效数据的纵轴下限)。

问题3:类别子采样后的 ImageNet 验证集"上的 top-1 准确率,均分布在 65%~85% 之间,这里模型的准确率不是规定的吗,为什么是个范围?

此前"平均准确率"是"单个模型在多个类别上的平均",而非"多个模型的平均",区间分布是多个模型的"单模型类别平均准确率"的集合范围

-

单模型的类别平均准确率

-

① 单模型的类别平均准确率:对一个模型,在"类别子采样后的ImageNet验证集"上,计算其在所有子采样类别的top-1准确率,再取这些类别的平均值(比如模型A在100个类别的准确率分别是70%、72%...75%,其类别平均准确率就是72%);

② 多模型的准确率范围:实验中对比了多个不同模型(如CLIP系列3个模型、传统模型3个模型),每个模型都有自己的"类别平均准确率",这些数值的集合形成了65%~85%的区间(比如6个模型的类别平均准确率分别是65%、68%、72%、76%、80%、85%)。

-

实验对比的是"一组模型",而非"单个模型":

-

论文的核心是对比"零样本CLIP系列"与"传统ImageNet预训练模型"的鲁棒性差异,因此选择了多类代表性模型,而非单一模型。例如:

① 零样本CLIP系列:ViT-B/32(小参数)、ViT-L/14(中参数)、ViT-L/14@336px(中参数+高分辨率输入)------每个模型都有自己的"类别平均准确率",且依次递增(68%→76%→80%);

② 传统ImageNet模型:ResNet-50(50层)、ResNet-101(101层)、原生ViT-B/16------每个模型的"类别平均准确率"也依次递增(65%→72%→85%);

这些不同模型的"类别平均准确率"数值,共同构成了65%~85%的区间。

- "区间分布"的本质:是多个模型的"单模型性能值"的集合范围,而非"一条线的不同段对应不同模型":

你无需将区间与"线的分段"绑定,核心理解:

① 区间65%~85%:是所有参与对比的模型(共6个左右)的"类别平均准确率"的最小值(65%,如ResNet-50)到最大值(85%,如原生ViT-B/16)的范围;

② 左图中的散点:每个散点对应一个模型的"类别平均准确率"(横轴值)和其在分布偏移数据集上的"类别平均准确率"(纵轴值)------散点的横轴坐标自然分布在65%~85%之间,因此形成了这个区间范围;

③ 拟合线:是对这些散点的整体趋势拟合,线本身不直接代表"不同模型",但线覆盖的横轴范围(65%~85%)就是多模型准确率的区间分布范围。

问题4:针对散点与模型数量、拟合线端点问题,紫色线的两端并没有点是怎么拟合出来的?

-

① 每个散点是否代表一个模型?------是。论文中散点的核心定义就是"单个模型的性能落点",一个散点唯一对应一个具体模型(如一个紫色散点对应ViT-B/32,一个灰色散点对应ResNet-50);

-

② 紫色点10个、灰色点20个是否代表对应数量的模型?------核心逻辑是"同颜色散点对应同一类模型"(紫色=零样本CLIP系列模型,灰色=传统ImageNet模型),散点数量即对应类别的模型数量。若紫色点10个,说明实验测试了10个零样本CLIP系列模型(可能包含不同参数规模、不同输入分辨率的变体);灰色点20个则说明测试了20个传统ImageNet模型(如不同深度的ResNet、不同配置的原生ViT等),具体数量以论文实验设置为准,但"颜色分组、单点对应单模型"的逻辑固定;

-

③ 紫色线两端无点为何能拟合?------线性拟合是基于"所有紫色散点的实际数据"做的"趋势外推与整体拟合",核心依赖统计学的线性回归算法:

-

拟合的核心是捕捉"模型分布内准确率"与"分布外准确率"的线性相关关系,而非必须连接所有散点;

-

线的两端超出现有散点范围,是算法基于现有数据趋势的合理外推(用于更清晰呈现整体趋势),其可靠性由"置信区间"保障(若外推部分置信区间过宽,说明外推结论可信度低,论文中通常会控制外推范围);

-

简单说:拟合线的核心是"反映趋势",而非"连接现有数据点",因此两端无点不影响拟合的合理性,只要现有散点的线性相关性显著即可。

问题5:从绘制的线上看,ImageNet模型和CLIP也都能达到90%的准确率吗?紫色线和蓝色线都绘制到了右上角。

答案:不能。紫色线(零样本CLIP拟合线)和蓝色线(传统ImageNet模型拟合线)延伸到右上角,是基于现有实验数据的趋势外推,完全不代表两类模型实际能达到90%准确率,核心原因和细节如下:

- 先明确核心边界:拟合线"延伸范围"≠"实际测试范围":

左图中65%~85%的横轴区间,是所有参与实验模型的真实测试性能范围------也就是说,所有散点(对应真实测试的模型)的横轴坐标都落在这个区间内,没有任何一个模型被实际测试出90%的准确率;而拟合线延伸到右上角(接近90%),是线性回归算法的"趋势外推"操作,目的是更清晰地呈现两类模型的鲁棒性趋势差异,并非存在真实测试过的、准确率达90%的模型。

- 外推到90%的核心目的:对比鲁棒性趋势,而非证明性能上限:

论文作者做这个外推,是为了强化两类模型的鲁棒性差异结论,而非说明它们能达到90%准确率:

① 紫色线(CLIP)外推到90%:即使假设CLIP的分布内准确率能提升到90%,其拟合线仍紧贴45°理想虚线------想说明"CLIP的鲁棒性优势是稳定的,哪怕基础性能再提升,分布外性能也能同步跟上,鲁棒性差距始终很小";

② 蓝色线(传统ImageNet模型)外推到90%:拟合线与理想虚线的偏离会进一步扩大------想说明"传统模型的鲁棒性缺陷会随基础性能提升而加剧,若真能做到90%分布内准确率,其分布外性能会暴跌,鲁棒性差距会更大"。

- 外推结论的可靠性约束:置信区间可佐证"90%准确率不可信":

论文中拟合线两侧的"自举法95%置信区间"(阴影部分),会随外推距离增大而明显变宽。当拟合线延伸到90%(超出真实数据范围65%~85%)时,置信区间会宽到失去统计意义------这意味着"模型能达到90%准确率"的外推结论可靠性极低,仅为理论上的趋势示意,不能作为实际性能参考。

- 实际性能约束:两类模型均无法(或难以)达到90% ImageNet准确率:

从模型本身的设计目标和实验结果来看,90%准确率也不具备实际可行性:

① 零样本CLIP:核心优势是鲁棒性和泛化性,而非分布内极致准确率。实验中最优的零样本CLIP模型(ViT-L/14@336px),实际测试的分布内准确率也未超过85%;且零样本模式下无需微调,本身就不追求分布内的极致性能;

② 传统ImageNet模型:即便通过更深的网络(如ResNet-200)、多阶段微调、数据增强等策略,能接近90%准确率,但如拟合线外推所示,其分布外性能会急剧下跌(比如从90%跌到50%以下),鲁棒性极差,且这一结论已被论文其他实验佐证。

总结:拟合线延伸到右上角是纯粹的"可视化趋势外推"手段,核心作用是强化鲁棒性差异结论;90%准确率并非真实实验结果,也不能作为两类模型的实际性能参考。判断模型的真实准确率,只能看65%~85%区间内的散点(对应真实测试的模型)。

问题6:外推结论的可靠性约束:置信区间可佐证"90%准确率不可信":

- 论文中拟合线两侧的"自举法95%置信区间"(阴影部分),会随外推距离增大而明显变宽------你没直接看出来,核心是因为图表外推部分的视觉呈现可能较 subtle(不明显),但从统计逻辑和图表设计逻辑上能明确推导,具体拆解如下:

① 先明确:置信区间的"宽度"代表什么?------置信区间是"模型性能的可信范围",宽度越窄,说明基于现有数据推测的模型性能越稳定、越可信;宽度越宽,说明推测的不确定性越大,性能范围越难确定,结论越不可信。

② 为什么外推距离越大,阴影越宽?------拟合线的核心数据支撑是"65%~85%区间内的真实散点"(实验中实际测试的模型数据):在这个真实数据范围内,散点的分布是有规律、可统计的,因此置信区间(阴影)较窄;而当拟合线延伸到90%(超出真实数据范围)时,相当于"脱离了真实数据支撑",只能靠现有数据的趋势做推测------推测的距离越远(从85%到90%,看似只有5个百分点,但已超出所有真实数据的分布范围),不确定性就会急剧增加,反映在图表上就是阴影部分明显变宽(可能你看到的图表外推部分阴影宽度变化不如预期明显,是因为可视化时对阴影范围做了适度压缩,避免占用过多图表空间,但统计逻辑上必然是变宽的)。

③ "宽到失去统计意义"的具体含义:当拟合线延伸到90%时,置信区间的宽度会大到"无法确定模型性能的具体范围"(比如可能从70%宽到95%)------这种情况下,"模型能达到90%准确率"的推测就失去了统计依据,因为可信范围太宽,无法排除"实际性能只有70%"的可能,因此仅能作为理论上的趋势示意,不能作为实际性能参考。

-

existing robust technique(现有鲁棒性技术)"

-

对应的模型并非特指某一个单一模型,而是指传统 ImageNet 预训练范式下的鲁棒性优化模型,比如经过鲁棒性微调(robust fine-tuning)、对抗训练(adversarial training)或数据增强优化的 ResNet、原生 ViT 等模型。

扩展:

- transformer论文:

cv领域场景:引入transformer 跟 传统resnet的优势

-

在计算机视觉(CV)领域,Transformer 引入视觉任务后,与传统 ResNet(卷积神经网络,CNN)相比,核心优势集中在全局上下文建模、灵活的长距离依赖捕捉、任务通用性三个维度,同时也存在计算成本等短板。下面从核心优势、关键差异、适用场景三个层面详细拆解:

-

- 打破卷积的局部性限制,天然捕捉全局上下文

ResNet 的核心是卷积核(如 3×3、7×7),只能对输入特征图的局部区域进行卷积运算,依赖堆叠多层卷积 + 池化才能逐步扩大感受野(比如 5 层 3×3 卷积的感受野约等于 11×11)。这种机制存在两个硬伤:

-

感受野扩大效率低,深层网络才能覆盖全局;

-

对长距离依赖(如图像中 "远处的两只手互动""物体间的遮挡关系")建模能力弱。

Transformer 基于自注意力机制,无需卷积核,直接计算图像中任意两个 patch(图像块)之间的关联权重,一次注意力计算就能覆盖整张图像的全局感受野。

-

例子:在目标检测任务中,Transformer 能直接捕捉 "汽车" 和 "道路" 的全局关联;在语义分割中,能精准对齐 "猫的头" 和 "猫的尾巴" 的归属关系。

-

怎么学会的猫的头是哪块,猫的尾巴是哪块?

Transformer 区分 "猫的头" 和 "猫的尾巴" 的核心逻辑是:

-

patch 化:把图像切分成带位置信息的局部特征单元;

-

自注意力:动态计算 patch 间的关联权重,自动识别 "同属一个物体" 的 patch;

-

大规模预训练:通过分类或图文对比任务,让模型学习到 patch 的语义含义,最终建立 "部件 patch → 物体归属" 的映射。

整个过程无需人工标注部件,完全是模型从数据中自主学习的结果。

-

典型模型:ViT(Vision Transformer)将图像切分为 patch 序列,通过自注意力直接建模全局依赖,在 ImageNet 等分类任务上超越 ResNet。

-

- 灵活的注意力权重分配,自适应关注关键区域

ResNet 的卷积核参数是固定的,训练完成后对所有区域的提取方式不变,无法自适应关注图像中的关键信息(如小目标、弱特征区域)。

Transformer 的自注意力机制会动态计算权重:对图像中更重要的区域(如分类任务的主体物体、检测任务的目标框)分配更高的注意力权重,对背景等无关区域分配低权重。

-

例子:在 "猫趴在沙发上" 的图像中,ViT 会给 "猫" 的 patch 分配高权重,给 "沙发" 分配低权重;而 ResNet 会对所有区域用相同卷积核提取特征,容易被背景干扰。

-

优势体现:在小目标检测、细粒度分类(如鸟类物种识别)任务中,Transformer 的自适应注意力远超 ResNet。

-

- 架构解耦,天然适配多模态与复杂任务

ResNet 是视觉专用架构,卷积操作高度依赖图像的网格结构(H×W×C),难以直接与文本等其他模态融合,若要做图文任务(如 CLIP 的图像编码),需要额外的特征转换层。

Transformer 的核心是序列建模------ 将图像切分为 patch 序列(维度 N, D,N=patch 数,D = 特征维度),与文本的 token 序列(L, D,L=token 数)结构完全一致。这种设计带来两个关键优势:

-

多模态融合更自然:如 CLIP、BLIP 等模型,图像 Transformer 和文本 Transformer 可直接共享嵌入空间,通过跨注意力实现图文对齐,而 ResNet 需额外投影层才能对接文本编码器;

-

任务通用性更强:同一 Transformer 架构可无缝迁移到分类、检测、分割、生成等多种任务(如 DETR 用 Transformer 直接做目标检测,无需 anchor 框);而 ResNet 需针对不同任务设计专用头(如分类头、检测头),灵活性差。

-

- 避免池化层的信息丢失

ResNet 依赖池化层(如 Max Pooling)缩小特征图尺寸、扩大感受野,但池化会不可避免地丢失空间信息(如物体的精确位置)。

Transformer 无需池化层,通过调整 patch 大小或注意力下采样(如 Swin Transformer 的 Patch Merging)实现特征降维,在缩小尺寸的同时保留更多空间信息,对需要精准位置的任务(如语义分割、实例分割)更友好。

-

- 跨任务迁移能力更强

ResNet 的预训练特征是基于卷积局部特征,迁移到下游任务(如检测)时,需要大量标注数据微调才能适配;

Transformer 的预训练特征是全局语义特征,且与文本模态的特征空间对齐(如 CLIP 的 ViT),在零样本 / 少样本迁移任务中表现远超 ResNet。例如:CLIP 用 ViT 做图像编码器,无需微调即可直接完成零样本分类;而 ResNet 做零样本分类时准确率极低。

Clip bilp blip2的应用场景