Wan2.2-Animate

github地址:github.com/Wan-Video/W...

Wan2.2 是一个开源的 AI视频生成模型框架,主要用于 文本→视频、图片→视频、音频→视频生成。它属于当前比较先进的一类 Video Diffusion(视频扩散模型)。

它支持多种生成方式:

- Text-to-Video (T2V):文本生成视频

- Image-to-Video (I2V):图片生成视频

- Text+Image-to-Video (TI2V):文本+图片生成视频

- Speech-to-Video (S2V):音频驱动生成视频

- 角色动画 / 替换(Animate)

本文主要是 角色动画 / 替换(Animate)

下图是测试效果

左侧是你的目标图片,让你的图片可以学习视频里面的人物动起来

中间是你要模仿的视频文件,可以是跳舞视频,也可以是其他动作视频

右侧是图片根据中间视频生成的视频结果

可以看到结果视频基本和中间视频的动作一致,但是人物不相同

同时原本只有一个头像的图片,在ai的处理下,自动添加了背景墙和下半身身体以及对应颜色和款式的衣物

建议模仿中间视频时,图片的人物最好和视频的人物一致,比如都是全身像,这样效果更好一些

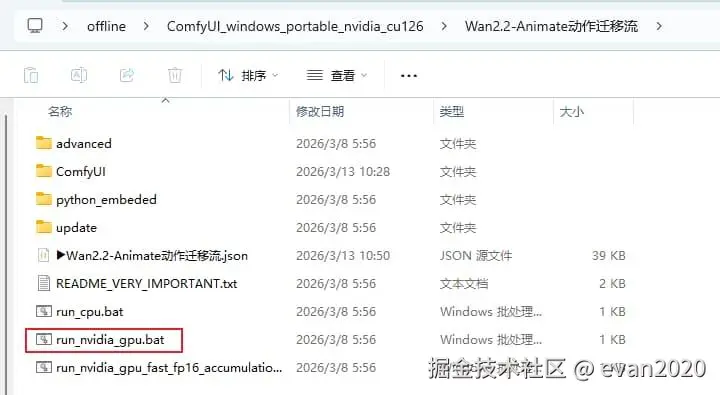

使用步骤

双击run_nvidia_gpu.bat,启动终端

等待终端执行完成

文件夹名称建议不要有中文路径

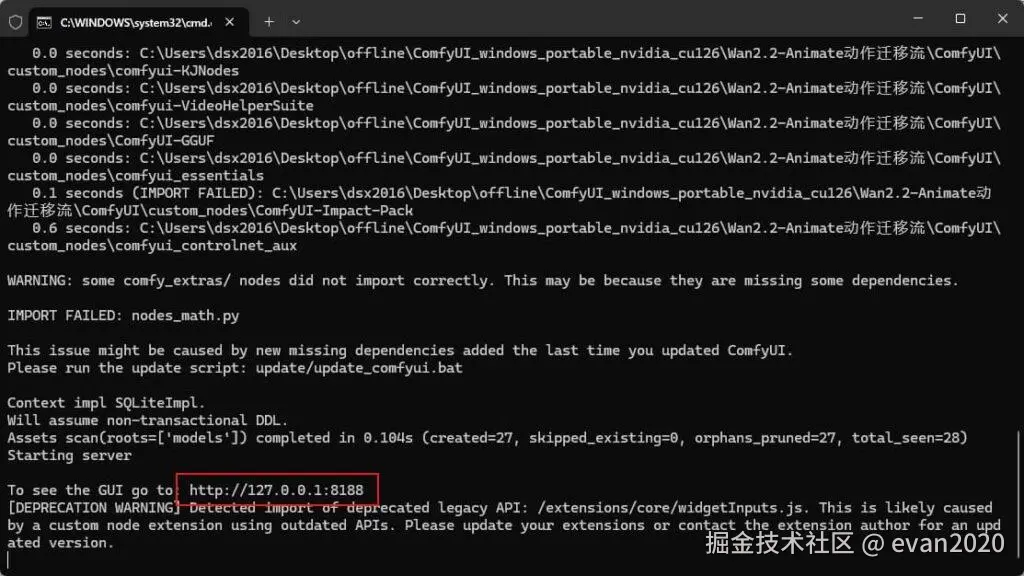

终端界面

确认终端无报错,自动打开对应的网页

如果127.0.0.1打不开,可以换为localhost,有代理的记得关掉代理

选择图片,选择图片要模仿的视频(比如跳舞视频),点击run

等待视频处理完成

本文使用3060 12Gb显卡测试,内存为64GB ddr4,测试过程中,本项目先使用cpu处理,然后内存爆满到60Gb,最后使用显卡峰值大约为8.2GB

整个视频处理时间大致为10分钟,不同的分辨率处理的时间各不相同,配置好的可以尝试1080p等高清分辨率,具体使用细节可以查看界面的参数自行调整

低显存8G可尝试,但是不一定成功,12GB显存可行

Tips

点击此处 网盘下载

目前已发布了LTX2.3 文生视频和图生视频,之前也体验了wan2.2文生视频和图生视频,不过还没有整理出来

有的人评价wan2.2某些场景好过LTX2.2,各有各的优点和特色

本文懒人包是wan2.2的一个动作迁移功能分支