1.简介

支持向量机(Support Vector Machine,简称 SVM)是机器学习领域中一种非常强大且优雅的分类算法。

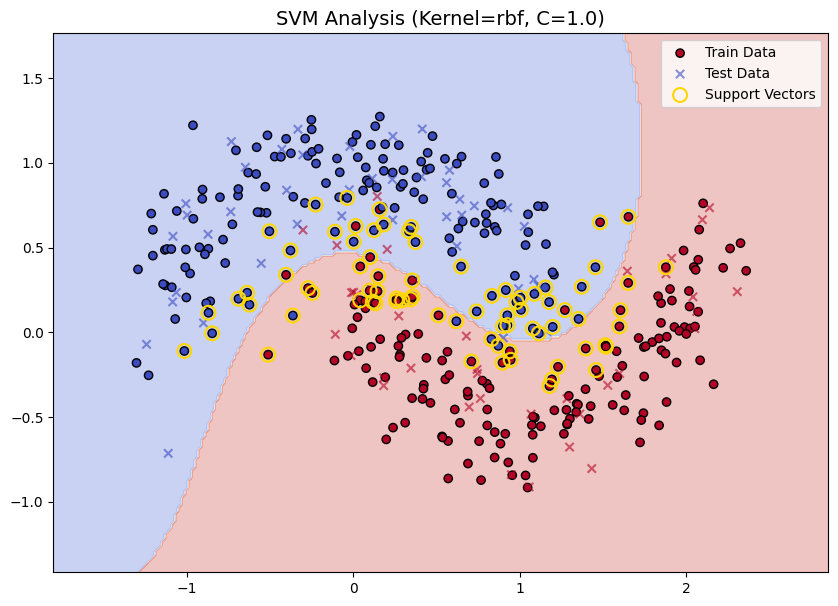

想象桌面上散落着两种颜色的球,SVM 的任务是画一条直线(在更高维空间里被称为超平面),将这两类球分开。

但 SVM 不仅仅是随手画条线,它的目标是找到一条最优边界 ,使得这条边界到两类数据点之间的距离(即间隔 Margin)最大化。这条边界就像一条"最宽的街道",两边的球离街道越远,分类就越稳健。

A. 支持向量 (Support Vectors)

并不是所有的数据点都对划分界限有贡献。SVM 只关注那些离边界最近的点,这些点被称为"支持向量"。如果删掉其他点,模型不会改变;但如果移动这些点,边界就会随之变动。

B. 超平面 (Hyperplane)

-

• 在二维空间是一条线。

-

• 在三位空间是一个面。

-

• 在 维空间中,它是 维的超平面。

C. 核函数 (Kernel Trick) ------ 维度打击

当数据在当前维度无法用直线分开时(例如红球围成一圈,蓝球在中间),SVM 会通过核函数将数据投影到更高维的空间,从而实现"降维打击"式的线性分割。

2.代码实现

def run_svm_analysis(X_train, X_test, y_train, y_test, kernel='rbf', C=1.0, gamma=0.7):

"""

接收数据并进行 SVM 训练与可视化

"""

# 初始化并训练模型

clf = svm.SVC(kernel=kernel, C=C, gamma=gamma)

clf.fit(X_train, y_train)

# 简单评估

y_pred = clf.predict(X_test)

print(f"训练完成!使用 {kernel} 核函数,测试集准确率: {accuracy_score(y_test, y_pred):.4f}")

# --- 绘图逻辑 ---

plt.figure(figsize=(10, 7))

# 确定绘图边界

X_combined = np.vstack((X_train, X_test))

x_min, x_max = X_combined[:, 0].min() - 0.5, X_combined[:, 0].max() + 0.5

y_min, y_max = X_combined[:, 1].min() - 0.5, X_combined[:, 1].max() + 0.5

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.02),

np.arange(y_min, y_max, 0.02))

# 绘制决策区域

Z = clf.predict(np.c_[xx.ravel(), yy.ravel()])

Z = Z.reshape(xx.shape)

plt.contourf(xx, yy, Z, cmap=plt.cm.coolwarm, alpha=0.3)

# 绘制训练集点

plt.scatter(X_train[:, 0], X_train[:, 1], c=y_train, cmap=plt.cm.coolwarm, edgecolors='k', label='Train Data')

# 绘制测试集点 (用不同标记)

plt.scatter(X_test[:, 0], X_test[:, 1], c=y_test, cmap=plt.cm.coolwarm, marker='x', alpha=0.6, label='Test Data')

# 突出显示支持向量

plt.scatter(clf.support_vectors_[:, 0], clf.support_vectors_[:, 1], s=100,

facecolors='none', edgecolors='gold', linewidth=1.5, label='Support Vectors')

plt.title(f"SVM Analysis (Kernel={kernel}, C={C})", fontsize=14)

plt.legend()

plt.show()

return clf3.结果展示