文章目录

- [一、什么是世界模型(World Model)?](#一、什么是世界模型(World Model)?)

-

- [✅ 定义:](#✅ 定义:)

- [🌍 核心功能:](#🌍 核心功能:)

- [🔧 技术原理(典型架构):](#🔧 技术原理(典型架构):)

- 二、世界模型在具身智能中的作用

- 三、VLA(Vision-Language-Action)模型是什么?

-

- [✅ 定义:](#✅ 定义:)

- [🔧 技术原理:](#🔧 技术原理:)

- [四、世界模型、VLA、RL 的区别与联系](#四、世界模型、VLA、RL 的区别与联系)

-

- [🔗 联系:三者如何协同?](#🔗 联系:三者如何协同?)

- [五、为什么 VLA 需要配合世界模型和 RL?](#五、为什么 VLA 需要配合世界模型和 RL?)

-

- [❌ VLA 单独使用的局限:](#❌ VLA 单独使用的局限:)

- [✅ 配合后的优势:](#✅ 配合后的优势:)

- 六、当前趋势:三者融合的代表工作

- [七、VLA vs. VLM:训练好后的优势](#七、VLA vs. VLM:训练好后的优势)

- [✅ 总结](#✅ 总结)

一、什么是世界模型(World Model)?

✅ 定义:

世界模型 是智能体(Agent)内部对环境动态(dynamics)的可学习、可推理的内部表征或模拟器。它能预测"如果我执行某个动作,环境会如何变化"。

🌍 核心功能:

- 状态编码 :将观测(如图像、激光雷达)压缩为紧凑的潜在状态 z t z_t zt;

- 动态预测 :给定当前状态 z t z_t zt和动作 a t a_t at,预测下一状态 z t + 1 = f ( z t , a t ) z_{t+1} = f(z_t, a_t) zt+1=f(zt,at);

- 奖励/回报预测 (可选):预测未来奖励 r t + 1 r_{t+1} rt+1;

- 想象/规划:在内部"模拟"多步未来,无需与真实环境交互。

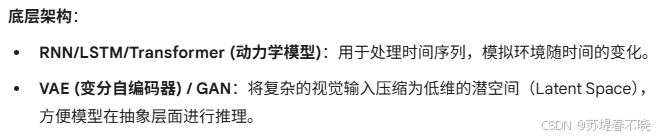

🔧 技术原理(典型架构):

以 Dreamer / DreamerV2 / DreamerV3 为代表:

bash

graph LR

O_t[Observation o_t] --> Encoder --> z_t[Latent State z_t]

z_t --> Dynamics --> z_t+1[Predicted z_{t+1}]

a_t[Action a_t] --> Dynamics

z_t+1 --> Decoder --> ō_t+1[Reconstructed o_{t+1}]- Encoder :CNN + RNN 将图像序列编码为 z t z_t zt;

- Dynamics Network:RNN 或 Transformer 预测状态转移;

- 训练目标:重建观测 + 预测奖励 + 保持信息瓶颈(避免过拟合)。

💡 关键思想 :在潜在空间中建模世界,而非像素空间,效率高、泛化好。

二、世界模型在具身智能中的作用

| 作用 | 说明 |

|---|---|

| 降低样本复杂度 | 在内部模拟中试错,减少真实环境交互(节省时间/成本) |

| 长期规划能力 | 想象多步未来(如"开门→进屋→拿杯子"),支持分层决策 |

| 鲁棒性提升 | 对传感器噪声、部分遮挡更鲁棒(因建模的是语义状态) |

| 零样本迁移 | 学到的动态模型可迁移到新任务(只要环境物理规律不变) |

📌 没有世界模型的具身智能 ≈ 盲目试错;有世界模型 ≈ 带"想象力"的智能体。

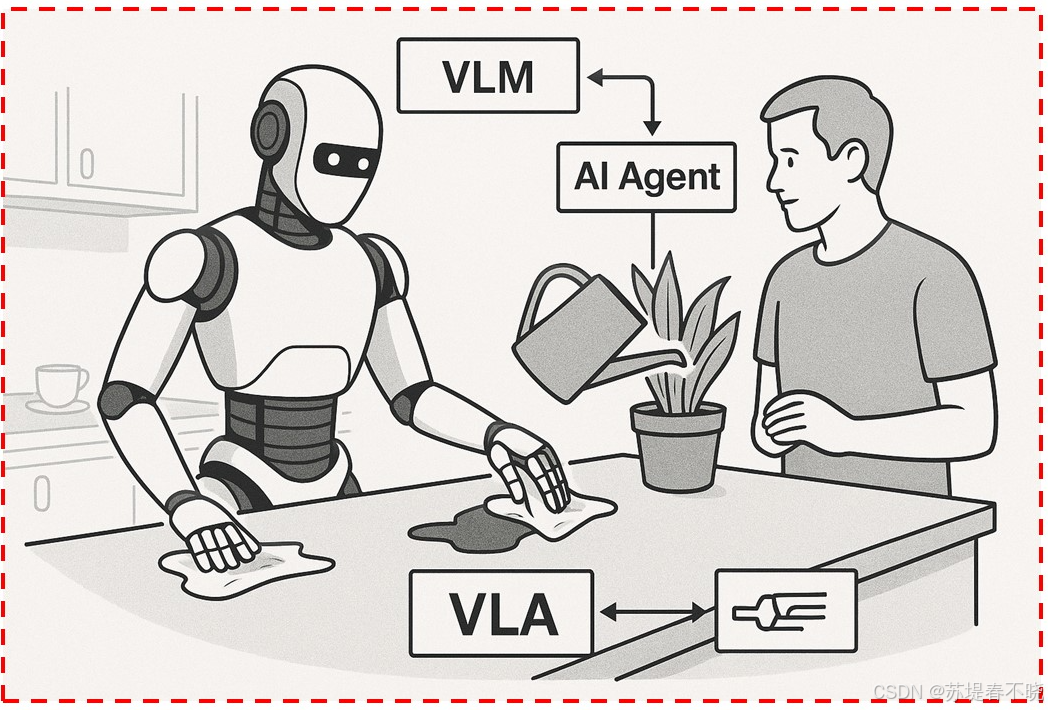

三、VLA(Vision-Language-Action)模型是什么?

✅ 定义:

VLA 模型 是一种端到端的策略网络,直接将视觉观测 + 自然语言指令 映射为机器人动作。

典型代表:RT-2 (Google), OpenVLA, GR00T (NVIDIA)。

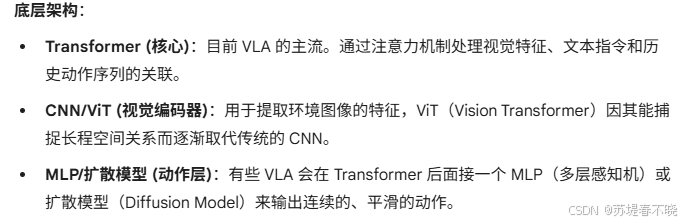

🔧 技术原理:

- 多模态编码 :

- 图像 → ViT 编码;

- 文本指令 → LLM(如 PaLM, Llama)编码;

- 融合与决策 :

- 跨模态注意力融合视觉+语言特征;

- 解码器输出离散/连续动作(如关节角、末端速度);

- 训练方式 :

- 行为克隆(Behavior Cloning) :从人类演示数据中学习( ( o , l ) → a (o, l) \rightarrow a (o,l)→a);

- 微调 + RLHF:用少量 RL 或人类反馈优化。

💡 VLA 本质是"模仿学习"的极致:看图+听指令→做动作。

四、世界模型、VLA、RL 的区别与联系

| 维度 | 世界模型(WM) | VLA | 强化学习(RL) |

|---|---|---|---|

| 目标 | 学习环境动态(预测未来) | 学习策略(输入→动作) | 最大化累积奖励 |

| 是否需要奖励 | 可无监督(仅观测) | 不需要(靠演示) | 必须有奖励信号 |

| 交互方式 | 可离线训练 | 离线(演示数据) | 在线/离线交互 |

| 泛化性 | 高(学到物理规律) | 中(依赖演示覆盖) | 低(任务特定) |

| 样本效率 | 高(内部模拟) | 高(一次性学习) | 低(需大量试错) |

| 典型输入 | 观测序列 | 观测 + 语言指令 | 观测 + 奖励 |

🔗 联系:三者如何协同?

提供初始策略

想象未来轨迹

优化动作

提供稀疏奖励

提供稀疏奖励

"VLA: 看图+听令→动作"

"世界模型: 模拟动作后果"

"规划器: 选最优动作序列"

"RL: 在真实环境中微调"

- VLA 提供"常识策略":快速响应语言指令;

- 世界模型提供"想象力":评估 VLA 动作是否安全/有效;

- RL 提供"最终校准":在真实环境中修正偏差。

五、为什么 VLA 需要配合世界模型和 RL?

❌ VLA 单独使用的局限:

- 缺乏长期规划:只能做"反应式"动作,无法处理多步任务(如"先拿钥匙再开门");

- 安全风险高:直接输出动作,可能撞墙、摔东西;

- 泛化到新场景弱:演示数据未覆盖的动作会失败;

- 无纠错机制:一旦出错,无法回溯调整。

✅ 配合后的优势:

| 组件 | 补足 VLA 的什么缺陷? |

|---|---|

| 世界模型 | 提供安全沙盒 :在内部模拟 VLA 动作的后果,拒绝危险动作;支持多步推理:通过想象规划完整任务流程。 |

| 强化学习 | 提供在线适应 :在真实环境中微调策略,弥补演示数据偏差;优化长期回报:超越模仿,追求任务成功率最大化。 |

🌟 理想架构 :

VLA(快思考) + 世界模型(慢思考/规划) + RL(经验校准) = 鲁棒、高效、可解释的具身智能

RL 在 VLA 框架中的作用

虽然 VLA 初始训练通常采用模仿学习(Imitation Learning / SFT)------即让机器人模仿人类录制的视频或轨迹,但 RL 的加入不可或缺:

-

超越"平均水平":模仿学习只能让机器人做得和演示者一样好。RL 可以通过自我博弈或奖励机制,让机器人探索出比人类演示更高效、更稳健的动作路径。

-

长程任务的一致性:在长达数分钟的任务中,微小的预测偏差会累积(误差漂移)。RL 能够通过目标导向的反馈,强制模型在整个任务周期内保持动作的一致性。

-

安全性与约束:通过设置负奖励,RL 可以教会 VLA 避开危险区域(如不要撞到人,不要打碎玻璃杯),这是纯模仿学习很难学到的"边界感"。

六、当前趋势:三者融合的代表工作

| 方法 | 核心思想 |

|---|---|

| RT-2 + World Model | 用 RT-2 生成候选动作,世界模型筛选安全/有效的序列 |

| OpenVLA + MBPO | 将 VLA 作为策略初始化,用模型基策略优化(MBPO)提升性能 |

| GR00T + Simulation | NVIDIA 构建大规模仿真环境(含物理引擎),训练世界模型 + VLA 联合策略 |

七、VLA vs. VLM:训练好后的优势

VLM (Vision-Language Model) 侧重于"看图说话"(理解和描述),而 VLA 侧重于"看图干活"(交互和决策)。

| 特性 | VLM (如 GPT-4o, LAVA) | VLA (如 RT-2, OpenVLA) |

|---|---|---|

| 输出目标 | 文本描述、分类标签 | 具体的电机控制指令 (如 7-DoF 关节转角) |

| 空间感 | 弱(可能分不清"左边"和"偏左 3 厘米") | 极强(具备亚厘米级的空间操作精度) |

| 动态闭环 | 通常是静态交互 | 实时闭环 (感知 → \rightarrow → 动作 → \rightarrow → 重新感知) |

| 推理能力 | 纯逻辑/常识推理 | 具身推理(将逻辑转化为物理世界的避障和操作) |

核心优势:VLA 解决了"恐怖谷"末端的落地问题。它不仅知道"杯子在桌子上",还知道"如何控制机械臂绕过花瓶,以适当的力度拿起杯子"。

✅ 总结

| 概念 | 角色 | 类比 |

|---|---|---|

| 世界模型 | 智能体的"想象力"和"物理直觉" | 大脑中的模拟器 |

| VLA | 智能体的"语言理解+反射动作" | 听到指令立刻伸手 |

| RL | 智能体的"实践经验" | 通过摔跤学会平衡 |

未来具身智能 = VLA(感知-语言-动作通路) × 世界模型(内部模拟) × RL(现实校准)

这种融合架构正成为机器人、自动驾驶、虚拟智能体的主流范式,也是通向通用人工智能(AGI)的关键路径之一。