一、什么是OpenClaw

OpenClaw(社区昵称"龙虾" 🦞)是一个开源、自托管的个人 AI 智能体(Agent)平台 。它最核心的突破在于:让 AI 不仅能"回答问题",还能直接"动手干活"(如操控浏览器、执行系统命令、发送消息)。

开源:将源代码公开,允许任何人自由地查看、使用、修改和分发。

自托管:不依赖第三方云服务商,由你自己或你的组织完全掌控服务器硬件、软件和数据的部署方式。

1.1 Openclaw能做什么

多渠道统一入口

它支持接入 WhatsApp、Telegram、Discord、Slack、飞书、钉钉、iMessage 等数十种通讯软件。你可以在这些 App 里直接和你的 OpenClaw 对话,它会把所有渠道的消息统一处理 。

强大的工具调用(Tools)

这是它的杀手级功能。OpenClaw 可以调用你本机的工具:

- 浏览器自动化:自动打开网页、截图、填写表单。

- 系统命令:执行 Bash 脚本、管理文件、安装软件。

- 设备控制:通过节点(Nodes)控制手机摄像头、屏幕、定位等。

- 定时任务(Cron):设置每天自动推送天气、新闻或生成日报 。

2.2 智能体和大模型有什么区别

与 ChatGPT 等纯聊天工具不同,OpenClaw 的设计理念是 Agent(智能体):

- ChatGPT:给你写一段代码,但不会帮你运行。

- OpenClaw :你告诉它"帮我查一下今天的新闻并整理成邮件",它自动打开浏览器抓取信息、整理内容、调用邮件接口发送出去。

2.3 安全隐患和保障

越权操作 :为了实现自动化,它被授予了读写文件、执行命令的高权限。但AI存在"幻觉",可能因误解指令而误删你的科研数据、代码库或论文。

环境隔离(必做) :仅在虚拟机(VMware/VirtualBox) 、Docker容器 或专用廉价设备上运行。确保宿主机与OpenClaw环境物理/逻辑隔离。

本地优先(Local-First) :数据默认存储在本地(~/.openclaw/),模型调用虽然依赖 API(如 Claude、GPT),但你的对话历史和工作记录不外流

2.4 核心技术:Gateway 网关

OpenClaw 的核心是一个叫 Gateway 的守护进程(通常运行在本地 18789 端口):

- Gateway:作为"大脑",负责连接所有聊天渠道、调度 AI 模型、管理安全策略。

- 客户端:如 CLI 命令行(文件操作)、手机 App、Web UI,都只是 Gateway 的"触手" 。

二、部署

2.1 部署方法(大模型+OpenClaw)

2.1.1 完全本地部署

环境要求:Node.js ≥ v22.0.0

wsl虚拟机

WSL(Windows Subsystem for Linux)是微软在 Windows 系统上构建的原生 Linux 兼容层 。它允许你在 Windows 10/11 中直接运行 Linux 命令行工具、应用和服务,无需双系统启动或虚拟机。

Windows10+版本安装命令(默认为乌班图系统):

shell

wsl --install如果使用默认命令安装失败的话,可以通过手动下载对应虚拟机镜像完成

shell

安装链接:https://releases.ubuntu.com/24.04.4/ubuntu-24.04.4-wsl-amd64.wsl

# 手动安装命令

wsl --install --from-file "D:\Downloads\ubuntu-24.04.4-wsl-amd64.wsl"安装后设置用户名和密码

shell

Create a default Unix user account: wyl

New password:

Retype new password:

passwd: password updated successfully

To run a command as administrator (user "root"), use "sudo <command>".

See "man sudo_root" for details.

wyl@daocaoren-computer:/mnt/c/Users/wyl$我们现在所处的位置是wyl@daocaoren-computer:/mnt/c/Users/wy,其中wyl是刚刚创建的虚拟机账户的名字@后面的名字为当前主机的名字,/mnt/c/Users/wyl路径下表示这是一个Windows 文件系统目录的映射

Linux虚拟机常用命令:

shell

# 查看已安装的发行版

wsl --list --verbose

# 进入 WSL(默认发行版)

wsl

# 关闭当前系统

exit

# 关闭 WSL

wsl --shutdown

# 导出/导入备份

wsl --export Ubuntu backup.tar

wsl --import MyUbuntu C:\path\to\folder backup.tar

# 彻底删除某个发行版(数据清空,谨慎!)

wsl --unregister UbuntuOllama

Ollama 是一款开源的大模型本地运行工具,你可以把它理解为**"本地大模型的 Docker"**。它通过极简的命令行操作,让你能在个人电脑(Mac/Windows/Linux)上快速部署和运行 Llama、Qwen、DeepSeek 等开源模型,无需复杂的环境配置。

安装ollama命令:

shell

curl -fsSL https://ollama.ai/install.sh | shollama常用命令:

shell

# 启动服务

sudo systemctl start ollama

# 设为开机自启

sudo systemctl enable ollama

# 下载模型(根据本机硬件环境选择合适的)

ollama pull qwen2.5:7b

# 下载完成后,运行测试

ollama run qwen2.5:7b

#退出ollama

【Ctrl】+【D】或\byeOpenClaw

OpenClaw官方一键安装命令:

shell

curl -fsSL https://openclaw.ai/install.sh | bash安装后自动进行配置选择,在进行模型选择的时候,选择自己要使用的模型软件,如Qwen、GPT或者Ollama,此处使用Ollama。还可以在初始化中进行接入的软件(钉钉等)还有Skills(邮件处理等)的配置,首次安装可以都选择跳过(skip),不进行配置,先安装成功后,可以再根据需求进行安装对应的功能。

如果首次安装OpenClaw启动了配置失败后,可以通过命令进行手动配置

shell

openclaw onboard

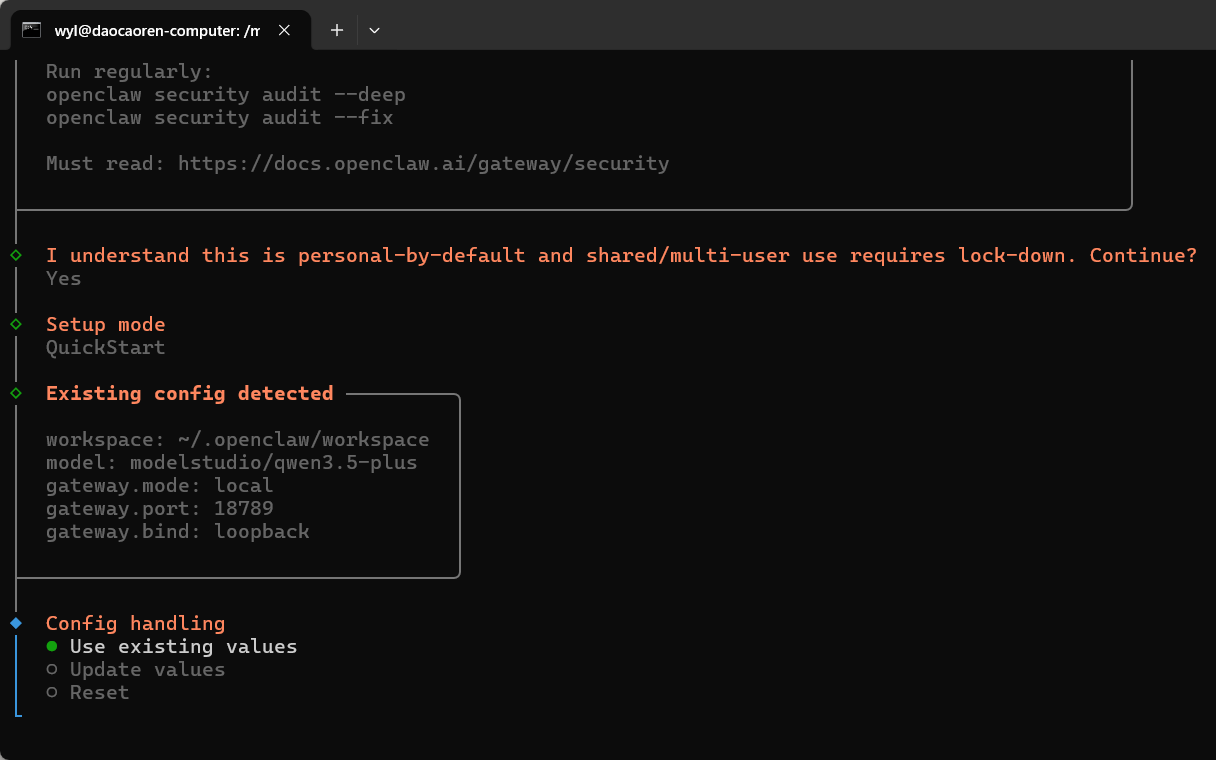

上图展示出了一些配置步骤,首先第一步,【yes】同意使用条款,然后设置模式选择【QuickStark】快速配置,然后后续根据自己的模型情况选择配置。

配置到最后一步,会提问怎么打开openclaw

shell

How do you want to hatch your bot?

│ ● Hatch in TUI (recommended)

│ ○ Open the Web UI

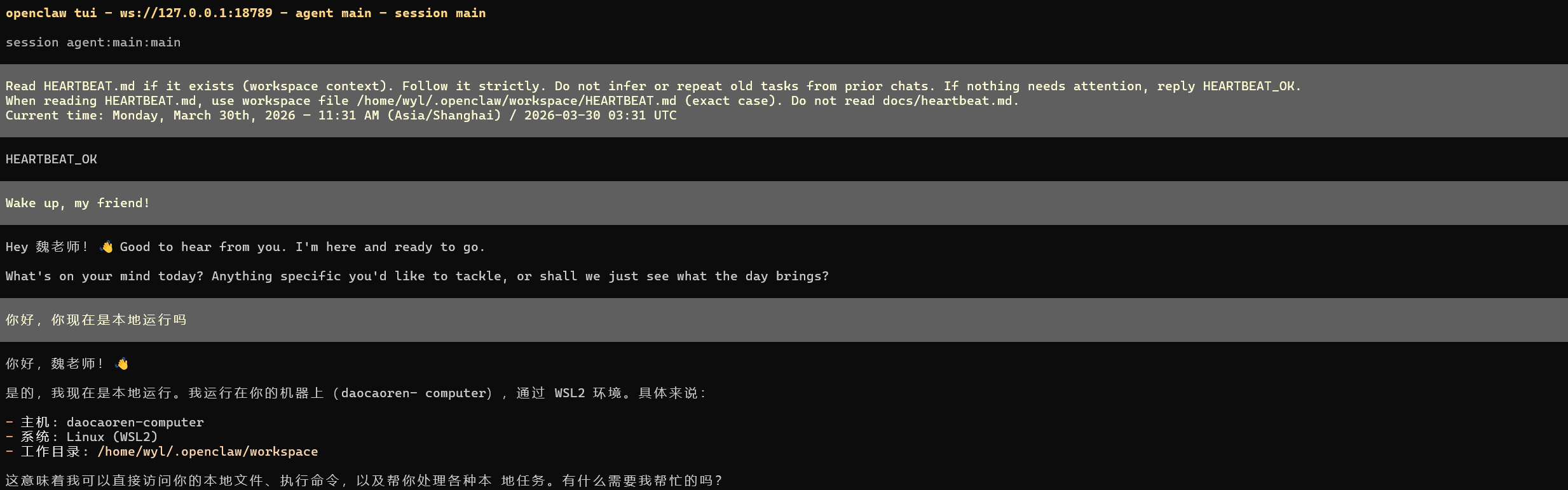

│ ○ Do this later默认也是推荐的用法是使用tui界面(命令行窗口),正确打开后的界面如下:

这是配置后的选择打开,在后续的使用过程中,可以使用如下命令完成交互窗口的打开:

shell

openclaw tui2.2.2 API的使用

使用API可以不受本地硬件的配置,但还是需要在本地下载OpenClaw,只是将大模型换成大公司的算力服务,安装OpenClaw的方法如上,还是建议使用wsl虚拟机,因为WSL 是 Windows 用户运行 OpenClaw 的"官方推荐宿主环境"。由于 OpenClaw 的核心依赖(如 systemd、Linux 工具链)在原生 Windows 上水土不服,WSL 充当了"翻译官"和"隔离沙箱"的角色。

然后在自己想要使用的大模型开发者界面申请API,此处使用阿里的Qwen模型(新用户有免费额度),进入官网https://bailian.console.aliyun.com/cn-beijing后登录选择API key管理。

创建key的时候需要注意,只有在创建的时候,会展示key的内容,一定要记下来,之后不会再次展示。

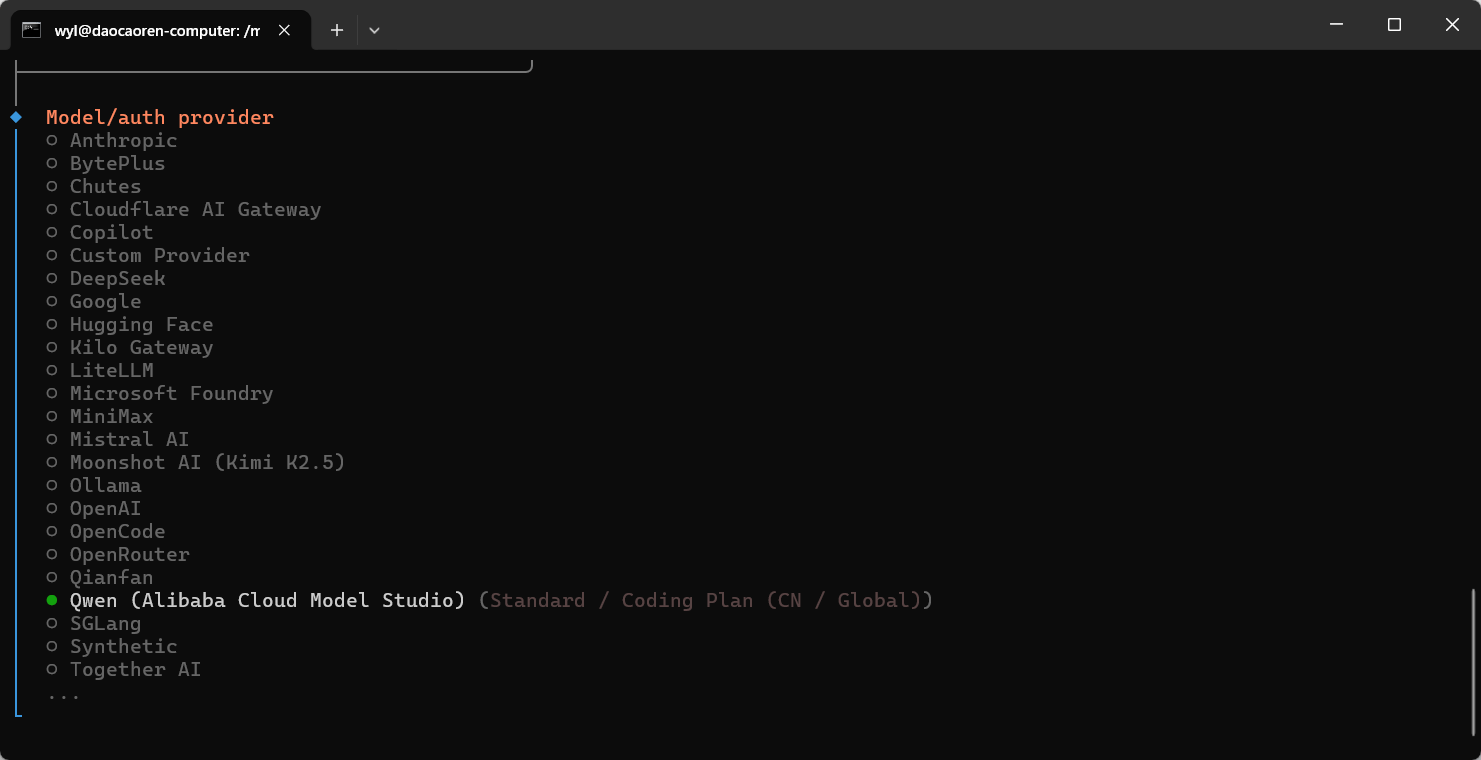

然后还是在OpenClaw配置中,选择对应的模型/厂商

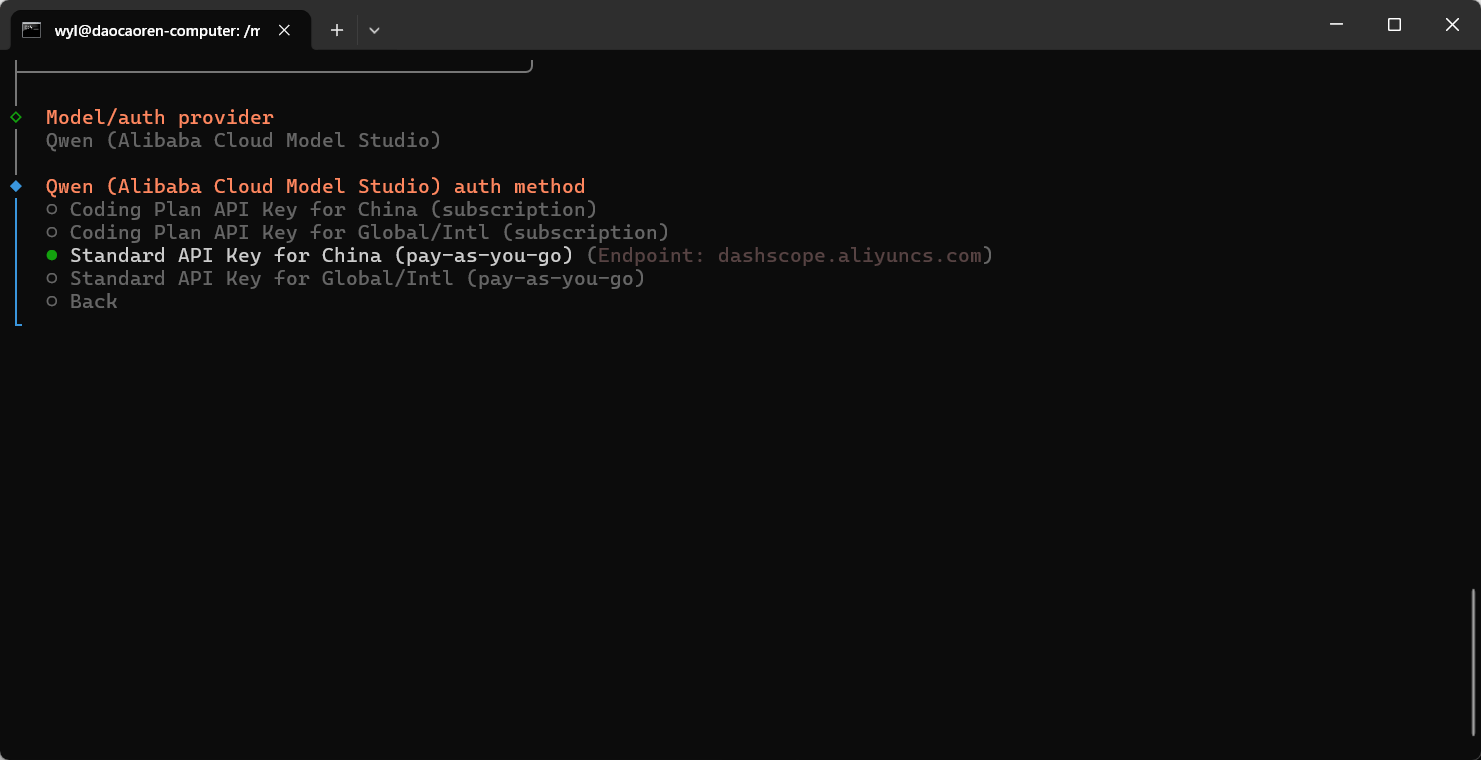

这里在选择时候会进入二级选择菜单:

选择第三项输入正确的key,要确保key值正确,同时账号里面有相应的tokens余额,才可以正常使用

2.2.3 云服务器部署

第一种部署方法的翻版,可以直接将大模型和OpenClaw都部署在云端服务器上,然后通过服务器提供接口在本地使用,这样的方法同样可以不受硬件资源的限制,但缺点是数据安全性的问题。

把 OpenClaw 部署在云端服务器上,数据安全风险极高,本质上相当于把你电脑的"最高管理员权限"交给了公网。如果不做严格的网络隔离和权限控制,它比普通的 Web 服务危险得多。

除非是自己搭建的有安全保障的服务器,否则不推荐使用该种方法进行部署。