引言

在当代企业级数据库架构中,MySQL主从复制早已超越简单的数据备份范畴,成为高可用架构、读写分离、在线DDL操作乃至数据分析等核心业务场景的基石。从电商平台的订单查询、内容社区的读写分离,到金融系统的异地容灾,主从复制架构几乎无处不在。然而,这套看似成熟的机制背后,隐藏着一个让无数数据库管理员(DBA)和运维工程师夜不能寐的难题------主从延迟。

主从延迟的常见表现往往令人困扰:应用程序明明刚写入数据,立即查询时却看不到最新结果,导致业务逻辑出现"读写不一致"的诡异现象;监控系统不断发出告警,Seconds_Behind_Master数值忽高忽低,甚至突破预警阈值;更为隐蔽的是,当延迟积累到一定程度时,从库会逐渐落后于主库,一旦主库发生故障,切换到延迟严重的从库将意味着大量数据的丢失,直接威胁RPO(恢复点目标)承诺。

延迟问题的复杂性在于,其根因可能隐藏在从网络传输、磁盘I/O、数据库参数配置到业务SQL模式的任意一个环节。许多团队在面对延迟告警时,往往采取"重启从库""调整参数"等盲试手段,既无法根治问题,又可能在生产环境引入新的风险。面对这一困境,一套系统化的诊断方法论显得尤为重要。本文将从主从复制的核心原理出发,沿着网络硬件、配置参数、SQL负载三个层次,构建一套层层递进的"分层排查"诊断体系,并结合真实案例与进阶策略,帮助读者建立从问题发现到根本原因定位再到优化解决的完整闭环能力。

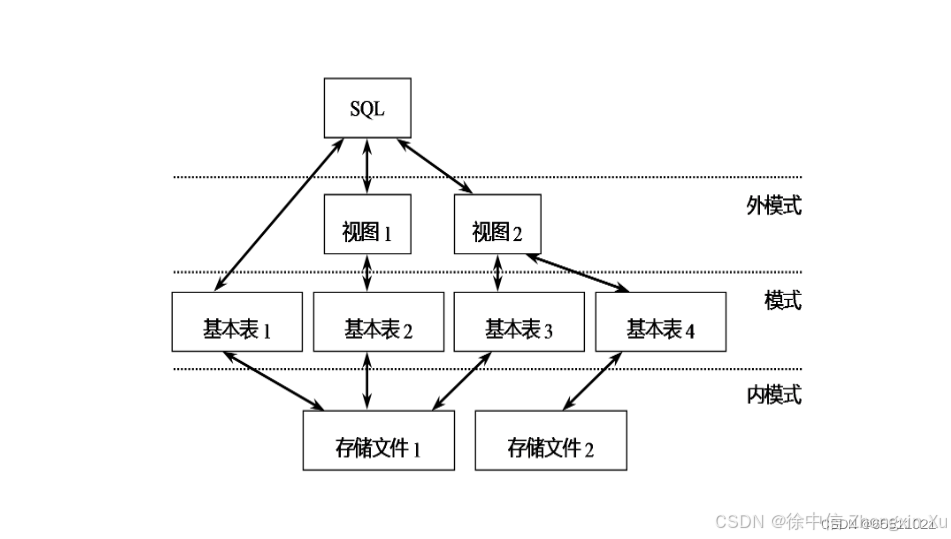

一、主从延迟的核心原理

在深入诊断方法之前,我们必须首先理解主从复制的数据同步机制,尤其是那些影响延迟的关键环节。这就像修车必须先了解发动机工作原理一样,只有掌握数据流动的全过程,才能在延迟发生时准确判断"堵点"所在。

1.1 主库与从库的数据同步流程

MySQL主从复制的完整流程可以清晰地划分为三个核心阶段:

第一阶段:主库Binlog生成(Master Logging)

当主库执行事务时,所有变更操作(INSERT、UPDATE、DELETE等)都会被记录到二进制日志(Binary Log,简称binlog)中。这个过程遵循特定的写入策略:根据参数

sync_binlog的设置,事务提交时可以同步刷盘,也可以异步刷盘。主库在生成binlog事件时,每个事件都会包含一个唯一的位置点(Log Position)和时间戳,为后续的同步提供锚定基准。第二阶段:Binlog传输与中转(Slave I/O Thread)

从库上运行的I/O线程负责与主库建立网络连接,请求从指定的binlog文件和位置开始拉取事件。主库在接收到请求后,会启动一个dump线程,将binlog事件源源不断地发送给从库。从库的I/O线程将这些接收到的数据写入本地的中继日志(Relay Log)文件中,并记录当前读取到的binlog文件名和位置。这一阶段主要受网络带宽、延迟以及主库dump线程性能的影响。

第三阶段:Relay Log重放(Slave SQL Thread)

从库的SQL线程(或协调线程)负责读取中继日志中的事件,并在从库上将这些变更重新执行一遍。在传统的单线程复制模式下,只有一个SQL线程顺序执行中继日志中的事件;而在多线程复制模式下,则会有一个协调线程将不同数据库或表的事件分配给多个工作线程并行执行。这一阶段是延迟问题的高发区,SQL线程的执行效率直接决定了从库与主库的同步进度。

1.2 Seconds_Behind_Master的计算逻辑与局限性

理解Seconds_Behind_Master这个最常用的延迟指标,对于正确解读监控数据至关重要。其计算公式可以简化为:

Seconds_Behind_Master = 从库SQL线程当前执行的事件在主库上记录的时间戳 - 从库服务器的系统当前时间戳具体实现上,主库每个binlog事件都包含一个timestamp字段(事件发生时主库的系统时间),从库SQL线程在执行每个事件时,会计算这个时间戳与从库当前时间的差值。当I/O线程或SQL线程出现异常时,该值会被设置为NULL。

然而,这个指标存在几个致命的局限性,如果盲目依赖,极易产生误判:

-

时间同步依赖 :该值依赖于主从服务器之间的系统时钟同步。如果主库和从库的时钟存在偏差,即使数据已经完全同步,

Seconds_Behind_Master也可能显示非零值。更极端的情况是,如果从库时钟比主库快,该值甚至可能出现负数。 -

瞬时波动特性 :

Seconds_Behind_Master是一个瞬时采样值,反映的是SQL线程当前执行事件的延迟程度。当主库在一段时间内没有新写入时,SQL线程会迅速追赶至最新位置,此时延迟值会骤降至0。但这并不代表网络传输和日志应用没有积压,只是恰好追平而已。 -

计算口径局限:该值只计算SQL线程执行事件时的"执行时间差",并未考虑I/O线程拉取日志的延迟,也无法反映事务在从库重放时因锁竞争或资源争用导致的额外等待时间。在某些场景下,即使延迟值为0,从库的复制进程可能仍然处于异常状态。

-

大事务失真问题 :当一个大事务在从库重放时,

Seconds_Behind_Master会从0开始迅速飙升,但这只是因为事务的主库时间戳与当前时间差逐渐拉大。实际上,只要该事务最终能够重放完成,延迟值就会恢复正常。这种"虚高"往往引发不必要的告警。

正是由于Seconds_Behind_Master存在上述局限,我们在诊断延迟时,绝不能仅依赖这一个指标,而必须结合更多的监控数据和诊断手段,从多个维度交叉验证延迟的真实状况。

二、根因诊断方法论

面对主从延迟问题,系统化的诊断思路至关重要。我们将按照从外到内、从硬件到软件的"分层排查"逻辑,依次检查网络与硬件层、配置与参数层、SQL与负载层,逐层逼近问题的根源。

2.1 网络与硬件层诊断

当延迟问题出现时,第一反应应该是检查物理链路和硬件资源。再优化的数据库参数,再精简的SQL语句,如果跑在千疮百孔的网络或捉襟见肘的硬件上,延迟问题也难以避免。

2.1.1 检查主从节点间的网络延迟

网络是主从复制的生命线。I/O线程从主库拉取binlog的效率,直接受网络延迟和丢包率的影响。诊断网络问题需要从以下几个维度入手:

使用ping测试基础延迟

最基础的ping命令可以快速测试主从节点之间的网络延迟和丢包情况。在生产环境中,建议使用较大数据包的ping测试,以模拟binlog传输的真实场景:

ping -c 100 -s 1400 slave_ip观察平均延迟(avg)和丢包率。对于同机房内的主从复制,理想延迟应在1ms以下;跨机房或云上跨可用区部署时,延迟可能达到几毫秒,但不应出现明显波动或丢包。

使用traceroute/mtr分析路由路径

当延迟异常或网络不稳定时,traceroute(或mtr,即My TraceRoute)可以帮助分析网络包经过的路由节点,定位瓶颈发生在哪一跳:

mtr master_ip持续观察每一跳的丢包率和延迟,如果发现某个中间节点的延迟显著升高或丢包严重,可能是运营商路由问题或中间设备(如防火墙、负载均衡器)导致的。此时需要考虑调整网络架构,如使用专线、优化路由策略,或至少将主从节点部署在同一网络区域内。

使用iperf测试带宽吞吐量

binlog传输是持续的数据流,除了延迟,可用带宽也是关键指标。iperf工具可以测试主从节点之间的实际TCP带宽:

# 在主库上启动服务端

iperf -s

# 在从库上运行客户端

iperf -c master_ip -t 30如果测试得到的带宽远低于预期(例如千兆网络只能跑到几十兆),可能存在网卡故障、交换机端口协商问题或带宽争抢,需要进一步排查。

2.1.2 磁盘I/O性能对比

从库的SQL线程在重放事务时,需要执行大量的数据写入操作(包括数据页的修改、redo log写入、binlog写入等),磁盘I/O能力直接决定了重放速度。

使用iostat监控磁盘性能

iostat命令可以实时监控磁盘的读写负载、IOPS(每秒输入输出操作次数)和响应时间:

iostat -x 1 10重点关注以下指标:

-

%util:磁盘繁忙程度,持续超过80%说明磁盘已达瓶颈。 -

await:平均每次I/O请求的响应时间(毫秒),对于数据库场景,理想的await应在10ms以内,超过50ms通常意味着严重的I/O瓶颈。 -

r/s和w/s:每秒读写次数,评估当前I/O压力。

对比主库和从库的I/O性能,如果从库的磁盘%util长期居高不下,而主库相对空闲,说明从库磁盘是性能瓶颈,可能需要升级为SSD、增加磁盘数量以提升并发能力,或考虑将从库的binlog和relay log放在独立的更快的磁盘上。

使用vmstat观察系统整体负载

vmstat提供系统级别的资源视图,特别是CPU上下文切换和I/O等待情况:

vmstat 1 10关注wa(等待I/O的CPU时间百分比)列,如果该值持续较高(如超过20%),说明系统瓶颈在I/O上。同时观察si和so(swap in/out),如果出现频繁的swap换入换出,说明物理内存不足,操作系统在频繁使用交换分区,这会严重拖慢SQL线程的执行速度。

2.1.3 从库服务器资源瓶颈分析

除了磁盘I/O,CPU、内存、磁盘空间等资源同样影响从库性能。

CPU资源分析

使用top或htop观察CPU使用率,重点关注%us(用户态)和%sy(内核态)的占比。如果%us持续接近100%,说明CPU已经饱和。此时需要进一步分析是SQL线程本身消耗CPU(如复杂的计算、大量的数据转换),还是其他进程(如监控、备份)与MySQL争抢CPU资源。

在多线程复制场景下,可以通过观察mysqld进程的CPU使用率和线程数来评估并行重放的效率。如果CPU利用率偏低但延迟持续,可能存在并行度配置不足或锁等待问题。

内存资源分析

MySQL是内存敏感型应用,InnoDB的缓冲池(InnoDB Buffer Pool)大小直接决定了热数据的命中率。通过以下命令查看内存使用情况:

free -m如果可用内存(available)远小于物理内存总量,且swap used较高,说明内存紧张。此时应检查InnoDB Buffer Pool是否配置过小(通常建议设置为物理内存的70%-80%),或者操作系统是否运行了其他占用大量内存的进程。内存不足会导致从库频繁进行磁盘I/O交换,严重拖慢重放速度。

磁盘空间分析

磁盘空间不足会导致从库无法写入新的中继日志,复制进程会停止。检查磁盘使用情况:

df -h重点关注MySQL数据目录(通常是/var/lib/mysql)所在分区的使用率。如果超过80%,应清理历史日志文件或考虑扩容。特别要注意中继日志(relay log)的清理策略,默认情况下MySQL会自动清理已应用的中继日志,但如果SQL线程出现异常停止,relay log可能会不断堆积。

2.2 配置与参数分析

硬件层面无异常后,我们需要深入MySQL自身的配置参数。不当的参数设置是导致主从延迟的常见原因,尤其是在高并发写入场景下,参数"错配"会放大性能问题。

2.2.1 主库sync_binlog与从库slave_parallel_workers的合理性

主库sync_binlog的权衡

sync_binlog参数控制binlog的刷盘策略:

sync_binlog=1:每次事务提交后立即将binlog刷入磁盘,保证数据安全性,但会带来一定的性能开销。

sync_binlog=0:由操作系统决定何时刷盘,性能高但存在事务丢失风险。

sync_binlog=N(N>1):每N个事务提交后刷盘一次,是一种折中方案。

在高并发写入场景下,如果主库设置sync_binlog=1且磁盘性能不佳,可能成为性能瓶颈,进而影响binlog的生成速率,间接导致从库延迟。但需要注意的是,盲目降低sync_binlog会降低数据安全性,需要在性能和数据安全之间找到平衡点。

从库slave_parallel_workers与并行复制的奥秘

从库的复制延迟,绝大多数情况下发生在SQL线程重放阶段。传统的单线程复制(slave_parallel_workers=0)在高并发场景下注定会成为瓶颈,因为主库可以并行执行事务,而从库只能串行重放。MySQL 5.7及更高版本引入了基于库(database)或逻辑时钟(logical clock)的多线程复制,通过设置slave_parallel_workers和slave_parallel_type实现并行重放。

经验法则 :对于高并发写入的业务,slave_parallel_workers通常建议设置为CPU核心数的2到4倍。但并非设置得越高越好,过多的并行线程可能导致锁竞争加剧和上下文切换开销增加。

2.2.2 从库relay_log_recovery和slave_parallel_type的设置影响

relay_log_recovery的自动修复能力

relay_log_recovery参数控制当从库崩溃或重启后,是否自动清除未应用的中继日志并从主库重新拉取。当设置为ON时,能够有效避免因中继日志损坏或断点不一致导致的复制问题。在生产环境中,建议将此参数设置为ON,以减少人工介入和复制中断的风险。

slave_parallel_type的选择

slave_parallel_type决定了并行复制的粒度:

DATABASE:基于库级别的并行,不同数据库的事务可以并行重放。如果业务压力集中在单个库上,这种模式无法提供并行能力。

LOGICAL_CLOCK(MySQL 5.7引入):基于组提交的并行,同一组提交的事务在从库上可以并行重放。这种模式在大多数场景下表现更好,因为它不依赖于数据库的拆分,能够更充分地利用并行能力。

在MySQL 8.0中,还引入了WRITESET并行复制模式,进一步提高了并行度。选择合适的并行模式,对提升从库重放效率至关重要。

2.2.3 事务大小与批量操作导致的延迟

大事务是主从延迟的"隐形杀手"。一个在主库上执行了10分钟的大事务,在从库上同样需要至少10分钟才能重放完成。在这期间,从库的Seconds_Behind_Master会持续增长,且后续的所有事务都会被阻塞,直到这个大事务重放完毕。

常见的大事务场景:

大批量删除或归档操作(如一次性删除几千万行记录)

无分页的大批量数据导入

对千万级大表的DDL操作(ALTER TABLE)

使用

INSERT INTO SELECT复制大量数据

诊断方法 :

通过SHOW SLAVE STATUS查看Exec_Master_Log_Pos和Relay_Log_Pos的差值,如果差值持续增大,结合中继日志分析当前执行的事务大小。

优化建议:

将大事务拆分为多个小事务,例如使用

LIMIT分批删除或更新,每批几千到几万行。对于DDL操作,考虑使用

pt-online-schema-change等工具进行在线变更,减少对主库的影响,同时避免在从库造成长时间阻塞。建立大事务监控机制,在

performance_schema中追踪运行超过阈值的事务,提前预警。

2.3 SQL与负载排查

当硬件和配置都无明显问题时,问题可能出在SQL层面------要么是主库写入压力过大导致binlog生成过快,要么是从库应用线程遭遇了阻塞或资源争用。

2.3.1 主库写入压力监控

主库的写入压力直接决定了binlog的产生速率。如果主库TPS(每秒事务数)过高,从库可能无法跟上这一速率,导致延迟逐渐累积。

使用SHOW PROCESSLIST观察实时负载

SHOW PROCESSLIST;重点关注State列,如果大量连接处于updating或inserting状态,说明主库正承受高写入压力。同时观察Time列,长时间运行的SQL可能是潜在的性能瓶颈。

使用pt-query-digest分析慢查询日志

Percona Toolkit中的pt-query-digest是分析SQL负载的利器。通过分析主库的慢查询日志或通用查询日志,可以识别出执行频率高、影响行数多的热点SQL:

pt-query-digest /var/log/mysql/slow.log > analysis.txt输出的报告中会按查询指纹聚合,显示每个SQL的总执行时间、平均执行时间、执行次数等关键指标。如果发现某些SQL执行频率极高或单次执行时间很长,它们可能是主库压力的主要来源。

监控binlog产生速率

通过对比binlog文件的大小变化,可以计算出主库每秒生成多少MB的binlog。如果生成速率超过从库的重放能力,延迟将不可避免。可以通过以下SQL获取binlog文件的当前大小:

SHOW BINARY LOGS;观察文件大小随时间的变化趋势,即可估算出binlog的增长速率。

2.3.2 从库应用线程阻塞分析

SHOW SLAVE STATUS的核心指标

SHOW SLAVE STATUS命令是诊断从库状态的第一站,其中多个字段组合起来可以揭示复制线程的健康状况:

sql

SHOW SLAVE STATUS\G关键指标解读:

Slave_IO_Running和Slave_SQL_Running:两者都应该为Yes,任何一个是No或Connecting都说明复制异常。

Master_Log_File和Read_Master_Log_Pos:I/O线程已读取的主库binlog位置。

Relay_Log_File和Exec_Master_Log_Pos:SQL线程已执行到的主库binlog位置。

Relay_Log_Pos与Exec_Master_Log_Pos的差值 :如果中继日志位置(Relay_Log_Pos)远大于执行位置(Exec_Master_Log_Pos),说明中继日志中有大量未应用的事件,积压严重。

Last_Errno和Last_Error:如果出现非零错误号,说明SQL线程因执行错误而停止。

通过performance_schema深入分析

MySQL的performance_schema提供了更细粒度的复制监控能力。在MySQL 5.7及以上版本中,可以查询以下表获取复制线程的状态:

sql

-- 查看复制线程的详细状态

SELECT * FROM performance_schema.replication_applier_status_by_worker\G每个工作线程的LAST_APPLIED_TRANSACTION和LAST_APPLIED_TIMESTAMP可以帮助判断哪些线程在追赶,哪些线程出现阻塞。

2.3.3 长查询或锁竞争对延迟的影响

从库上的长查询和锁竞争是导致延迟的"暗礁"。当从库上执行复杂的SELECT查询(例如报表生成、数据导出)时,这些查询可能会持有共享锁或意向锁,与正在重放的更新操作产生锁冲突。

锁竞争场景分析:

在从库上启用performance_schema的锁监控:

sql

-- 查看当前的锁等待关系

SELECT * FROM performance_schema.data_locks;

SELECT * FROM performance_schema.data_lock_waits;如果发现SQL线程的重放操作频繁被阻塞在锁等待上,说明从库上存在与复制冲突的查询。解决思路包括:

将从库的只读查询导向专门的分析从库,与主从复制从库分离。

设置从库参数

max_execution_time,限制查询的最大执行时间,避免长查询阻塞复制。在从库上设置

innodb_lock_wait_timeout,减少重放操作的锁等待时间(但需谨慎设置,避免事务回滚导致复制中断)。

从库复制线程的阻塞分析:

通过以下SQL可以查看SQL线程当前正在执行的事件:

sql

SHOW PROCESSLIST;在输出中找到Command为Connect且State为Waiting for ...或Reading event from the relay log的线程。如果状态长时间不变,说明线程可能被阻塞。

在MySQL 8.0中,可以通过replication_applier_status_by_worker表获取更详细的工作线程状态,包括当前正在执行的事务及其持续时间。

2.4 工具链辅助诊断

在掌握了基本原理和手工排查方法后,借助专业工具可以大大提升诊断效率和精度。

2.4.1 Percona Toolkit的pt-heartbeat实现毫秒级延迟检测

pt-heartbeat是Percona Toolkit中的利器,它通过在主库上定期更新一个心跳表,从库上通过读取这个心跳表的时间戳来计算精确到毫秒级别的延迟,完美弥补了Seconds_Behind_Master精度不足和易受时钟影响的缺陷。

部署方式:

- 在主库上创建心跳表:

sql

CREATE DATABASE percona;

CREATE TABLE percona.heartbeat (

ts VARCHAR(26) NOT NULL,

server_id INT UNSIGNED NOT NULL PRIMARY KEY,

file VARCHAR(255),

position BIGINT UNSIGNED,

relay_master_log_file VARCHAR(255),

exec_master_log_pos BIGINT UNSIGNED

);在主库上启动心跳更新进程:

sql

pt-heartbeat --update -D percona --interval=1 --master-server-id=1 --user=root --password=xxx在从库上监控延迟:

sql

pt-heartbeat --monitor -D percona --master-server-id=1 --user=root --password=xxx输出结果会显示当前从库与主库的时间差,单位为秒,精度可达毫秒级。这种方式不依赖系统时钟,因为pt-heartbeat会对比心跳表的更新时间和从库服务器的当前时间,如果从库时钟不准确,可以通过--check-read-only等参数规避。

2.4.2 利用SHOW BINARY LOGS和SHOW RELAYLOG EVENTS定位日志应用点

当需要精确定位复制卡在哪个事务时,可以直接查看binlog和中继日志的内容。

查看主库binlog事件:

sql

SHOW BINLOG EVENTS IN 'mysql-bin.000123' FROM 123456 LIMIT 10;这可以查看从某个位置开始的具体binlog事件,包括事件类型、事务ID、SQL语句(如果开启binlog_rows_query_log_events)等。通过对比从库Exec_Master_Log_Pos对应的位置,可以知道当前正在执行哪个事务。

查看中继日志事件:

sql

SHOW RELAYLOG EVENTS IN 'relay-bin.000456' FROM 789012 LIMIT 10;中继日志记录了I/O线程从主库拉取的事件,通过查看未被SQL线程应用的事件,可以了解积压的内容。如果发现某个事件特别大(如几MB的更新事件),可能就是导致延迟的"元凶"。

2.4.3 Prometheus+Grafana可视化延迟趋势与关联指标

手工诊断虽然精确,但难以应对复杂的场景和多变的负载。构建基于Prometheus和Grafana的可视化监控体系,可以实现延迟趋势的持续观察和多维度关联分析。

关键监控指标:

通过Prometheus的MySQL Exporter采集以下指标:

mysql_slave_seconds_behind_master:从库延迟秒数

mysql_slave_relay_log_space:中继日志占用的空间

mysql_global_status_threads_running:当前运行的线程数

mysql_innodb_rows_inserted/updated/deleted:InnoDB的行操作速率

mysql_global_status_binlog_cache_use:binlog缓存使用情况主机层面的CPU、内存、磁盘I/O指标

Grafana仪表盘设计:

将上述指标整合到一个仪表盘中,可以:

绘制延迟的时间序列图,叠加主库的TPS曲线,判断延迟是否由高写入量引起。

同时展示从库的CPU和磁盘I/O指标,识别资源瓶颈。

设置告警规则:当延迟持续超过阈值(如10秒)且持续时间超过5分钟时,触发告警。

通过可视化手段,延迟问题不再是孤立的事件,而是可以关联到负载变化、配置变更、网络抖动等多个维度的综合分析。

三、典型场景与优化案例

理论需要实践来验证,下面通过三个典型的生产案例,展示如何运用上述诊断方法论解决实际的主从延迟问题。

3.1 案例1:从库单线程回放导致的高并发延迟

场景描述:

某电商平台的订单数据库采用一主两从架构,主库承接所有订单写入,从库用于订单查询和报表分析。在大促期间,监控系统发现从库延迟持续攀升,高峰时达到3000秒以上,业务侧频繁出现订单状态查询不一致的情况。

诊断过程:

首先检查硬件层面,通过

iostat和vmstat发现从库磁盘I/O%util在30%左右,CPU使用率30%,均无瓶颈。网络延迟测试显示主从间延迟<0.5ms,带宽充足。

查看

SHOW SLAVE STATUS,发现Relay_Log_Pos与Exec_Master_Log_Pos差值巨大,但Slave_IO_Running和Slave_SQL_Running均为Yes。检查参数配置,发现

slave_parallel_workers=0,即从库使用单线程复制。而主库在高峰期TPS达到2000以上,且事务粒度小、并发高。

根因分析:

主库的高并发写入产生了大量binlog事件,但由于从库采用单线程重放,每秒能够重放的事务数远低于主库的写入TPS。随着时间推移,积压的中继日志越来越多,延迟不断增长。

优化方案:

将

slave_parallel_workers调整为16(服务器为16核CPU),slave_parallel_type设置为LOGICAL_CLOCK。重启从库复制线程使参数生效。

同时优化主库的

binlog_group_commit_sync_delay和binlog_group_commit_sync_no_delay_count,增加组提交的效率,提升binlog中可并行的事务密度。

优化效果:

调整后,从库延迟在30分钟内从3000秒降至10秒以内,高峰期延迟稳定在5秒以下,订单查询的读写一致性问题得到解决。通过监控发现,从库的CPU使用率从30%上升至70%左右,充分利用了CPU资源换取吞吐量。

3.2 案例2:主库大事务阻塞从库

场景描述:

某内容社区平台在凌晨执行数据清理任务,运维人员编写了一个DELETE语句,用于删除三年前的历史评论数据,涉及约5000万行记录。执行后,主库上该事务运行了约15分钟,随后从库延迟监控告警,延迟值从0骤升至1200秒,并在后续1小时内缓慢恢复。

诊断过程:

从延迟告警的时间点反推,正好是主库执行DELETE操作的时间段。

查看从库的

SHOW SLAVE STATUS,Exec_Master_Log_Pos在告警期间几乎停滞不动,Seconds_Behind_Master持续上升。通过

SHOW RELAYLOG EVENTS发现中继日志中正重放一个巨大的DELETE事件,影响行数达到5000万。

根因分析:

大事务在主库执行15分钟,意味着生成的binlog中包含了这个DELETE操作的所有行级变更事件(在ROW模式下)。从库SQL线程在重放时,需要逐个删除这5000万行记录,同样需要约15分钟的时间。在这期间,所有后续的事务都被阻塞在relay log中排队等待,导致延迟急剧升高。

优化方案:

立即措施:停止主库的大事务执行(如果尚未完成),避免进一步影响。

优化策略 :将大事务拆分为多个小事务。例如将一次删除5000万行改为循环删除,每次删除10万行,并在循环中设置

SLEEP间隔,降低对主库和从库的冲击。

sql

-- 伪代码示例

SET @rows = 1;

WHILE @rows > 0 DO

DELETE FROM comments WHERE create_time < '2020-01-01' LIMIT 100000;

SELECT ROW_COUNT() INTO @rows;

COMMIT;

DO SLEEP(1); -- 适当休眠,降低主库压力

END WHILE;- 长期策略 :对于数据清理类操作,建议使用

pt-archiver工具,该工具自动实现了分批删除,并能够控制删除速率,减少对复制的影响。

优化效果:

采用分批删除方案后,主库和从库的负载均保持平稳,从库延迟始终保持在5秒以内,不再出现因大事务导致的严重延迟问题。

3.3 案例3:网络抖动引发的延迟

场景描述:

某金融科技公司的主从实例部署在云上,主库位于A可用区,从库位于B可用区,通过云厂商的内网连接。业务团队发现,从库延迟在每天下午2点左右出现周期性抖动,延迟值在几十秒到几百秒之间波动,持续约15分钟后恢复正常。经过多日观察,该现象规律性出现,与业务峰值无明显关联。

诊断过程:

使用

mtr在主从之间持续运行,发现每天下午2点前后,云内网路由的第三跳出现短暂的丢包(约2%-5%)和延迟升高(从1ms上升至50ms)。检查从库

SHOW SLAVE STATUS发现,延迟抖动期间,Relay_Log_Pos与Exec_Master_Log_Pos的差值并未显著增大,但Seconds_Behind_Master出现波动。分析网络层面的监控数据,确认丢包和延迟升高与云厂商在该时段的内网维护或带宽争抢有关。

根因分析:

云内网在特定时段出现网络拥塞或路由波动,导致binlog传输出现短暂中断或速度下降。I/O线程因网络问题无法及时拉取binlog,造成从库暂时落后。当网络恢复后,I/O线程会快速追赶,但积累的relay log需要时间消化,导致延迟在一段时间内逐渐恢复。

优化方案:

短期措施 :调整从库的

slave_net_timeout参数,从默认的60秒降低至30秒,使I/O线程能更快地检测到网络中断并重连,减少闲置等待时间。中期方案:考虑将主从实例迁移至同一可用区,或使用云厂商提供的专线/直接连接服务,避免经过公网或共享内网。

长期策略 :引入

pt-heartbeat进行精确延迟监控,结合网络监控实现联动告警。当检测到网络丢包时,自动触发报警并记录相关日志,便于后续与云厂商沟通。

优化效果:

通过将主从实例迁移至同一可用区,并使用更高QoS保障的内网连接,网络丢包和延迟波动问题得到彻底解决。从库延迟稳定在1秒以内,周期性抖动消失。

四、进阶策略

当基础诊断和优化手段无法满足业务需求时,可以引入更高级的复制架构和自动化策略,进一步提升主从复制的可靠性和可观测性。

4.1 基于GTID的复制故障快速恢复

GTID(全局事务标识符)是MySQL 5.6引入的重要特性,它为每个提交的事务分配一个全局唯一的标识符(格式为server_uuid:transaction_id)。相比传统的基于binlog文件名和位置的复制,GTID复制带来了巨大的运维便利。

GTID的核心优势:

自动定位:当从库与主库断开连接后重新连接时,MySQL可以自动判断从库已经执行到哪个GTID,并自动从正确的位置开始复制,无需人工指定binlog文件和位置。这在主从切换和故障恢复场景下极为有用。

简化故障切换 :在执行主从切换时,只需要在从库上执行

STOP SLAVE; CHANGE MASTER TO MASTER_HOST='new_master' ...; START SLAVE;,MySQL会自动根据GTID的连续性找到正确的复制起点。便于识别复制拓扑:通过GTID可以清晰追踪每个事务的源头和执行路径,便于排查复制中断或数据不一致的问题。

启用GTID的注意事项:

启用GTID需要设置

gtid_mode=ON和enforce_gtid_consistency=ON。从非GTID复制切换到GTID复制需要谨慎操作,通常需要通过停机或使用

pt-online-schema-change等工具完成。GTID复制要求事务必须是确定性的,某些操作(如

CREATE TABLE ... SELECT)在GTID模式下需要改写为两条语句。

故障恢复实践:

当复制因错误中断时(如从库上执行了与主库冲突的写操作),在传统复制模式下,需要精确定位binlog位置并手动跳过错误。而在GTID复制下,可以简单地设置gtid_next跳过冲突事务:

sql

SET GTID_NEXT='conflict_gtid';

BEGIN; COMMIT;

SET GTID_NEXT='AUTOMATIC';

START SLAVE;这种简洁的恢复方式大大降低了故障处理的复杂度和时间成本。

4.2 半同步复制与增强半同步的取舍

MySQL默认的异步复制模式下,主库提交事务时并不等待从库确认,因此一旦主库故障,可能丢失已提交但尚未同步到从库的事务。半同步复制(Semi-Synchronous Replication)通过引入确认机制,在数据一致性和性能之间提供了一种平衡。

半同步复制的原理:

在半同步复制模式下,主库在提交事务后,会等待至少一个从库确认已经接收到该事务的binlog并写入中继日志后,才向客户端返回成功。这种机制保证了至少有一个从库拥有最新的数据,降低了故障切换时的数据丢失风险。

增强半同步(Loss-Less Semi-Sync):

在MySQL 5.7中引入的增强半同步(也称为无损半同步),进一步将确认点提前:主库在事务提交前就等待从库确认,确保从库的binlog已经持久化后,主库才真正提交事务。这种模式下,即使主库在事务提交前崩溃,事务也不会丢失。

性能与一致性权衡:

半同步复制会引入额外的网络往返延迟,对主库的吞吐量有一定影响。在高并发场景下,如果从库网络延迟较高或性能不足,半同步可能成为性能瓶颈。因此,选择半同步复制还是异步复制,需要根据业务对数据丢失的容忍度和性能要求综合考量:

关键业务(如金融交易、支付):强烈建议使用半同步复制,保证数据不丢失。

非关键业务(如日志分析、报表查询):可以使用异步复制,追求更高的性能。

混合策略:部署两个从库,一个采用半同步,一个采用异步,在一致性和性能之间取得平衡。

4.3 延迟监控自动化方案

当MySQL实例规模扩大后,手动诊断每个延迟问题变得不可持续。构建自动化的延迟监控和告警体系是保证系统稳定性的必要手段。

Prometheus + AlertManager集成方案:

-

数据采集 :使用Prometheus的MySQL Exporter采集每个从库的

Seconds_Behind_Master、中继日志空间、复制线程状态等指标。同时采集主机层面的资源指标,形成完整的监控数据链。 -

告警规则设计:

sql

groups:

- name: mysql_replication

rules:

- alert: MySQLReplicationLagHigh

expr: mysql_slave_seconds_behind_master > 10

for: 5m

labels:

severity: warning

annotations:

summary: "MySQL replication lag is high on {{ $labels.instance }}"

- alert: MySQLReplicationStopped

expr: mysql_slave_sql_running == 0 or mysql_slave_io_running == 0

for: 1m

labels:

severity: critical

annotations:

summary: "MySQL replication stopped on {{ $labels.instance }}"-

自动化诊断脚本 :结合告警触发,可以调用自动化诊断脚本,收集故障时刻的

SHOW SLAVE STATUS、SHOW PROCESSLIST、系统负载快照等信息,推送到运维人员的即时通讯工具或工单系统,加速问题响应。 -

智能基线预警:基于历史监控数据建立延迟的基线模型,当延迟超出正常波动范围时,即使未达到绝对阈值也触发预警,提前发现潜在问题。

通过自动化监控体系,可以将运维人员从被动响应告警中解放出来,转向主动优化和容量规划,提升整体运维效率。

结语

主从延迟问题的诊断与优化,从来不是一蹴而就的工作,而是一场需要持续投入、层层深入的持久战。通过本文的系统梳理,我们可以总结出一套行之有效的"分层排查"思维模型:

第一层:确认现象,全面采样。不要仅凭Seconds_Behind_Master的瞬时值做出判断,而是通过pt-heartbeat等工具获取精确的延迟数据,结合中继日志积压、复制线程状态等多个指标交叉验证,准确界定延迟的真实程度和持续时间。

第二层:由外向内,逐层深入。按照"网络硬件→配置参数→SQL负载"的顺序,逐层排查可能的瓶颈。从最简单的网络延迟测试开始,到磁盘I/O、CPU内存等资源分析,再到MySQL内部参数和并行复制配置,最后深入到具体的SQL语句和执行计划。这种分层方法有助于快速收敛问题范围,避免在错误的方向上浪费时间。

第三层:善用工具,数据驱动 。将SHOW SLAVE STATUS、performance_schema、Percona Toolkit等工具融入日常诊断流程,同时构建基于Prometheus+Grafana的可视化监控体系,让延迟趋势和关联指标一目了然。数据是诊断的基石,只有掌握足够的数据,才能做出准确的判断。

第四层:案例沉淀,预防为主。每个延迟问题的解决过程,都应该形成案例文档,记录根因、诊断路径和优化方案。更重要的是,将这些经验转化为预防性措施:定期巡检关键参数配置,建立大事务监控机制,设置合理的告警阈值,进行定期的容灾演练。预防性优化的投入产出比,远高于故障发生后的应急处理。

回顾全文,我们从主从复制的核心原理出发,剖析了Seconds_Behind_Master的局限性,系统阐述了网络硬件、配置参数、SQL负载三个层次的诊断方法,并通过真实案例展示了理论与实践的结合,最后探讨了GTID、半同步复制和自动化监控等进阶策略。