目录

[1. 记忆与状态管理](#1. 记忆与状态管理)

[2. 通信与集成策略](#2. 通信与集成策略)

[3. 安全性设计](#3. 安全性设计)

[1. 外显记忆型闭合(GenericAgent)](#1. 外显记忆型闭合(GenericAgent))

[2. 叙事自我型闭合(OpenClaw)](#2. 叙事自我型闭合(OpenClaw))

[3. 安全隔离型闭合(CoPaw/HiClaw)](#3. 安全隔离型闭合(CoPaw/HiClaw))

一、前言

仅供参考,未经实验验证。

二、设计思路的异同点

https://github.com/lsdefine/GenericAgent?tab=readme-ov-file#chinese https://github.com/ultraworkers/claw-code https://github.com/OpenCoworkAI/open-cowork?tab=readme-ov-file https://github.com/openclaw/openclaw https://github.com/agentscope-ai/CoPaw

我想知道这些的设计思路的异同点

基于对这五个代码库的调研,我从架构哲学 、技术实现 、自主性与协作模式三个维度为你分析它们的设计思路异同:

一、架构哲学对比

项目 核心哲学 代码规模/架构特点 关键隐喻 GenericAgent 自进化极简主义 "Don't preload skills --- evolve them" ~3,300行核心代码,92行Agent Loop,7个原子工具 种子生长:从极小种子代码生长出个人专属技能树 claw-code 洁净室重写与性能优先 基于泄露代码的Python/Rust重写,强调"Better Harness Tools" Rust核心追求内存安全与高并发,Python版本降低门槛 工具驾驭:专注如何让LLM更好地"驾驭"工具链 OpenClaw 本地优先的持久化自主 "给AI一双手"的编排层 ~43万行TypeScript,Gateway+Pi Agent双架构 数字员工:通过SOUL.md定义身份,HEARTBEAT.md实现主动心跳 open-cowork 桌面级协同工作流 受Claude CoWork启发,强调"Co-Working"关系 Tauri+React桌面应用,Session-based工作流 结对编程:人类提供方向,AI处理迭代执行 CoPaw 企业级安全与多Agent协作 AgentScope生态的个人端 Python后端,支持本地/云端,强调多层安全 数字助手:"Co Personal Agent Workstation"温暖的小爪子 二、技术实现差异

1. 记忆与状态管理

GenericAgent: Skill树自动沉淀,每次任务执行路径固化为可复用Skill

OpenClaw: Markdown-based持久记忆(SOUL.md + MEMORY.md),SQLite向量存储,支持跨会话记忆

CoPaw: 与ReMe记忆框架深度集成,支持文件级和向量级记忆,计划中的体验蒸馏与技能提取

claw-code: 基于Rust运行时的Session状态压缩与MCP编排

open-cowork: Session-based上下文绑定,工作目录感知,流式输出

2. 通信与集成策略

OpenClaw/CoPaw: 消息优先(Messaging-first),原生集成WhatsApp、Telegram、Slack、Discord、飞书、钉钉等

GenericAgent: 系统级控制(浏览器、终端、文件系统、移动设备ADB),更像"系统代理"

open-cowork: IDE/桌面集成,文件I/O、PowerShell/Bash、代码搜索的原生工具箱

claw-code: 专注代码编辑器集成,LSP客户端支持,API客户端抽象

3. 安全性设计

CoPaw: 多层安全(Tool guard、文件访问控制、技能安全扫描),强调企业级安全

claw-code: Clean-room重写规避法律风险,Rust内存安全保证

open-cowork: 显式权限模式,工具调用可视化,破坏性操作确认

OpenClaw: 41.7%社区技能存在安全漏洞暴露出的安全隐忧

三、自主性与协作模式

自主性光谱

项目 自主性级别 实现机制 触发方式 OpenClaw 高(主动式) Cron心跳机制(HEARTBEAT.md),无需人工提示自主检查任务 时间/事件驱动 GenericAgent 中(进化式) 自动Skill沉淀与复用,但需人工触发任务 人工触发,自动优化 CoPaw 中(协作式) Agentic Ralph Loop进行中,支持多Agent并行协作 人工+调度触发 open-cowork 低-中(辅助式) 人提供方向,AI处理执行,强调Human-in-the-loop 人工主导 claw-code 工具依赖 通过MCP(Model Context Protocol)编排工具链 API调用 多Agent协作架构

CoPaw: 独立Agent+协作Skill模式,每个Agent有独立角色,通过协作Skill通信

open-cowork: 主Agent协调并行子Agent处理多维度问题(如重构模块+更新测试)

HiClaw(CoPaw企业版): Manager-Workers架构,Manager集中调度多个Workers

OpenClaw: 原子Agent(Atomic Agents)通过高速消息总线通信,防止推理漂移

四、关键设计取舍

相同点(趋同趋势)

本地优先(Local-first):所有项目都强调数据留在本地,避免第三方托管

配置驱动:均使用Markdown/YAML/JSON配置定义Agent行为(SOUL.md、skill定义等)

工具扩展性:都支持通过Skill/Plugin/MCP机制扩展能力

多模型兼容:均支持Claude、GPT、Kimi等主流模型切换

不同点(差异化定位)

轻量化 vs 全功能:GenericAgent追求3,300行代码的极简,OpenClaw则是43万行的全栈框架

主动式 vs 响应式:OpenClaw的Cron心跳实现真正主动Agent,其他多为响应式

个人 vs 企业:CoPaw+HiClaw形成个人/企业双轨生态,OpenClaw偏向个人生产力,open-cowork聚焦开发者桌面场景

技术栈选择:claw-code选择Rust追求性能,GenericAgent选择Python追求极简,open-cowork选择Tauri追求跨平台桌面体验

总结

这五个项目代表了当前AI Agent框架的不同演进路径:

GenericAgent 探索了"代码极简但能力可进化"的边界

claw-code 代表了社区对工业级代码的逆向工程与重构能力

OpenClaw 定义了"有手的AI"的本地自主代理标准

open-cowork 专注于开发者桌面的实时协作体验

CoPaw 试图构建安全可控的企业级多Agent基础设施

它们共同指向一个未来:AI Agent正从"聊天界面"进化为"环境嵌入、自主决策、持续记忆"的数字同事。选择哪个框架取决于你更看重极简代码(GenericAgent)、主动自治(OpenClaw)、桌面集成(open-cowork)还是企业安全(CoPaw)。

三、与认知循环架构的区别和联系

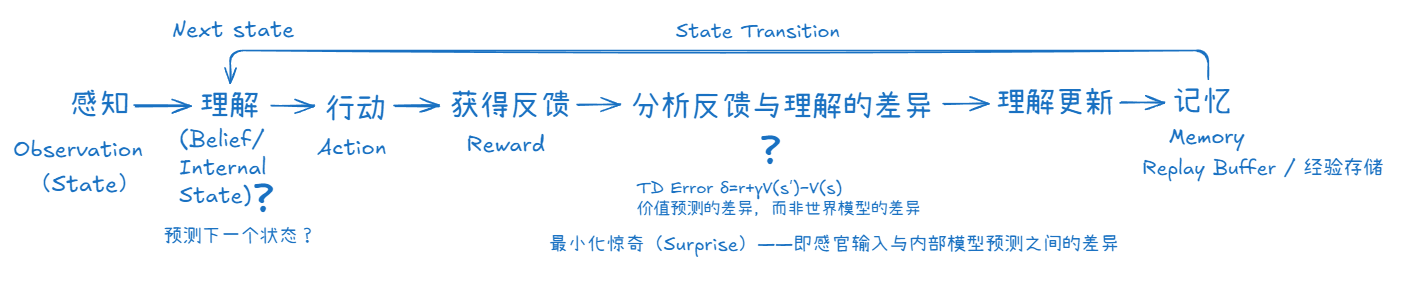

比对一下它们跟认知循环架构:感知、理解、行动、获得反馈、分析反馈与理解的差异、理解更新、记忆、下一轮理解受到了记忆的影响,比对它们各自与该认知循环架构区别和联系

从认知循环架构 (Cognitive Loop Architecture)的视角来看,这五个项目代表了工程化实现"感知→理解→行动→反馈→分析差异→更新理解→记忆沉淀→记忆影响下一轮感知"这一完整闭环的不同范式。它们在认知闭合方式 、记忆外化形式 、理解更新机制三个维度存在本质差异。

一、认知循环架构的映射对比

标准认知循环: 感知(Perception) → 理解(Understanding) → 行动(Action) → 反馈(Feedback) → 差异分析(Discrepancy) → 理解更新(Update) → 记忆(Memory) → 记忆影响感知(Memory-influenced Perception)

项目 感知阶段特征 理解阶段机制 行动执行 反馈回路 记忆外化形式 理解更新方式 认知闭合特点 GenericAgent 7个原子工具的多模态感知(系统、网络、ADB等) Skill-based意图映射:将任务匹配到Skill描述空间 原子工具链执行(Python/bash) 工具输出直接回传LLM,形成即时反馈 显性Skill文件(可复用子任务路径的JSON/YAML描述) 非参数化更新:新Skill通过Prompt注入,不修改模型权重,形成"外挂式"理解进化 递归Skill沉淀:每轮循环产生的新Skill成为下一轮感知的"认知滤镜" claw-code MCP协议标准化的感知:通过Model Context Protocol将IDE/文件系统转为LLM可解析的上下文 工具编排映射:将自然语言意图映射到MCP工具调用图 代码编辑器操作+LSP客户端执行 LSP诊断+执行结果的技术反馈 Session级状态压缩:Rust运行时的内存状态,缺乏跨Session持久化 即时推理调整:依赖LLM内化的上下文学习(In-context Learning),无显性的理解积累机制 工具链闭环:MCP协议标准化了反馈格式,但未形成跨任务的认知积累 OpenClaw 主动式感知:Cron心跳机制(HEARTBEAT.md)主动轮询环境变化,突破请求-响应模式 自我定义式理解:SOUL.md作为"自我"认知锚点,指导任务分解的方向性 原子Agent+消息通信(原子化、高并发) 消息总线广播+Markdown记忆文件重写 叙事性记忆:SQLite向量存储+Markdown文档(SOUL.md/MEMORY.md)构成"自我叙事" 叙事重写:通过修改SOUL.md更新"自我"认知,下一轮理解受更新后的"身份定义"引导 叙事循环:记忆以自然语言叙事形式存在,理解更新表现为"自我故事"的版本迭代 open-cowork IDE上下文绑定感知:工作目录、代码结构、Session状态的强耦合 协作式理解:Planning阶段人工介入,人类意图与AI理解双向校准 并行子Agent执行(主Agent协调多维度子任务) 流式输出+人工检查点(Human-in-the-loop显式确认) Session级上下文绑定:跨对话保持的工作目录状态,但缺乏长期记忆结构 人工引导更新:理解更新主要依赖人工指令修正,Agent执行而非学习 人机协同闭合:人类在差异分析环节强制介入,认知循环由人类完成最终闭合 CoPaw 安全过滤感知:Tool Guard在感知层前置风险拦截,安全扫描后才进入理解阶段 分布式理解:Manager-Workers架构(HiClaw)将复杂任务分解为多Agent的分布式理解 技能执行(Skill)+多Agent协作(通过协作Skill通信) Tool Guard监控的执行结果+ReMe框架的经验记录 结构化记忆(RalphMemory):文件级+向量级双轨存储,计划中的"经验蒸馏"将对话转为结构化技能 渐进式理解更新:计划中的Experience Distillation将非结构化经验转为结构化Skills,形成渐进式认知进化 生态级闭合:与ReMe记忆框架分离但协同,认知循环外包给专门的记忆管理系统 二、关键差异:认知闭合的三种范式

1. 外显记忆型闭合(GenericAgent)

认知循环断裂点 :理解更新不发生在模型内部,而是通过Skill文件的外化实现。

记忆形式 :Skill是"可执行的理解"------将任务解决路径固化为自然语言描述+工具调用序列,存储在

user_skills.json中影响机制 :每轮任务开始时通过"Skill Selection"将历史Skill作为Prompt前缀注入,形成RAG式的记忆检索

与标准认知循环的差异 :标准循环假设理解更新是内部表征的调整(如神经网络权重更新),而GenericAgent将理解更新视为外部代码库的追加,模型本身永远是" virgin "状态,通过上下文窗口加载历史认知

独特优势:实现了"零遗忘"------不会因为微调而损失旧能力,且Skills可版本控制、人工审计、跨Agent迁移。

2. 叙事自我型闭合(OpenClaw)

认知循环断裂点 :通过Markdown叙事构建"自我"的连续性,记忆影响感知的方式是"身份定义"的约束。

SOUL.md的作用:不仅是配置,更是Agent的"自传体记忆"(Autobiographical Memory)。它定义了Agent的价值观、工作方式、历史决策模式

理解更新的本质 :当Agent完成一轮任务,它会重写SOUL.md中的"Recent Experiences"和"Skill Progression"章节,这相当于修改自我的叙事脚本

与标准认知循环的差异 :标准循环的记忆是"数据积累",而OpenClaw的记忆是**"身份重构"**------下一轮Agent阅读更新后的SOUL.md,会基于新的"我是谁"来重新诠释感知到的信息

独特优势:实现了人格一致性(Persona Consistency),即使跨Session,Agent仍能维持"自我"的连续性,避免"金鱼记忆"导致的认知碎片化。

3. 安全隔离型闭合(CoPaw/HiClaw)

认知循环断裂点 :在标准循环的每个环节插入安全控制点,认知闭合被安全策略中介。

感知层的预过滤 :Tool Guard在信息进入理解阶段前进行风险扫描,这相当于感知层的认知防火墙

分布式理解的风险分散:Manager-Workers架构将复杂理解分解为多个受限Worker的局部理解,避免单点认知偏差导致系统性风险

记忆的安全蒸馏 :ReMe框架的Experience Distillation不仅是理解更新,更是安全审计后的经验提纯------只有符合安全策略的经验才被允许沉淀为Skills

与标准认知循环的差异 :标准循环假设认知过程是"信息无损传递",而CoPaw认为认知即风险,每个环节都需要权限验证和沙箱隔离

独特优势:实现了企业级的认知鲁棒性,通过将"分析反馈与理解的差异"环节显性化为安全扫描,防止认知偏差导致的破坏性行为。

三、与标准认知循环的结构性偏离

理解更新的位置差异

GenericAgent :理解更新发生在行动后 (任务完成后沉淀Skill),属于后验学习

OpenClaw :理解更新贯穿全程(SOUL.md随时可被自身修改),属于自指学习

claw-code :理解更新缺失 (依赖LLM的静态能力),属于无学习推理

open-cowork :理解更新被人工替代 (人类分析差异并下达新指令),属于人机协同学习

CoPaw :理解更新外包 (由ReMe框架专门处理),属于分布式认知

记忆对感知的影响机制

项目 影响机制 认知科学类比 GenericAgent Skill作为"认知滤镜":感知信息先经过Skill描述空间匹配,决定调用哪些历史经验 图式理论(Schema Theory):用已有Skill框架筛选感知信息 OpenClaw SOUL.md作为"自我实现的预言":Agent基于自我定义选择性注意环境信息 自我知觉理论(Self-Perception Theory):行为受自我概念引导 CoPaw RalphMemory作为"内隐记忆":通过向量相似度自动关联历史经验,无需显性检索 内隐记忆(Implicit Memory):无意识的经验影响当前判断 open-cowork Session上下文作为"工作记忆":短期保持的认知状态影响当前任务理解 工作记忆模型(Working Memory):有限的短期存储 claw-code 无记忆影响:每轮感知都是独立的,受限于LLM的上下文窗口 金鱼认知:缺乏跨周期的记忆连续性 四、深层联系:从单体认知到分布式认知

这五个项目共同展示了认知循环架构的工程化演进路径:

claw-code 代表去认知化 :将理解完全外包给LLM,自身仅保留工具编排,适合认知外包场景(工具执行器)

open-cowork 代表人机混合认知 :人类承担"分析反馈与理解差异"的核心环节,Agent负责行动,适合高不确定性创意场景(结对编程)

GenericAgent 代表外显认知 :通过Skill文件将认知过程显性化、可审计,适合需要可解释性的自动化场景(个人工作流)

OpenClaw 代表叙事认知 :通过自我叙事维持认知连续性,适合长期陪伴型Agent(数字员工)

CoPaw 代表安全认知 :在认知循环中嵌入安全控制,适合企业级高风险场景(生产环境部署)

最终结论 :这五个项目并非简单实现认知循环,而是分别解构了认知循环的不同环节------claw-code解构了"理解"(外包给LLM),GenericAgent解构了"记忆与更新"(外化为Skill文件),OpenClaw解构了"自我连续性"(叙事性记忆),CoPaw解构了"安全控制"(分布式安全),open-cowork解构了"人机分工"(人类保留差异分析权)。它们共同构成了从"工具"到"同事"的认知光谱。