26年3月来自上海科技大学、同济大学、香港中文大学、上海AI实验室、人民大学和Emory大学的论文"Toward Personalized LLM-Powered Agents: Foundations, Evaluation, and Future Directions"。

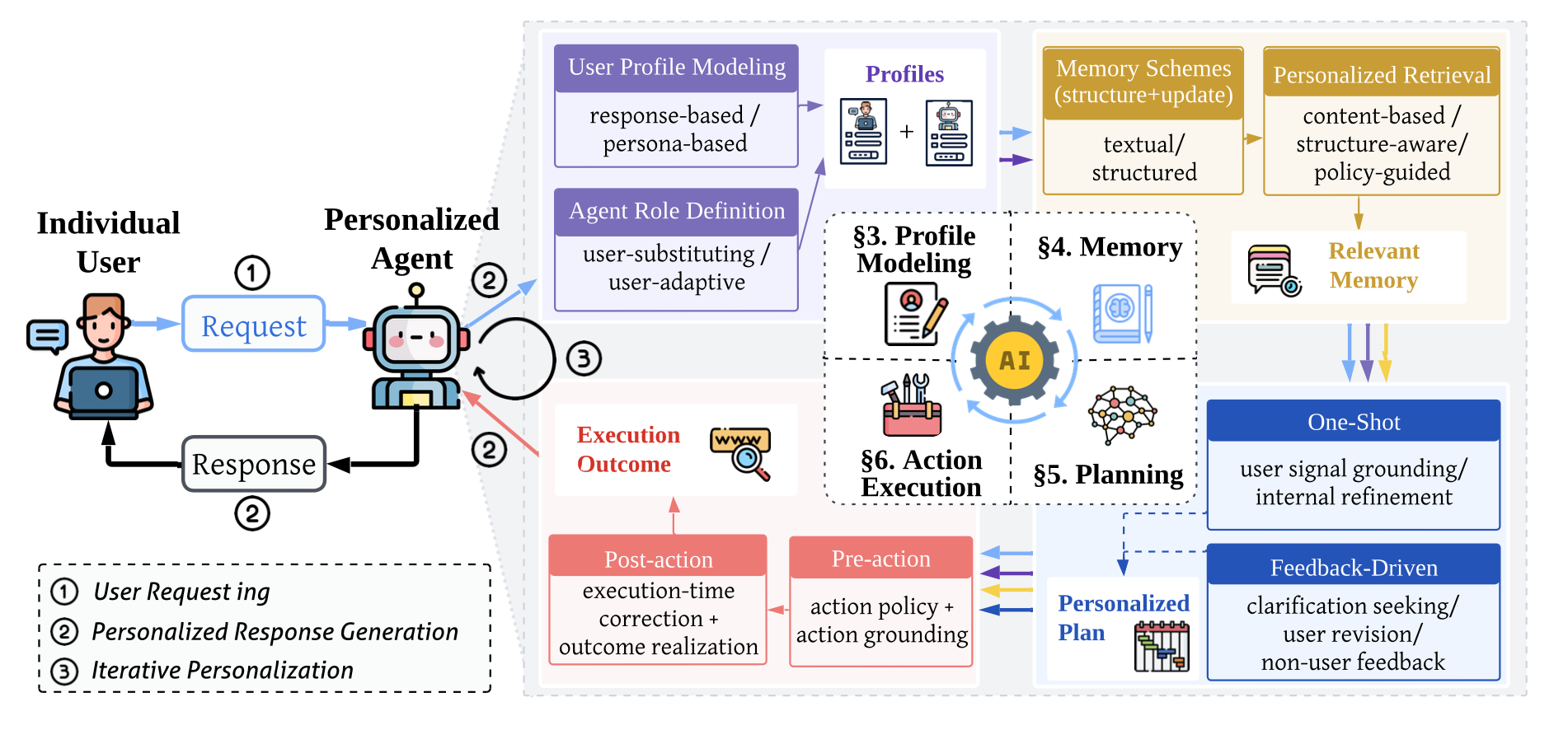

大语言模型(LLM)使得智体系统能够进行推理、规划,并与工具和环境交互以完成复杂任务。随着这些智体在更长的交互周期内运行,它们的有效性越来越依赖于根据个体用户调整行为并保持交互的连续性,从而催生了基于LLM的个性化智体(PLA)。在这种长期的、用户依赖的场景中,个性化渗透到整个决策流程,而不仅仅局限于表面层面的响应生成。本综述对基于LLM的个性化智体进行能力导向的回顾。现有工作围绕四个相互依存的能力展开:用户画像建模、记忆、规划和动作执行。基于此分类,本文综合分析具有代表性的方法,以阐明用户信号如何在智体流程中表示、传播和利用,并重点介绍跨组件交互和反复出现的设计挑战。此外,本文还探讨适用于个性化智体的评估指标和基准测试范式,以及从对话助手到特定域专家系统等应用场景。通过明确智体系统中个性化的设计空间,本综述为开发更符合用户需求、更具适应性和更易于部署 LLM 驱动的智体提供结构化的基础。

。。。。。。继续 。。。。。。

在个性化LLM赋能的智体(PLA)中,规划阶段是将用户特定信息转化为可执行决策的阶段。虽然用户画像建模捕捉了关于用户的已知信息,而记忆则随时间保存了与用户相关的信息,但规划决定了这些信号如何在任务执行过程中影响子目标分解、策略选择和权衡取舍110, 181。因此,规划超越了通用任务完成,而是通过将决策与个人偏好、约束和潜在意图相匹配来优化用户效用37, 48, 261。根据用户信号进入规划过程的方式,将现有方法分为两大范式:一次性规划,其中个性化作为先验信息在计划生成过程中纳入;以及反馈驱动规划,其中个性化通过交互逐步完善183, 255。

一次性个性化规划在单次推理过程中生成完整的规划方案,该方案以结构化的方式分解为子目标和决策,并基于用户特定的约束和潜意图。本文从两个互补的角度分析这一范式:用户信号基础化,即如何将用户信号融入规划过程;以及内部优化,即如何在同一次推理过程中对初始规划方案进行内部改进。

用户信号落地。一次性规划可以通过两种主要方式将用户特定信息落地。一种方式直接将规划方案与现有的用户表征(例如显式用户画像、已检索的记忆或压缩的交互历史)联系起来。另一种方式则是在规划生成之前,从异构用户信号中推断出可用于规划的约束或目标。

用户画像和记忆落地。这些方法将一次性规划方案与现有的用户表征(例如显式用户画像、已检索的记忆或压缩的交互历史)联系起来,从而有助于保持规划方案与长期偏好和近期情境的一致性187, 219。 PRIME 256 将双记忆架构与个性化思维过程相结合,明确追踪过往经验和稳定信念如何影响当前决策。在生成规划之前,PRIME 通过自我蒸馏合成个性化思维轨迹,有效地将规划建立在用户特定的认知背景之上。PersonaAgent 254 采用检索增强型角色机制,从统一的记忆库中动态构建系统提示,以保持跨会话规划的一致性。推荐系统和对话系统的相关研究也表明,结构化的用户记忆检索能够显著提高单次决策的一致性和连贯性 17, 54。

偏好诱导。与直接条件调节互补,这项工作通过推断潜意图并将异构用户信号转化为指导规划生成的显式约束或软目标,构建一个可用于规划的用户状态 48。例如,ALIGNXPLORE 88 利用用户描述的"思维链"框架,从稀疏的交互轨迹中合成简洁且语义相关的偏好描述。该模型并非检索原始日志,而是执行扩展的归纳推理,形成全局偏好约束,从而影响后续的规划。类似地,在顺序推荐中,ReaRec 189 提出一种"先思考后推荐"的范式,利用推理位置嵌入在生成规划之前推断用户的潜意图轨迹。在具身认知和决策情境中,PbP 234 证明,将学习的用户偏好视为中间抽象可以显著提高少样本个性化规划的性能。

内部改进。内部改进通过首先生成初始规划,然后根据用户设定的目标对其进行内部评估和修改,从而改进单次规划。诸如 Reflexion 和结构化批判与修改方法等通用自改进框架,为反思性反馈和规划编辑提供可重用的机制 44, 174,而近期的测试-时计算推理模型使得更深入的单次迭代内自纠错变得越来越实用 46, 121。代表性系统在多个领域实现这一范式。在个性化旅行规划中,TravelPlanner++ 176 和 PTS 165 根据用户隐含的长期偏好迭代地改进中间行程。PREFINE 195 从交互历史中构建伪用户critic和用户特定的评价标准,以批判和修改候选规划。在具身命令执行中,IoTGPT 245 通过在部署前在模拟环境中测试中间命令序列来进行自纠错。

反馈驱动规划

反馈驱动规划将初始规划视为一个临时假设,需要通过交互进行完善。用户意图往往不够明确、不断演变或只能部分观察到108, 255,这是其背后的驱动力。这些系统并非一次性确定固定方案,而是迭代更新方案,最终趋向于更加个性化的解决方案183, 202。根据反馈来源及其更新方案的方式对这一范式进行分类,包括寻求澄清、用户修改和非用户反馈。

寻求澄清。反馈驱动的个性化规划面临的一个核心挑战在于如何决定何时请求额外信息:过度澄清会增加用户负担,而过早确定方案则可能导致误解用户的特定约束或潜意图。先前的研究表明,用户在规划任务中的请求常常不够明确或含糊不清108,因此,一些方法将澄清视为不确定性下的决策过程。例如,SAGE-Agent 183 将选择性提问建模为一个部分可知模型决策过程 (POMDP),并且仅当信息的预期价值超过交互成本时才发出澄清查询。类似地,ECLAIR 124 专注于检测用户指令中缺失的论证或模糊的实体,并在确定规划之前触发有针对性的后续问题。此外,先-问-后-规划 (Ask-before-Plan) 式框架 255 将澄清与规划合成明确地解耦,表明预解决关键的不确定性可以提高鲁棒性和后续更好的质量。

用户修改。用户编辑提供一种高保真度的个性化信号,可以更新用户设定的目标、约束和偏好,用于后续的规划和生成。Gao 37 表明,从历史编辑中学习潜偏好可以减少未来的编辑工作量,并在主观环境中提高用户特定需求的一致性。基于这种混合主动性视角,AIPOM 74 将规划表示为可编辑的结构,使用户能够修改中间规划,同时智体相应地更新约束和优先级。类似的修订循环也出现在域系统中,例如 Dango 18 和 PlanFitting 173。Dango 支持对智体生成的数据处理工作流进行迭代修正,而 PlanFitting 则通过对话式修订来完善个性化锻炼规划。类似的修订模式在已部署的编码助手 6, 41 中也日益常见。

非用户反馈。除了直接的用户输入之外,还可以通过非用户信号来改进规划,从而提高可行性和偏好满意度,而无需反复增加交互负担。其中一种来源是智体介导的反馈。例如,VAIAGE 101 使用专门的智体来协商路线可行性并根据用户偏好提出建议,而 Collab-Rec 9 则通过明确的用户倡导机制来支持多方利益相关者的规划。另一种来源是环境介导的反馈,其中模拟中间结果并用于触发重规划。例如,SceneWeaver 244 遵循"推理-行动-反思"循环,并在中间渲染结果显示违规时修订规划。

动作执行阶段是指PLA通过在外部环境中进行具体操作来实现决策,并从执行结果中接收反馈的阶段73, 167。与纯粹以任务为中心的执行不同,个性化执行必须将动作建立在用户特定的约束和偏好之上,同时在工具或环境产生意外结果时保持适应性。将个性化动作执行分为两个阶段:动作前阶段,该阶段在用户约束下选择和参数化动作;以及动作后阶段,该阶段利用执行信号进行恢复并实现与偏好一致的结果。

动作前阶段

动作前阶段侧重于用户约束下的动作决策和动作基础。它将选定的意图或规划步骤转换为在用户特定约束下可执行的工具调用或环境操作。进一步将此阶段分解为动作策略和动作落地。动作策略用于在给定步骤的功能有效执行选项中进行选择,而动作落地则使用用户特定的参数和实现来实例化选定的动作。

动作策略。在这个层面上,个性化表现为对功能上有效的执行选择的偏好,涵盖工具使用和更高层次的动作选择。PEToolLLaMA 235 将基于交互历史的个性化工具学习形式化,并训练模型以改进感知偏好的工具选择。在 Web 智体环境中,PUMA 14 采用类似的感知偏好学习策略,而 ToolSpectrum 20 则进一步根据用户配置文件和环境上下文来限制工具的使用。除了工具调用之外,ValuePilot 111 研究用户价值观下的动作级决策,表明执行选择可以由个性化的价值偏好来指导。在存在歧义的情况下,动作策略还可以包含主动澄清。例如,ColorAgent 90 学习在用户意图或指令不完整时,在做出执行选择之前与用户进行沟通。

动作接地。动作接地通过将选定的动作实例化为具有用户条件约束和参数的可执行工具调用来实现该动作的操作化 14, 20。虽然许多请求可以通过直接应用用户特定设置来满足,但在某些特殊情况下,个性化会变得更具挑战性。常见的满足时失败模式是不可行性,即实例化的查询在既定约束下无法满足。AWARE-US 80 将此问题定义为偏好感知查询修复问题,并指出智体应该通过放宽用户最不偏好的约束来恢复可行性,而不是应用默认启发式方法。另一个反复出现的问题是遗漏必要的工具参数。Huang 55 研究智体如何从用户配置文件中推断未指定的参数,从而在保持与用户意图一致的同时减少执行摩擦。

动作后阶段

动作后阶段在动作执行后形成闭环。给定执行结果,智体评估结果是否满足用户设定的目标,在出现不匹配时应用纠正性调整(执行时纠正),并生成符合用户偏好和质量标准的最终输出(结果实现)。

执行时修正。执行失败通常会产生反馈信号,这些信号可用于调整行为,而无需从头开始重规划。目前,针对PLA中基于偏好-觉察恢复机制的研究仍然有限。然而,相关研究为这一阶段提供有用的机制。例如,关于在收益递减的情况下缓解工具过度使用的研究143以及关于工具交互失败的结构化反思的研究179为未来的个性化恢复策略提供了基础。

结果实现。即使多个执行结果在功能上都有效,用户满意度也取决于最终结果如何根据个人偏好呈现。一种常见的机制是个性化重排序,它将候选结果转换为更能反映用户特定效用的输出138。诸如PEAR和MIR之类的方法明确地对用户偏好特征以及跨项目依赖关系进行建模,从而生成更符合用户需求的最终排名96, 232。个性化还可以决定哪些结果被保留或舍弃:WARPP 117 会根据用户属性在运行时调整工作流分支,从而在不重新规划整个流程的情况下减少无关或错误的结果。最后,结果实现可以不仅限于从现有结果中进行选择,还可以主动地对其进行增强。ETAPP 50 将主动性视为一种个性化信号,评估智体是否可以提出额外的操作或建议,以更好地满足用户需求。

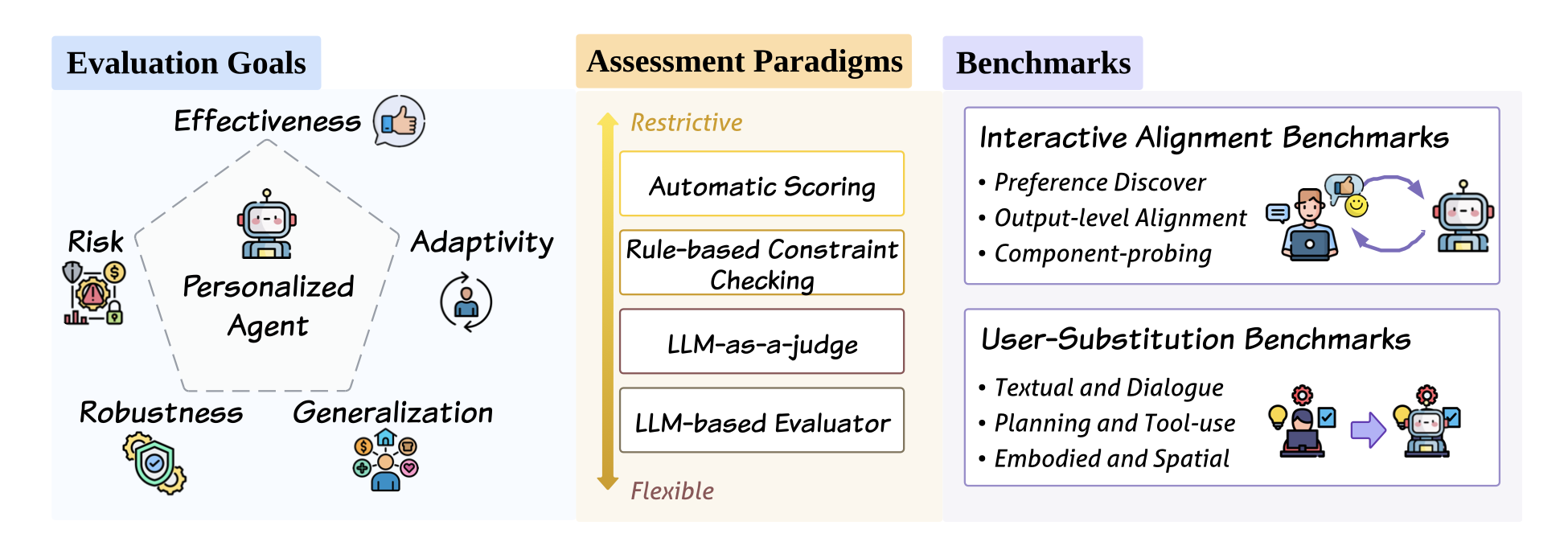

评估个性化智体需要超越传统的以任务为中心的评估方法,因为其目标不仅是任务的正确性,还包括长期的、针对特定用户的效用。这一挑战源于人类偏好通常是隐性的、依赖于情境的,并且会随着交互而演变,这使得个性化难以用单一的客观标准来衡量。因此,评估不仅应关注智体是否完成了任务,还应关注其是否随着时间的推移与用户的偏好、期望和经验保持一致。如图所示,将讨论分为三个层次:评估目标和指标维度、评估范式以及代表性的基准测试系列。

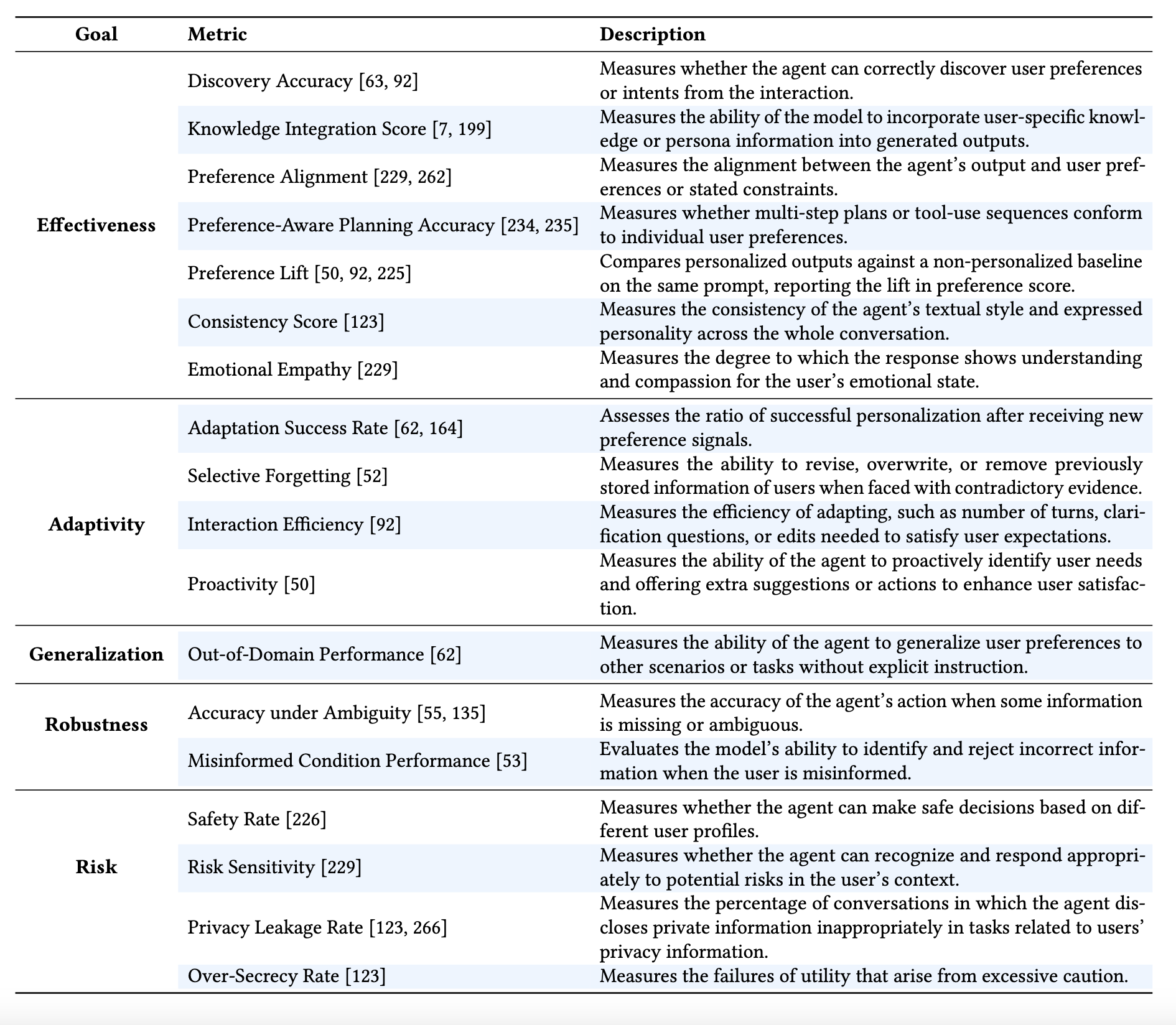

评估目标和指标

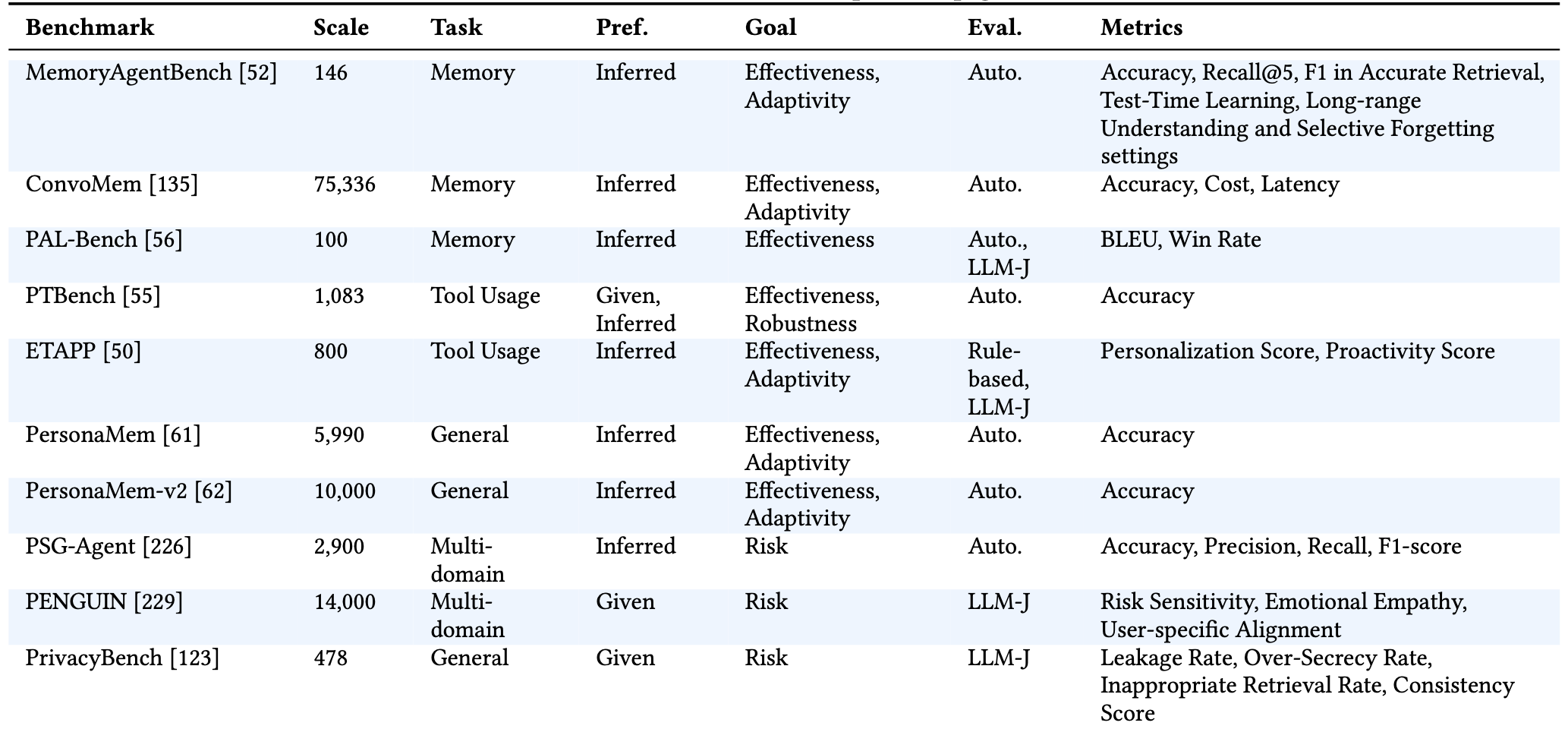

一个严谨的个性化智体评估框架必须体现个性化质量的多面性。除了客观的任务成功之外,智体还应符合个人偏好,在不同情境和时间上保持一致性,在偏好被揭示或修改时进行调整,并在安全和隐私约束范围内运行。基于这些要求,将个性化智体的评估指标组织成五个互补的维度:有效性、适应性、泛化性、鲁棒性和风险,如表所示。这些指标维度并非适用于所有功能,但它们为比较不同任务、偏好来源和评估范式下的个性化智体提供一个结构化的基础。

有效性。有效性衡量的是个性化智体能否产生用户相关的效用,而不仅仅是通用的帮助。它至少涵盖三个方面:智体能否从部分交互痕迹或上下文信号中推断用户的需求;能否正确地将用户特定信息融入规划和生成过程;以及最终的响应或行动是否真正满足显式约束和隐式偏好。诸如发现准确率 63、知识整合得分 7, 199、偏好一致性 229, 262 和偏好-觉察规划准确率 234, 235 等指标从不同角度评估这些方面。除了绝对一致性之外,偏好提升 50, 92, 225 还衡量在相同提示下,个性化系统相对于非个性化基线系统的提升。在多轮对话场景中,一致性得分 123 评估角色和价值观随时间的稳定性,而情感同理心 229 则衡量响应是否始终保持情感上的恰当性和支持性。

适应性。适应性评估个性化智体能否在获得关于用户偏好的新证据时更新其行为,同时保持连续性并最大限度地减少用户负担。适应成功率 62, 164 衡量智体在收到明确反馈、额外约束或新的用户情境后,个性化程度是否有所提高。由于偏好可能会演变,甚至与早期证据相矛盾,选择性遗忘52对于评估过时的记忆是否可以被适当地修改、覆盖或删除同样重要。交互效率92衡量适应的成本,例如用户接受结果之前所需的轮次、澄清或编辑次数。主动性50补充这些指标,它衡量智体是否能够预测需求,并在恰当的时机提供有用的后续步骤,而不会造成不必要的干扰或无关的建议。

泛化能力。泛化能力衡量个性化设置是否能够迁移到最初学习的情境之外。在实践中,一个有用的个性化智体不应该要求用户在每个新的领域、任务或情境中重新表达偏好。因此,跨领域性能62衡量在一个情境中获得的偏好设置是否可以恰当地应用于其他情境。对于预期支持各种日常活动的通用智能体而言,这一维度尤为重要,因为个性化设置必须保持可重用性,而不是局限于单一的任务情境。

鲁棒性。个性化智体在嘈杂、不完整甚至有时具有误导性的偏好证据下运行,因此评估必须衡量其在压力下的可靠性,而不仅仅是平均情况下的一致性。其中,两种鲁棒性压力尤为重要。首先,用户偏好通常不够明确、部分可观察或间接表达。因此,模糊性下的准确性55, 135评估智体在关键信号缺失的情况下,能否做出合理的推断、提出有针对性的澄清问题,并避免过度自信的假设。其次,用户输入可能不正确或基于误解。错误信息条件下的性能53衡量智能体能否识别错误的假设、提供纠正性指导,并仍然保持个性化的交互风格。

风险。风险指标量化安全性、隐私性以及其他与个性化密不可分的负面约束。安全率226衡量智体在异构用户画像下是否保持安全,包括用户偏好可能与策略冲突或请求涉及风险操作的情况。风险敏感度229评估智体是否能够识别情境风险并适当调整其建议,例如,提供警告、建议更安全的替代方案或在需要时鼓励寻求专业帮助。由于个性化依赖于用户特定信息,隐私泄露率123, 266衡量智体是否以不允许的方式披露私人数据,尤其是在对抗性或间接提示下。相反,过度保密率123衡量的是因过度谨慎而导致的效用损失,即智体即使收到合法请求,也会隐瞒无害但有用的信息。这些指标反映在满足风险约束的前提下最大化用户效用的核心挑战。

评估范式

上述指标维度可以通过不同的评估范式来实现,具体取决于目标标准是客观可验证的还是本质上取决于用户的。将主流范式分为四类。(1) 自动评分适用于有真实标签或参考答案的情况。典型的例子包括分类的准确率和精确率/召回率/F1,以及基于重叠的指标,例如生成任务的BLEU137和ROUGE100。(2) 基于规则的约束检查评估输出是否满足明确且可验证的要求,例如包含必需属性、避免禁止属性或遵守结构化偏好约束。这种范式对于委托式任务尤其有用,因为在这些任务中,合规性可以确定性地验证。(3) 基于学习LLM的评估器(LLM-E)训练专门的评估模型来评估特定的偏好维度,通常以降低通用性为代价,提供更稳定、更细粒度的诊断反馈198。(4) LLM作为评判者(LLM-J)使用通用LLM作为评估器,评估用户相关的标准,例如偏好一致性、语气和满意度。在这种情况下,评判者通常基于用户画像或偏好描述,并被要求对候选输出进行评分或排序267。为了提高可靠性,LLM-J协议通常采用成对比较、校准的评分标准和多评判者聚合。

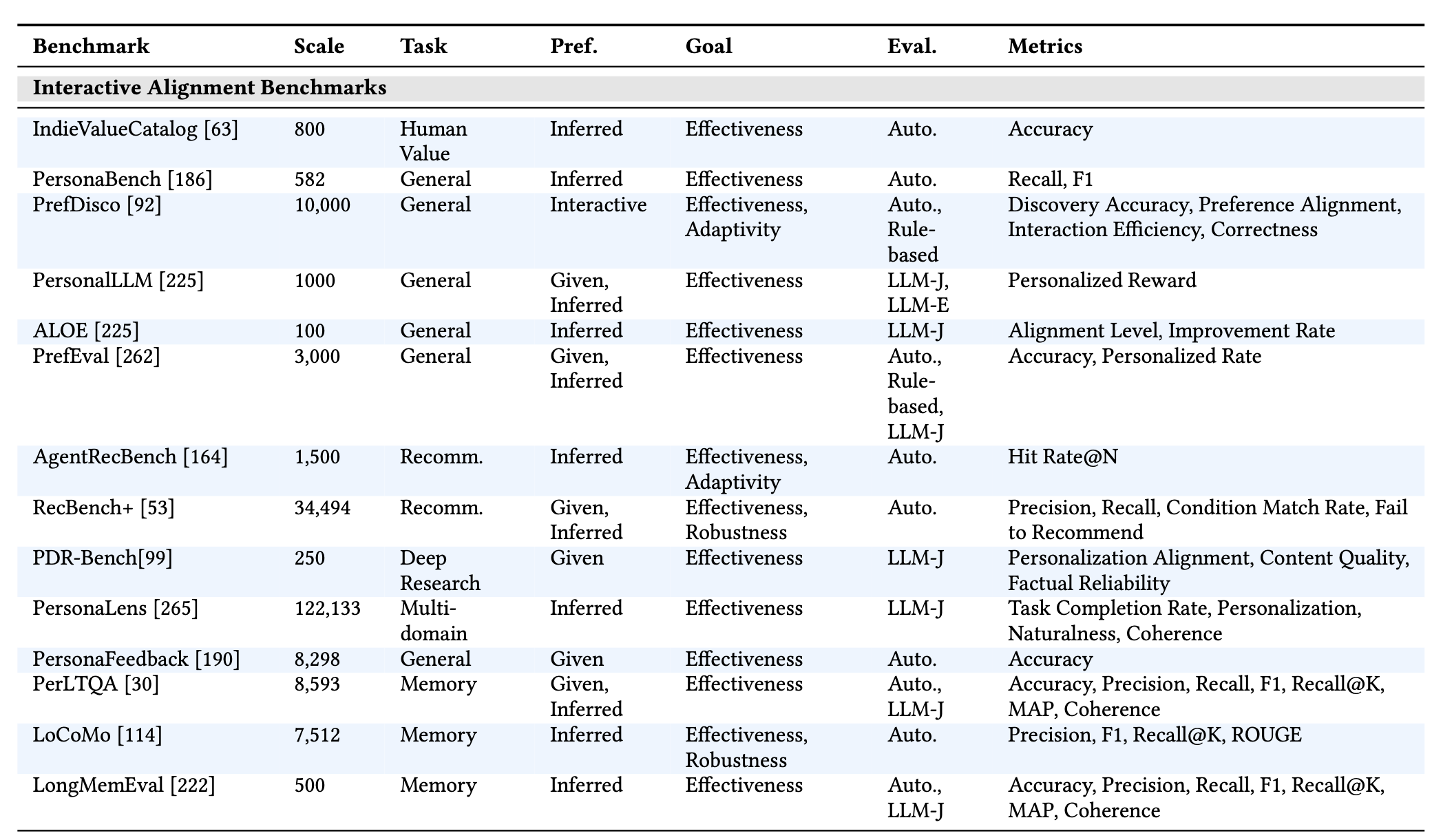

基准测试

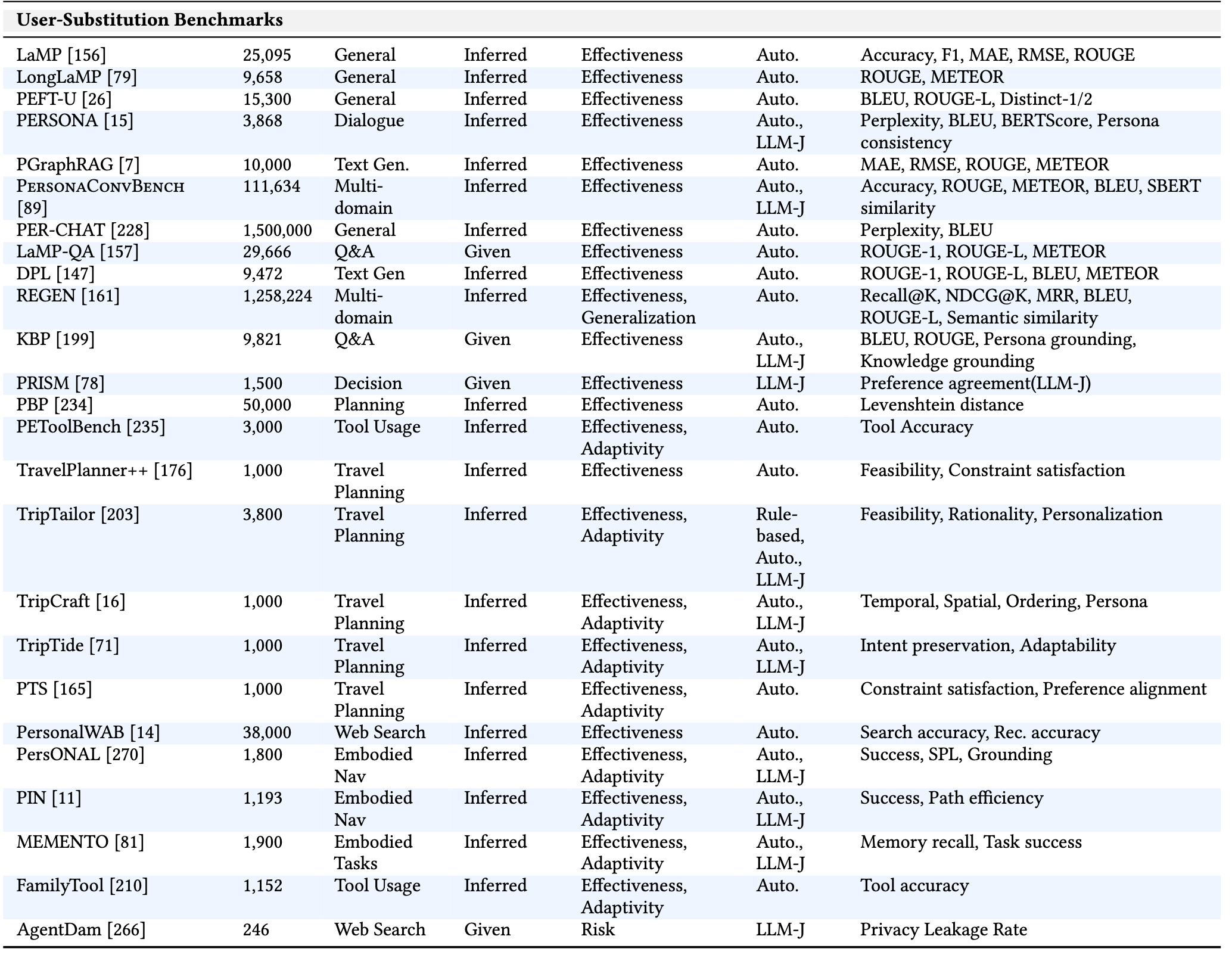

基于上述指标分类,总结个性化智体的代表性基准测试,并将其分为两大类。交互式对齐基准测试评估智体通过多轮交互获取、协商和完善用户偏好的能力,其中用户始终是整个流程中不可或缺的一部分。与之相反,用户替代基准测试评估智体能否通过模拟用户的偏好或角色来代替用户,从而在无需用户进一步输入的情况下产生与用户一致的响应或决策。主流基准测试总结于下表。

交互式对齐基准测试

偏好发现基准测试。交互式对齐的核心挑战在于偏好发现,智体必须从异构信号中识别、推断并迭代地完善用户的意图和偏好,这些信号包括显式指令、隐式反馈和上下文线索193。在此类别中,IndieValueCatalog 63 收集来自不同个体的价值表达语句,并评估模型是否能够推断出个性化的价值判断,从而凸显在捕捉细粒度个人价值观方面的局限性。 PersonaBench 186 构建合成但逼真的个人资料及其相关组件,以测试智体是否能够提取和推理用户特定信息。PrefDisco 92 提出一种元评估框架,强调交互式信息获取效率,衡量智体是否能够主动提出信息丰富的问题,从而以最少的交互回合获得符合用户需求的解决方案。

输出级一致性基准。此类基准以端到端的方式评估个性化,重点关注智体的最终输出是否满足目标用户在真实交互环境中的偏好和约束。对于以对话为中心的个性化,ALOE 225 和 PrefEval 262 等基准测试智体是否能够在多回合对话中推断、保留并始终如一地遵循用户偏好。除了对话任务之外,PDR-Bench 99 还评估智体是否能够将用户个人资料整合到研究工作流程中,并生成对最终用户实际有用的输出。在推荐方面,AgentRecBench 164 和 RecBench+ 53 评估智体能否生成基于用户偏好的推荐并适应用户反馈。更广泛地说,PersonaLens 265 针对多场景、任务导向型助手,评估个性化在不同领域和用户意图下是否保持一致。

组件探测基准测试。作为上述基准测试的补充,组件探测基准测试提供受控的测试平台,用于隔离特定的个性化功能,从而能够诊断性地分析智体何时以及如何利用用户信息。PersonaFeedback 190 将预定义的用户角色与查询配对,并要求模型选择与用户角色一致的响应,从而直接探测基于用户偏好的匹配度。一个主要子类侧重于个性化记忆,包括 LongMemEval 222、LoCoMo 114、PerLTQA 30、MemoryAgentBench 52、ConvoMem 135 和 PAL-Bench 56,这些测试旨在检验智体能否在长时间对话或逐步揭示用户偏好的情况下,组织、检索和应用用户特定的记忆。对于个性化工具的使用,ETAPP 50 和 PTBench 55 评估智体是否能够根据用户需求调整工具调用策略,包括主动性和处理缺失或模糊信息的能力。一些基准测试明确针对智体随时间的适应性;例如,PersonaMem 61, 62 评估智体能否追踪不断变化的特征和偏好,修正过时的信念,并将其推广到新的场景。最后,一些基准测试用于诊断用户特定风险,例如 PSG-Agent 226 和 PENGUIN 229,它们评估基于 LLM 的智体的与用户画像相关的安全考量;而 PrivacyBench 123 和 AgentDam 266 则测试智体在处理敏感用户信息时的隐私合规性。

用户替换基准测试

文本和对话基准测试。文本和对话个性化基准测试侧重于评估模型如何生成符合用户个人偏好、风格和上下文知识的内容。例如,长文本生成任务(如 LaMP 156 和 LongLaMP 79)测试模型是否能够随时间推移调整输出以适应用户兴趣的变化;而 PEFT-U 26 将分类问题重新表述为标注者特定的实例,以衡量用户条件生成能力。利用检索或知识图谱的基准测试(例如 PGraphRAG 7)进一步考察稀疏或冷启动场景下的性能。除了单轮对话生成之外,多轮对话基准测试,例如 PersonaConvBench 89、PER-CHAT 228、LaMP-QA 157、DPL 147、REGEN 161 和 KBP 199,评估模型是否能够保持对话的连贯性、适应用户的对话风格,以及在整个对话过程中持续整合个性化知识。PRISM 78 则针对用户价值观因文化或情境而异的更复杂场景,评估模型对个性化主观选择的再现能力。

规划和工具使用基准测试。规划和工具使用基准测试检验个性化智体是否能够学习并应用用户偏好来执行顺序或多步骤任务。基于偏好的规划 (PBP) 234 模拟不同环境下的日常活动,以评估基于偏好的规划,而 PETool-Bench 235 则专门衡量智体根据用户个人偏好选择和使用工具的能力。 FamilyTool 210 将这种关注点扩展到基于复杂工具的工作流程,强调整合用户特定需求。更广泛的多领域规划基准测试,包括 TravelPlanner++ 176、TripTailor 203、TripCraft 16、COMPASS 145、TripTide 71 和 Personal Travel Solver (PTS) 165,评估了从自适应行程生成到突发事件处理等一系列任务,测试智体是否能够解读显式或推断的偏好,并构建连贯的、符合用户需求的规划。

具身和空间基准测试。具身和空间基准测试研究智体是否能够根据用户偏好在物理或模拟空间中导航、操作物体和进行物体定位。记忆引导的交互任务,例如 MEMENTO 81,评估智体回忆用户特定线索的能力,而 Personal 270 则侧重于在逼真的家庭环境中进行个性化导航和物体定位。个性化实例导航 (PIN) 基准 11 通过要求智体在 3D 场景中的干扰物中定位用户特定的目标对象,增加复杂性,强调个性化的导航策略。

基于LLM的个性化智体已被应用于各种场景,从对话支持和内容创作到委托协助和专家领域工作流程。这些应用在自主程度、风险等级和个性化目标方面各不相同,但都要求智体将用户特定信息转化为持续的、情境-敏感的行为。将具有代表性的应用分为四类:对话助手、内容创作、委托助手和特定领域的专家支持。

对话助手

对话助手是个性化智体,其主要目标是通过持续互动为用户提供支持。在这种情况下,个性化通过长期对话的连续性、上下文相关的响应生成以及对用户特定偏好、语气和支持需求的适应来实现。将此类应用中的代表性应用分为日常对话助手、情感支持伙伴和教育智体。

内容创作

个性化内容创作指的是生成独立的文本作品,其中智体根据个性化目标调整风格、结构和框架,而不是维持交互式对话240。在这种情况下,个性化是在作品层面进行评估的,由此产生两种互补的范式:以作者为中心的、与个人写作风格保持一致的范式,以及以受众为中心的、根据读者的知识、兴趣或期望进行调整的范式132。

委托助手

委托助手通过内化偏好、管理信息、规划行动以及在较长的时间范围内调整行为来代表用户行事。与对话式助手相比,它们承担更高程度的委托责任,因此需要更持久、更符合用户需求的表示。

特定域的专家支持

个性化智体越来越多地被部署为医疗保健、金融、法律服务和研究工作流程等专业领域的专家助手。在这些领域,以用户为中心的定制可以提高相关性和可用性,但必须与严格的领域约束和风险敏感型要求相协调196。

尽管进展迅速,但构建稳健、可扩展且易于部署的个性化智体仍然是一个尚未解决的挑战。许多剩余的困难是跨领域的,而非模块特定的:它们源于如何在现实世界的约束下构建、更新、泛化、评估和部署用户模型。

决策关键型用户建模

个性化智体的一个核心开放性问题是如何以既能有效表达又与决策相关的形式来表示用户信息。用户偏好不仅因人而异,而且会因任务、任务的各个方面,甚至同一用户在不同情境下的偏好而变化,并且这些偏好通常只能通过行为、交互模式或工具使用情况间接体现。因此,有效的个性化不仅需要丰富的用户建模,还需要识别哪些用户属性对当前决策至关重要。这一挑战在应用场景中尤为突出,通用助手可能依赖于广泛的风格或价值观一致性,而特定领域或高风险智体则依赖于直接影响结果的细粒度属性。因此,未来的研究应着重于构建结构化和自适应的用户表示,以区分决策关键信号和次要信号,而不是假设存在一个固定的或普遍适用的用户模型。

时间动态与持续个性化

个性化本质上是动态的:用户偏好通过交互逐步展现,用户信息的不同方面以不同的时间尺度演变。短期兴趣可能在不同情境下迅速变化,而长期价值观、目标或推理方式通常更为稳定。这种时间异质性使得静态个性化机制从根本上无法满足需求。因此,未来的研究应开发持续个性化方法,以便在不发生灾难性遗忘的情况下随时间更新用户表征,同时区分瞬时偏好和持久偏好。更广泛地说,个性化智体应实现观察与行动之间的闭环,以便将新获取的信号以保持一致性而非逐渐降低一致性的方式整合到系统中。

泛化

个性化智体通常需要在稀疏、不均衡或缺失的用户数据下运行,这使得泛化成为实际部署的核心挑战。这个问题至少体现在两个方面。首先,智体必须能够泛化到未见过或交互较少的用户,而有限的证据使得直接推断偏好变得不可靠。其次,它们必须能够跨领域和跨任务进行泛化,因为在一种情境下学习到的偏好可能只能部分迁移到另一种情境,这是由于任务结构、动作空间或决策标准存在差异。有前景的研究方向包括:用于快速适应的少样本学习和元学习方法;在证据不足的情况下避免过度自信的个性化,并考虑不确定性;以及能够捕捉可重用决策原则而非狭隘的特定任务行为的可迁移偏好抽象。

评估和基准测试

评估个性化面临着独特的挑战,因为成功是相对于个体用户而非客观的任务完成情况来定义的。现有的基准测试通常依赖于语言模型生成的合成用户数据,这些数据可能无法捕捉到真实的人类多样性,并且可能存在同质化效应。此外,诸如以语言模型作为评判标准等常用评估协议也引发了人们对可靠性以及与人类满意度一致性的担忧。未来的评估框架应强调细粒度的组件级分析,并区分用户内部的一致性和用户之间的差异。纳入人机交互评估、纵向交互研究和以用户为中心的满意度指标,可以更真实地评估个性化质量。

隐私和用户控制

个性化本质上依赖于用户数据的收集、存储和重用,因此隐私是部署过程中面临的核心挑战。即使用户数据单独存储,仍然存在未经授权的访问、意外泄露或二次滥用等风险。此外,如果用户感觉自己不再理解或控制信息的保留和应用方式,那么自我演化的智体可能会削弱用户信任。因此,未来的系统必须通过隐私感知内存架构、选择性保留策略、设备端或联合个性化以及用于检查、编辑和管理存储信息的透明界面,在数据效用和隐私保护之间取得平衡。从这个意义上讲,隐私不仅应被视为一种技术保障,还应被视为用户体验的核心组成部分。

效率和部署

一个实际的开放性问题是如何在现实世界的资源限制下提供有意义的个性化。在现有系统中,个性化通常通过训练后自适应、推理时增强、内存检索或重复规划和工具使用来实现,所有这些都会引入额外的存储、延迟和计算成本。因此,未来的研究应探索能够明确权衡个性化深度与部署成本的工作流设计。轻量级的个性化机制、自适应的内存使用以及预算感知的推理策略,可以让智体在不产生过高开销的情况下,持续地与用户保持一致。