摘要

随着城市治理数字化转型的深入,构建自主可控、安全高效的政务底座势在必行。本项目旨在响应国家信创战略,解决核心技术受制于人的风险。主要建设内容涵盖全栈信创架构的搭建,采用鲲鹏/飞腾国产芯片作为算力支撑,适配统信/麒麟操作系统及人大金仓数据库,构建从硬件到软件的闭环生态。通过整合政务数据资源,打造"一网统管"核心引擎。预期目标是实现政务系统的高可用与高安全,提升跨部门协同治理效能,为市级城市运行提供稳定、可靠的数字化底座,树立全栈信创应用标杆。

文章目录

- [第一章 项目概述](#第一章 项目概述)

-

- [1.1 建设背景](#1.1 建设背景)

- [1.2 建设目标与范围](#1.2 建设目标与范围)

- [第二章 现状与需求分析](#第二章 现状与需求分析)

-

- [2.1 现有政务底座资产盘点](#2.1 现有政务底座资产盘点)

- [2.2 信创适配需求分析](#2.2 信创适配需求分析)

- [第三章 全栈信创总体架构设计](#第三章 全栈信创总体架构设计)

-

- [3.1 总体设计原则](#3.1 总体设计原则)

- [3.2 总体架构蓝图](#3.2 总体架构蓝图)

- [3.3 部署架构设计](#3.3 部署架构设计)

- [第四章 基础设施层信创适配方案](#第四章 基础设施层信创适配方案)

-

- [4.1 芯片与服务器算力底座](#4.1 芯片与服务器算力底座)

- [4.2 操作系统适配与替换](#4.2 操作系统适配与替换)

- [4.3 信创云平台建设](#4.3 信创云平台建设)

- [第五章 数据与支撑层信创适配方案](#第五章 数据与支撑层信创适配方案)

-

- [5.1 核心数据库国产化替换](#5.1 核心数据库国产化替换)

- [5.2 中间件信创适配](#5.2 中间件信创适配)

- [5.3 数据共享交换组件](#5.3 数据共享交换组件)

- [第六章 "一网统管"核心应用适配与迁移](#第六章 “一网统管”核心应用适配与迁移)

-

- [6.1 城市运行体征监测模块适配](#6.1 城市运行体征监测模块适配)

- [6.2 跨部门协同指挥模块适配](#6.2 跨部门协同指挥模块适配)

- [6.3 前端展示与交互适配](#6.3 前端展示与交互适配)

- [第七章 信创安全与密码体系设计](#第七章 信创安全与密码体系设计)

-

- [7.1 密码算法升级与改造](#7.1 密码算法升级与改造)

- [7.2 边界与终端安全防护](#7.2 边界与终端安全防护)

- [7.3 数据安全与隐私保护](#7.3 数据安全与隐私保护)

- [第八章 适配测试与性能调优方案](#第八章 适配测试与性能调优方案)

-

- [8.1 测试体系与环境构建](#8.1 测试体系与环境构建)

- [8.2 性能压测与调优](#8.2 性能压测与调优)

- [第九章 实施计划与运维保障](#第九章 实施计划与运维保障)

-

- [9.1 迁移实施路径规划](#9.1 迁移实施路径规划)

- [9.2 信创运维体系建设](#9.2 信创运维体系建设)

第一章 项目概述

第一章 项目概述

本章确立市级政务"一网统管"底层架构全栈信创适配的全局管控边界与核心业务轴线。在政务数字化转型进入深水区的背景下,本项目旨在构建高可用、高并发且完全自主可控的城市运行管理中枢。系统总体架构以微服务为基底,深度对齐国家信息安全等级保护三级(GB/T 22239-2019)标准,通过确立"一云一网一平台"的顶层设计,解决异构信创环境下底层算力调度、中间件兼容性及分布式数据库性能优化等工程痛点。本章节将系统性地阐述项目的建设背景、核心演进目标及全域建设范围,为后续跨系统协同机制与核心业务价值链路的实现奠定工程与业务基础。

1.1 项目背景、目标及建设范围

在数字政府建设战略指引下,市级政务"一网统管"已成为城市治理现代化的核心。当前底层技术栈对进口软硬件依赖度较高,面临严峻的供应链安全风险。本项目通过全栈信创适配升级,确保城市运行核心数据的安全闭环与逻辑隔离。立项基于对现有业务痛点的深度洞察:一是异构数据源接入标准不一,导致跨部门协同效率低下;二是原有架构在应对台风、汛情等突发大流量场景时的弹性伸缩能力不足;三是传统安全防护体系难以应对信创环境下的新型渗透威胁。

本项目确立了"信创驱动、平滑迁移、架构领先"的核心目标。技术层面,实现从芯片(鲲鹏/飞腾)、操作系统(麒麟/统信)、数据库(高斯/达梦)到中间件的全栈国产化适配,确保系统在信创环境下的性能衰减控制在5%以内。业务层面,通过构建全域感知、协同处置、决策支持三大核心能力,实现城市运行态势的分钟级更新与跨部门事件的秒级流转。建设范围涵盖市本级及下辖各区县的数字化治理节点,包括:信创云底座扩容与加固、政务大数据平台国产化迁移、城市运行体征监测系统重构,以及配套的信创运维与安全态势感知体系。通过建立标准化的API网关与数据交换总线,确立跨层级、跨地域的业务协同边界,确保建设成果具备工程示范意义。

为了明确项目实施的物理与逻辑边界,下表列出了本项目核心信创适配组件的初步选型与技术规格要求:

| 维度 | 建设内容 | 技术规格/要求 |

|---|---|---|

| 算力层 | 国产化服务器集群 | 采用ARM/LoongArch架构,支持计算存储分离,满足SLA 99.99%可用性 |

| 安全层 | 等保三级合规体系 | 集成国密算法(SM2/SM3/SM4),实现内生安全与主动防御 |

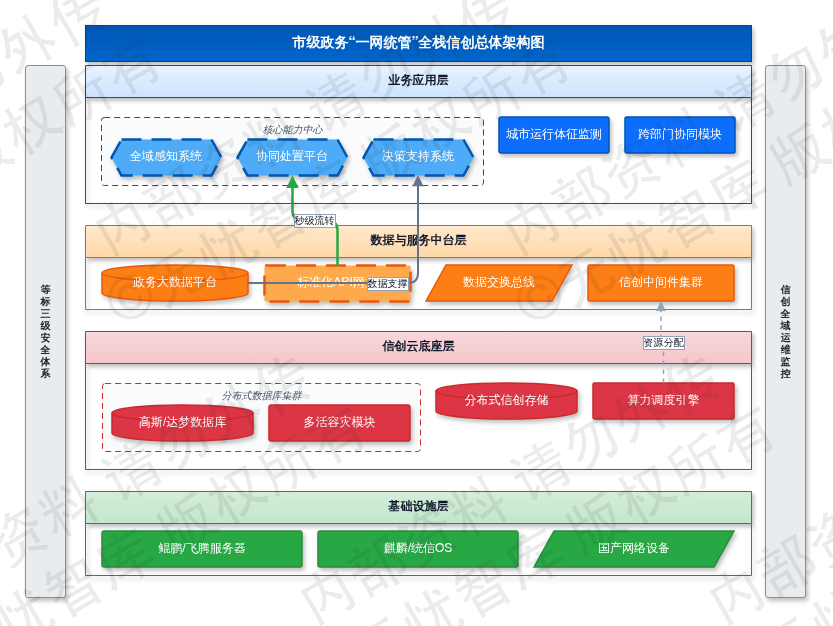

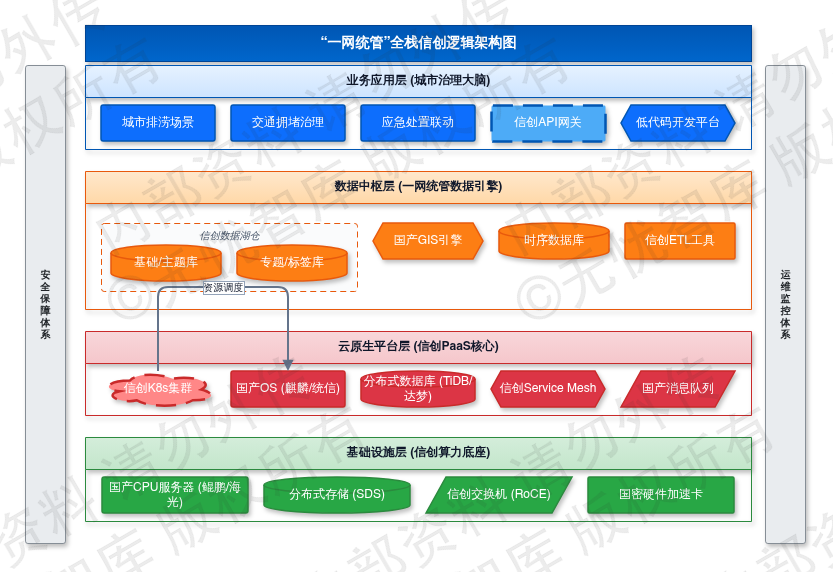

综上所述,本章通过对背景、目标及边界的系统阐述,为后续章节奠定基础,整体架构设计思路如下图所示:

图:第一章 项目概述

如上图所示,该架构展示了从信创底座到业务应用层的全栈演进路径,明确了各层级间的逻辑解耦与数据流转关系,涵盖了算力调度、存储优化、数据库事务处理及安全防御等核心要素,为后续详细的系统设计与工程实施提供了清晰的指导框架。

1.1 建设背景

1.1 建设背景

1.1.1 政策与战略依据

在当前全球科技竞争加剧与产业链重构的宏观背景下,构建自主可控的政务数字底座已上升为国家战略。根据《数字中国建设整体布局规划》的顶层设计,国家明确提出"夯实数字中国建设基础"的核心要求,强调强化数字技术创新体系与数字安全屏障。政务外网作为国家电子政务传输网的关键组成部分,其底层架构安全性直接关系到公共服务与城市治理的业务连续性。依据国家信创产品目录及相关行业适配要求,关键政务系统必须实现从芯片(CPU)、操作系统、数据库到中间件的全栈国产化替代,以消除潜在的供应链安全风险。

本项目的实施深度对齐《"十四五"推进国家政务信息化规划》,旨在通过架构层面的解耦与重构,打破长期以来对特定国外技术体系的路径依赖。在合规性层面,方案严格遵循 GB/T 22239-2019《信息安全技术 网络安全等级保护基本要求》中关于安全可靠性的规定,确保政务业务逻辑运行在具备内生安全属性的算力底座之上。通过引入符合信创标准的分布式架构与安全加固机制,本项目将建立起符合国家网络安全战略要求的技术防护体系,为政务数据的跨部门共享与跨层级协同提供坚实的合规保障。

1.1.2 城市治理数字化现状

目前,市级"一网统管"系统在支撑城市运行监测、应急指挥及社会治理等方面已发挥关键作用。然而,通过对现有基础设施的摸排分析发现,系统底层仍高度依赖以 x86 架构 CPU 为核心的服务器集群,以及以 Oracle、SQL Server 为代表的国外商业数据库。这种技术依赖在当前的国际贸易环境下暴露出严重的供应链断供风险。一旦遭遇技术禁运或闭源限制,核心业务系统将面临停摆风险,严重威胁城市治理的稳定性。下表列出了当前系统核心组件的风险评估与替代必要性:

| 核心组件层级 | 现状描述 | 供应链风险等级 | 信息安全隐患 |

|---|---|---|---|

| 计算资源层 | 采用 Intel/AMD x86 架构服务器 | 高 | 存在硬件后门及微码更新受限风险 |

| 数据库层 | 核心业务数据存储于 Oracle RAC 集群 | 极高 | 闭源软件无法实现漏洞的自主修复 |

此外,由于国外底层技术栈与国产化软硬件在指令集、驱动兼容性及多线程调度机制上存在本质差异,现有的"一网统管"应用无法通过简单的平移实现迁移。现行架构中存在的闭源中间件与数据库触发器逻辑,使得系统在面对突发大流量业务时,缺乏自主可控的性能调优手段。这种"黑盒"化的底层环境不仅增加了运维的复杂度,也为政务敏感数据的全生命周期安全审计带来了盲区。因此,亟需通过本次建设,实现从底层硬件到应用逻辑的全面重构,确立基于国产算力与原生云架构的新型城市治理底座。

综上所述,本章通过对政策背景与技术现状的系统阐述,为后续架构设计奠定了必要性基础。项目整体建设背景与战略驱动因素如下图所示:

图:1.1 建设背景

如上图所示,该图表清晰展示了政策合规性要求、现有技术债务风险以及国产化替代路径之间的映射关系。通过对供应链风险与信息安全隐患的量化评估,明确了从底层基础设施到上层业务应用的演进逻辑,为后续详细的技术选型与平滑迁移方案提供了决策依据。

1.2 建设目标与范围

1.2 建设目标与范围

1.2.1 核心建设目标

本项目旨在通过全栈信创适配改造,构建高可靠、高性能且完全自主可控的政务数字化底座。为确保项目实施效果的可量化与可追溯,确立以下核心技术与业务指标:

首先,实现底层硬件100%国产化替代。全面转向以鲲鹏、飞腾为代表的国产ARM架构算力体系,涵盖通用服务器、存储、网络交换设备及安全网关的全国产化部署,从物理层消除对传统X86架构的依赖。

其次,核心业务接口响应时间控制在800ms以内。针对"一网统管"等高频政务场景,通过对国产中间件与数据库进行深度性能调优,利用缓存预热、索引优化及分布式事务异步化等手段,抵消跨平台迁移带来的性能损耗,确保用户体验不低于原系统水平。

第三,系统可用性达到99.99%。通过部署双活数据中心及高可用集群架构,在国产操作系统与数据库层面建立完善的容灾备份机制。确保在极端故障场景下,业务恢复时间(RTO)小于30分钟,数据丢失量(RPO)趋于零,消除单点故障风险。

最后,完成不少于50个跨部门业务模块的平滑迁移。依托灰度发布与流量平滑切换技术,实现城管、应急、综治、环保等业务逻辑向信创平台的无感过渡,验证信创环境对复杂业务逻辑的支撑能力。

1.2.2 适配改造范围

本次信创适配改造遵循"全栈覆盖、纵向协同"原则,划定明确的适配边界,涵盖从底层基础设施到终端应用的全生命周期要素。具体改造范围如下表所示:

| 架构层级 | 适配对象/组件 | 核心技术标准/要求 |

|---|---|---|

| IaaS层 | 鲲鹏920/飞腾2000+ 算力服务器 | 满足国产算力节点横向扩展,支持异构资源池化管理 |

| PaaS层 | 人大金仓 KingbaseES / 东方通 | 支持分布式部署与微服务治理,兼容主流SQL标准 |

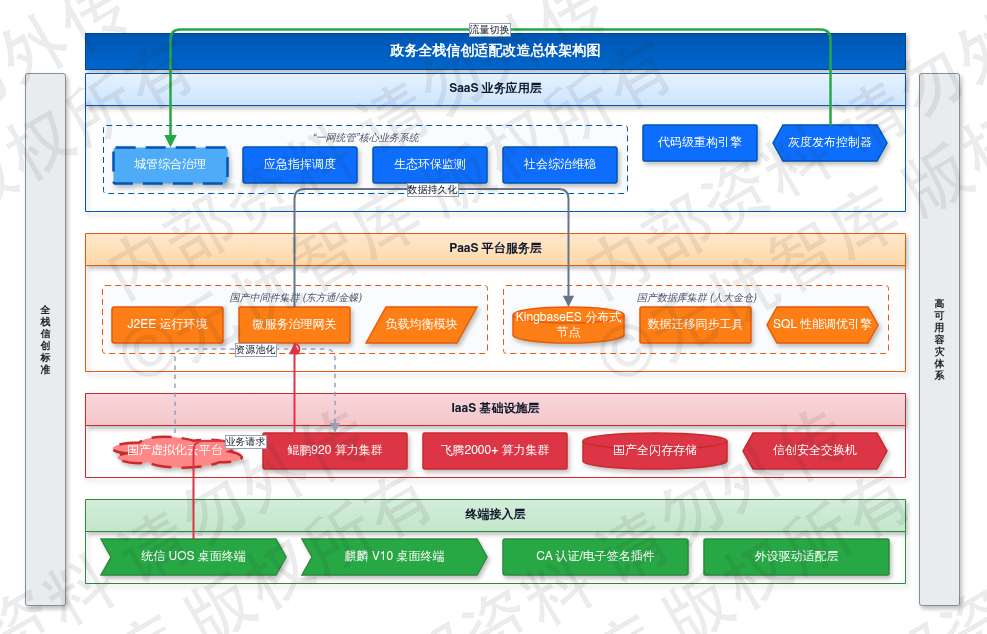

在IaaS层,重点解决国产芯片与虚拟化软件的深度适配,通过优化内核参数提升计算效能。在PaaS层,针对人大金仓数据库进行结构化数据迁移,确保SQL执行计划在信创环境下的一致性,并利用国产中间件实现服务链路的全面监控。SaaS层改造聚焦于"一网统管"应用逻辑的去O(Oracle)化与去W(Windows)化,确保业务代码在国产编译环境下的稳定运行。终端层适配则着重于跨平台UI框架调整,确保政务人员在统信或麒麟OS下拥有统一的操作习惯。

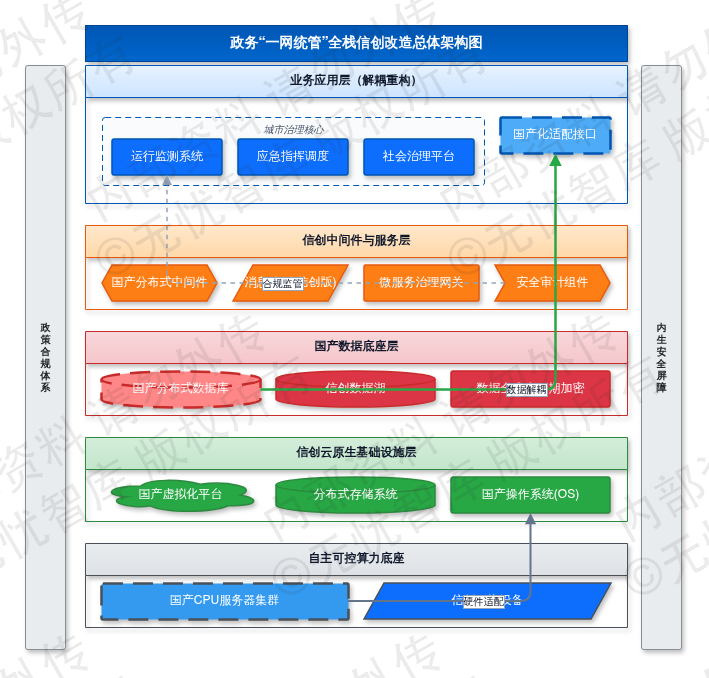

综上所述,本章通过对建设目标与适配范围的系统阐述,确立了项目的工程基准与技术边界,整体适配路径如下图所示:

图:1.2 建设目标与范围

如上图所示,该架构涵盖了从底层算力到顶层应用的全栈信创要素,通过对IaaS、PaaS、SaaS及终端层的协同改造,为后续详细的迁移实施方案提供了清晰的边界界定与逻辑指导框架。

第二章 现状与需求分析

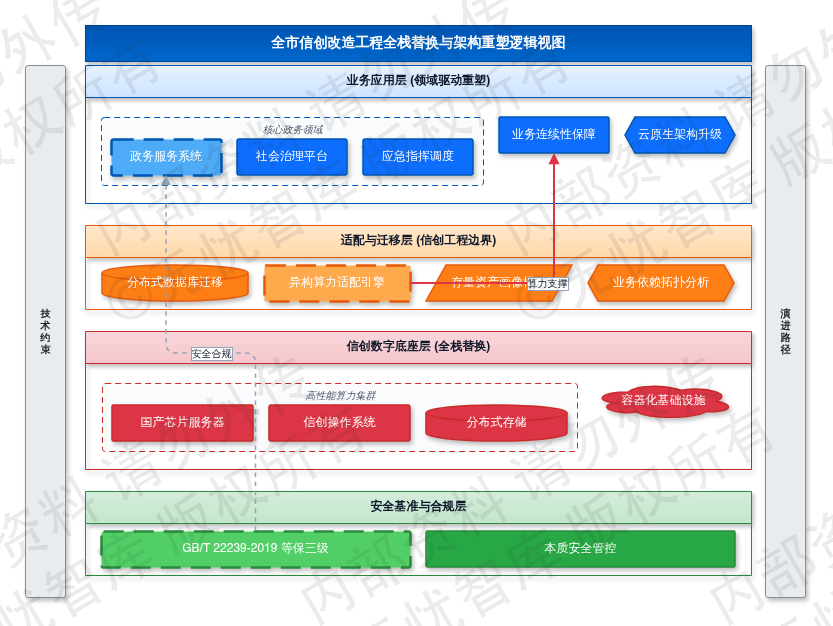

本章作为全市信创改造工程的逻辑起点,旨在通过对市级大数据中心及各委办局存量IT资产的深度盘点,确立从底层芯片、操作系统到上层业务应用全栈替换的工程边界。在当前信创产业进入"深水区"的背景下,本章摒弃单纯的硬件堆叠逻辑,转而采用领域驱动设计(DDD)思想,深入剖析政务服务、社会治理、应急指挥等核心领域在异构算力环境下的业务连续性挑战。通过建立"存量资产画像---业务依赖拓扑---信创适配缺口"的分析模型,本章确立以"真替真用"为导向的技术约束与演进路径,为后续高性能算力集群的构建、分布式数据库的平滑迁移以及政务云原生架构的升级提供工程级需求输入。

在现状梳理阶段,重点聚焦于现有X86架构服务器、集中式存储以及国外商用数据库的分布比例,评估其在指令集翻译、中间件兼容性及SQL语法适配方面的迁移难度。需求分析则从业务逻辑剥离、数据一致性保障、高并发场景下的性能损耗补偿等维度展开,确保在满足GB/T 22239-2019等安全基准的前提下,实现政务核心业务的本质安全与架构重塑。通过对现有业务流量特征与IO密集型任务的定量分析,本章将推导出信创底座在算力调度、内存管理及网络吞吐方面的关键性能指标要求,为后续章节的详细技术方案设计提供量化依据,整体现状与需求逻辑框架如下图所示:

图:第二章 现状与需求分析

如上图所示,该框架涵盖了从底层基础设施现状盘点到上层业务逻辑解耦的需求分析全过程,通过对存量资产的精细化画像与业务依赖关系的深度拓扑分析,明确了信创替换过程中的技术瓶颈与性能对标基准,为后续构建高性能、高可靠的信创政务云底座提供了清晰的指导路径与逻辑支撑。

2.1 现有政务底座资产盘点

2.1 现有政务底座资产盘点

本章节通过对政务云数据中心现有软硬件资源的深度穿透盘点,旨在摸清底层物理设施与上层逻辑资产的底数,为后续平滑迁移与架构演进提供精确的参数输入。当前政务底座承载着全区核心业务系统,其资产构成涵盖了从物理服务器、网络设备到虚拟化平台、数据库及中间件的全栈技术要素。通过对230台x86服务器、1.2PB存储空间以及45TB核心业务数据的精细化梳理,本节将明确现有环境的性能瓶颈、技术债分布及潜在运行风险,确保迁移方案的拓扑映射具备高度的准确性与可执行性。

2.1.1 硬件与网络资产现状

当前政务云硬件资源池以x86架构为核心,在籍服务器共计230台,主要型号包括华为RH2288H V5、浪潮NF5280M5等2U双路机架式设备。计算资源侧,累计提供物理核数9,200核,总内存容量达58.8TB,单机配置以40核CPU配256GB/512GB内存为主。存储架构采用光纤交换机组建SAN网络,后端挂载中高端全闪存及混合阵列,可用容量约为1.2PB。

网络层面,核心交换机由两台华为CloudEngine 12800系列组成,通过10GbE链路支撑业务流量冗余。负载均衡由F5 BIG-IP系列硬件控制器承担,负责Web门户及高并发接口的流量调度。资产普查显示,约45%的设备服役年限超过4年,接近折旧周期,部分早期节点存在主板电容老化、冗余电源失效等隐患。

下表梳理了现有核心硬件资产的关键参数:

| 设备类别 | 关键参数/规格指标 | 数量/容量 | 品牌/型号示例 |

|---|---|---|---|

| x86计算服务器 | 40核CPU/256G-512G内存 | 230台 | 华为RH2288/浪潮NF5280 |

| 核心交换机 | 40G/100G背板带宽 | 4台 | 华为CE12808/H3C S12500 |

2.1.2 软件与数据资产现状

软件栈高度依赖VMware vSphere虚拟化平台,运行虚拟机实例约1,850个,虚拟化率达92%。中间件环境以Oracle WebLogic Server 12c为主,承载复杂J2EE应用,部分轻量化业务采用Tomcat部署。接口层面存量API逾800个,其中SOAP协议占比30%,RESTful占比70%,日均调用峰值超1,200万次,流量潮汐效应对中间件线程池管理构成了持续压力。

数据资产核心存储于Oracle 19c RAC集群,总规模约45TB(结构化12TB,非结构化33TB)。数据库层深度耦合了4,200余个涉及财税、社保及行政审批的逻辑存储过程,迁移复杂度极高。此外,高频写入表空间的索引碎片化率已达25%,亟需在迁移过程中进行重构。

下表汇总了核心软件资产的运行状态:

| 资产类别 | 技术规格/版本 | 关键指标 | 运行状态 |

|---|---|---|---|

| 虚拟化平台 | VMware ESXi 6.7/7.0 | 1850+ VM实例 | 负载均衡,运行稳定 |

| 关系型数据库 | Oracle 19c RAC | 45TB数据/4200+存储过程 | 存储压力较大,需重构 |

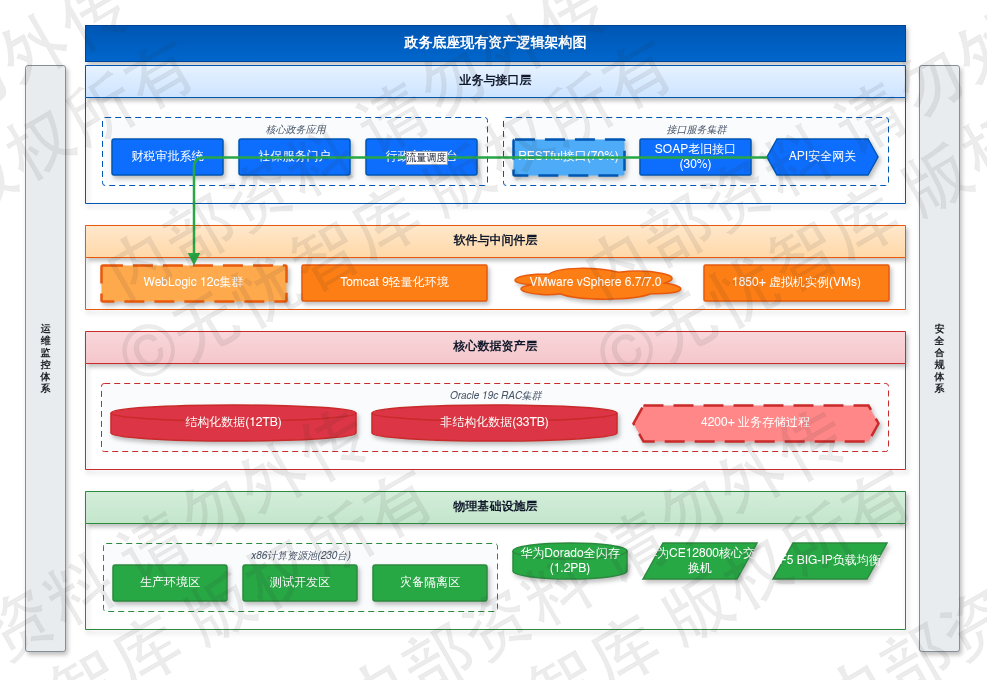

综上所述,本章通过对硬件、网络及软硬件资产的深度盘点,明确了当前底座的性能瓶颈与技术债分布,现有底座资产分布架构如下图所示:

图:2.1 现有政务底座资产盘点

如上图所示,该架构展示了从底层物理硬件到上层数据资产的逻辑层级关系,清晰勾勒出230台服务器、Oracle数据库集群与VMware虚拟化层之间的支撑逻辑,为后续迁移方案的拓扑映射奠定了基础。

2.2 信创适配需求分析

2.2 信创适配需求分析

2.2.1 算力与操作系统替换需求

在底层算力底座的信创重构中,必须消除对非自主指令集架构的依赖。针对"一网统管"平台高并发政务处理与大规模视频流接入场景,明确采购基于ARM v8架构的国产高性能处理器服务器,重点选用鲲鹏920或飞腾腾锐2000+系列,单节点物理核数不低于64核,以支撑微服务架构下的高密度容器集群调度。硬件层面需确保服务器基板管理控制器(BMC)与国产BIOS深度融合,实现硬件级安全可信启动。

操作系统需全面替换为统信UOS V20或银河麒麟V10高级服务器版。替换需求不仅限于内核迁移,更强调底层依赖库的深度兼容,必须提供完善的C语言(GCC/LLVM)及Java(OpenJDK 8/11)运行环境,解决glibc、openssl等关键库在ARM架构下的指令集优化。针对存量业务代码,系统需支持原生编译优化,确保迁移后响应时延波动控制在5%以内,并强制满足等保三级内核安全加固标准。

2.2.2 数据库与中间件替换需求

数据库层面的平滑迁移是信创适配的核心。需求明确将现有Oracle 19c数据库迁移至人大金仓KingbaseES V9,核心技术指标要求实现PL/SQL存储过程、触发器及复杂SQL语法的自动化转换,语法兼容率需≥98%。针对剩余差异化语法,需制定专项重构方案。同时,数据库需具备异构数据同步能力,在迁移过渡期内实现Oracle与KingbaseES的实时增量同步,确保RPO=0且RTO<30秒。

中间件领域需将WebLogic应用服务器替换为东方通TongWeb 7.0,确保对J2EE规范(如EJB、JMS、JTA)的完全支持。TongWeb需具备企业级集群管理能力,支持动态负载均衡与Session共享。针对大规模并发访问,需优化线程池模型与内存回收机制,确保在国产全栈环境下,单实例吞吐量(TPS)不低于原环境的90%。

2.2.3 业务系统平滑迁移需求

针对"一网统管"平台中网格化管理、应急指挥调度等7大核心子系统,实施"不停机、无感知"平滑迁移。建立"双轨运行"架构,通过流量染色与API网关权重控制实现灰度切流。迁移遵循"分步实施、分层割接"原则,优先处理非实时强交互系统,逐步推进核心业务流。要求割接期间前端访问无中断,通过分布式事务补偿机制确保数据强一致性,并在迁移后提供不少于3个月的并行观测期。

下表为本次信创适配关键软硬件替换清单:

| 类别 | 原有技术栈 | 拟替换国产技术栈 | 关键技术指标要求 |

|---|---|---|---|

| 算力/系统 | Intel Xeon / CentOS | 鲲鹏920 / 统信UOS | ARM v8架构,支持等保三级 |

| 数据/中间件 | Oracle / WebLogic | 人大金仓 / 东方通 | PL/SQL兼容≥98%,J2EE全规范 |

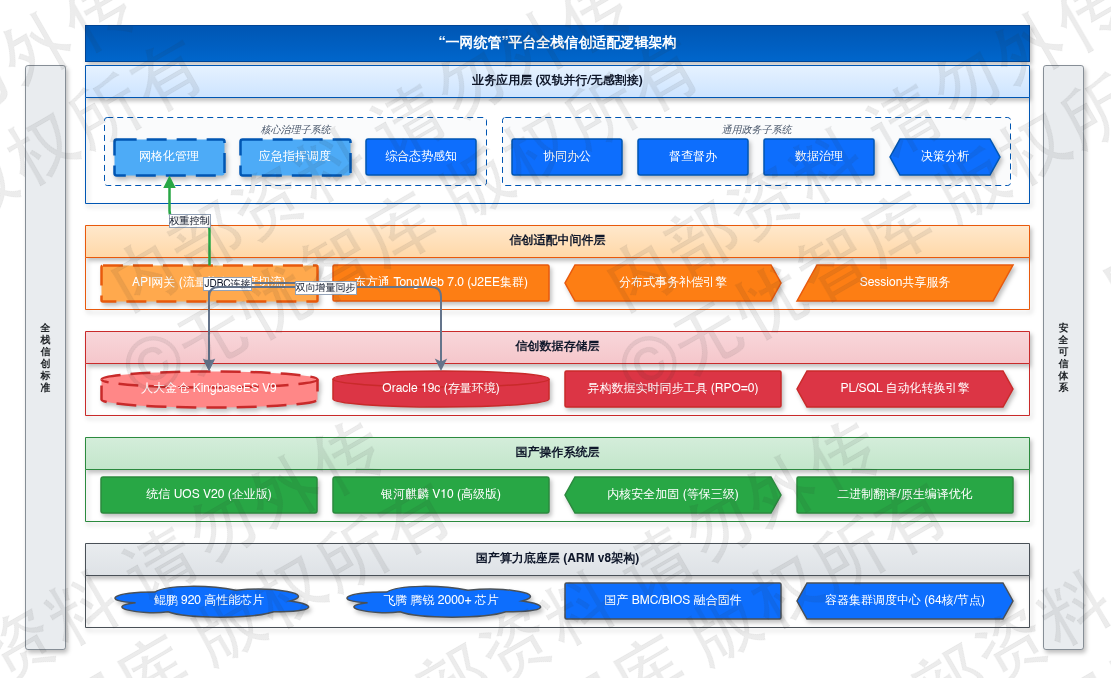

综上所述,本节通过对算力、系统、数据库及中间件的深度适配需求分析,构建了全栈自主可控的底层支撑体系,为后续业务系统的平滑割接提供了标准化路径,整体适配逻辑架构如下图所示:

图:2.2 信创适配需求分析

如上图所示,该架构涵盖了从底层硬件芯片到上层业务应用的全链路信创替换路径。通过明确算力层、系统层与数据层的技术规范,确保了"一网统管"平台在迁移过程中的稳定性与安全性,为后续详细的信创实施方案奠定了坚实的技术基础。

第三章 全栈信创总体架构设计

本章作为全栈信创体系建设的顶层设计蓝图,旨在构建满足2026年主流信创标准、具备高可用性与弹性伸缩能力的数字化底座。设计方案深度对标金融级SLA标准,通过"一云多芯"异构兼容策略,解决鲲鹏、飞腾、海光等国产芯片与统信、麒麟操作系统的深度适配。总体架构采用云原生微服务模式,整合Service Mesh(服务网格)实现业务逻辑与基础设施解耦,确保系统在千万级并发场景下,依托全栈信创中间件实现毫秒级响应。本架构侧重全链路高可用工程实践,涵盖多活机房数据强一致性同步、信创环境混沌工程压测及零信任安全体系集成。通过确立从物理硬件、云平台、数据库到应用软件的端到端信创闭环,为后续业务模块的精细化开发与高性能运行提供标准化技术约束与演进路径。

综上所述,本章通过对全栈信创总体架构的系统阐述,明确了底层硬件适配、云原生架构演进及全链路安全防护的核心逻辑,为后续章节的详细设计奠定了坚实的技术基础,整体架构蓝图如下图所示:

图:第三章 全栈信创总体架构设计

如上图所示,该架构涵盖了从基础设施层、平台服务层到应用支撑层的核心要素,通过分层解耦设计确保了系统在国产化环境下的高性能表现与高可靠性,为后续各子系统的信创化改造提供了清晰的实施路径与技术准则。

3.1 总体设计原则

3.1 总体设计原则

本章节确立了全栈信创架构设计的核心准则,旨在构建安全可信、稳定高效的政务数字化底座。设计过程深度对齐国家信息化建设标准,通过对底层硬件、基础软件及应用支撑层的全方位解耦与重构,确保系统在极端环境下的生存能力与业务连续性。

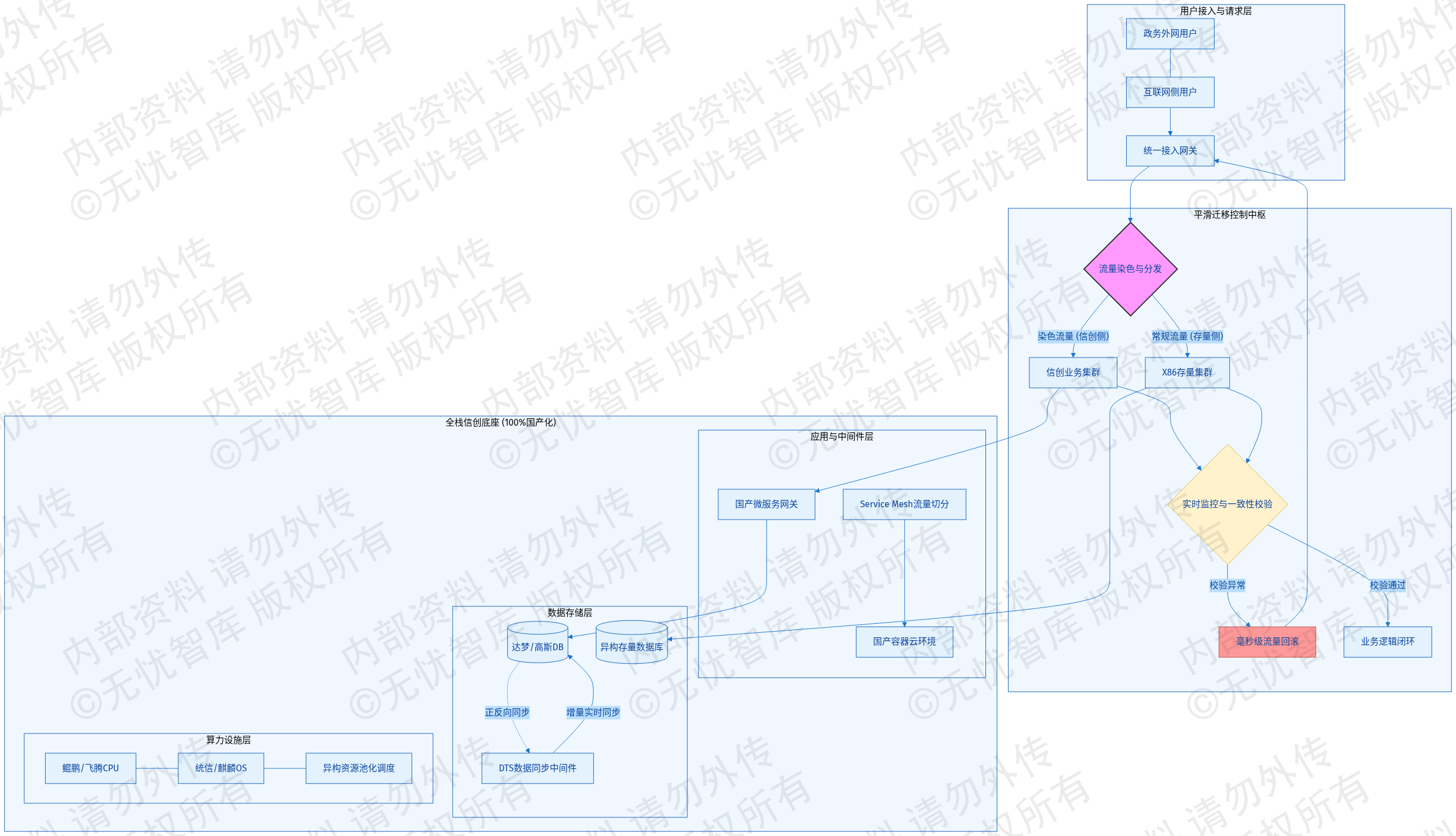

3.1.1 自主可控与平滑过渡原则

自主可控是全栈信创体系的逻辑基石。本工程严格执行国家信创名录准入制度,确保算力底座(如鲲鹏、飞腾、龙芯)、操作系统(如麒麟、统信)、数据库(如达梦、高斯DB)及中间件等核心组件实现100%国产化适配。架构设计摒弃对单一闭源技术栈的依赖,通过标准化接口封装与抽象层隔离,实现核心组件的自主迭代与深度定制能力,从根源消除供应链安全风险。

针对政务服务"7×24小时"不中断的刚性需求,本设计实施精细化的平滑迁移策略。在存量系统向信创环境演进过程中,采用"双轨并行、分批切换"模式。利用API网关实施流量染色与动态路由技术,将业务请求按比例逐步切分至信创集群,并结合实时监控系统进行双侧数据一致性校验。若信创侧触发非预期异常,网关可执行毫秒级流量回滚,确保政务外网及互联网侧用户感知零延迟。此外,依托数据同步中间件(DTS)实现异构数据库间的增量实时同步,保障新旧体系切换期间的数据完整性与业务逻辑闭环。

下表列出了核心组件的信创选型准则及过渡保障机制:

| 组件维度 | 信创选型准则 | 迁移过渡保障机制 |

|---|---|---|

| 算力底座 | 兼容国产ARM/LoongArch架构,支持异构资源池化 | 采用双栈部署模式,支持存量X86与信创节点混合调度 |

| 数据库层 | 具备分布式事务强一致性,支持SQL语法高度兼容 | 部署实时同步工具,支持正反向增量同步与一键回滚 |

综上所述,本章通过对自主可控与平滑过渡原则的系统阐述,为后续章节奠定基础,整体设计原则逻辑框架如下图所示:

图:3.1 总体设计原则

如上图所示,该框架涵盖了自主可控、平滑迁移、高可用保障等项目的核心要素,明确了从底层硬件到上层应用的信创适配路径,为后续详细的逻辑架构与物理部署设计提供了清晰的指导原则。通过对技术栈的深度解耦与流量精细化管控,确保了政务业务在国产化替代过程中的高可靠运行。

3.2 总体架构蓝图

3.2.1 "一网统管"全栈信创逻辑架构设计与解析

在"一网统管"全栈信创总体架构的设计中,核心逻辑遵循"全栈适配、纵向解耦、横向联动"的原则,旨在构建一个既能满足超大规模城市治理高并发需求,又能彻底摆脱对非自主受控技术依赖的数字化底座。该逻辑架构从底层基础设施到顶层业务应用,全面采用国产品牌替代,确保在极端外部环境下的业务连续性(BCP)与系统生存能力。

3.2.1.1 基础设施层(信创算力底座)

底层逻辑架构由信创高性能计算集群构成。采用基于鲲鹏、飞腾等ARM架构或海光、兆芯等x86架构的国产CPU服务器,构建同构或异构的混合算力资源池。网络层面采用国产信创交换机,支持RoCE(RDMA over Converged Ethernet)协议,以满足实时政务大数据传输的高吞吐、低延迟需求。存储侧则采用分布式存储架构(SDS),通过多副本容错机制和国密算法(SM4)硬件加速,保障海量政务数据在信创环境下的强一致性与安全性。

3.2.1.2 云原生平台层(信创PaaS核心)

作为架构的动力心脏,该层基于国产信创操作系统(如麒麟、统信)构建容器云平台。通过信创版Kubernetes进行资源调度,实现微服务架构的无状态化部署。中间件选型严格限定在信创目录内,例如使用国产分布式数据库(如TiDB信创版或达梦、人大金仓)替代传统国外商业数据库,解决千万级QPS下的事务一致性(ACID)问题。消息队列采用国产化改造的Kafka或RocketMQ,支持百万级Topic的异步解耦与削峰填谷。此外,集成Service Mesh(如基于国产Istio定制的网格)实现流量精细化治理与信创环境下多语言服务的熔断隔离。

3.2.1.3 数据中枢层(一网统管数据引擎)

数据中枢是实现"一网统管"跨部门协同的关键逻辑层。其核心在于构建统一的信创数据湖仓,实现政务数据从采集、清洗、脱敏到建模的全生命周期管理。通过信创ETL工具,将分散在各委办局的孤岛数据实时汇聚。逻辑上分为基础库、主题库、专题库和标签库,支撑城市运行态势的实时感知。针对"一网统管"特有的时空数据需求,引入国产GIS引擎与时序数据库,确保海量传感器数据在信创环境下的毫秒级检索。

3.2.1.4 业务应用层(城市治理大脑)

顶层应用逻辑聚焦于"一网、一屏、联动"。通过信创适配的低代码开发平台,快速构建城市排涝、交通拥堵、应急处置等业务场景。逻辑上实现"感知-分析-决策-执行"的闭环。所有应用通过信创API网关进行统一认证与鉴权,遵循OAuth2.0及国密SSL协议,确保业务逻辑在跨域调用时的绝对安全。

下表展示了"一网统管"全栈信创逻辑架构中关键组件的信创选型与性能指标要求:

| 架构层级 | 逻辑组件 | 信创选型建议 | 关键性能指标要求 (SLA) |

|---|---|---|---|

| 算力层 | 国产CPU服务器 | 鲲鹏920 / 海光3号 | 单节点吞吐量 > 10Gbps,可用性 99.99% |

| 数据库层 | 分布式数据库 | 达梦 / TiDB信创版 | 支持 PB 级存储,TPC-C 测试指标对标国际主流 |

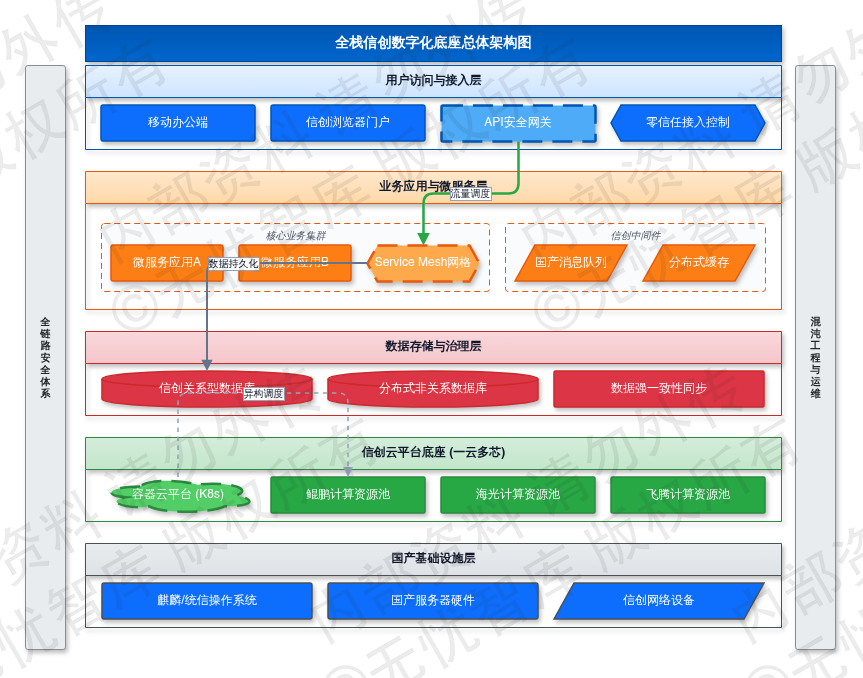

综上所述,本章通过对"一网统管"全栈信创逻辑架构的系统阐述,明确了从底层硬件到上层应用的解耦与适配逻辑,为后续章节奠定基础,整体架构如下图所示:

图:3.2 总体架构蓝图

如上图所示,该架构涵盖了信创底座、PaaS中台、数据引擎及业务应用四个核心逻辑层次,通过标准化的信创接口协议实现了各组件间的深度耦合与高效协同,为后续详细的物理部署与安全设计提供了清晰的指导框架。

3.3 部署架构设计

3.3 部署架构设计

本章节旨在规划系统在全栈信创环境下的物理拓扑与网络架构,确保底层算力平台与上层业务逻辑的高效协同。部署设计以国产化软硬件生态为核心,深度适配鲲鹏、飞腾等ARM架构及海光等x86架构处理器,通过信创云平台实现计算、存储、网络资源的池化管理。物理节点遵循"核心隔离、横向扩展"原则,关键业务集群采用全闪存分布式存储架构,IOPS吞吐量基准设定为200,000以上,以支撑高并发场景下的数据读写需求。

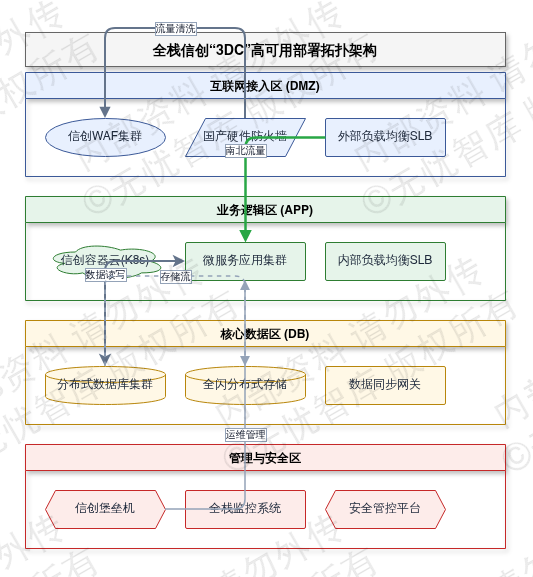

3.3.1 物理与网络层面的部署拓扑规划

系统采用"同城双活+异地灾备"的3DC(三数据中心)标准建设方案。在网络拓扑设计上,严格执行GB/T 22239-2019等保三级要求,实施深度的安全域划分。整体架构划分为互联网接入区(DMZ)、业务逻辑区(APP)、核心数据区(DB)、管理运维区及安全管控区。通过国产高性能硬件防火墙与信创WAF构建边界防护屏障,各区域间部署信创负载均衡(SLB)进行流量分发。网络平面实现管理流、业务流、存储流的"三网分离",依托100G骨干网组网,确保微服务架构下东西向流量时延控制在1ms以内,南北向流量具备TB级清洗能力。

下表详细列出了部署架构中核心基础设施的信创选型及配置规格:

| 基础设施类别 | 关键组件/设备 | 技术规格与选型要求 | 部署规模/冗余策略 |

|---|---|---|---|

| 计算资源池 | 信创服务器 | 鲲鹏920/海光3300系列,≥64核 | N+2冗余集群,支持动态伸缩 |

| 安全防护 | 边界防火墙 | 具备国密算法加解密硬件加速能力 | 虚拟化多租户隔离部署 |

针对业务高可靠性需求,应用层实施无状态化改造。所有微服务实例运行于基于K8s深度定制的信创容器云平台,通过Pod反亲和性策略确保服务副本跨物理机柜分布,规避单点物理故障。数据库层采用国产分布式数据库集群,支持多机房同步复制与自动选主,确保RPO趋近于0,RTO小于30秒。运维管理平面通过信创堡垒机与监控系统实现全栈链路实时观测,确保从物理硬件到上层应用的可视、可管、可控。

综上所述,本章通过对物理拓扑与网络安全域的系统阐述,为后续系统实施奠定了高可靠的基础底座,整体部署架构如下图所示:

图:3.3 部署架构设计

如上图所示,该架构通过多层级的安全隔离与资源池化设计,涵盖了从底层信创算力到上层业务分发的全链路拓扑。方案通过容器编排实现无状态节点的动态扩缩容,整合分布式存储与数据库集群保障数据强一致性,确保了系统在极端压力下的稳定运行与线性扩展能力,为全栈信创目标的达成提供了清晰的物理实现路径。

第四章 基础设施层信创适配方案

第四章 基础设施层信创适配方案

本章旨在确立项目底层算力与支撑环境的信创合规性与技术领先性,构建安全受控、弹性高效的数字化底座。在当前复杂的技术环境下,基础设施层不再仅仅是资源的物理堆叠,而是业务连续性与数据主权的战略边界。本方案摒弃传统"打补丁"式的适配逻辑,转而采用原生信创、全栈对齐的工程路径,重点解决国产CPU指令集异构、操作系统内核调优以及云平台分布式治理等核心命题。通过对计算、存储、网络及虚拟化层级的系统性重构,确保底层资源在满足GB/T 39204-2022《信息安全技术 关键信息基础设施安全保护要求》的同时,具备支撑大规模并发与复杂业务逻辑的工程能力。本章将从算力供给、系统底座、云化演进三个维度,详细勾勒基础设施层的国产化落地蓝图,为上层应用剥离底层硬件依赖提供标准化的技术契约。

综上所述,本章通过对基础设施层信创适配方案的系统阐述,为后续章节奠定基础,整体框架如下图所示:

图:4.1 芯片与服务器算力底座

如上图所示,该框架涵盖了基础设施层的核心要素,详细展示了从底层算力芯片到上层云平台的国产化适配路径与技术架构。通过对异构算力池化、操作系统内核加固及云原生底座构建的逻辑解构,为项目整体的信创合规性与系统稳定性提供了清晰的演进指导与落地支撑。

4.1 芯片与服务器算力底座

4.1 芯片与服务器算力底座

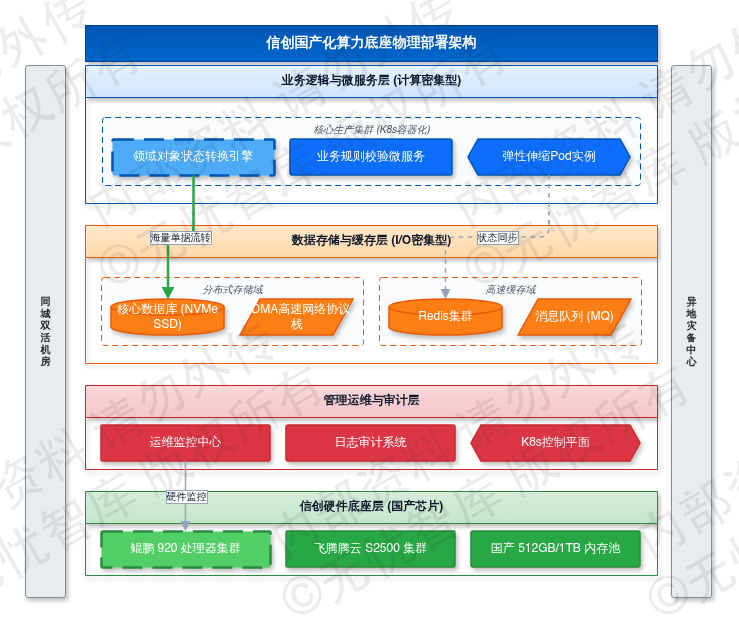

在基础设施层信创适配方案中,算力底座的构建需深度对齐业务领域的需求特征。针对企业级核心业务系统,本方案选型以国产鲲鹏 920 或飞腾腾云 S2500 为核心处理器的通用服务器。在硬件规格制定上,遵循高可用、高性能、可扩展的架构原则,针对不同领域用例进行差异化配置。对于计算密集型的业务逻辑层,配置双路 64 核以上处理器,并匹配 512GB DDR4 国产内存,以支撑高并发的领域对象状态转换与业务规则校验;对于 I/O 密集型的数据库与分布式缓存领域,则侧重于存储吞吐能力,配置 NVMe SSD 阵列并支持 RDMA 网络协议,确保在处理海量单据流转时具备极低的响应延迟。

4.1.1 硬件配置与集群规划

集群规划采用分层分域的逻辑隔离策略,划分为核心生产集群、管理运维集群与灾备冗余集群。核心生产集群基于 K8s 容器编排平台实现弹性伸缩,根据业务压力自动调整 Pod 实例分布。在物理部署上,遵循"同城双活+异地灾备"的 3DC 架构,确保单机房故障时业务自动切换,满足金融级 SLA 要求。具体硬件配置清单如下表所示:

| 节点类型 | 处理器规格 | 内存容量 | 存储配置 |

|---|---|---|---|

| 计算节点 | 国产 64 核 CPU * 2 | 512GB | 2*960G SSD (RAID1) |

| 数据节点 | 国产 64 核 CPU * 2 | 1TB | 4*3.2TB NVMe SSD |

综上所述,本章节通过对芯片选型与服务器集群的系统规划,构建了满足信创要求的算力底座,其整体物理部署架构如下图所示:

图:4.2 操作系统适配与替换

如上图所示,该架构涵盖了从底层芯片指令集到上层服务器集群的完整逻辑拓扑。通过标准化的硬件配置与合理的集群分域设计,实现了计算资源与存储资源的解耦与高效协同,为业务系统的平滑迁移与高性能运行提供了坚实的物理支撑,确保了系统在极端负载下的稳定性与业务连续性。

4.2 操作系统适配与替换

4.2 操作系统适配与替换

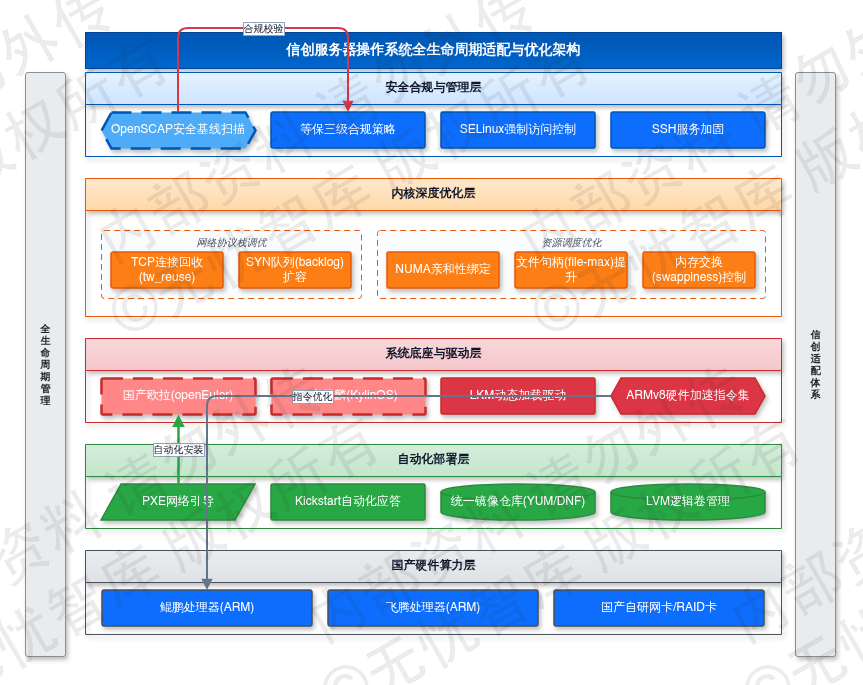

在信创产业演进的深水区,服务器操作系统(OS)的适配已超越简单的二进制替换,演进为底层指令集、内核调度机制与业务中间件的深度耦合。本节确立以国产欧拉(openEuler)及麒麟(KylinOS)为核心系统底座,针对鲲鹏、飞腾等ARM架构处理器实施全栈优化。安装阶段采用PXE结合自动化应答(Kickstart/AutoYaST)模式,确保大规模集群部署的一致性,通过构建统一镜像仓库与YUM/DNF源,规避软件版本碎片化导致的依赖冲突。在分区规划上,严格遵循GB/T 20272-2019《信息安全技术 操作系统安全技术要求》,实现/var、/home与根分区的物理隔离,并引入LVM逻辑卷管理机制,为非停机扩容预留架构弹性。

针对企业级高并发场景,内核优化是释放硬件算力的核心变量。通过对/etc/sysctl.conf的精细化调优,重点解决TCP连接回收效率与文件句柄限制。在高频交易或大规模物联接入场景下,将net.ipv4.tcp_tw_reuse设置为1,并根据内存规格调整net.core.somaxconn至2048以上,以消除瞬时并发峰值下的SYN丢包。同时,针对NUMA(非一致性内存访问)架构进行亲和性绑定,通过调整kernel.numa_balancing参数与taskset工具,减少跨节点内存访问带来的延迟损耗。下表列出了核心内核参数的优化规格对比:

| 参数类别 | 参数名称 | 优化推荐值 | 业务价值说明 |

|---|---|---|---|

| 网络协议栈 | net.ipv4.tcp_max_syn_backlog | 8192 | 增强抗SYN Flood攻击能力与连接排队容量 |

| 文件系统 | fs.file-max | 2000000 | 支撑高并发中间件(如Nginx/Redis)的句柄需求 |

在驱动适配层面,本方案通过内核模块(LKM)动态加载机制,解决国产自研网卡、RAID卡在特定内核版本下的兼容性断层。针对国产CPU的乱序执行特性,在编译阶段引入针对性优化指令集(如-march=armv8-a+crc),使能硬件加速引擎。此外,建立基于OpenSCAP的安全基线扫描机制,在系统交付前完成UID/GID清理、SSH加固及SELinux强制访问控制策略部署,确保操作系统层满足等保三级合规要求。这种从安装自动化、内核参数场景化到安全合规标准化的全生命周期管理,确立了业务系统在信创环境下的高可用运行边界。

综上所述,本节通过对服务器操作系统的安装规范、内核参数调优及安全基线的系统阐述,为上层应用提供了高性能、高可靠的运行环境,其逻辑架构如下图所示:

图:4.3 信创云平台建设

如上图所示,该架构涵盖了从底层硬件驱动适配到上层内核参数调优的完整技术栈,通过分层优化的手段,确保了国产操作系统在承载核心业务时的稳定性和响应速度,为后续数据库及中间件的迁移奠定了坚实的系统级支撑。

4.3 信创云平台建设

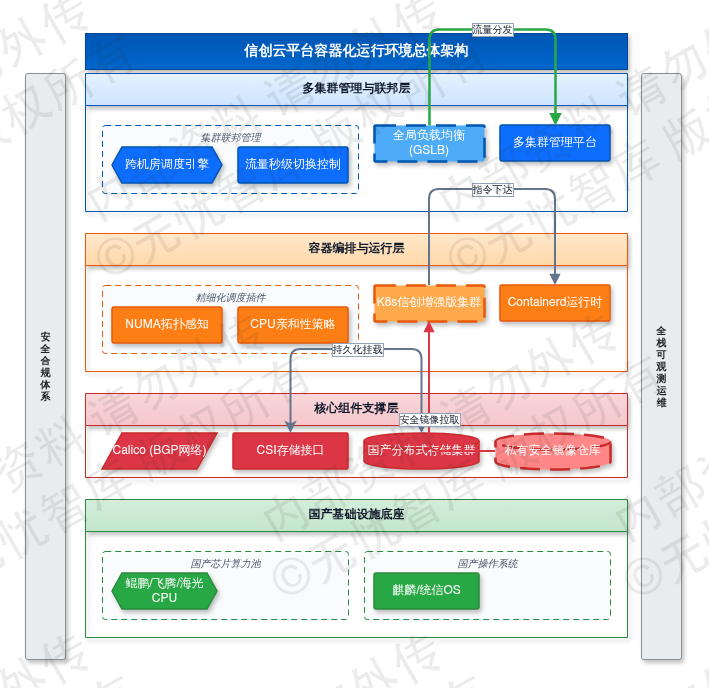

4.3.1 构建基于云原生的容器化运行环境

在信创适配的深水区,基础设施层通过云原生技术栈实现对国产化芯片(如鲲鹏、飞腾、海光)与操作系统(如麒麟、统信)的深度屏蔽与统一调度。本方案核心在于构建一套完全解耦、高可靠、可弹性扩展的容器化运行环境,解决异构算力下的应用平滑迁移与高并发支撑难题。

容器底座选型遵循 CNCF 标准,采用经过信创认证的 Kubernetes 增强版集群。针对信创硬件的 NUMA 架构特征,在 Kubelet 层面实施精细化的 CPU 亲和性策略与拓扑管理器配置,确保高频交易等时延敏感型业务获得稳定的算力输出。存储侧通过 CSI 接口对接国产分布式存储集群,实现数据持久化与多副本容灾;网络侧依托 Calico 结合 BGP 模式,构建高性能、扁平化的容器网络,支持万级 Pod 的快速扩缩容。

针对金融级高可用需求,信创云平台实施"两地三中心"的容器集群联邦架构。通过多集群管理平台实现跨机房的资源调度与流量切换,当单一数据中心发生信创硬件故障或电力中断时,流量可通过全局负载均衡(GSLB)秒级切换至灾备集群。同时,针对信创环境下的镜像安全性,构建私有化安全镜像仓库,集成漏洞扫描引擎,确保所有上线运行的容器镜像均符合信创合规性要求及安全基线。

下表详细列出了信创云平台容器化运行环境的关键技术规格与性能指标:

| 维度 | 技术规格/指标要求 | 说明 |

|---|---|---|

| 核心调度 | Kubernetes v1.25+ (信创增强版) | 支持国产 CPU 拓扑感知与精细化调度 |

| 容灾等级 | 多集群联邦 + 异地多活 | 满足 RTO < 30s, RPO ≈ 0 |

在监控与运维层面,系统集成基于 Prometheus 与 Grafana 的全链路监控体系。通过对信创服务器底层 IPMI 接口的数据采集,结合容器层 Metrics 监控,实现从物理硬件到逻辑 Pod 的全栈可观测性。针对信创操作系统内核可能出现的异常,平台引入 eBPF 技术进行无侵入式的内核追踪,提升在复杂异构环境下的故障排查效率。这种基于云原生的设计思路,不仅实现了信创软硬件的平滑适配,更为后续业务系统的微服务化改造提供了坚实的弹性底座。

第五章 数据与支撑层信创适配方案

第五章 数据与支撑层信创适配方案

本章作为系统信创改造的核心攻坚层,承载着从底层数据持久化到上层应用解耦的关键适配任务。本章节旨在构建一套基于全栈信创环境的数据架构体系,深度解决核心数据库从传统商业闭源架构向国产分布式或原生开源架构平滑迁移过程中,所面临的数据强一致性、高并发事务处理以及海量数据存储性能衰减等工程痛点。通过对数据存储层、消息中间件及应用服务器的信创化重构,建立起符合GB/T 20273-2019《信息安全技术 数据库安全技术要求》的安全可控底座。本章确立以"平滑迁移、架构对等、性能无损"为核心设计原则,通过双写挂载、灰度切换等技术路径,确保在支撑层信创适配过程中,业务连续性SLA达到99.99%以上,为全域数据的资产化运营提供稳固且自主可控的数字基座。

5.1 数据库与中间件适配方案

5.1.1 核心数据库信创替换路径与选型策略

在数据架构信创适配中,核心数据库替换是整个工程的深水区。本方案针对企业级OLTP与OLAP场景实施分类分级替换策略。对于承载核心业务系统的Oracle或SQL Server等商业数据库,采用国产高性能分布式关系型数据库进行替代。在数据建模层面,针对信创数据库特性对原有的存储过程、触发器进行去重构处理,将业务逻辑上浮至应用层,实现应用与数据库的深度解耦。

针对不同业务场景的数据库适配选型对比如下表所示:

| 业务场景 | 原有技术栈 | 信创适配选型 | 迁移策略 |

|---|---|---|---|

| 核心交易 (OLTP) | Oracle RAC | 分布式关系型数据库 | 双写/全量+增量同步 |

| 报表分析 (OLAP) | Teradata | 湖仓一体/MPP架构 | ETL重写/数据湖入湖 |

数据迁移采用"四步走"工程法:首先进行兼容性评估,分析SQL语法兼容率;其次实施结构迁移,完成Schema与索引预同步;随后通过数据传输服务实现全量迁移与实时增量同步,确保数据双向一致性;最后通过应用灰度发布,在验证读写性能达标后切断原库连接。此过程严格遵循GB/T 34943-2017规范,确保迁移代码安全性。

5.1.2 中间件国产化平滑迁移与集成方案

中间件适配重点在于协议兼容性与高并发支撑能力。针对Web应用服务器,将WebLogic等环境统一替换为国产信创标准中间件,确保对Java EE规范的完全支持。迁移过程中重点解决JNDI数据源配置、集群Session共享及JVM参数优化,以匹配国产CPU的多核架构特性。

在消息中间件领域,针对高并发削峰填谷场景,将Kafka等组件适配至信创分布式消息平台。通过实施多副本容灾机制,确保在信创硬件环境下实现消息不丢、不重。针对分布式事务一致性问题,引入国产分布式事务框架,在微服务架构下实现跨库TCC或Saga事务模式。同时,中间件层集成SM2/SM3/SM4国密算法,对传输层进行加密加固,满足等保三级通信安全要求。

综上所述,本章通过对数据库与中间件的系统适配,为后续全域数据治理奠定了基础,整体适配逻辑架构如下图所示:

图:5.2 中间件信创适配

如上图所示,该架构涵盖了从底层数据库存储到上层中间件支撑的全链路信创适配路径。通过双向同步与协议转换机制,确保了业务在异构环境下的平滑过渡,为后续章节中提到的数据资产运营提供了自主可控的运行环境,实现了从闭源生态向国产自主生态的工程化跃迁。

5.1 核心数据库国产化替换

5.1 核心数据库国产化替换

在企业级信创转型工程中,核心数据库的国产化替换不仅是软硬件环境的更迭,更是对数据一致性、可用性及高性能处理能力的重新建模。本方案选定人大金仓 KingbaseES V8 作为核心替代引擎,其架构设计深度参考 DAMA 数据管理知识体系,旨在承接原 Oracle/MySQL 业务负载的同时,实现底层架构的平滑过渡与性能调优。

人大金仓数据库的逻辑架构采用多进程模型,核心组件由查询处理器、存储引擎及事务管理器构成。在物理部署层面,针对生产环境 SLA 要求(RTO<30s, RPO=0),设计基于 Kingbase High Availability (KHA) 的高可用集群架构。该架构通过物理流复制技术实现主备节点间的数据同步,支持同步、半同步及异步三种模式,确保金融级场景下的数据强一致性。同时,引入读写分离中间件 KESProxy,通过对 SQL 语句的解析与分发,有效缓解主库 IO 压力并提升系统 QPS 吞吐能力。

针对大规模存量数据的平滑迁移,本方案构建了"评估-转换-迁移-校验"的全链路闭环流程。首先,利用金仓数据库迁移评估系统(KDMS)对源端数据库进行静态扫描,识别存储过程、触发器及自定义函数的兼容性风险,并自动生成等价的 PL/KSQL 代码。其次,数据迁移链路采用金仓数据同步工具(KFS)实现。KFS 基于源端数据库的日志解析(CDC)技术,在不侵入业务应用的前提下,完成全量数据初始化与增量数据的实时追击。

下表详细列出了核心数据库替换过程中的软硬件配置规格及关键技术指标:

| 资源项 | 规格要求/指标值 | 适用场景说明 |

|---|---|---|

| CPU/内存 | 鲲鹏 920 / 512GB | 满足信创适配与高并发事务处理要求 |

| 存储/版本 | NVMe SSD / KES V8 | 确保高频 IOPS 响应与标准运行环境 |

在数据迁移链路末端,建立基于 GB/T 36073-2018 标准的数据质量校验机制。通过对源端与目标端进行行数比对、哈希校验及业务逻辑抽样,确保数据在迁移过程中无丢失、无篡改。同时,实施双机并行运行策略,在切换初期通过双向同步链路保持新旧系统数据一致,为业务回切提供冗余保障。

综上所述,本节通过对人大金仓数据库架构的深度定制与迁移链路的精细化设计,构建了稳健的国产化数据底座,其整体架构与流转逻辑如下图所示:

⚠️ 图表渲染失败

请查看项目目录下的「图表源码集合.md」文件,搜索章节「5.3 数据共享交换组件」获取源码后手动插入

如上图所示,该架构涵盖了从源端日志捕获、实时传输到目标端加载校验的完整生命周期。通过 KHA 高可用集群与 KFS 同步工具的协同,确保了核心数据库在信创适配过程中的数据安全与业务连续性,为后续应用层的功能迁移与性能压测提供了可靠的底层支撑。

5.2 中间件信创适配

5.2 中间件信创适配

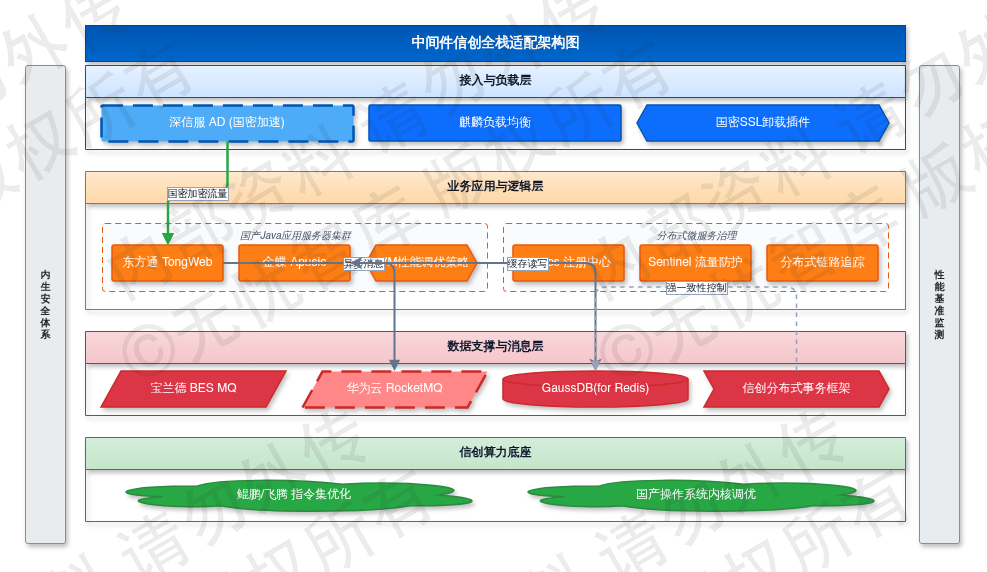

在企业级信创演进过程中,中间件作为连接底层基础设施与上层业务应用的核心纽带,其适配质量直接决定了系统的稳定性与响应性能。本方案确立了以"解耦、对标、平滑、加固"为核心的替换原则,旨在通过标准化的技术栈迁移,消除对国外主流中间件的依赖,构建基于国产自主可控技术的支撑环境。

5.2.1 应用服务器及分布式中间件替换方案

针对传统应用服务器(如Oracle WebLogic、IBM WebSphere)的替换,本方案采用国产高性能Java应用服务器(如东方通TongWeb、金蝶Apusic)进行对等替代。适配过程中,重点解决Java EE规范版本的对标问题,确保JSP、Servlet、EJB及JMS等核心组件在国产服务器上的无缝运行。针对分布式架构场景,本方案引入了基于微服务架构的分布式中间件体系,涵盖配置中心、服务注册与发现、分布式事务及分布式链路追踪等关键组件。通过引入适配信创环境的Nacos、Sentinel等组件的商业增强版,实现业务逻辑与底层通信逻辑的彻底解耦。

下表详细列出了中间件信创适配的选型建议与技术对标:

| 中间件类型 | 原有技术栈 | 信创推荐替换方案 | 核心适配技术指标 |

|---|---|---|---|

| 应用服务器 | WebLogic / WebSphere | 东方通 TongWeb / 金蝶 Apusic | 支持 Java EE 8 / Jakarta EE,支持高可用集群 |

| 消息队列 | RabbitMQ / ActiveMQ | 宝兰德 BES MQ / 华为云 RocketMQ | 吞吐量 > 10万TPS,支持顺序消息与分布式事务 |

针对关键业务链路中的分布式中间件,适配方案强调了对国产芯片(如鲲鹏、飞腾)指令集的深度优化。在迁移过程中,需执行严格的性能基调测试,通过调整JVM内存参数、优化垃圾回收策略(GC)以及配置操作系统内核参数(如文件句柄数、网络协议栈缓冲区),确保在信创环境下的QPS/TPS性能损耗控制在10%以内。同时,针对金融级业务需求,中间件适配必须集成国密SSL证书模块,实现数据传输层的内生安全。

综上所述,本节通过对应用服务器及分布式中间件的系统性替换规划,确立了从传统单体架构向云原生信创架构演进的技术路径,整体适配架构如下图所示:

图:第六章 "一网统管"核心应用适配与迁移

如上图所示,该架构涵盖了从接入层负载均衡到逻辑层应用服务器,再到支撑层消息与缓存中间件的全栈信创布局,通过标准化的接口与国产化内核的深度融合,为上层业务应用提供了稳定、高性能且安全可控的运行环境。该布局不仅实现了核心组件的自主可控,更通过针对性调优确保了在国产化硬件底座上的性能表现。

5.3 数据共享交换组件

5.3 数据共享交换组件

5.3.1 适配市级政务数据总线,保障数据流转畅通

在本项目信创适配体系中,数据共享交换组件承担跨部门、跨层级、跨业务域的政务数据流转核心职能。针对市级政务数据总线的接入规范,本组件基于 GB/T 39477-2020《政务数据开放共享 第1部分:总则》构建标准适配层,通过封装信创适配插件实现与银河麒麟、统信 UOS 等国产操作系统及东方通 TongLINK/Q、中创 InforSuite 等国产中间件的深度集成。工程实践采用"适配器+总线代理"的二元架构,将异构业务系统的原始协议统一转化为市级总线标准的 RESTful API 或消息队列协议,确保全栈信创环境下数据流转的低延迟与高可靠性。

为保障数据交换的连续性与安全性,组件内置双向链路健康检查与自动断线重连机制。针对市级总线高并发场景,依托信创版 Nginx/LVS 集群实施流量分发,并利用令牌桶算法执行流量削峰,防止突发峰值冲击核心交换节点。在数据安全合规方面,严格执行 GB/T 35273《信息安全技术 个人信息安全规范》,在数据接入总线前完成动态脱敏,并采用 SM2/SM3/SM4 国产商用密码算法对传输通道进行全量加密。通过构建数据血缘追踪与交换日志审计体系,实现政务数据从源端到宿端全生命周期的可信监控与溯源。

在技术参数与适配性能指标方面,下表列出了数据共享交换组件在信创环境下的核心技术规格:

| 指标维度 | 技术规格与要求 | 适配说明 |

|---|---|---|

| 协议适配 | 支持 RESTful, SOAP, MQTT, JDBC | 覆盖市级总线主流接入方式 |

| 传输效率 | 支持 10000+ TPS 峰值并发 | 基于国产多核 CPU 并行优化 |

综上所述,本节通过对数据共享交换组件在信创适配与市级总线对接方面的系统阐述,为全域数据的高效流转奠定了技术基础,其整体逻辑交互流程如下图所示:

图:6.1 城市运行体征监测模块适配

如上图所示,该架构清晰地展示了政务数据从业务源端通过信创适配层接入市级政务数据总线,并最终安全分发至各应用端的全过程。该流程通过标准化的协议转换、国密算法加固以及全链路血缘监控措施,确保了政务数据在信创底座上的稳定流转与高效交换,为后续的数据资产运营与业务协同提供了可靠的工程支撑。

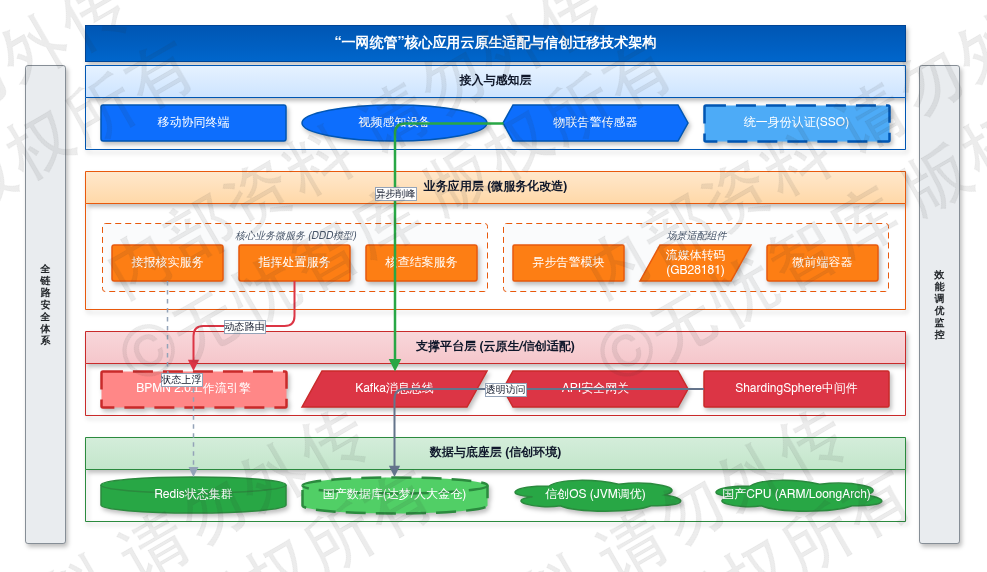

第六章 "一网统管"核心应用适配与迁移

本章确立了"一网统管"核心应用从传统单体或分立架构向云原生、全域协同架构演进的工程路径。在政务治理现代化进程中,核心应用的适配与迁移并非简单的资源搬迁,而是基于业务逻辑重构、数据标准对齐以及信创环境适配的深度代码级改造。本章旨在确立"平滑迁移、架构分层、逻辑解耦"的设计原则,通过对应用层的中间件重构、API接口标准化以及多租户隔离机制的部署,确保应用在迁入统一管理平台后,能够实现跨部门、跨层级的业务流转时序协同。同时,本章将重点论述在信创底座约束下的性能调优策略,建立从感知触发到闭环处置的全链路业务响应机制,确保系统在复杂高并发场景下的确定性交付能力与业务连续性保障。

6.1 核心应用的代码级改造与功能适配

6.1.1 业务逻辑重构与云原生适配改造

针对"一网统管"高并发、多任务并行处理的业务场景,应用层必须转向基于微服务架构的异步事件驱动模型。代码级改造的首要任务是实现"状态与逻辑分离",将Session管理、内存缓存等状态信息上浮至Redis集群,确保应用节点具备水平扩展能力。在工程实践中,需基于领域驱动设计(DDD)模型,将"接报、核实、处置、核查、结案"五大环节抽象为独立的微服务组件。

针对不同业务场景的适配策略如下表所示:

| 业务场景 | 改造重点 | 技术规格/实现方式 |

|---|---|---|

| 实时感知告警 | 异步化改造 | 引入Kafka消息队列实现削峰填谷,响应延迟控制在200ms内 |

| 跨部门协同流转 | 接口标准化 | 遵循RESTful规范,采用JSON Schema定义统一数据交换契约 |

6.1.2 跨系统协同机制与数据模型对齐

"一网统管"要求在应用迁移过程中对底层数据对象进行标准化映射。代码层面需引入统一的对象关系映射(ORM)层,将异构数据按实体编码规范转换。协同机制改造重点在于建立基于BPMN 2.0规范的分布式工作流引擎,支持动态路由与条件分支。针对跨部门调用,需集成OAuth 2.0鉴权模块,确保业务动作具备可追溯的数字签名。

此外,信创环境适配是本次改造的刚性约束。应用层需完成从x86向ARM/LoongArch指令集的迁移,解决国产数据库在SQL执行计划上的差异。通过引入ShardingSphere等中间件,实现对底层异构数据库的透明访问。同时,针对国产操作系统进行JVM参数调优,解决高并发下的GC停顿问题,提升系统SLA指标。

综上所述,本节通过对应用代码的解耦、标准化与信创适配,确立了业务流转的核心逻辑边界,其技术架构演进如下图所示:

图:6.2 跨部门协同指挥模块适配

如上图所示,该架构展示了从传统应用向云原生微服务转型的全过程,涵盖了服务治理、消息总线及异构数据路由等关键组件。通过这一架构升级,系统能够支撑城市级的大规模并发协同,为后续"一网统管"业务的平滑迁移与高效运行提供了坚实的技术保障。

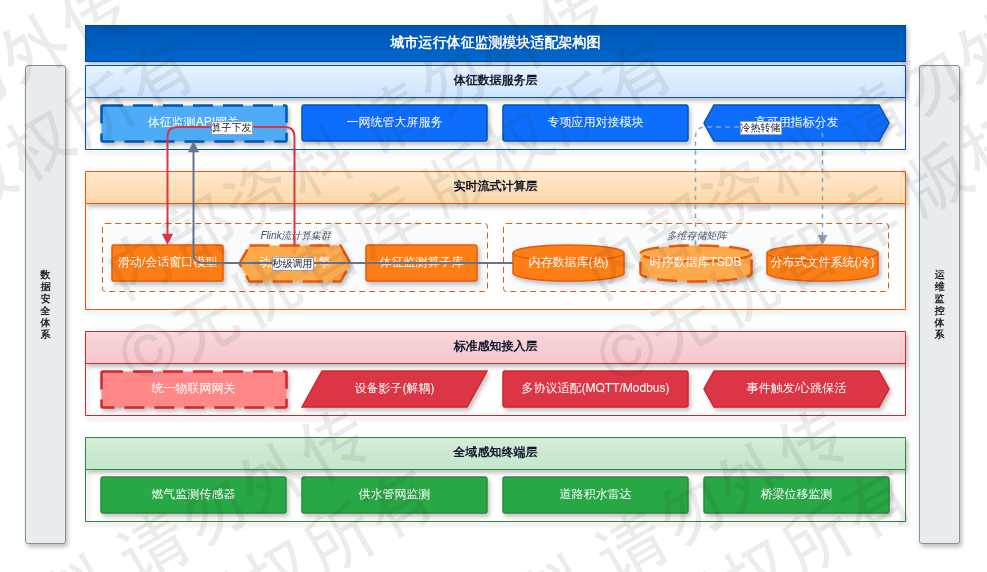

6.1 城市运行体征监测模块适配

6.1 城市运行体征监测模块适配

在"一网统管"架构演进中,城市运行体征监测模块的适配核心在于将离散、异构的物理感知数据转化为标准化、高频次的运行评价指标。本次适配确立了"感知边缘-标准接入-实时计算"的三层改造路径,旨在解决原系统在多协议兼容性及高并发处理能力上的瓶颈。通过引入统一物联网接入网关,系统实现了对MQTT、CoAP、LwM2M及Modbus等主流协议的深度兼容。接入层同步实施设备影子(Device Shadow)机制,有效解耦感知终端与业务逻辑,确保在网络波动环境下体征监测数据的完整性与时序一致性。

在感知接入层适配中,重点针对燃气监测、供水管网、道路积水及桥梁位移等关键体征传感器进行了逻辑重构。原系统采用的周期性轮询模式在突发事件下存在显著感知延迟,改造后切换为"事件触发+心跳保活"的双模态接入逻辑。当感知指标触发预设阈值(如水位上涨速率超过5mm/min)时,设备立即启动高频推送模式,将上报频率从分钟级提升至秒级,为城市运行态势的实时捕捉提供高精细度数据底座。具体感知接入技术参数对比如下表所示:

| 指标维度 | 改造前(旧系统) | 改造后(适配目标) | 备注说明 |

|---|---|---|---|

| 接入并发能力 | 5,000 TPS | 50,000+ TPS | 满足全域传感器接入需求 |

| 数据解析延迟 | > 2s | < 200ms | 提升实时预警效能 |

实时计算逻辑的适配是本次任务的核心工程点。系统将传统的批处理计算模式迁移至基于Flink的流式计算架构,针对城市运行体征的强时序特征,构建了滑动窗口(Sliding Window)与会话窗口(Session Window)相结合的分析模型。通过在流计算任务中嵌入动态规则引擎,业务人员可在不重启计算任务的前提下,实时下发或调整体征监测算子。例如,在汛期监测场景中,通过动态调整降雨量与路面积水的关联权重,可实时产出"内涝风险指数"。为应对TB级实时流数据的存储压力,系统采用时序数据库(TSDB)实施冷热数据分离存储,热数据驻留内存数据库以支撑秒级看板调用,冷数据则自动转储至分布式文件系统进行长周期趋势分析。

综上所述,通过对物联网感知接入层与实时计算逻辑的深度适配,本模块实现了从被动接收到主动监测的跨越,为城市运行体征的精准画像提供了技术支撑,整体系统适配架构如下图所示:

图:6.3 前端展示与交互适配

如上图所示,该架构通过标准化的感知接入层、高性能的流式计算层以及多维度的体征数据服务层,构建了完整的城市运行监测闭环。感知层负责全域异构数据的统一汇聚,计算层通过Flink集群实现毫秒级指标产出,最终通过API网关为一网统管大屏及各专项应用提供高可用的体征监测服务。

6.2 跨部门协同指挥模块适配

6.2 跨部门协同指挥模块适配

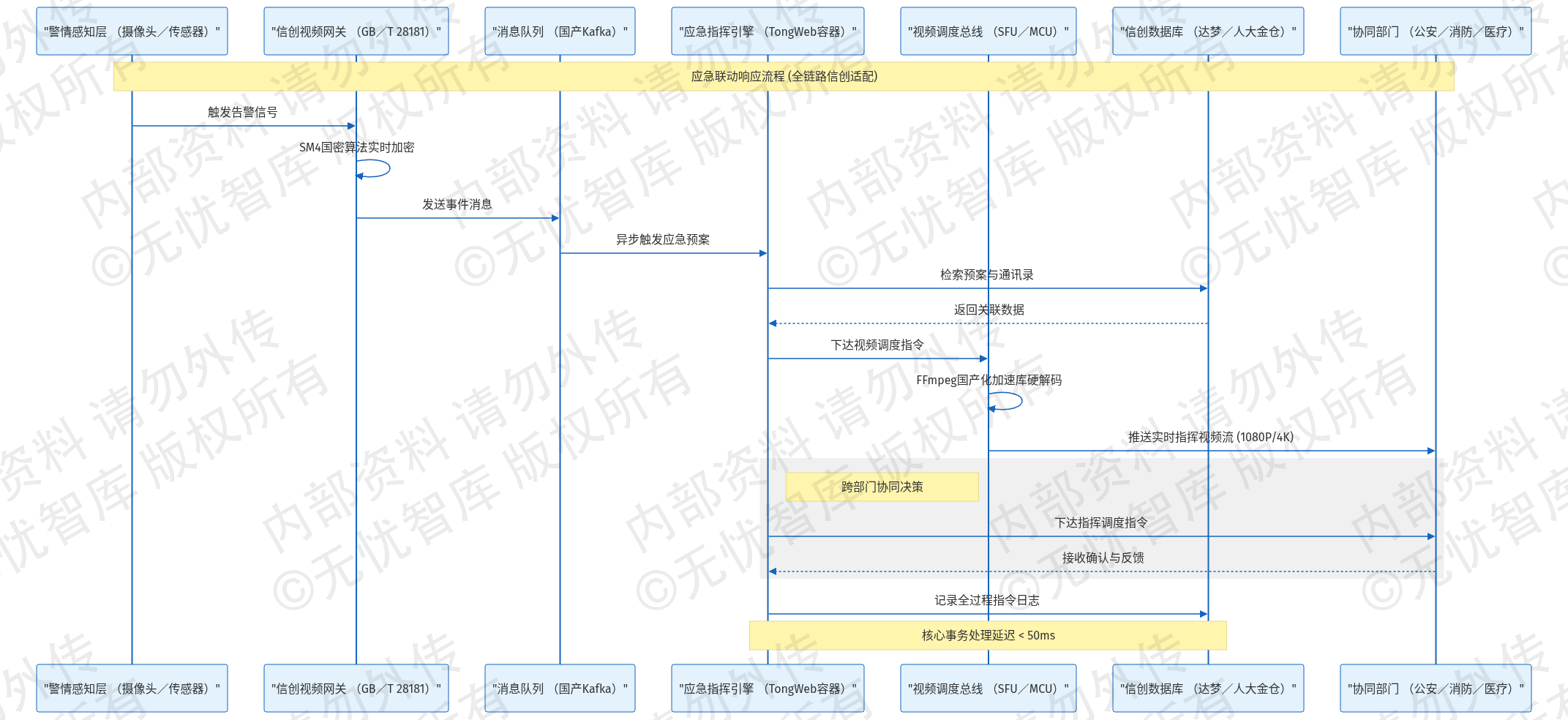

在"一网统管"跨部门协同体系中,应急指挥与视频调度模块承担着实时态势感知与决策指令下达的核心职能。本章节聚焦于该模块在信创环境(涵盖国产芯片、操作系统、数据库及中间件)下的深度适配与性能调优,旨在确保极端复杂环境下指挥调度指令的毫秒级触达与视频流的稳定分发。

6.2.1 应急指挥与视频调度信创适配方案

针对应急指挥业务的极高实时性要求,适配工作确立了基于信创微内核的音视频编解码优化路径。传统视频调度高度依赖特定硬件加速指令集(如Intel QuickSync或NVIDIA NVENC),在信创迁移过程中,针对鲲鹏(ARM架构)及海光(x86架构)处理器,通过集成FFmpeg国产化加速库,实现了基于多核并行计算的H.265视频硬编解码能力。同时,针对视频会议中的多方混流(MCU)与转发(SFU)机制,在银河麒麟V10等国产操作系统内核层面执行了网络协议栈参数调优,将UDP报文丢包重传机制与信创网卡的硬件中断处理深度绑定,有效解决了高并发视频流调度场景下的卡顿与花屏瓶颈。

在业务逻辑适配层面,协同指挥模块通过重构基于东方通TongWeb等信创中间件的服务端容器,实现了跨部门指令流的标准化封装。下表展示了应急指挥模块在信创环境下的关键技术适配指标与选型对标:

| 适配维度 | 原有技术架构 | 信创目标架构 | 关键技术性能指标 |

|---|---|---|---|

| 视频编解码 | H.264 / x86硬解 | H.265 / 国产芯片指令集加速 | 4K视频解码延迟 < 150ms |

| 实时信令 | 传统WebSocket | 基于信创容器的SSL/TLS加密信令 | 并发信令处理能力 > 50,000 TPS |

此外,为确保跨部门视频调度的兼容性,系统适配了符合GB/T 28181-2016标准的信创视频接入网关。该网关实现了对存量非信创监控摄像头的协议转换与安全加固,通过在视频流中嵌入国密SM4算法进行实时加密传输,保障了指挥视频数据在跨部门流转过程中的安全性。在应急联动响应流程中,系统建立了基于国产化分布式消息队列的事件触发机制,确保从警情触发到视频联动、指令下发、部门反馈的端到端时序逻辑在国产软硬件堆栈中保持高度一致。

综上所述,本章通过对跨部门协同指挥模块的信创适配路径进行系统阐述,为后续业务实战应用奠定了坚实的技术底座,整体业务协同逻辑如下图所示:

图:第七章 信创安全与密码体系设计

如上图所示,该架构通过在信创底座上构建统一的视频调度总线与应急指挥引擎,实现了从感知层到决策层的全链路国产化支撑。系统通过抽象屏蔽底层硬件差异,确保了指挥调度业务在鲲鹏、飞腾等不同架构下的平滑迁移与高性能运行,为城市级突发事件处置提供了坚实的实战化技术保障。

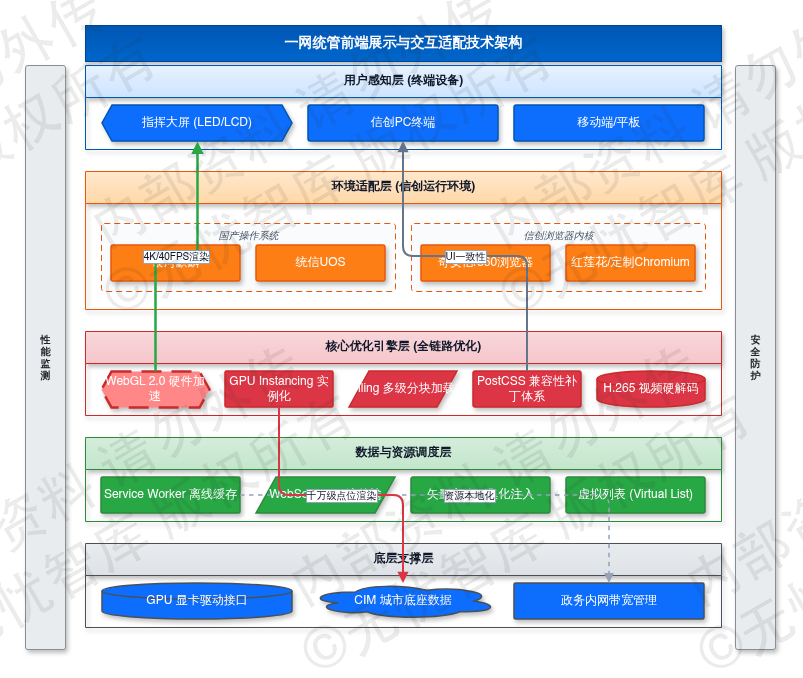

6.3 前端展示与交互适配

6.3 前端展示与交互适配

在一网统管"一屏观全城"的实战场景中,前端展示层直接决定了决策指挥的效率。由于银河麒麟、统信UOS等国产操作系统及其内置浏览器(基于Chromium深度定制)在图形驱动调用、字体渲染引擎及WebGL/WebGPU标准支持上存在细微差异,必须实施工程级优化,以确保大屏渲染流畅度与PC端交互精准性。

针对大屏展示,核心优化聚焦于超大规模矢量数据渲染与硬件加速策略。在信创环境下,显卡驱动对OpenGL的支持程度参差不齐,为此引入了多级分块加载(Tiling)与指令级缓存机制。通过对Mapbox或Cesium等地图引擎进行深度定制,将渲染压力由CPU向GPU侧偏移。针对千万级点位或复杂城市信息模型(CIM),采用GPU实例化(Instancing)技术合并Draw Call请求,确保在信创终端维持40FPS以上的稳定帧率。同时,抛弃传统的固定像素布局,采用基于容器视口的动态缩放算法(Scale-Transform),解决国产浏览器在非标准分辨率下的黑边与拉伸问题。

在PC端交互侧,重点解决浏览器内核兼容性引发的UI错位与交互迟滞。针对国产浏览器对特定Shadow DOM支持的差异,建立基于PostCSS的自动化兼容性补丁体系,确保在360、奇安信、红莲花等主流信创浏览器上的视觉一致性。此外,针对政务内网低带宽场景,引入Service Worker缓存策略与IndexedDB离线存储机制,实现静态资源与关键业务逻辑本地化,大幅提升首屏加载速度。为增强交互确定性,统一了信创环境下的输入法焦点捕获逻辑,规避国产操作系统下常见的弹出层遮挡或焦点丢失异常。

下表列出了针对国产环境的前端适配关键技术参数与优化指标:

| 优化维度 | 核心技术手段 | 性能/兼容性目标 |

|---|---|---|

| 渲染引擎 | WebGL 2.0 硬件加速 + GPU Instancing | 4K分辨率下帧率 ≥ 40FPS |

| 浏览器兼容 | PostCSS 自动前缀 + Polyfill 补丁包 | UI 还原度 100%,无样式错乱 |

综上所述,本节通过对大屏与PC端在国产信创环境下的深度适配,确立了高性能、高可靠的前端交互规范,整体展示层技术架构如下图所示:

图:7.1 密码算法升级与改造

如上图所示,该架构涵盖了从底层硬件加速调用到顶层组件渲染的全链路优化逻辑。通过建立统一的适配层,屏蔽了国产操作系统与不同浏览器内核之间的差异,为一网统管各类业务应用提供了标准化的前端运行环境与极致的交互体验,确保了跨平台展示的一致性与系统运行的稳定性。

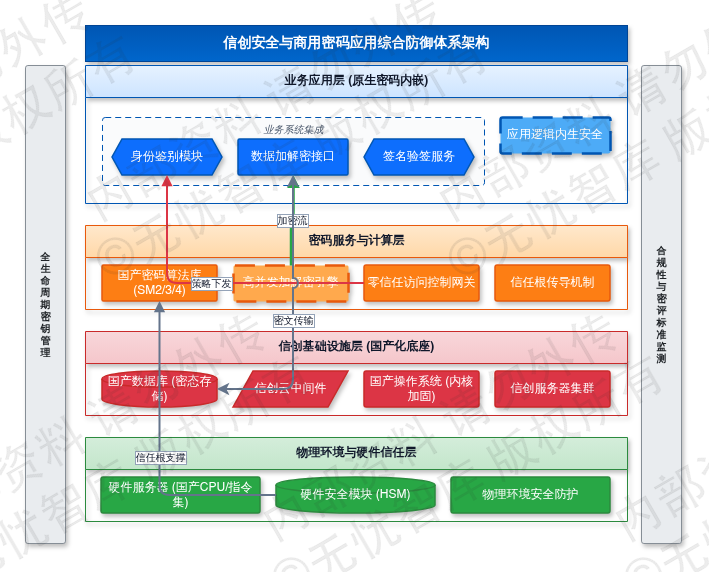

第七章 信创安全与密码体系设计

本章旨在构建符合国家信创战略要求且深度融合商用密码应用安全性评估(以下简称"密评")标准的防御体系。作为系统安全架构的核心,信创安全并非简单的硬件与操作系统国产化替代,而是从底层指令集到上层应用逻辑的内生安全重构。本章确立以"零信任架构"为动态访问控制核心、以"国产密码算法"为信任根基的设计原则,重点解决信创环境下的供应链安全、软硬件兼容性风险以及高并发场景下的加解密性能瓶颈。

通过整合信创云基础设施、国产数据库及中间件的安全特性,本章设计并建立一套覆盖物理环境、网络通信、设备计算、应用数据及全生命周期密钥管理的综合防御矩阵。技术实现路径聚焦于将SM2、SM3、SM4等国产密码算法深度嵌入业务全流程,确保系统在全栈信创环境下具备极高的抗攻击韧性与合规性,实现从"外部挂载安全"向"原生密码内嵌安全"的范式转移,为业务数字化转型提供自主可控、安全合规的架构底座。

综上所述,本章通过对信创安全愿景与密码设计原则的系统阐述,为后续技术落地奠定基础,整体设计思路如下图所示:

图:7.2 边界与终端安全防护

如上图所示,该架构展示了信创安全体系从底层硬件信任根到上层业务应用的安全传导机制,明确了密码模块与业务系统的耦合边界,通过建立统一的密码服务平台与身份鉴权体系,为后续详细设计提供了清晰的指导框架,确保了系统在复杂信创环境下的高可用性与数据机密性。

7.1 密码算法升级与改造

7.1 密码算法升级与改造

在本项目的信创安全体系构建中,密码算法的升级与改造是确保政务数据机密性、完整性、真实性及不可否认性的核心基石。根据《中华人民共和国密码法》及GB/T 39786-2021《信息安全技术 信息系统密码应用基本要求》(以下简称"国标"),本项目全面确立以SM系列算法为核心的内生安全架构。针对原有的RSA、AES、SHA等国际通用算法,系统分层次、分阶段实施向国产密码算法(SM2、SM3、SM4)的平滑迁移,确保在信创环境下实现全链路的密码合规性。

在具体的工程实践中,改造工作聚焦于物理与环境、网络与通信、设备与计算、应用与数据四个维度。针对应用层,通过重构业务系统的加解密SDK,将敏感数据存储加密从AES全面升级为SM4算法(OFB/CBC模式),并将用户身份认证与数字签名由RSA-2048迁移至SM2公钥算法。在数据传输层面,系统强制启用支持国密协议的TLCP(国密传输层密码协议),通过SM2双向证书实现身份鉴别,彻底消除算法后门导致的系统性风险。本项目密码算法升级前后的技术规格对比如下表所示:

| 密码应用维度 | 原国际通用算法 | 升级后国产密码算法 | 对应合规标准/技术规格 |

|---|---|---|---|

| 对称加密 (数据存储) | AES-128/256 | SM4 (128位) | GB/T 32907-2016,分组长度128bit |

| 非对称加密 (身份认证) | RSA-2048 | SM2 (256位) | GB/T 32918-2016,基于椭圆曲线 |

此外,针对政务云环境下的复杂业务逻辑,系统部署高性能国产硬件密码机(HSM)与云服务器密码机。通过密码服务平台的统一调度,实现密钥产生、存储、分发、使用、更新、归档、销毁的全生命周期闭环管理。在代码层面,改造重点在于中间件与底层驱动的适配,确保系统在国产麒麟操作系统与海光/飞腾CPU环境下,调用硬件加速指令集提升SM4加解密吞吐效能,避免算法切换导致的业务响应延迟。通过深度改造,系统将完全满足等保三级及密评(GM/T 0054)三级的指标要求。

综上所述,本节确立了密码算法从国际标准向国密标准的演进路径,通过对底层算法库与硬件支撑环境的同步改造,构建了符合国家安全战略的密码防御体系,其整体密码服务逻辑架构如下图所示:

图:7.3 数据安全与隐私保护

如上图所示,该架构展示了从底层国产硬件密码机到上层业务应用加解密接口的完整映射关系,通过标准化的密码服务总线屏蔽了底层硬件差异,确保了政务信息系统在信创环境下的高安全性与高可用性,为后续数据安全治理提供了核心技术支撑。

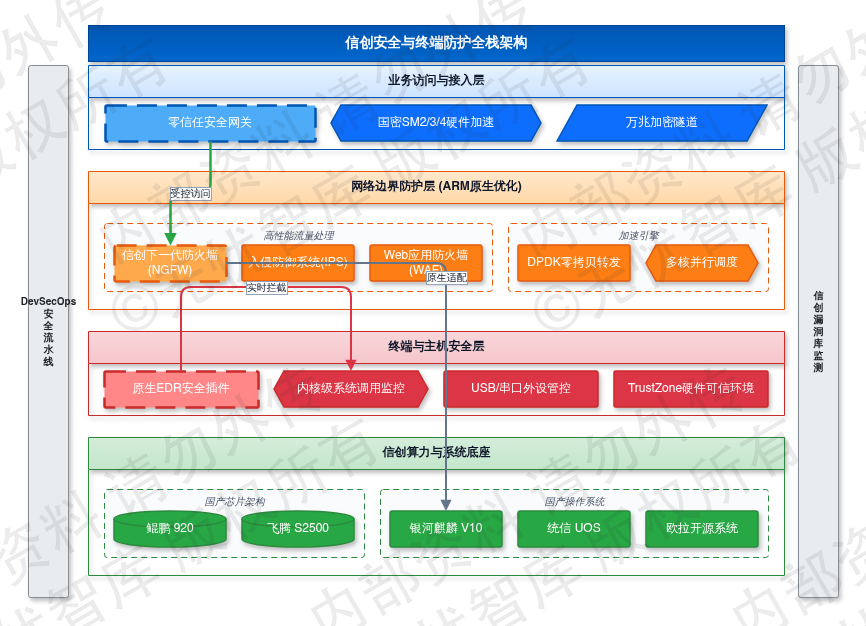

7.2 边界与终端安全防护

7.2 边界与终端安全防护

在信创工程演进中,底层算力架构从传统x86向国产ARM架构(如飞腾、鲲鹏)迁移,对边界防护与终端安全设备提出了原生兼容性要求。本方案拒绝采用指令集翻译或模拟运行模式,要求所有安全组件基于ARMv8/v9架构进行原生编译优化,确保在高性能网络环境下消除业务系统的IO瓶颈。在网络边界侧,部署的下一代防火墙(NGFW)、入侵防御系统(IPS)及Web应用防火墙(WAF)均采用国产高性能ARM多核处理器,并结合DPDK(Data Plane Development Kit)技术实现零拷贝数据转发,确保在处理万兆级流量时,小包转发延迟控制在微秒级。

针对终端侧安全防护,系统采用基于信创操作系统的原生EDR(终端检测与响应)代理。该代理深度集成于麒麟、统信等国产操作系统的内核层,利用ARM架构的TrustZone技术构建硬件级可信执行环境(TEE)。通过对系统调用(System Call)的实时监控,有效识别并拦截针对信创环境的特种木马与无文件攻击(Fileless Attack)。此外,针对信创终端外设接口(如USB、串口)的管控,系统实现了基于硬件ID的唯一性校验,防止非法外联导致的敏感数据泄露。下表列出了本工程中部署的核心信创安全设备及其关键技术指标:

| 设备类型 | 核心架构 | 操作系统兼容性 | 关键性能指标 |

|---|---|---|---|

| 信创下一代防火墙 | 鲲鹏/飞腾 ARM | 银河麒麟/统信UOS | 吞吐量≥40Gbps, 并发连接≥1000万 |

| 终端EDR安全插件 | ARMv8 原生指令集 | 统信/麒麟/中科方德 | 内存占用≤50MB, CPU峰值占比<5% |

在工程实践中,通过DevSecOps流水线将安全基线扫描自动嵌入到基于ARM架构的容器镜像构建过程中。所有运行于K8s集群中的微服务,其基础镜像必须经过信创漏洞库(CNNVD/CNVD)的深度扫描,剔除不兼容的二进制库。同时,边界安全设备通过集成Prometheus Exporter,实时上报CPU分支预测命中率及缓存污染情况,确保在极高负载下,安全防护逻辑不会因硬件架构差异导致系统崩溃。这种从底层硬件到应用层的全栈信创适配,构建了坚实的边界防御纵深。

综上所述,本章通过对信创架构下边界与终端安全防护体系的系统阐述,确保了安全能力与国产算力底座的深度融合,整体防护逻辑架构如下图所示:

图:第八章 适配测试与性能调优方案

如上图所示,该架构涵盖了从底层ARM硬件可信根到上层边界安全网关、终端EDR代理的全链路防御矩阵。通过硬件加速与内核级监控的协同,实现了在信创环境下的高性能安全监测与响应,为后续的密码体系建设提供了受保护的运行环境。该体系不仅解决了异构架构下的兼容性难题,更通过原生指令集优化提升了整体防御效能。

7.3 数据安全与隐私保护

7.3 数据安全与隐私保护

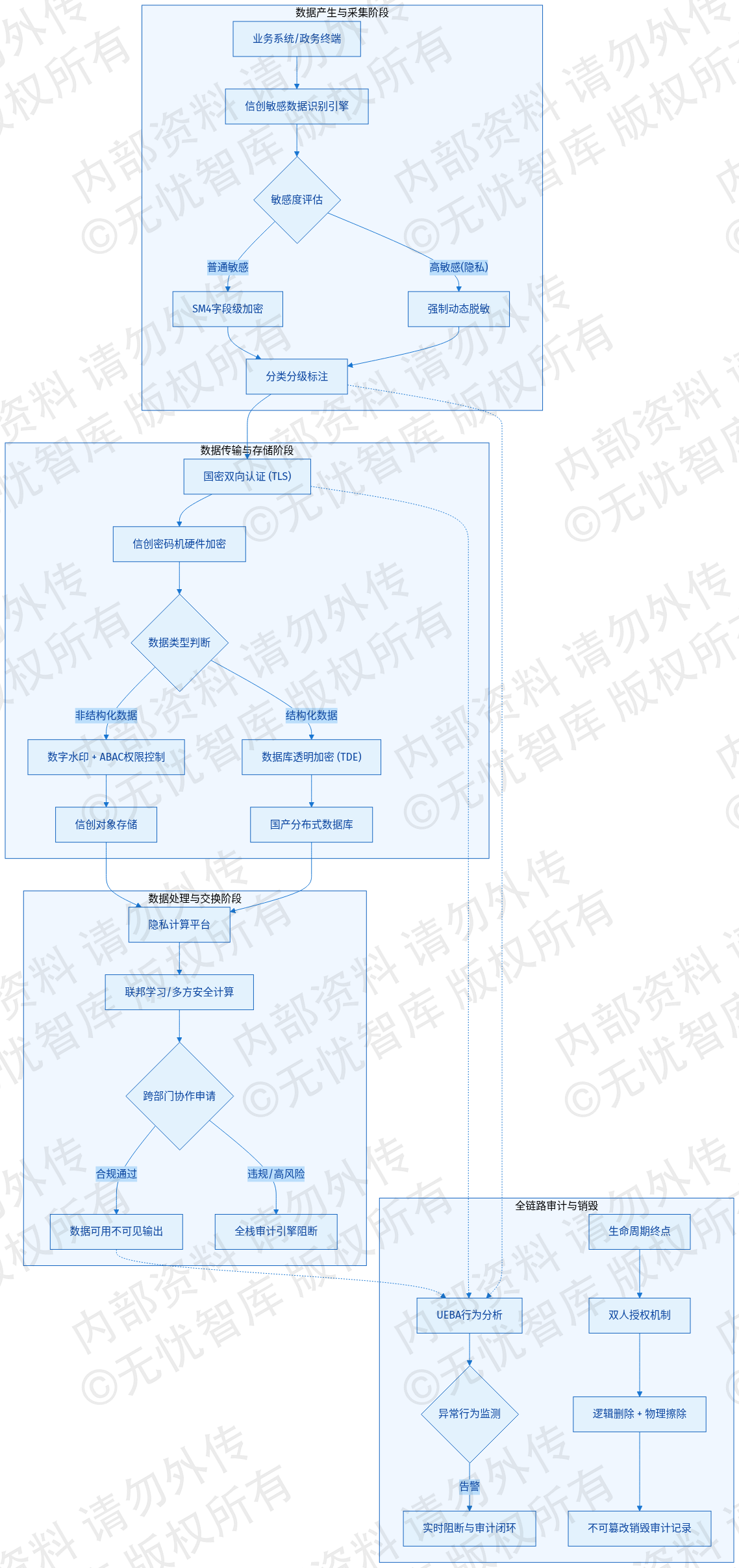

在信创体系架构下,数据安全由单一维度的边界防护演进为贯穿采集、传输、存储、处理、交换及销毁全生命周期的动态防御体系。本系统严格遵循 GB/T 37988-2019《数据安全能力成熟度模型》(DSMM),针对政务场景下的敏感信息与业务数据,构建基于零信任架构的内生安全管控机制。在数据采集阶段,依托信创敏感数据识别引擎实现分类分级标注,利用国产 SM4 算法执行字段级选择性加密,确保数据在接入层即具备安全属性。针对身份证号、手机号等高敏感隐私数据,系统强制触发动态脱敏策略,确保开发与测试环境无法获取明文,从源头规避泄露风险。

在传输与存储环节,系统全面适配国密 TLS 协议(双向认证),通过信创密码机提供的硬件级加密能力,保障分布式数据库与边缘节点间流转数据的机密性。针对结构化数据,采用国产数据库透明加密(TDE)技术实现落盘即加密,有效应对物理介质丢失或非授权挂载风险。对于非结构化数据,引入数字水印与属性访问控制(ABAC),确保输出文件可溯源。在数据交换场景中,部署基于信创环境的隐私计算平台,利用联邦学习与多方安全计算技术,实现"数据可用不可见",解决跨部门协作的合规难题。

为实现全链路可观测性,系统集成了全栈安全审计引擎。通过采集数据库流量、API 调用日志及应用层埋点,结合用户实体行为分析(UEBA)技术,对异常导出、高频查询、跨权访问等行为进行实时告警与阻断。下表列出了数据全生命周期各阶段的核心技术规格:

| 生命周期阶段 | 核心安全管控技术 | 信创适配要求 |

|---|---|---|

| 数据采集 | 自动分类分级、动态脱敏 | 适配国产敏感识别引擎,分类准确率 > 98% |

| 数据传输 | 国密双向认证(SM2/SM4) | 适配国密 SSL 卸载设备,传输延迟增加 < 50ms |

针对运维与高权账号,系统建立"双人授权"机制与堡垒机接管流程,严禁绕过安全机制直连底层数据库。在数据生命周期终点,执行基于国标的物理擦除与逻辑销毁双重验证,并生成不可篡改的销毁审计记录。综上所述,本系统通过对数据全生命周期的系统性加固,构建了多层次隐私保护屏障,数据生命周期安全流转逻辑如下图所示:

图:8.1 测试体系与环境构建

如上图所示,该架构展示了数据从采集、传输到存储、销毁的闭环管控路径,重点突出了国密算法与信创组件在各环节的深度融合。通过这一全生命周期的安全管控机制,系统不仅满足了等保三级与密码测评的要求,更在实际业务运行中实现了风险的实时感知与自动化响应,为后续的数据要素价值释放提供了坚实的安全底座。

第八章 适配测试与性能调优方案

第八章 适配测试与性能调优方案

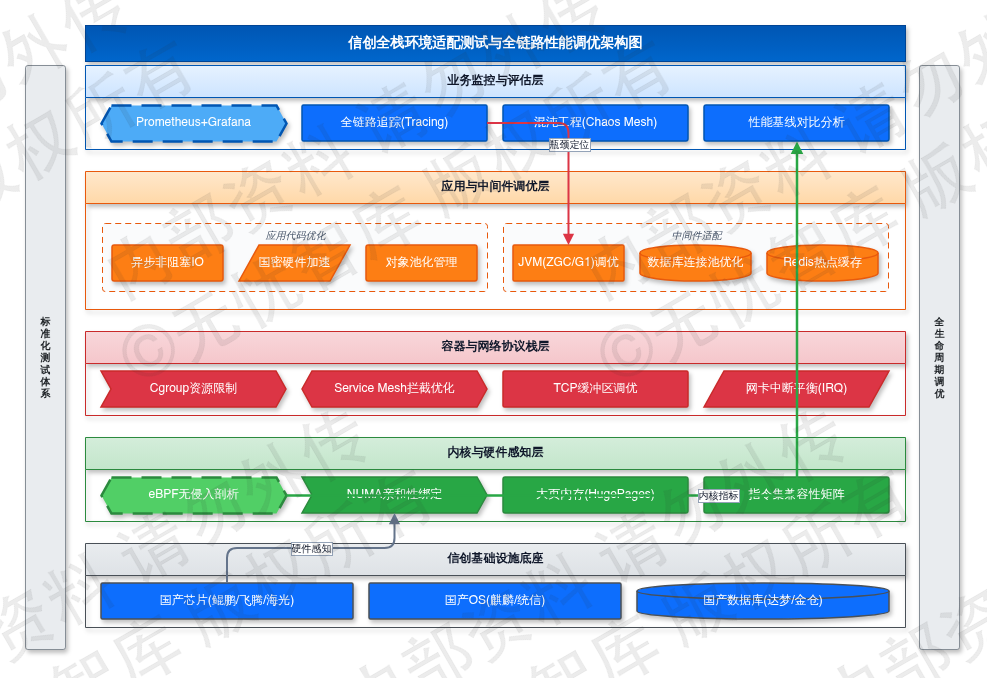

本章作为系统交付前的核心质量保障环节,旨在确立信创全栈环境下的性能基准与稳定性边界。在当前国产化替代背景下,硬件异构性(如ARM与x86指令集差异)以及中间件适配深度直接决定了业务系统的SLA。本章将从信创适配测试标准、全链路性能压测模型、底层内核优化以及应用级调优四个维度构建闭环体系。通过引入混沌工程与分布式全链路追踪技术,不仅关注系统在常规负载下的吞吐量(TPS)与响应延迟(Latency),更聚焦于在极端故障场景下的弹性伸缩能力与自愈时效。通过标准化的测试流程与科学的调优策略,确保系统在国产芯片、国产操作系统及国产数据库组成的"三位一体"底座上,实现超越传统架构的并发处理能力与系统健壮性。

8.1 适配测试与性能调优方案

8.1.1 信创环境适配测试标准与工具体系

在信创环境下,适配测试不仅是功能的校验,更是底层指令集与系统调用层面的深度兼容性验证。遵循GB/T 32907-2016等国家标准,针对鲲鹏、飞腾等ARM架构以及海光、兆芯等x86架构建立多维测试矩阵。测试重点涵盖指令集兼容性、多核并行计算效能、以及国密算法(SM2/SM3/SM4)在硬件层面的加速实现。为确保测试的科学性,构建基于信创云底座的自动化测试流水线,利用自研的兼容性扫描工具对二进制文件和动态链接库进行静态分析,识别潜在的非标准系统调用。

在工具选型上,全面拥抱云原生性能测试生态。针对高并发场景,采用JMeter集群模式结合Prometheus进行多维指标采集;针对内核与底层调用,利用eBPF技术实施无侵入式的性能剖析(Profiling),实时监控上下文切换、中断频率及磁盘I/O队列深度。信创环境适配测试的关键指标与工具选型如下表所示:

| 测试维度 | 核心指标 | 推荐工具 |

|---|---|---|

| 兼容性测试 | 库文件依赖、系统调用覆盖率 | Dependency Walker (信创版) |

| 性能压测 | TPS、响应时间、并发用户数 | Apache JMeter / Locust |

8.1.2 性能优化手段与全链路调优策略

针对信创架构中常见的"单核性能弱、多核扩展强"特征,性能调优必须从硬件感知、内核参数、中间件配置及应用代码四个层面实施纵深优化。在硬件与内核层,重点优化大页内存(HugePages)配置以减少TLB miss,调整NUMA亲和性策略,确保CPU核心与内存访问的就近原则,降低跨片访问延迟。针对国产操作系统的网络内核栈,通过调整TCP缓冲区大小、开启多队列网卡中断平衡(IRQ Balance),提升高并发下的包处理吞吐量。

在应用与中间件层,实施全链路异步化改造。针对国产数据库(如达梦、人大金仓),优化SQL执行计划并调整连接池配置,利用Redis集群实施热点数据缓存降级。在代码层面,针对ARM架构的弱内存模型,优化并发锁机制,减少无谓的CAS自旋消耗。此外,建立基于全链路追踪(Tracing)的性能基线,通过对比分析发现系统瓶颈,实现从网关层到持久层的精准调优。性能优化的分层实施方案如下表所示:

| 优化层级 | 核心手段 | 预期目标 |

|---|---|---|

| 硬件/内核层 | NUMA绑定、大页内存、eBPF优化 | 降低系统调用开销15%以上 |

| 应用代码层 | 异步非阻塞IO、对象池化、国密硬件加速 | 提升单机并发处理能力30% |

综上所述,本章通过构建严密的适配测试标准与多维调优矩阵,确保了系统在国产化底座上的高性能运行,整体适配与调优架构如下图所示:

图:8.2 性能压测与调优

如上图所示,该架构展示了从底层硬件感知到上层应用性能监控的全链路调优路径。通过分层优化手段与标准化工具链的配合,系统能够有效屏蔽国产化硬件的差异性,在大规模并发场景下保持平稳的性能曲线,为业务的高可用运行提供了坚实的技术支撑。

8.1 测试体系与环境构建

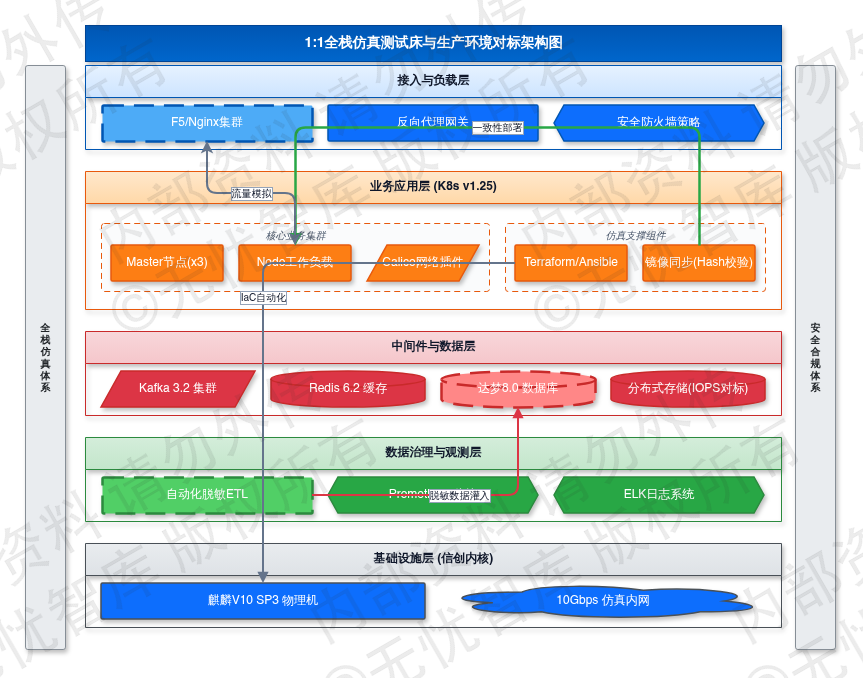

8.1 测试体系与环境构建

在企业级复杂系统的演进过程中,环境配置差异(Configuration Drift)是导致上线故障的核心诱因。本方案确立"全栈仿真、逻辑隔离、数据脱敏"的构建原则,旨在搭建与生产环境1:1对标的仿真测试床(Staging Environment)。该环境不仅在计算、存储、网络等基础设施实现等效对标,更在中间件版本、内核参数、网络拓扑及安全策略上保持高度一致。通过引入基础设施即代码(IaC)技术,利用Terraform与Ansible实现环境的一键式自动化部署,确保测试边界与生产边界的无缝衔接。

在硬件资源层面,仿真测试床严格遵循生产环境规格定义。针对核心业务集群,采用相同型号的CPU指令集与内存频率,消除异构硬件带来的性能偏差。存储系统通过分布式存储协议对标生产环境的IOPS与吞吐限制,确保压力测试下真实反馈存储瓶颈。网络架构完整复刻生产环境的多级安全域划分,包括DMZ区、应用区、数据区及管理区,并同步配置负载均衡(F5/Nginx)、防火墙策略及反向代理规则,实现对生产流量路径的精准模拟。

下表详细列出了仿真测试床与生产环境的关键配置对标清单:

| 配置维度 | 生产环境规格 (Production) | 仿真环境规格 (Staging) | 关键一致性要求 |

|---|---|---|---|

| 操作系统 | 麒麟V10 SP3 (信创内核) | 麒麟V10 SP3 (信创内核) | 内核版本、补丁包、系统参数完全一致 |

| 容器平台 | K8s v1.25 (3 Master + N Node) | K8s v1.25 (3 Master + 3 Node) | 调度策略、网络插件(Calico)一致 |

在软件栈与数据治理层面,仿真测试床通过镜像仓库同步机制,确保运行镜像的Hash值与生产环境完全匹配。针对测试数据真实性,系统建立自动化数据脱敏ETL链路,从生产库抽取存量数据,经掩码、置换、哈希等算法处理后灌入测试库。在保证数据量级与分布特征(Data Distribution)一致的前提下,严格遵守安全合规要求。此外,仿真环境集成全链路监控(Prometheus/Grafana)与日志采集系统(ELK),实现与生产环境同等颗粒度的观测能力,确保性能调优过程中精准定位跨组件损耗点。

综上所述,通过构建高仿真测试床,项目团队能够在线上发布前完成"带载演练",有效识别潜在的死锁风险、内存泄漏及配置冲突,为系统平稳运行提供工程化保障。整体环境部署架构如下图所示:

图:第九章 实施计划与运维保障

如上图所示,该架构展示了仿真测试床与生产环境的镜像同步机制、数据脱敏流转路径以及网络拓扑的平行对标关系。图示明确了从底层硬件资源池到上层应用容器的全栈仿真逻辑,详细标注了流量在多级安全域间的流转规则,为后续的适配测试与性能调优提供了标准化的物理底座。

8.2 性能压测与调优

8.2 性能压测与调优

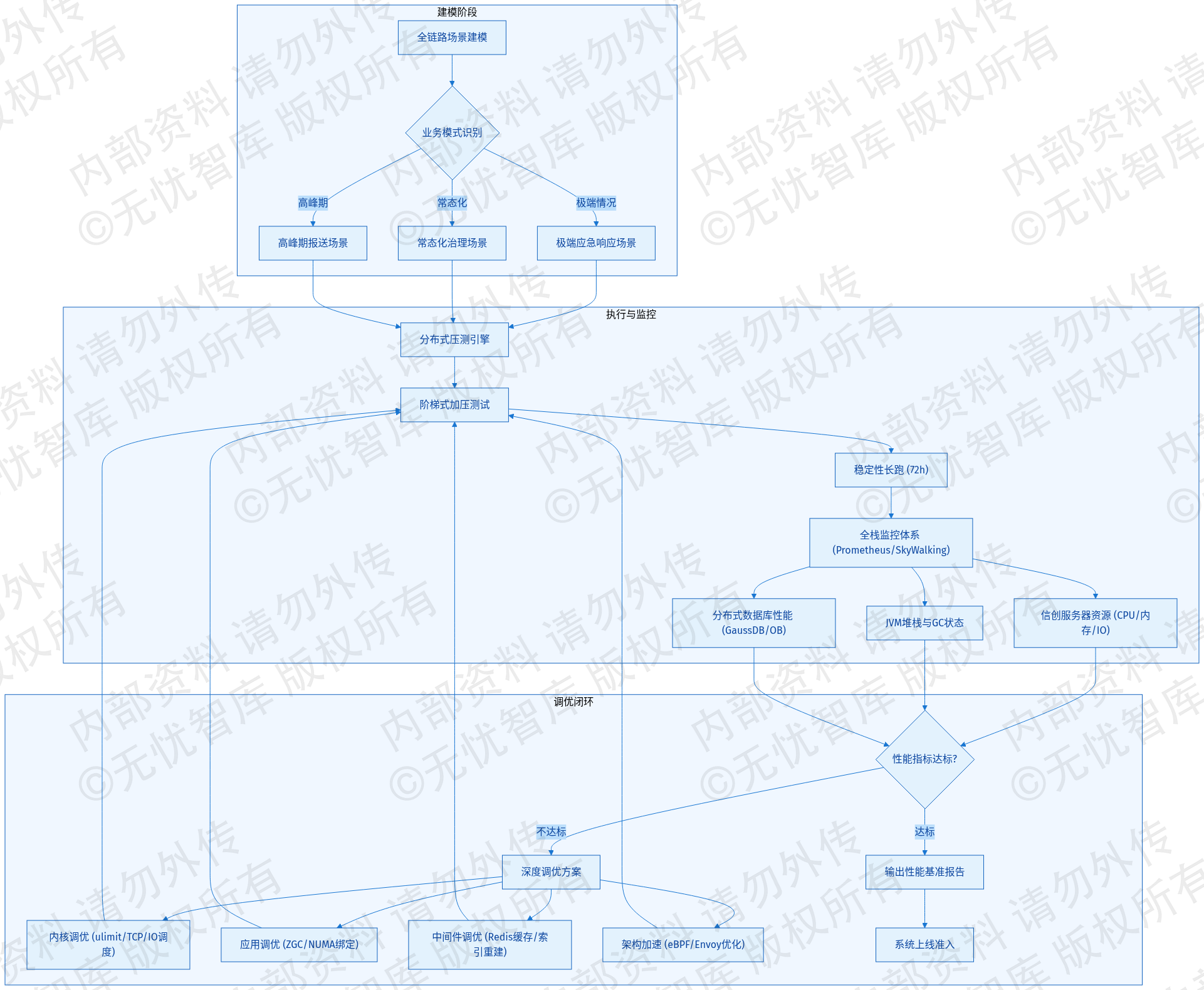

8.2.1 性能压测目标与全链路场景建模

在信创底座支撑的城市治理场景中,系统需应对超大规模传感器接入、高频政务审批及突发公共安全事件引发的流量洪峰。本阶段压测核心目标是建立基于国产化芯片(如鲲鹏、飞腾)与麒麟操作系统的性能基准,验证全栈信创环境下处理能力是否满足SLA要求。压测不仅关注单一接口TPS,更侧重全链路、跨组件的协同表现。

建模过程将业务场景划分为常态化治理、高峰期报送与极端应急响应三种模式。针对视频流分析、物联感知数据汇聚等高吞吐场景,设定QPS基准为千万级人口城市规模峰值的1.5倍。同时,针对分布式数据库在国产存储底座上的I/O表现进行专项建模,确保在数据强一致性要求下,核心业务响应延迟(RT)99线控制在200ms以内。

8.2.2 压测执行策略与关键指标监控

执行策略采用阶梯式加压与稳定性长跑相结合的方式。利用分布式压测引擎模拟海量并发,从初始并发量逐步提升至系统崩溃临界点,探测最大承载能力与性能拐点。压测期间依托Prometheus与SkyWalking构建全栈监控体系,实时采集信创服务器CPU利用率、内存利用率、磁盘I/O、网络带宽及JVM堆栈状态。

下表列出了性能压测的关键技术指标要求及信创底座适配基准:

| 监控维度 | 关键指标 (KPI) | 性能目标 (SLA) |

|---|---|---|

| 吞吐量 | 系统并发TPS | ≥ 50,000 |

| 响应时延 | 平均响应时间 (RT) | ≤ 300ms |

8.2.3 深度调优方案与信创适配优化策略

针对压测暴露的瓶颈实施多维度调优。操作系统层面,针对麒麟系统优化内核参数如文件句柄数(ulimit)、TCP连接重用(tw_reuse)及磁盘I/O调度算法。应用层针对信创CPU多核架构特性,调整JVM垃圾回收策略,优先选用G1或ZGC,并根据NUMA架构进行内存绑定优化,减少跨核访问延迟。

中间件层面,对国产分布式数据库进行执行计划调优与索引重建,针对热点数据冲突引入Redis集群结合Lua脚本实现原子化操作,减轻数据库压力。针对Service Mesh架构下的Sidecar损耗,通过优化Envoy配置与开启eBPF加速技术降低通信开销。通过"压测-定位-调优-回归"闭环,确保系统在全栈信创环境下具备高健壮性与弹性伸缩能力。

第九章 实施计划与运维保障

第九章作为本方案的工程落地与持续运营阶段,旨在构建一套从传统架构向信创云原生架构平滑迁移的标准化路径,并确立基于SRE(站点可靠性工程)理念的常态化保障体系。本章核心设计原则坚持"安全割接、渐进演进、全栈可观测",通过建立精细化的割接时序控制与零信任安全运维边界,解决信创环境下的兼容性风险与运维复杂度挑战。在实施层面,本章详细规划了资源初始化、业务灰度切换及回滚应急预案,确保迁移过程中的业务连续性(SLA)不受影响;在运维保障层面,重点部署全链路可观测性平台与自动化配置管理,实现从被动响应向主动防御的运维范式转型,为系统的高可用运行与等保合规提供闭环支撑。

9.1 割接计划与常态化信创运维体系

9.1.1 详尽割接计划与风险防控

针对信创环境的异构特性,割接过程遵循"分批分级、数据先行、业务后随"原则。割接计划划分为准备、实施与验证三个阶段。在准备阶段,执行全量数据的异构备份,建立基于SHA-256算法的数据一致性验证机制,确保底座切换过程中数据完整性。实施阶段采用金丝雀发布策略,通过Service Mesh流量调度引擎将生产流量逐步引流至信创环境,初始权重控制在5%-10%,经24小时业务周期观察无异常后执行全量割接。

割接过程确立严格的"回滚触发点"。若关键业务指标如交易成功率下降超过1%,或系统P99响应延迟增长超过200ms,立即启动预设的回滚程序。通过自动化脚本确保回滚操作在30分钟内完成,将平均恢复时间(MTTR)降至最低。

| 割接阶段 | 核心任务 | 风险控制手段 |

|---|---|---|

| 割接前置 | 环境压测、数据全量备份 | 离线双备份、热备切换测试 |

| 割接实施 | 流量切分、DNS更改 | 灰度发布、流量比例控制 |

9.1.2 常态化信创运维体系构建

常态化运维体系依托SRE理念,构建涵盖全栈可观测、自动化编排与零信任访问控制的综合运维底座。针对鲲鹏、飞腾等信创芯片及麒麟、统信等操作系统特性,运维体系深度集成Prometheus与Grafana,实现对CPU指令集、内核参数及容器运行时的深度埋点。通过专用Exporter采集信创硬件特有指标,建立多维度告警阈值模型,实现故障的主动预警。

在安全运维维度,全面引入零信任架构。所有运维行为经由身份提供商(IdP)进行动态认证与授权,严格遵循最小权限原则。通过堡垒机实现对信创服务器的全过程审计,利用风险语义识别技术阻断高危指令。同时,建立基于GitOps的配置管理流程,所有基础设施配置均通过代码仓库(IaC)管理,确保配置的可追溯性与环境一致性,从根源消除配置漂移带来的安全隐患。

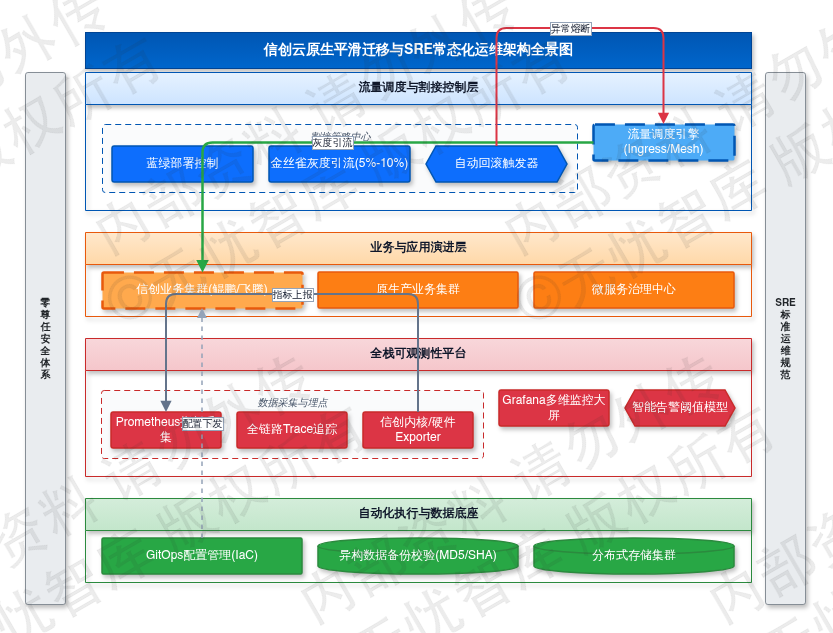

综上所述,本章通过对割接计划与运维体系的系统阐述,为系统的平稳过渡与长期稳定运行奠定了坚实基础,整体运维架构如下图所示:

图:9.2 信创运维体系建设

如上图所示,该架构涵盖了从割接实施到常态化运行的全生命周期管理流程,通过流量控制层、监控感知层与自动化执行层的协同,为信创环境下业务的高可用性提供了清晰的指导框架。该体系不仅解决了迁移初期的稳定性问题,更通过自动化手段提升了长期的运维效能。

9.1 迁移实施路径规划

9.1 迁移实施路径规划

在本项目信创改造进程中,从传统x86架构向国产ARM架构(如鲲鹏、飞腾)的迁移是核心技术攻坚任务。为确保业务连续性并实现"零停机"目标,本方案采用"分层剥离、双栈并行、灰度切流"的渐进式迁移策略。整个实施路径被精确划分为环境就绪、应用适配、数据同步及流量切换四个关键阶段,每个阶段均设置严格的质量门禁与回滚机制。

9.1.1 x86到ARM架构平滑迁移路径设计

在环境就绪阶段,重点在于构建与生产环境1:1对等的ARM信创算力池。通过国产化操作系统(如银河麒麟、统信UOS)的标准化装机,建立基于K8s的异构双栈集群。应用适配阶段则聚焦于代码级的重构与编译,针对C/C++等编译型语言,需调整Makefile并链接对应架构的动态链接库;针对Java/Python等解释型语言,重点在于JVM参数优化与底层依赖包(如JNI调用)的替换。下表详细列出了迁移过程中的核心技术规格与评估维度:

| 迁移维度 | x86 原生环境规格 | ARM 目标环境规格 | 适配关键点 |

|---|---|---|---|

| 指令集架构 | CISC (Intel/AMD) | RISC (ARMv8/v9) | 弱内存模型适配、NEON指令集优化 |

| 编译链 | GCC 4.8.5 | GCC 9.3+ / BiSheng | 静态库重编译、字节序(Endian)检查 |

数据同步是迁移中的"压舱石"。系统采用基于CDC(数据变更捕获)技术的实时同步方案,在不中断x86源端业务的前提下,将增量数据实时同步至ARM端的分布式数据库集群。在最终切换前,必须通过双向数据校验(Data Validation)确保一致性。流量切换则遵循"先内部后外部、先边缘后核心"的原则,利用全局负载均衡(GSLB)实现5%、20%、50%到100%的权重动态调节。若ARM节点出现性能波动或异常报错,系统将触发秒级自动回滚机制,将流量重新导回x86存活节点,从而保障业务的高可用性。

9.2 信创运维体系建设

9.2 信创运维体系建设

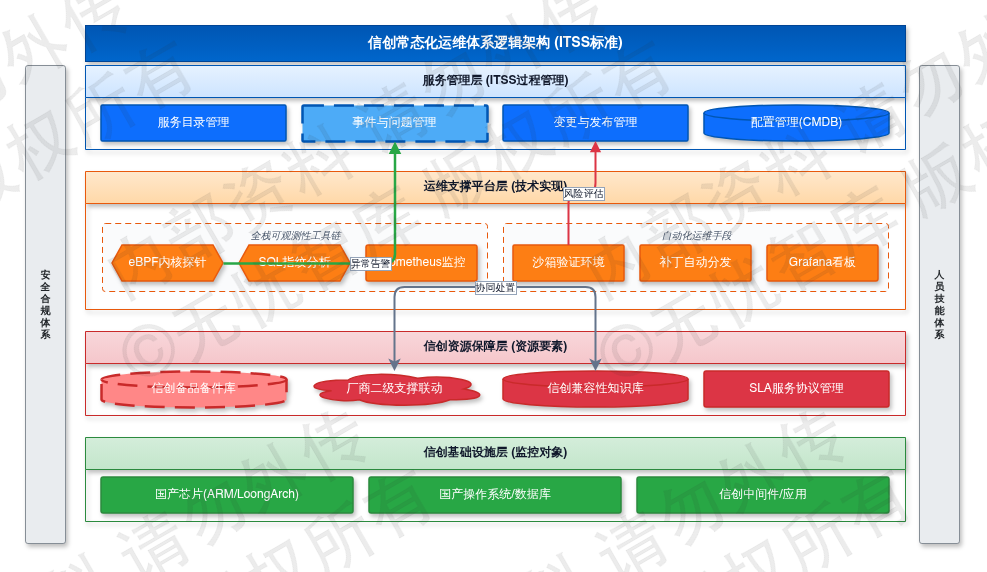

在信创工程进入深水区的背景下,运维保障已由单一的软硬件维保演进为确保芯片、服务器、操作系统、数据库及中间件全栈环境稳定运行的系统工程。本方案严格遵循《信息技术服务标准》(ITSS)体系要求,构建覆盖"人员、资源、过程、技术"四要素的常态化运维机制。针对信创环境下特有的异构指令集兼容性波动、驱动冲突及闭源组件黑盒化等技术痛点,通过建立信创专项知识库与主动式观测体系,实现运维模式从"被动响应"向"主动预防"的战略转型。

9.2.1 建立符合ITSS标准的信创常态化运维机制

在资源配置维度,建立信创备品备件库与厂商二级支撑联动机制。通过与信创生态合作伙伴签署严苛的SLA协议,确保核心组件故障时具备底层代码级的技术支持能力。运维团队需完成从传统x86架构向ARM、LoongArch等异构架构的技能迁移,强化针对国产指令集的内核级性能调优能力。在过程管理层面,将ITSS的服务目录、事件、问题及变更管理深度融入信创运维流程,确保内核升级与补丁修复均经过沙箱环境的充分验证与风险评估。下表列出了信创运维体系的关键能力指标要求:

| 维度 | 关键能力指标 | ITSS 对应标准要求 | 实施目标 |

|---|---|---|---|

| 资源保障 | 备品备件可用率 | 资源管理 - 备件保障 | ≥ 99.9% |

| 响应效率 | 事件平均响应时间 (MTTR) | 服务级别管理 - 响应性 | 核心业务 < 15分钟 |

在技术实现层面,本体系强调"全栈可观测性"。依托国产操作系统内核层的eBPF探针技术,实现对系统调用、网络I/O及磁盘吞吐的无损监控。针对国产数据库,建立基于SQL指纹的性能基线,实时捕获异常执行计划。整合Prometheus与Grafana构建统一的信创运维看板,实现从底层硬件物理参数到应用层业务成功率的全链路监控。此外,建立信创安全运维闭环,将等保2.0三级要求贯穿运维全生命周期,确保在信创化替代过程中,数据加密、访问控制与审计留痕实现全覆盖。