在 AI 技术飞速迭代的今天,Anthropic 联合创始人 Chris Olah 的一句话道出了生成式 AI 的本质:Claude 这类大模型不是被 "搭建" 出来的,而是被 "培育" 成长的。

研究人员设定成长规则,却无法精准预判它会涌现出怎样的能力。这给开发者带来了一个核心难题:我们为 Claude 搭建的智能体框架(Agent Harness),总是基于 "它做不到什么" 的假设,可这些假设会随着 Claude 的进化快速失效。

昨天的最优解,可能成为今天的性能瓶颈;曾经为弥补短板设计的逻辑,转眼变成冗余负担。

如何让 AI 应用跟上 Claude 的进化速度,同时平衡延迟、成本与体验?Anthropic 官方团队总结出三大黄金开发范式,既是技术指南,更是 AI 应用开发的底层逻辑,读懂就能少走弯路。

一、善用既有能力:别重复造轮子,用好 Claude 天生精通的工具

很多开发者陷入误区:为了实现特定功能,费尽心思为 Claude 开发专属工具,却忽略了它早已熟练掌握的核心能力。

最高效的开发,是依托 Claude 的原生能力搭建应用。

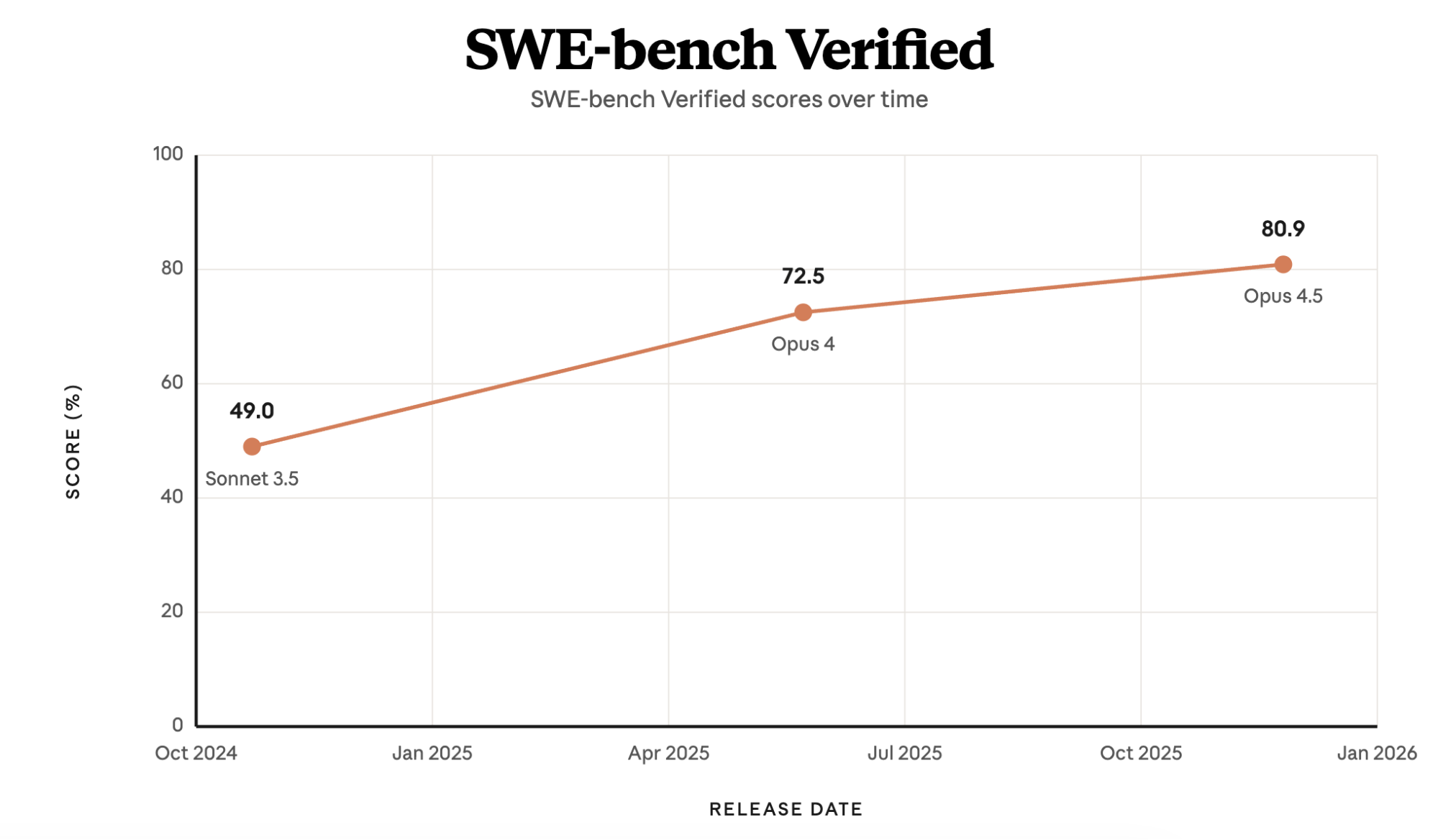

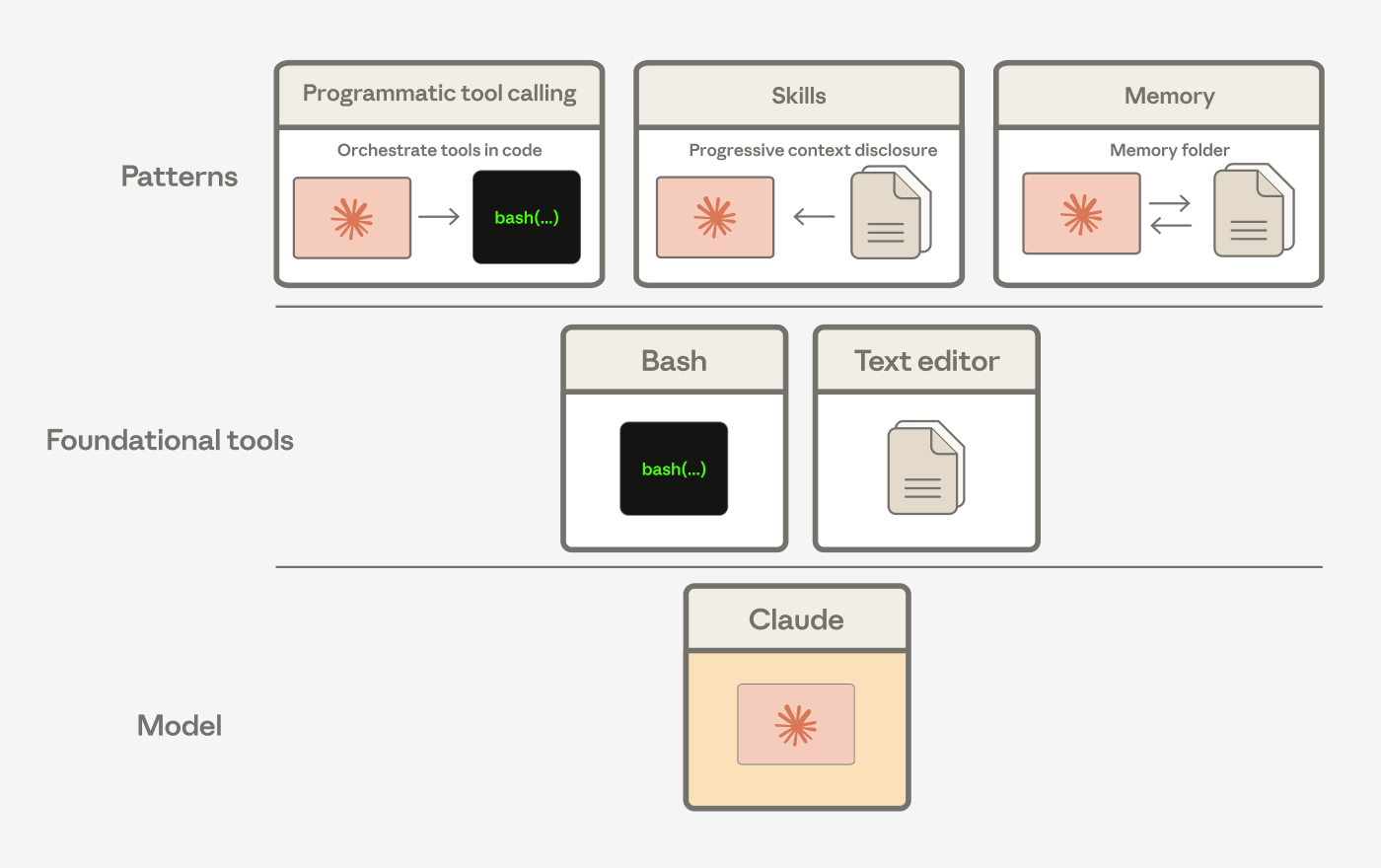

2024 年末,Claude 3.5 Sonnet 仅凭两款通用工具 ------bash 命令工具、文本编辑器工具(支持文件查看 / 创建 / 编辑),就在权威软件工程测试 SWE-bench Verified 中拿下 49% 的准确率,登顶当时全球最佳水平,而 Claude Code 正是基于这两款工具打造。

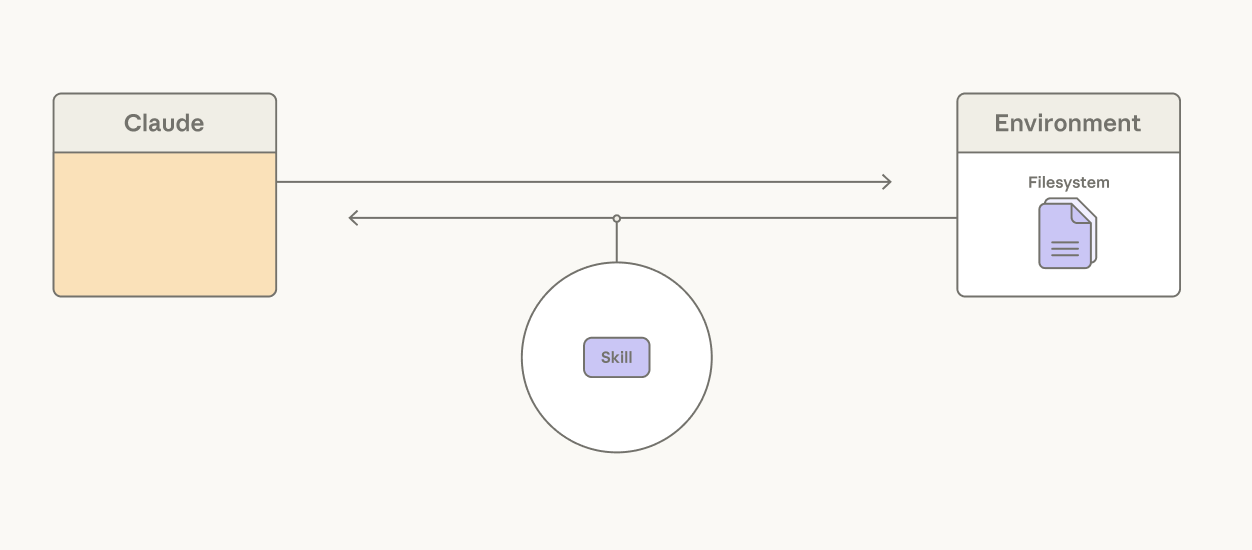

bash 并非为智能体设计,却是 Claude 越用越精通的工具。更关键的是,Claude 能自主组合这些通用工具,衍生出高阶能力:

-

智能体技能(Agent Skills)

-

程序化工具调用

-

记忆工具

这些复杂功能,本质都是 bash 与文本编辑器的组合应用。不用追求 "专属定制",用好模型已吃透的工具,就能实现远超预期的效果。

二、停止过度干预:把决策权还给 Claude,减负就是提效

智能体框架的本质,是固化了 "Claude 无法自主完成" 的假设。但随着模型进化,这些假设必须被打破 ------你替 Claude 做的决定越多,越限制它的智能发挥。(个人感受:AI给出的方案,已经远超普通大众给出的方案,也就是之前说的,我们需要用AI实现自己的思想的跃升。)

真正高效的开发,是不断追问:我可以停止做什么?

- 让 Claude 自主编排操作,告别无效token消耗

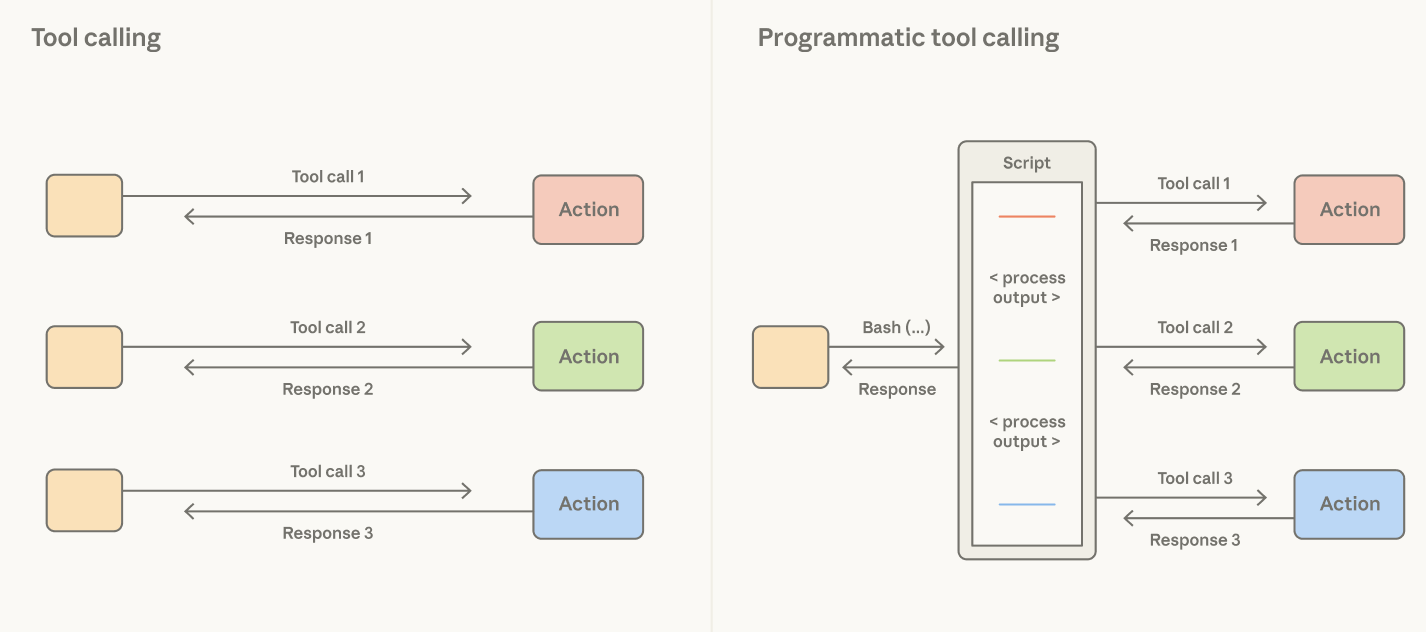

传统开发逻辑:所有工具结果都必须传回 Claude 上下文窗口,才能进行下一步。

但这会造成巨大浪费:读取大型表格时,无关数据会占用大量token,耗时又费钱。即便用硬编码过滤,也是框架替 Claude 做了本应由它决定的事。

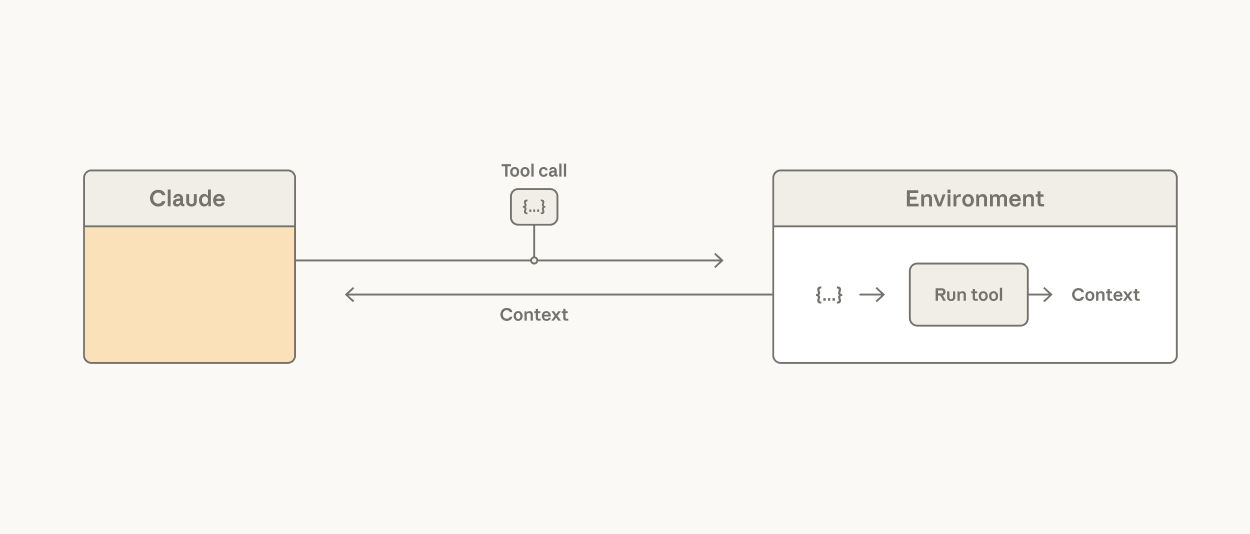

解决方案 :给 Claude 配备代码执行工具(bash/REPL)。

Claude 能自主编写代码,定义工具调用逻辑,自主筛选、传递、衔接工具结果,无需占用上下文窗口,只有最终执行结果会传入模型。

实测效果惊人:在网页浏览测试 BrowseComp 中,Opus 4.6 凭借自主编排能力,准确率从 45.3% 飙升至 61.6%。代码能力越强,Claude 的通用智能体能力就越出众。

- 让 Claude 自主管理上下文,拒绝注意力浪费

传统做法:人工编写系统提示词,把所有任务指令预加载进去。

弊端:多任务场景下,极少用到的指令会占用 Claude 的 "注意力预算",导致性能下降。

解决方案 :用技能调用 + 上下文编辑 + 子智能体三重能力,让 Claude 自主管理上下文。

-

技能调用:仅预加载简短描述,需要时再调取完整内容,不浪费token;

-

上下文编辑:主动清除失效信息,保留核心内容;

-

子智能体:创建独立上下文,专项任务专项处理。

Opus 4.6 凭借子智能体能力,BrowseComp 成绩再提升 2.8%,真正实现 "精准聚焦,不做无用功"。

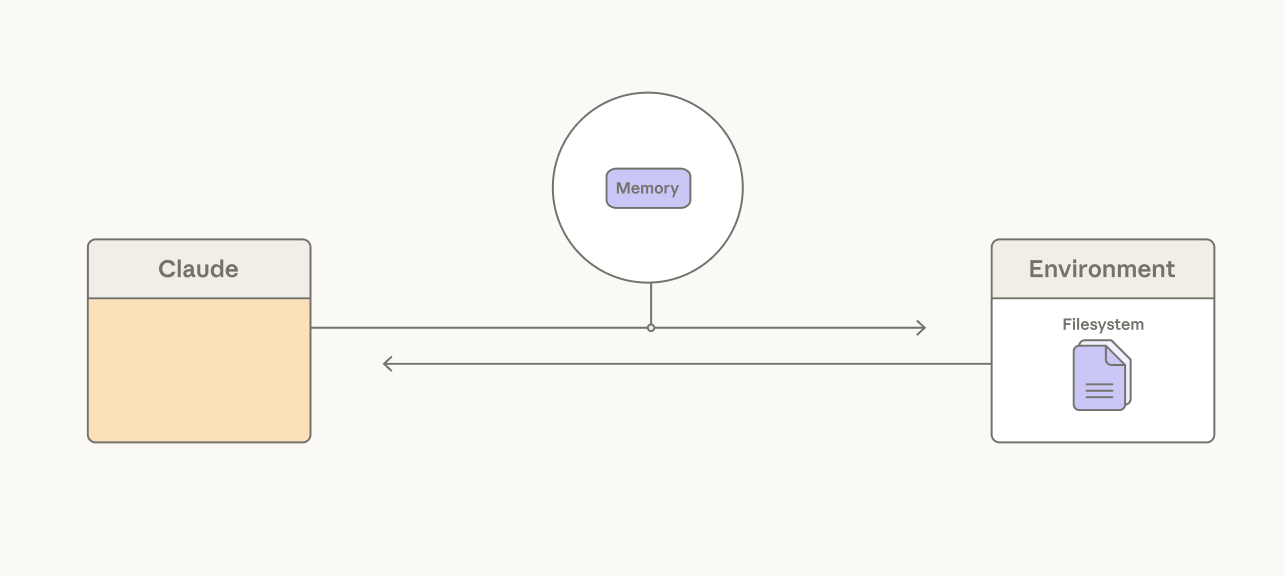

- 让 Claude 自主持久化上下文,长周期任务不再掉线

长周期任务很容易超出上下文窗口限制,传统方案依赖外围检索架构,复杂又低效。

Anthropic 给出极简方案:让 Claude 自己管理记忆。

-

上下文压缩:自主总结过往内容,保障长任务连贯性;

-

记忆文件夹:自主写入、读取文件,存储关键信息。

效果差距一目了然:

-

旧版 Sonnet 3.5 玩《宝可梦》,只会机械记录 NPC 对话,14000 步生成 31 个冗余文件;

-

新版 Opus 4.6,会自动整理战术笔记,10 个文件归类清晰,还能总结失败经验,游戏进度大幅领先。

从 "机械记录" 到 "策略思考",Claude 的记忆能力,全靠自主掌控实现质变。

三、精准设定边界:框架不限制智能,只守护规则

智能体框架不是 Claude 的 "枷锁",而是用户体验、成本、安全的守护者。无需限制模型能力,只需做好三件事:

- 最大化缓存命中率,成本直降 90%

Claude 的 API 无状态,每轮交互都需要打包全量上下文,而缓存token成本仅为基础token的 10%。

遵循 5 大原则,缓存利用率拉满:

-

静态内容前置:系统提示、工具说明放最前面;

-

消息更新:用

<system-reminder>追加内容,不修改原提示; -

不切换模型:缓存与模型绑定,切换即失效;

-

谨慎管理工具:增删工具会清空缓存,动态工具用搜索替代;

-

动态更新断点:多轮交互中,及时移动缓存断点。

小改动大收益,轻松实现 "降本增效"。

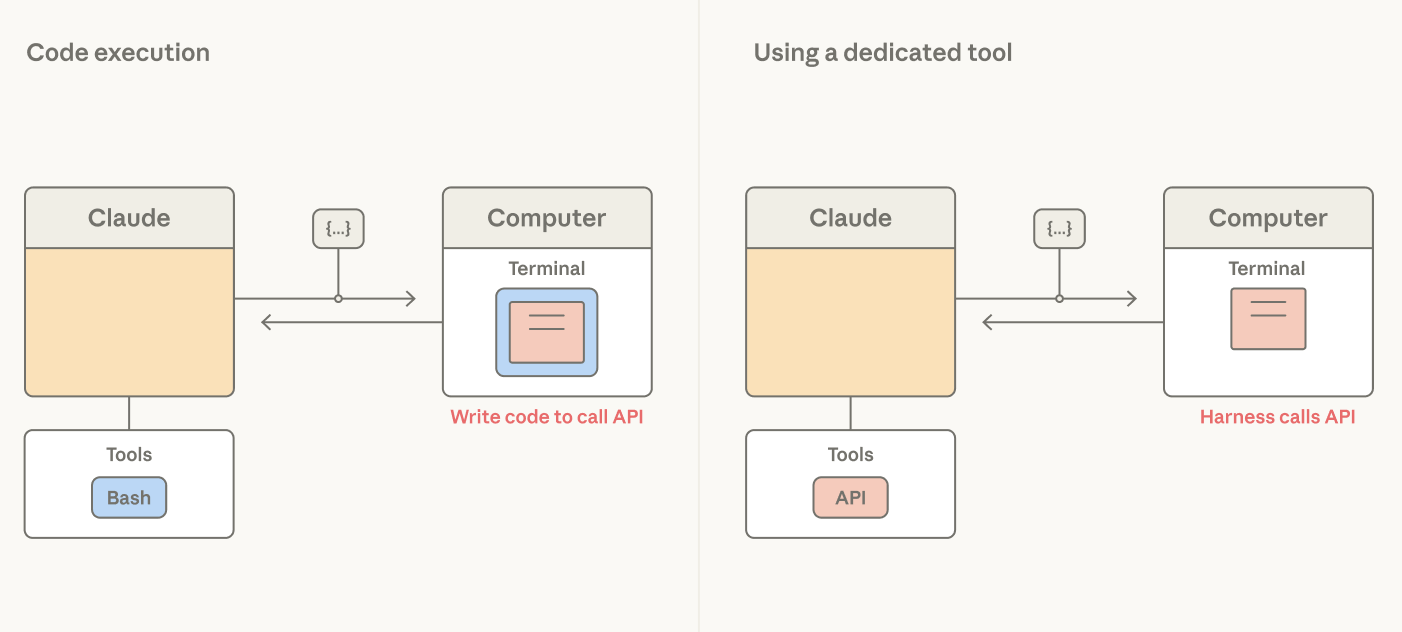

- 声明式工具:划定安全与体验边界

Claude 不懂应用的安全规则和用户交互逻辑,bash 工具权限过大,存在风险。

解决方案:将高风险、高交互操作,转化为专用声明式工具:

-

安全层面:外部 API 调用增设用户确认,文件编辑加入过期校验;

-

体验层面:用户交互转为弹窗,阻塞智能体等待反馈;

-

可观测性:结构化参数,方便日志记录、追踪复现。

高风险动作严格管控,常规操作放开发挥,平衡安全与效率。

四、未来启示:AI 应用开发,要学会 "做减法"

Claude 的智能边界一直在拓展,今天的 "能力短板",明天可能就变成 "核心优势"。

Anthropic 团队亲身验证:Sonnet 4.5 存在 "上下文焦虑",接近上限会提前终止任务,团队专门开发了上下文重置功能;可到了 Opus 4.5,这个问题彻底消失,曾经的补救逻辑变成了冗余代码,反而拖累性能。

AI 应用开发的终极智慧,是持续 "做减法"。

每一次 Claude 迭代,都要重新审视:哪些假设已经失效?哪些逻辑可以删除?哪些干预可以停止?不要让昨天的解决方案,成为今天的性能瓶颈。

写在最后

驾驭 Claude 的智能,核心不是 "控制它",而是 "成就它":

-

善用既有能力,不做无用功;

-

停止过度干预,释放模型潜力;

-

精准设定边界,平衡效率与安全。

在 AI 快速进化的时代,最好的应用不是 "固化的成品",而是能跟着模型一起成长的生态。

掌握这三大范式,你打造的不仅是一款 AI 应用,更是能持续迭代、始终领先的核心竞争力。