前言:在跨境业务、经济研究场景中,经常需要批量获取国外网站的经济类(如各国GDP、进出口数据)、跨境电商类(如平台商品价格、销量、评论)数据,但普通采集器受限于反爬机制、网站结构差异,无法满足需求。本文针对"需针对单个网站定制程序、对接API/编写爬虫、按中文目录/表名保存"的核心需求,拆解完整技术实现路径,兼顾实用性和可落地性。

一、需求核心拆解

先明确核心诉求,避免技术选型偏离,需求拆解如下:

-

采集范围:国外经济类网站(如世界银行、IMF、各国统计局)、跨境电商网站(如亚马逊、eBay、速卖通海外站等);

-

核心痛点:普通采集器无法适配不同网站的反爬、结构差异,需定制程序;需批量下载,提升效率;需按中文目录、中文表名规范保存,便于后续分析;

-

技术核心:针对单个网站定制采集逻辑(API对接/爬虫编写)、批量调度、中文规范化保存、反爬适配;

-

输出要求:数据保存为可编辑格式(Excel、CSV、JSON),目录按"网站名称-数据类型"中文命名,数据表按中文主题(如"美国2024年季度GDP""亚马逊美妆类商品销量")命名。

二、核心技术选型

结合需求,优先选择Python生态(开发效率高、爬虫/API对接库丰富),搭配轻量工具,选型如下(附选型理由,贴合CSDN技术选型风格):

2.1 核心开发语言:Python 3.9+

理由:Python拥有成熟的爬虫库(requests、Scrapy)、API对接库(requests、httpx)、数据处理库(pandas),代码简洁,开发效率高,且社区资源丰富,遇到反爬、解析问题可快速找到解决方案,适合定制化开发。

2.2 采集方式选型(分场景适配)

核心原则:优先对接API(稳定性高、反爬风险低),无API则编写定制化爬虫(应对静态/动态网站),两种方式结合覆盖所有场景。

-

API对接:使用requests/httpx库,适用于提供开放API的网站(如世界银行API、亚马逊MWS API、跨境电商平台开放接口);

-

爬虫采集:分两种场景

-

静态网站(HTML渲染):requests + BeautifulSoup4(解析HTML);

-

动态网站(JS渲染,如React/Vue搭建):Selenium(模拟浏览器,应对JS加载、登录验证)或Playwright(比Selenium更轻量、稳定,支持无头模式);

-

2.3 反爬适配工具

国外网站反爬机制通常包括:IP封禁、User-Agent校验、Cookie验证、验证码(滑动、图形)、请求频率限制,对应工具选型:

-

IP代理:使用代理池(如阿布云、芝麻代理),搭配requests的proxies参数,实现IP轮换;

-

请求头伪装:随机生成User-Agent、Referer,模拟浏览器请求;

-

验证码处理:简单图形验证码用pytesseract(OCR识别),复杂滑动验证码用Selenium+OpenCV,或对接第三方验证码识别接口(如超级鹰);

-

请求频率控制:用time.sleep()或concurrent.futures控制并发,避免触发反爬。

2.4 数据处理与保存

-

数据解析:HTML解析用BeautifulSoup4,JSON数据直接用Python内置json库,表格数据(如HTML表格)用pandas.read_html()快速解析;

-

数据清洗:pandas库(去重、缺失值处理、格式标准化,如日期、数值格式统一);

-

保存格式:优先Excel(xlsx格式,便于非技术人员查看)、CSV(轻量,适合批量存储),JSON适合结构化数据;

-

目录/文件名规范化:用Python的os库创建目录,按"中文网站名称-中文数据类型"命名目录(如"世界银行-全球GDP数据"),数据表按中文主题命名(如"2024年全球各国GDP排名.xlsx")。

2.5 批量调度工具

实现多网站、多任务批量采集,选型:

-

轻量场景:Python内置concurrent.futures(多线程/多进程),实现并发采集,提升效率;

-

复杂场景:Celery(分布式任务调度),搭配Redis作为消息队列,支持定时采集、失败重试,适合长期运行的批量采集任务。

三、完整技术实现路径

按"准备工作→分场景实现采集→数据处理→批量调度→保存规范→测试优化"分步实现,每一步附核心代码片段(贴合CSDN编码分享风格,简洁可复用)。

3.1 准备工作(环境搭建+前置配置)

3.1.1 环境安装

执行pip命令安装所需依赖(核心依赖,按需安装):

说明:openpyxl用于Excel文件读写,pytesseract用于OCR验证码识别,playwright需额外执行playwright install安装浏览器驱动。

3.1.2 前置配置

提前准备:代理IP列表、目标网站API密钥(如有)、User-Agent列表(用于伪装),封装为配置文件(config.py),便于后续修改:

3.2 分场景实现采集(核心步骤)

重点实现两种核心场景:API对接采集、动态网站爬虫采集,每种场景附完整代码片段。

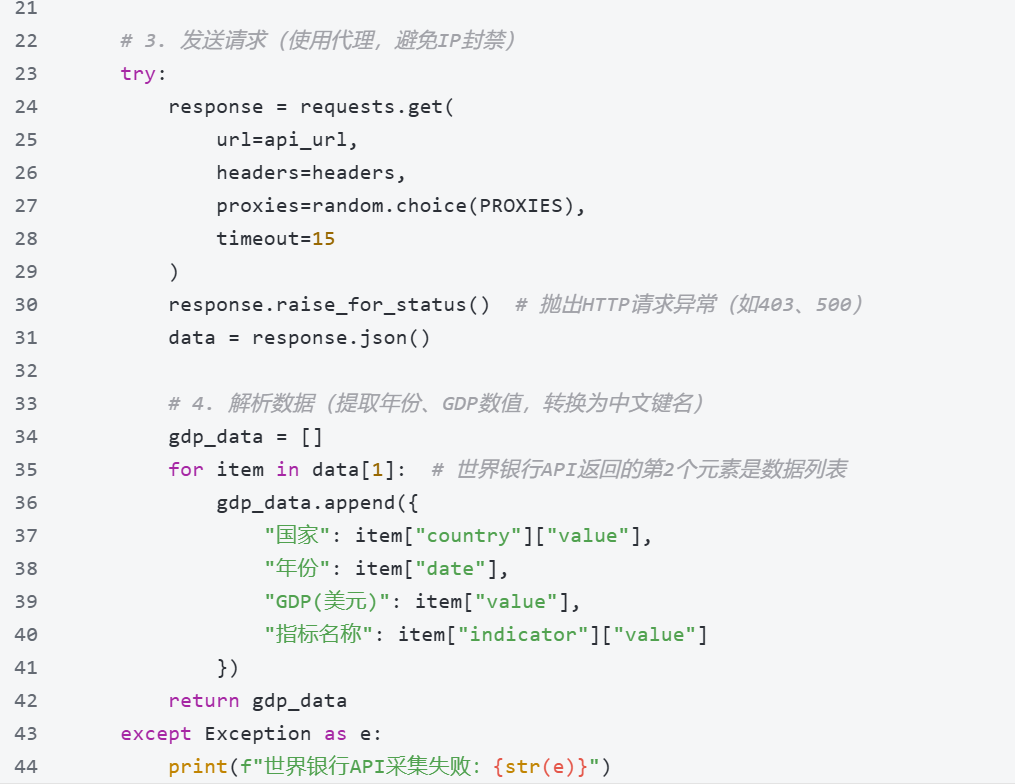

3.2.1 场景1:API对接采集(优先选择)

适用场景:网站提供开放API,需申请API密钥,稳定性高,无需解析HTML,效率最高。

核心逻辑:构造API请求参数→添加请求头(伪装+API密钥)→发送请求→解析JSON数据→返回结构化数据。

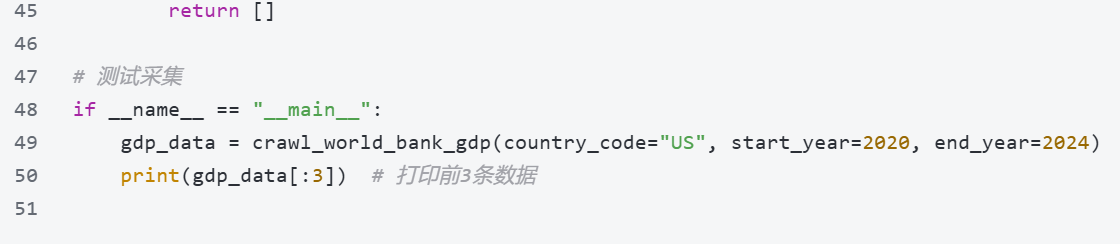

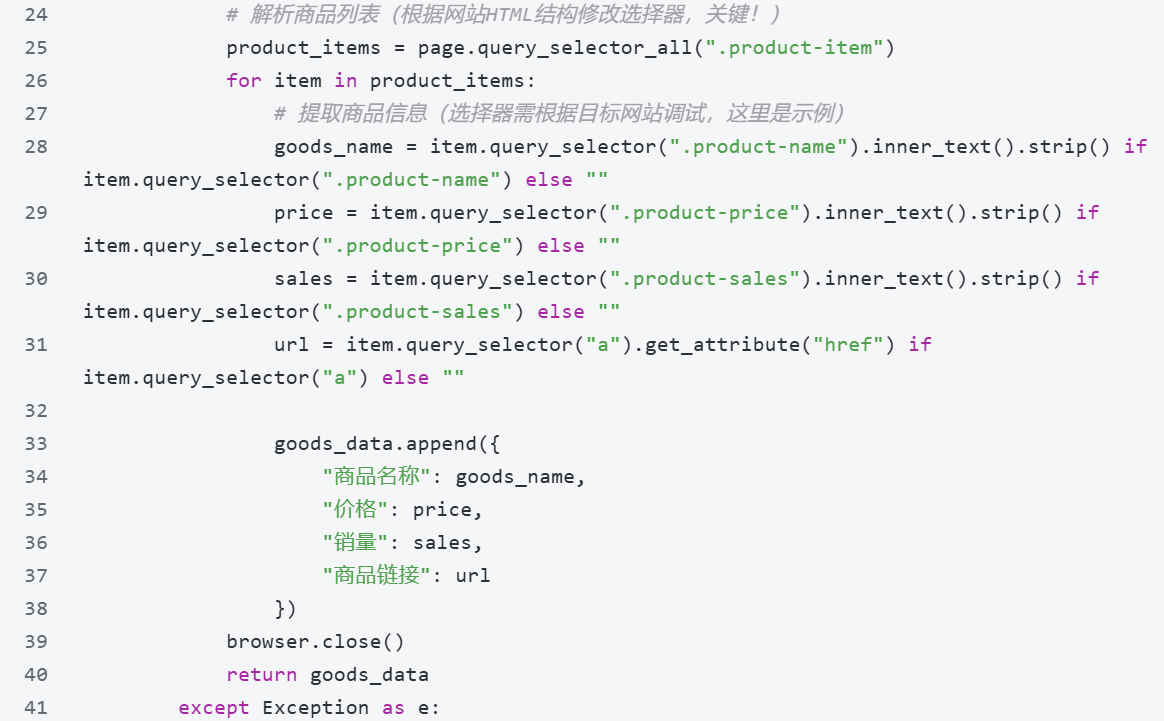

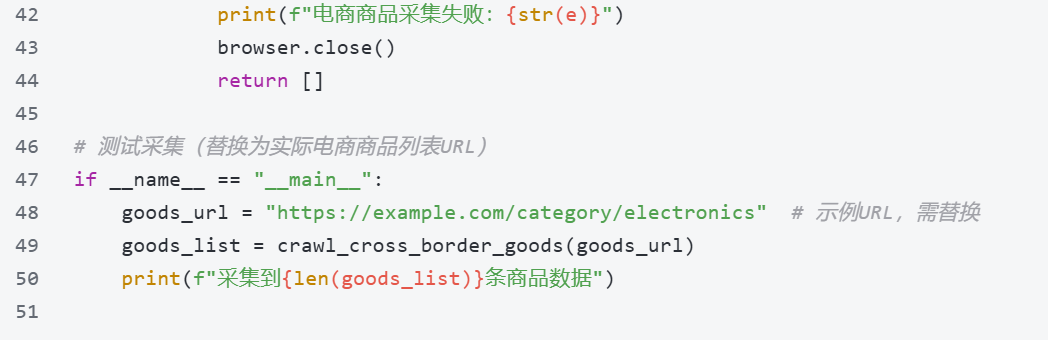

3.2.2 场景2:动态网站爬虫采集(无API,以某跨境电商商品数据为例)

适用场景:网站无开放API,数据通过JS渲染(如商品列表、销量数据),需模拟浏览器加载,这里用Playwright实现(比Selenium更稳定)。

核心逻辑:启动浏览器→访问目标页面→等待JS加载完成→解析页面元素→提取数据→关闭浏览器。

关键提示:爬虫的核心是"匹配网站HTML结构",需通过浏览器F12查看目标元素的class、id,修改代码中的选择器(如.product-item、.product-name),这是定制化爬虫的核心步骤。

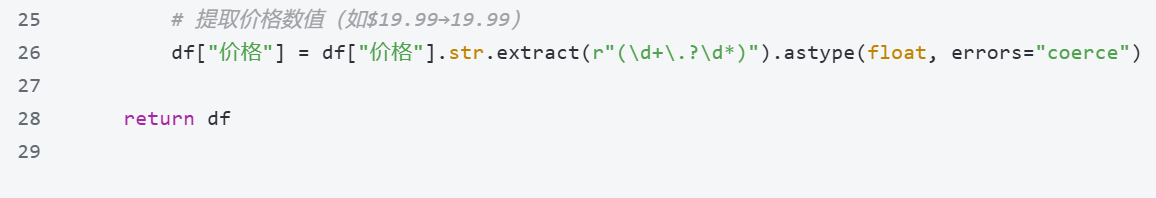

3.3 数据处理(规范化,适配中文保存)

采集到的原始数据可能存在缺失值、格式混乱(如日期格式、数值单位),用pandas清洗,统一格式,为保存做准备:

3.4 中文规范化保存(按目录/中文表名)

核心需求:按中文目录、中文表名保存,用os库创建目录,pandas保存为Excel/CSV,代码如下:

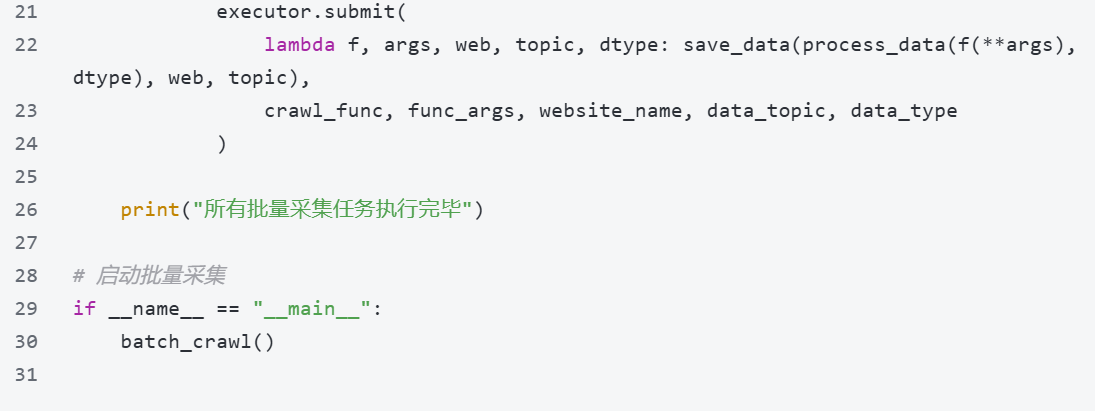

3.5 批量调度(多网站、多任务并发采集)

实现多网站同时采集,提升效率,用concurrent.futures多线程实现(轻量场景),复杂场景可替换为Celery:

3.6 测试与优化(关键,避免采集失败)

"问题解决"是重点,这里列出常见问题及优化方案:

-

问题1:IP被封禁→优化:增加代理池数量,延长请求间隔(time.sleep(1-3秒)),随机切换代理;

-

问题2:JS加载不完整,数据提取失败→优化:延长页面等待时间(page.wait_for_selector超时时间),模拟用户操作(如滚动页面);

-

问题3:中文乱码→优化:保存时使用encoding="utf-8-sig",请求时添加Accept-Charset请求头;

-

问题4:API请求失败→优化:添加重试机制(用tenacity库),捕获HTTP异常,打印详细错误信息;

-

问题5:数据重复→优化:保存前用pandas去重,或基于商品链接、数据日期等唯一标识去重。

重试机制示例(tenacity库):

四、整体架构总结

整个技术实现架构分为5层,层层递进,可灵活扩展,适配不同国外网站的采集需求:

-

配置层:config.py,统一管理代理、API密钥、保存目录,降低耦合;

-

采集层:分API对接、爬虫采集两种方式,针对单个网站定制逻辑;

-

处理层:pandas清洗数据,统一格式,解决缺失值、乱码问题;

-

保存层:按中文目录、中文表名规范保存,支持Excel/CSV/JSON;

-

调度层:多线程/分布式调度,实现批量采集,提升效率。

五、扩展建议

-

长期采集:使用Celery+Redis实现定时采集(如每天凌晨采集最新数据),搭配日志模块(logging),记录采集日志,便于排查问题;

-

反爬升级:如果遇到高强度反爬(如Cloudflare验证),可使用undetected-chromedriver(规避Cloudflare检测),或对接第三方采集服务;

-

数据可视化:采集完成后,用matplotlib/seaborn绘制图表(如GDP趋势图、商品销量排行榜),提升数据价值;

-

代码复用:将采集、处理、保存逻辑封装为类,后续新增网站时,只需继承类、重写采集方法,降低开发成本。

结语:本文针对"国外网站定制化批量采集+中文规范保存"的核心需求,提供了完整的技术实现路径,从选型到编码、优化,均贴合CSDN技术分享风格,可直接参考落地。实际开发中,需根据目标网站的具体结构、反爬机制,调整采集逻辑和选择器,重点关注反爬适配和数据规范化,避免采集失败和数据混乱。