编写爬虫基本请求:使用爬虫框架发送 HTTP 请求,获取网页内容

编写爬虫基本请求使用爬虫框架发送 HTTP 请求获取网页内容

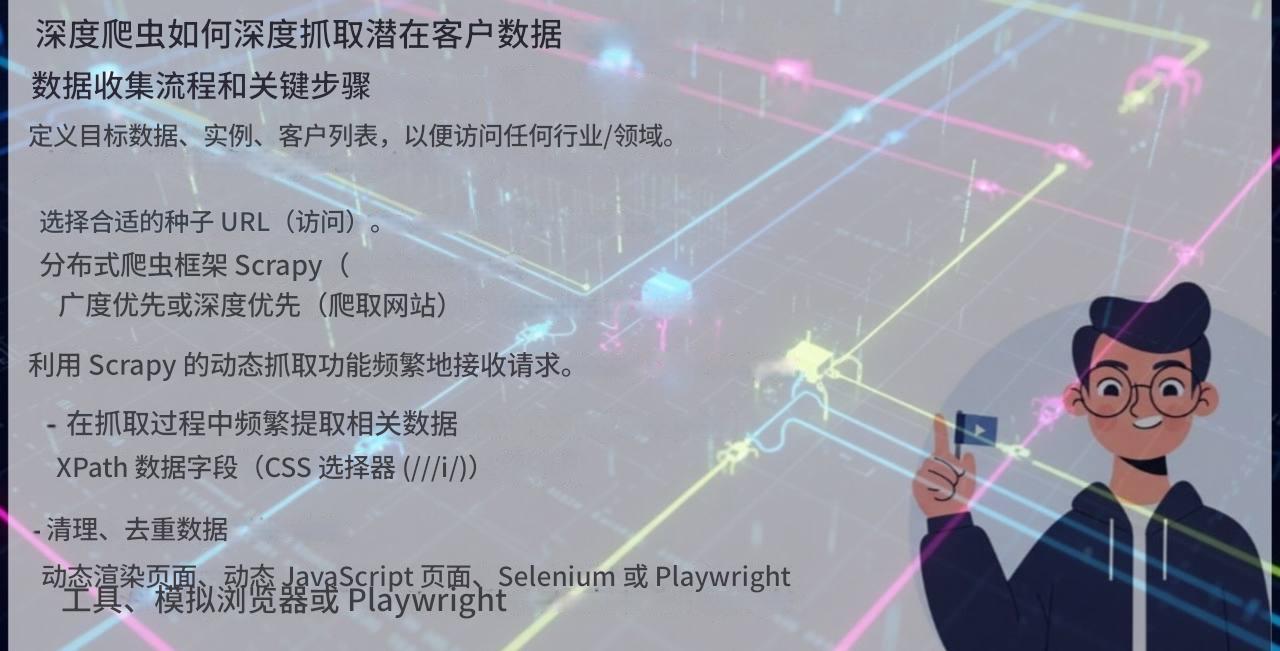

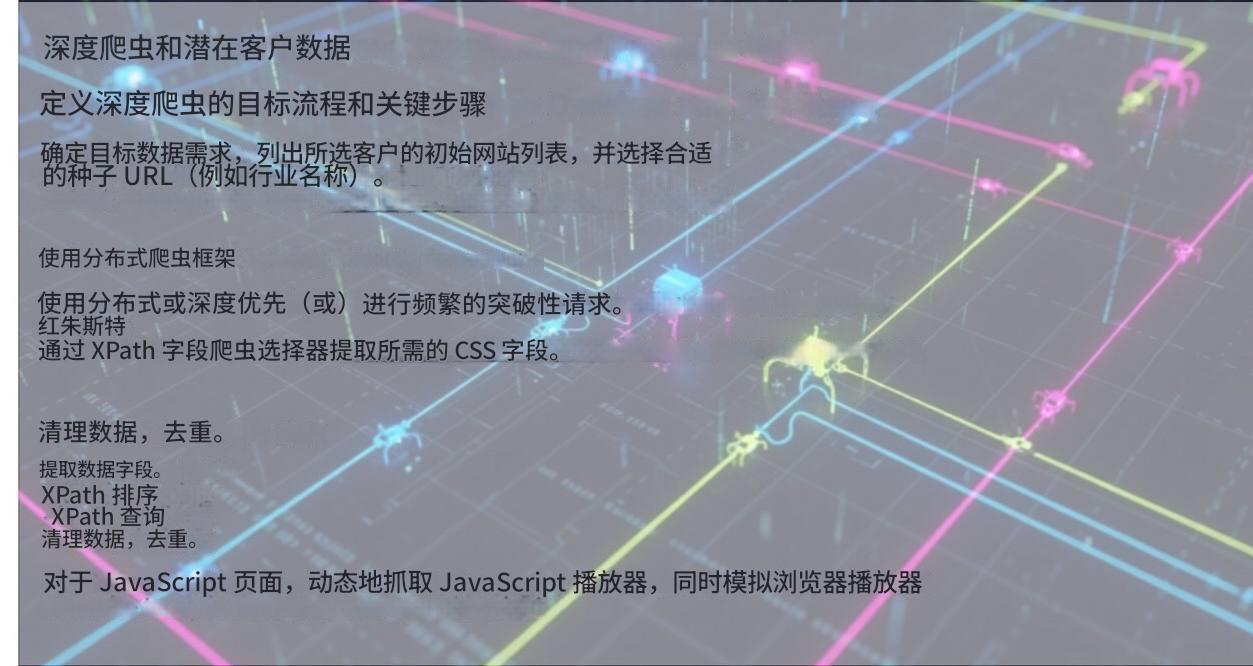

随着互联网信息的爆炸式增长,自动化获取数据的需求日益凸显。爬虫技术应运而生,它能够模拟浏览器行为,通过网络请求获取网页内容,进而提取、处理和存储数据。无论是市场调研、数据挖掘还是学术研究,爬虫都发挥着不可替代的作用。而使用爬虫框架,如 Python 中的 requests 和 BeautifulSoup,可以极大简化开发流程,提高代码的可读性和可维护性。这些工具不仅提供了便捷的 HTTP 请求发送功能,还支持高效的 HTML 解析,使得爬虫开发变得更加高效和便捷。

网络请求与数据获取

网络请求与数据获取

爬虫的核心任务是通过 HTTP 请求获取目标网页的内容。在 Python 中,requests 库是最常用的 HTTP 请求库之一,它提供了简洁的 API,使得发送 GET 或 POST 请求变得轻而易举。例如,以下代码展示了如何使用 requests 获取网页内容:

python import requests from bs4 import BeautifulSoup

URL = '//example.com/consultations' response = requests.get(URL) soup = BeautifulSoup(response.text, 'html.parser')

通过上述代码,我们首先发送一个 GET 请求到指定 URL,然后使用 BeautifulSoup 解析返回的 HTML 内容。这一步骤是爬虫的基础,后续的数据提取和存储都依赖于获取到的网页内容。

数据提取与结构化处理

数据提取与结构化处理

获取网页内容后,下一步是提取所需的数据。通常,网页中的数据以 HTML 标签的形式存在,我们可以通过解析 HTML 结构,定位到特定的标签并提取其内容。例如,以下代码展示了如何提取咨询留言:

python comments = soup.find_all('div', class_='comment') for comment in comments: author = comment.find('span', class_='author').text message = comment.find('p', class_='message').text

存储或处理提取的数据

这里,我们使用 find_all 方法查找所有带有 comment 类的 div 标签,然后进一步提取每个留言的作者和内容。这种结构化的数据提取方式,使得后续的数据处理和分析更加高效。

翻页处理与完整数据抓取

许多网站采用分页展示数据,因此爬虫需要能够处理翻页逻辑,以确保抓取到完整的信息。以下代码展示了如何实现翻页抓取:

python while next_page: response = requests.get(next_page)

python while next_page: response = requests.get(next_page)

提取数据

更新 next_page

在循环中,我们不断发送请求到下一页的 URL,直到没有更多页面为止。这种处理方式确保了爬虫能够获取到所有页面的数据,而不仅仅是第一页的内容。

总结

总结

编写爬虫基本请求是数据采集的第一步,通过使用爬虫框架,如 requests 和 BeautifulSoup,我们可以高效地发送 HTTP 请求并解析网页内容。结合数据提取和翻页处理,爬虫能够自动化地获取结构化数据,为后续的分析和应用提供支持。无论是商业决策还是学术研究,爬虫技术都将在数据驱动的时代中发挥越来越重要的作用。