【【图神经网络】入门到精通(GCN、GAT、PyG、GTN、HAN、SDGNN、HGNN、TGAT...)基础原理+源码复现,由浅入深通俗易懂!】 https://www.bilibili.com/video/BV1fc411z7mx/?p=18\&share_source=copy_web\&vd_source=6b8044752c092314d4b426afb8ebd370

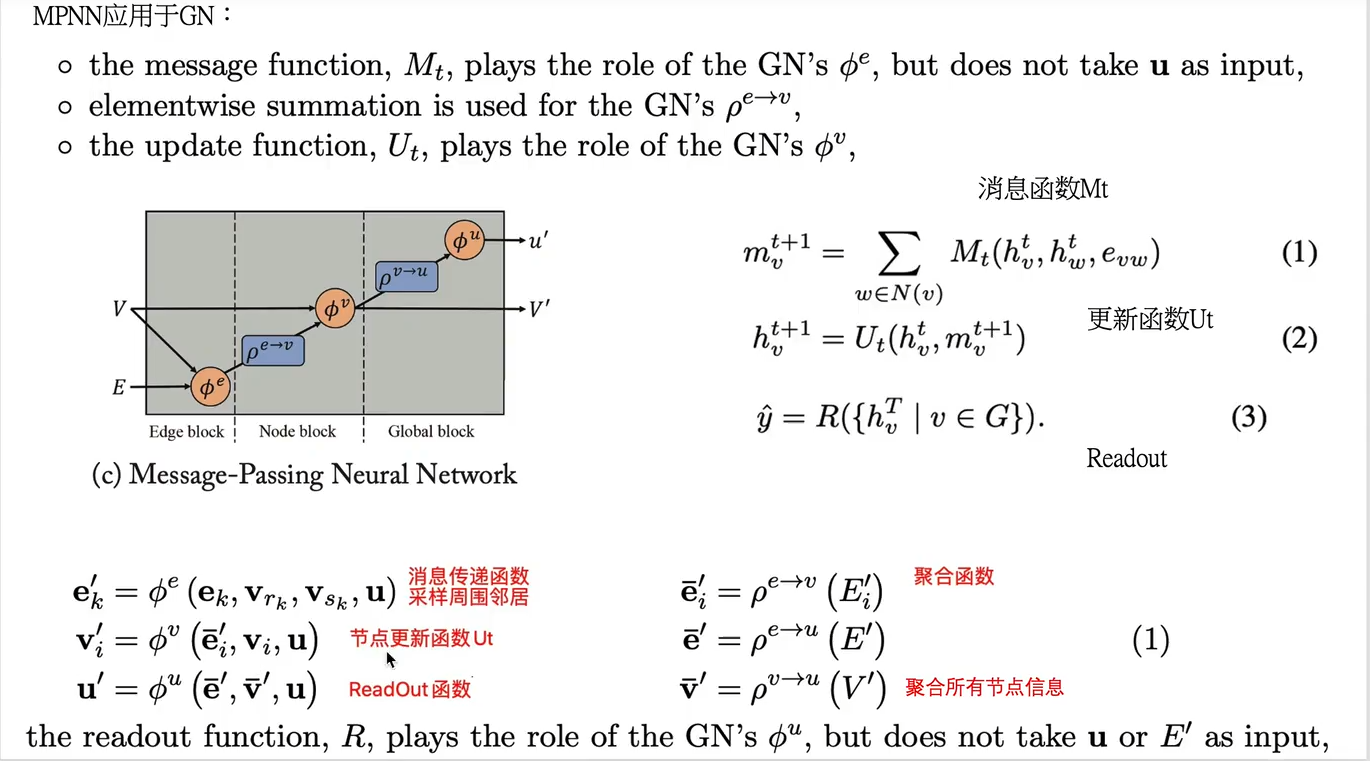

这一步确实是整个MPNN框架的核心,你可以把它想象成节点之间"交换信息"的过程。公式 (1) 具体描述了节点 vvv 在第 t+1t+1t+1 轮是如何收集并汇总来自其邻居的信息的。

公式 (1) 详解

mvt+1=∑w∈N(v)Mt(hvt,hwt,evw)m_v^{t+1} = \sum_{w \in \mathcal{N}(v)} M_t(h_v^t, h_w^t, e_{vw})mvt+1=w∈N(v)∑Mt(hvt,hwt,evw)

这个公式可以拆解为三个关键部分来理解:

消息函数 MtM_tMt ------ "说什么"

- 作用: MtM_tMt 是一个可学习的函数(通常是神经网络,如多层感知机)。它的作用是计算邻居节点 www 应该向中心节点 vvv 传递什么样的信息。

- 输入: 它接收三个输入:

- hvth_v^thvt:接收者(中心节点 vvv)当前的状态。

- hwth_w^thwt:发送者(邻居节点 www)当前的状态。

- evwe_{vw}evw:连接这两个节点的边的特征(如果图没有边特征,这一项可以忽略)。

- 含义: 这意味着消息的内容不仅取决于邻居是谁,还取决于中心节点当前的状态以及它们之间的关系(边)。

求和符号 ∑\sum∑ ------ "怎么听"

- 作用: 这是一个聚合操作 。它表示将节点 vvv 的所有邻居 w∈N(v)w \in \mathcal{N}(v)w∈N(v) 发来的消息加在一起。

- 含义: 节点 vvv 不会只听某一个邻居的话,而是把所有邻居的意见汇总起来,形成一个综合的信息向量 mvt+1m_v^{t+1}mvt+1。

- 注: 虽然公式中写的是求和 ∑\sum∑,但在不同的图神经网络变体中,这个聚合操作也可以是均值 、最大值 或者LSTM聚合等。

输出 mvt+1m_v^{t+1}mvt+1 ------ "收到的汇总信息"

- 这是计算出的结果,代表在第 t+1t+1t+1 时刻,节点 vvv 从其周围邻居那里收集到的总消息。

- 这个 mvt+1m_v^{t+1}mvt+1 随后会被带入公式 (2),用来更新节点 vvv 自身的状态。

举个通俗的例子

假设这是一个社交网络图,我们要预测用户的兴趣:

- www 是你的朋友。

- vvv 是你自己。

- MtM_tMt 决定了你的朋友 www 会根据他自己的兴趣(hwth_w^thwt)和你目前的兴趣(hvth_v^thvt)向你推荐什么东西。

- ∑\sum∑ 意味着你会把所有朋友推荐给您的东西都收集起来,打包成一个大包裹(mvt+1m_v^{t+1}mvt+1)。

总结: 公式 (1) 的核心逻辑就是**"收集邻居信息"**。它定义了信息如何在图的边上传播,以及如何将分散在邻居节点上的信息集中到中心节点上。