写在前面 :这篇文章不是模型评测,是决策工具。你要回答的问题只有一个:给定我的业务场景和预算约束,哪个模型组合的预期收益最高? 本文从这个问题出发,给出可操作的判断框架。

一、先说结论,再说依据

很多模型对比文章的问题在于:它们从"模型能力"出发,试图证明某个模型更好。这是错误的起点。

正确的起点是:你的任务结构决定了你的选型空间。

任何 LLM 任务都可以分解为三个维度:

- 精确性要求:输出是否有客观正确答案(代码运行、事实问答)vs. 主观优劣(创意写作、风格把控)

- 上下文规模:输入 token 量决定了成本结构,这直接影响规模化时的经济可行性

- 语言与文化场景:中文业务的隐性要求远超字面翻译

沿着这三个维度,V4 的定位才能被清晰理解。

二、V4 真正领先的三个场景

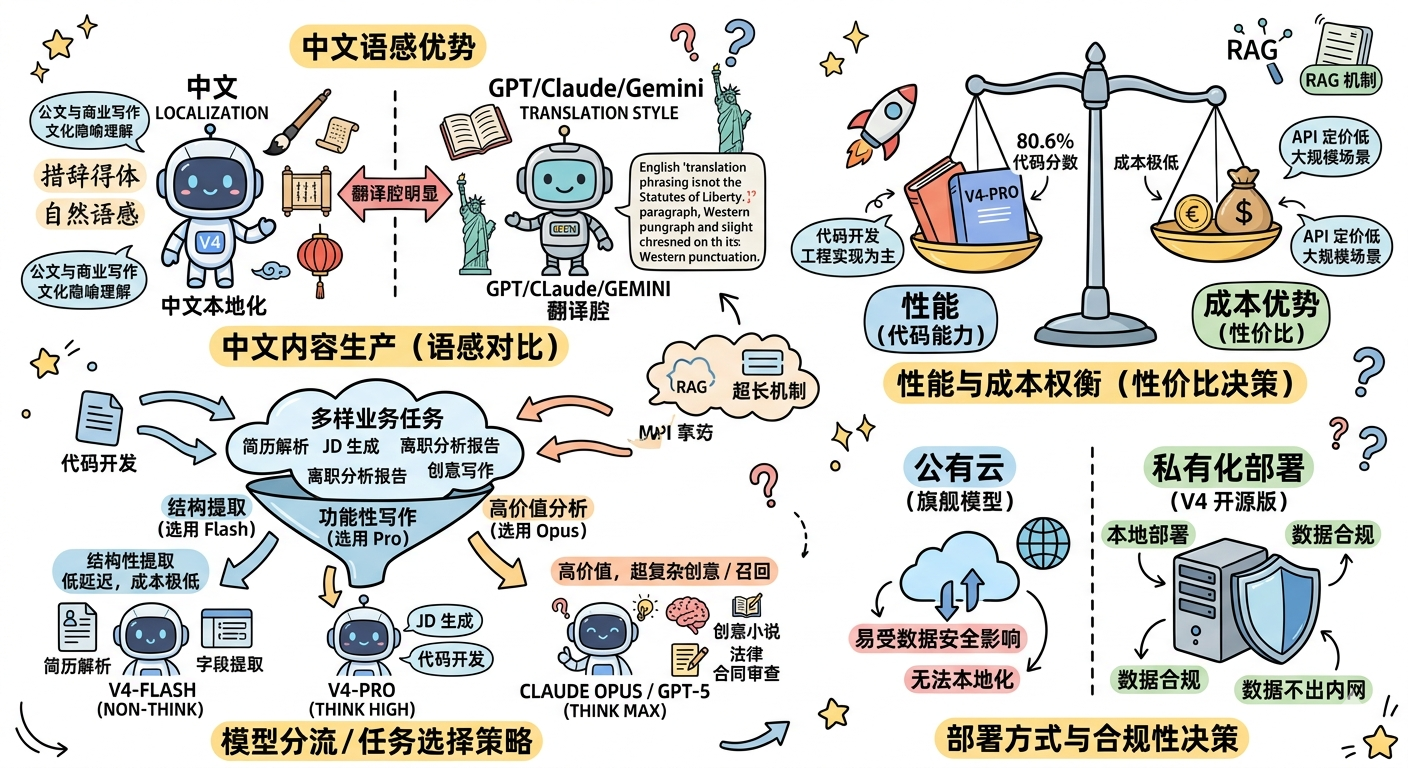

2.1 代码任务:开源可私有化,成本优势明确

V4-Pro 在 SWE-bench Verified 上达到 80.6% 通过率,这是一个衡量"真实工程任务"而非"代码智力题"的基准。它的意义在于:模型需要理解代码库上下文、定位 bug、修改正确并通过测试,而不只是从零生成一段代码片段。

与旗舰竞品在代码任务上的质量已基本持平,但有两点差异值得特别注意:

成本差距显著。V4-Pro 的 API 定价远低于 Claude Opus 系列和 GPT-5.4。在大规模代码补全场景下,这个差距会在月账单上显现为显著的成本节省。

开源可私有化是护城河,不是加分项。对于金融、医疗、政务类客户,数据不出内网是合规要求而非偏好。能私有化部署意味着 V4 在这类场景根本没有竞争对手------GPT 和 Claude 都无法满足这一要求。

代码任务分流建议:

行内补全 / 注释生成

函数级代码审查 / 单元测试生成

系统架构设计 / 大规模重构

代码请求

任务类型

V4-Flash Non-think

低延迟,成本极低

V4-Pro Think High

质量稳定,成本可控

V4-Pro Think Max

或保留旗舰模型

判断标准:如果你的代码任务以工程实现为主(而非算法竞赛类智力题),V4-Pro 是第一优先级。

2.2 中文内容生产:语感差异是真实存在的

这是一个很难用 benchmark 衡量、但实际使用者能立刻感受到的差异。

Claude 和 Gemini 在中文写作上的问题不是语法错误,而是"翻译腔"------句式结构模仿英文原文、用词习惯偏向书面语直译、段落节奏不符合中文阅读惯例。对于中文读者而言,这类文本读起来"感觉对、但总差点什么"。

V4 在中文表达上的优势体现在:

- 公文与商业写作:措辞符合中文语境下的行业规范(如"建议""需关注""应重点考虑"等表达的场合感)

- 口吻把控:能准确区分"正式但不官僚""专业但不晦涩"等微妙风格差异

- 文化隐喻理解:不会将"打太极""按下葫芦浮起瓢"等表达字面化处理

适用场景:日产量较高的中文技术文章、产品说明、客服话术、政务报告。

不适用场景:高度原创性的文学创作、需要强烈个人风格的专栏写作。对于后者,Claude Opus 的创意深度目前仍有优势。

2.3 长文档批量处理:成本结构决定可行性边界

这是 V4 优势最为量化、最容易做 ROI 分析的场景。

以分析一份 300 页财报(约 800K tokens 输入)为例,V4-Flash 的输入成本约为 $0.14/1M tokens,而 Claude Opus 4.6 的定价高出数倍。在批量处理场景下,这不是"省一点钱",而是决定了某些业务在经济上是否可行的分水岭。

关键判断:如果你的任务是"从长文档中提取结构化信息"(而非"对长文档进行深度分析并做出高风险决策"),V4-Flash 足以胜任,且成本优势使得规模化在经济上成立。

反例:如果是法律合同的风险条款精确定位,错一个遗漏就可能造成重大损失,这时成本节省的优先级应低于召回率,Claude Opus 的优势更值得那笔开销。

三、V4 真正落后的三个场景

诚实地描述劣势,比罗列优势更有价值。

3.1 超复杂创意写作:结构控制能力存在差距

一个可重复验证的测试:要求模型写一篇同时满足"三条时间线交织、每个角色有独特语言风格、埋设伏笔并在结尾收束"的短篇小说。

Claude Opus 系列在这类任务上的优势体现在:它能同时追踪多个叙事约束、在生成过程中保持内部一致性、并在结局处做出有意义的收束。这不是风格偏好问题,而是多约束协同跟踪的能力差异。

V4 在此类任务上的常见失误:时间线切换提示过于明显、角色语言风格趋于雷同、伏笔与结局的关联缺乏设计感。

判断标准:如果写作任务有多于两个需要同时维持一致性的结构约束,优先考虑 Claude Opus。

3.2 知识密集型问答:知识边界与更新频率的差异

在物理、医学、法律等专业领域的深度问答上,Gemini 和 GPT-5 的优势来自两个方面:更大的预训练知识量,以及与更新数据源的整合能力。

这在实践中意味着:当用户追问"该领域 2024 年后的最新研究进展"时,V4 更容易出现知识截止导致的信息滞后,而 Gemini 凭借与 Google 生态的整合,更新频率更有保障。

判断标准:任务是否依赖近期动态知识,或专业领域的细粒度准确性。如果是,优先选择 Gemini 或 GPT-5。

3.3 超长文本的精确召回:500K token 以上场景

在处理超过 50 万 token 的超长上下文(如百万字代码库、多份完整报告的交叉分析)时,召回率的差异会放大。

Claude Opus 在此场景的优势不是"支持更长的 context",而是在极长上下文下的注意力稳定性------它更不容易在长文本中"遗漏"某个关键细节。

V4-Pro 的召回能力在普通长文档场景下完全够用(如分析一份财报、审查一个代码模块),但在需要跨越极长文本做交叉引用的任务上,仍存在一定的遗漏风险。

判断标准:任务的错误代价是否高到无法容忍遗漏(如合规审查、完整性验证)。如果是,Claude Opus 更稳妥。

四、四大模型的定位全景

| 模型 | 定位 | 核心优势 | 适用场景 |

|---|---|---|---|

| V4-Flash | 规模化的基础设施层 | 成本极低、速度快 | 不需要深度推理的高频任务 |

| V4-Pro | 代码与中文内容的主力 | 性价比最优 | 代码开发、中文写作、长文档处理 |

| Claude Opus | 创意与长文本之王 | 创意深度、长文本召回 | 超复杂创意写作、高价值分析 |

| GPT-5.4 | 多模态与生态首选 | 知识广度、多模态 | 多模态任务、成熟生态项目 |

| Gemini 3.1 Pro | 知识密集型首选 | 知识更新频率 | 知识问答、Google 生态 |

选择逻辑:

- 成本敏感 + 中文/代码场景 → V4

- 质量至上 + 创意/长文本 → Claude Opus

- 多模态 + 生态完整 → GPT-5.4

- 知识密集 + 更新频率 → Gemini

五、三个实战场景的决策推演

5.1 场景一:B 端 SaaS 产品的 AI 功能集成

场景描述:一家 HR SaaS 企业,需要为 3000 家中小企业客户提供以下 AI 功能:简历解析、JD 生成、面试题推荐、离职分析报告。日均 API 请求约 8 万次,用户主要使用中文。

决策推演:

简历解析属于结构化信息提取,对推理深度要求低、对速度和成本敏感------V4-Flash Non-think 是正确答案。

JD 生成属于中文功能性写作,要求语感自然、符合招聘场景的表达习惯------V4-Pro Think High 是正确答案。

面试题推荐属于知识型任务,依赖岗位专业知识------此处可对比测试 V4-Pro 与 GPT-5 的实际输出质量,再做决策。

离职分析报告属于多维度综合分析,报告质量直接影响客户续约判断------建议保留 Claude Opus 或 GPT-5 作为高价值场景的处理层。

简历解析 / 字段提取

JD 生成 / 通知文案

面试题推荐

通用岗位

高专业度岗位

离职分析报告

用户请求

任务类型

V4-Flash Non-think

延迟低,成本极低

V4-Pro Think High

中文质量优,成本可控

岗位类型

V4-Pro / GPT-5

对比测试决定

Claude Opus / GPT-5

高价值,成本可接受

关键结论:不同功能模块用不同模型,是正确的工程决策,不是"不统一"。

5.2 场景二:法律科技公司的合同审查系统

场景描述:为律所和企业法务部门提供合同风险条款自动标注服务。单份合同平均 80 页(约 200K tokens),每日处理约 500 份。客户对遗漏的容忍度极低,任何遗漏都可能引发法律责任。

决策推演:

这是一个错误代价极高的场景,与成本优化的逻辑相反------这里应该优先考虑召回率,再考虑成本。

在 200K tokens 的范围内,V4-Pro 的召回能力是足够的。但当合同附件、背景资料、历史往来邮件也被纳入分析时,上下文可能突破 500K tokens,此时 Claude Opus 的注意力稳定性优势就变得关键。

建议架构:

不要让模型一次性处理全部内容,而是建立分层召回机制:

- 第一层:用 V4-Flash 做粗筛,按条款类型切分合同,提取疑似风险段落(成本可控)

- 第二层:将粗筛结果送入 Claude Opus 做精确分析和定性判断(聚焦在必要的高风险段落上,控制 token 消耗)

- 第三层:生成结构化报告(V4-Pro,中文输出质量有保障)

这种架构下,Claude Opus 的高成本只发生在真正需要它的那一层,而不是全链路都用高成本模型。

5.3 场景三:内容工厂的规模化中文生产

场景描述:为多个行业垂直媒体生产中文技术文章,日产量目标 200 篇,每篇 2000-3000 字。要求原创性高、SEO 友好、行业术语准确。

决策推演:

这个场景的核心矛盾是:质量要求不低,但日产量目标使得高成本模型在经济上不可持续。

中文写作是 V4 的相对优势场景,这里应该建立以 V4 为核心的生产流程,而不是把 Claude 或 GPT 当成"质量兜底"来依赖。

正确的做法是在 Prompt 工程上投入更多精力,让 V4-Pro 输出更接近预期标准,而不是用更贵的模型替代 Prompt 工程的工作。

一个高质量的 Prompt 设计,对产出质量的提升远超模型切换带来的差异。

生产流程设计要点:

- 大纲生成与内容填充应该分成两步,而不是一步到位要求模型直接输出全文

- 为每个垂直领域单独维护一份"语料参考库",通过 RAG 方式注入行业术语和表达习惯

- 建立人工审核的抽检机制(而非全量审核),将人力集中在 10% 的复杂稿件上

这一流程下,90% 的文章可以由 V4-Pro 完成,10% 质量存疑的文章再由人工介入修改,这比全程依赖高成本模型更具可持续性。

六、迁移路径:如何从 GPT/Claude 切换到 V4

6.1 技术迁移成本极低

V4 的 API 与 OpenAI SDK 完全兼容,迁移核心代码只需修改两个参数:

python

from openai import OpenAI

# 原有代码(GPT)

client = OpenAI(

api_key="your-openai-key",

)

# 迁移后代码(V4)

client = OpenAI(

api_key="your-deepseek-key", # 替换 key

base_url="https://api.deepseek.com" # 替换 endpoint

)

# 其他代码无需修改

response = client.chat.completions.create(

model="deepseek-v4-pro", # 模型名称

messages=[{"role": "user", "content": "Hello"}]

)已有的 Prompt、对话历史管理、流式输出处理逻辑无需修改。技术迁移的门槛不是障碍。

真正的迁移风险在于:Prompt 在不同模型上的表现不完全相同。为 Claude 精调过的 Prompt,在 V4 上可能需要微调才能达到同等效果。这是灰度发布策略存在的真正理由。

6.2 灰度发布策略

合格

不合格

迁移准备

建立评测基准

第一周

10% 流量切 V4

质量评测

第 2-3 周

30% → 50%

Prompt 调整

重新测试

第 4 周

70% → 全量

持续监控

保留回滚能力

关键步骤:

- 建立评测基准:收集 100-200 个历史请求样本及其预期输出,作为测试集

- 灰度测试:从 10% 流量开始,逐步放量

- 质量对比:收集用户反馈,对比质量差异

- 持续监控:保留回滚能力,确保稳定性

七、给决策者的选型矩阵

| 任务场景 | 首选模型 | 核心理由 | 不建议使用 |

|---|---|---|---|

| 代码补全 / 审查 | V4-Pro Think High | 质量与旗舰持平,成本显著降低 | 基础版模型 |

| 中文功能性写作 | V4-Pro Think High | 中文语感优于竞品 | Gemini(翻译腔明显) |

| 结构化信息提取 | V4-Flash Non-think | 速度与成本优先,精确性足够 | 高推理模型 |

| 知识密集型问答 | Gemini 3.1 Pro | 知识更新频率高,专业深度更强 | V4-Flash |

| 超复杂创意写作 | Claude Opus | 多约束协同能力目前最强 | V4-Flash |

| 超长文本精确召回 | Claude Opus | 极长上下文的注意力稳定性更高 | V4-Flash |

| 多模态任务 | GPT-5.4 | V4 暂不支持图像输入 | V4(功能不支持) |

| 私有化部署 | V4(开源版) | 唯一可本地化部署的旗舰级选项 | 闭源模型均不适用 |

八、核心判断:三个真正值得问自己的问题

读完这篇文章,如果只能带走三个问题,应该是这三个:

问题一:我的任务允许"足够好",还是要求"尽可能好"?

大多数 B2B 场景的答案是"足够好"------用户不会区分 85 分和 95 分的输出,但能感受到延迟和体验。在这些场景下,把高成本模型用在低要求任务上,是一种浪费。

问题二:我的规模化目标是否使当前成本结构不可持续?

如果你现在用高成本旗舰模型处理所有请求,且日均调用量超过 5 万次,建议认真做一次 ROI 计算。V4 带来的成本结构变化,在规模化之后可能从"节省一些钱"变成"决定业务是否盈利"。

问题三:我的业务是否有数据合规需求?

如果有,私有化部署的可行性直接缩减了选项空间------V4 是目前旗舰级别中唯一可以满足这一条件的选项。在这个前提下,其他模型的能力差距已经不再是决策变量。

结语

没有最好的模型,只有最适合当前场景和约束条件的模型组合。

V4 的出现,改变的不是"谁最聪明"这个问题的答案,而是改变了在大多数实际任务中做出性价比最优决策的可行解空间。

搞清楚自己任务的真实需求,是比反复跑 benchmark 更有价值的工作。

数据说明:本文引用的 benchmark 数据基于 DeepSeek-V4 技术报告(2026 年)及 2026 年 4-5 月公开评测数据。成本数据基于各平台官方定价,实际使用成本因批量协议和使用模式而有所不同。模型能力持续迭代,建议每季度重新评估选型决策。