上周在义乌,一家年销几个亿的外贸公司找我聊 AI Agent。

大家好,我是小虎。

他们的硬约束很明确:数据不能出外网。

不是不能出国,是不能出外网。国内云也不行,阿里云百度云腾讯云统统不行。

因为他们担心数据在处理过程中被外网访问到,客户数据、产品图纸一旦泄露,后果不堪设想。

所以只有一条路:本地部署。

聊到选模型的时候,我说推荐 Gemma 4。

老板问为什么不是 Qwen 或者 DeepSeek。

我说了七个理由,他当场拍板。

理由一:140+ 语种,外贸的命脉

义乌做外贸的,客户遍全球。

中东客户用阿拉伯语,南美客户用西班牙语,欧洲客户用法语德语。

国内大模型中文确实强,但小语种呢?

Gemma 4 原生支持 140+ 种语言。不是"能翻译",是理解各国文化语境。

阿拉伯语里"明天再说"不代表真的明天,西班牙语里"ahora"可能是现在也可能是等会儿。

理由二:跟 Gemini 3 同源技术

Gemma 4 基于谷歌闭源旗舰模型 Gemini 3 的同源技术构建。

什么概念?Gemini 3 是目前全球最强的多语言模型之一。

Gemma 4 继承了它的核心能力,但是开源免费的。

多语言问答基准 MMMLU 得分 85.2% ,全球开源模型最高水平。

比前代 Gemma 3 从 67.6% 飙到 85.2%,代际提升巨大。

理由三:能看图

外贸公司每天处理大量产品图片、设计稿、扫描件。

国内开源大模型也有多模态版本,但参数往往要 70B 以上,显存占用翻倍。

Gemma 4 用 31B 参数就做到了原生多模态。

产品的材质、规格、型号,它能识别。对接单里附带的图片内容,它能理解。

这对有大量产品图片处理需求的外贸公司是硬需求。

理由四:Agent 工具调用最稳定

外贸企业的日常运营涉及十几个业务场景:文档翻译、邮件处理、销售数据分析、客户服务、产品内容生成、市场情报、供应链管理、合同风控、报关单据、社交媒体运营。

每一个场景都不是简单的一问一答。

文档翻译要经过「识别→提取术语→翻译→校对→格式输出」五步。

邮件处理要分类、摘要、草拟回复、多语言转换。

报关单据要从发票和装箱单中自动提取信息并核对。

合同风控要逐条审查条款、标注潜在风险点。

多步骤串联,每一步都不能掉链子。

Gemma 4 原生支持函数调用,Agent 工具使用评测 τ²-Bench 得分 86.4% ,开源模型里最稳的。

不是"能调",是"稳定地调"。生产环境和实验室的区别就在这里。

理由五:31B 参数打出 6000 亿级别的成绩

这是最反直觉的部分。你想想,310 亿参数,在很多人眼里就是"小模型"。

| 评测项目 | Gemma 4 得分 |

|---|---|

| 数学推理 AIME 2026 | 89.20% |

| 编程能力 LiveCodeBench | 80.00% |

| 科学推理 GPQA Diamond | 84.30% |

| 综合知识 MMLU Pro | 85.20% |

310 亿参数,打出了媲美 6000 亿参数级别模型的性能。

用最少的资源,跑出最强的效果。

对外贸企业来说,这意味着你不需要买最贵的显卡,就能跑出顶级效果。

理由六:显存占用极低

96GB 的显卡跑 Gemma 4-31B Q8_0 量化,实际占用 34-38GB,还剩 58GB。

这 58GB 可以跑知识库、向量检索、数据库,整个系统稳稳当当。

国内大模型要达到同等的多语言和看图能力,得用 70B 以上的多模态版本,显存占用翻倍。

同样是 31B,Gemma 4 用更少参数做到了更多事,所以留出了更多空间。

理由七:Apache 2.0,商用无限制

通义千问月活超 1 亿需要单独申请授权。

Gemma 4 用的是 Apache 2.0 协议,商用、修改、再分发完全免费无限制。

训练数据经过 CSAM 和敏感信息严格过滤,满足企业审计要求。

Google 出品,安全协议跟闭源模型相同,合规叙事完善。

七个理由说完了。

说实话,数据看多了也麻木。如果你觉得这些离你太远,那我换个角度------我自己装了一遍。

我用 RTX 4060 笔记本实测了一回

说真的,七个理由说再多,不如自己跑一遍。

我的笔记本电脑是 RTX 4060 8GB 显存,不算什么高端配置。

前两天我花不到 10 分钟,把 Gemma 4 E4B 版本装上去了。

你猜怎么着?文字识别、图片理解,都能用。

整个过程就三步。

第一步:安装 Ollama

Ollama 是目前最流行的本地大模型运行工具,免费开源,官网是 ollama.com。

Windows 用户:

- 打开浏览器,访问 ollama.com

- 点击右上角 "Download"

- 下载 Windows 版本安装包(约 100MB)

- 双击安装包,一路"下一步"

Mac 用户:

- 访问 ollama.com,下载 Mac 版本

- 双击安装包,拖到应用程序文件夹

Linux 用户:

终端输入一行命令:

arduino

curl -fsSL https://ollama.com/install.sh | sh完事。

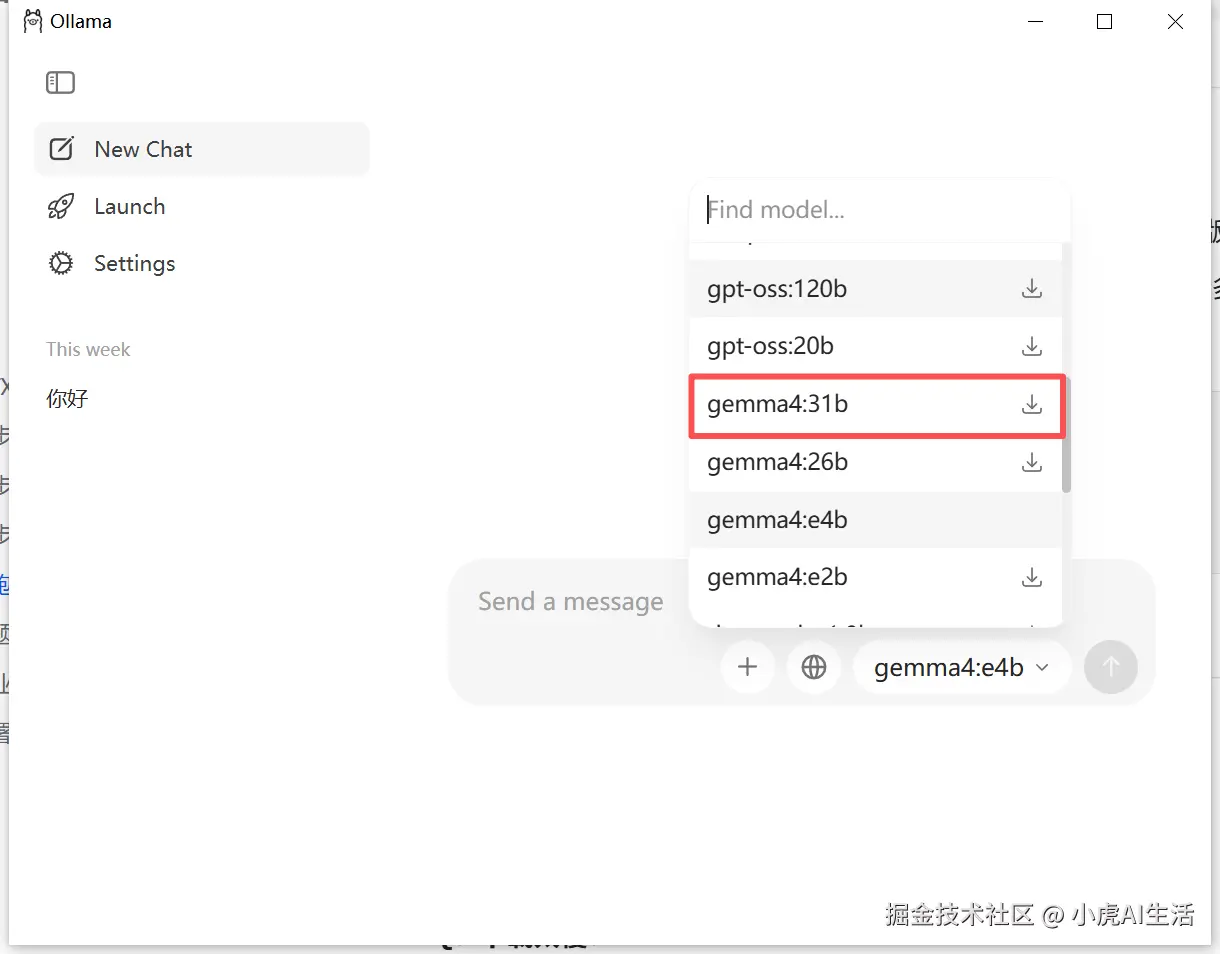

第二步:下载 Gemma 4 E4B 模型

Gemma 4 有两个常用版本:

| 版本 | 参数 | 显存要求 | 适用场景 |

|---|---|---|---|

| E4B | 4.5B | RTX 4060 8GB | 日常对话、快速测试 |

| 31B | 31B | 24GB 显存 | 高质量推理、多模态 |

建议先从 E4B 开始。

打开终端(Windows 按 Win+R 输入 cmd),输入:

ollama pull gemma4:e4b模型文件约 9GB,需要耐心等待,去喝杯咖啡吧。

第三步:运行

下载完成后直接输入:

arduino

ollama run gemma4:e4b看到欢迎信息就说明启动成功了。

试试这些:

你是什么大模型?

你能看的了图片吗?

(图片)这张图上有什么?在我的 RTX 4060 笔记本上,基本 10 秒出结果。

试试用阿拉伯语问它一个问题,你就知道什么叫"140+ 语种"了。

进阶:跑 31B 版本

如果你有更强的显卡(RTX 4090 24GB 或专业卡),可以试 31B 版本。

31B 版本对话质量明显更高,复杂推理和长文本处理更强。还支持多模态,可以上传图片让它理解。

命令:

arduino

ollama pull gemma4:31b

ollama run gemma4:31b

常见问题

Q: 显存 6GB 能跑吗?

E4B 可能跑不动。可以试更小的 gemma4:2b,6GB 显存就行。

Q:下载太慢?

Ollama 支持断点续传,中断了再执行同样的命令会接着下。晚上或凌晨网速会快一些。

Q:跑起来卡?

- 更新显卡驱动到最新版

- 关掉其他占显存的大型程序

- 试试调低上下文长度

Q:怎么退出?

输入 /bye 或直接关终端(程序)。

外贸企业的 10 个典型场景

跑通 Gemma 4 之后,外贸企业可以用它覆盖十几个业务场景:

文档翻译:产品说明书、合同、报价单多语种翻译,支持术语库校对

邮件处理:邮件自动分类、摘要生成、回复草拟、多语言转换

销售 数据分析:订单趋势分析、客户分布统计、销量可视化报表

客户服务:7×24 多语言客服机器人,FAQ 自动回复

产品内容生成:产品详情页多语言描述、SEO 标题和关键词生成

市场情报:竞品价格追踪、海外市场趋势分析报告

供应链管理:采购建议、库存预警、交期预测

合同风控:外贸合同条款逐条审查、风险点标注

报关单据:发票、装箱单、报关单信息自动提取和核对

社交媒体运营:LinkedIn/Instagram 多语言内容生成和评论回复

全部在本地服务器上完成,数据不出外网。

本地部署,数据在自己手上

这是我觉得 Gemma 4 最值得说的部分。

不上传云端,不经第三方服务器,不存任何外部存储。

你的数据,在你自己的硬盘上。

对有数据安全要求的公司来说,这不是锦上添花,是刚需。

我有时候觉得,很多人对"AI 必须联网"这个执念,就像十年前觉得"手机必须插 SIM 卡才能上网"一样。

时代变了,认知也该跟着变。

P.S.

如果你公司也在考虑本地部署 AI Agent,核心看三件事:数据安全、硬件投入、模型能力。

Gemma 4 不是唯一答案。但对做全球生意的公司来说,它可能是最合适的那个。

说一句我在义乌听到的话: "做全球生意,需要一个懂全球的 AI,而不是只懂中文的 AI。"