搭建本地智能体的简单说明

- 1.个人电脑部署

-

- [1.1 安装 Ollama](#1.1 安装 Ollama)

- [1.2 模型下载](#1.2 模型下载)

- [1.3 可视化界面安装](#1.3 可视化界面安装)

- [2. 内网服务器部署(离线)](#2. 内网服务器部署(离线))

-

- [2.1 安装Ollama](#2.1 安装Ollama)

-

- [2.1.1 解压](#2.1.1 解压)

- [2.1.2 添加启动脚本](#2.1.2 添加启动脚本)

- [2.1.3 启动服务](#2.1.3 启动服务)

- [2.2 模型迁移](#2.2 模型迁移)

-

- [2.2.1 注册文件](#2.2.1 注册文件)

- [2.2.2 模型文件迁移](#2.2.2 模型文件迁移)

- [2.3 AnythingLLM的Docker部署及配置(实现公司内网共享智能体)](#2.3 AnythingLLM的Docker部署及配置(实现公司内网共享智能体))

-

- [2.3.1 离线安装Docker](#2.3.1 离线安装Docker)

- [2.3.1 离线部署AnythingLLM](#2.3.1 离线部署AnythingLLM)

- [2.3.2 配置](#2.3.2 配置)

1.个人电脑部署

核心流程:安装Ollama(运行模型的基础工具)→ 下载模型 → 安装Chatbox(可视化聊天界面)→ 配置Chatbox连接Ollama。

1.1 安装 Ollama

Ollama 官网地址:https://ollama.com/

Windows 版本下载地址:https://ollama.com/download

- 安装操作:双击下载的.exe文件,点击「下一步」「安装」,全程默认设置即可,安装完成后会自动启动Ollama。

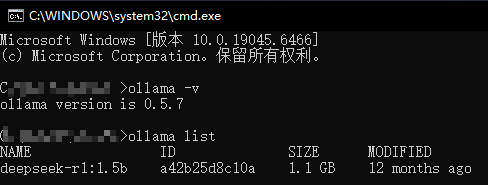

- 验证安装:安装完成后,打开电脑的「终端」(Windows按Win+R,输入cmd回车),输入命令「ollama -v」,按下回车,若显示版本号(如0.5.7),说明安装成功。

1.2 模型下载

Ollama 支持的模型:https://ollama.com/search 查询期望使用的模型,本次以最新的 qwen3.5 为例,进行模型搜索:

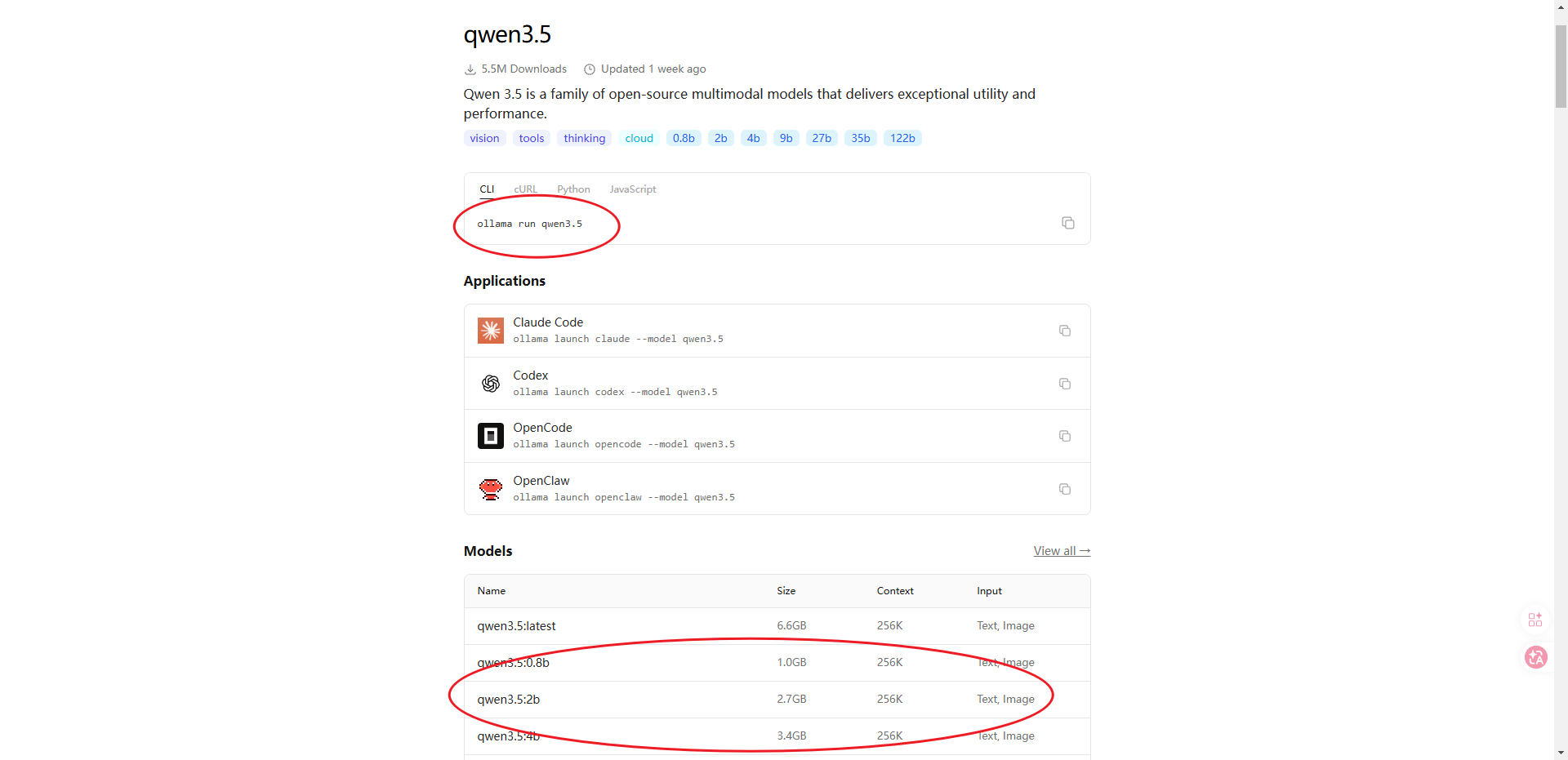

点击进入模型详情页面,根据需要安装完整或蒸馏模型,个人电脑无 GPU 可选择 3b 以下的小模型,有 GPU 可以选择稍大的模型,这里以 0.8b 模型为例:

- 保持终端打开,输入模型下载命令:「 ollama run qwen3.5:0.8b」

- 输入命令后按下回车,终端会显示下载进度(如百分比),下载过程中不要关闭终端,中断后可重新输入命令续传。

- 验证下载:下载完成后,输入命令「ollama list」,回车后若显示已下载的模型名称,说明模型下载成功。

提示:模型下载速度取决于网络,轻量模型(如1.5b、0.5b参数)约5-10分钟,较大模型(如8b参数)约15-20分钟。

1.3 可视化界面安装

可参考文件《客户端ChatBox、AnythingLLM、OpenWebUI安装》。

2. 内网服务器部署(离线)

核心流程:安装Ollama → 模型迁移 → Docker安装 → AnythingLLM部署及配置。

2.1 安装Ollama

将官网下载的 Linux 安装文件上传服务器。

2.1.1 解压

bash

# 解压

sudo tar -C /usr -xzf ollama-linux-amd64.tgz使用 lscpu查看 CPU 核心数:

bash

# 查询命令

lscpu

# 输出结果

架构: x86_64

CPU 运行模式: 32-bit, 64-bit

Address sizes: 46 bits physical, 48 bits virtual

字节序: Little Endian

CPU: 40

在线 CPU 列表: 0-392.1.2 添加启动脚本

在服务器上添加startOllama.sh文件,内容如下:

bash

# 根据查询的CPU核心数进行参数调整

export OMP_NUM_THREADS=40

export OLLAMA_NUM_THREADS=40

export OLLAMA_NUM_PARALLEL=0

export OLLAMA_KEEP_ALIVE="2h"

export OLLAMA_MODELS=/root/.ollama/models

export OLLAMA_FLASH_ATTENTION=1

export OLLAMA_HOST=0.0.0.0:11434

nohup ollama serve >> serve.log 2>&1 &- 变量说明

- OLLAMA_DEBUG(显示额外的调试信息)

bash

# 没有开启

export OLLAMA_DEBUG=1- OLLAMA_HOST(指定 ollama 服务器的 IP 地址和端口,默认为 127.0.0.1:11434)

bash

export OLLAMA_HOST=0.0.0.0:11434- OLLAMA_KEEP_ALIVE(设置模型在内存中保持加载的时间,默认为 5m)

bash

export OLLAMA_KEEP_ALIVE="2h"- OLLAMA_MAX_LOADED_MODELS(指定每个 GPU 上可以同时加载的最大模型数)

- OLLAMA_MAX_QUEUE(设置允许排队的最大请求数量)

- OLLAMA_MODELS(指定存储模型的目录路径)

- OLLAMA_NUM_PARALLEL(设置允许同时处理的最大并行请求数量)

- OLLAMA_NOPRUNE(禁用启动时清理模型 blob 文件的功能)

- OLLAMA_ORIGINS(指定允许的跨域请求来源,以逗号分隔)

bash

export OLLAMA_ORIGINS="http://example.com,https://localhost"- OLLAMA_SCHED_SPREAD(强制将模型均匀分配到所有 GPU 上)

- OLLAMA_FLASH_ATTENTION(启用 Flash Attention,加速注意力机制)

- OLLAMA_KV_CACHE_TYPE(设置 K/V 缓存的量化类型,默认为 f16)

bash

export OLLAMA_KV_CACHE_TYPE="q4_0"- OLLAMA_LLM_LIBRARY(指定 LLM 库以绕过自动检测)

- OLLAMA_GPU_OVERHEAD(为每个 GPU 预留一部分 VRAM,以字节为单位)

- OLLAMA_LOAD_TIMEOUT(设置模型加载的最大等待时间,默认为 5m)

bash

export OLLAMA_LOAD_TIMEOUT="10m"2.1.3 启动服务

bash

# 赋权

chmod +x startOllama.sh

# 启动

./startOllama.sh启动后可查看 serve.log日志信息,也可使用 「ollama -v」验证安装。

2.2 模型迁移

前提 :已在个人电脑(或其他联网设备)下载好所需模型。以 deepseek-r1:1.5b 为例,完整流程如下。

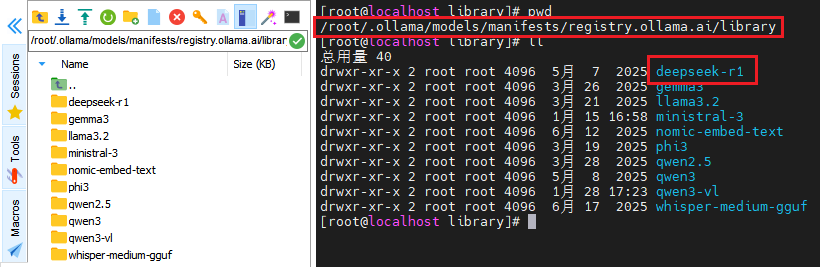

2.2.1 注册文件

Windows 安装后模型目录默认为 C:\Users\userName\.ollama\models\manifests Linux 的默认目录为 /root/.ollama/models/manifests

将 manifests 文件夹下的 registry.ollama.ai/library/deepseek-r1/1.5b 连同目录结构迁移到目标服务的相同目录下。

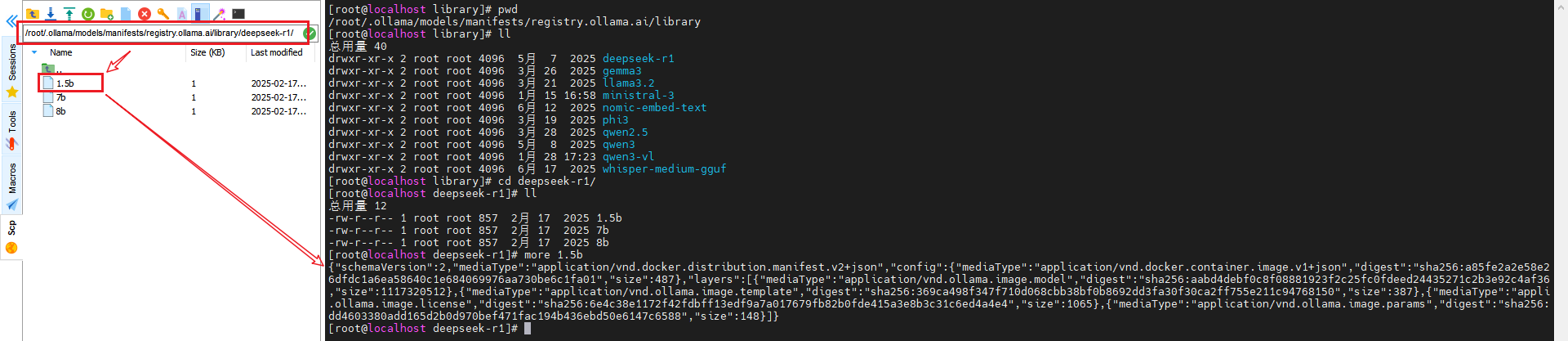

2.2.2 模型文件迁移

查看 deepseek-r1:1.5b 对应的 digest文件信息,其内容如下:

json

{

"config": {

"digest": "sha256:a85fe2a2e58e2426116d3686dfdc1a6ea58640c1e684069976aa730be6c1fa01",

"mediaType": "application/vnd.docker.container.image.v1+json",

"size": 487

},

"layers": [

{

"digest": "sha256:aabd4debf0c8f08881923f2c25fc0fdeed24435271c2b3e92c4af36704040dbc",

"mediaType": "application/vnd.ollama.image.model",

"size": 1117320512

},

{

"digest": "sha256:369ca498f347f710d068cbb38bf0b8692dd3fa30f30ca2ff755e211c94768150",

"mediaType": "application/vnd.ollama.image.template",

"size": 387

},

{

"digest": "sha256:6e4c38e1172f42fdbff13edf9a7a017679fb82b0fde415a3e8b3c31c6ed4a4e4",

"mediaType": "application/vnd.ollama.image.license",

"size": 1065

},

{

"digest": "sha256:f4d24e9138dd4603380add165d2b0d970bef471fac194b436ebd50e6147c6588",

"mediaType": "application/vnd.ollama.image.params",

"size": 148

}

],

"mediaType": "application/vnd.docker.distribution.manifest.v2+json",

"schemaVersion": 2

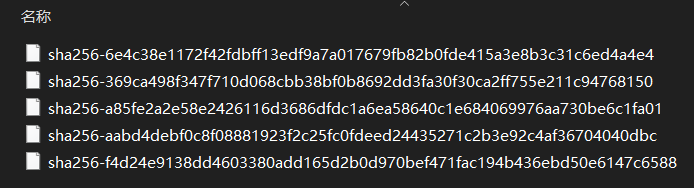

}在目录 /root/.ollama/models/blobs下找到对应的 sha256文件(5 个),迁移到目标服务的相同目录下。

在目标服务器使用命令查看模型列表:

plain

ollama ls

NAME ID SIZE MODIFIED

deepseek-r1:1.5b a42b25d8c10a 1.1 GB 49 minutes ago可以看到模型已经迁移成功了。

2.3 AnythingLLM的Docker部署及配置(实现公司内网共享智能体)

2.3.1 离线安装Docker

上传安装文件 docker-20.10.13.tgz到服务器后执行以下 6 步:

bash

# (1/6): 解压Docker安装文件

tar -zxvf docker-20.10.13.tgz

# (2/6): 迁移Docker文件

mv docker/* /usr/bin/

bash

# (3/6): 将Docker添加到service服务

cat <<'EOF' > /etc/systemd/system/docker.service

[Unit]

Description=Docker Application Container Engine

Documentation=https://docs.docker.com

After=network-online.target firewalld.service

Wants=network-online.target

[Service]

Type=notify

ExecStart=/usr/bin/dockerd

ExecReload=/bin/kill -s HUP $MAINPID

TimeoutSec=0

RestartSec=2

Restart=always

StartLimitBurst=3

StartLimitInterval=60s

LimitNOFILE=infinity

LimitNPROC=infinity

LimitCORE=infinity

TasksMax=infinity

Delegate=yes

KillMode=process

[Install]

WantedBy=multi-user.target

EOF

# 执行命令

systemctl daemon-reload

bash

# (4/6): 开启开机自启并首次启动Docker

systemctl enable docker.service

systemctl start docker

# (5/6): 查看Docker状态

systemctl status docker

# (6/6): 查询Docker版本

docker version2.3.1 离线部署AnythingLLM

前提:已在个人电脑(或其他联网设备)拉取镜像并导出成 tar 文件,将镜像文件上传到服务器。

bash

# 使用国内镜像源拉取镜像

docker pull docker.1ms.run/mintplexlabs/anythingllm:latest

# 将镜像导出成tar文件

docker save docker.1ms.run/mintplexlabs/anythingllm:latest -o anythingllm.tar- 创建存储目录:用于存储AnythingLLM的配置和数据。

bash

mkdir -p /opt/anythingllm- 设置目录权限:避免权限不足导致部署失败。

bash

chown -R 1000:1000 /opt/anythingllm && chmod -R 755 /opt/anythingllm- 导入镜像文件

bash

# 导入镜像

docker load -i anythingllm.tar- 启动 AnythingLLM

bash

# 启动容器

docker run -d \

--name anythingllm \

-p 3001:3001 \

--network host \

-v /opt/anythingllm:/app/server/storage \

-e STORAGE_DIR="/app/server/storage" \

-e OLLAMA_BASE_URL="http://127.0.0.1:11434" \

--restart always \

docker.1ms.run/mintplexlabs/anythingllm- 验证部署

bash

# 查看进程

docker ps

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

741794bc32ea docker.1ms.run/mintplexlabs/anythingllm "/bin/bash /usr/loca..." 7 minutes ago Up 3 minutes (healthy) anythingllm

# 查看日志

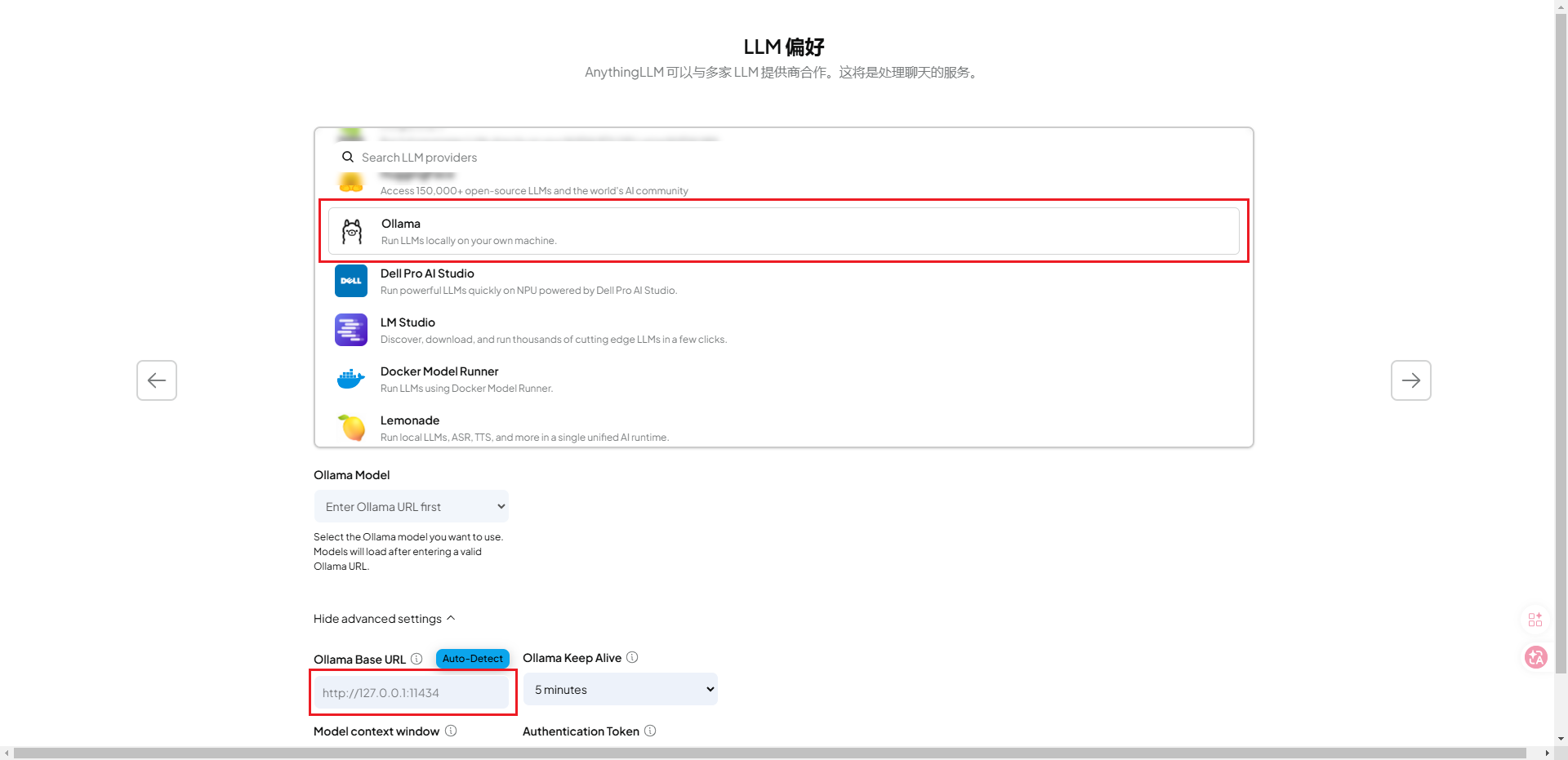

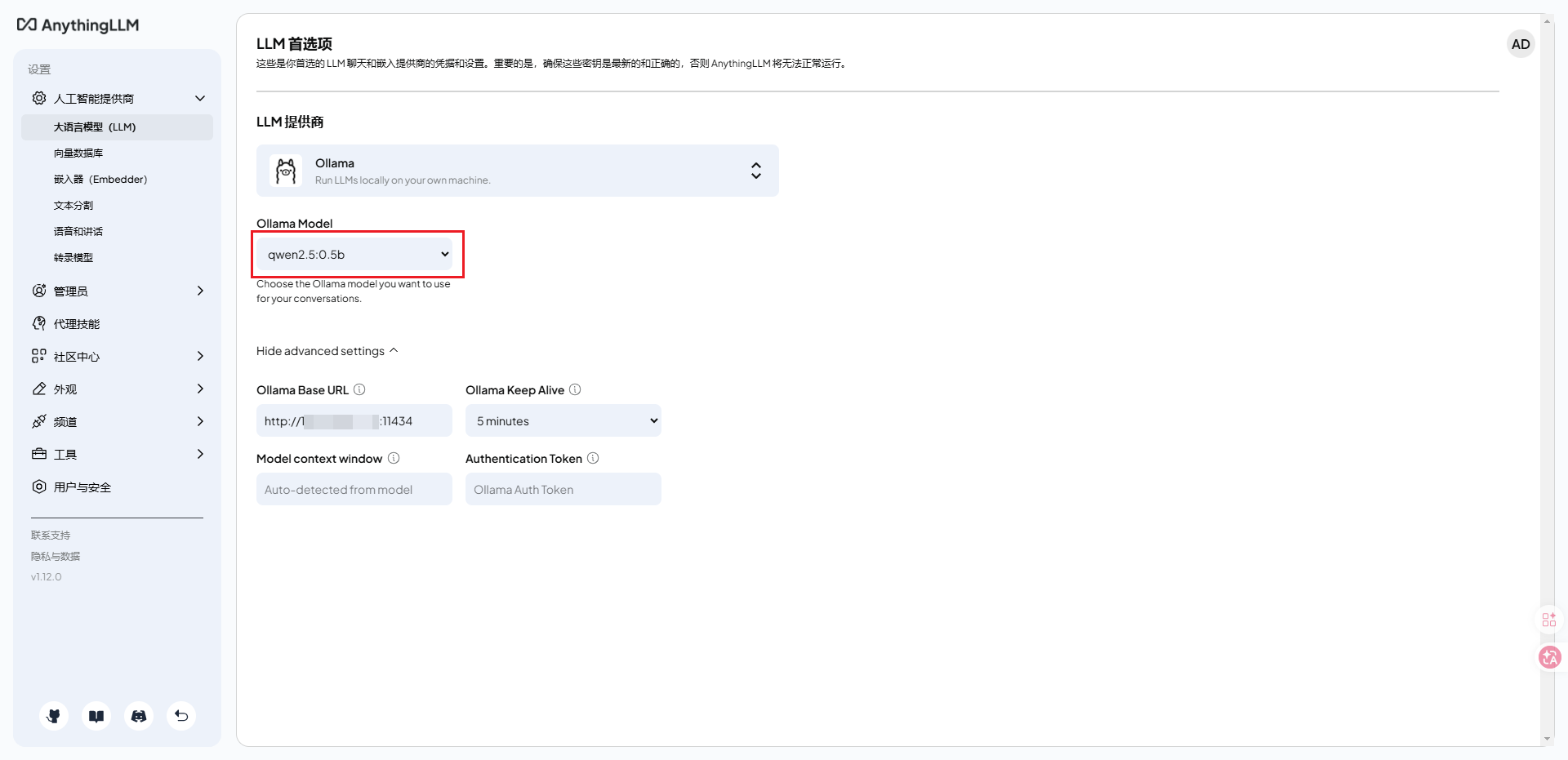

docker logs -f --tail=100 741794bc32ea2.3.2 配置

- 访问AnythingLLM界面:在公司内网的任意一台电脑上,打开浏览器,输入「服务器内网IP:3001」(如192.168.1.100:3001),即可进入AnythingLLM 初始化界面。

- 设置 Ollama 服务 URL。

- 验证配置:返回AnythingLLM主界面,创建新对话,输入任意问题,若能正常收到回复,说明配置成功。

此时公司内网所有电脑,只要输入「服务器内网IP:3001」,即可访问智能体,实现全员共享。