概述

1、介绍

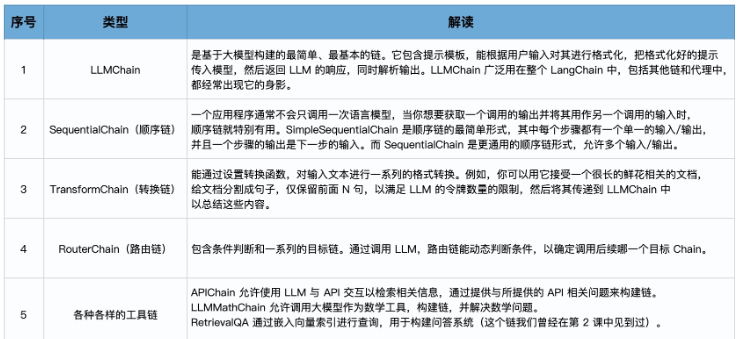

LangChain 中提供了很多种类型的预置链,目的是使各种各样的任务实现起来更加方便、规范。

2、链的调用方式

链有很多种调用方式。

(1)直接调用

(2)通过 run 方法

(3)通过 predict 方法

(4)通过 apply 方法

(5)通过 generate 方法

备注:这几个API在最新的版本中已经废弃。对于chain,官方现在更推荐的是 Runnable 风格,也就是这种:

chain = prompt | model | parser一、最简单的链

1、介绍

LLMChain 围绕着语言模型推理功能又添加了一些功能,整合了 PromptTemplate、语言模型(LLM 或聊天模型)和 Output Parser,相当于把 Model I/O 放在一个链中整体操作。它使用提示模板格式化输入,将格式化的字符串传递给 LLM,并返回 LLM 输出。

2、用法

举例来说,如果我想让大模型告诉我某种花的花语,如果不使用链,代码如下:

#----第一步 创建提示

# 导入LangChain中的提示模板

from langchain import PromptTemplate

# 原始字符串模板

template = "{flower}的花语是?"

# 创建LangChain模板

prompt_temp = PromptTemplate.from_template(template)

# 根据模板创建提示

prompt = prompt_temp.format(flower='玫瑰')

# 打印提示的内容

print(prompt)

#----第二步 创建并调用模型

# 导入LangChain中的OpenAI模型接口

from langchain import OpenAI

# 创建模型实例

model = OpenAI(temperature=0)

# 传入提示,调用模型,返回结果

result = model(prompt)

print(result)输出:

玫瑰的花语是?

爱情、浪漫、美丽、永恒、誓言、坚贞不渝。

此时 Model I/O 的实现分为两个部分,提示模板的构建和模型的调用独立处理。如果使用链,代码结构则显得更简洁。

# 导入所需的库

from langchain import PromptTemplate, OpenAI, LLMChain

# 原始字符串模板

template = "{flower}的花语是?"

# 创建模型实例

llm = OpenAI(temperature=0)

# 创建LLMChain

llm_chain = LLMChain(

llm=llm,

prompt=PromptTemplate.from_template(template))

# 调用LLMChain,返回结果

result = llm_chain("玫瑰")

print(result)输出:

{'flower': '玫瑰', 'text': '\n\n爱情、浪漫、美丽、永恒、誓言、坚贞不渝。'}

注意:对于chain,官方现在更推荐的是 Runnable 风格,也就是这种:

chain = prompt | model | parser二、顺序链

1、介绍

2、用法

(1)老版本

# 设置OpenAI API密钥

import os

os.environ["OPENAI_API_KEY"] = '你的OpenAI API Key'

from langchain.llms import OpenAI

from langchain.chains import LLMChain

from langchain.prompts import PromptTemplate

from langchain.chains import SequentialChain

# 这是第一个LLMChain,用于生成鲜花的介绍,输入为花的名称和种类

llm = OpenAI(temperature=.7)

template = """

你是一个植物学家。给定花的名称和类型,你需要为这种花写一个200字左右的介绍。

花名: {name}

颜色: {color}

植物学家: 这是关于上述花的介绍:"""

prompt_template = PromptTemplate(input_variables=["name", "color"], template=template)

introduction_chain = LLMChain(llm=llm, prompt=prompt_template, output_key="introduction")

# 这是第二个LLMChain,用于根据鲜花的介绍写出鲜花的评论

llm = OpenAI(temperature=.7)

template = """

你是一位鲜花评论家。给定一种花的介绍,你需要为这种花写一篇200字左右的评论。

鲜花介绍:

{introduction}

花评人对上述花的评论:"""

prompt_template = PromptTemplate(input_variables=["introduction"], template=template)

review_chain = LLMChain(llm=llm, prompt=prompt_template, output_key="review")

# 这是第三个LLMChain,用于根据鲜花的介绍和评论写出一篇自媒体的文案

template = """

你是一家花店的社交媒体经理。给定一种花的介绍和评论,你需要为这种花写一篇社交媒体的帖子,300字左右。

鲜花介绍:

{introduction}

花评人对上述花的评论:

{review}

社交媒体帖子:

"""

prompt_template = PromptTemplate(input_variables=["introduction", "review"], template=template)

social_post_chain = LLMChain(llm=llm, prompt=prompt_template, output_key="social_post_text")

# 这是总的链,我们按顺序运行这三个链

overall_chain = SequentialChain(

chains=[introduction_chain, review_chain, social_post_chain],

input_variables=["name", "color"],

output_variables=["introduction","review","social_post_text"],

verbose=True)

# 运行链,并打印结果

result = overall_chain({"name":"玫瑰", "color": "黑色"})

print(result)(2)新版本

伪代码:

introduction_chain = introduction_prompt | llm | StrOutputParser()

review_chain = review_prompt | llm | StrOutputParser()

social_post_chain = social_post_prompt | llm | StrOutputParser()

overall_chain = (

RunnablePassthrough()

.assign(introduction=introduction_chain)

.assign(review=review_chain)

.assign(social_post_text=social_post_chain)

)

result = overall_chain.invoke({"name": "玫瑰", "color": "黑色"})输出

> Entering new chain...

> Finished chain.

{'name': '玫瑰', 'color': '黑色',

'introduction': '\n\n黑色玫瑰,这是一种对传统玫瑰花的独特颠覆,它的出现挑战了我们对玫瑰颜色的固有认知。它的花瓣如煤炭般黑亮,反射出独特的微光,而花蕊则是金黄色的,宛如夜空中的一颗星,强烈的颜色对比营造出一种前所未有的视觉效果。在植物学中,黑色玫瑰的出现无疑提供了一种新的研究方向,对于我们理解花朵色彩形成的机制有着重要的科学价值。',

'review': '\n\n黑色玫瑰,这不仅仅是一种花朵,更是一种完全颠覆传统的艺术表现形式。黑色的花瓣仿佛在诉说一种不可言喻的悲伤与神秘,而黄色的蕊瓣犹如漆黑夜空中的一抹亮色,给人带来无尽的想象。它将悲伤与欢乐,神秘与明亮完美地结合在一起,这是一种全新的视觉享受,也是一种对生活理解的深度表达。',

'social_post_text': '\n欢迎来到我们的自媒体平台,今天,我们要向您展示的是我们的全新产品------黑色玫瑰。这不仅仅是一种花,这是一种对传统观念的挑战,一种视觉艺术的革新,更是一种生活态度的象征。

这种别样的玫瑰花,其黑色花瓣宛如漆黑夜空中闪烁的繁星,富有神秘的深度感,给人一种前所未有的视觉冲击力。这种黑色,它不是冷酷、不是绝望,而是充满着独特的魅力和力量。而位于黑色花瓣之中的金黄色花蕊,则犹如星星中的灵魂,默默闪烁,给人带来无尽的遐想,充满活力与生机。

黑色玫瑰的存在,不仅挑战了我们对于玫瑰传统颜色的认知,它更是一种生动的生命象征,象征着那些坚韧、独特、勇敢面对生活的人们。黑色的花瓣中透露出一种坚韧的力量,而金黄的花蕊则是生活中的希望,二者的结合恰好象征了生活中的喜怒哀乐,体现了人生的百态。'}三、路由链

1、介绍

RouterChain,也叫路由链,能动态选择用于给定输入的下一个链。我们会根据用户的问题内容,首先使用路由器链确定问题更适合哪个处理模板,然后将问题发送到该处理模板进行回答。如果问题不适合任何已定义的处理模板,它会被发送到默认链。

2、用法

(1)老版本

# 构建两个场景的模板

flower_care_template = """你是一个经验丰富的园丁,擅长解答关于养花育花的问题。

下面是需要你来回答的问题:

{input}"""

flower_deco_template = """你是一位网红插花大师,擅长解答关于鲜花装饰的问题。

下面是需要你来回答的问题:

{input}"""

# 构建提示信息

prompt_infos = [

{

"key": "flower_care",

"description": "适合回答关于鲜花护理的问题",

"template": flower_care_template,

},

{

"key": "flower_decoration",

"description": "适合回答关于鲜花装饰的问题",

"template": flower_deco_template,

}]

# 初始化语言模型

from langchain.llms import OpenAI

import os

os.environ["OPENAI_API_KEY"] = '你的OpenAI Key'

llm = OpenAI()

# 构建目标链

from langchain.chains.llm import LLMChain

from langchain.prompts import PromptTemplate

chain_map = {}

for info in prompt_infos:

prompt = PromptTemplate(template=info['template'],

input_variables=["input"])

#print("目标提示:\n",prompt)

chain = LLMChain(llm=llm, prompt=prompt,verbose=True)

chain_map[info["key"]] = chain

# 构建路由链

from langchain.chains.router.llm_router import LLMRouterChain, RouterOutputParser

from langchain.chains.router.multi_prompt_prompt import MULTI_PROMPT_ROUTER_TEMPLATE as RounterTemplate

destinations = [f"{p['key']}: {p['description']}" for p in prompt_infos]

router_template = RounterTemplate.format(destinations="\n".join(destinations))

print("路由模板:\n",router_template)

router_prompt = PromptTemplate(

template=router_template,

input_variables=["input"],

output_parser=RouterOutputParser(),)

print("路由提示:\n",router_prompt)

router_chain = LLMRouterChain.from_llm(llm,

router_prompt,

verbose=True)

# 构建默认链

from langchain.chains import ConversationChain

default_chain = ConversationChain(llm=llm,

output_key="text",

verbose=True)

# 构建多提示链

from langchain.chains.router import MultiPromptChain

chain = MultiPromptChain(

router_chain=router_chain,

destination_chains=chain_map,

default_chain=default_chain,

verbose=True)

print(chain.run("如何为玫瑰浇水?"))