前端视频多模态数据编解码、传输与渲染全解析

在前端音视频开发中,视频多模态数据的处理是核心环节------从原始视频数据的编解码、网络传输,到最终在浏览器端的渲染展示,每一步都直接影响用户体验。尤其是多模态场景(如视频+音频+字幕、实时互动视频),对编解码效率、传输稳定性、渲染流畅度的要求更高。本文将从编解码(含帧信息解析)、传输协议、Video渲染三个核心模块展开,重点解决flv.js使用中"浏览器渲染帧数与视频实际帧数不一致"的高频问题,结合实战细节,帮前端开发者打通视频处理全流程。

-

核心通用版:前端 视频多模态数据 编解码 传输协议 渲染 实战详解

-

编解码专项版:前端 视频编解码 帧信息解析 VideoFrame API 实战

-

传输协议专项版:前端 视频传输协议 MOQ WebRTC HLS FLV 对比及应用

-

渲染专项版:前端 Video标签渲染 画布叠加 性能优化 WebGL

-

问题解决专项版:flv.js 浏览器渲染帧数 与视频实际帧数不一致 配置方案 避坑

优化说明:补充"实战""配置方案""避坑"等前端高频需求词,修正原提示词"MOQ、WebRTC、HIS、FLV"中"HIS"为行业通用的"HLS",明确帧信息解析、Video渲染等核心细节,避免搜索结果偏离前端场景。

二、前端视频多模态数据核心流程解析

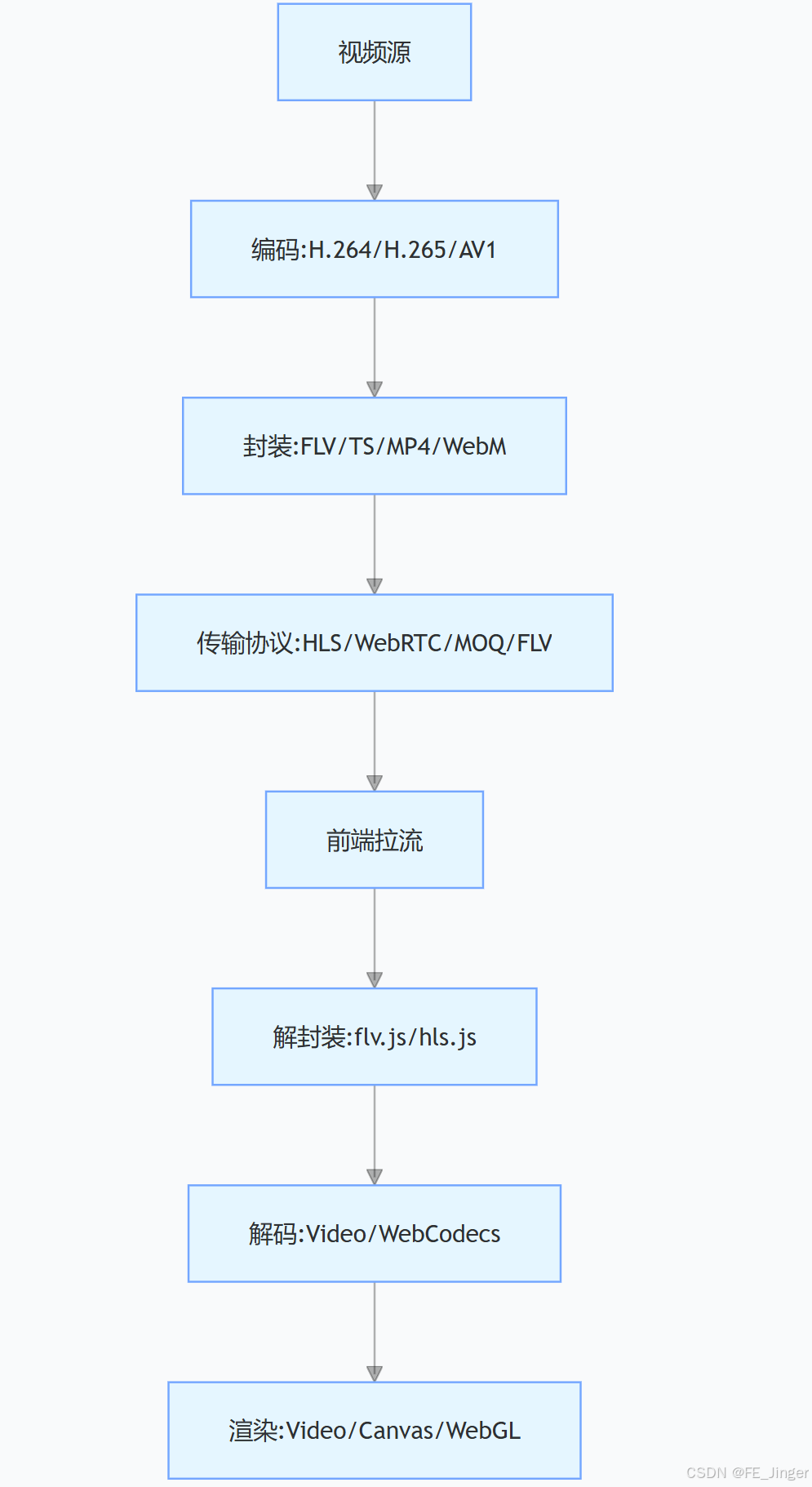

视频多模态数据,本质是"视频帧+音频帧+辅助数据(字幕、元信息等)"的组合,前端处理流程可概括为:原始数据 → 编码压缩 → 网络传输 → 解码解析 → 渲染展示,四个环节环环相扣,任一环节出问题都会导致播放异常。

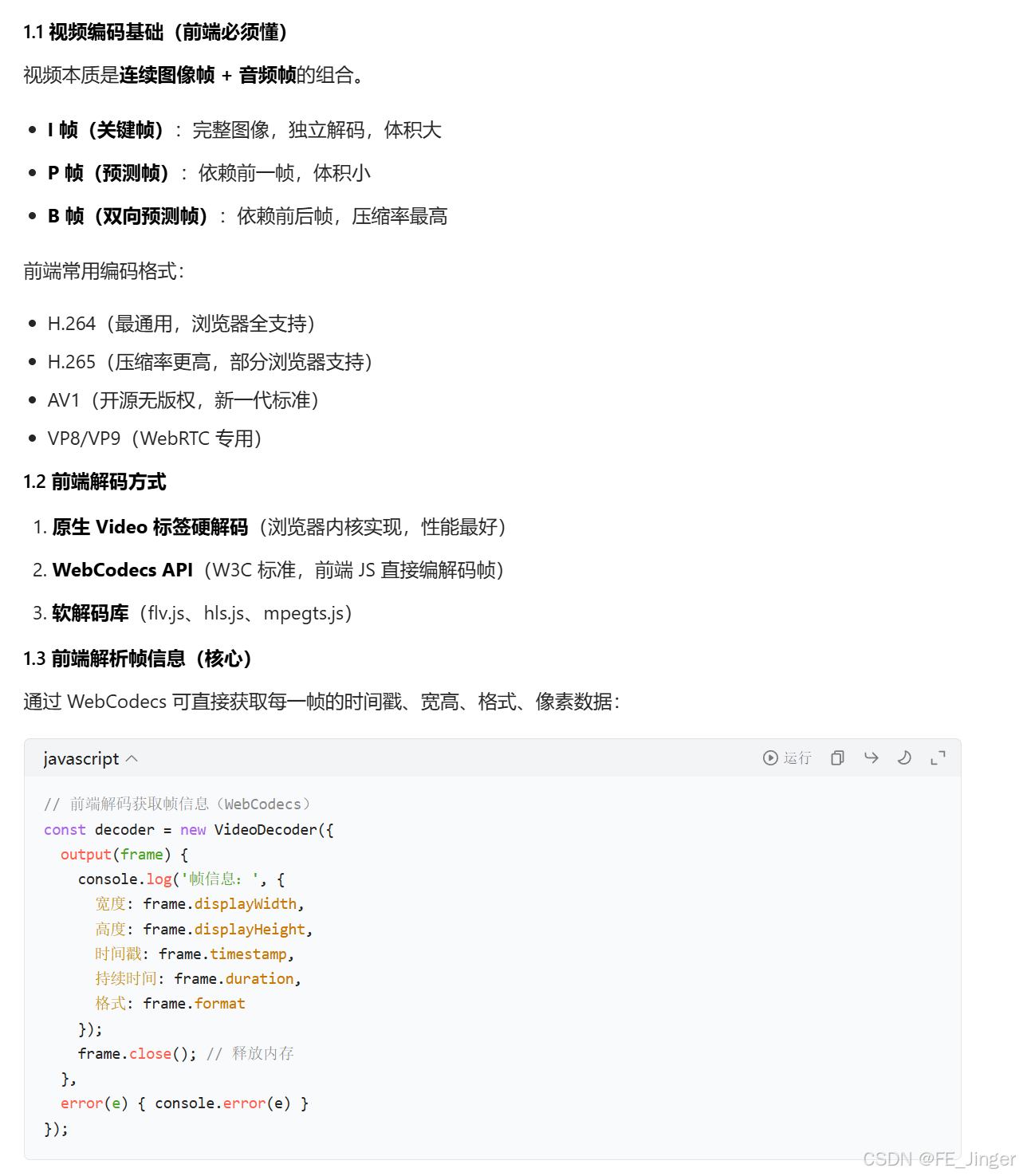

(一)编解码:多模态数据的"压缩与解密",解析帧信息是关键

编解码是视频处理的基础------编码负责将原始视频(超大体积、未压缩)压缩为可传输的二进制数据,解码负责将传输过来的压缩数据还原为可渲染的帧数据(视频帧、音频帧),而帧信息的解析则是衔接编解码与渲染的核心。

1. 核心编解码标准(前端常用)

前端编解码主要依赖浏览器原生支持或第三方库(如flv.js、ffmpeg.js),常用标准如下:

-

视频编码:H.264(最通用,兼容性强)、VP9(开源,压缩率高)、AV1(新一代开源标准,压缩效率优于H.264,帧头结构复杂需特殊解析);

-

音频编码:AAC(配合H.264使用最广泛)、Opus(低延迟,适合实时互动场景,WebRTC默认使用);

-

多模态扩展:字幕编码(SRT、ASS)、元数据编码(JSON格式嵌入视频流),需与音视频帧同步解析。

2. 帧信息解析(前端实战重点)

解码的核心目标之一,就是解析出视频帧的关键信息,为后续渲染提供依据。前端可通过两种方式解析帧信息:

方式1:使用WebCodecs API(浏览器原生,低级别控制)------ 这一API首次将底层编解码能力直接暴露给JavaScript,可直接操作VideoFrame、AudioData等原始帧对象,绕过video标签的"黑盒"限制,支持硬件加速编解码,零拷贝传递提升性能,适合需要自定义帧处理的场景(如AI推理、逐帧编辑)。

核心解析代码示例(获取帧信息):

javascript

// 1. 初始化解码器

const decoder = new VideoDecoder({

output: (frame) => {

// 解析帧信息

const frameInfo = {

width: frame.displayWidth, // 帧宽度

height: frame.displayHeight, // 帧高度

timestamp: frame.timestamp, // 帧时间戳(毫秒)

format: frame.format, // 帧格式(如I420、RGBA)

frameType: frame.type, // 帧类型(关键帧/非关键帧)

duration: frame.duration // 帧时长

};

console.log("解析到视频帧信息:", frameInfo);

// 渲染帧(后续渲染环节详解)

renderFrame(frame);

frame.close(); // 必须手动释放,避免内存泄漏

},

error: (e) => console.error("解码错误:", e)

});

// 2. 配置解码器(需传入编码格式,如H.264)

await decoder.configure({

codec: 'avc1.42001e', // H.264 Baseline

codedWidth: 1280,

codedHeight: 720

});方式2:使用第三方库(flv.js、mpegts.js)------ 无需手动处理解码细节,库内部已封装帧解析逻辑,可直接获取帧信息(适合快速开发,如视频播放场景)。

关键说明:帧信息中,时间戳(timestamp)、帧类型(I帧/P帧/B帧)、帧宽高是渲染同步的核心------I帧(关键帧)是画面完整帧,P帧、B帧依赖前一帧/后一帧,解析错误会导致画面卡顿、花屏;时间戳不一致会导致音视频不同步。

(二)传输协议:多模态数据的"网络通道",按需选择是关键

编码后的视频多模态数据,需通过网络传输到前端,不同传输协议的延迟、兼容性、带宽消耗差异较大,前端需根据场景(直播/点播、实时互动/非实时)选择合适的协议。以下是前端常用的4种视频传输协议(含原提示词中MOQ、WebRTC、FLV,修正HIS为HLS):

1. MOQ(Media Over QUIC):下一代低延迟传输协议

MOQ基于QUIC协议(运行在UDP之上),专为媒体传输设计,是下一代视联网的核心传输方案,IETF已成立工作组推进标准化。

-

核心特点:低延迟(0-RTT握手,首帧延迟降低50%以上)、内置TLS加密、多路复用(解决TCP队头阻塞)、连接迁移(网络切换无感知),支持发布/订阅模式和分层传输,结合CDN中继节点实现就近分发,大幅降低丢包率和带宽消耗。

-

前端应用场景:超高清直播、VR/AR沉浸式视频、实时互动场景(如万人直播、云游戏),目前需依赖第三方库或自定义实现,兼容性正在逐步完善(Chrome、Edge已支持基础功能)。

2. WebRTC:实时互动场景首选

WebRTC(Web Real-Time Communication)是浏览器原生支持的实时通信协议,无需插件,核心用于点对点(P2P)实时音视频传输,分层设计清晰,从底层传输到上层API全覆盖。

-

核心特点:低延迟(延迟可控制在100ms以内)、基于UDP传输、支持P2P直连(减少中间节点)、内置音视频编解码和加密(DTLS/SRTP),支持ICE穿透解决NAT问题,可传输视频、音频、自定义数据。

-

前端应用场景:视频通话、直播连麦、在线教育互动、远程控制,通过getUserMedia()获取音视频流,RTCPeerConnection建立连接,无需复杂配置。

3. HLS(HTTP Live Streaming):跨平台点播/直播通用

HLS是苹果提出的基于HTTP的自适应比特率流媒体协议,核心是将视频切片为TS片段,通过M3U8索引文件管理,客户端按需下载播放,兼容所有主流浏览器和移动设备(修正原提示词中"HIS"为行业标准"HLS")。

-

核心特点:兼容性极强(iOS、macOS原生支持,Android、Chrome需HLS.js辅助)、支持自适应码率(根据带宽动态切换清晰度)、基于HTTP传输(穿透防火墙/CDN友好),无需特殊服务器,部署成本低。

-

缺点:延迟较高(10-30s,取决于切片时长),不适合实时互动场景;切片机制会增加存储和请求开销。

-

前端应用场景:短视频点播、非实时直播(如赛事回放)、跨平台视频分发。

4. FLV(Flash Video):低延迟直播经典方案

FLV是Adobe推出的视频格式,基于HTTP传输(常称HTTP-FLV),延迟低于HLS(1-3s),曾是直播行业的主流方案,目前前端通过flv.js实现无Flash播放(Flash已淘汰)。

-

核心特点:延迟低、体积小、编码效率高,支持边传边播(流式播放),flv.js可将FLV格式转换为浏览器支持的MediaSource Extensions(MSE)格式,实现无插件播放。

-

缺点:兼容性略差(部分浏览器需降级处理),不支持自适应码率,目前逐步被MOQ、WebRTC替代,但在传统直播场景仍广泛使用。

-

前端应用场景:传统低延迟直播(如秀场直播、游戏直播),需配合flv.js使用。

协议选择总结(前端实战)

| 协议 | 延迟 | 兼容性 | 核心场景 |

|---|---|---|---|

| MOQ | 极低(毫秒级) | 中等(逐步完善) | 超高清直播、VR/AR、万人直播 |

| WebRTC | 低(<100ms) | 高(浏览器原生支持) | 视频通话、直播连麦、实时互动 |

| HLS | 高(10-30s) | 极高(全平台) | 点播、非实时直播、跨平台分发 |

| FLV | 中低(1-3s) | 中等(需flv.js) | 传统低延迟直播、游戏直播 |

(三)Video渲染:多模态数据的"最终展示",流畅度是核心

解码后的视频帧、音频帧,需在浏览器端渲染展示,前端渲染主要依赖标签和Canvas(多模态叠加场景),核心是保证"帧同步""流畅无卡顿"。

1. 基础渲染:标签渲染(简单场景)

最简洁的渲染方式,浏览器会自动处理解码后的帧数据,无需手动干预,支持原生播放控制(暂停、播放、进度条)。需注意以下细节,避免渲染异常:

-

标签属性配置:添加controls(显示控制栏)、playsinline(内联播放,避免iOS自动全屏)、preload(预加载策略,建议设为"auto"或"metadata");

-

格式兼容:原生支持MP4(H.264+AAC),FLV、HLS需配合对应库(flv.js、hls.js),通过MSE接口将非原生格式转换为浏览器可识别的格式;

-

渲染优化:设置video标签宽高与视频帧宽高一致,避免拉伸变形;启用硬件加速(浏览器默认开启,可通过CSS transform: translateZ(0)强制开启)。

核心代码示例:

html

<!-- 基础渲染 -->

<video

id="videoPlayer"

controls load="auto"

width="1280"

height="720"

>

2. 多模态叠加渲染(复杂场景)多模态场景(如视频+字幕、视频+实时标记、逐帧图像处理),需结合Canvas叠加渲染,核心是保证视频帧与叠加内容同步。需注意以下要点:Canvas与Video尺寸一致:将Canvas设置为与Video相同的宽高,通过CSS层叠定位覆盖在Video上方,避免叠加内容错位;帧同步机制:监听Video的play事件启动requestAnimationFrame(RAF)循环,仅在需逐帧同步绘制时使用RAF,避免盲目使用引入同步开销和卡顿------RAF不能驱动视频播放,仅用于协调视频帧与自定义绘制内容;逐帧处理优化:若需对每一帧做JS处理(如人脸识别),建议使用video.captureStream()获取MediaStream,搭配VideoFrame API在requestVideoFrameCallback中获取精确帧对象,避免漏帧或重复采样。核心代码示例(视频+字幕叠加):const video = document.getElementById('videoPlayer');

const canvas = document.getElementById('overlayCanvas');

const ctx = canvas.getContext('2d');

// 确保Canvas与Video尺寸一致

function resizeCanvas() {

canvas.width = video.videoWidth;

canvas.height = video.videoHeight;

}

video.addEventListener('loadedmetadata', resizeCanvas);

// 启动RAF循环,同步绘制字幕

function drawSubtitle() {

if (video.paused || video.ended || document.hidden) {

requestAnimationFrame(drawSubtitle);

return;

}

// 清空画布

ctx.clearRect(0, 0, canvas.width, canvas.height);

// 绘制字幕(根据当前时间戳匹配字幕内容)

const currentTime = video.currentTime;

const subtitle = getSubtitleByTime(currentTime); // 自定义函数,匹配字幕

if (subtitle) {

ctx.font = '24px Arial';

ctx.fillStyle = '#fff';

ctx.textAlign = 'center';

ctx.fillText(subtitle, canvas.width / 2, canvas.height - 30);

}

requestAnimationFrame(drawSubtitle);

}

// 视频播放时启动绘制

video.addEventListener('play', drawSubtitle);3. 渲染性能优化(前端必看)

-

避免频繁DOM操作:渲染过程中不频繁修改Video、Canvas属性,减少浏览器重排重绘;

-

跳过非可视帧:检查document.hidden,页面不可见时暂停RAF循环和视频播放,节省性能;

-

降低绘制压力:高分辨率视频可降低Canvas绘制分辨率,再用CSS缩放显示;避免在RAF回调中执行耗时操作(如DOM修改、复杂计算);

-

监控渲染状态:通过video.getVideoPlaybackQuality()检查丢帧情况(droppedVideoFrames),定位解码或渲染压力导致的卡顿问题。

三、高频问题:flv.js浏览器渲染帧数与视频实际帧数不一致(解决方案)

很多前端开发者在使用flv.js播放FLV视频时,会遇到"浏览器渲染帧数 < 视频实际帧数""画面卡顿、跳帧"的问题,核心原因是帧同步配置不当、解码缓冲策略不合理、视频编码参数异常,以下是具体解决方案(实战可直接复用)。

1. 先排查基础问题(必做)

首先确认视频文件本身无问题,避免因源文件导致的帧数异常:

-

用ffprobe工具查看视频实际帧数和帧率:执行命令

ffprobe -v quiet -show_entries stream=nb_frames,r_frame_rate,duration -of csv=p=0 your.flv,确认视频帧率(如30fps)和总帧数正常; -

检查视频编码参数:确保视频关键帧间隔(GOP)合理(建议2s@30fps,即-g 60),关键帧间隔过大会导致解码卡顿和帧数丢失;

-

验证flv.js版本:使用最新版flv.js(避免旧版本的解码bug),旧版本可能存在帧解析错误、缓冲策略不合理的问题。

2. 核心配置修改(解决帧数不一致的关键)

通过调整flv.js的配置参数,强制帧同步,减少帧数丢失,核心配置如下(关键参数已标注说明):

javascript

const flvPlayer = flvjs.createPlayer({

type: 'flv',

url: 'live.flv',

isLive: true, // 直播场景设为true,点播设为false(关键)

enableWorker: true, // 启用Web Worker解码,避免主线程阻塞(减少帧丢失)

enableStashBuffer: false, // 关闭缓冲池(直播场景,减少延迟,避免帧堆积)

stashInitialSize: 128, // 缓冲池初始大小(单位:KB),直播场景设小,点播设大(如512)

fixAudioTimestampGap: false, // 关闭音频时间戳修复,避免音视频同步导致的帧丢弃(关键)

autoCleanupSourceBuffer: true, // 自动清理SourceBuffer,避免内存泄漏导致的帧渲染异常

decodeFirstFrame: true, // 优先解码第一帧,确保渲染及时

lazyLoad: false, // 关闭懒加载,直播场景需实时加载帧数据

lazyLoadMaxDuration: 3 * 60, // 懒加载最大时长(点播场景用)

lazyLoadRecoverDuration: 30, // 懒加载恢复时长(点播场景用)

statisticsInfoReportInterval: 1000, // 每1s上报一次帧数统计,便于排查问题

}, {

enableLowLatencyMode: true, // 启用低延迟模式(直播场景关键,减少帧丢弃)

maxBufferLength: 1, // 最大缓冲长度(单位:s),直播场景设1-2s,避免缓冲过多导致帧丢失

maxMaxBufferLength: 3, // 最大缓冲上限,防止缓冲溢出

bufferBehind: 0.5, // 缓冲滞后阈值,低于该值触发帧丢弃保护

});3. 额外优化(进一步减少帧数差异)

-

监听帧渲染事件,手动校准帧数:通过flvPlayer的

frameRendered事件,统计渲染帧数,与视频实际帧数对比,若差异较大,调整缓冲参数; -

修复SourceBuffer异常:若控制台出现"Failed to read the 'buffered' property from 'SourceBuffer'"报错,在flv.js源码的mse-controller.js中,添加MediaSource合法性检查(入口处添加

if (!this._mediaSource || this._mediaSource.readyState !== 'open') { return; }); -

避免高频操作:不频繁调用flvPlayer.pause()、play(),避免中断帧渲染流程;不频繁修改video.currentTime,防止触发seek队列阻塞,导致帧撕裂和丢失;

-

浏览器兼容性处理:部分浏览器(如Safari)对MSE支持不完善,需降级为HLS格式,或使用flv.js的fallback方案。

4. 问题排查技巧

若配置后仍有帧数不一致,可通过以下方式排查:

-

查看控制台日志:flv.js默认输出debug日志,搜索"frame""drop"关键词,定位帧丢失原因(如"drop frame due to buffer full"表示缓冲满导致丢帧);

-

使用浏览器开发者工具:在Rendering面板勾选"FPS Meter"和"Paint Flashing",观察渲染帧率与视频实际帧率的差异;

-

降低视频码率:若视频码率过高,浏览器解码压力大,会导致帧丢失,可在服务端降低码率(如从1080P降至720P)。

四、总结与实战建议

前端视频多模态数据处理,核心是"编解码保效率、传输保稳定、渲染保流畅":

-

编解码:优先使用WebCodecs API实现自定义帧解析(复杂场景),简单场景用flv.js、hls.js封装库,注意释放帧对象避免内存泄漏;

-

传输协议:实时互动选WebRTC,低延迟直播选FLV,跨平台点播选HLS,下一代场景可尝试MOQ;

-

渲染:基础场景用标签,多模态叠加用Canvas+RAF,注意帧同步和性能优化;

-

问题解决:flv.js帧数不一致,核心是调整缓冲策略、关闭不必要的时间戳修复、启用低延迟模式,先排查视频源,再调整配置。

前端音视频开发涉及的细节较多,建议结合实际场景(直播/点播、实时/非实时),逐步调试优化,尤其是多模态场景,需重点关注帧同步和性能问题,避免因细节疏忽导致用户体验下降。

(注:文档部分内容可能由 AI 生成)