语音识别还是挺重要的,常用的比如现在语音输入法啊,需要将你说话的声音转成文字,再比如手机上各种智能助手,还有就是让龙虾可以听懂你发的语音(目前我是通过Whisper来实现的)但是这些大多数都需要依赖云端服务, 每次说话,数据要上传到服务器处理,再返回结果。这不仅受限于网络状况,还让隐私安全成为潜在隐患。

今天聊一个不一样的选择------Vosk。

什么是 Vosk?

image.png

image.png

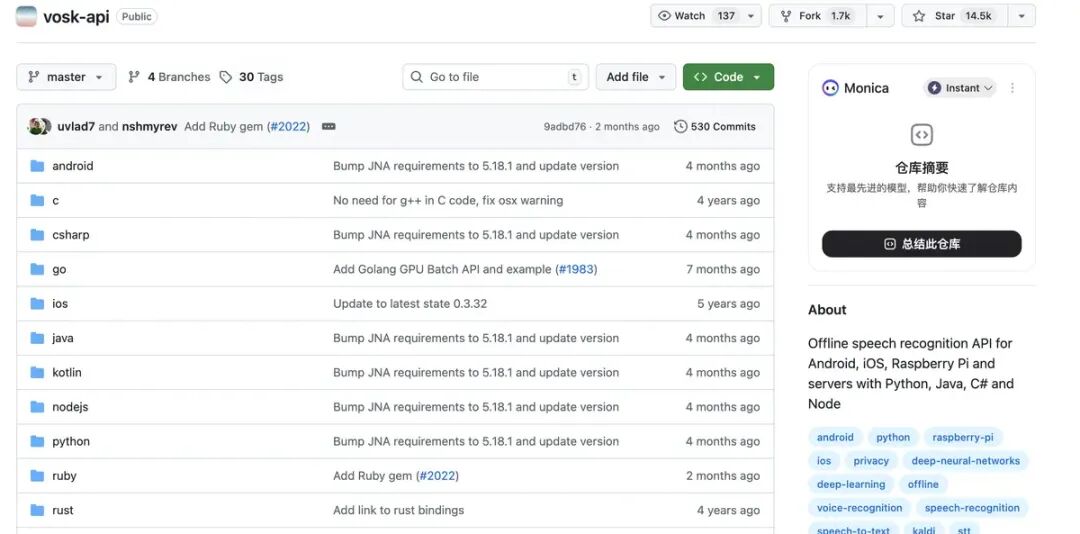

Vosk 是 Alpha Cephei 团队开发的开源离线语音识别工具包,目前在 GitHub 上已有 14.5k 星标,被 1.7k 个项目使用。它基于 Kaldi 语音识别引擎深度优化,核心理念是离线运行 和轻量化。

说人话就是:不需要联网,你的声音数据不用上传到任何服务器,全在本地完成识别。而且它能在树莓派、Android 手机这类低功耗设备上流畅跑起来。

有什么优点?

抛开那些技术术语,Vosk 有几个实实在在的优势:

完全离线,隐私安全。 医疗问诊、金融业务这类场景,语音数据往往涉及敏感信息。云端方案再好,数据上传这一步本身就让人不放心。Vosk 的所有处理都在本地完成,识别结果出来后,原始音频可以不留任何痕迹。

模型很小,要求不高。 小型模型压缩后只有 40-50MB,运行内存占用约 300MB。这意味着不用买昂贵的高配设备,一台树莓派 4B(4GB 内存)就能胜任。在树莓派上实测,单线程处理延迟低于 200ms,基本感觉不到卡顿。

支持 20 多种语言。 中文、英语、德语、法语、西班牙语、俄语、日语......官方提供的语言模型覆盖了全球主流语种。以中文为例,标准普通话测试准确率能达到 95% 以上。

跨平台,多语言 API。 无论你习惯用 Python、Java、Node.js、C#、Go 还是 Rust,都能找到对应的接口。平台方面,Windows、macOS、Linux、Android、iOS 都支持。

动态词汇调整。 医疗、工业这类垂直领域经常遇到生僻术语,普通模型识别不准。Vosk 允许运行时动态添加自定义词汇表,不用重新训练整个模型就能提升准确率。

和其他方案比怎么样?

有人可能会问:Vosk 和 Whisper 这类主流方案比,哪个更好?

简单说,各有侧重。Whisper 的准确率更高,但模型体积大,最低 1.55GB 起步,更适合服务器端部署。Vosk 走的是轻量路线,体积小、速度快,适合资源受限的设备。

在安卓设备上的实测数据显示,Vosk 的 APK 体积仅 15MB,内存峰值 80MB,平均识别延迟 120ms 左右。同场景下,Mozilla DeepSpeech 的 APK 体积是 120MB,延迟 350ms。Vosk 在资源占用和响应速度上的优势很明显,适合嵌入式设备和实时交互场景。

核心功能一览

除了基本的语音转文字,Vosk 还提供了几个实用的功能:

-

流式识别:边说话边出结果,不用等整句话说完才开始处理。每 200ms 左右触发一次识别计算,保证了低延迟的交互体验。

-

说话人识别:不止能识别内容,还能区分是谁在说话。这在多人对话场景下非常实用。

-

自定义词表:行业术语、品牌名、生僻人名,都可以通过动态词表配置来提升识别准确率。

-

模型灵活切换:支持在小型模型(50MB 左右)和大型高精度模型(1GB 以上)之间按需选择。小模型跑在移动设备上,大模型部署在服务器端,两者互不冲突。

快速上手

以 Python 为例,整个安装过程很简单:

go

pip3 install vosk

#或

pip3 install https://github.com/alphacep/vosk-api/releases/download/v0.3.42/vosk-0.3.42-py3-none-linux_riscv64.whl然后从官方模型页面下载你需要的语言模型,比如中文模型。解压后,几行代码就能实现麦克风实时识别:

go

from vosk import Model, KaldiRecognizer

import pyaudio

model = Model("path/to/your/model")

recognizer = KaldiRecognizer(model, 16000)

p = pyaudio.PyAudio()

stream = p.open(format=pyaudio.paInt16, channels=1, rate=16000,

input=True, frames_per_buffer=8000)

while True:

data = stream.read(4000)

if recognizer.AcceptWaveform(data):

print(recognizer.Result())这段代码从麦克风采集音频,实时输出识别结果。识别结果以 JSON 格式返回,包含文本内容、置信度、时间戳等信息,方便进一步处理。

如果是处理已有的音频文件,代码也差不多,把音频流换成 wave.open 读取文件就行。

典型应用场景

Vosk 适合哪些场景?举几个例子:

智能音箱和语音助手。 在家里不用联网也能语音控制,没有云端延迟,也不担心隐私问题。

车载系统。 进隧道或偏远地区没信号,导航和语音控制照样能用。测试显示,在 80km/h 高速行驶噪音下,识别准确率仍能保持在 90% 以上。

医疗病历转录。 医生口述病历实时转成结构化文本,敏感数据全程不上传云端。某三甲医院通过定制医疗术语词典,显著提升了专业词汇的识别准确率。

会议和课堂实时字幕。 教师授课内容实时生成双语字幕,帮助听障学生更好地参与课堂。

工业设备语音控制。 操作人员通过语音指令调整设备参数,无需手动输入。某汽车工厂应用后,设备操作时间从平均 12 秒缩短至 4 秒,误操作率下降了 75%。

一些有用的资源

-

GitHub 仓库:https://github.com/alphacep/vosk-api

-

许可证:Apache 2.0,对商业使用友好

写在最后

语音识别技术发展到今天,云端方案已经非常成熟。但在某些场景下,离线、轻量、隐私保护才是真正的刚需。Vosk 恰好填补了这个空白,让开发者可以用更低的成本,把语音交互能力集成到更多设备中。

如果你手头正好有需要离线语音识别的项目,不妨试试这个工具。 如果你暂时不需要,建议你收藏起来,说不定就用到了那,防止哪天用到了,找不到这个项目了。