大家好,我是子昕。

同样的模型,别人的 Agent 能跑到 95% 成功率,自己的总在 70% 上下摇摆------问题出在哪里?

最近看到 Youtube 一个讲解《最近爆火的 Harness Engineering 到底是个啥?》视频。

看完之后,我更加确定了一件事:

AI 工程的瓶颈,已经不在模型本身,而在模型之外。

这篇文章,是我在原视频基础上的一次"再理解"。

如果你最近在做 Agent,或者关注 AI 应用落地,这件事,可能会直接影响你接下来半年的方向。

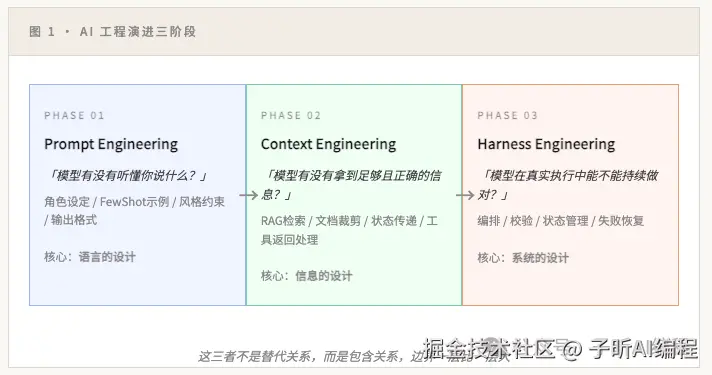

一、三次中心迁移:从 Prompt 到 Harness

过去两年,AI 工程经历了三次明显的重心转移。

表面上是换了几个新名词,实质上对应了 AI 系统发展的三个阶段性问题:

阶段一:Prompt Engineering------把话说明白

大模型本质上是一个对上下文高度敏感的概率生成系统。

你给它什么身份,它就沿着那个身份回答;你给它什么样例,它就沿着那个范式补全。

所以 Prompt Engineering 的本质,不是"驯服"模型,而是:

塑造一个局部的概率空间。

这个阶段的核心能力是语言的设计,不是系统的设计。

阶段二:Context Engineering------把信息给对

当 Agent 开始流行,模型不再只是回答问题,而是进入真实环境执行任务。

这时候,一个关键变化出现了:

模型未必知道所有事实,系统必须在正确时机把正确信息送进去。

工程意义上的 Context,其实是:

- 用户输入

- 历史对话

- 检索结果(RAG)

- 工具返回

- 当前任务状态

- 中间产物

- 系统规则

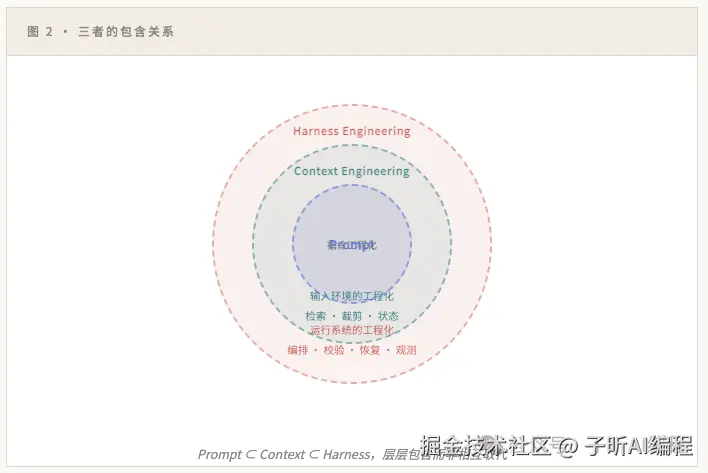

👉 Prompt 只是 Context 的一个子集。

成熟的上下文工程关注的远不止检索本身,还包括:文档怎么切块、结果怎么排序、长文怎么压缩、历史对话何时保留何时摘要、多个 Agent 之间传原文还是结构化字段......

真正的难点在于:

不是"给得更多",而是"给得刚刚好(按需给、分层给、在正确时机给)"。

这也是近年来"Agent Skills"(渐进式披露)概念走红的底层逻辑:先只给最少量的索引信息,当 Agent 真正触发某项能力时,再把详细的 SOP 和参考资料动态注入。

这也是为什么:

- 长上下文不一定更好

- RAG(Context Engineering 的典型实践之一) 也经常"越做越乱"

阶段三:Harness Engineering------让系统跑稳

前两步解决的是:

- Prompt:表达意图

- Context:提供信息

但复杂任务里还有一个更难的问题:

模型一旦开始连续执行,谁来监督它、约束它、纠偏它?

Harness 这个词,原意是"缰绳、马具、约束装置"。

放到 AI 里,它其实在强调一件很朴素的事情:

模型不是用来"放养"的,而是需要被"驾驭"的。

一个非常关键的理解是:

Agent = Model + Harness

Harness = Agent − Model\

👉 换句话说:

除了模型本身以外,所有决定它是否稳定的东西,都属于 Harness。

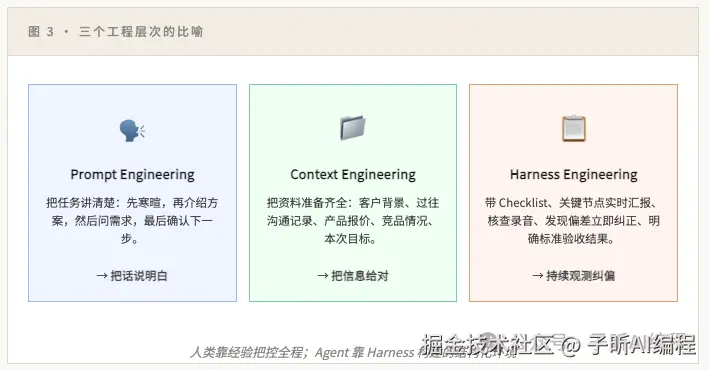

二、一个更直观的比喻

可以把这三层理解成:

👉 派一个新员工去见客户

- Prompt:你跟他说"表现专业一点"

- Context:你给他客户资料、背景信息

- Harness:你安排流程、设检查点、出错能兜底

👉 真正决定结果的,往往不是他说什么,而是:

公司有没有一套机制,保证他不会搞砸。

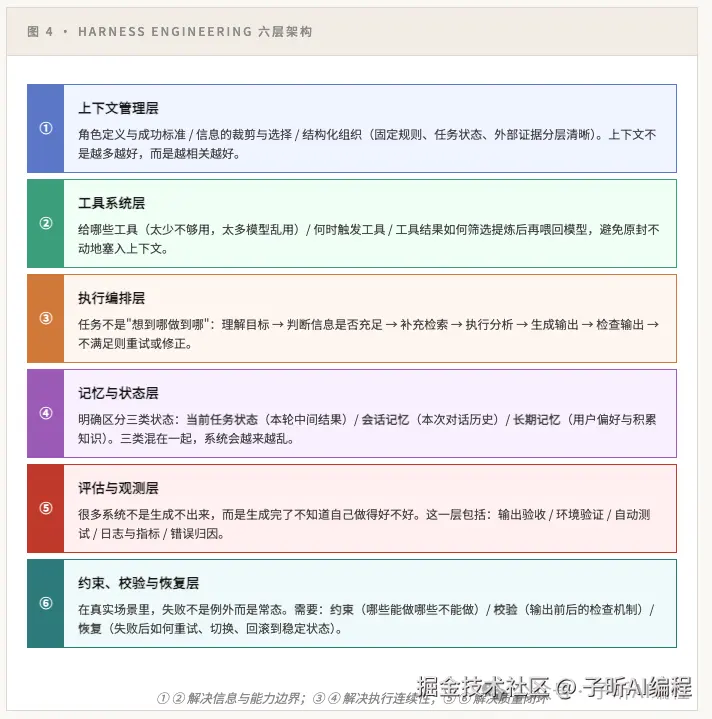

三、成熟 Harness 的六个层次

一个工业级的 Harness 系统,通常可以拆解成六层:

但这里我给你一个更"工程化"的理解方式:

Harness 本质上 = 调度 + 约束 + 纠偏

它解决的,不是"聪不聪明",而是:

- 稳不稳定

- 可不可控

- 能不能复用

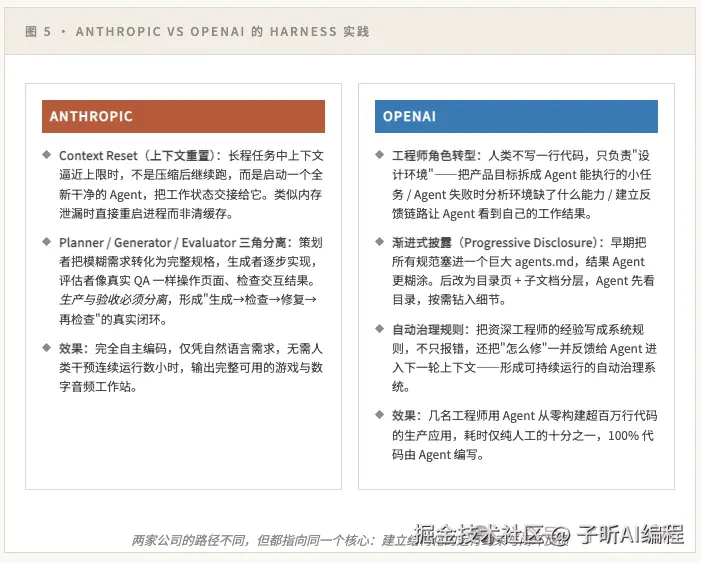

四、一线公司的真实实践

Harness 之所以最近突然火,不是因为概念,而是因为:

👉 一线公司已经在这么干了。

比如:

- Anthropic 的 Agent 设计

- OpenAI 的工具调用体系

本质都在做一件事:

把"不确定的模型行为",包裹在"确定的系统结构"里。

这里有一个非常关键的工程原则:

当 Agent 出问题时,解决方案几乎从来不是"让模型更努力",

而是:在 Harness 层补结构。

五、总结:什么时候你必须考虑 Harness?

这三种范式,其实对应三个阶段:

- 任务是简单的单轮生成 → Prompt 是关键

- 任务开始依赖外部知识、需要多步推理 → Context 变得关键

- 模型进入长链路、低容错的真实执行场景 → Harness 几乎不可避免

👉 也就是说:

只要你的系统开始"跑流程",Harness 就已经不可避免了。

最后给你一个判断标准:

如果你现在的系统出现:

- 成功率不稳定

- 偶尔"抽风"

- 很难 debug

- 改一个地方,全局崩

👉 那基本可以确定:

问题不在模型,而在 Harness。

写在最后

AI 落地的核心挑战,正在发生一个变化:

从"让模型更聪明"→ 到"让模型稳定工作"

这也是为什么:

同样的模型,不同产品表现差距巨大。

最后一句话总结:

决定你能不能做出 Demo 的,是模型;

决定你能不能做成产品的,是 Harness。

更多内容,欢迎关注微信公众号【子昕AI编程】~