Cosmos

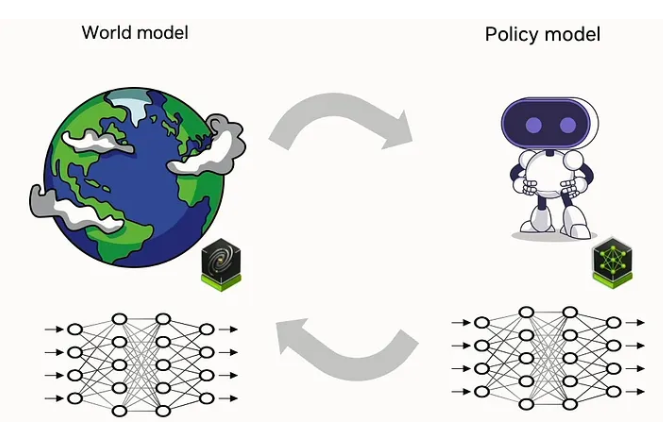

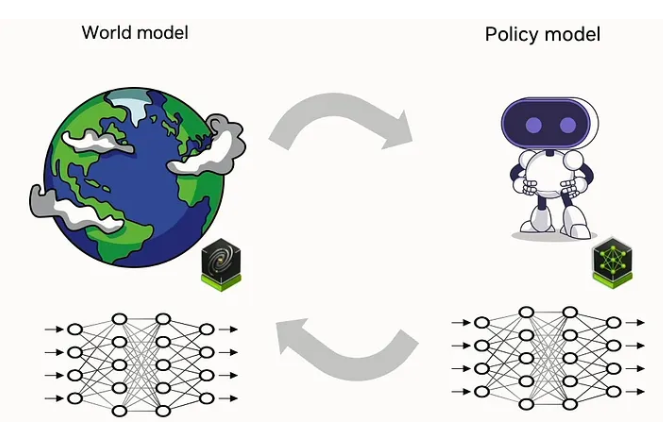

Cosmos 是 NVIDIA 开源的世界模型平台。世界基础模型(World Foundation Model,以下简称 WFM)可视为策略模型(例如 GROOT N1)与之交互、用于学习或评估的环境。

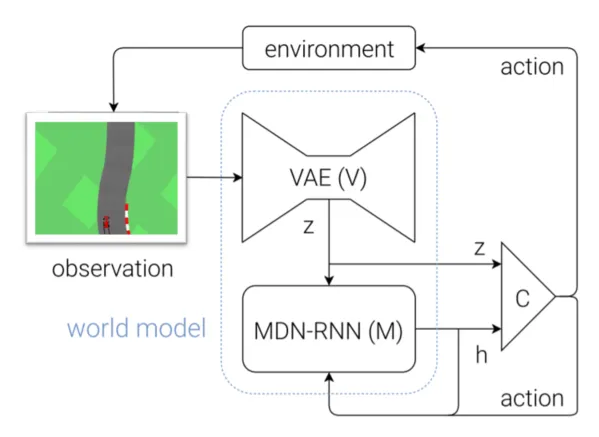

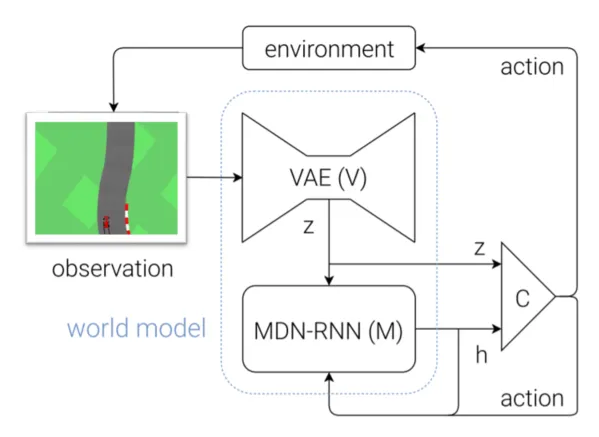

如下图所示,控制器C (即强化学习中的行动者 )若同时参照环境观察 与世界模型 的预测结果(即下文将提及的Cosmos Predict),已被证实能够获得更好的训练效果。

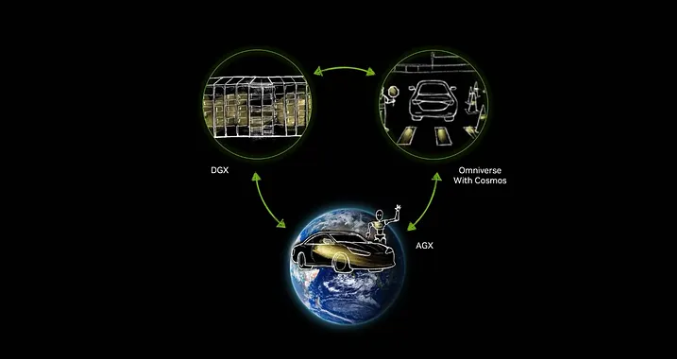

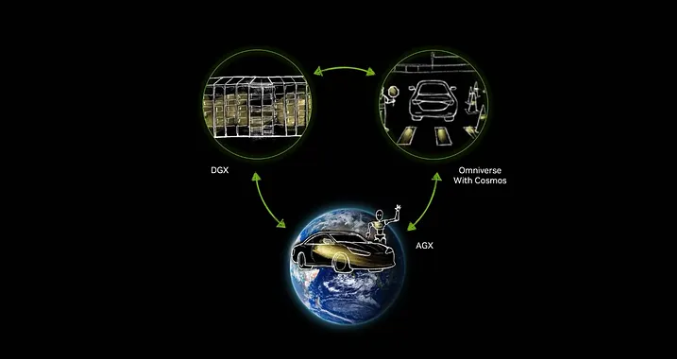

黄仁勋频繁提及的"3 Computers"指的是:DGX 用于执行模型训练,并与Omniverse 的世界基础模型(WFM)进行模拟交互,或是通过Cosmos 生成数据再用于训练;而AGX则是最终部署策略模型的计算设备。

世界基础模型(World Foundation Model)

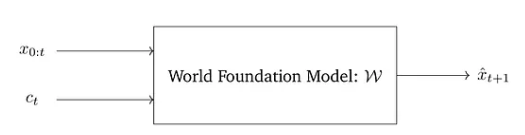

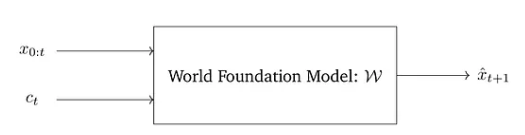

世界基础模型(WFM)可被视为一种以历史观测值 x0:t 和当前扰动 ct 作为输入,进而预测未来状态的模型。世界基础模型期望实现以下目标:

-

策略评估与初始化

-

策略训练

-

规划或模型预测控制(MPC)

-

合成数据生成

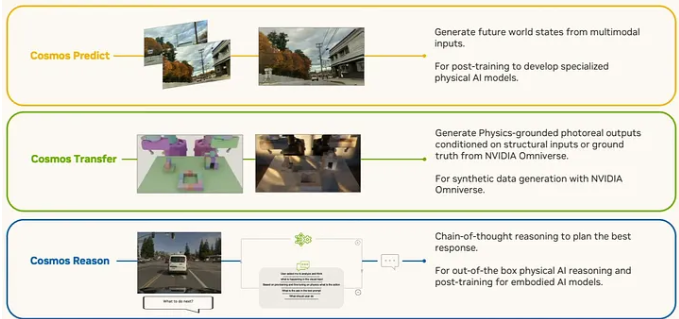

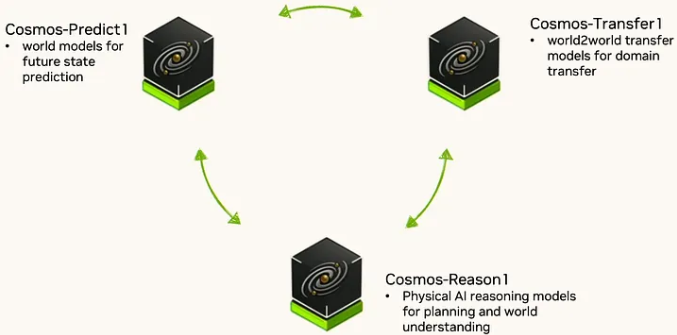

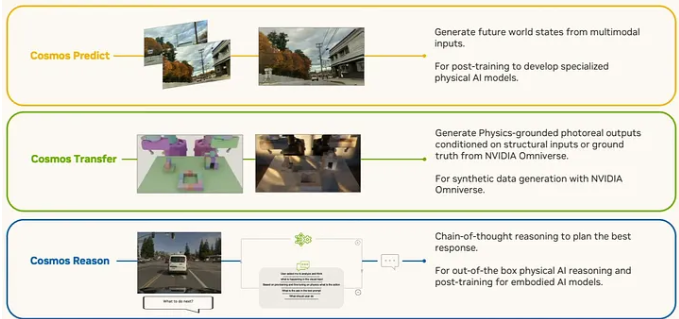

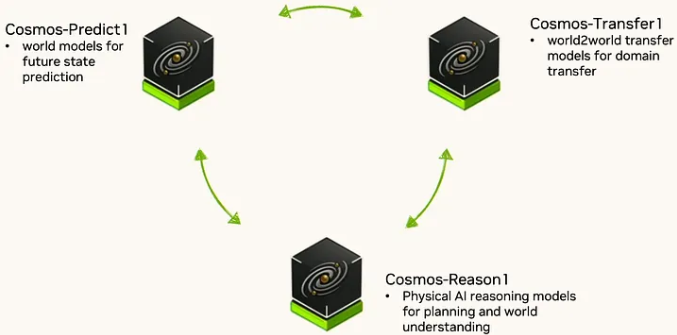

而 Cosmos 系列世界基础模型提供了多种模型,主要分为 Predict / Transfer / Reason 三类:

这三类世界基础模型(WFM)之间可以相互交互,例如由迁移模型(Transfer Model)生成的新场景,可再交由预测模型(Predict Model)进行预测。

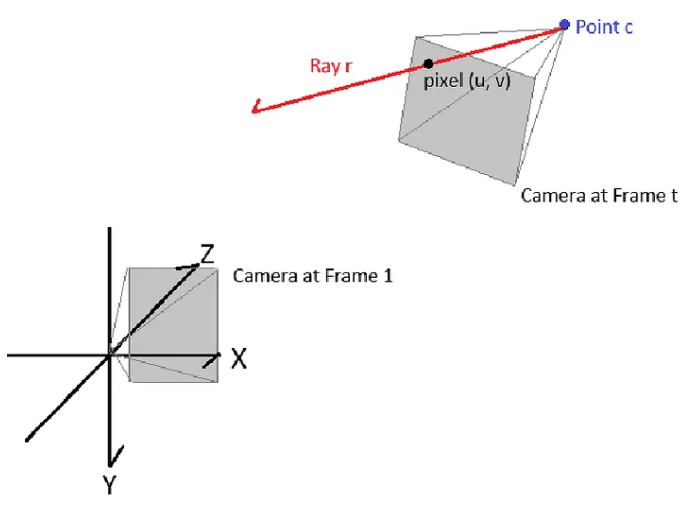

Cosmos-Predict

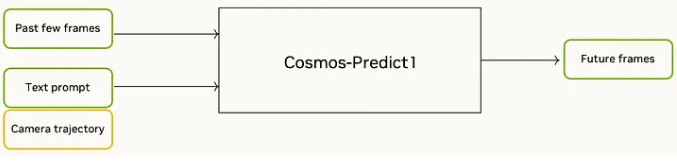

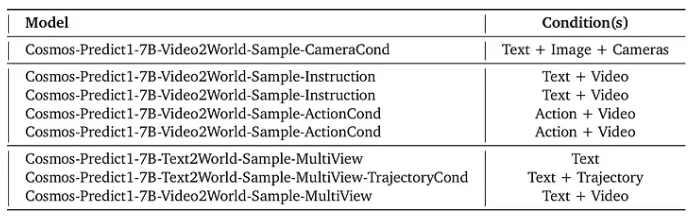

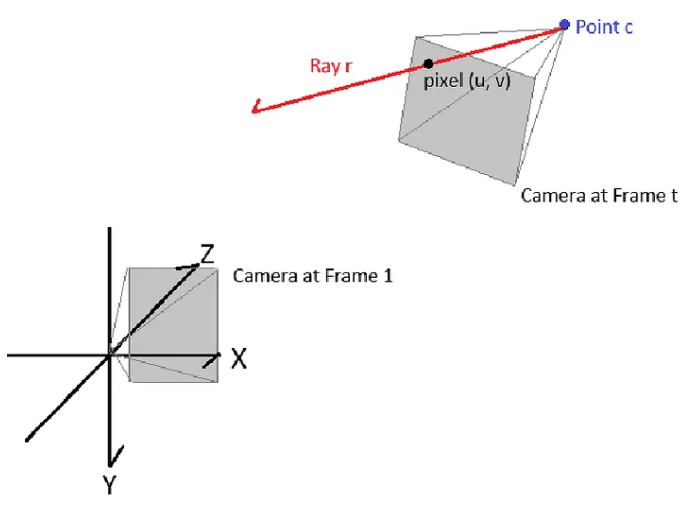

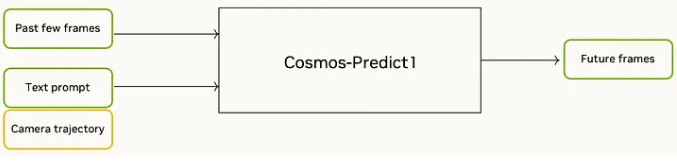

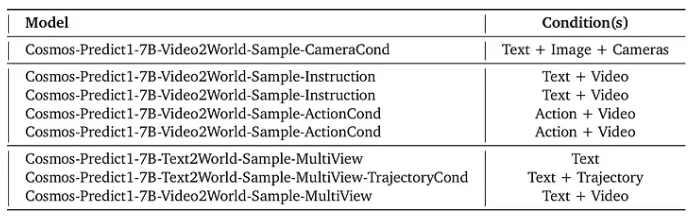

列举几个常用的 Cosmos-Predict 模型,例如接入相机姿态以预测后续帧:

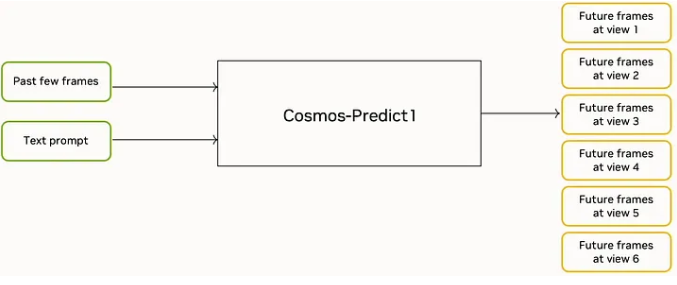

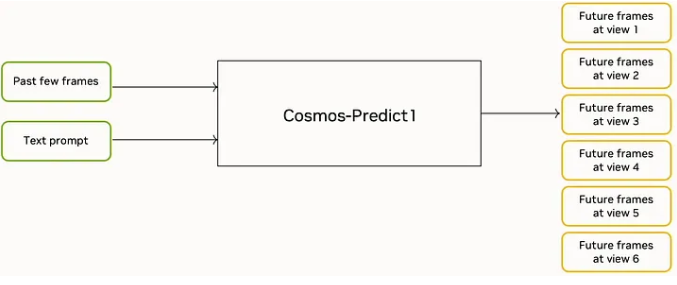

或是生成多个Frame的应用:

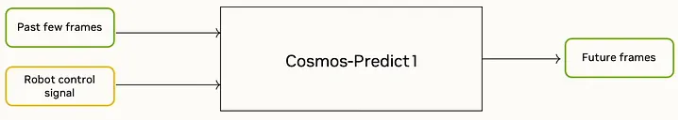

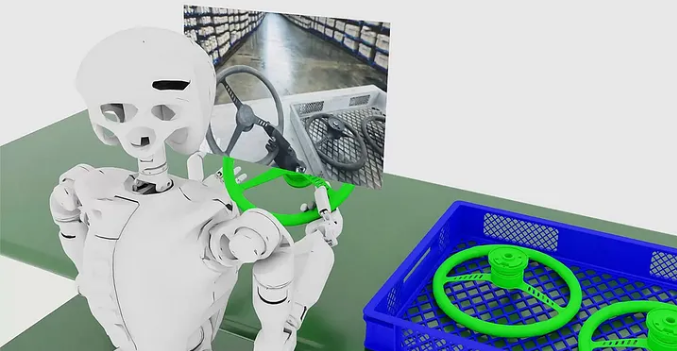

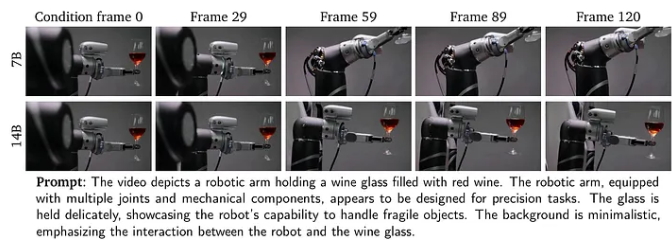

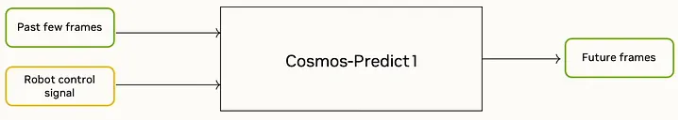

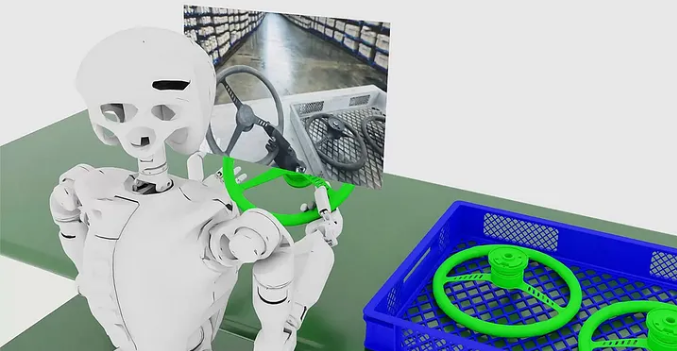

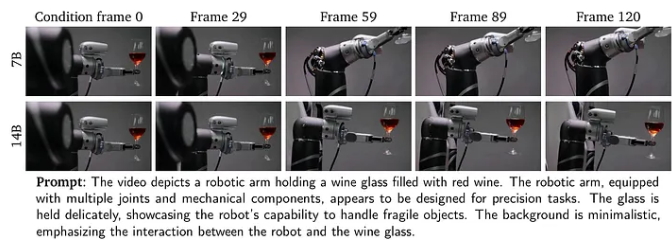

也可以输入机器人的控制信号:

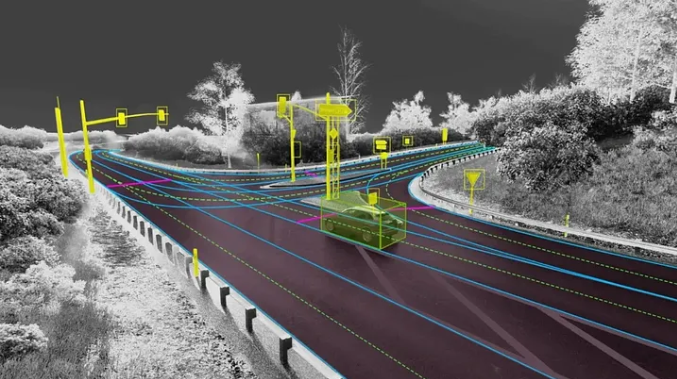

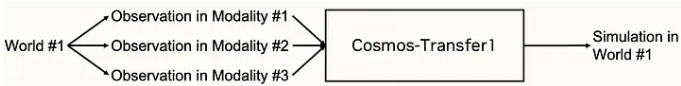

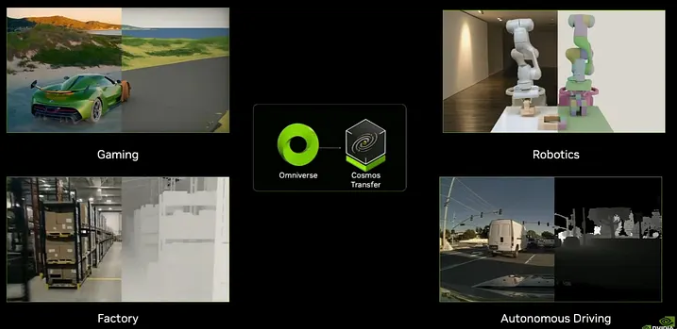

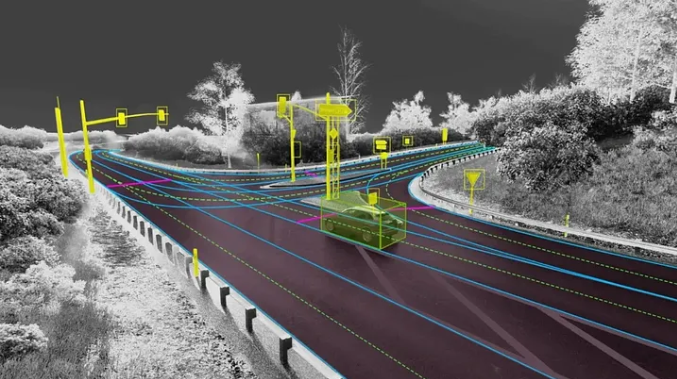

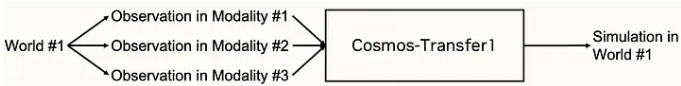

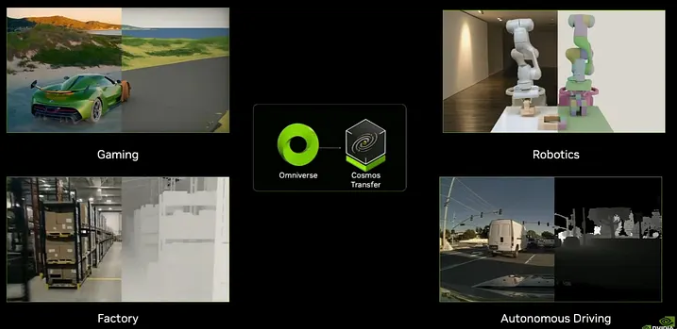

Cosmos-Transfer

顾名思义,Cosmos-Transfer 用于实现数据与场景的转换,例如将 Omniverse 中的数字孪生模型转化为逼真的虚拟场景。

以下四张图中,右侧为Omniverse场景,左侧为Cosmos-Transfer生成的写实场景:

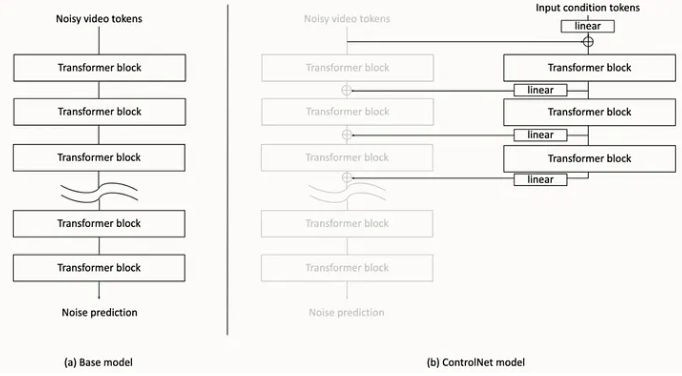

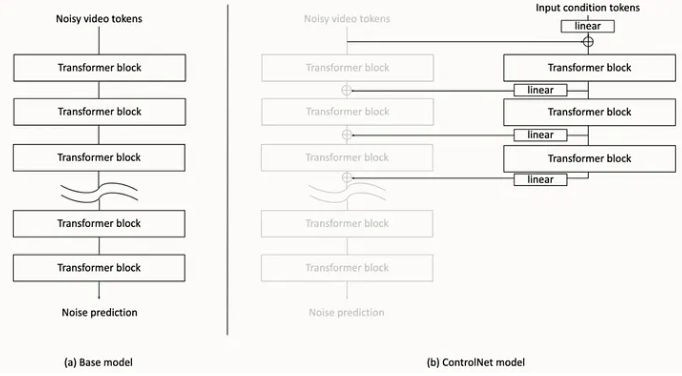

下图左侧是Cosmos-Predict 1的架构,为基于DiT的扩散模型。右侧则是Cosmos-Transfer 1,其基于Cosmos-Predict 1的架构进行设计,参照ControlNet架构加入了控制分支。控制分支的前几层Transformer块在推理时会混合使用。

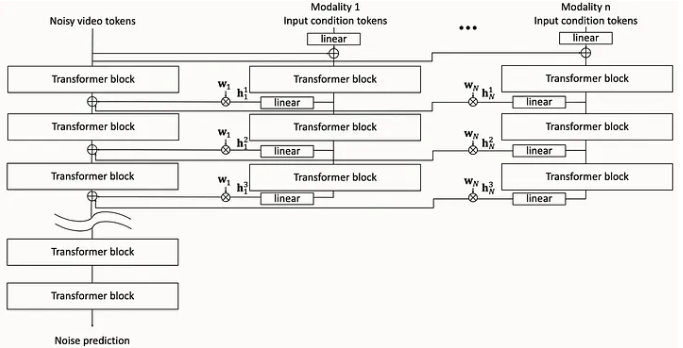

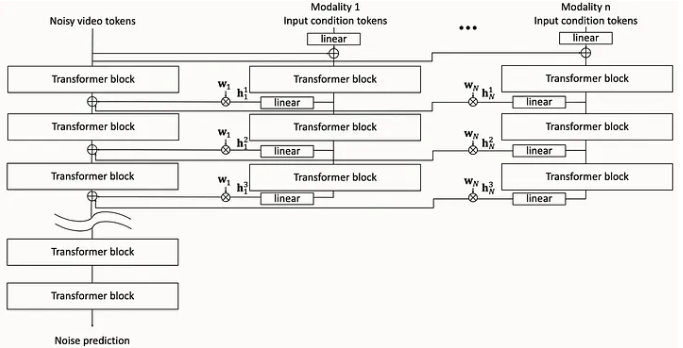

完整的Cosmos-Transfer 1架构如下,各分支(模态)可分配不同权重,实现定制化的图像转换(例如可增强边缘特征的权重占比)。

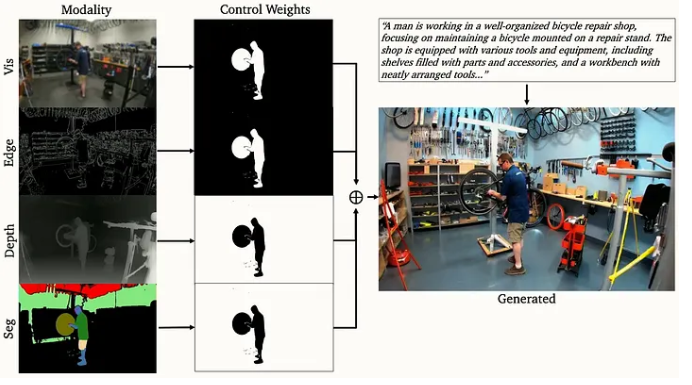

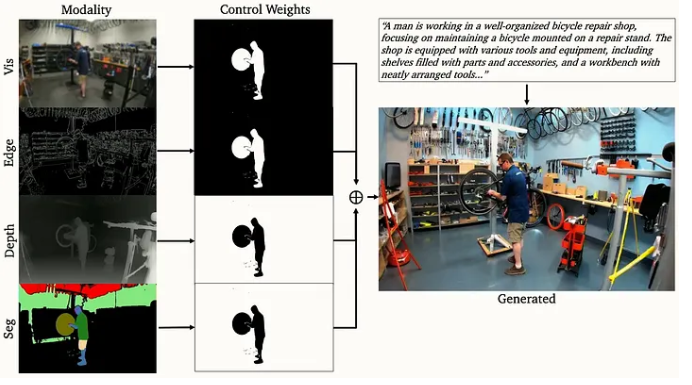

下图是Cosmos-Transfer 1在推理阶段的示例:

Cosmos-Reason 1

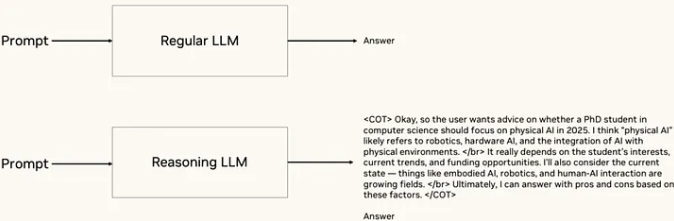

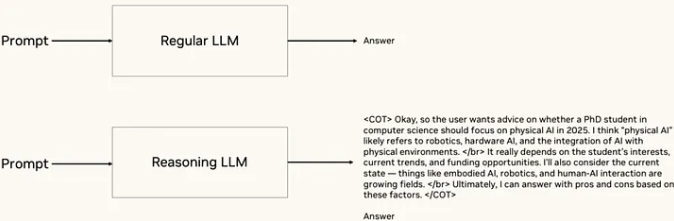

下图展示了推理模型与传统大型语言模型的比较:

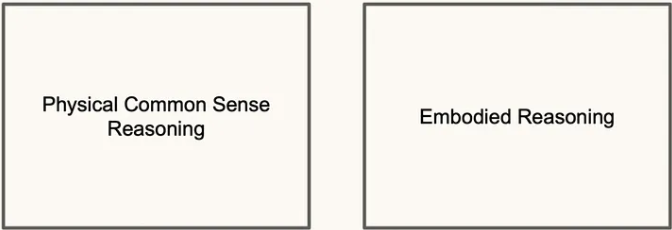

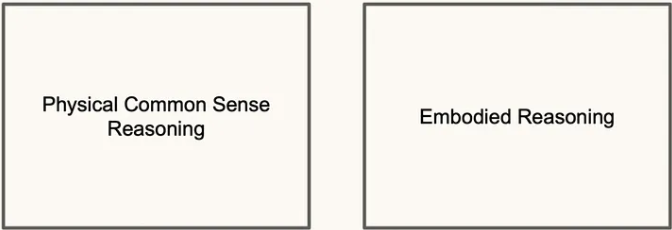

在Physical AI方面,Cosmos-Reasoning 1分为以下两大类:

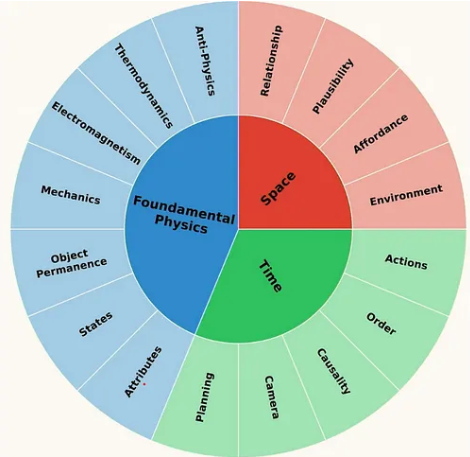

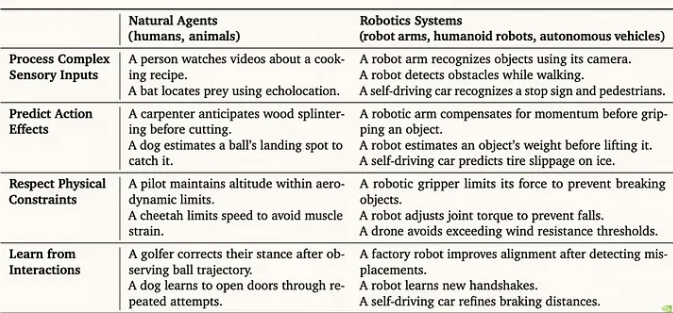

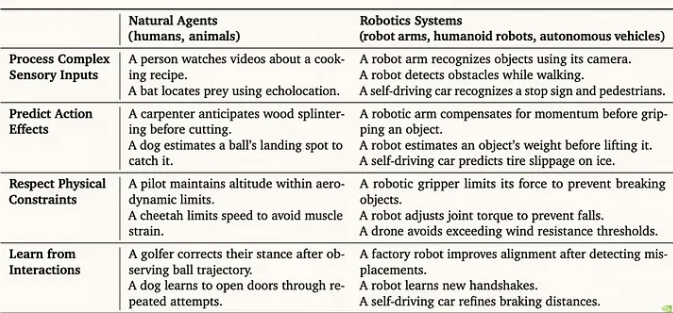

物理常识推理 的分类如下,旨在让AI学习与物理相关的常识知识:

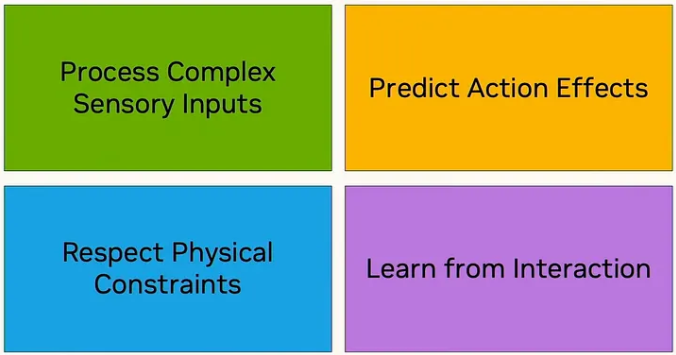

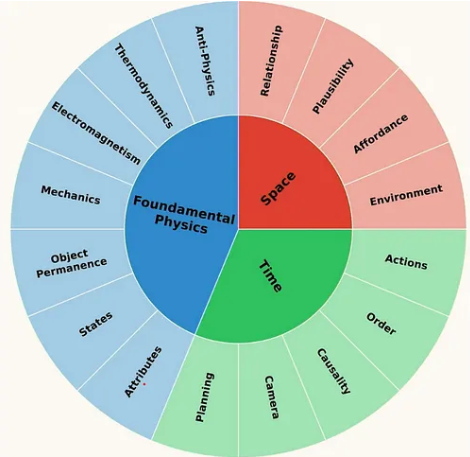

而具身推理则分为以下四大类,NVidia认为推理模型必须能处理以下各类任务:

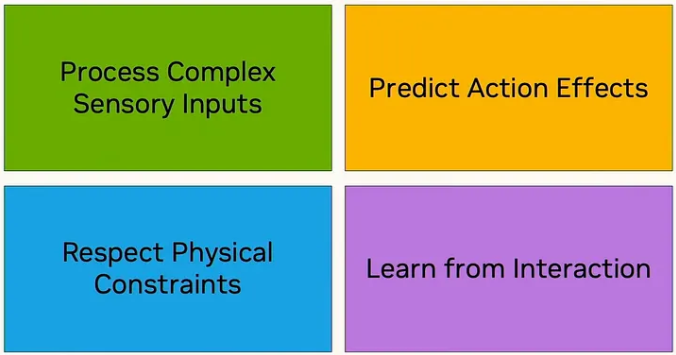

而不同具身形态在这四个类别中的差异,可参考下图所示:

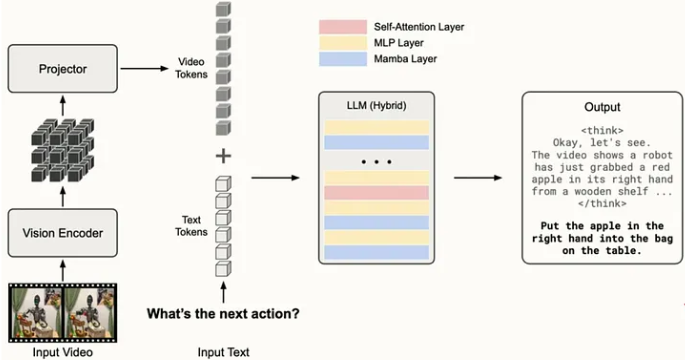

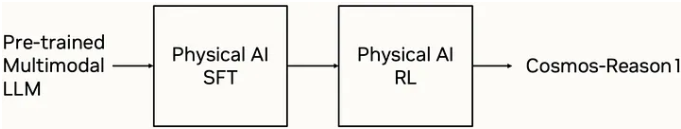

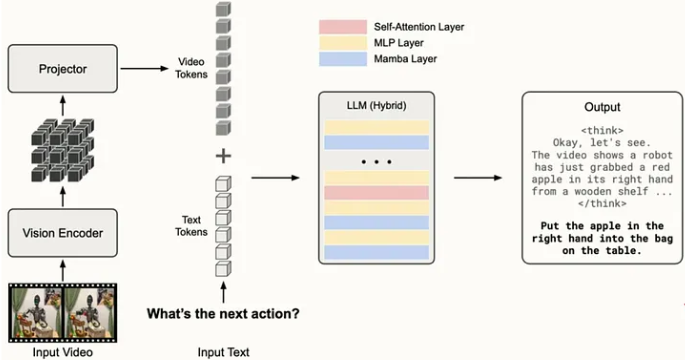

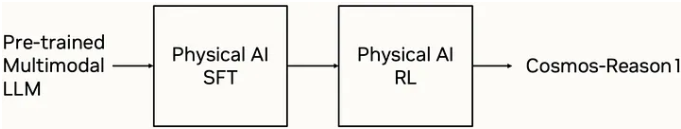

Cosmos-Reason 1 的架构如下:

Cosmos-Reason 1 的训练方式:

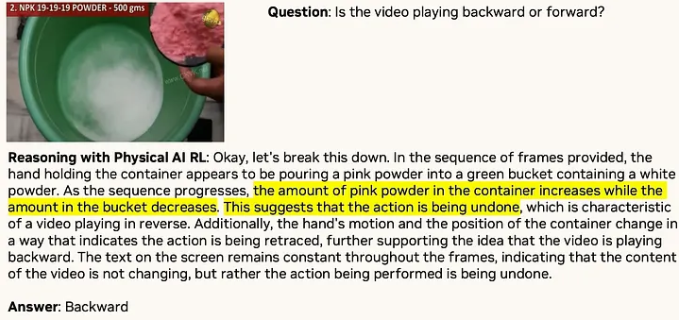

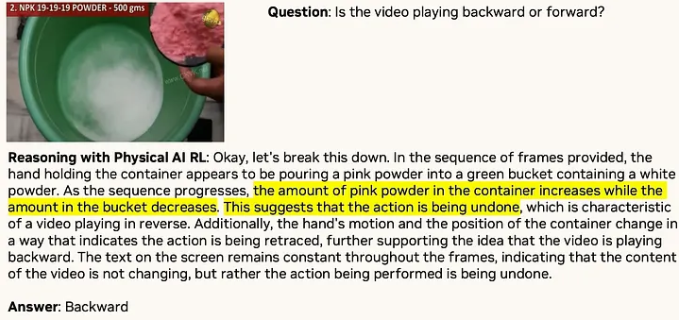

Cosmos-Reason 1 的使用示例:

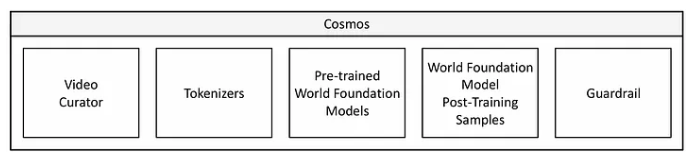

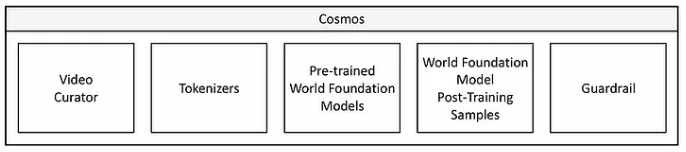

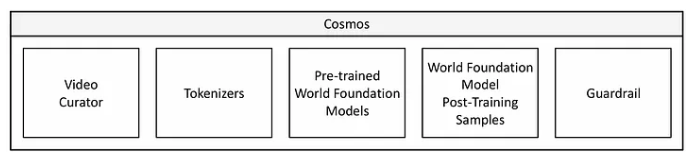

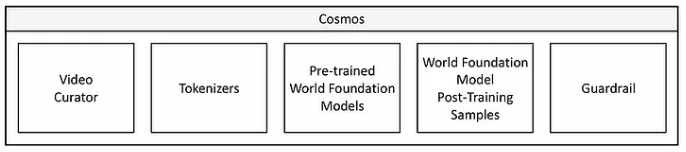

Cosmos 平台组件

目前,Cosmos 平台主要包括以下几个组成部分:

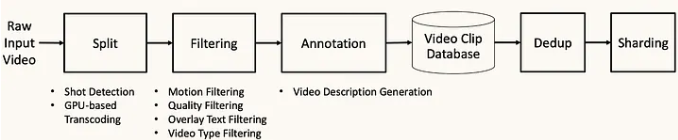

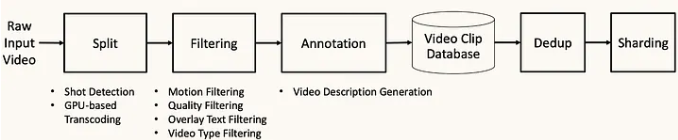

Video Curator

这是一个提供完整工具链的流程,让用户能够编辑和准备所需的训练资料。

Cosmos 世界基础模型的训练数据分布 如下,其中绝大部分数据集与物理人工智能 相关。所收集的视频总时长达到2000万小时,分辨率涵盖从720p到4k。

经过切割的视频片段会通过以下4种过滤器,筛选出适合训练世界基础模型的优质内容:

-

运动过滤器:过滤掉物体静止或无运动的视频片段。

-

画质过滤器:过滤掉存在严重畸变或噪音的视频片段。

-

文本叠加过滤器:过滤掉含有硬字幕的视频片段。

-

视频类型过滤器:过滤掉游戏画面或动画内容。

随后,视频会经由视觉语言模型(VLM) 自动添加描述字幕。在去重阶段 ,系统会滤除内容高度相似的片段。最后,这些精选的视频片段会被组织成网页数据集,供模型训练师进行训练(此步骤称为分片)。

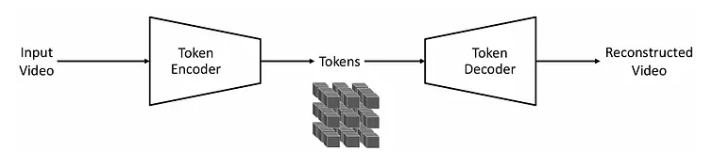

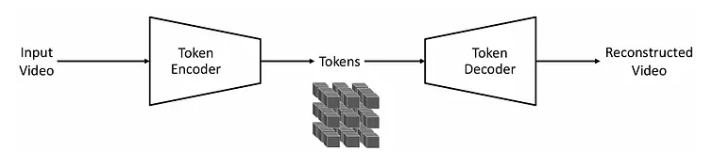

Tokenizers(分词器)

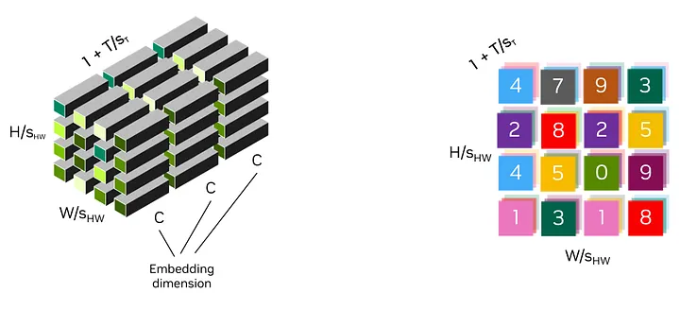

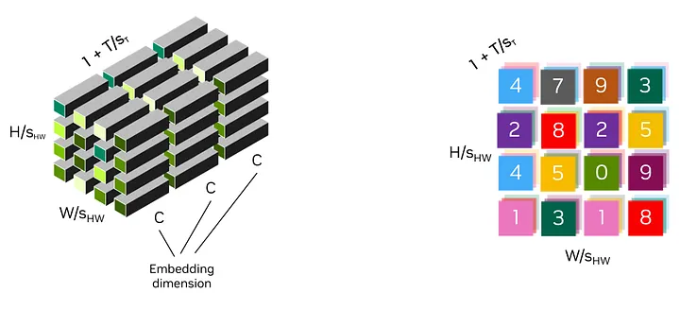

视频分词器(Video Tokenizers)的目标,是以一种高效的方式编码和表示视频中所蕴含的信息。

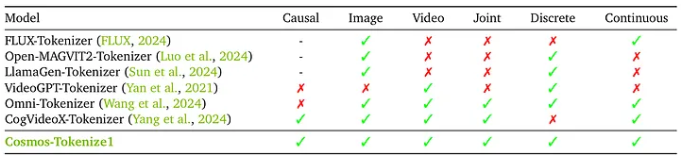

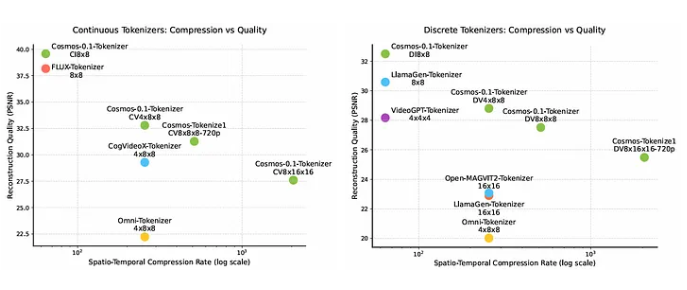

Tokenizer 又可以分为连续型 (例如 VideoLDM)与离散型(例如 VideoPoet)两种:

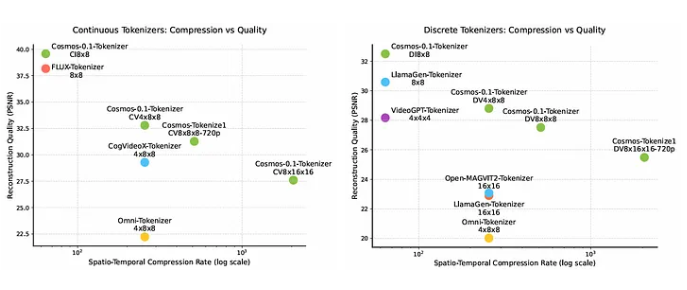

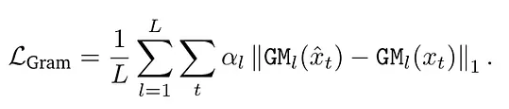

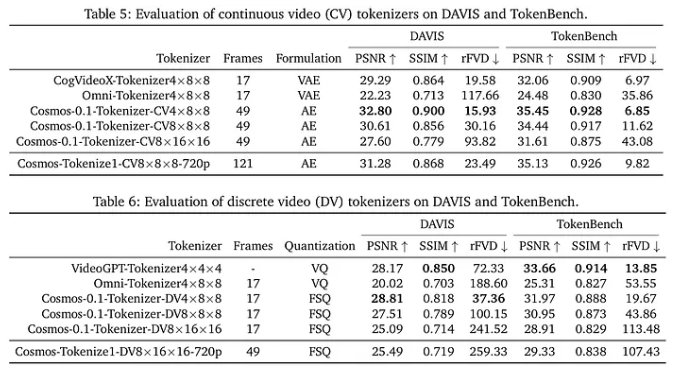

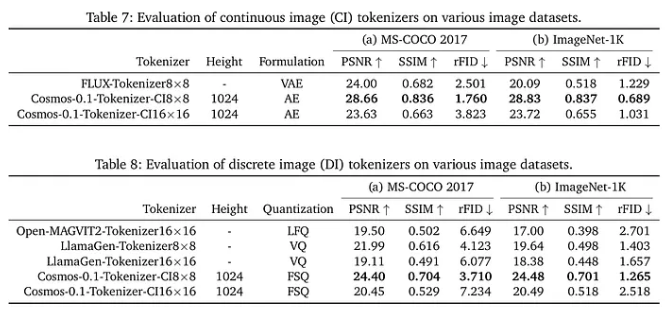

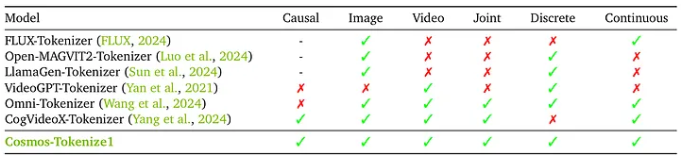

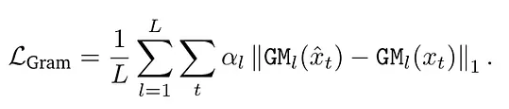

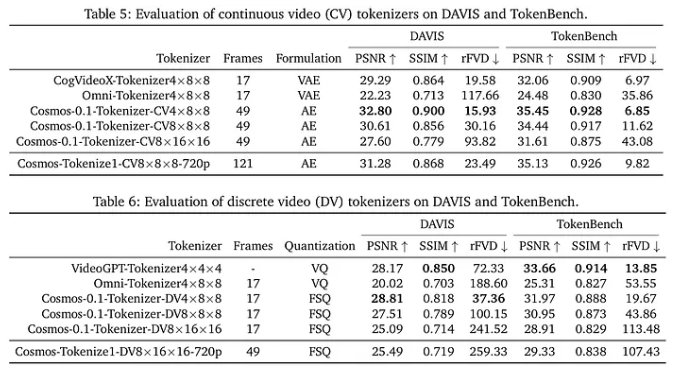

分词器 的核心在于实现高压缩率 ,同时重建质量 也必须保持高水平,其本质是一种自编码器。以下两张图展示了 Cosmos-Tokenize 1 与现有其他分词器的性能比较。

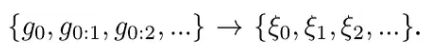

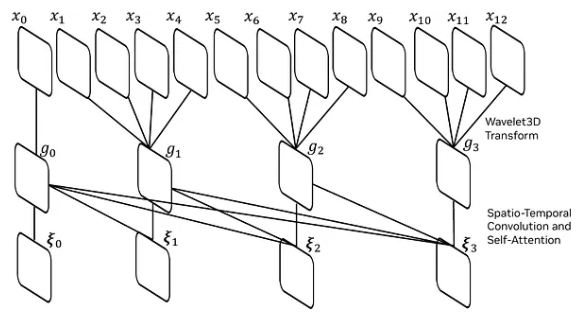

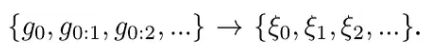

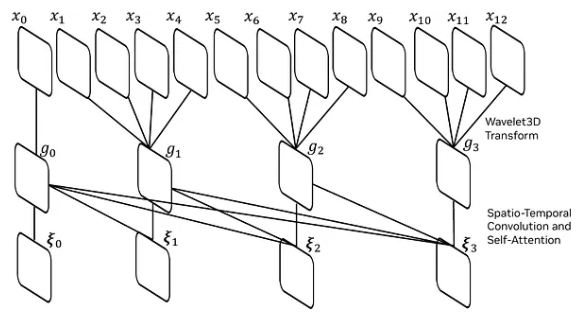

Cosmos-Tokenizer 1 将每4帧图像通过小波变换,切分成若干组(时域窗口),随后送入编码器。其数学表示如下:

其目的在于保留视频前后帧之间的时间因果关系,具体架构可参考下图:

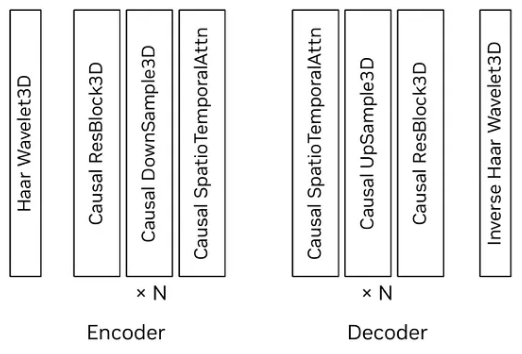

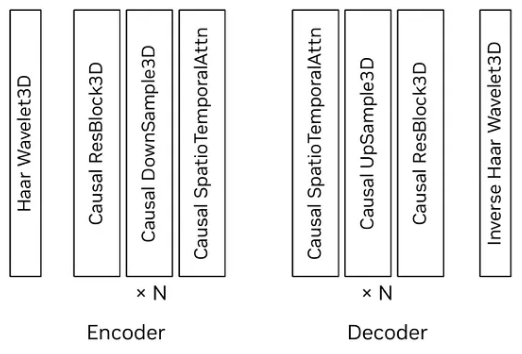

经过小波变换后,数据会进一步经过下采样 等层的处理,而解码器则采用编码器的逆过程架构:

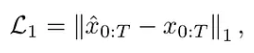

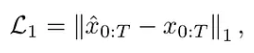

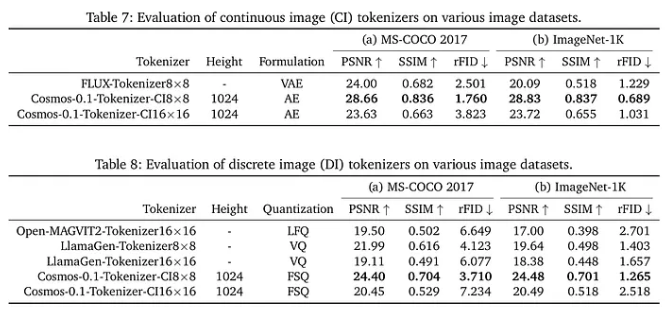

在训练策略上,Cosmos-Tokenizer 1分为两个阶段。首先,最小化原始视频与重建视频之间的像素RGB差异。

通过L1损失进行优化,以最小化输入视频与重建视频之间的像素级RGB差异。

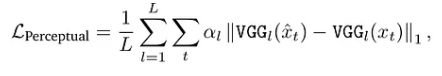

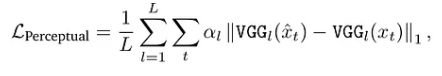

以及基于VGG-19的特征损失

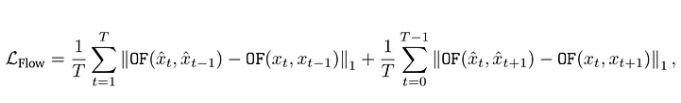

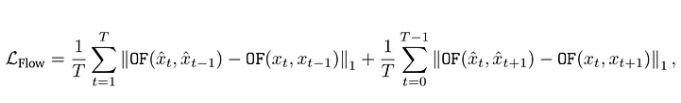

在第二个阶段,会基于RAFT这篇论文去最小化光流损失

以及基于《Image Style Transfer Using Convolutional Neural Networks》所计算出的Gram矩阵损失。

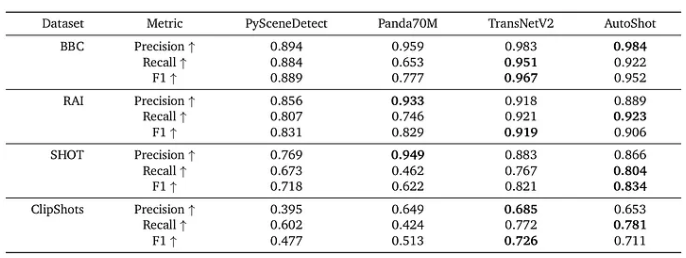

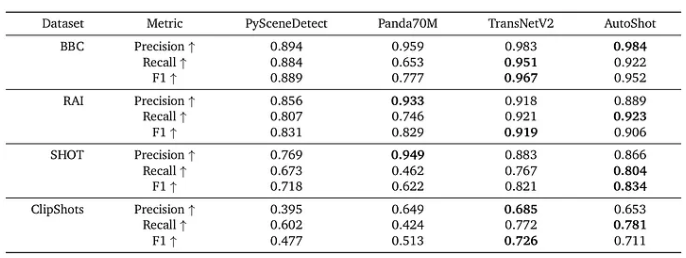

不同分词器之间的比较结果

此处我们大致列举了不同分词器之间的比较。

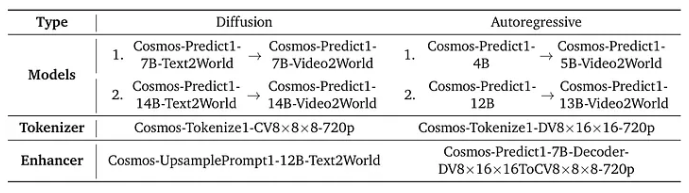

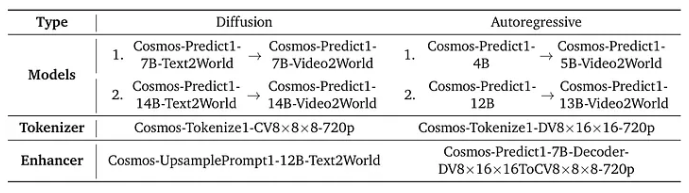

世界基础模型预训练(Pre-trained WFMs)

Cosmos 预训练的 WFMs 分为 Diffusion-based 与 Autoregressive-based 两类。Diffusion-based 的 WFM 将生成问题分解为一系列去噪问题,而 Autoregressive-based 则将生成问题分解为一系列 Token 预测问题。

Cosmos 预训练 WFMs 的路线图如下:

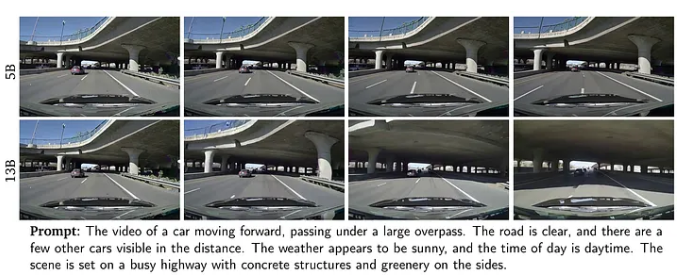

以Diffusion-based模型为例,首先训练Text2World 模型,再引入视频作为输入,通过微调得到Video2World 模型。Diffusion-based模型使用连续型Token,因此采用对应的CV Tokenizer。训练所使用的文本提示由VLM生成,这与人工编写的提示通常存在差异,因此添加一个增强器来处理人工提示与VLM生成提示之间的差别。

而Autoregressive-based模型则直接训练纯视觉输入的Llama3-style GPT模型,随后加入文本提示训练为Video2World模型,并采用离散型DV Tokenizer。为应对高压缩率带来的失真问题,在增强器部分引入一个Diffusion Decoder(基于Cosmos-Predict1--7B-Decoder),将Discrete Tokens转换为Continuous Tokens。

Diffusion-based World Foundation Model

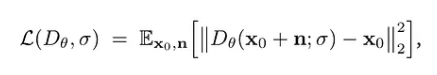

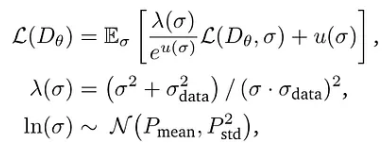

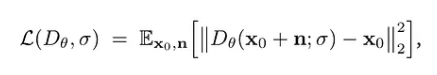

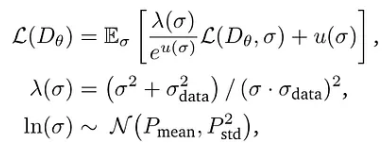

参考EDM的去噪分数匹配损失,损失函数可定义为:

其中,x0 是从训练数据集中采样得到的视频,n ∼ 𝒩(0, 2σ²I) 为高斯噪声。

关于EDM ,笔者后面有时间的话会另行撰写文章介绍。EDM 提出从设计的角度 审视扩散模型,质疑了先前过于理论化且难以修改的扩散模型范式。

基于 EDM 的 Preconditioning Design,Diffusion-based WFM 的训练损失可以表示为

σ 为噪声水平,由 Pmean 和 Pstd 两个超参数控制。σdata 则是训练数据中的标准差,而 λ(σ) 用于确保在训练初始阶段,各噪声水平具有等价的贡献。

随着训练的进行,λ(σ) 的平衡可能会劣化,因此设计了 u(σ) 来对冲各噪声水平在损失函数上造成的不确定性。例如,当去噪器对任务的不确定性较高时,噪声水平 σ 的贡献就应随之降低,也就意味着此时的 u(σ) 会较高。

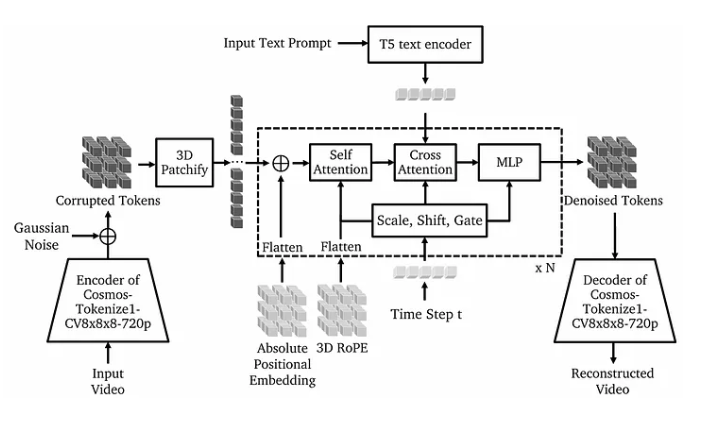

架构

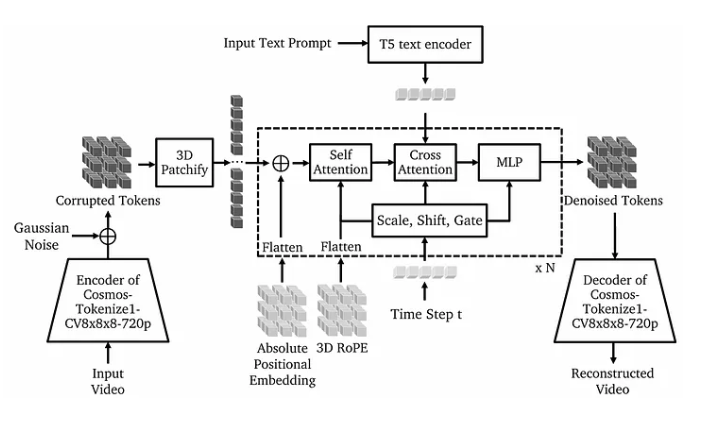

Diffusion-based 的预训练模型基于 DiT,其架构如下。

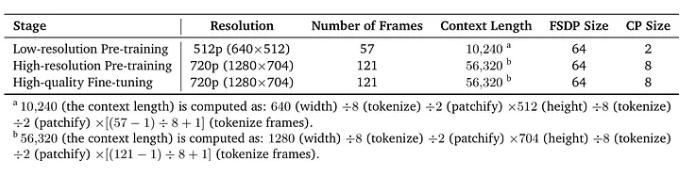

训练策略

为提升跨模态的认知能力,Cosmos 预训练的 WFM 将视频与图片混合在批次中一同训练。

这种方法源于以下观察:减少图像与视频潜表示之间的分布偏移,能够提升生成质量。

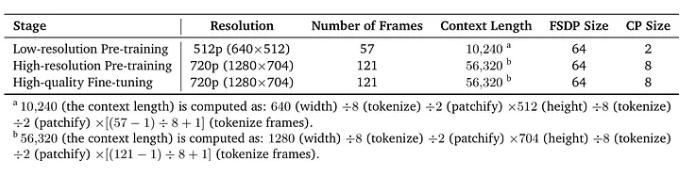

Cosmos 预训练的 WFM 采用阶段性训练,分辨率从低到高逐步提升。

提示词上采样器

如前所述,提示词上采样器的目的是处理用户推理时输入的提示词与训练所用提示词之间的差异,其目标可分为以下三点:

-

对输入提示词的保真度:上采样后的提示词必须忠实保留原始用户输入的关键要素,包括主要角色、动作或运动、关键属性以及整体意图。

-

与训练分布的对齐:上采样后的提示词应在长度、语言结构和风格上与 WFM 训练时使用的提示词分布高度相似。

-

增强的视觉细节:上采样后的提示词应能引导 WFM 生成更精确的视觉效果。

基于自回归的世界基础模型

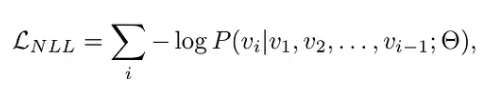

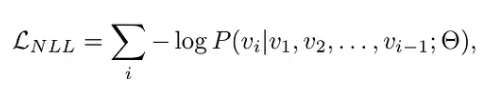

自回归式 WFM 将生成过程视为预测下一个 Token 的问题。视频首先会被离散型分词器拆解为一系列 Token V = (v1, v2, ..., vn),而模型的目标是训练一个 Transformer 解码器来最小化以下损失:

Θ 是 Transformer 解码器的参数

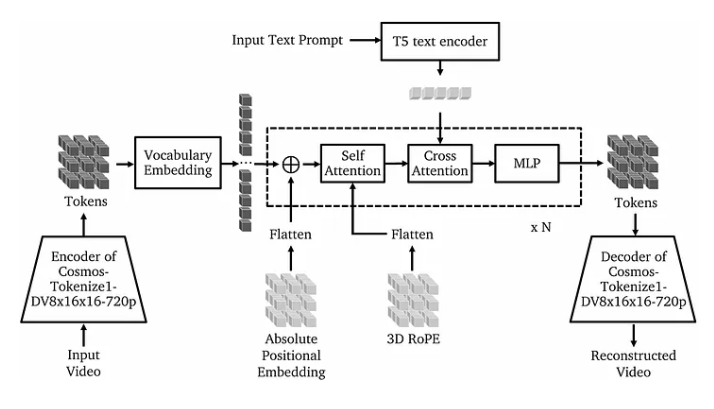

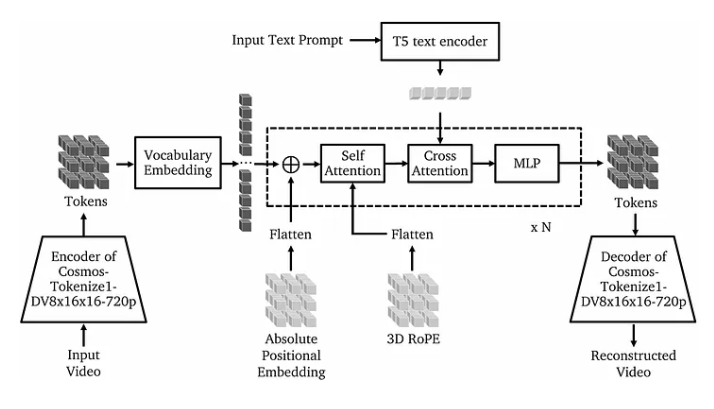

Autoregressive架构

与基于扩散(Diffusion-based)的模型类似,自回归(Autoregressive)模型同样采用了 T5 Text Encoder 以及 3 DAbsolute + RoPE Position Embedding。

训练策略

自回归模型的训练分为以下三个阶段:

阶段 1:目标是给定视频第一帧,预测后续几帧。在17帧的视频中,给定第一帧,预测未来16帧。

阶段 1.1:将视频长度扩展到34帧,利用YaRN扩展RoPE。

阶段 2:加入文本条件,仍配合34帧长度的视频进行训练。

面向实时生成的推理优化

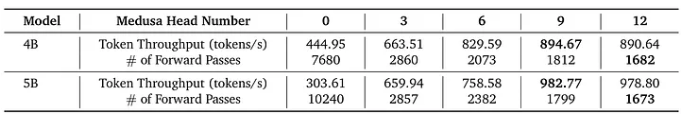

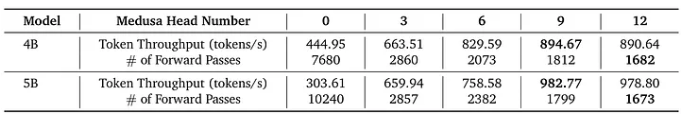

自回归WFM采用Medusa进行推理加速。下表评估了Medusa头数量对推理速度的影响,最终采用增加9个Medusa头的方案。

此外,针对需要微调的Transformer层也总结了一些结论,并得出以下实验结果:

我们通过实验发现,在保持主干网络冻结的情况下,仅解冻最后两个Transformer层及最终的解嵌入层,能够获得最佳性能。

为加速推理,自回归模型会将视频压缩至320 * 512的分辨率,因此需在低分辨率视频上对原有预训练模型进行微调。

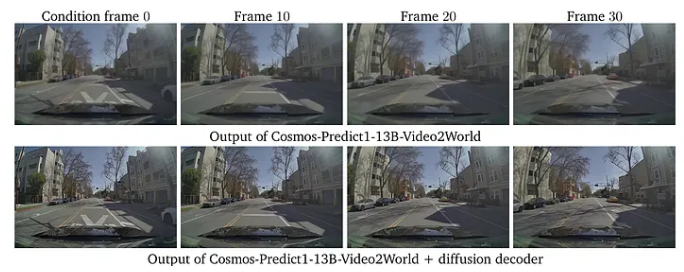

离散型分词器(Diffusion Decoder)

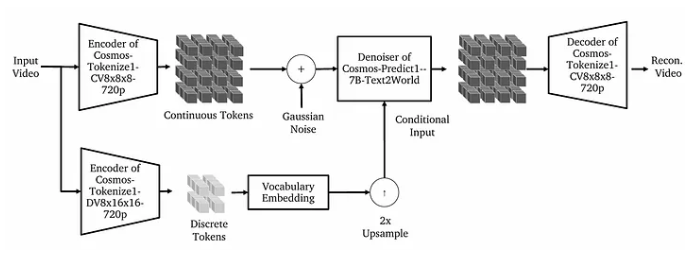

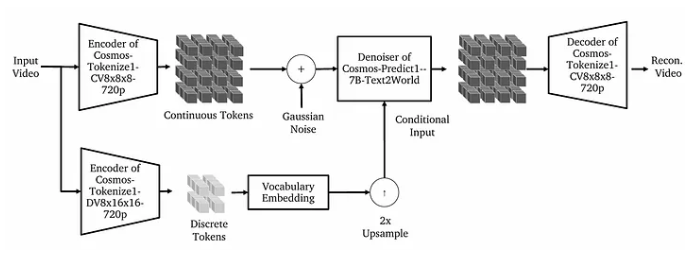

离散型分词器(Diffusion Decoder)会对图像进行高压缩,导致生成的视频容易出现模糊。因此,额外设计了一个分词器解码器来处理这个问题。如下图所示,在训练时会另外搭配一个CV Tokenizer(连续型分词器能够保存更多原始视频信息)。

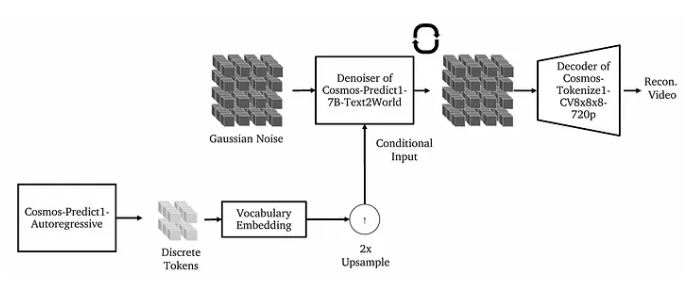

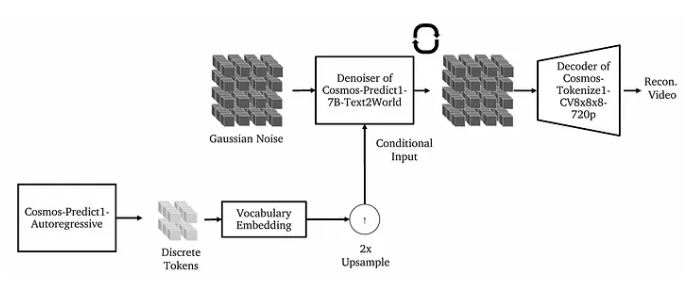

Inference的流程如下图所示

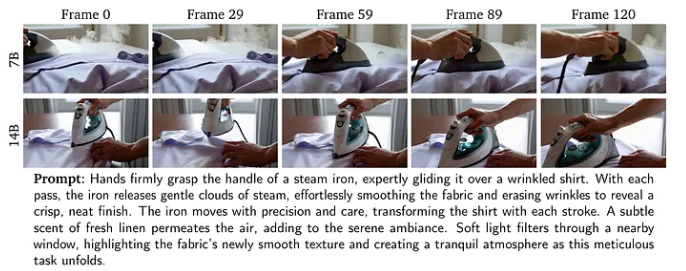

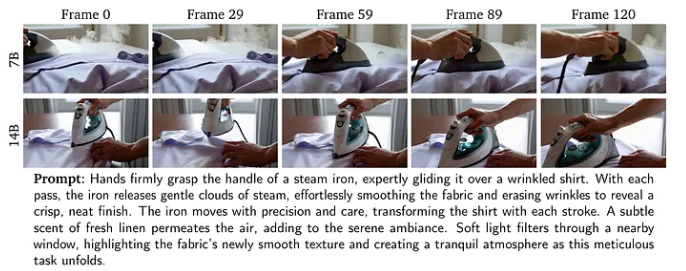

推理结果

预训练WFM的评估

预训练的WFM主要从3D一致性 和物理对齐两个层面进行评估。

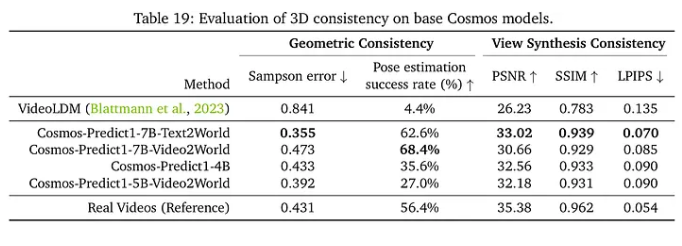

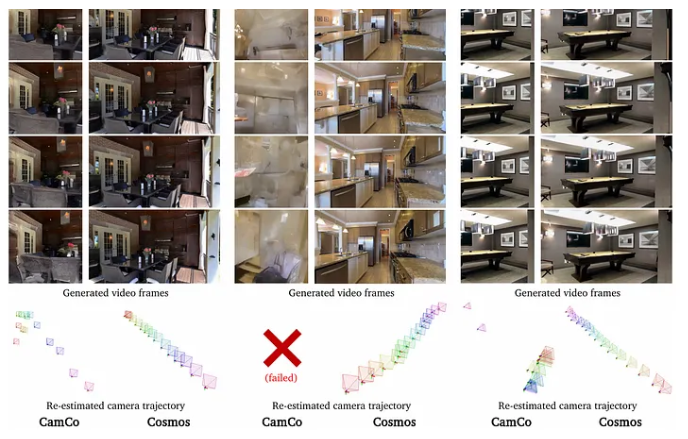

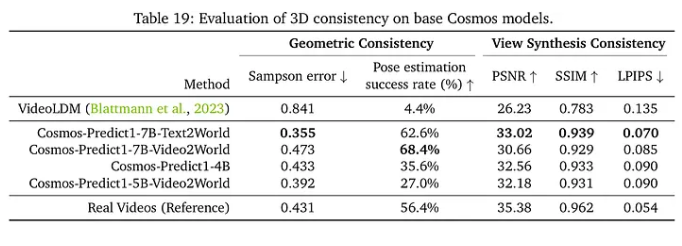

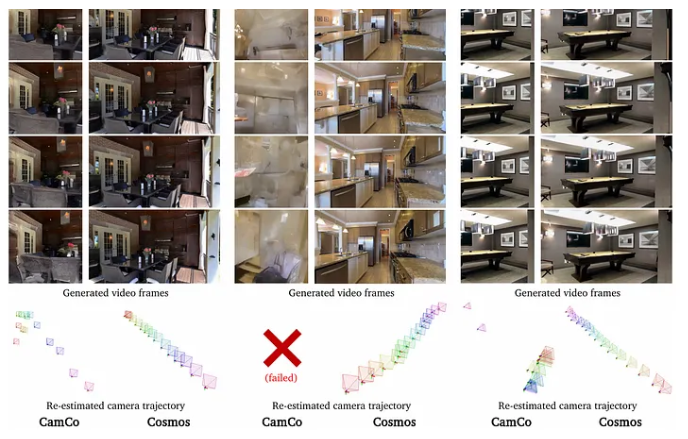

3D一致性

理想的WFM应能从几何上合理的3D世界生成视频模拟。Cosmos针对RealEstate 10K中的静态场景进行评估,并与VideoLDM进行比较。在几何一致性方面,Cosmos评估了生成视频各帧之间的对极几何约束 是否被满足,以及姿态估计的成功率。此外,在视图合成一致性部分,评估了各生成图像的3D结构一致性。

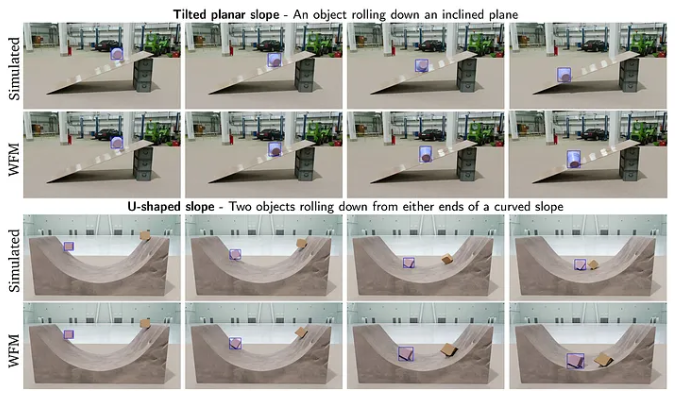

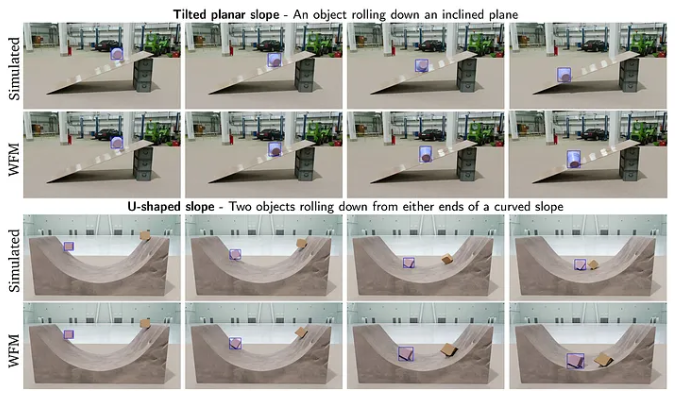

物理对齐

Cosmos 在虚拟物理引擎(PhysX + Isaac Sim)生成的基准数据集上进行验证,确保生成的视频遵循牛顿力学和刚体动力学规律(将模型生成的视频与虚拟物理引擎渲染出的视频进行比较)。

评估的物理效应如下:

-

自由落体物体:物体在平面上坠落(涉及重力、碰撞等)

-

倾斜平面坡度:物体沿斜面滚下(涉及重力、转动惯量等)

-

U形坡度:物体沿U形坡面滚下(涉及势能、动能等)

-

稳定堆叠:处于平衡状态的物体堆叠(涉及力的平衡)

-

不稳定堆叠:处于失衡状态的物体堆叠(涉及重力、碰撞等)

-

多米诺骨牌:一系列矩形积木依次倒下(涉及动量传递、碰撞等)

-

跷跷板:物体置于跷跷板两端(涉及扭矩、转动惯量等)

-

陀螺:在平面上旋转的陀螺(涉及角动量、进动等)

比较的图示如下:

物理对齐的测试结果如下

WFM 后训练模型

下表为 Cosmos 列出的几种在下游应用中经过后训练的 WFM 模型

后训练模型示例

此处列举的模型仅作示例,并非完整系统。开发者需基于自身的数据集对模型进行额外微调。

用于相机控制的后训练 WFM

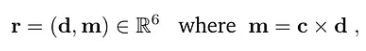

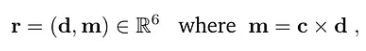

Cosmos-Predict1--7B-Video2World Sample-CameraCond 的目标是通过单张图像及相机轨迹,生成具有合理3D结构的视频。

数据集

数据集采用 DL3DV-10K ,并通过 GLOMAP 这类结构光运动恢复方法重建相机姿态标注,同时利用 VLM 为视频添加文本提示标签。

微调(Fine-tuning)

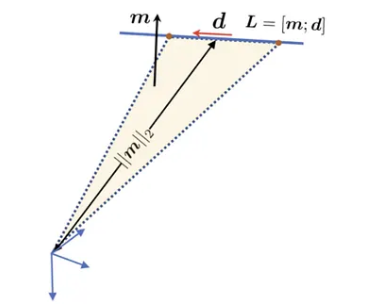

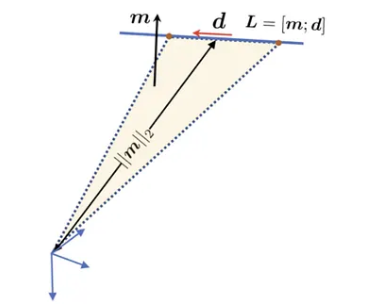

Cosmos-Predict1--7B-Video2World Sample-CameraCond 通过一个基于普吕克坐标 的嵌入层来实现相机控制的条件输入。普吕克坐标在光场网络中用于表示 360 度的光场,其特性是便于表示空间中的直线及相关计算。

参考Light Field Network,Cosmos 通过 Plücker 坐标编码相机姿态:

其中 c 是某一帧中相机原点的世界坐标,该世界坐标即第一个帧的相机坐标 。d 则为从相机原点出发、穿过所有像素 (u, v) 的光线,如下图所示:

所有相机姿态均相对于初始帧进行计算。

评估

Cosmos 用于评估后训练模型的指标包括:

-

视频生成质量 :通过 Fréchet Inception Distance 与 Fréchet Video Distance 衡量

-

3D 一致性 :通过 结构从运动 重新估计的相机姿态进行评估

后训练结果

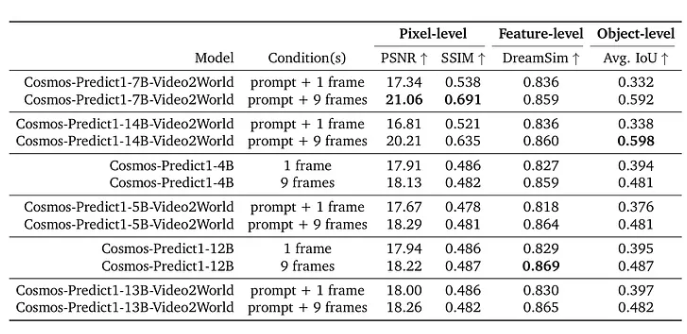

针对机器人操作的后训练模型

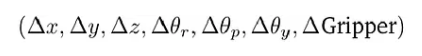

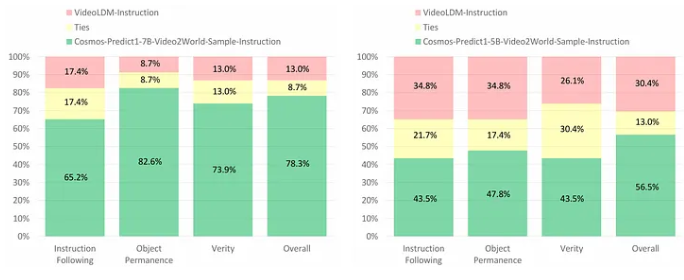

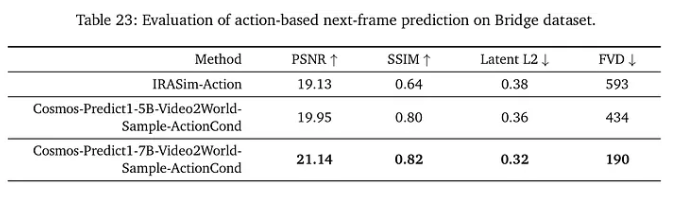

针对机器人操作的后训练主要分为以下两类:

-

基于指令的视频预测:给定当前帧及一段文本指令,输出为根据该指令生成的视频。

-

基于动作的下一帧预测:给定当前帧及当前帧与下一帧之间的动作向量,输出为根据该动作生成的下一帧。

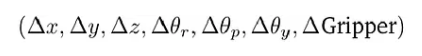

数据集

针对基于指令的模型,Cosmos 创建了 Cosmos-1X 数据集 。该数据集主要通过 1x.tech 公司的 EVE 机器人 进行采集。

基于动作的模型则使用 Bridge 数据集,其对应的动作向量参考了 OpenVLA 中的夹爪坐标空间:

微调

由于基于动作模型的动作向量 在预训练阶段未被使用,因此在后训练时,会在 Cosmos-Predict1--5B-Video2World-Sample-ActionCond 这类模型中增加一个MLP层,用于将动作向量嵌入为张量,并整合到交叉注意力机制中(与T5文本嵌入的处理方式相同)。

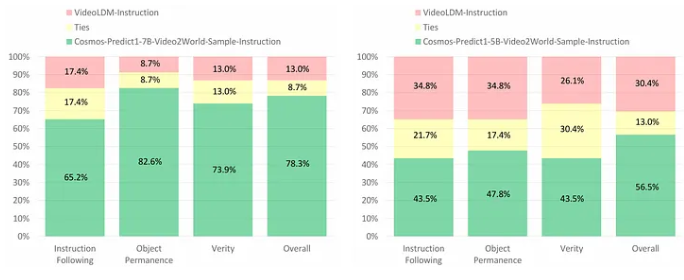

评估

针对基于指令的模型,Cosmos 提出以下四个维度进行评估:

-

指令跟随:生成的视频是否与输入的语言指令一致?

-

物体持久性:场景中存在的物体是否在整个生成的视频中持续出现?

-

真实性:生成的视频是否真实反映了现实世界,没有出现意外的虚构物体?

-

整体合理性:生成的视频是否合理,足以让机器人据此进行规划?

评估通过人工进行:

人工评估员的任务是观察由不同模型生成、但基于相同语言指令的一对匿名视频,并依据上述维度进行比较。一组十名评估员对 23 个测试片段进行了评估。

与基线模型 VideoLDM-Instruction 的比较结果如下:

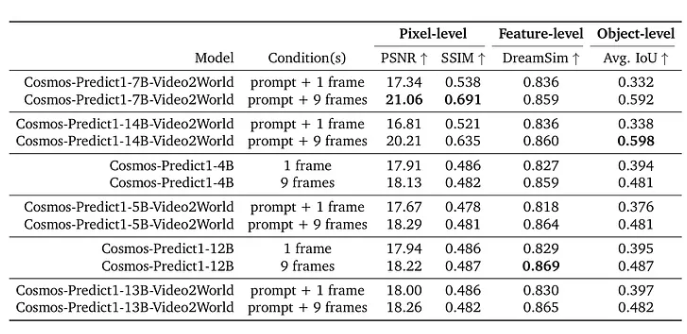

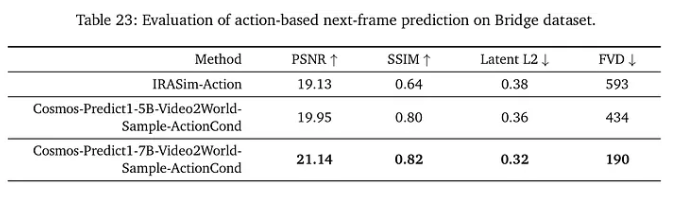

对于基于动作的模型,则直接与真值帧进行比较:

针对机器人操作的后训练模型结果

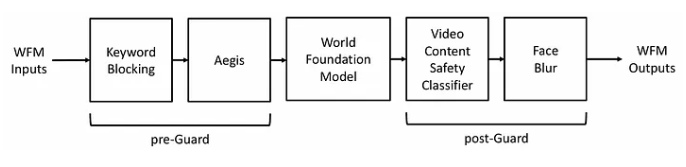

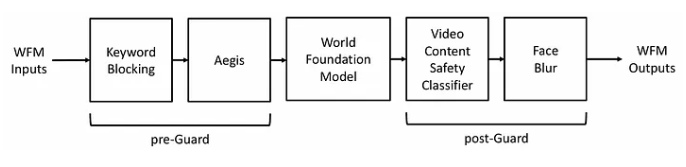

防护机制

针对WFM的使用,Cosmos设置了相应的保护机制,例如某些关键词不得用作指令,以及对人脸进行模糊化处理等。具体细节可直接参考论文第七章,笔者在此不做赘述。

Cosmos

Cosmos 是 NVIDIA 开源的世界模型平台。世界基础模型(World Foundation Model,以下简称 WFM)可视为策略模型(例如 GROOT N1)与之交互、用于学习或评估的环境。

推荐阅读:下一代人工智能技术:从大语言模型(LLM)到世界模型(WM)

如下图所示,控制器C (即强化学习中的行动者 )若同时参照环境观察 与世界模型 的预测结果(即下文将提及的Cosmos Predict),已被证实能够获得更好的训练效果。

黄仁勋频繁提及的"3 Computers"指的是:DGX 用于执行模型训练,并与Omniverse 的世界基础模型(WFM)进行模拟交互,或是通过Cosmos 生成数据再用于训练;而AGX则是最终部署策略模型的计算设备。

世界基础模型(World Foundation Model)

世界基础模型(WFM)可被视为一种以历史观测值 x0:t 和当前扰动 ct 作为输入,进而预测未来状态的模型。世界基础模型期望实现以下目标:

-

策略评估与初始化

-

策略训练

-

规划或模型预测控制(MPC)

-

合成数据生成

而 Cosmos 系列世界基础模型提供了多种模型,主要分为 Predict / Transfer / Reason 三类:

这三类世界基础模型(WFM)之间可以相互交互,例如由迁移模型(Transfer Model)生成的新场景,可再交由预测模型(Predict Model)进行预测。

推荐阅读:为何英伟达的世界动作大模型DreamZero在机器人技术基准测试中表现如此出色?

Cosmos-Predict

列举几个常用的 Cosmos-Predict 模型,例如接入相机姿态以预测后续帧:

或是生成多个Frame的应用:

也可以输入机器人的控制信号:

Cosmos-Transfer

顾名思义,Cosmos-Transfer 用于实现数据与场景的转换,例如将 Omniverse 中的数字孪生模型转化为逼真的虚拟场景。

以下四张图中,右侧为Omniverse场景,左侧为Cosmos-Transfer生成的写实场景:

下图左侧是Cosmos-Predict 1的架构,为基于DiT的扩散模型。右侧则是Cosmos-Transfer 1,其基于Cosmos-Predict 1的架构进行设计,参照ControlNet架构加入了控制分支。控制分支的前几层Transformer块在推理时会混合使用。

完整的Cosmos-Transfer 1架构如下,各分支(模态)可分配不同权重,实现定制化的图像转换(例如可增强边缘特征的权重占比)。

下图是Cosmos-Transfer 1在推理阶段的示例:

Cosmos-Reason 1

下图展示了推理模型与传统大型语言模型的比较:

在Physical AI方面,Cosmos-Reasoning 1分为以下两大类:

物理常识推理 的分类如下,旨在让AI学习与物理相关的常识知识:

而具身推理则分为以下四大类,NVidia认为推理模型必须能处理以下各类任务:

而不同具身形态在这四个类别中的差异,可参考下图所示:

Cosmos-Reason 1 的架构如下:

Cosmos-Reason 1 的训练方式:

Cosmos-Reason 1 的使用示例:

Cosmos 平台组件

目前,Cosmos 平台主要包括以下几个组成部分:

Video Curator

这是一个提供完整工具链的流程,让用户能够编辑和准备所需的训练资料。

Cosmos 世界基础模型的训练数据分布 如下,其中绝大部分数据集与物理人工智能 相关。所收集的视频总时长达到2000万小时,分辨率涵盖从720p到4k。

经过切割的视频片段会通过以下4种过滤器,筛选出适合训练世界基础模型的优质内容:

-

运动过滤器:过滤掉物体静止或无运动的视频片段。

-

画质过滤器:过滤掉存在严重畸变或噪音的视频片段。

-

文本叠加过滤器:过滤掉含有硬字幕的视频片段。

-

视频类型过滤器:过滤掉游戏画面或动画内容。

随后,视频会经由视觉语言模型(VLM) 自动添加描述字幕。在去重阶段 ,系统会滤除内容高度相似的片段。最后,这些精选的视频片段会被组织成网页数据集,供模型训练师进行训练(此步骤称为分片)。

Tokenizers(分词器)

视频分词器(Video Tokenizers)的目标,是以一种高效的方式编码和表示视频中所蕴含的信息。

Tokenizer 又可以分为连续型 (例如 VideoLDM)与离散型(例如 VideoPoet)两种:

分词器 的核心在于实现高压缩率 ,同时重建质量 也必须保持高水平,其本质是一种自编码器。以下两张图展示了 Cosmos-Tokenize 1 与现有其他分词器的性能比较。

Cosmos-Tokenizer 1 将每4帧图像通过小波变换,切分成若干组(时域窗口),随后送入编码器。其数学表示如下:

其目的在于保留视频前后帧之间的时间因果关系,具体架构可参考下图:

经过小波变换后,数据会进一步经过下采样 等层的处理,而解码器则采用编码器的逆过程架构:

在训练策略上,Cosmos-Tokenizer 1分为两个阶段。首先,最小化原始视频与重建视频之间的像素RGB差异。

通过L1损失进行优化,以最小化输入视频与重建视频之间的像素级RGB差异。

以及基于VGG-19的特征损失

在第二个阶段,会基于RAFT这篇论文去最小化光流损失

以及基于《Image Style Transfer Using Convolutional Neural Networks》所计算出的Gram矩阵损失。

不同分词器之间的比较结果

此处我们大致列举了不同分词器之间的比较。

世界基础模型预训练(Pre-trained WFMs)

Cosmos 预训练的 WFMs 分为 Diffusion-based 与 Autoregressive-based 两类。Diffusion-based 的 WFM 将生成问题分解为一系列去噪问题,而 Autoregressive-based 则将生成问题分解为一系列 Token 预测问题。

Cosmos 预训练 WFMs 的路线图如下:

以Diffusion-based模型为例,首先训练Text2World 模型,再引入视频作为输入,通过微调得到Video2World 模型。Diffusion-based模型使用连续型Token,因此采用对应的CV Tokenizer。训练所使用的文本提示由VLM生成,这与人工编写的提示通常存在差异,因此添加一个增强器来处理人工提示与VLM生成提示之间的差别。

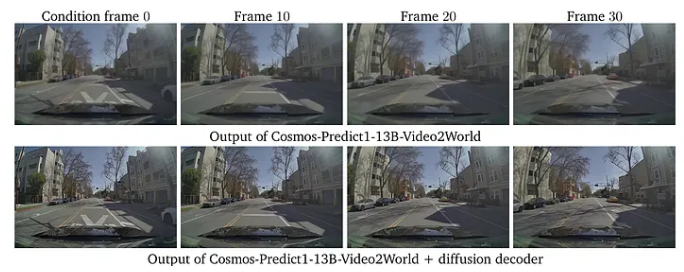

而Autoregressive-based模型则直接训练纯视觉输入的Llama3-style GPT模型,随后加入文本提示训练为Video2World模型,并采用离散型DV Tokenizer。为应对高压缩率带来的失真问题,在增强器部分引入一个Diffusion Decoder(基于Cosmos-Predict1--7B-Decoder),将Discrete Tokens转换为Continuous Tokens。

Diffusion-based World Foundation Model

参考EDM的去噪分数匹配损失,损失函数可定义为:

其中,x0 是从训练数据集中采样得到的视频,n ∼ 𝒩(0, 2σ²I) 为高斯噪声。

关于EDM ,笔者后面有时间的话会另行撰写文章介绍。EDM 提出从设计的角度 审视扩散模型,质疑了先前过于理论化且难以修改的扩散模型范式。

基于 EDM 的 Preconditioning Design,Diffusion-based WFM 的训练损失可以表示为

σ 为噪声水平,由 Pmean 和 Pstd 两个超参数控制。σdata 则是训练数据中的标准差,而 λ(σ) 用于确保在训练初始阶段,各噪声水平具有等价的贡献。

随着训练的进行,λ(σ) 的平衡可能会劣化,因此设计了 u(σ) 来对冲各噪声水平在损失函数上造成的不确定性。例如,当去噪器对任务的不确定性较高时,噪声水平 σ 的贡献就应随之降低,也就意味着此时的 u(σ) 会较高。

架构

Diffusion-based 的预训练模型基于 DiT,其架构如下。

训练策略

为提升跨模态的认知能力,Cosmos 预训练的 WFM 将视频与图片混合在批次中一同训练。

这种方法源于以下观察:减少图像与视频潜表示之间的分布偏移,能够提升生成质量。

Cosmos 预训练的 WFM 采用阶段性训练,分辨率从低到高逐步提升。

提示词上采样器

如前所述,提示词上采样器的目的是处理用户推理时输入的提示词与训练所用提示词之间的差异,其目标可分为以下三点:

-

对输入提示词的保真度:上采样后的提示词必须忠实保留原始用户输入的关键要素,包括主要角色、动作或运动、关键属性以及整体意图。

-

与训练分布的对齐:上采样后的提示词应在长度、语言结构和风格上与 WFM 训练时使用的提示词分布高度相似。

-

增强的视觉细节:上采样后的提示词应能引导 WFM 生成更精确的视觉效果。

基于自回归的世界基础模型

自回归式 WFM 将生成过程视为预测下一个 Token 的问题。视频首先会被离散型分词器拆解为一系列 Token V = (v1, v2, ..., vn),而模型的目标是训练一个 Transformer 解码器来最小化以下损失:

Θ 是 Transformer 解码器的参数

Autoregressive架构

与基于扩散(Diffusion-based)的模型类似,自回归(Autoregressive)模型同样采用了 T5 Text Encoder 以及 3 DAbsolute + RoPE Position Embedding。

训练策略

自回归模型的训练分为以下三个阶段:

阶段 1:目标是给定视频第一帧,预测后续几帧。在17帧的视频中,给定第一帧,预测未来16帧。

阶段 1.1:将视频长度扩展到34帧,利用YaRN扩展RoPE。

阶段 2:加入文本条件,仍配合34帧长度的视频进行训练。

面向实时生成的推理优化

自回归WFM采用Medusa进行推理加速。下表评估了Medusa头数量对推理速度的影响,最终采用增加9个Medusa头的方案。

此外,针对需要微调的Transformer层也总结了一些结论,并得出以下实验结果:

我们通过实验发现,在保持主干网络冻结的情况下,仅解冻最后两个Transformer层及最终的解嵌入层,能够获得最佳性能。

为加速推理,自回归模型会将视频压缩至320 * 512的分辨率,因此需在低分辨率视频上对原有预训练模型进行微调。

离散型分词器(Diffusion Decoder)

离散型分词器(Diffusion Decoder)会对图像进行高压缩,导致生成的视频容易出现模糊。因此,额外设计了一个分词器解码器来处理这个问题。如下图所示,在训练时会另外搭配一个CV Tokenizer(连续型分词器能够保存更多原始视频信息)。

Inference的流程如下图所示

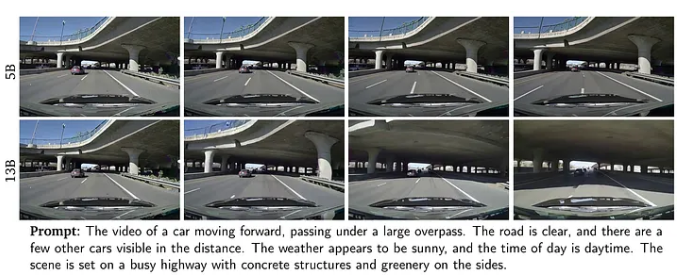

推理结果

预训练WFM的评估

预训练的WFM主要从3D一致性 和物理对齐两个层面进行评估。

3D一致性

理想的WFM应能从几何上合理的3D世界生成视频模拟。Cosmos针对RealEstate 10K中的静态场景进行评估,并与VideoLDM进行比较。在几何一致性方面,Cosmos评估了生成视频各帧之间的对极几何约束 是否被满足,以及姿态估计的成功率。此外,在视图合成一致性部分,评估了各生成图像的3D结构一致性。

物理对齐

Cosmos 在虚拟物理引擎(PhysX + Isaac Sim)生成的基准数据集上进行验证,确保生成的视频遵循牛顿力学和刚体动力学规律(将模型生成的视频与虚拟物理引擎渲染出的视频进行比较)。

评估的物理效应如下:

-

自由落体物体:物体在平面上坠落(涉及重力、碰撞等)

-

倾斜平面坡度:物体沿斜面滚下(涉及重力、转动惯量等)

-

U形坡度:物体沿U形坡面滚下(涉及势能、动能等)

-

稳定堆叠:处于平衡状态的物体堆叠(涉及力的平衡)

-

不稳定堆叠:处于失衡状态的物体堆叠(涉及重力、碰撞等)

-

多米诺骨牌:一系列矩形积木依次倒下(涉及动量传递、碰撞等)

-

跷跷板:物体置于跷跷板两端(涉及扭矩、转动惯量等)

-

陀螺:在平面上旋转的陀螺(涉及角动量、进动等)

比较的图示如下:

物理对齐的测试结果如下

WFM 后训练模型

下表为 Cosmos 列出的几种在下游应用中经过后训练的 WFM 模型

后训练模型示例

此处列举的模型仅作示例,并非完整系统。开发者需基于自身的数据集对模型进行额外微调。

用于相机控制的后训练 WFM

Cosmos-Predict1--7B-Video2World Sample-CameraCond 的目标是通过单张图像及相机轨迹,生成具有合理3D结构的视频。

数据集

数据集采用 DL3DV-10K ,并通过 GLOMAP 这类结构光运动恢复方法重建相机姿态标注,同时利用 VLM 为视频添加文本提示标签。

微调(Fine-tuning)

Cosmos-Predict1--7B-Video2World Sample-CameraCond 通过一个基于普吕克坐标 的嵌入层来实现相机控制的条件输入。普吕克坐标在光场网络中用于表示 360 度的光场,其特性是便于表示空间中的直线及相关计算。

参考Light Field Network,Cosmos 通过 Plücker 坐标编码相机姿态:

其中 c 是某一帧中相机原点的世界坐标,该世界坐标即第一个帧的相机坐标 。d 则为从相机原点出发、穿过所有像素 (u, v) 的光线,如下图所示:

所有相机姿态均相对于初始帧进行计算。

评估

Cosmos 用于评估后训练模型的指标包括:

-

视频生成质量 :通过 Fréchet Inception Distance 与 Fréchet Video Distance 衡量

-

3D 一致性 :通过 结构从运动 重新估计的相机姿态进行评估

后训练结果

针对机器人操作的后训练模型

针对机器人操作的后训练主要分为以下两类:

-

基于指令的视频预测:给定当前帧及一段文本指令,输出为根据该指令生成的视频。

-

基于动作的下一帧预测:给定当前帧及当前帧与下一帧之间的动作向量,输出为根据该动作生成的下一帧。

数据集

针对基于指令的模型,Cosmos 创建了 Cosmos-1X 数据集 。该数据集主要通过 1x.tech 公司的 EVE 机器人 进行采集。

基于动作的模型则使用 Bridge 数据集,其对应的动作向量参考了 OpenVLA 中的夹爪坐标空间:

微调

由于基于动作模型的动作向量 在预训练阶段未被使用,因此在后训练时,会在 Cosmos-Predict1--5B-Video2World-Sample-ActionCond 这类模型中增加一个MLP层,用于将动作向量嵌入为张量,并整合到交叉注意力机制中(与T5文本嵌入的处理方式相同)。

评估

针对基于指令的模型,Cosmos 提出以下四个维度进行评估:

-

指令跟随:生成的视频是否与输入的语言指令一致?

-

物体持久性:场景中存在的物体是否在整个生成的视频中持续出现?

-

真实性:生成的视频是否真实反映了现实世界,没有出现意外的虚构物体?

-

整体合理性:生成的视频是否合理,足以让机器人据此进行规划?

评估通过人工进行:

人工评估员的任务是观察由不同模型生成、但基于相同语言指令的一对匿名视频,并依据上述维度进行比较。一组十名评估员对 23 个测试片段进行了评估。

与基线模型 VideoLDM-Instruction 的比较结果如下:

对于基于动作的模型,则直接与真值帧进行比较:

针对机器人操作的后训练模型结果

防护机制

针对WFM的使用,Cosmos设置了相应的保护机制,例如某些关键词不得用作指令,以及对人脸进行模糊化处理等。具体细节可直接参考论文第七章,笔者在此不做赘述。