在短视频时代,影视解说类内容已经成为众多创作者的首选赛道。但要完成一条高质量的影视解说视频,往往需要字幕提取、文案撰写、配音合成、视频剪辑等多个步骤,过程复杂且耗时。

今天介绍的 narrator-ai-cli,是一款专为影视解说场景打造的命令行工具,基于AI解说大师开放接口实现全流程自动化。和同类 WebUI 工具最大的不同在于:CLI 架构让它可以被脚本调用、被 AI Agent 驱动,不只是一个手动操作的工具,而是一个可以接进自动化工作流的能力模块。

一、narrator-ai-cli 的核心功能

一条命令完成全流程

从字幕提取到成片输出,一条命令跑通全流程:字幕提取 → 关键帧抽取 → 文案生成 → 配音合成 → 本地视频合成。原片不上传,只有轻量载荷走云端,本地不需要 GPU 和本地大模型。

风格化学习模型

内置多个预置学习模型(喜剧、悬疑、情感),同一部电影用不同模型生成的文案风格差异极大,读起来像完全不同的人写的。也支持上传自定义风格样本训练专属模型。

分步模式与人工审阅

文案生成和视频合成是独立步骤,支持在文案阶段介入修改,确认后再合成视频。文案不满意重新生成,不需要重跑视频合成,节省点数消耗。

多场景支持

纪录片场景支持逐帧视觉分析,识别图表和地图内容;短剧混剪场景支持多段素材输入和前3秒钩子优化;影视解说场景支持完整叙事结构理解和风格化文案生成。

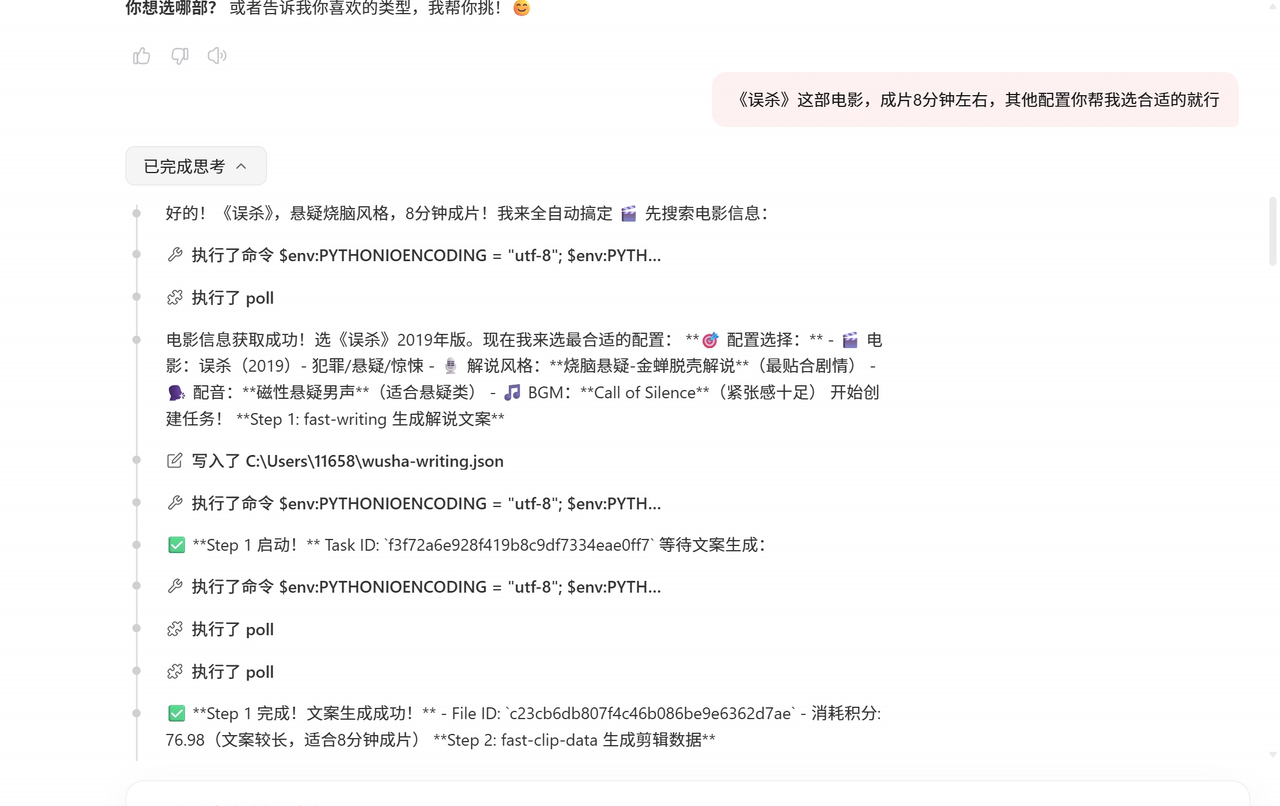

AI Agent 接入

提供官方 SKILL.md 文件,支持 QClaw、WorkBuddy、小龙虾 OpenClaw 等主流 AI Agent 直接加载。加载后在对话框说一句话,Agent 自动完成从字幕提取到成片输出的全流程。

多平台适配

支持抖音、B站、小红书、YouTube 等主流平台,平台参数(前3秒钩子、字幕样式、视频比例)自动适配。

二、narrator-ai-cli 的核心亮点

- CLI 架构:可脚本化、可 Agent 驱动

这是 narrator-ai-cli 和同类 WebUI 工具最本质的架构差异。streamlit WebUI 的交互单元是鼠标点击,无法被脚本调用,也无法被 AI Agent 驱动。CLI 架构意味着:

-

可以写 bash 脚本批量处理一批素材

-

可以接进 cron 定时任务实现定时出片

-

可以被 QClaw、WorkBuddy、小龙虾等 AI Agent 通过 Skill 文件直接调用

<BASH>

批量处理示例

for file in ~/Videos/*.mp4; do

narrator-ai-cli commentary create-movie \

--movie-file "$file" \

--platform "抖音" \

--output ~/Videos/output/(basename "file" .mp4)_解说.mp4

done

- 本地优先架构:原片不上传

原片始终在本地硬盘,只有字幕文本(几十 KB 的 SRT)、关键帧序列(几 MB 的 JPEG)、生成好的配音(几 MB 的 MP3)这些轻量载荷走云端。一部 2 GB 的电影,全程不上传,4G 信号都能稳定跑完整条流程。

- 无需本地 GPU 和本地大模型

所有模型计算(文案生成、语音合成、视频理解)全部在云端完成。CPU 4核、内存 8G 的普通笔记本完全够用,不需要配置 pytorch 和 CUDA 环境。

- 分步模式支持人工审阅

<BASH>

Step 1:生成文案,输出 JSON 供审阅

narrator-ai-cli commentary create-script \

--movie-file ~/Videos/movie.mp4 \

--output-script ~/Scripts/script.json

Step 2:确认后合成视频

narrator-ai-cli commentary create-video \

--script ~/Scripts/script.json \

--movie-file ~/Videos/movie.mp4 \

--output ~/Videos/movie_解说.mp4

- 执行前预估消耗,确认后才扣费

每次执行前显示预估点数消耗,用户确认后才会继续,不会有意外消耗。

三、两类解说场景的应用

影视解说原创脚本

输入一部完整电影,指定风格学习模型,自动生成有辨识度的解说文案、配音和成片。支持喜剧、悬疑、情感等多种风格,适合个人解说博主和有账号调性要求的内容团队。

<BASH>

narrator-ai-cli commentary create-movie \

--movie-file ~/Videos/movie.mp4 \

--learning-model-id narrator-comedy-001 \

--platform "抖音" \

--output ~/Videos/movie_恐怖悬疑风格.mp4

短剧混剪解说

支持多段素材输入,自动重建情节逻辑,开启前3秒钩子优化,适配抖音和快手的完播率算法。适合短剧账号运营团队和 MCN 批量生产场景。

<BASH>

narrator-ai-cli commentary create-movie \

--movie-file ~/Videos/clip1.mp4 ~/Videos/clip2.mp4 \

--scene-type short_drama \

--hook-optimization \

--platform "抖音" \

--output ~/Videos/shortdrama_解说.mp4

四、如何快速上手 narrator-ai-cli

- 安装

<BASH>

pip install narrator-ai-cli

系统要求:Python 3.8+,FFmpeg 已安装。

- 配置 APP Key

<BASH>

narrator-ai-cli config set app_key 你的API_Key

APP Key 按照git指引获取即可。

- 验证安装

<BASH>

narrator-ai-cli --version

narrator-ai-cli user balance

看到版本号说明链路已通。

- 跑第一条解说

<BASH>

narrator-ai-cli commentary create-movie \

--movie-file ~/Videos/movie.mp4 \

--platform "抖音" \

--output ~/Videos/movie_解说.mp4

- 接入 AI Agent(可选)

<BASH>

下载 Skill 文件

git clone https://github.com/jieshuo-ai/narrator-ai-cli-skill.git

放到小龙虾 Skill 目录

cp narrator-ai-cli-skill/SKILL.md ~/.openclaw/skills/narrator-ai-cli/SKILL.md

重启 Agent,在对话框说一句话即可触发全流程。

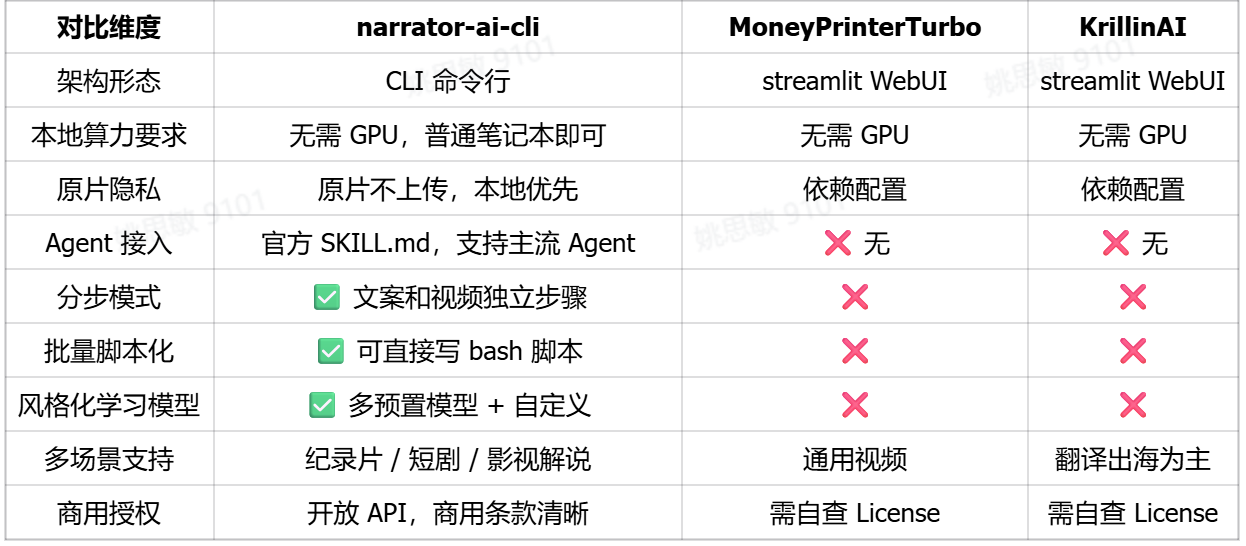

五、narrator-ai-cli 与同类工具的核心差异

三款工具的定位差异一句话说清楚:

-

MoneyPrinterTurbo:通用短视频生成,覆盖场景广,适合快速出各类短视频内容,不专注影视解说

-

KrillinAI:以视频翻译和出海本地化为核心,适合需要多语言字幕和配音的出海内容团队

-

narrator-ai-cli:专注影视解说场景,CLI 架构支持脚本化批量生产和 Agent 工作流接入,适合有自动化需求的内容团队

三款工具解决的核心问题不同,不存在绝对的优劣之分。如果你的需求是批量生产影视解说、或者需要把解说能力接进 AI Agent 工作流,narrator-ai-cli 是目前这个场景里唯一有官方 Skill 支持的选项。

六、总结

narrator-ai-cli 是一款为命令行和 Agent 时代设计的影视解说工具。pip 安装,无需 GPU,无需本地模型,一条命令跑通字幕提取到成片输出的全流程。

CLI 架构让它可以被脚本批量调用,SKILL.md 让它可以被 QClaw、WorkBuddy、小龙虾等 AI Agent 直接驱动。如果你的工作流已经在往 Agent 方向迁移,或者需要批量生产解说内容,narrator-ai-cli 值得优先试一下。

体验全流程自动化的影视解说创作,解锁高效创作新方式!