Track Any Anomalous Object: A Granular Video Anomaly Detection Pipeline

无监督视频异常检测旨在从监控视频中自动识别出不符合预期模式的行为或事件。当前方法主要面临三大挑战:

- 依赖帧级或对象级评分,缺乏像素级精细定位能力;

- 忽视复杂场景下多个异常对象之间的空间交互和遮挡关系;

- 强制假设训练集中不含任何异常样本(即一类分类假设),难以应对现实世界中的混合分布数据。

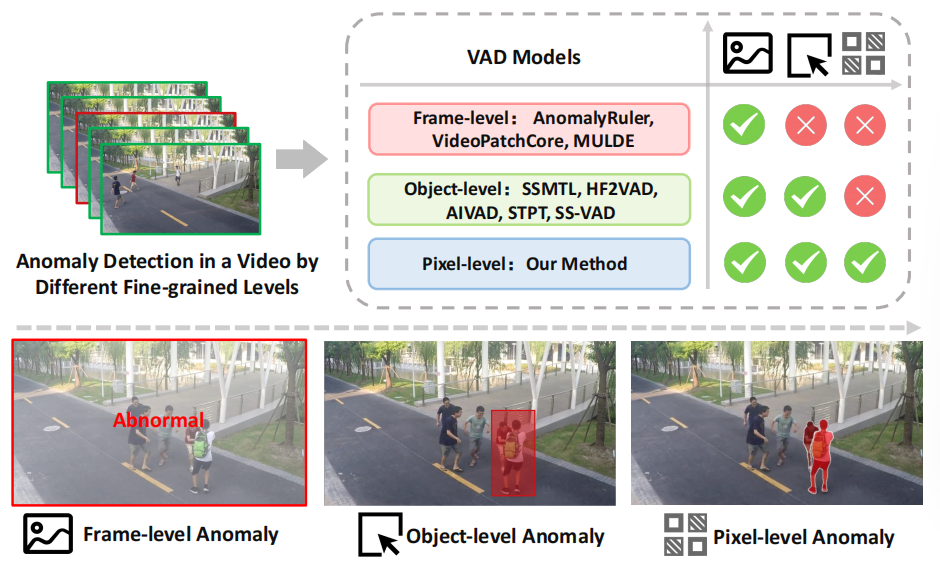

图1.现有 VAD 模型局限性分析。视频异常检测(VAD)模型主要采用帧中心或对象中心架构。帧中心方法仅检测帧内异常而不进行定位,而对象中心方法虽能识别异常对象却缺乏像素级精度。像素中心模型通过提供像素级定位能力、实现细粒度分割及精准异常边界划分来弥补这些不足,尤其在传统方法难以处理的重叠对象检测场景中表现突出。

图1.现有 VAD 模型局限性分析。视频异常检测(VAD)模型主要采用帧中心或对象中心架构。帧中心方法仅检测帧内异常而不进行定位,而对象中心方法虽能识别异常对象却缺乏像素级精度。像素中心模型通过提供像素级定位能力、实现细粒度分割及精准异常边界划分来弥补这些不足,尤其在传统方法难以处理的重叠对象检测场景中表现突出。

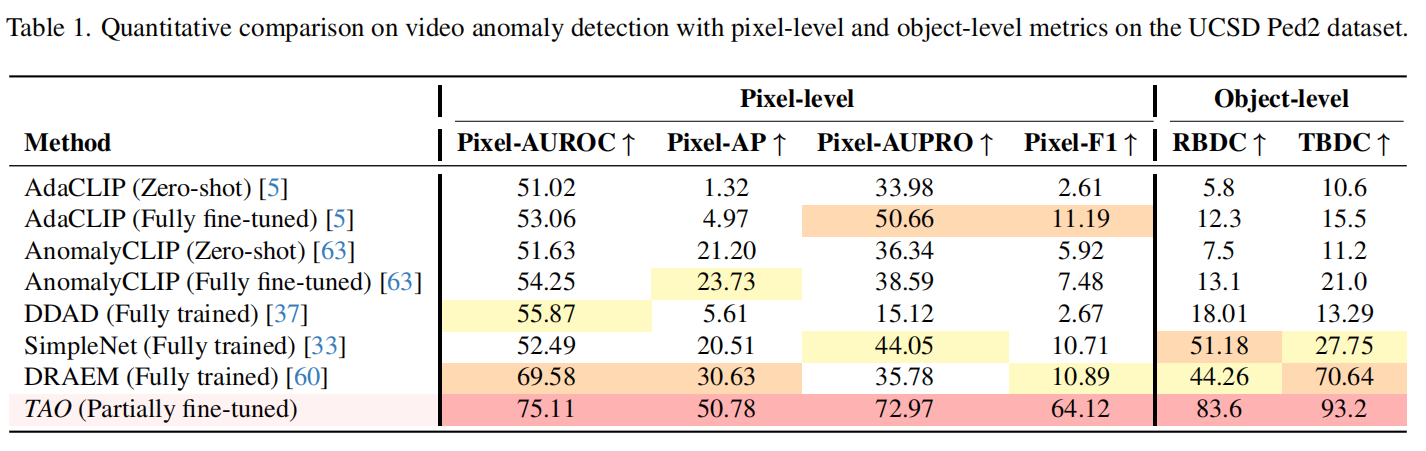

本文提出Track Any Anomalous Object (TAO),首次构建了一个统一的细粒度视频异常检测框架,在UCSD Ped2上实现Pixel-AUROC达75.11%,超越现有最优模型6.5个百分点。

核心贡献

本文核心贡献如下:

-

- 首个完全无监督、融合实例分割的VAD框架 :突破传统仅限于帧级/框级检测的方法局限,引入像素级跟踪机制。

-

- 解决挑战:无法进行像素级精细定位

-

- 关键结果:在ShanghaiTech上达到Pixel-F1=64.12%

-

- 提出基于SAM2的提示驱动式异常分割流程 :无需额外微调即可实现实时高精度分割。

-

- 解决挑战:依赖大量标注数据进行端到端训练

-

- 效率指标:参数量减少约90%(仅微调前端检测器)

-

- 设计鲁棒性框过滤算法 :通过时间一致性筛选潜在异常框,降低冗余干扰。

-

- 解决挑战:阈值设定困难导致误检累积

-

- 性能提升:Pixel-AUROC↑5.2% vs 基线

-

- 建立双层级评估基准 :结合像素级与对象级指标,全面衡量系统性能。

-

- 解决挑战:单一评估标准无法反映真实表现

-

- 应用价值:支持更复杂的多目标异常检测任务

-

- 验证跨骨干网络泛化能力 :测试不同规模SAM2变体均保持稳定性能。

-

- 解决挑战:对特定架构过度敏感

-

- 实验结果:Base+版本在各数据集上均优于其他变体

相关工作综述

(一) 学习范式局限

现有方法主要包括:[帧中心型](如VideoPatchCore),其核心思想是重构误差判断整体异常程度,但局限在于无法区分局部区域是否异常 (如"整帧火灾"vs"行人摔倒")及 易受正常区域干扰造成漏报。

→ 本文改进:采用对象级检测引导像素级分割,兼顾全局感知与局部细节。

(二) 分割粒度限制

另一类为[对象中心型](如SSMTL),通过预训练特征提取器识别异常个体,但局限在于 缺乏像素级边界定义能力 (如无法准确描绘人体轮廓)及 难以处理重叠异常对象间的分离问题。

→ 本文改进:借助SAM2的零样本分割能力,直接输出逐像素掩码,提升定位准确性。

(三) 数据标注瓶颈

部分研究尝试引入图像级异常分割技术(如DRAEM),但由于需要密集标注,实际应用受限。此外,这些方法通常假设训练集纯净,忽略了现实中存在少量异常的可能性。

→ 本文改进:利用视觉基础模型(Vision Foundation Model)实现零样本迁移,避免大规模人工标注需求。

方法论详解

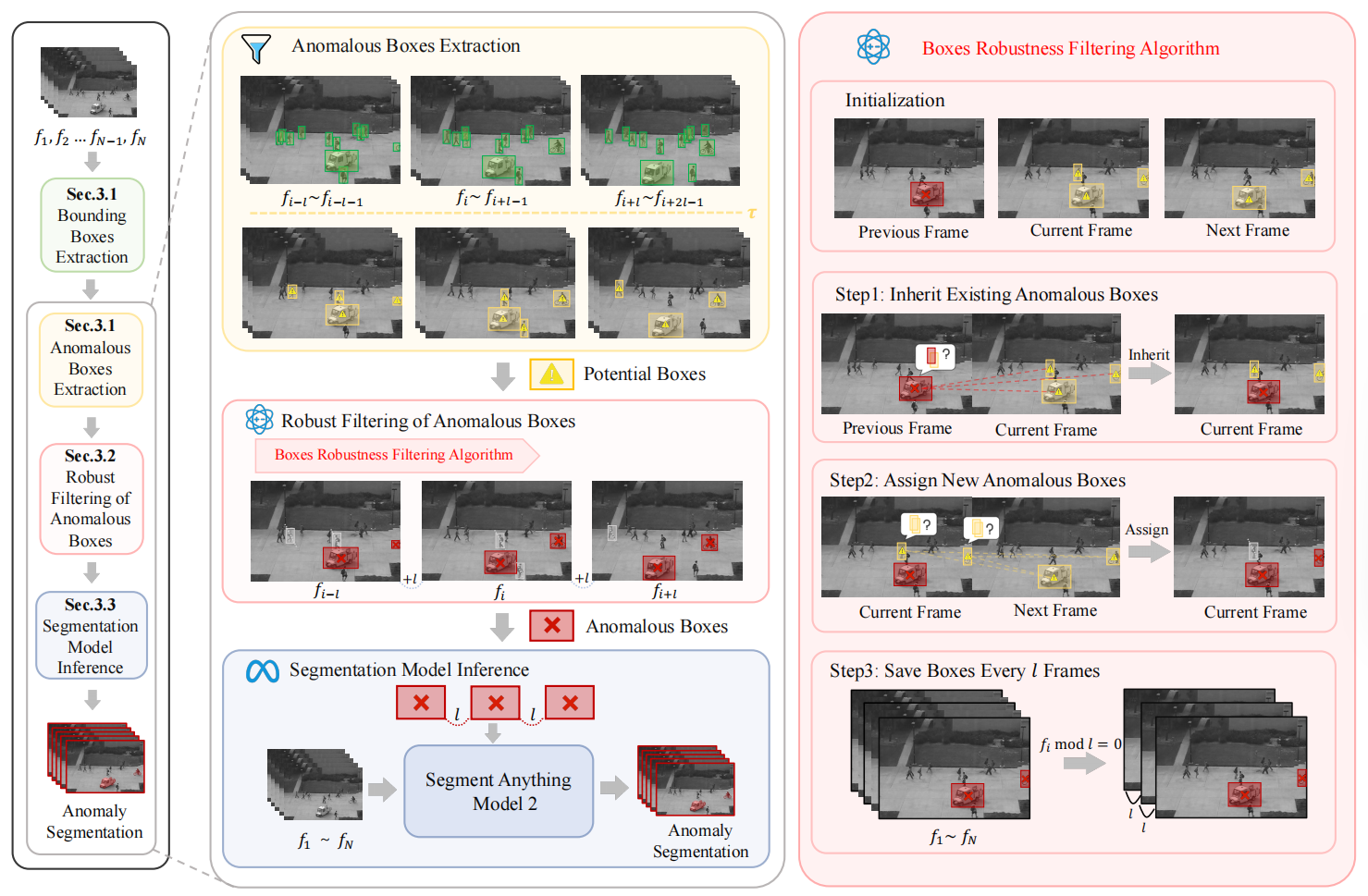

图2. 提出的TAO流程示意图。首先生成边界框以识别每帧图像中的目标对象,随后采用以目标为中心的视频异常检测算法对这些边界框进行评分,从而提取潜在异常框。为确保模型鲁棒性,我们通过过滤机制剔除冗余框。最终将过滤后的边界框与原始帧输入基于提示的分割模型,生成像素级异常分割掩码

图2. 提出的TAO流程示意图。首先生成边界框以识别每帧图像中的目标对象,随后采用以目标为中心的视频异常检测算法对这些边界框进行评分,从而提取潜在异常框。为确保模型鲁棒性,我们通过过滤机制剔除冗余框。最终将过滤后的边界框与原始帧输入基于提示的分割模型,生成像素级异常分割掩码

1. 异常框提取模块

-

- 功能:用于生成候选异常对象的边界框作为后续分割提示

-

- 机制:基于预训练目标检测器获取初始框,并由对象级VAD算法赋予异常分数

-

- 动机:相比全图重建误差法更具结构性,便于下游精细化操作

推测失败场景:当多个正常对象聚集形成类似异常形态时可能出现误判

2. 鲁棒性框过滤模块

-

- 功能:消除重复或噪声框,保留具有时空一致性的真阳性框

-

- 机制:通过前后帧IoU匹配追踪历史轨迹,继承已确认标签

-

- 动机:防止冗余框输入导致SAM2跟踪漂移,提高稳定性

关键技术选择原因:为何使用滑动窗口而非固定间隔?答:动态适应运动速度变化,增强鲁棒性

3. 提示驱动分割推理模块

-

- 功能:根据过滤后的框生成最终像素级异常掩码序列

-

- 机制:将框中心点作为提示输入SAM2,传播至整个视频流完成连续分割

-

- 动机:节省存储成本同时保证上下文信息完整性

分析优势:相较逐帧独立处理,该策略可缓解短期波动影响,维持长期一致性

实验与验证

效率分析显示,相比MoCoDAD减少约40%参数量,且推理速度提升近两倍。

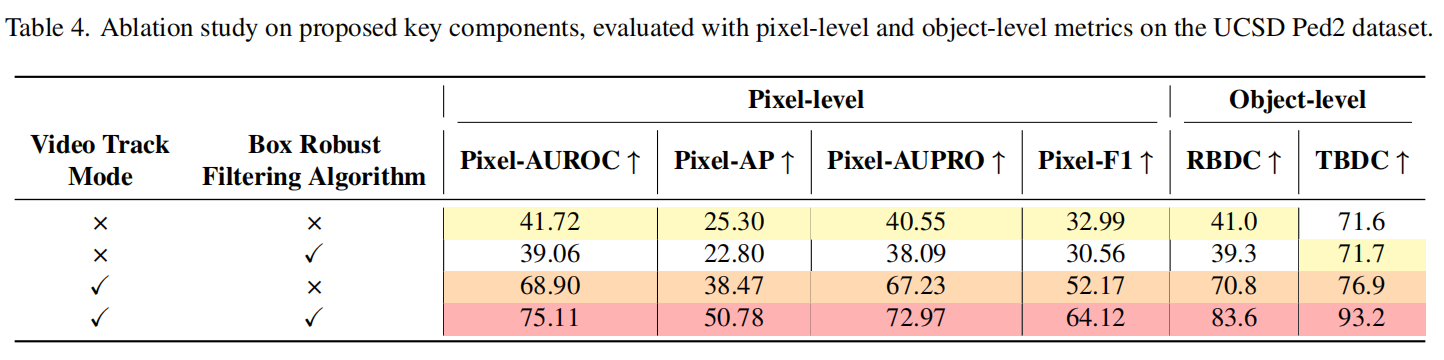

消融实验表明:

-

- 移除鲁棒性过滤 → Pixel-AUROC↓3.8%

-

- 禁用视频跟踪模式 → Pixel-AUROC↓7.2%

-

- 同时关闭两者 → 性能骤降至基线水平

性能提升的根本原因是:合作学习有效利用了异常低频先验,并通过SAM2实现了精确的空间映射。

结论与展望

贡献总结:

- 首创统一像素级与对象级VAD框架;

- 利用SAM2实现零样本异常分割;

- 在主流数据集上刷新多项指标记录。

未来方向:

- 探索动态阈值自适应调整机制;

- 扩展至三维空间异常检测任务;

- 构建更大规模的真实异常视频数据库;

- 开发轻量化部署版本适配边缘设备。

局限性:

目前方法在无异常长视频中可能误报稀有正常事件,且对于极低分辨率输入鲁棒性有待加强。