videopipe下载和编译参见VideoPipe学习之环境搭建及编译ubuntu240403。

1 运行一个demo

运行下1-1-1_sample这个demo,需要数据模型准备,还要一个可选的终端链接软件。

2 数据模型准备

想要1-1-1_sample跑起来,需要模型和数据。

2.1 数据

其数据我下载下来了,如下:

通过网盘分享的文件:vp_data

链接: https://pan.baidu.com/s/12_EzZgx-sb7GF0_6anMHTQ?pwd=vqh6 提取码: vqh6

2.2 远程终端软件

推荐用mobaxtem,比xshell和vscode的好,不用管x11转发,非常省心,其他两个要装x11的转发插件,xshell还好点,vscode的x11转发插件就比较恶心------不稳定。

3 运行

3.1 数据目录存放

下载的vp_data目录和demo放到同级目录下,如下我的:

为啥呢?看下/samples/1-1-1_sample.cpp代码:

cpp

int main() {

......

// create nodes

auto file_src_0 = std::make_shared<vp_nodes::vp_file_src_node>("file_src_0", 0, "./vp_data/test_video/face.mp4", 0.6);

auto yunet_face_detector_0 = std::make_shared<vp_nodes::vp_yunet_face_detector_node>("yunet_face_detector_0", "./vp_data/models/face/face_detection_yunet_2022mar.onnx");

auto sface_face_encoder_0 = std::make_shared<vp_nodes::vp_sface_feature_encoder_node>("sface_face_encoder_0", "./vp_data/models/face/face_recognition_sface_2021dec.onnx");

auto osd_0 = std::make_shared<vp_nodes::vp_face_osd_node_v2>("osd_0");

auto screen_des_0 = std::make_shared<vp_nodes::vp_screen_des_node>("screen_des_0", 0);

......

}它用的数据路径如下:

"./vp_data/test_video/face.mp4"

"./vp_data/models/face/face_detection_yunet_2022mar.onnx"

"./vp_data/models/face/face_recognition_sface_2021dec.onnx"

所以要把/build/bin/1-1-1_sample这个demo拷贝到vp_data目录的同级下,当然你可以修改源码自定义。

3.2 运行效果

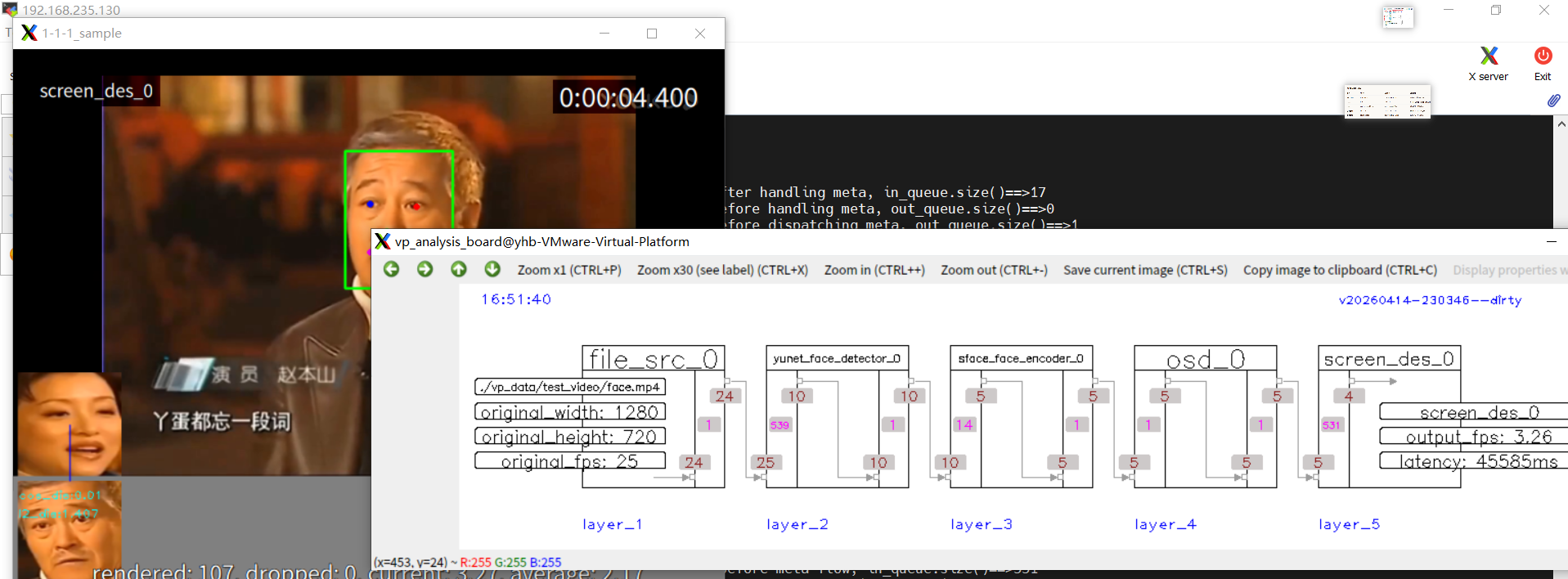

在mobaxtem里或者虚拟机里直接./1-1-1_sample运行如下效果: