导读

多数据集混合训练是提升模型泛化能力的常见策略,但如果不同数据集对同一语义类别采用了不同的空间标注规范,直接混合会怎样?Unstructured Technologies的研究团队给出了一个反直觉的答案:直接混合训练不仅没有提升,反而让预训练模型的表格识别指标(table TEDS)从0.800降到0.750,单元格内容准确率从0.767降到0.715。

为解决这一问题,他们提出了Agentic Harmonization方法,在训练之前利用VLM Agent逐页协调不同数据集间的标注差异,将标注统一到同一规范下。协调后的模型不仅恢复了退化的性能,还在17项评估指标中的14项取得最优,检测F-score从0.860提升至0.883,table TEDS从0.800提升至0.814。

论文信息

- 标题:Improving Layout Representation Learning Across Inconsistently Annotated Datasets via Agentic Harmonization

- 作者:Renyu Li, Vladimir Kirilenko, Yao You, Crag Wolfe

- 机构:Unstructured Technologies

一、跨数据集标注不一致:被忽视的训练陷阱

文档布局检测旨在识别页面中的段落、标题、表格、列表等结构元素。在实际应用中,研究者通常希望通过混合多个数据集来扩大训练数据量,从而提升模型的泛化能力。然而,不同数据集之间存在两类根本性的标注不一致。

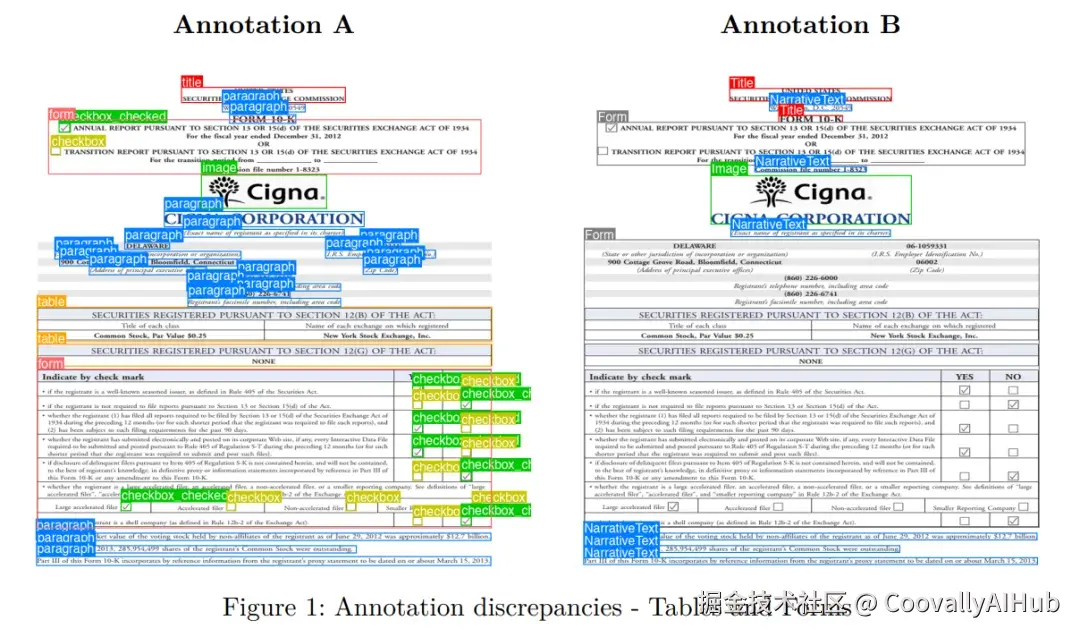

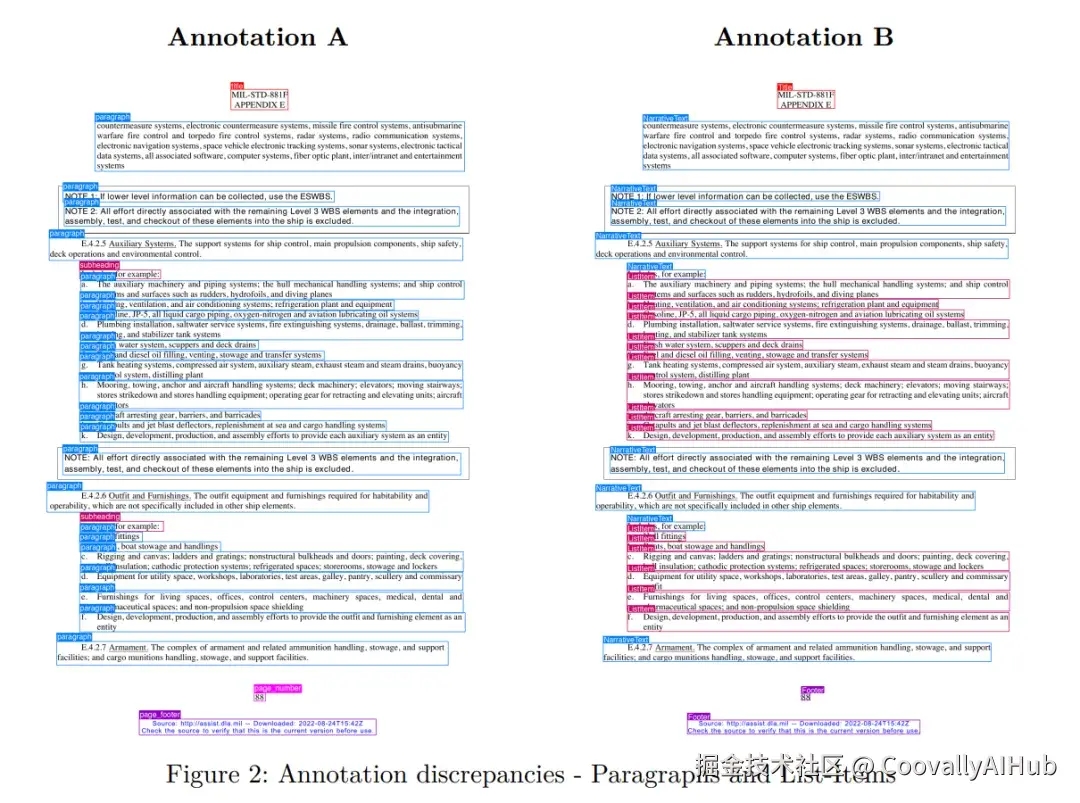

分类不对齐 。论文使用的两个数据集------Unstructured (私有,47,744张训练图像,810,644条标注,16个类别)和DocLayNet 25k(公开,25,000张图像,328,756条标注,10个类别)------在类别定义上存在显著差异。16个Unstructured类别和10个DocLayNet类别之间,只有8个可以直接对应(如paragraph对应Text,subheading对应Section-header)。Unstructured独有checkbox、code_snippet、form等8个类别,DocLayNet独有Caption和List-item两个类别。

空间不一致 。即使在共享的类别之间,标注框的空间范围也差异悬殊。例如,table区域在Unstructured中比DocLayNet大5.2倍 ,page_footer框大6.3倍 ,subheading框大4.7倍。这意味着同一个段落,一个数据集可能标注为包含周围空白的粗粒度块,另一个数据集则标注为与OCR边界对齐的细粒度框。

这种不一致的后果在实验中体现得非常明显。论文以IBM Docling Heron (基于RT-DETR v2,ResNet-50vd backbone,6层decoder)为基础检测器,在SCORE-Bench评估框架下进行测试。直接混合两个数据集进行训练(Naive mixed fine-tuning),表格相关指标全面退化:table TEDS从0.800降到0.750(-0.050),cell_level_content_acc从0.767降到0.715(-0.052),page_teds从0.778降到0.733(-0.045)。混合训练不是简单的"数据越多越好"。

图片来源于原论文

二、Agentic Harmonization:VLM Agent驱动的标注协调

针对上述问题,论文提出了Agentic Harmonization方法,核心思路是:在训练之前,用VLM Agent逐页审视并转换源数据集的标注,使其与目标标注标准对齐。

形式化描述。给定K个源数据集D_k = {(I_i, A_i)},其中I_i为页面图像,A_i为标注集合。Agent F将每页标注转换为协调后的版本:Â_i = F(I_i, A_i; R),其中R是从目标检测器原生标注标准中提取的结构化规则集。Agent将M_i个源标注划分为G_i个不相交组S_r,每组通过统一算子M_R转换为一个协调标注â_r。

Agent的决策依赖两种推理信号:

- 视觉推理:Agent观察页面图像,理解实际的视觉布局结构,而非仅依靠标签名称做出判断

- 语言推理:Agent理解标签语义和不同标注规范之间的差异,做出合理的映射决策

对于每个源标注,Agent可以执行三种操作之一:保留 原有标注、与相邻标注合并 、或对边界/类别进行修正。

两个关键设计约束保证了协调过程的可靠性:

- 视觉接地推理(Visually-Grounded Reasoning) :Agent的所有决策必须基于实际页面图像中的视觉结构,避免仅凭标签名称做出错误映射。例如,一个被标为"Text"的区域,Agent需要看到图像后才能判断它在目标标准下应该是paragraph还是list_item。

- 标注守恒(Annotation Conservation) :每个输入标注在输出中必须恰好出现一次------要么被保留,要么被合并到某个组中,要么被修正。不允许凭空创建新标注,也不允许删除任何输入标注。这一约束确保了协调过程的可追溯性。

统一后的分类法包含17个类别,保留了Unstructured的细粒度form和checkbox类别,同时纳入了DocLayNet的figure_caption和list_item。

三、实验结果:协调训练全面超越预训练和混合训练

论文在SCORE-Bench上对三种训练策略进行了系统对比:预训练模型(Heron)、直接混合训练(Naive)、协调后训练(Harmonized)。评估覆盖17项指标,从检测精度、表格结构识别到端到端文档转换质量。

核心结果汇总(Table 5):

| 指标 | Heron(预训练) | Naive(混合训练) | Harmonized(协调后) |

|---|---|---|---|

| detection_f | 0.860 | 0.858 | 0.883 |

| detection_precision | 0.868 | 0.868 | 0.885 |

| detection_recall | 0.858 | 0.858 | 0.887 |

| table_teds | 0.800 | 0.750 | 0.814 |

| table_teds_corrected | 0.777 | 0.730 | 0.792 |

| cell_level_content_acc | 0.767 | 0.715 | 0.771 |

| cell_level_index_acc | 0.764 | 0.725 | 0.778 |

| page_teds_corrected | 0.778 | 0.733 | 0.790 |

| adjusted_NED | 0.870 | 0.871 | 0.872 |

| bbox_mean_iou (越低越好) | 0.043 | 0.019 | 0.016 |

| bbox_max_iou (越低越好) | 0.079 | 0.045 | 0.035 |

几个关键发现值得关注:

协调模型在17项指标中14项取得最优。仅element_alignment(0.579 vs. 预训练0.585)、percent_tokens_found(0.946 vs. 预训练0.947)和percent_tokens_added(0.049 vs. 混合训练0.046)三项略低,且差距极小。

混合训练对表格指标的破坏是系统性的。table_teds下降0.050,cell_level_content_acc下降0.052,page_teds下降0.045,shifted_cell_content_acc下降0.055。这说明标注空间不一致对结构化元素(尤其是表格)的影响最为严重。

协调训练不仅恢复了退化,还超越了预训练基线。table_teds从0.800提升到0.814(+0.014),detection_f从0.860提升到0.883(+0.023),detection_recall从0.858提升到0.887(+0.029)。这证明额外数据在标注对齐后确实带来了增益。

空间预测质量显著提升。bbox_mean_iou从0.043降至0.016(-0.027),bbox_max_iou从0.079降至0.035(-0.044),说明协调训练后模型预测的边界框重叠更少、空间定位更精确。

四、实验分析:表征空间的可视化验证

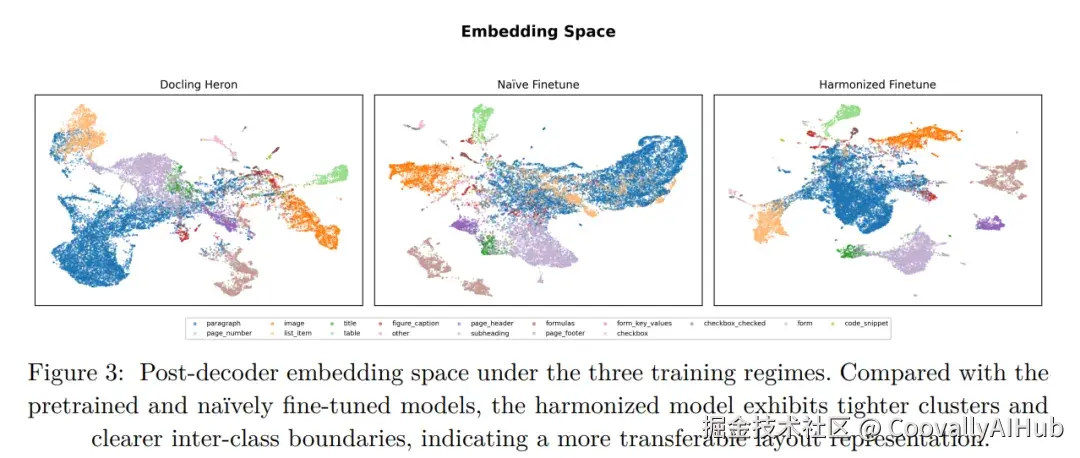

论文通过UMAP可视化对三种训练策略下的post-decoder嵌入空间进行了分析,从表征层面揭示了性能差异的内在原因。

整体聚类质量对比(Figure 3) :

- 预训练模型:各类别有一定程度的聚类,但类间存在纠缠现象

- 混合训练模型:聚类出现碎片化,类间边界模糊,不同类别的嵌入混合加剧

- 协调训练模型:聚类更加紧凑,类间边界更清晰,表征质量明显优于前两者

易混淆类对分析(Figure 4) 。论文特别关注了几组语义相近但类别不同的元素对:

- paragraph vs list_item:这两个类别在视觉上非常接近(都是文本块),混合训练后两者在嵌入空间中严重重叠,而协调训练显著改善了分离度

- title vs subheading:层级不同但外观相似,协调训练后模型能更好地区分两者

- checkbox vs checkbox_checked:细粒度状态差异,协调训练也帮助模型学到了更有区分度的表征

这些表征分析结果与定量指标的改善完全一致:混合训练破坏了模型原有的表征结构,而标注协调在扩大数据量的同时保持了表征空间的有序性。从表征质量的角度来看,Agentic Harmonization的作用并非简单的数据清洗,而是在语义层面消除了跨数据集标注不一致对特征学习的干扰。

图片来源于原论文

五、总结与思考

本文揭示了跨数据集标注的空间不一致会导致混合训练适得其反,并提出用VLM Agent在训练前协调标注差异。协调后的模型在17项指标中14项取得最优,检测F-score提升0.023,table TEDS提升0.014。

在此基础上,有两点值得关注:一是论文仅验证了两个数据集的协调,扩展到更多数据集时Agent逐页处理的成本和规则复杂度是否可控,尚未讨论;二是标注守恒约束不允许创建新标注,意味着源数据集的漏标问题无法通过协调修复。不过,"训练前用Agent做标注对齐"这一思路不限于文档布局,目标检测、语义分割等面临类似标注规范差异的任务也可借鉴。