前提

- 一台mac电脑

- 本地已安装ollama,此处以qwen3.5:4b模型为例(如果使用的是LM Studio或者其他模型,可以自测)

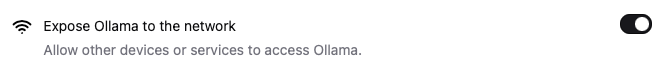

在ollama设置中打开一个设置。

- 已安装homebrew。

需安装的环境

- git。安装命令如下:

bash

brew install git

# 检查命令

git --version- Node.js。

bash

brew install node@22

# 检查命令

node --version- pnpm

bash

npm install -g pnpm

# 检查命令

pnpm --version- uv

bash

brew install uv

# 检查命令

uv --version- nginx

bash

brew install nginx

# 检查命令

nginx -v安装(一行一行执行就可以)

bash

# 1下载项目

git clone https://github.com/bytedance/deer-flow.git

# 2进入项目路径

cd deer-flow

# 3检查依赖,出现OK All dependencies are installed!才算完成。有失败就装下失败的,再重新检查

make check

# 4生成配置文件

make config

# 5配置模型

vi config.yaml- 将下面内容粘贴进config.yaml中,替代models里注释掉的东西。

其中base_url中的ip写本机ip,可以通过ifconfig命令直接在终端查询。

bash

- name: qwen3.5

display_name: Qwen3.5 4B (Ollama)

use: langchain_ollama:ChatOllama

model: qwen3.5:4b

base_url: http://192.168.1.224:11434 # No /v1 suffix --- uses native /api/chat

num_predict: 8192

temperature: 0.7

reasoning: true # Passes think:true to Ollama native API

supports_thinking: true

supports_vision: false也可以用在线大模型,文件中有例子,可以直接改一下api key。

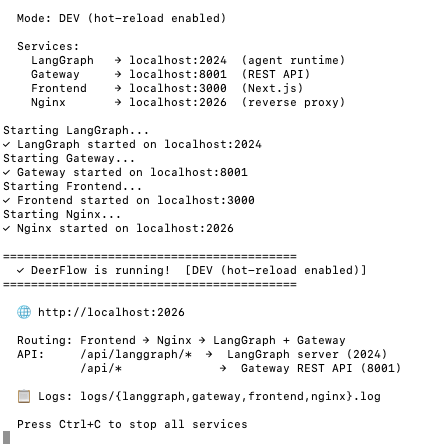

可以启动执行:

bash

# 7安装项目依赖

make install

# 8启动。

make dev日志显示如下:

如果有端口被占用情况,直接改下端口号。

结果呈现

参考:https://www.toutiao.com/article/7625892456562770472/?wid=1776316957469