我厂有算力,能产出token, 我使用vllm production-stack + higress在数据中心部署了几个大模型。

但是Trae/Cusor这些老登免费版都不支持接入自定义远程/本地模型, 咱们vibe coding主打一个不花冤枉钱。

下面以Trae为例,演示如何接入自定义本地/远程模型。

① 给Trae安装扩展会吧: 安装Roo Code就行了。

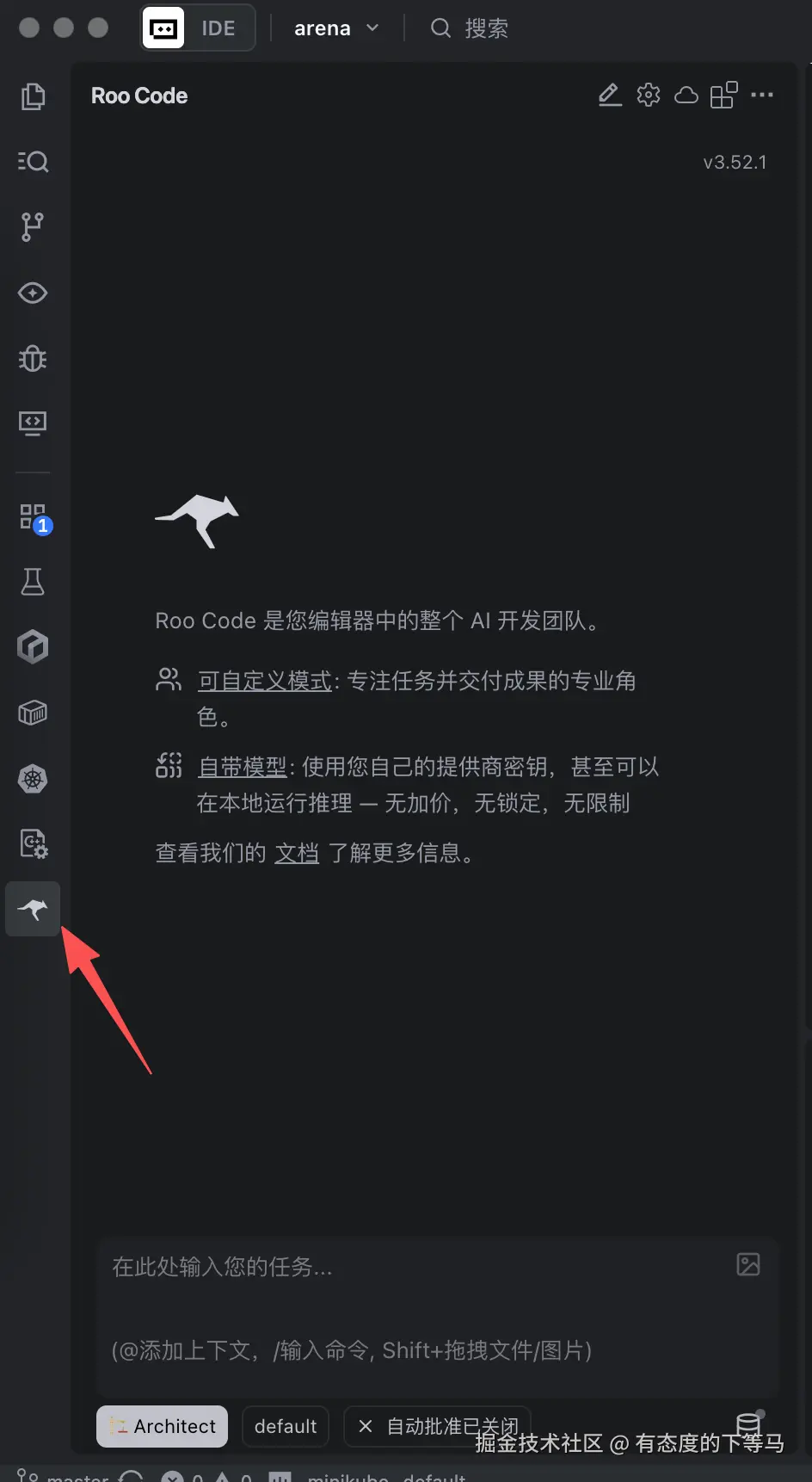

② 安装之后Trae左侧栏会出现一个猎豹图标,这就是Roo Code

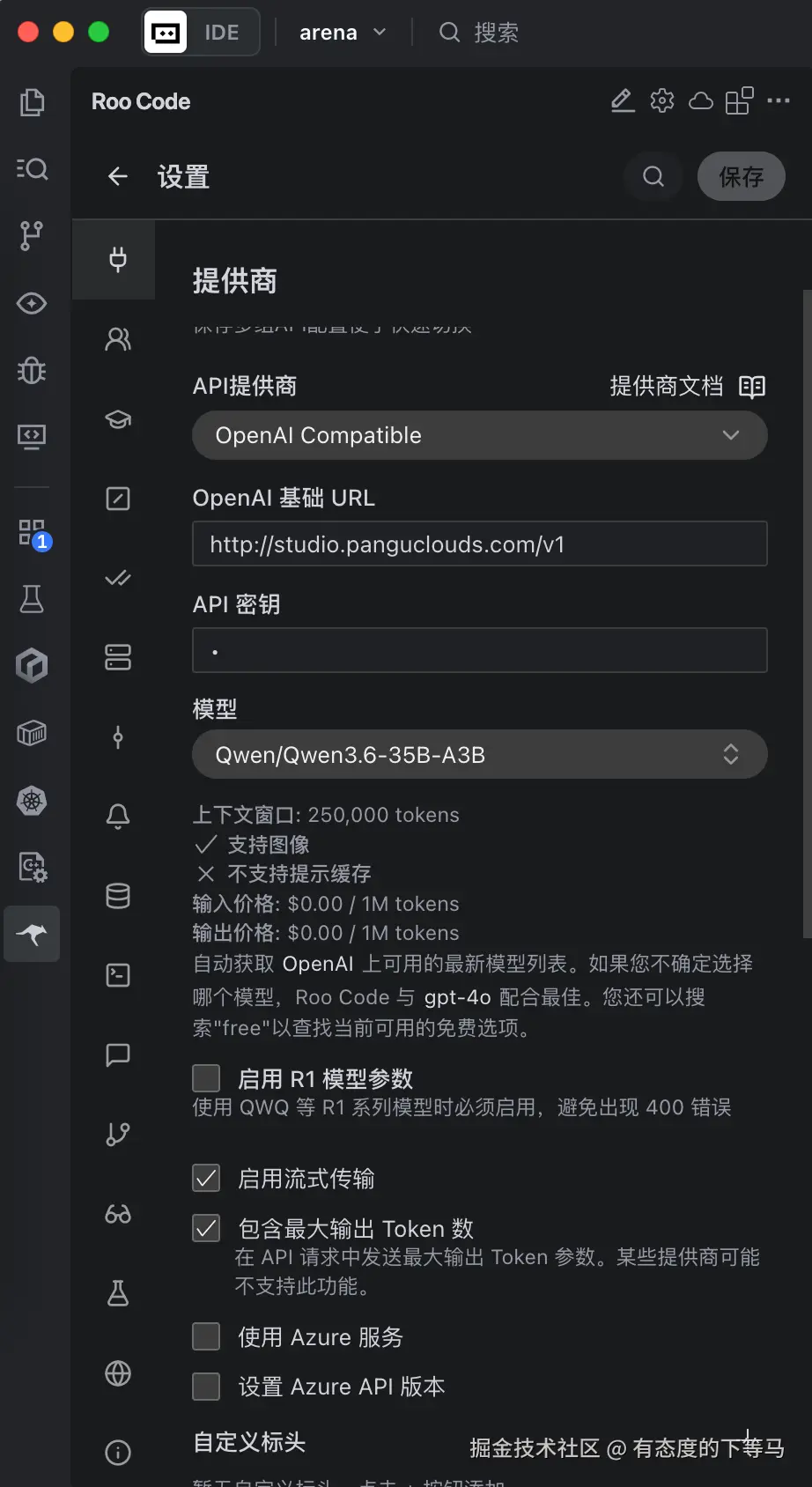

③ 设置LLM: 按照兼容OpenAI接口规范的方式,接入咱自己的算力提供商节点,需要apikey就填自己的key,不需要key就随便填。 下面的[上下文长度],[图像支持]等配置可以根据LLM实际来配置。

④ vibe coding

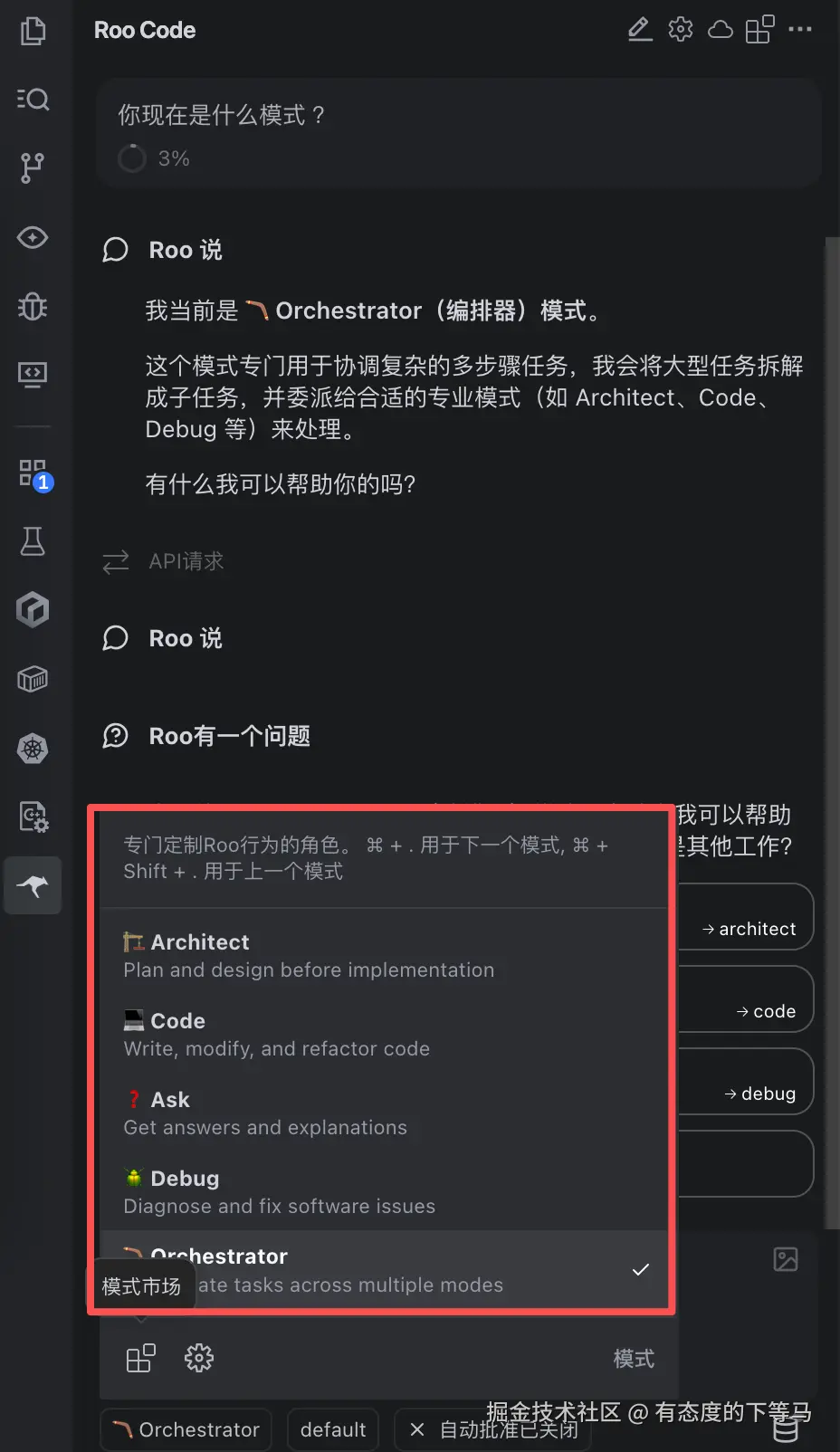

回到Roo Code主界面,有几个模式市场:

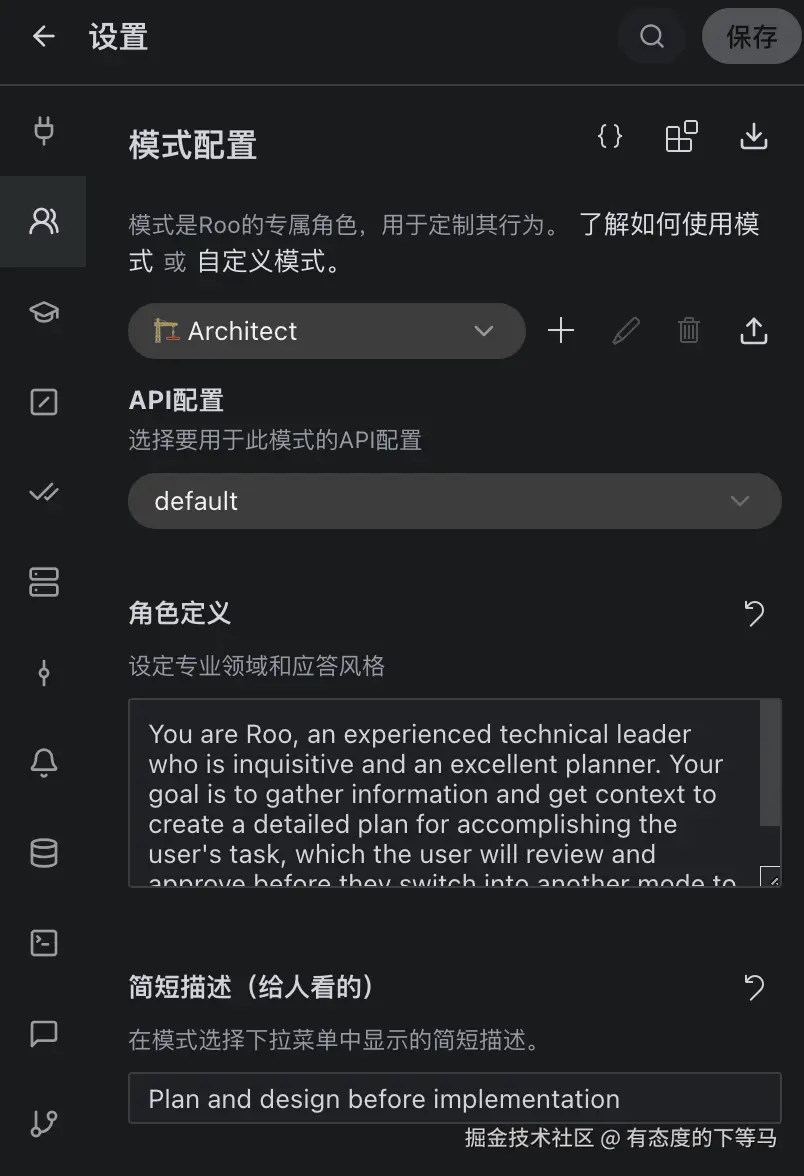

- Architect: 架构师模式,在实现之前做计划plan和设计design

- Code: 码农模式

- Ask: 问答模式

- Debug: 诊断和修复软件bug模式

- 编排器:专门用于协调复杂的多步骤任务,会将大型任务拆解成子任务,并委派给合适的专业模式(如 Architect、Code、Debug 等)来处理。

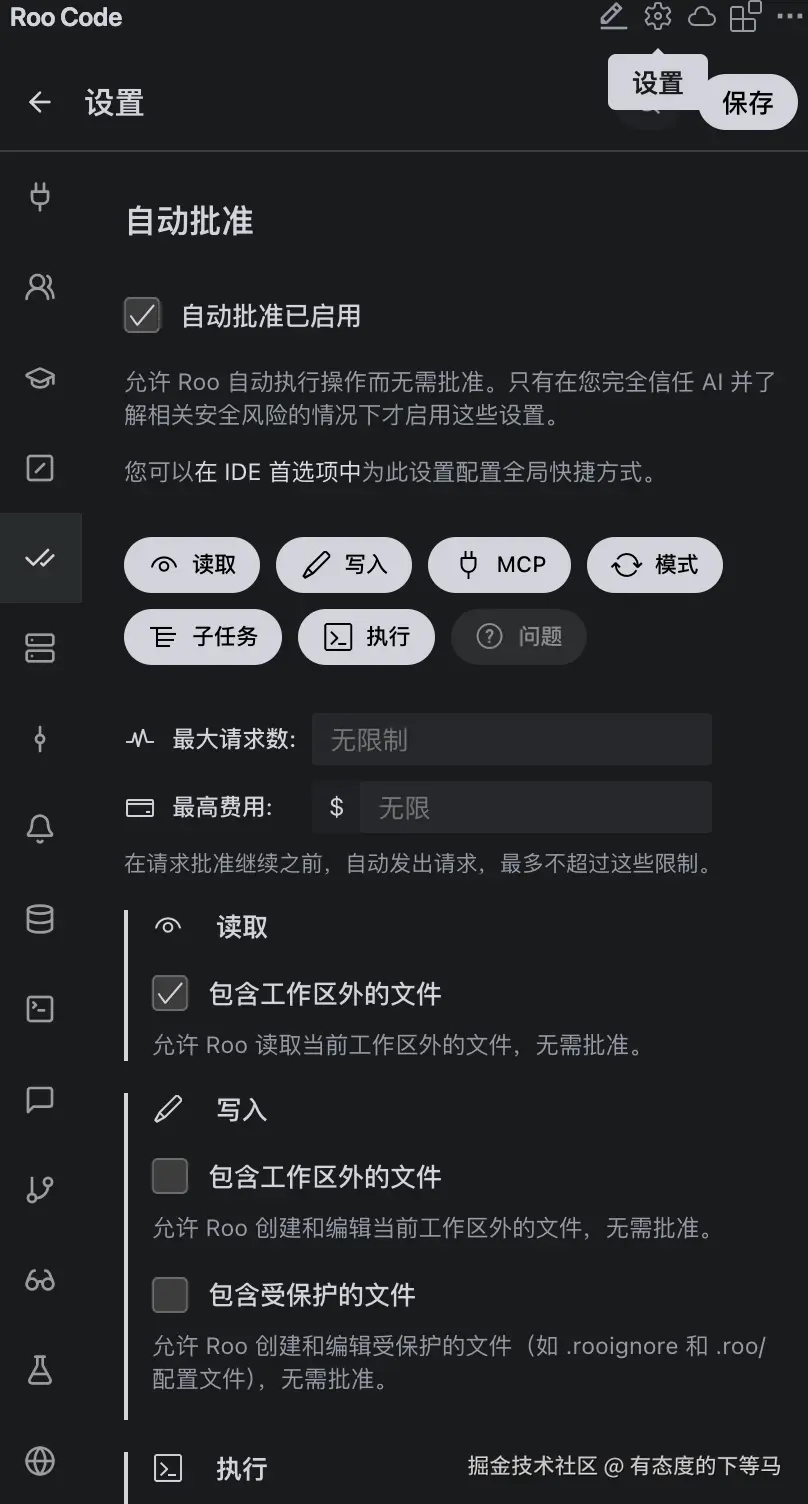

右下角开启"自动批准":

这意味着: LLM判断出要做这些工作时, AI编程智能体会自动批准这些行为, 以此得到一个流畅的vibe coding 体验。

后面你就可以开心的vibe coding了。

Roo Code 跟其他AI编程工具一样,在[设置]提供了 SKILL、MCP、角色+Prompts 配置, 可酌情关注。