这两年,随着 HarmonyOS NEXT 的持续推进,越来越多做音视频的开发者开始认真面对一个问题:

在纯血鸿蒙上,播放器到底该怎么做?

表面上看,这是一个"怎么解码"的问题。

但真到项目落地时,大家很快就会发现,真正难的往往不是"调通一个 API",而是你要把一整条链路想清楚:

数据从哪里来?

谁负责解封装?

谁负责音视频解码?

谁负责画面输出?

谁负责音频播放?

首帧、重连、启停、黑屏、时钟、低延迟,这些边界又该怎么处理?

这也是为什么,鸿蒙 NEXT 下的音视频开发,远不只是"会不会用播放器组件"这么简单。HarmonyOS 当前提供了完整的媒体开发体系:一边是面向常规媒体业务的一站式能力,另一边是面向音视频编解码、渲染和 Native 能力开放的 AVCodec、Audio Kit 等模块。系统能力已经很完整,真正决定项目质量的,往往是开发者如何组织这条链路。

一、先别急着谈播放器,先把"媒体链路"想明白

很多人一说播放器,脑子里第一反应就是"给个 URL,点播放"。

但从技术上看,播放器从来不是一个单点组件,而是一条完整链路的组合:

- 网络接入

- 协议处理

- 解封装

- 音视频解码

- 视频送显

- 音频播放

- 时钟与同步

- 启停与恢复

对于常规本地媒体文件或者标准化媒体资源,系统播放器可以帮你处理掉其中大部分复杂度。但如果你面对的是实时流 ,尤其是要追求低延迟、稳定重连、跨平台一致行为的场景,问题就会迅速从"播放器怎么用"变成"媒体链路怎么设计"。

华为官方文档对媒体能力的划分其实很清楚:HarmonyOS 提供了媒体开发概览、AVCodec 音视频编解码能力,以及音频播放相关能力。对开发者来说,这意味着你既可以走"系统播放器"路线,也可以走"自己掌控链路"的路线。

说得更直白一点:

做一个能播的视频组件,并不难。

做一个在复杂网络环境下还稳定、低延迟、可维护的实时播放器,难度完全不是一个量级。

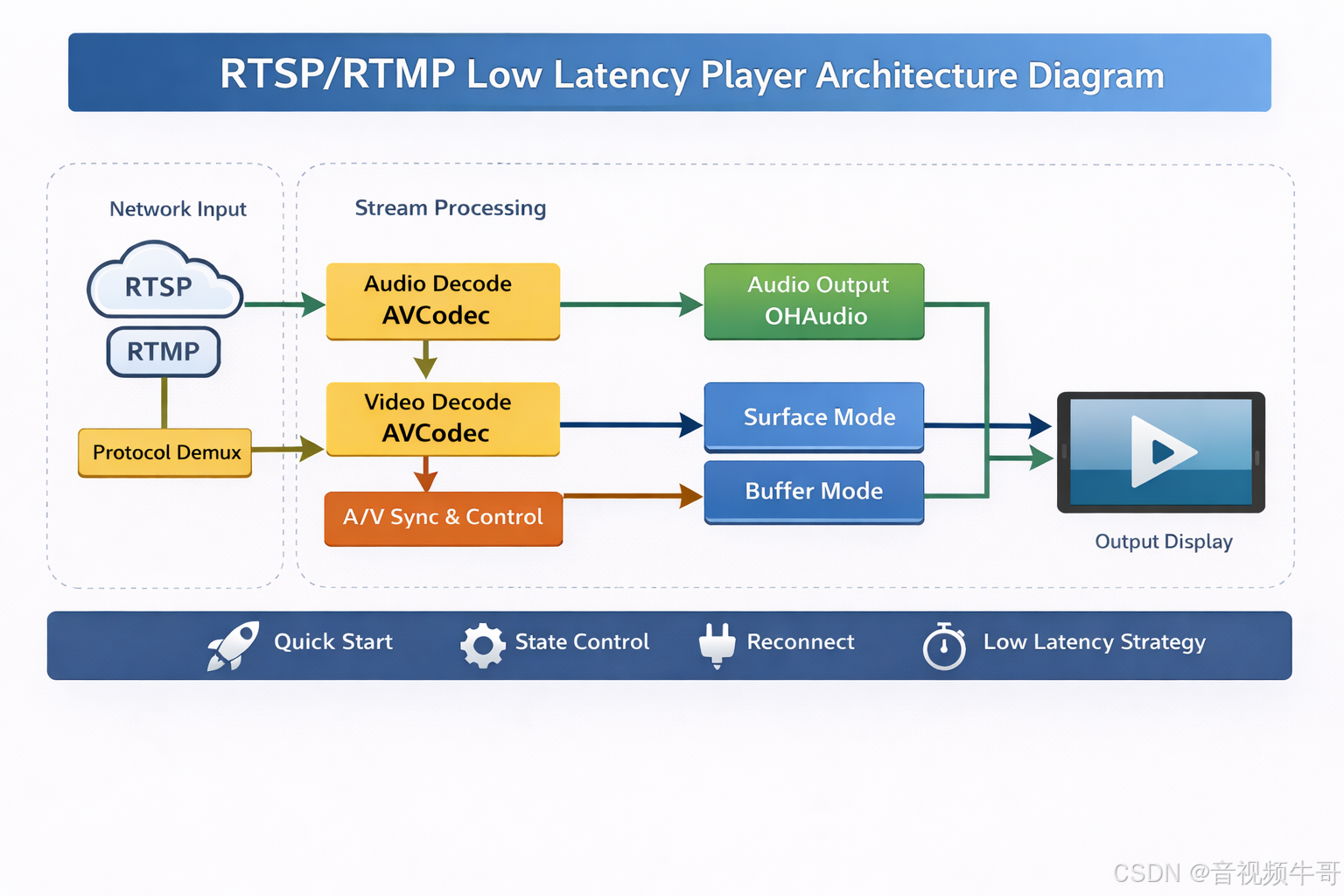

二、视频解码这件事,真正的分水岭是 Surface 模式和 Buffer 模式

在鸿蒙 NEXT 的视频解码体系里,一个非常核心的概念,就是Surface 模式。

华为官方的视频解码指南,就是围绕 Surface 模式展开的:解码器可以把输出直接交给 Surface,画面显示链路更直接,适合"解码出来就要显示"的场景。文档同时也明确展示了视频解码的标准状态机:创建解码器、注册回调、配置参数、设置 Surface、Prepare、Start,再进入正常解码流程。

这条链路的重要性在于,它并不是"能跑就行"的顺序,而是带有明确生命周期约束的流程。

比如,Surface 的设置要放在 Prepare 前;Start 之后,解码器就进入执行态;Stop、Flush、Reset 之后,缓冲区的生命周期和再次喂流的规则都会发生变化。

但技术上更值得关注的,其实是另一个问题:

你到底要不要自己拿到解码后的像素数据?

如果不需要,Surface 模式通常更高效。

如果需要做滤镜、图像处理、自定义渲染、纹理共享、视频分析,或者要把解码结果交给自己的渲染引擎,那么 Buffer 模式往往更合适。

本质上,这不是"哪个模式更高级",而是谁拥有解码后这一帧的控制权 。

Surface 模式更偏向"系统帮你把最后一公里也做了";

Buffer 模式则意味着"系统负责解码,应用继续掌控后续渲染与处理"。

做播放器时,很多后续设计上的选择,其实都和这里直接相关。

三、音频不要只当"配角",它往往决定了整体体验的下限

很多团队前期做播放器,最容易陷入的一个误区,就是把所有注意力都放在视频上,觉得只要画面出来了,剩下的都是小问题。

实际上,在鸿蒙 NEXT 下,音频链路同样值得单独对待。

华为官方推荐,在 Native 场景下使用 OHAudio 做音频播放。文档明确提到,OHAudio 是 API version 10 引入的一套 C API,支持普通音频通路和低时延通路,但它只支持 PCM 数据。

这句话背后其实非常关键:

如果你自己掌控音频解码链路,那么最终喂给音频播放模块的,通常就应该是 PCM。

也就是说,系统已经把职责划分得很清楚:

- 压缩音频的解码,交给 AVCodec

- PCM 的渲染播放,交给 OHAudio

这样的好处是,链路清晰,可控性强,也更适合低延迟场景。

但代价也很明显:你需要自己承担更多工程组织工作,包括音频缓存、数据节奏、回调线程处理、与视频时钟的协调等。

所以,从工程实践看,音频从来不是视频的附属品。

它不是"顺手接一下"的模块,而是播放器稳定性和体验一致性的关键部分。

四、低延迟播放器,真正难的不是"解码",而是"控制"

| 阶段 | 核心模块 | 技术要点 (HarmonyOS NEXT) |

|---|---|---|

| 1. 接入 | 网络协议层 | 处理 RTSP/RTMP 建连与断线重连 |

| 2. 处理 | SmartMediakit | Jitter Buffer 控制积压,降低延迟 |

| 3. 解码 | AVCodec | 视频走 Surface 模式;音频解出 PCM |

| 4. 渲染 | 最终输出 | XComponent 送显 + OHAudio 播放 |

如果只是把一个标准媒体文件播出来,那么"解码成功"基本就意味着事情已经做完大半。

但低延迟播放器完全不是这样。

低延迟意味着什么?

意味着你不仅要解码,还要尽量少排队、少积压、少等待 ;

意味着你要控制首帧速度,也要控制后续时延漂移;

意味着你要在网络波动、码流抖动、重连恢复的情况下,尽量维持播放连续性。

这时候,播放器的核心能力就不再只是"能不能出图出声",而变成了:

- 首帧能不能尽快起来

- 断线后能不能快速恢复

- 停止/开始频繁切换时会不会偶发黑屏

- Surface 重建后能不能继续出画

- Stop/Restart 之后首个关键帧是否能正确恢复解码

- 音频和视频是否还能维持合理同步

华为官方文档在这方面其实给了不少有价值的提示。比如在视频解码文档中明确强调:Stop、Flush、Reset 之后,之前上报过的缓冲区不应继续使用;重新 Start 后,首个输入 buffer 需要从关键帧开始,对于 AVC/HEVC 通常还要携带 SPS/PPS。

这说明,真正影响播放器稳定性的,往往不是"某个接口会不会调",而是你有没有把状态机、缓冲区生命周期和恢复策略都想清楚。

五、为什么 RTSP、RTMP 这类实时流,往往更需要"自己掌控链路"

说到这里,就可以自然过渡到实时流场景了。

RTSP、RTMP 这类协议,和普通文件播放最大的差异,不是"格式不同",而是它们天然带有更强的实时性诉求 。

你往往不能简单接受"系统内部缓一大段再播";

也不能接受"一旦 Stop/Start 或断线重连,就偶发几十秒黑屏";

更不能接受不同平台上行为完全不一致。

这也是为什么,面向 RTSP、RTMP 的播放器,很多时候都更适合走"自己掌控网络接入、解封装、解码、送显、音频播放"的路线。前面提到的 AVCodec、Surface 模式、Buffer 模式、OHAudio,在这种场景下就不再是单纯的底层接口,而是搭建低延迟播放器的基础能力模块。

从这个角度看,鸿蒙 NEXT 下做实时播放器,本质上就是把系统开放出来的媒体能力,重新组织成一条更贴近业务目标的实时播放链路。

六、也正是在这个层面,成熟 SDK 的价值才真正体现出来

当我们把前面的技术逻辑都梳理清楚之后,再来看低延迟 RTSP、RTMP 播放器,就会发现一个很现实的结论:

真正难的不是把"解码接口"接进来,真正难的是把这些接口组织成一个在业务里长期稳定运行的播放器。

这也是为什么,在鸿蒙 NEXT 这样的新平台上,成熟音视频 SDK 的价值会被放大。

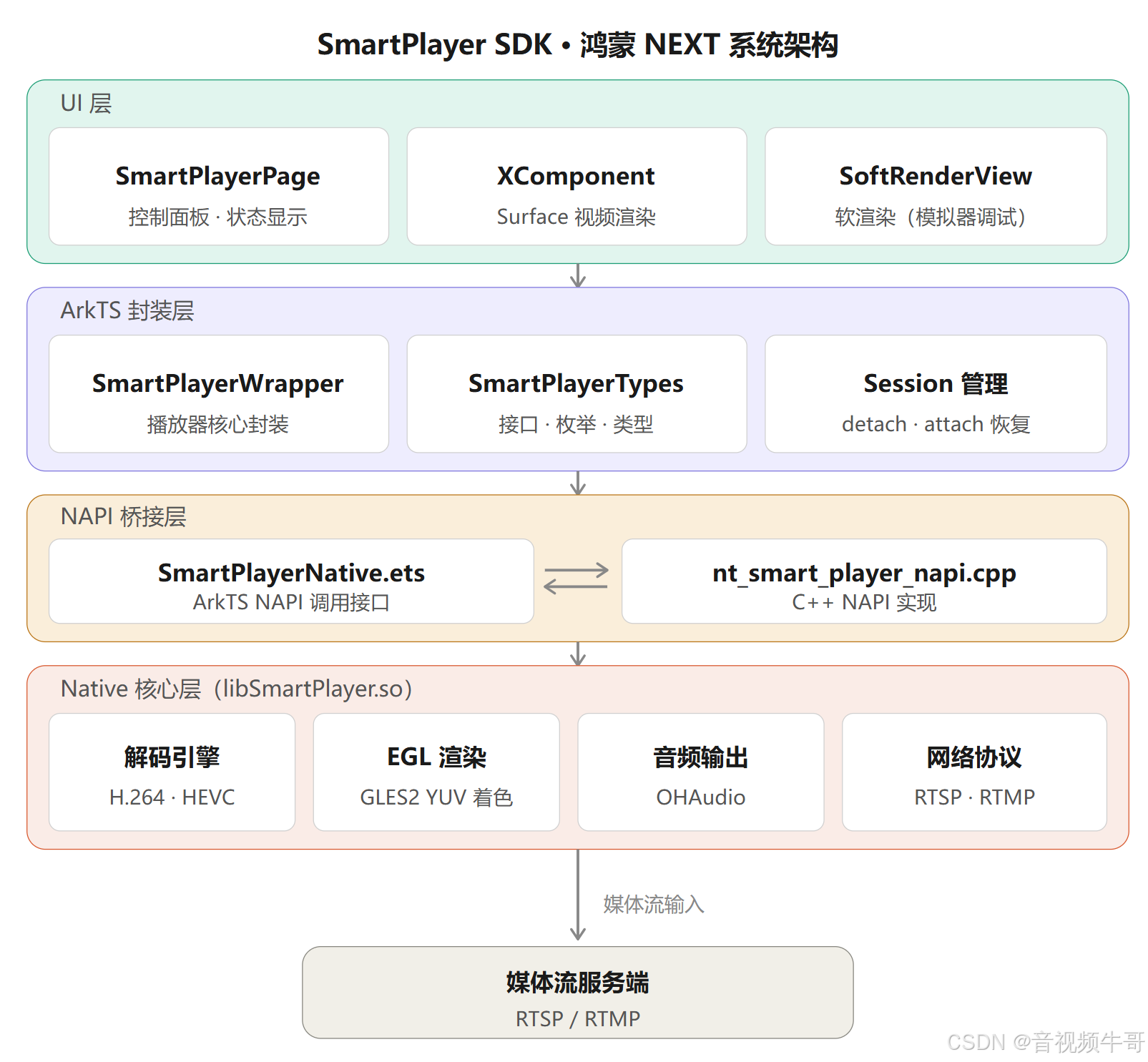

以大牛直播SDK(SmartMediaKit)为例,很多人第一眼看到的,可能只是"它支持 RTSP、RTMP 播放"。

但从技术落地角度看,更关键的其实不是"支持播放"这四个字,而是它在鸿蒙 NEXT 下,要把下面这些事情真正串起来:

- 实时流协议接入

- 解封装与数据投递

- HarmonyOS AVCodec 视频解码

- Surface 或 Buffer 模式输出

- OHAudio 音频播放链路

- 启停、重连、重建 surface 后的恢复

- 低延迟策略与跨平台一致性

当这些能力拆开来看,每一项都不算神秘;

但当它们要组合成一个可交付、可维护、可复用的低延迟 RTSP、RTMP 播放器时,事情就完全不一样了。

这也是大牛直播SDK(SmartMediaKit)在鸿蒙 NEXT 下做低延迟播放器时的意义所在:

它不是把已有播放器"简单搬过来",而是把 HarmonyOS 的编解码与音频能力,和实时流播放器真正需要的传输、解封装、恢复、低延迟控制这些逻辑,整合成一条完整链路。

HarmonyOS鸿蒙NEXT下RTMP播放器时延测试

七、鸿蒙 NEXT 下的低延迟 RTSP、RTMP 播放器,真正比拼的是什么

如果把问题再说透一点,那么鸿蒙 NEXT 下低延迟实时播放器真正比拼的,主要就是三件事:

1. 首帧速度

系统能力已经给了解码器和音频播放模块,但首帧速度不只取决于"解码器快不快",还取决于网络首包、参数集、关键帧、缓冲策略、线程切换、Surface 准备时机这些因素。

2. 稳定性

播放器不是只跑一次。

它要面对的是不断的开始、停止、切后台、回前台、断线、重连、surface 重建、分辨率变化。

稳定性的本质,是这些场景下状态机能不能持续正确。

3. 低延迟与可控性

低延迟从来不只是"某个参数调小一点"。

它需要整条链路都围绕"减少积压、减少等待、减少无效恢复"去设计。

换句话说,低延迟不是某个 API 的能力,而是架构设计的结果。

而这三件事,恰恰也是成熟实时播放器和普通"能播组件"之间最本质的差别。

HarmonyOS 鸿蒙NEXT RTSP播放器时延测试

八、写在最后

回到最初的问题:鸿蒙 NEXT 下,音视频解码到底该怎么做?

如果只是从接口调用层面回答,其实并不复杂。

HarmonyOS 已经把视频解码、音频播放、渲染配合这些能力开放得很完整了。视频解码可以通过 AVCodec 实现,音频播放可以通过 OHAudio 完成,系统也明确给出了状态机、Surface 模式、Stop/Restart 约束等关键规则。

但如果从工程和产品落地层面回答,事情就会变成另一句话:在鸿蒙 NEXT 下,真正有价值的不是"把一个解码器跑起来",而是把它做成一个面向真实业务、稳定可靠、低延迟可控的播放器。

而当话题进一步落到 RTSP、RTMP 这样的实时流场景上时,系统能力只是地基,真正决定体验的,还是上层如何组织这条链路。

也正是在这个意义上,大牛直播SDK(SmartMediaKit)在鸿蒙 NEXT 下的低延迟 RTSP、RTMP 播放器,不只是一个"支持鸿蒙"的功能点,更是对鸿蒙媒体能力、实时流播放需求和工程稳定性之间关系的一次完整回答。

📎 CSDN官方博客:音视频牛哥-CSDN博客