HeyGen 是什么

一句话总结:HeyGen 是一个"AI 视频 + AI 数字人"在线平台,主要帮你快速生成带数字人出镜的视频,以及把已有视频翻译成多语言并做对口型配音。

HeyGen能做什么?

文本 → 视频:你写文案/脚本,选择一个数字人(AI Avatar),它自动生成带画面、配音、字幕、背景等的成片视频。

照片 → 视频:上传照片,输入台词,照片"开口说话",带对口型和手势。

自己的"数字分身":录一段自己说话的视频,生成一个外观和声音都很像你的数字人(Digital Twin),以后用它代替你出镜。

视频翻译:上传视频或粘贴 YouTube 链接,选择目标语言,平台会翻译语音并做 AI 对口型、克隆原声音、自动生成多语种字幕,官方号称支持 175+ 语言与方言。

广告/UGC 内容生成:产品图 + 文案 → 由数字人把产品"拿在手里"讲解;也可批量生成短视频平台风格的 UGC/口播类内容。

团队/企业使用:提供多账号协作、品牌资产管理、SCORM 导出、LMS 集成、互动视频(测验、分支跳转)等企业级能力,并有 API 可集成到自有系统

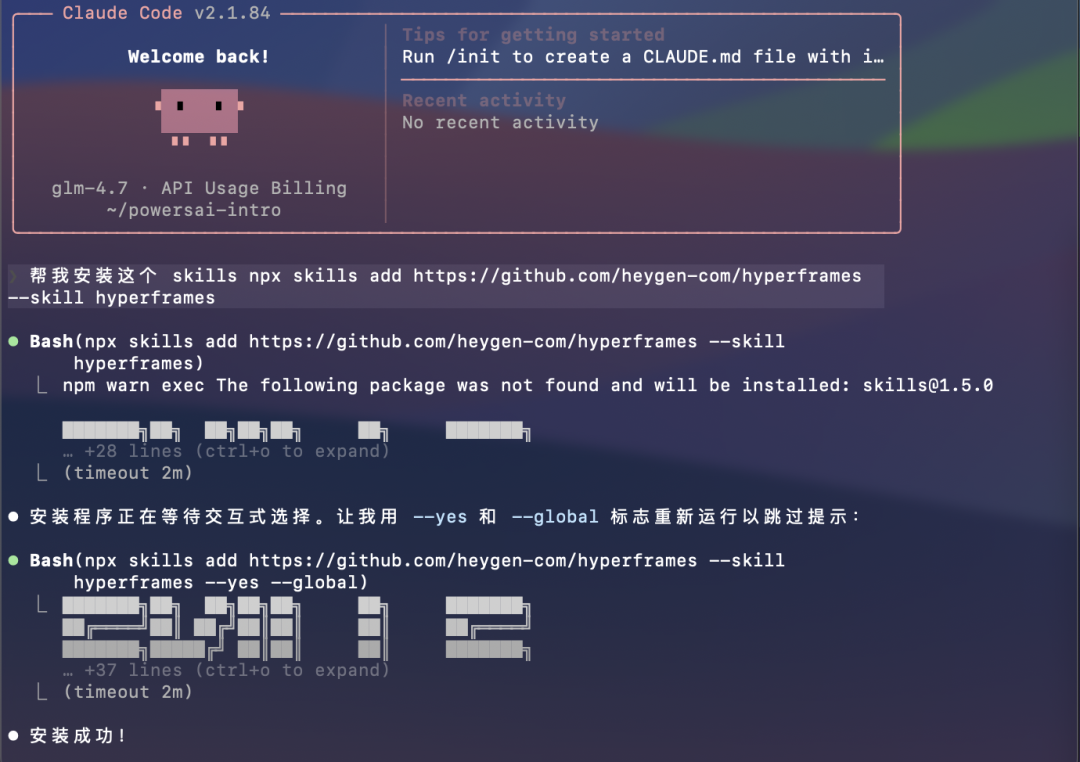

HeyGen 平台也可以根据 prompt 来制作视频,但是额度有限,而HeyGen开源了HyperFrames skills,让你也可以在 Claude code,opencode 以及 cursor 等等 agent 框架下,免费制作 HTML 视频

一句话说清楚HyperFrames是什么

Write HTML. Render video.(写 HTML,渲染视频。)

这是 HyperFrames 在 GitHub 上的官方 Slogan,简单得有些暴力------但背后藏着一个真正颠覆性的思路:把 HTML 文件当作视频的"源代码",让 AI 智能体像写网页一样去"编写"视频。

这个框架由 AI 视频公司 HeyGen 开源,仓库地址为 github.com/heygen-com/hyperframes,发布仅十余天,在 skills.sh 平台上的周安装量已超过 1,600 次,覆盖 Claude Code、Cursor、Gemini CLI 等主流 AI 编码工具。

为什么视频制作需要一场"范式转移"?

在聊 HyperFrames 之前,我们需要先理解现有视频制作工具的核心矛盾。

当前市面上的视频制作工具,无论是 After Effects、Premiere,还是面向开发者的 Remotion(React 渲染视频),设计上都是以"人类为中心"的。它们的界面、语言、逻辑,都预设了一个坐在屏幕前的人类操作者。

但 AI 时代来了,局面变了。

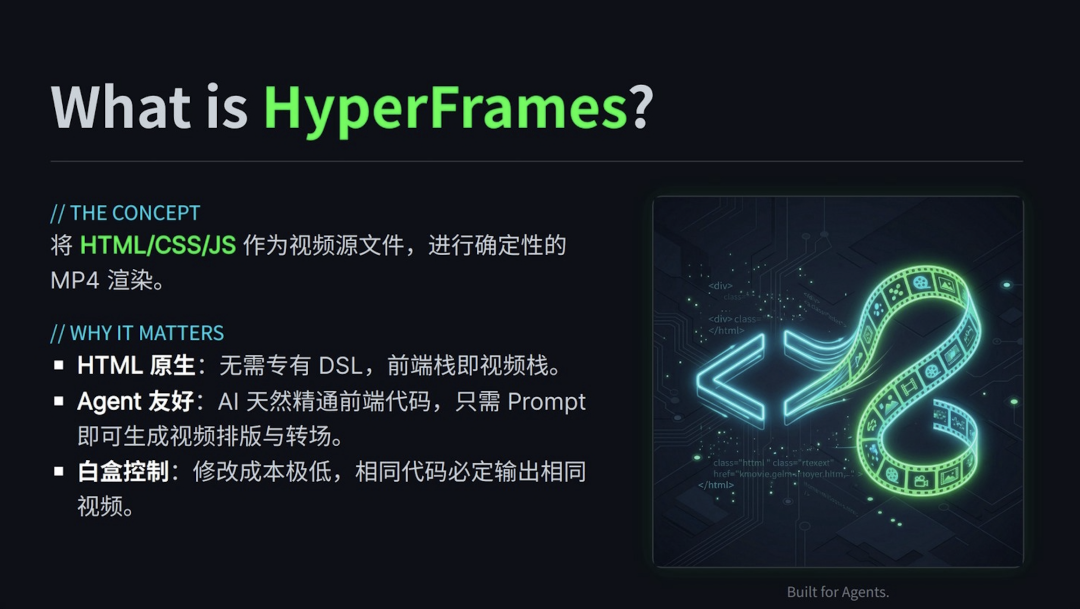

大语言模型天然地"会"写 HTML,经过数十亿网页的训练,HTML、CSS、JavaScript 已经是它们最熟悉的语言。如果我们能让 AI 用它最擅长的语言------HTML------来描述一段视频,然后把渲染的脏活交给框架去做,这条路是不是更顺畅?

HyperFrames 的核心设计理念,就建立在这个洞察之上:HTML 是视频内容的真正来源(source of truth)。

它到底怎么工作?

核心机制:data 属性即时间轴

HyperFrames 的革命性在于,它用 HTML 的 data-* 属性来描述视频的时序和轨道信息。看一段示例代码:

<div id="stage" data-composition-id="my-video" data-start="0" data-width="1920" data-height="1080"> <!-- 第 0 秒开始播放,持续 5 秒 --> <video id="clip-1" data-start="0" data-duration="5" data-track="0" src="intro.mp4" muted playsinline></video> <!-- 第 2 秒出现,叠加 3 秒 --> <img id="overlay" data-start="2" data-duration="3" data-track="1" src="logo.png" /> <!-- 背景音乐,音量 50% --> <audio id="bg-music" data-start="0" data-duration="9" data-track="2" data-volume="0.5" src="music.wav"></audio></div>就这样。一个普通的 HTML 文件,加上几个 data-start、data-duration、data-track 属性,就定义了一段包含视频、图层叠加、背景音乐的合成视频。

动画部分则交给 GSAP(GreenSock Animation Platform)------一个在前端开发中广泛使用的动画库------来处理。开发者用 GSAP 的 timeline API 定义元素的入场、停留和退场动画,框架负责把这些动画与视频时间轴精确同步,最终渲染为 MP4 文件。

三步工作流

npx hyperframes init my-video # 初始化项目

npx hyperframes preview # 在浏览器中实时预览

npx hyperframes render # 渲染输出为 MP4渲染引擎底层使用 Puppeteer(无头浏览器)逐帧截图,再通过 FFmpeg 编码合成音视频。技术路径完全开源,没有黑盒。

AI 优先设计:不是"支持 AI",而是"为 AI 而造"

这一点是 HyperFrames 真正区别于其他视频框架的地方。

Skills 系统

框架内置了一套叫做 "Skills" 的机制------本质上是一批专门写给 AI 智能体的"使用说明书",用来教会 Claude Code、Cursor、Gemini CLI 等工具如何正确编写 HyperFrames 合成文件。

安装命令:

npx hyperframes skills --claude # 安装到 Claude Code

npx hyperframes skills --cursor # 安装到 Cursor

安装后,AI 编码助手会自动获得框架的使用规范,包括:HTML 合成结构的正确写法、data- 属性的使用规则、时间轴注册方式、渲染约束(例如禁止使用随机数,所有动画必须是确定性的)等。

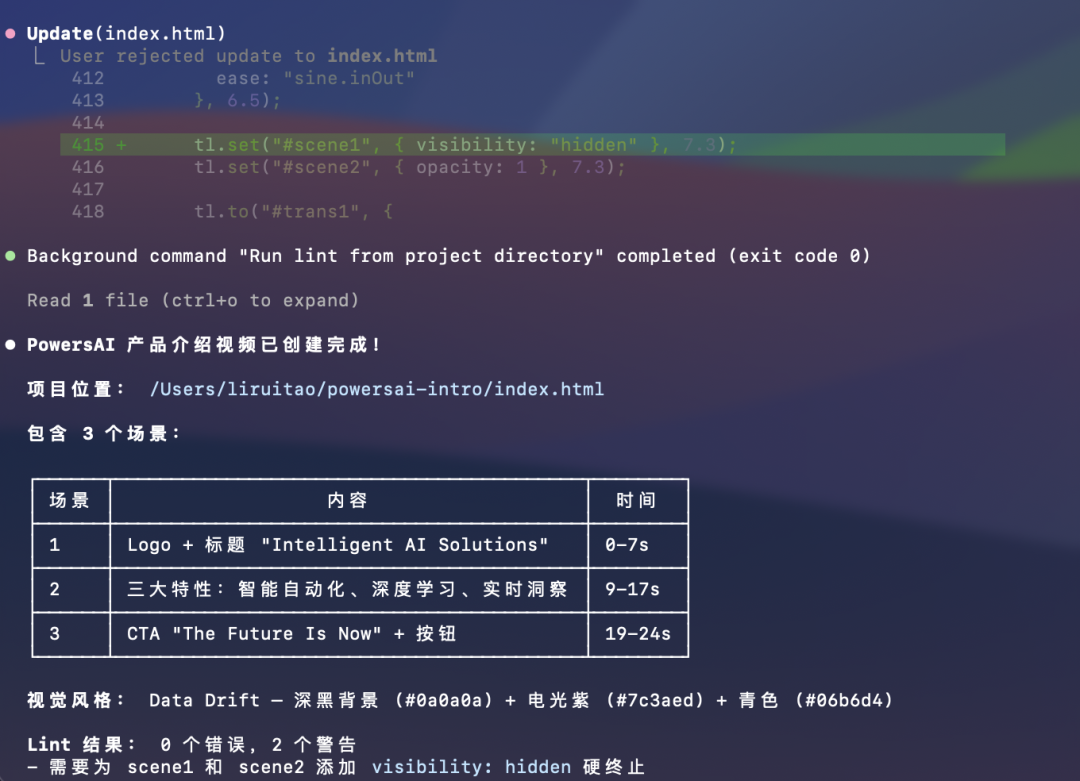

这意味着,你可以直接对 Claude Code 说:"帮我做一个产品发布的宣传短视频,开头是 Logo 动画,然后展示三个核心功能,最后是 Call to Action",AI 会真正理解框架的规则,生成可以直接渲染的代码。

确定性渲染

这是 AI 视频生成中一个常被忽略的关键问题:输出必须可复现。

HyperFrames 对此有明确的强制规定------框架内禁止使用 Math.random()、Date.now() 或任何基于时间的逻辑。相同的 HTML 输入,必须产生完全相同的视频输出。

这个设计让 HyperFrames 可以无缝嵌入自动化的内容生产流水线------今天渲染的结果和三个月后用同一份代码渲染的结果,逐帧完全一致。

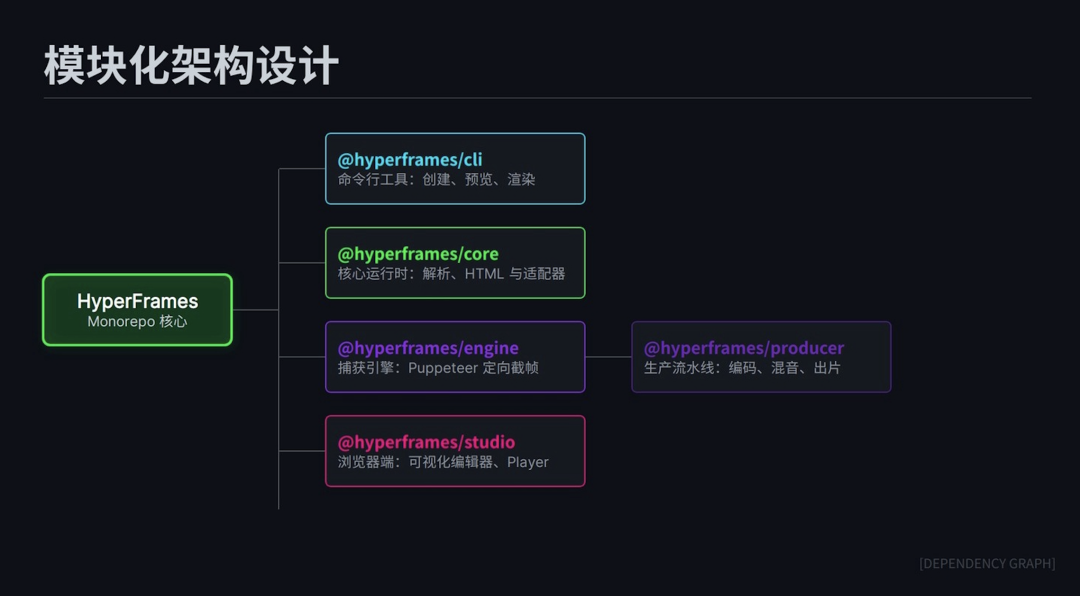

技术架构一览

HyperFrames 是一个 monorepo,由多个职责清晰的包组成:

运行要求:Node.js ≥ 22,FFmpeg。

视觉设计:框架也有"审美规范"

令人意外的是,HyperFrames 不只是一个渲染引擎,它还内置了一套完整的视觉设计体系。

框架提供了 8 种命名视觉风格预设,包括:

- Swiss Pulse------瑞士风格,简洁几何

- Velvet Standard------奢华质感

- Data Drift------数据可视化风格

- Shadow Cut------高对比度暗黑风格

每种风格都包含颜色方案(精确到 hex 值)、字体搭配建议、GSAP 缓动签名,以及禁止使用的反模式清单。

这意味着,当你让 AI 生成一个"瑞士风格"的产品介绍视频时,它不需要从零发明审美,而是直接调用框架预定义的设计规范。

实际应用场景

基于 HyperFrames 的设计哲学,它最适合这些场景:

内容自动化生产:电商平台的商品介绍视频、新闻资讯的可视化短片、数据报告的动态呈现------这些需要大批量、模板化生产的视频,可以完全交给 AI 智能体通过 HyperFrames 自动生成。

AI Agent 工作流:与 MCP(Model Context Protocol)集成后,HyperFrames 可以成为多智能体工作流的一个节点,接收上游的文案、数据,输出渲染好的视频文件。

开发者视频工具:对于有编程背景的内容创作者,HyperFrames 提供了比传统剪辑软件更精确、更可版本控制的视频创作方式。

需要注意的局限

诚实地说,HyperFrames 目前仍处于早期阶段(当前版本 v0.2.2),存在一些现实限制:

-

渲染性能

:基于截图的渲染方式比原生视频编码慢,不适合需要实时输出的场景

-

复杂特效

:高度复杂的粒子效果、3D 渲染等场景,仍需借助专业工具

-

学习曲线

:对于完全没有前端开发背景的用户,HTML + GSAP 的组合仍有一定门槛

结语:一个关于"语言"的押注

HyperFrames 本质上是一个关于"语言"的押注------押注 HTML 将成为 AI 时代视频内容的通用描述语言。

这个押注不是没有道理。HTML 有着数十年的生态积累,是互联网上最普遍的结构化语言;它对 AI 来说几乎没有学习门槛;它可以被版本控制、被 diff、被协作编辑。

当 AI 开始大规模参与内容生产,我们需要的,也许不是一个"更智能的视频剪辑软件",而是一个从一开始就为机器设计的视频描述格式。

HyperFrames 给出了一个值得关注的答案。

更多transformer,VIT,swin tranformer

参考头条号:人工智能研究所

v号:人工智能研究Suo, 启示AI科技动画详解transformer 在线视频教程