看了一个小视频说ddtree-mlx可以在丐版16G M4 macbook上运行qwen3.5-8b效果很好,果断尝试一下,这是我的一些操作流程记录一下:

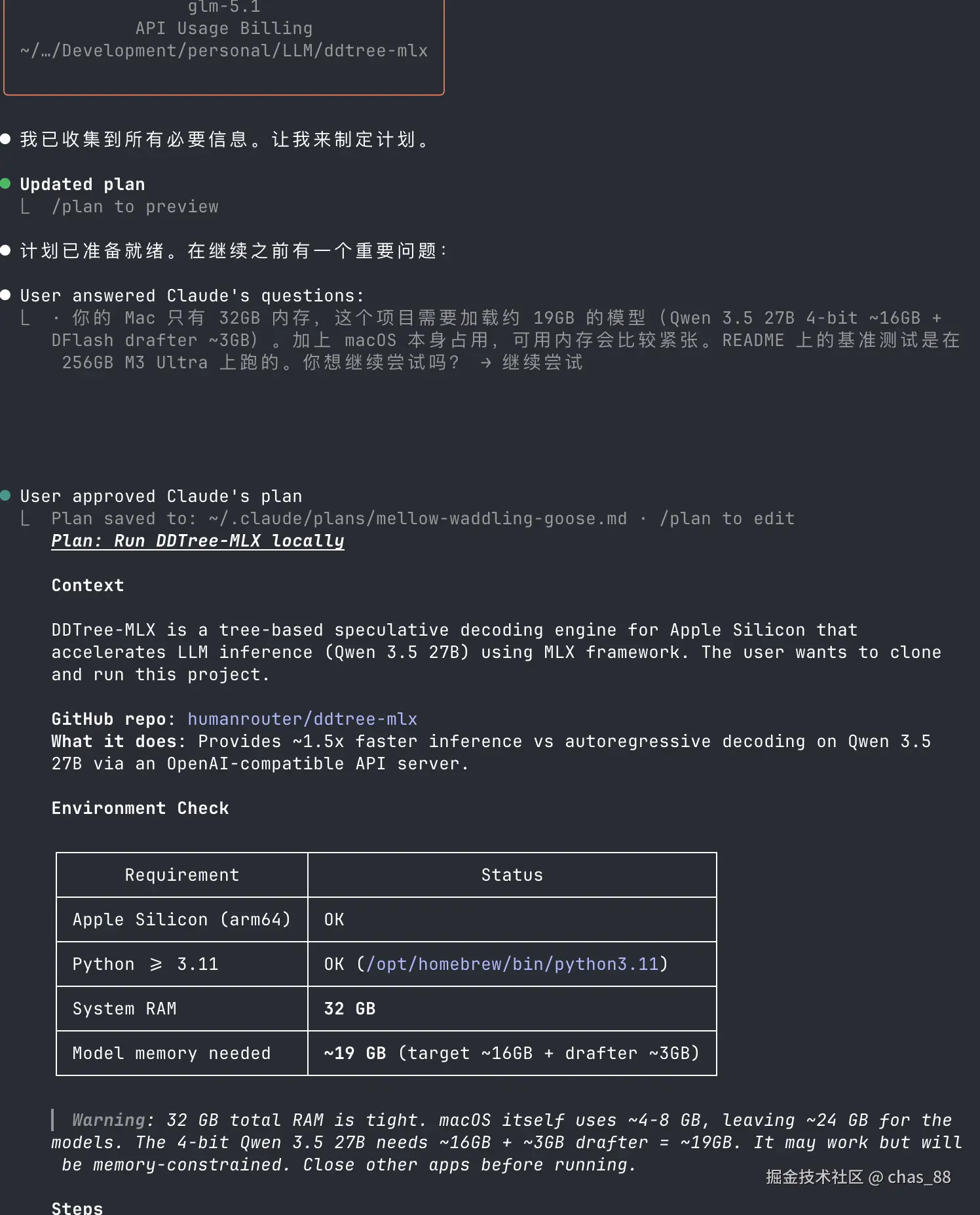

启动本地claudecode帮我进行本地运行该项目,我使用的模型是GLM5.1

bash

# 启动claude code

claude

# 直接指派任务

帮我在本地把https://github.com/humanrouter/ddtree-mlx运行起来

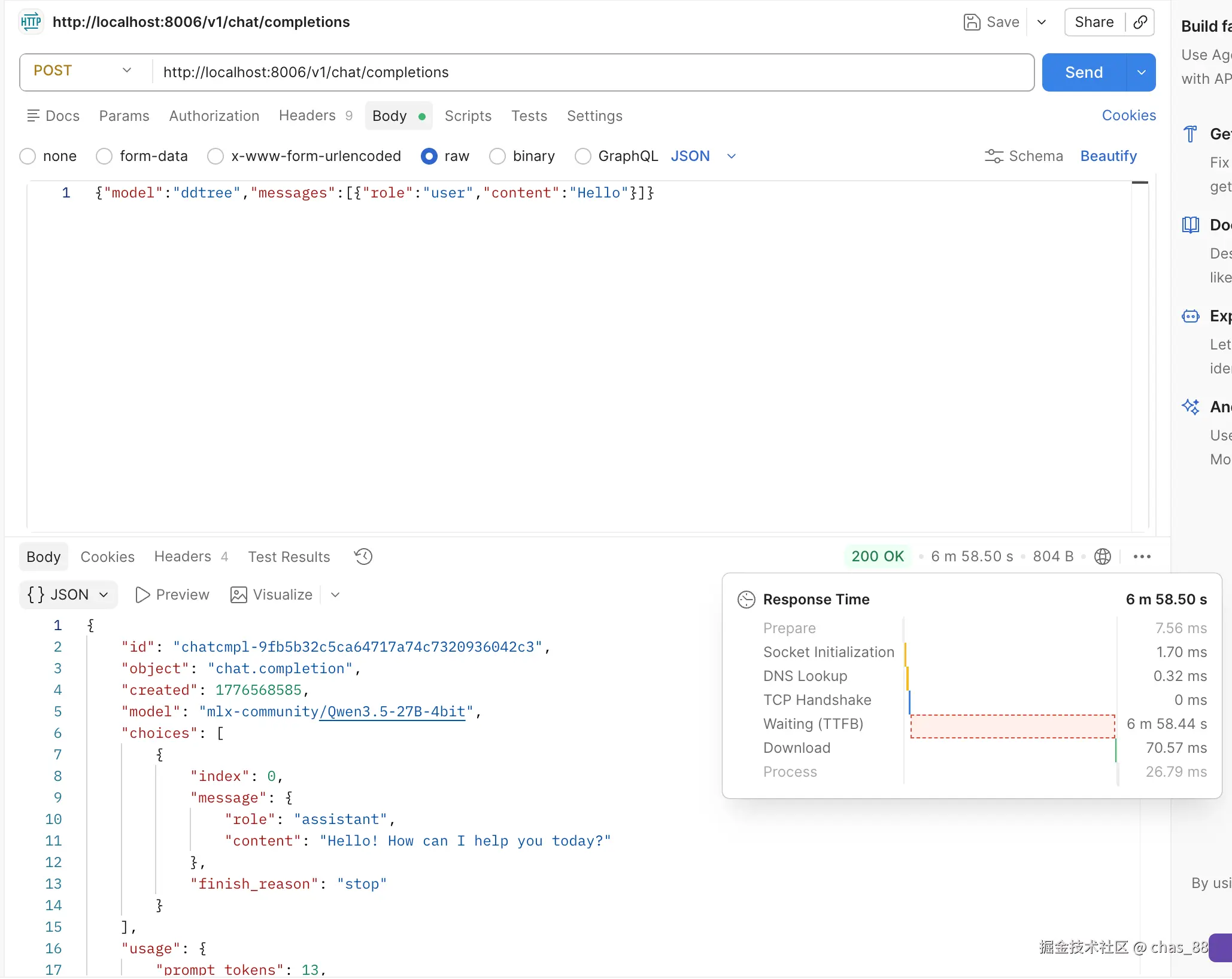

成功启动了,postman调试

本地调试:

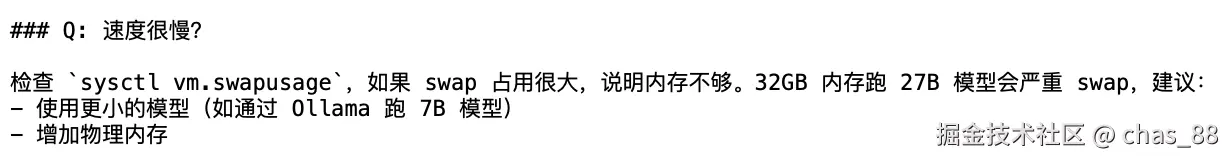

耗时很久,32G内存也没拉满,最高29G

最终效果应该是mlx-community/Qwen3.5-27B-4bit+z-lab/Qwen3.5-27B-DFlash一共19G

claude code回应

看来本地还是跑8B、9B的模型玩一下好了