引言

先说下我目前使用Coding Plan的场景吧,目前订阅的是pro套餐,接入claude code cli进行日常的编程使用,图形化界面用的是any code。

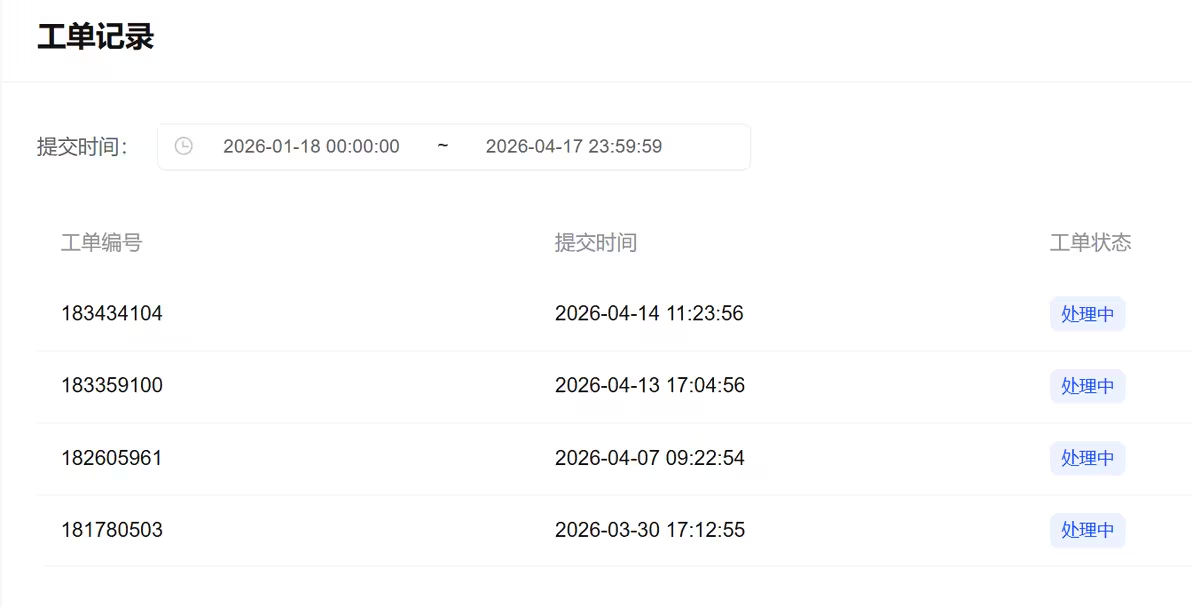

提交工单

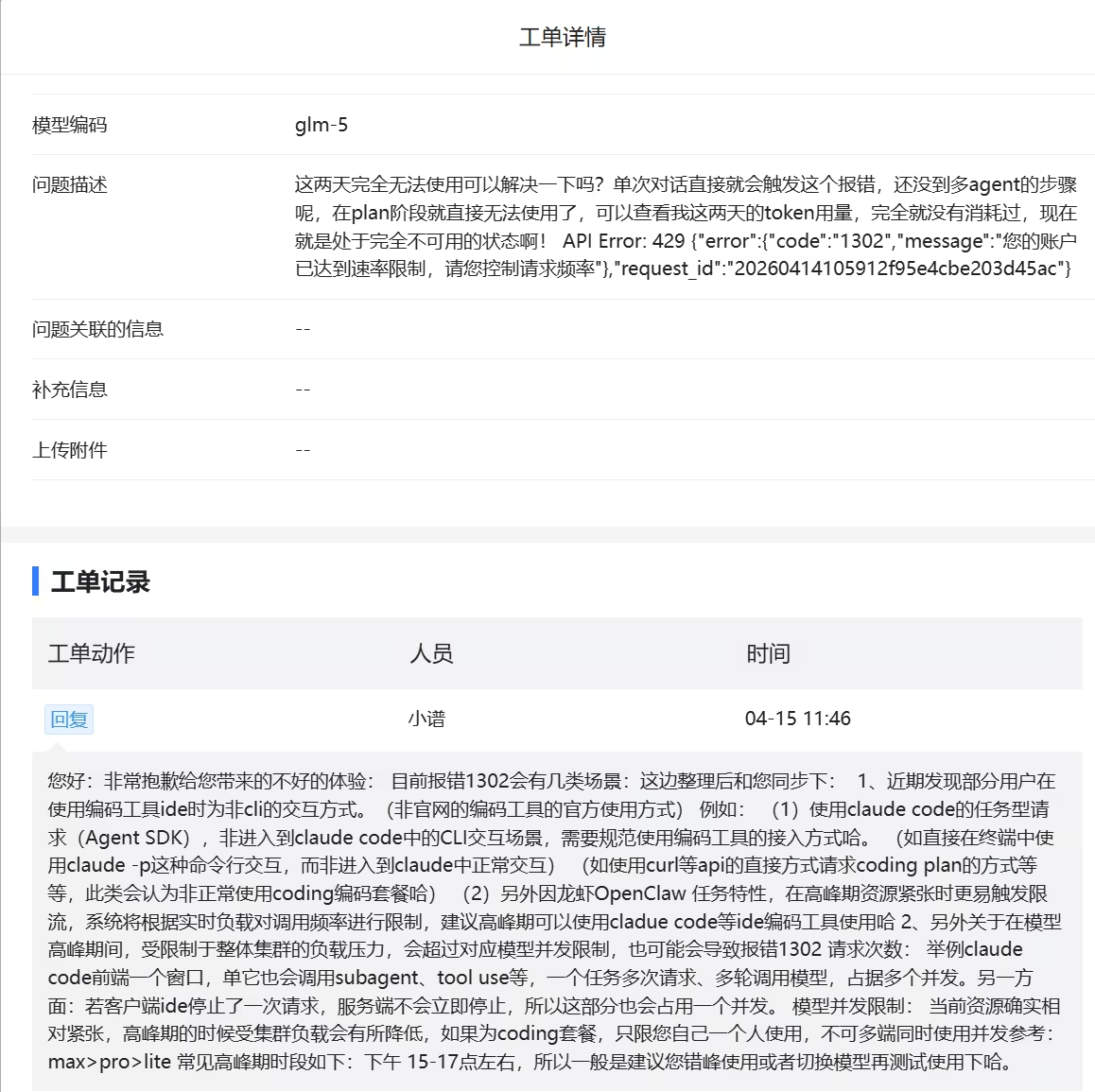

出现这种问题的时候在智谱后台提交了几次工单,见下图

问题分析

根据工单回复,多agent并发或者使用claude -p等命令都可能触发这个报错,那估计可能就是用gui的原因,我当时马上就使用终端调用,结果还是不行。但是当天我在家晚上使用gui进行使用是完全正常的。

json

{"error":{"code":"1302","message":"您的账户已达到速率限制,请您控制请求频率"},"request_id":"202604171452396418a46baa4e4846"}后续处理

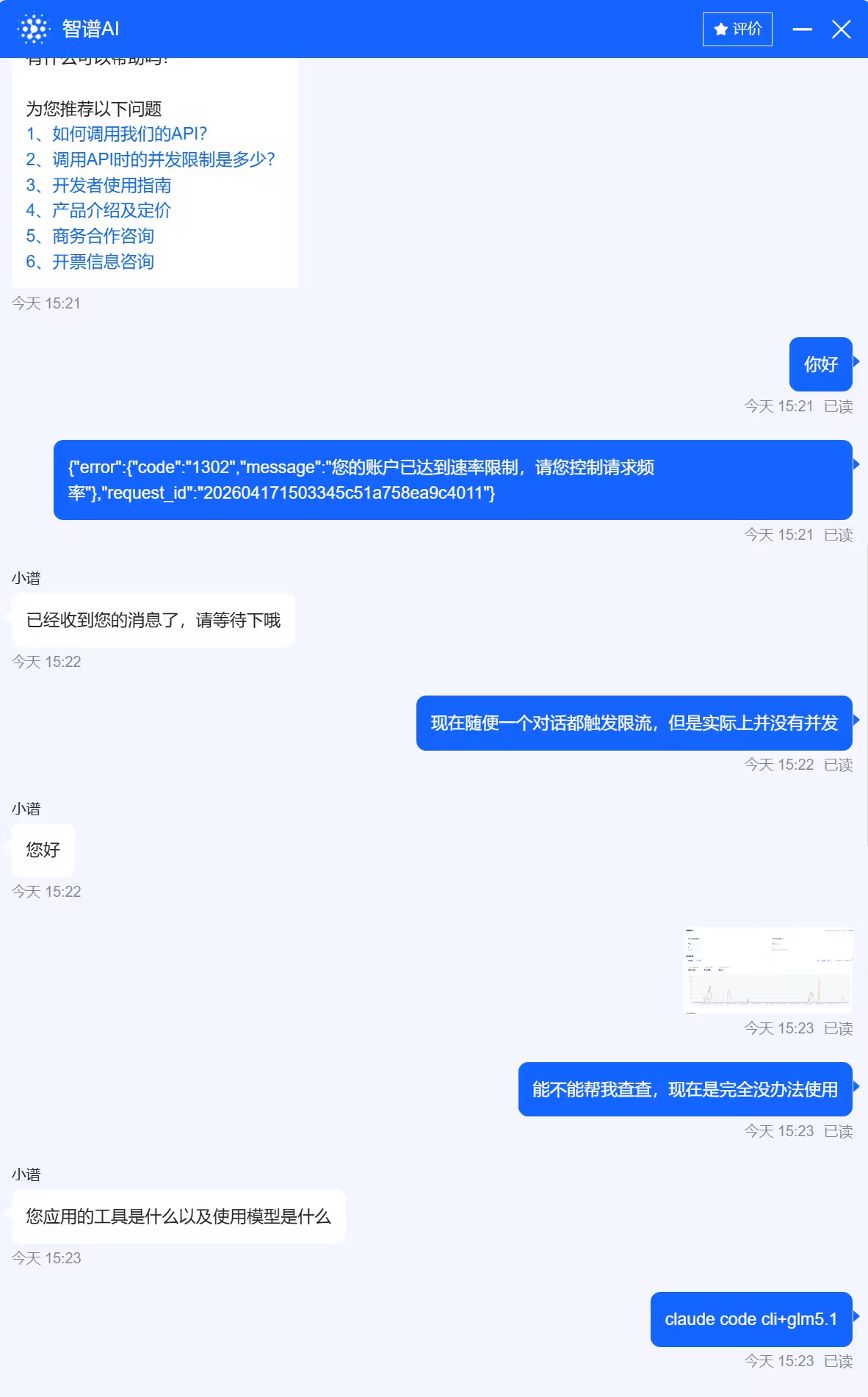

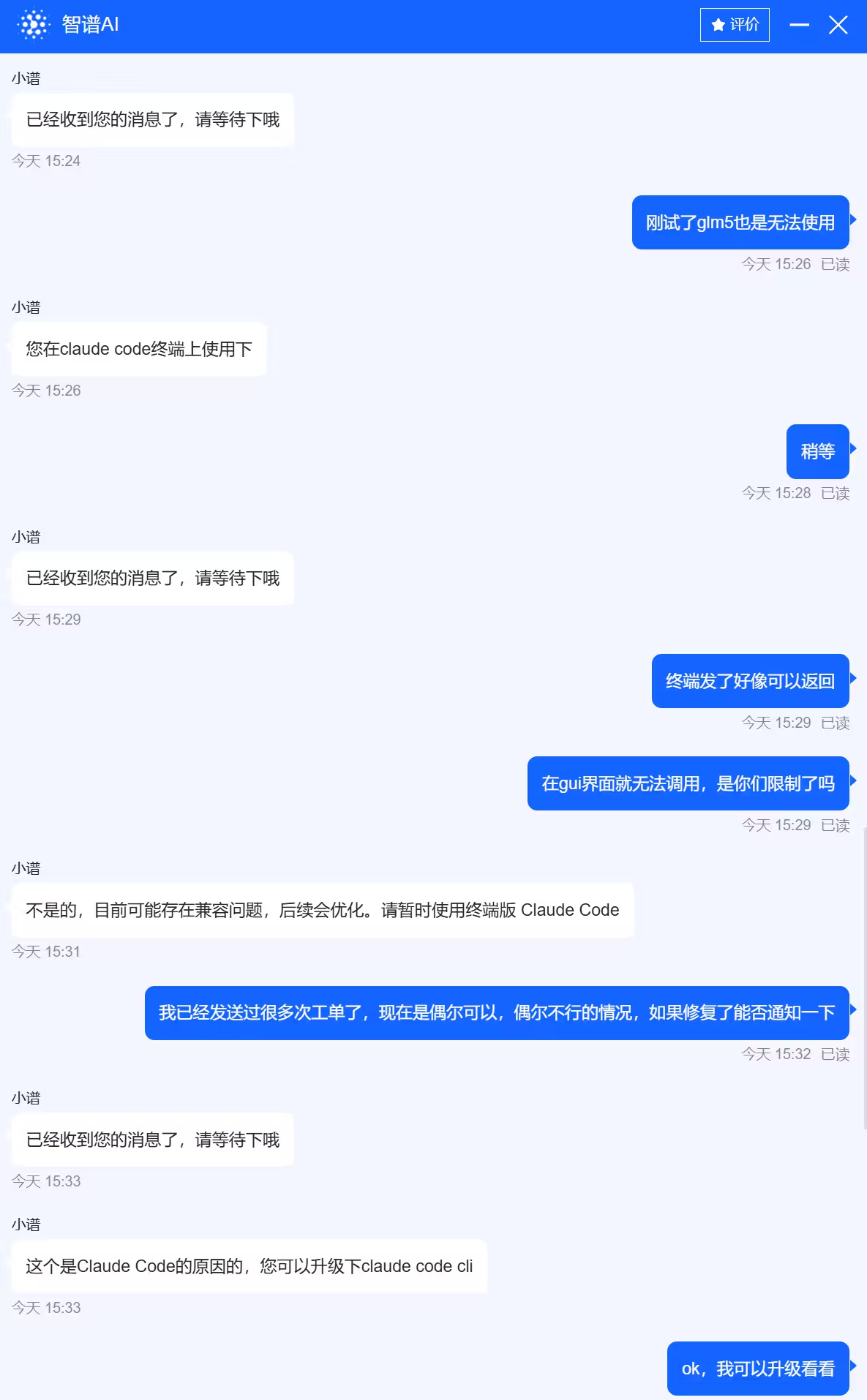

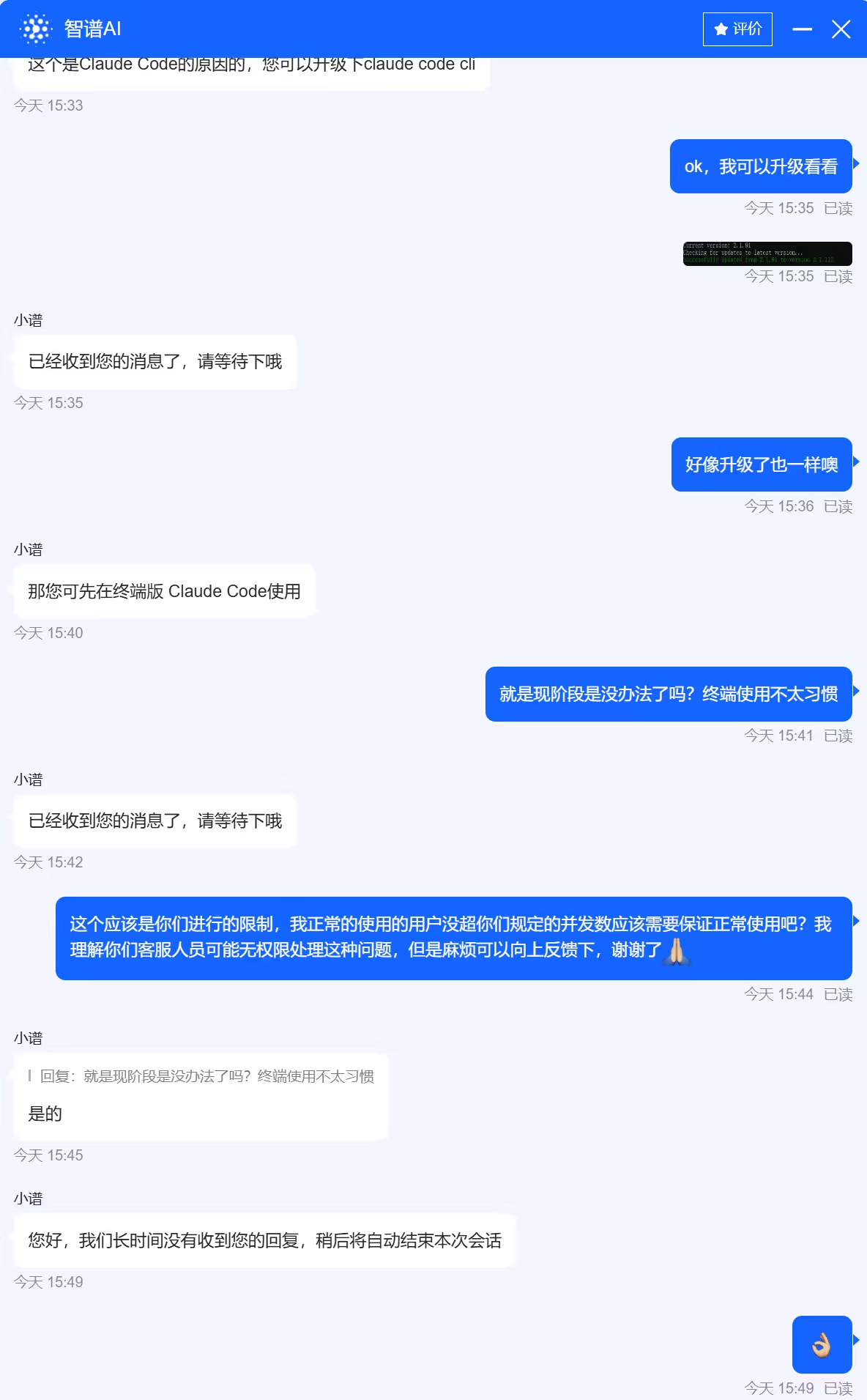

过两天我直接在官网询问在线客服,见下图

这次听客服建议,在终端调用,好像对话了几次都是正常,切换到gui调用的话就会触发429的报错,感觉就是调用方式不同,在高峰时间智谱直接就对这部分的请求进行拦截导致的,那没得办法咯,终端就终端吧。

使用分享

目前我开通各家的coding plan套餐如下,都是每月都会使用的模型,并不是买来玩玩的那种,通常就是这家用完额度或者高峰时间用不了就换下一家。

glm pro

kimi moderato

minimax plus-极速版

chatgpt plus

claude pro 中转平台

目前各家模型按照我web前端+java后端使用场景来看,其实差距并不是拉开的特别大,在做好工程化管理之后基本都能够完成任务,非要给他们进行排名的话,我会是这样排:

claude = chatgpt > glm >= kimi > minimax

-

chatgpt+codex在修复bug,或者小需求变动的情况下很好用,经常指哪打哪,一些没有考虑到的情况它都会帮你傻瓜式考虑进去处理好,并且在遵循用户指令方面我觉得应该是这几家里最强的。

-

glm的话没什么好说的,除了限流问题和有人反映的降智问题外,这个模型的综合能力确实能打(但是最近其实就是属于无限流量,速率为0的情况)。

-

kimi的话在大部分场景下任务完成的还是不错的,但是某些场景总是对工具的执行或者需求的理解差了那么一点点,顺带提一句用它做ppt确实不错(其实这个模型还是不错的,但是moderato用量是真的不够用)。

-

minimax速度确实可以,在前端场景用用很好,但是太复杂的需求好像就有点力不从心,建议可以先用其他模型plan完再切换它去执行任务可能会好点(但是需要不介意没法命中缓存的额外消耗)。

-

claude我其实使用的并不算太多(太贵了),但是用起来确实非常流畅,各种任务都理解执行到位了。

用量方面

下面只是个人经验的主观总结,因为各家对于用量的定义和限制情况五花八门,具体用量需要结合自身的使用场景和订阅的plan来分析。

-

claude就不用说了,可能用opus 4.6完成一次稍微时间长点的任务就能直接把pro每月用量使用完(很夸张)。

-

kimi可能就比claude好点,可以完成十来个左右长任务执行,多agent暂时没遇到限流的情况(10到30分钟那种)。

-

minimax目前用plus的话每天工作下来也不会遇到限流或者用量不够的情况。

-

chatgpt的话如果作为唯一重度使用的模型话,plus的用量肯定是不够的,但是如果向我这种作为辅助使用,或者作为review工具,应该差不多够用,但是我使用下来用量还是会达到限制。

-

glm老用户的pro套餐如果在不限流的情况下完全可以满足重度使用,我还没试过用完的情况。

订阅分享

下面是各家订阅的跳转链接,进去订阅可以返我一点优惠

glm

https://www.bigmodel.cn/glm-coding?ic=AVJL23AGW7

第三方中转

https://bewild.ai?code=H3FSOX5Y

https://0011.ai/i/H3FSOX5Y