本文解读CMU 2026最新研究成果------Learning Versatile Humanoid Manipulation with Touch Dreaming,探索如何让机器人通过"触觉梦想"实现多功能的精细操控

✨ 核心亮点速览

| 创新技术 | 核心突破 | 应用成果 |

|---|---|---|

| 触觉梦想(Touch Dreaming) | 预测未来触觉信号学习接触感知表征 | 5项复杂任务平均成功率提升90.9% |

| 多模态Transformer架构 | 融合视觉+触觉+本体感知的端到端策略 | 实现全身协调的灵巧操控 |

| 全身控制系统 | RL-based控制器+VR遥操作 | 从仿真到真机零样本迁移 |

一、研究背景:为什么人形机器人"难当大任"?

人形机器人被寄予厚望,承诺成为通用物理助手。然而,现实世界中的**人形全身操控(loco-manipulation)**仍面临根本性挑战:

三重困境

🔹 全身稳定性: 人形机器人需要在操作过程中保持平衡,任何姿态误差都可能导致摔倒

🔹 末端灵巧性: 需要像人类一样使用多指灵巧手进行精细操作

🔹 接触感知: 在频繁的接触变化中,微小的位姿或力误差都会迅速级联为滑脱、卡阻或失稳

💡 关键洞察:准确的手部运动还不够;成功的人形操控还需要稳健的全身执行和对接触的及时理解。

现有方案的瓶颈

| 方案类型 | 代表工作 | 局限性 |

|---|---|---|

| 全身控制系统 | OmniH2O, HumanPlus | 缺乏触觉感知和建模 |

| 触觉学习方法 | ViTacFormer | 多用于臂-手系统,不支持全身人形操控 |

研究空白 :很少有系统将全身控制 、完整末端灵巧性 和触觉感知/建模整合到一个平台中。

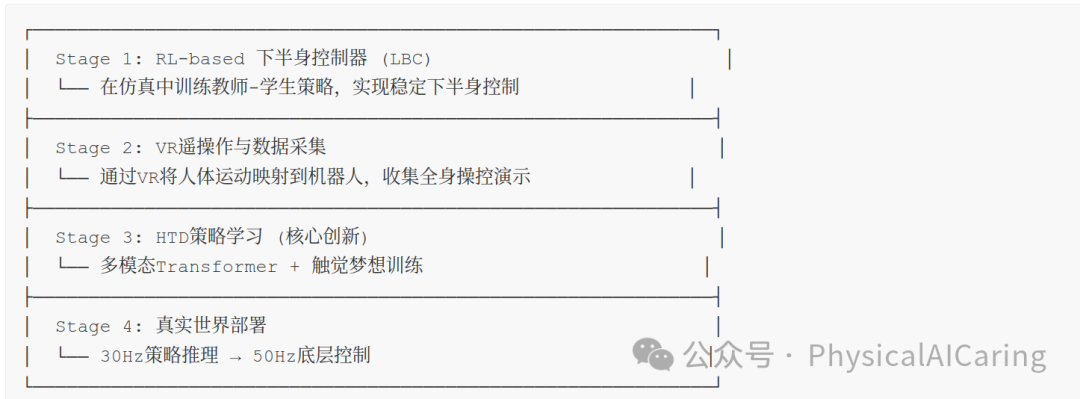

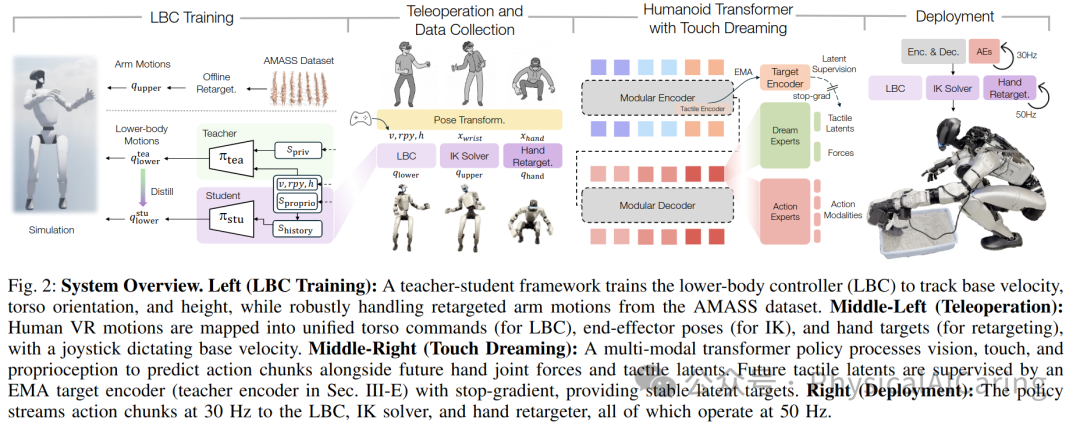

二、系统架构:四大核心模块

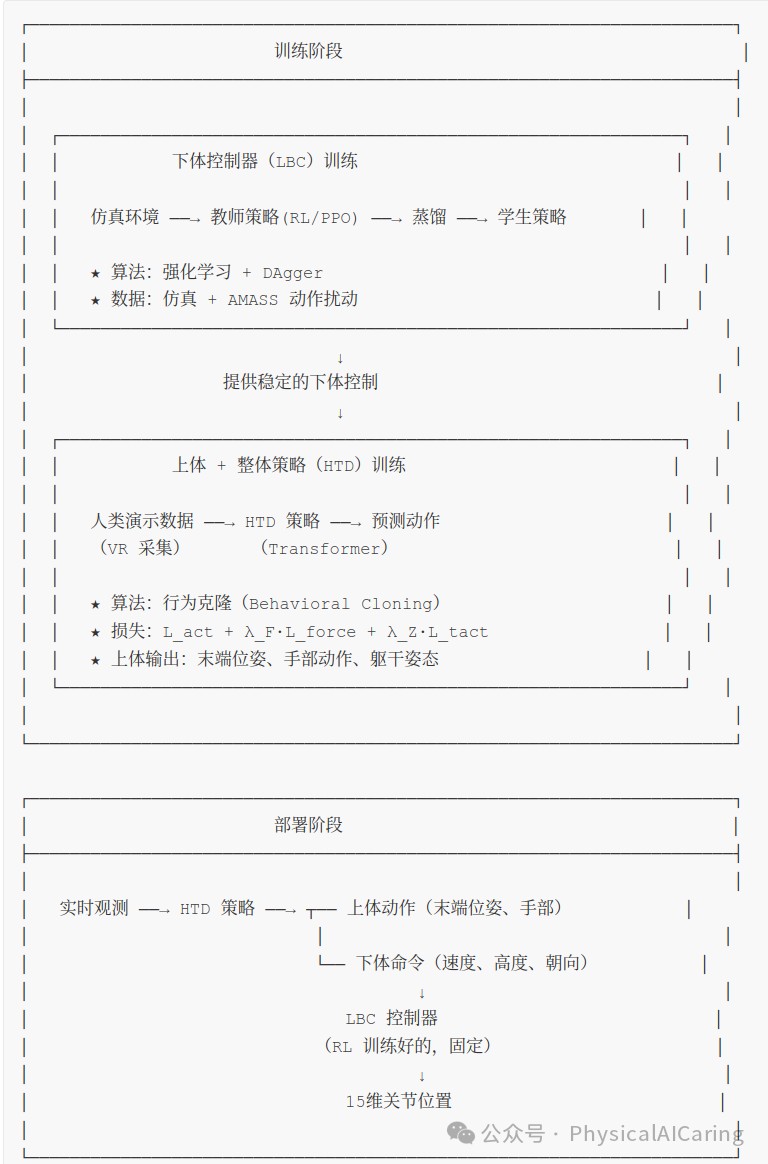

研究团队构建了一个集成系统,包含四个关键阶段:

三、核心技术:什么是"触觉梦想"(Touch Dreaming)?

3.1 核心思想

人类在操作物体时,不仅能感知当前的接触状态,还能预判未来的接触变化。这种"触觉想象力"对于复杂操控至关重要。

Touch Dreaming = 预测未来触觉信号,学习接触感知表征

3.2 为什么需要触觉梦想?

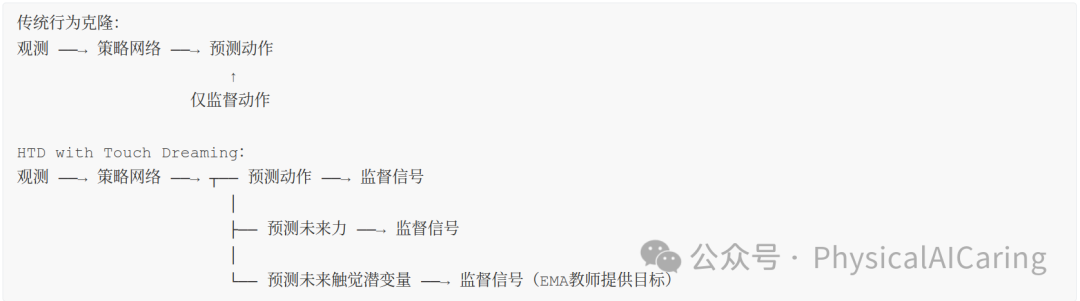

传统行为克隆的局限:

-

仅从视觉和本体感知进行动作监督学习

-

在接触丰富的操控中表现不佳,因为接触只能被部分观察且可能突然变化

-

简单地添加触觉观测并不能稳定提升性能

触觉梦想的解决方案:

除了预测动作块,策略还预测未来手部关节力 和未来触觉潜变量,鼓励共享的Transformer主干学习用于灵巧交互的接触感知表征。

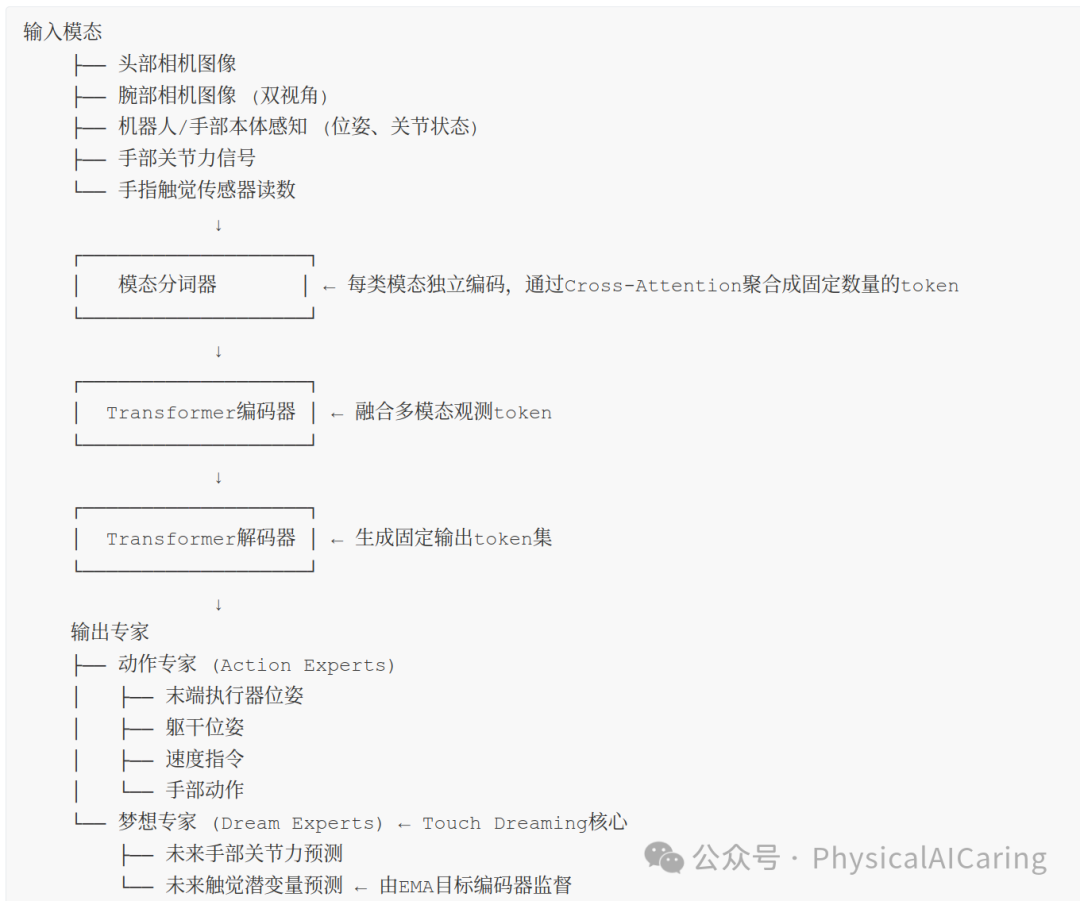

3.3 技术实现

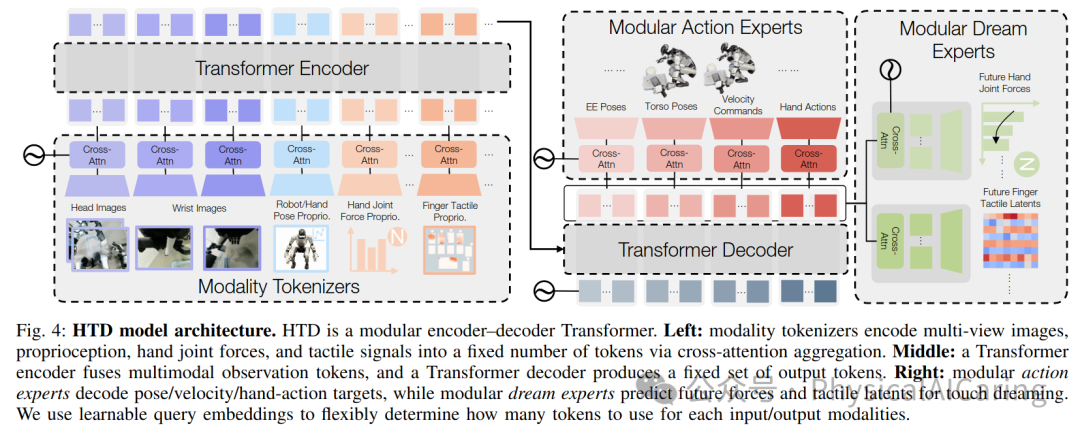

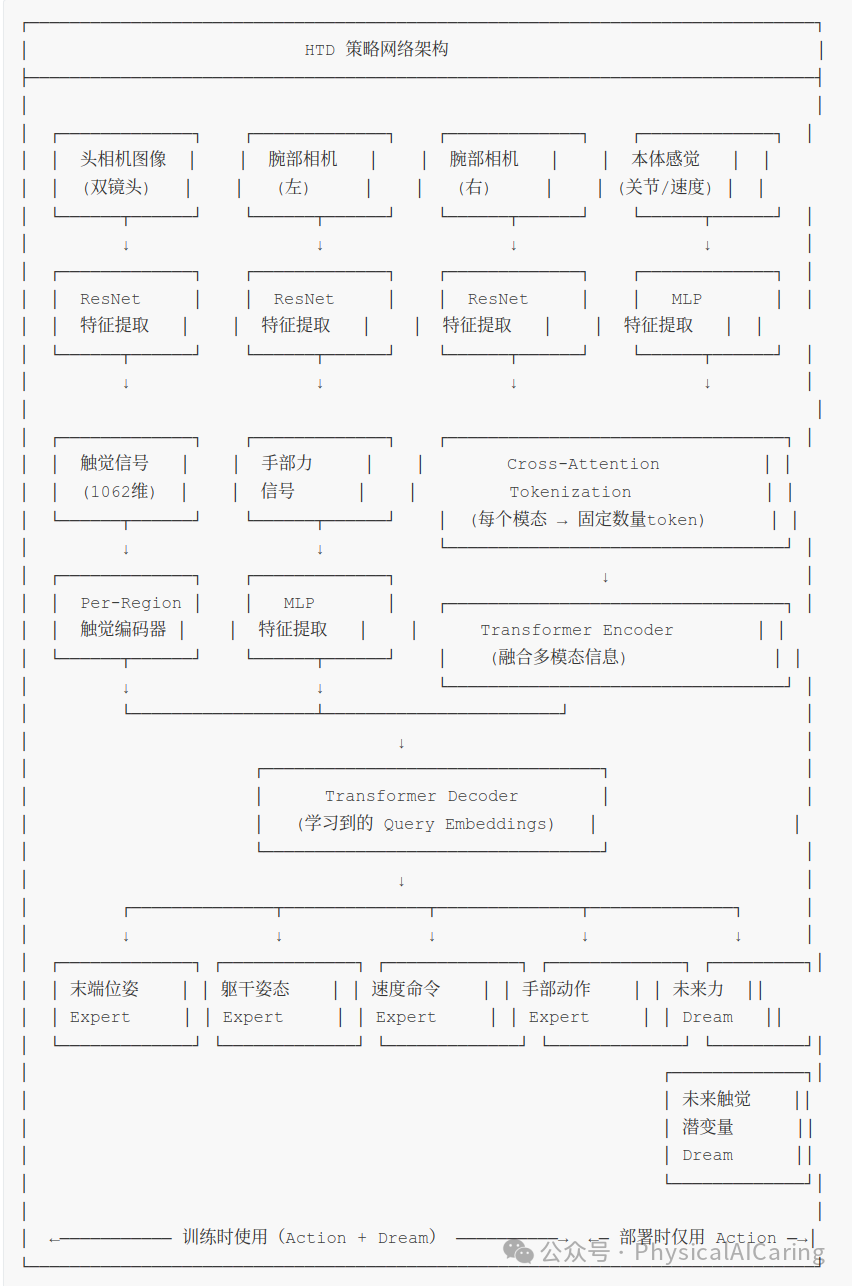

架构设计:模块化编码器-解码器Transformer

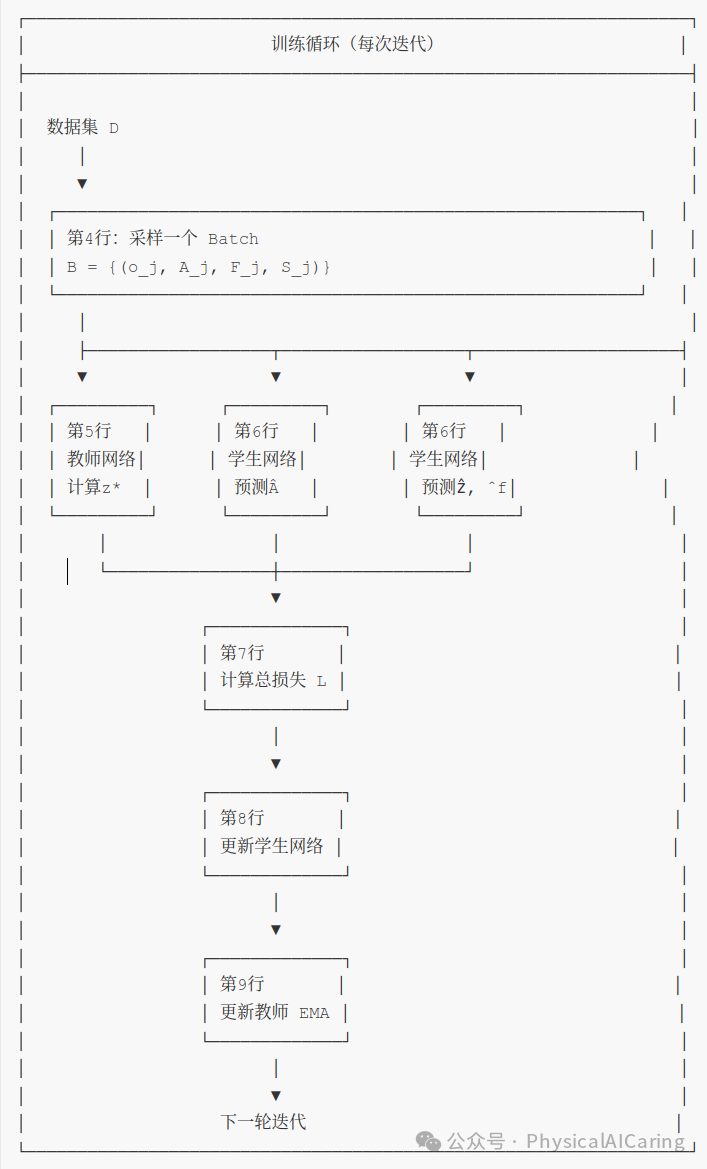

算法流程:

Algorithm 1: Imitation learning with touch dreamingAlgorithm 1: Imitation learning with touch dreaming

Input: 数据集 D(包含观测、动作、力信号、触觉信号)Output: HTD 策略 π_Θ

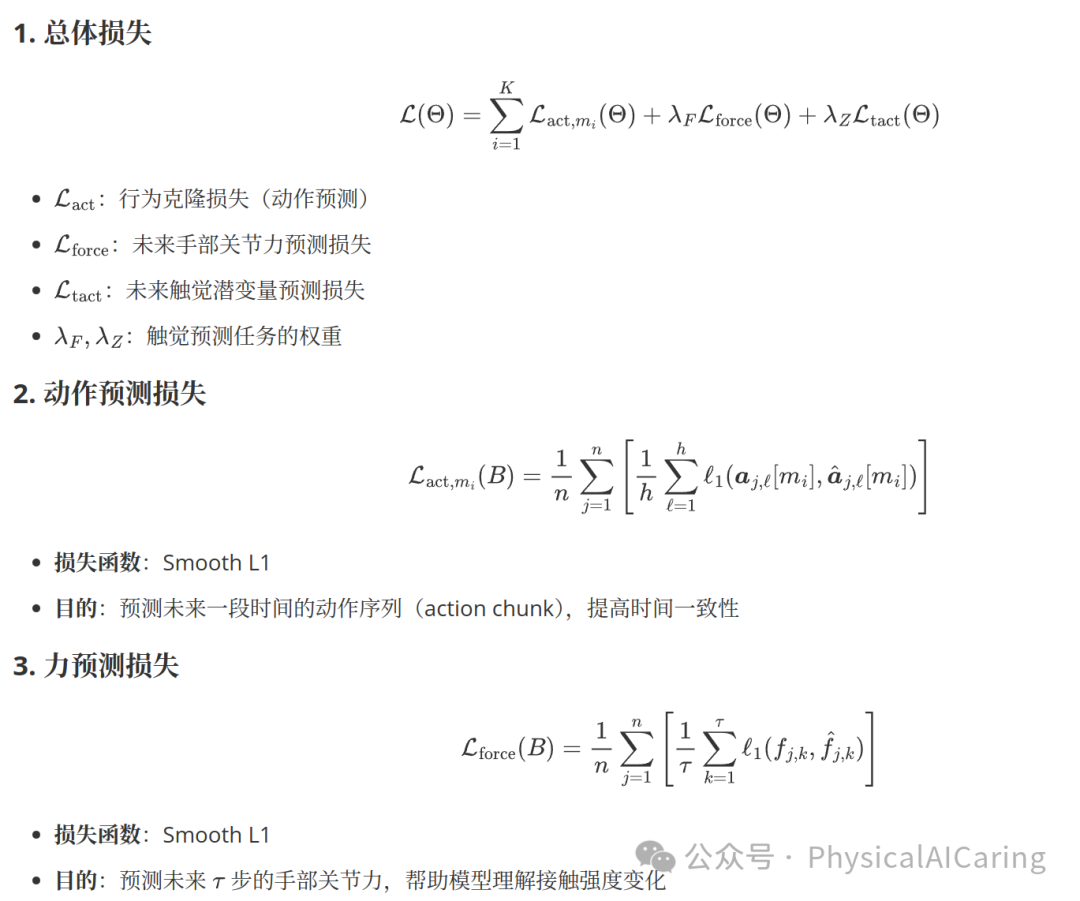

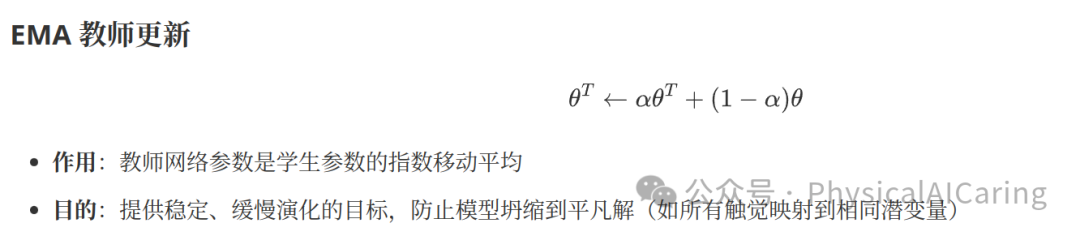

1. 初始化策略网络 π_Θ 和 EMA 教师网络2. for step = 1, 2, ... do3. 从 D 中采样一个 batch4. 用 EMA 教师计算未来触觉潜变量目标 z*5. 策略网络 π_Θ 输出:预测动作、预测未来力、预测未来触觉潜变量6. 计算总损失 L(Θ) = L_act + λ_F·L_force + λ_Z·L_tact ← 这里!7. 反向传播,更新学生网络参数 Θ8. 更新 EMA 教师网络9. end用流程图表示:

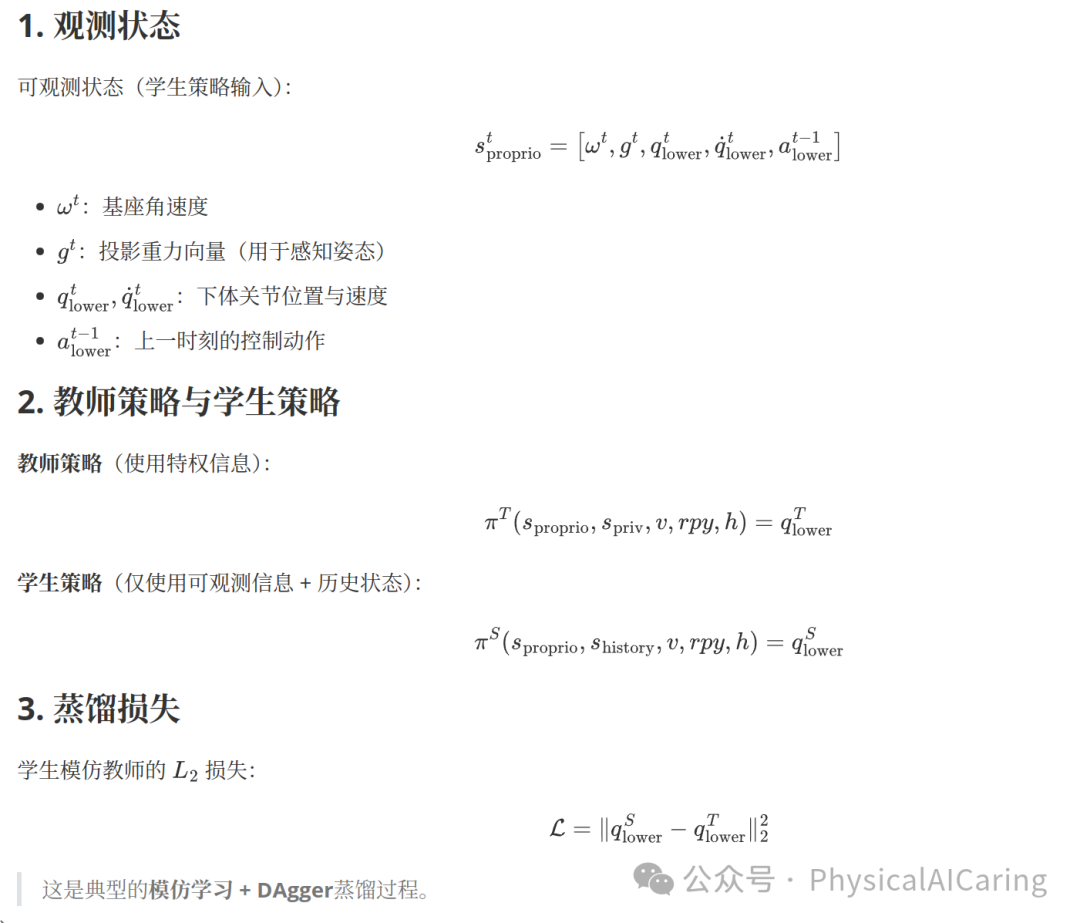

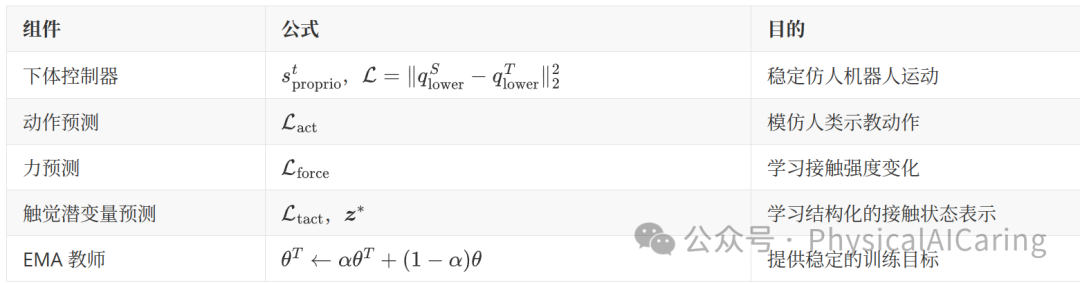

教师学生网络

Touch Dreaming总损失函数

EMA 教师更新

公式逻辑总结

这些公式共同构成了一个端到端、单阶段、触觉感知与预测结合的仿人机器人学习框架。通过:

-

下体控制器蒸馏:保证运动稳定性

-

动作块预测:提高时间一致性

-

力预测 + 触觉潜变量预测(Touch Dreaming):让模型学会"想象"未来的接触状态

最终在插入、折叠毛巾、舀猫砂等五个复杂任务中,相比基线方法取得了 90.9% 的相对成功率提升。

上下半身联合控制架构

HTD策略

传统方法 vs HTD

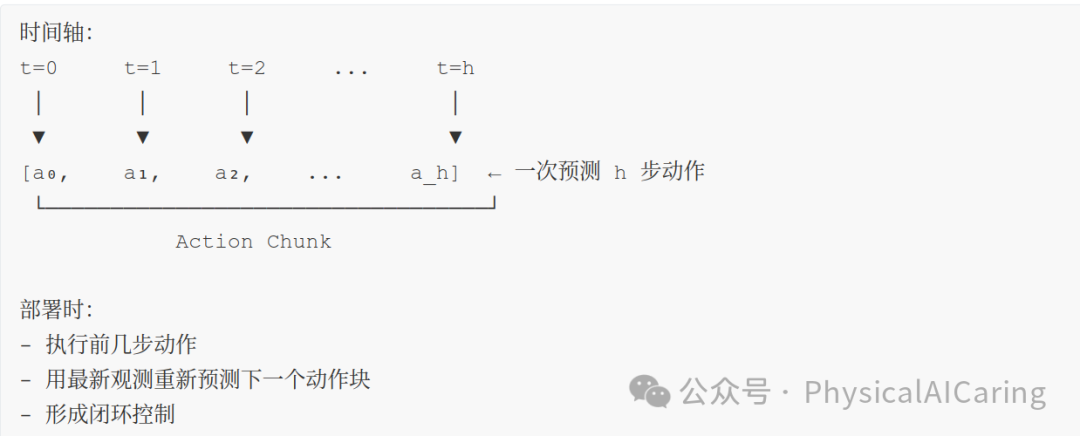

HTD 不是预测单步动作,而是预测一个动作块:

HTD整体架构

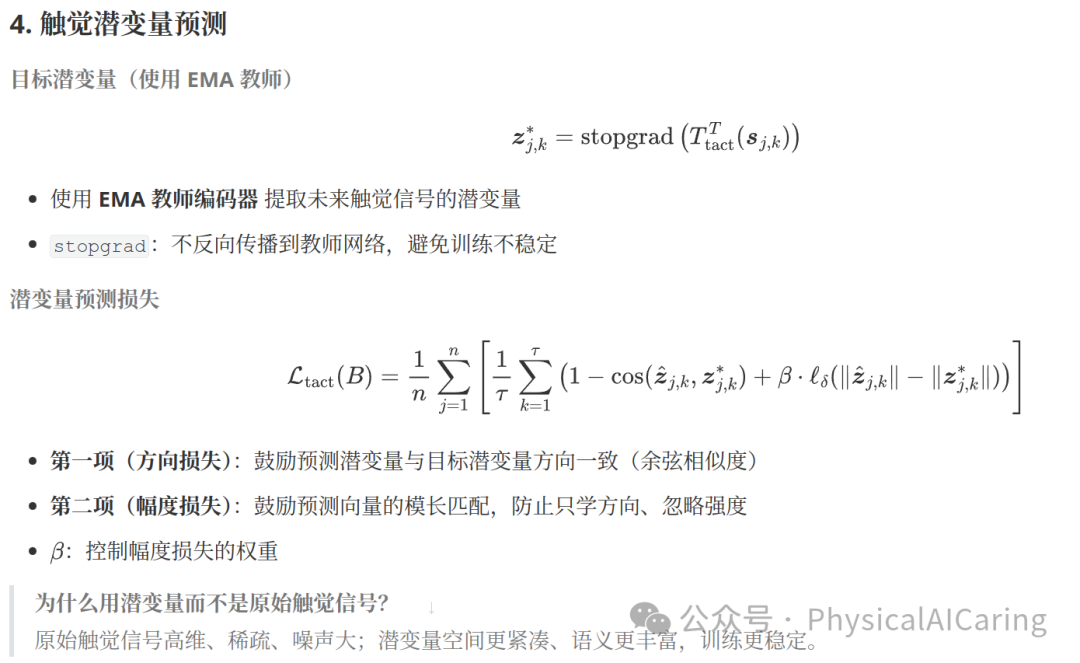

关键创新:潜空间触觉预测

Raw Tactile Prediction (原始触觉预测):

-

直接预测未来的原始触觉传感器读数

-

问题:高维、噪声敏感、不稳定

Latent Tactile Prediction (潜空间触觉预测) - 本文方法:

-

使用EMA (指数移动平均) 目标编码器作为教师网络

-

预测未来触觉的潜变量表征

-

优势:低维、语义丰富、训练稳定

训练过程:

1. 触觉编码器将原始触觉信号编码为潜变量

2. EMA目标编码器(教师)提供稳定的潜空间监督信号

3. Dream Expert预测未来触觉潜变量

4. 使用stop-gradient防止EMA教师被反向传播影响

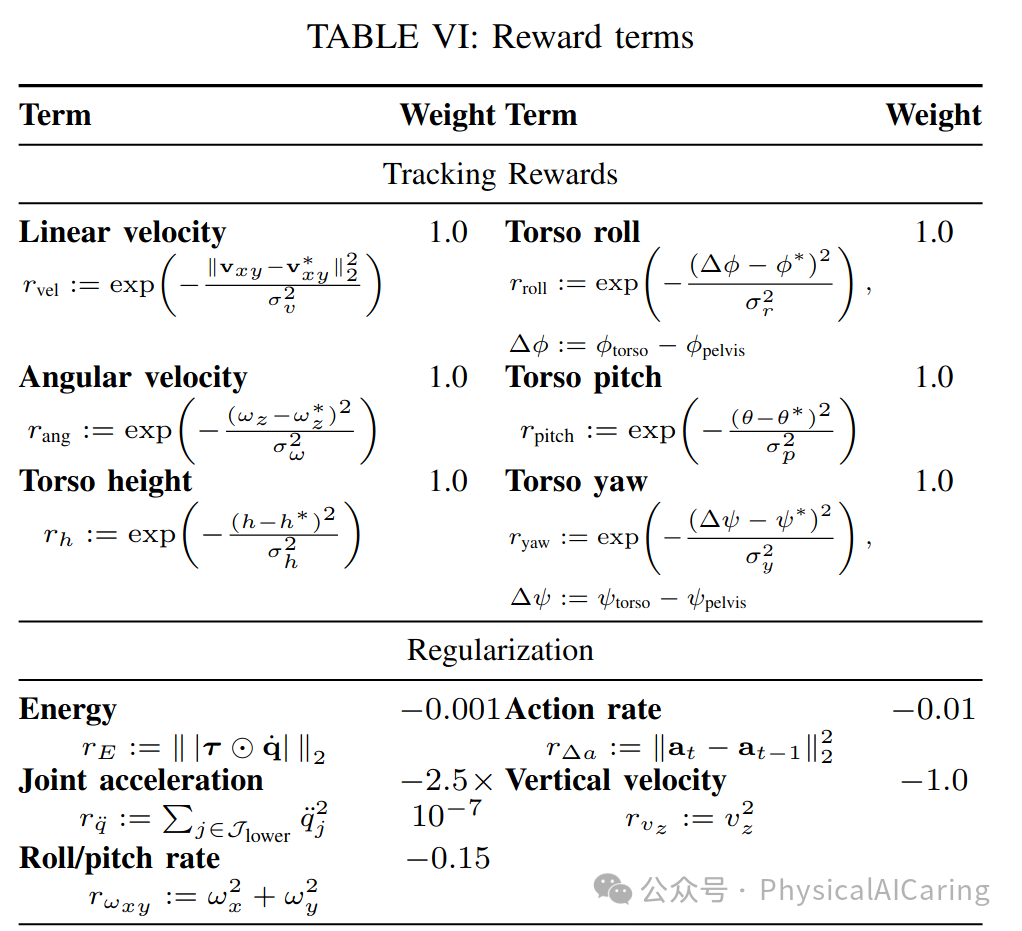

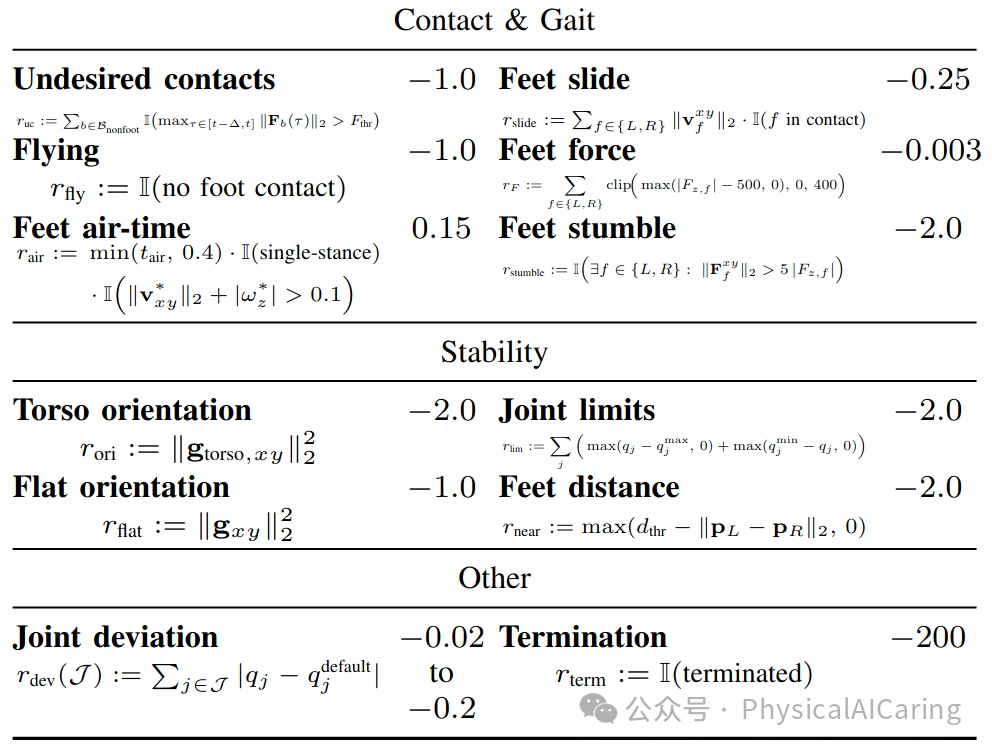

奖励函数

四、实验验证:五大真实世界任务

4.1 任务设计

| 任务 | 难度特点 | 接触类型 |

|---|---|---|

| Insert-T | 3.5mm间隙的高精度插入,需要反应性适应 | 刚性接触、精密配合 |

| Book Organization | 薄型刚性物体,抓取 affordance 有限 | 混合抓握/非抓握操控 |

| Towel Folding | 可变形物体,长程多阶段操控 | 柔性接触、大变形 |

| Cat Litter Scooping | 低矮空间约束下的工具介导接触 | 工具使用、受限空间 |

| Tea Serving | 全身移动操控,要求运输过程稳定 | 动态平衡、双手协调 |

4.2 实验结果

主实验:与ACT基线对比

| 任务 | ACT (w/ chunking) | ACT (w/ diff.) | HTD (Ours) | 提升幅度 |

|---|---|---|---|---|

| Insert-T | 13.3% | 26.7% | 60.0% | +124% vs 最强基线 |

| Book Organization | 33.3% | 46.7% | 73.3% | +57% |

| Towel Folding | 33.3% | 33.3% | 80.0% | +140% |

| Cat Litter Scooping | 60.0% | 60.0% | 93.3% | +55% |

| Tea Serving | 40.0% | 46.7% | 66.7% | +43% |

| 平均 | 36.0% | 42.7% | 74.7% | +90.9% |

🎯 核心结论:HTD在5项任务上均显著优于ACT基线,平均成功率提升90.9%!

消融实验:验证Touch Dreaming的有效性

| 配置 | Insert-T | Towel Folding | 平均成功率 |

|---|---|---|---|

| w/o Touch and TD (无触觉输入) | 46.7% | 60.0% | 基准 |

| w/o TD (有触觉输入,无触觉梦想) | 40.0% | 66.7% | 仅触觉输入帮助有限 |

| Dream Raw Tactile (原始触觉预测) | 46.7% | 73.3% | 预测目标有帮助 |

| Dream Latent Tactile (潜空间预测) | 60.0% | 80.0% | 最佳 (+30% vs 原始触觉) |

关键发现:

-

仅添加触觉输入并不总是有益 - 在某些任务上甚至略微下降

-

预测性触觉目标优于被动触觉条件 - Dream方法均优于w/o TD

-

潜空间预测显著优于原始触觉预测 - 成功率相对提升30%

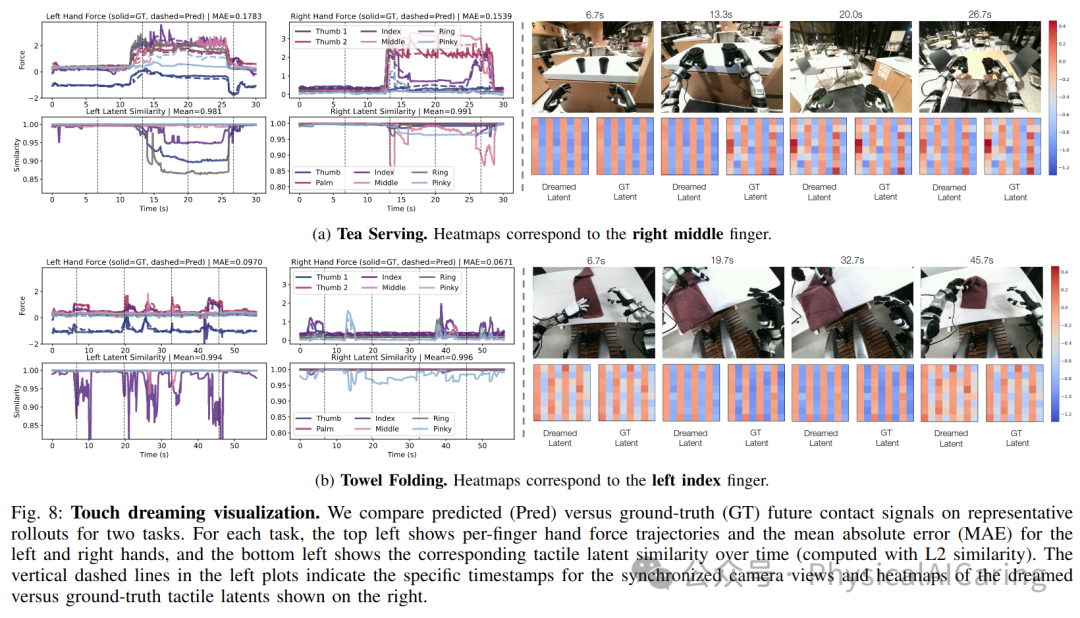

4.3 定性分析:触觉梦想可视化

实验显示HTD能够:

-

✅ 准确预测未来手部力轨迹 - 有效跟踪接触事件的时机和幅度

-

✅ 在持续接触期间保持高潜变量相似度

-

✅ 适应突发接触变化 - 尽管开环预测在不可预测的中断接触时会暂时偏离

不同任务展现不同的接触特征:

-

Tea Serving (刚性物体):施加较大力

-

Towel Folding (可变形物体):轻接触为主

五、技术创新深度解析

5.1 🌟 创新点一:触觉梦想训练范式

突破传统:将未来触觉预测作为辅助目标,而非独立的世界模型或多阶段推理模块

优势:

-

单阶段端到端训练

-

无需单独的触觉预训练

-

无需显式世界模型模块

-

训练和部署简单高效

5.2 🌟 创新点二:潜空间触觉监督

技术洞察:直接预测高维原始触觉信号困难且不稳定;潜空间预测更语义化、更稳定

实现细节:

-

EMA目标编码器提供稳定的监督信号

-

Stop-gradient防止EMA教师退化

-

触觉编码器采用逐手指/区域独立编码策略

5.3 🌟 创新点三:全身人形操控集成

系统级创新:

-

RL-based下半身控制器提供稳定基础

-

VR遥操作系统支持高效数据收集

-

多模态Transformer统一处理感知-动作映射

六、研究意义与应用前景

6.1 学术价值

| 贡献领域 | 具体价值 |

|---|---|

| 触觉学习 | 首次将预测性触觉学习引入全身人形操控 |

| 表征学习 | 验证了潜空间预测在物理交互中的有效性 |

| 系统设计 | 提供了完整的全身灵巧操控系统范式 |

6.2 应用前景

| 应用场景 | 落地价值 |

|---|---|

| 🏭 工业装配 | 精密零件装配、电子产品组装 |

| 🏠 家庭服务 | 家务协助、物品整理、老人照护 |

| 🏥 医疗辅助 | 手术器械递送、康复训练辅助 |

| 🍽️ 餐饮服务 | 餐具摆放、食物准备、茶艺服务 |

6.3 技术延伸方向

🔮 多模态融合 :结合视觉、触觉、力觉、听觉等多感官信息🔮 在线学习 :让机器人在使用中持续改进接触模型🔮 跨物体泛化 :学习通用的接触动力学,迁移到新物体🔮 人机协作:安全地与人类进行物理交互

七、局限性与未来工作

当前局限

-

触觉传感器布局依赖:当前系统针对特定触觉传感器布局设计

-

计算开销:Transformer推理需要一定的计算资源

-

接触突变处理:开环预测在面对突然接触变化时会有暂时偏离

未来方向

-

开发更轻量级的模型架构,支持边缘设备部署

-

探索闭环触觉预测,提升对突发接触的适应能力

-

将触觉梦想扩展到更多模态(如力觉、温度等)

-

研究跨机器人平台的触觉知识迁移

八、总结

Humanoid Transformer with Touch Dreaming (HTD) 代表了人形机器人操控领域的重要突破:

🎯 核心贡献:提出"触觉梦想"训练范式,通过预测未来触觉潜变量学习接触感知表征

🚀 关键突破:

相比ACT基线平均成功率提升90.9%

潜空间触觉预测比原始触觉预测提升30%

在5项复杂真实世界任务中验证有效性

💡 实用价值:为工业、家庭、医疗等领域的人形机器人应用提供了可靠的技术基础

这项工作为"如何让机器人像人类一样理解和预判物理接触"这一核心问题提供了创新性的解决思路,标志着数据驱动人形机器人学在接触丰富任务中的重大突破。