巴塞罗那,4月的CHI 2026刚结束。1705篇论文,6730份投稿,25.3%的录用率 ------ 这个数字本身不算惊人,惊人的是这1705篇里有相当比例在讨论同一件事:LLM到底怎么跟人交互。

67个研讨会里,至少有十几个直接贴着"LLM"或"AI Interaction"的标签。Google派了30多篇论文和10个研讨会,Microsoft、Apple、Carnegie Mellon(170+研究者)、Georgia Tech(110+专家)悉数到场。这不是学术会议,这是行业在用脚投票。

本文从CHI 2026出发,拆解当前HCI领域最值得关注的5个研究方向,配合世界模型与多模态LLM的最新动态,给你一张当下AI×人机交互的全景图。

一、Agentic AI:从工具到队友的范式转移

CHI 2026最密集的讨论集中在人智协作 (Human-Agent Collaboration)上。多场workshop的核心议题只有一个:LLM-powered agents能不能从"听话的工具"变成靠谱的队友。

关键问题不是能力,是信任校准。模型在什么情况下应该主动提出不同意见?失败了怎么恢复?人类应该把多少决策权交给系统?这些问题没有标准答案,但CHI 2026的研究者已经开始用实证方式逼近它们。

值得注意的一个细节:大多数讨论假设的是单人×单agent场景。但现实正在快速复杂化 ------

多用户LLM agents是今年新冒出来的研究方向。研究者开始测试模型同时服务多个主体时的表现:冲突利益怎么协调?隐私约束怎么执行?跨用户协调能力是否具备?大多数现有AI助手围绕单用户设计,这个假设正在被动摇。

Agent Team,从零构建 Claude Code Agent 工作流

二、健康公平:AI设计谁为中心的问题

CHI 2026的Best Paper - "Promise or Peril?"(Georgia Tech + Google)做了一件看起来简单但极其重要的事:系统性研究黑人成年人对AI健康应用的真实看法。

结论指向一个根本问题:AI设计对话里,谁被中心化了?当"以人为中心"被当作口号,研究者用民族志方法把它还原成了具体的人、具体的需求、具体的信任结构。这篇论文的获奖本身就是一个信号 ------ HCI社区开始认真对待"AI公平"这个命题,而不是停留在声明层面。

三、具身AI与触觉:从屏幕走向物理世界

Best Paper - "Scene2Hap"(Max Planck Institute)用多模态LLM生成整个VR场景的触觉反馈。这意味着什么?生成式AI从文字、图像一路延伸到了物理交互设计。VR不再只是视觉,触觉反馈让虚拟体验多了真实的一维。

这个方向的潜力不在于游戏,而在于远程操作、手术辅助、危险环境探测这类需要"手感"的场景。CHI 2026有多个workshop在讨论Embodied AI与Haptics的结合,包括具身导航、机器人交互、VR触觉反馈。传统HCI研究(用户研究、可用性工程)和具身AI研究(物理模拟、机器人实验)的方法论张力还没有解决,但两者正在加速汇流。

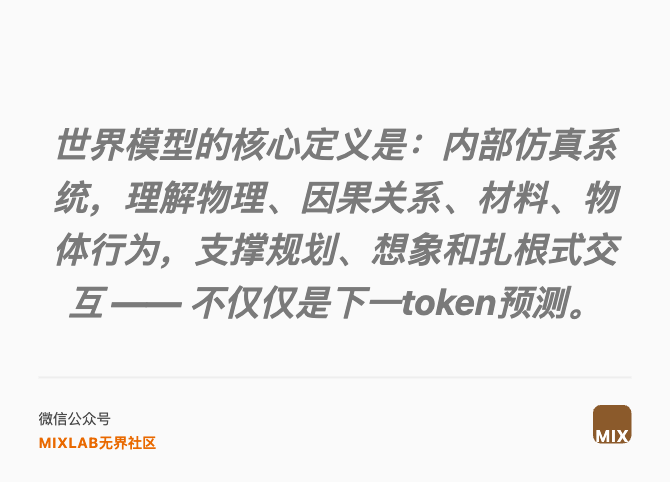

四、世界模型:2026年的突破窗口

DeepMind CEO Demis Hassabis的观点正在被更多数据支撑:通往AGI的路径将来自持续学习、记忆架构、世界模型、推理/规划、混合系统的突破,而不是单纯放大模型参数。

2026年的预期突破包括:

-

可信赖的世界模型 + 持续学习原型

-

Agent/robotics中的实时物理仿真系统(类似Genie)

-

记忆架构成为agentic框架的标准组件

JEPA/V-JEPA系列(Meta Yann LeCun主导)专注于预测性、扎根式智能,强调世界模型是实现真正通用AI的关键路径。这个路线和OpenAI/Anthropic的LLM scaling路线形成了当前最激烈的学术辩论------我们后面会单独拆这个命题。

五、多模态个性化LLM:CVPR 2026 Highlight

ByteDance发布的PersonaVLM把多模态大语言模型(MLLMs)转化为具有记忆、推理和个性对齐能力的个性化助理。在Persona-MME基准测试中,框架相比基线提升22.4%,超越GPT-4o达5.2%。

这个数字本身可能不够直观。换个角度:多模态LLM正在从"通用能力"向持久个性迁移。模型不再只是回答问题,而是记住你的偏好、你的工作流、你反复强调的约束条件。这意味着什么?AI助手正在获得连续性,而不只是即时响应。

六、一个被低估的警示信号

MIT的最新研究:使用LLM的用户在四个月期间持续在神经、语言和行为层面表现不佳。这个结果没有被广泛讨论,但它对所有"AI增强人类能力"的叙事都是一个直接质疑。

不是AI没价值,是我们对"AI作为人类能力放大器"的假设可能需要重新检验。在某些任务上,依赖LLM可能正在让使用者变弱,而不是变强。这个研究需要更多复现,但它提出的问题值得每个设计AI产品的人认真面对。

七、CHI往年文献综述告诉我们什么

Harvard、MIT、Stanford、Oxford的联合团队对2020--2024年CHI会议上153篇涉及LLM的论文做了系统文献综述(arXiv:2501.12557)。核心发现:

-

LLM工作覆盖10个不同领域,主要通过实证研究和artifact贡献

-

作者以5种不同角色使用LLM:研究工具、模拟用户、被研究对象等

-

关键问题:作者频繁提出有效性和可复现性担忧,且绝大多数研究闭源模型

-

研究社区缺乏使用LLM的明确指南和最佳实践

最后一点是这份综述里最值得留意的:HCI研究者已经在大量使用LLM,但还没有建立起方法论规范。工具跑在了指南前面。

参考

1\] ACM CHI 2026 Wraps With Record Papers --- AI2Work \[2\] Understanding the LLM-ification of CHI (arXiv:2501.12557) --- Rock Yuren Pang et al. \[3\] 2026 is Breakthrough Year for Reliable AI World Models --- NextBigFuture / Brian Wang \[4\] Multi-User LLM Agents --- Twitter @HuggingPapers \[5\] Foundation Models for Embodied Navigation: A Survey --- Twitter @jiqizhixin \[6\] PersonaVLM: Long-Term Personalized Multimodal LLMs (CVPR 2026 Highlight) --- Twitter @HuggingPapers \[7\] MIT Research: LLM users underperform over four months --- Twitter @0xtotem *** ** * ** *** 如果你对AI×HCI的交叉方向感兴趣,欢迎来 MixLab 无界社区和我们一起讨论。这里聚集着**最先触达未来的那一小部份人**,正在把AI落地实践里的真实问题跑出来。