人工智能的发展

AI,人工智能(Artificial Intelligence),是一门致力于使机器能够模拟人类思维、学习与解决问题的技术。

自文明萌芽以来,人类始终怀有 "造物" 的冲动------渴望赋予非生命以智慧。尽管 AI 在近年才成为全球焦点,但其思想的种子,早在 20 世纪50年代便已埋下。

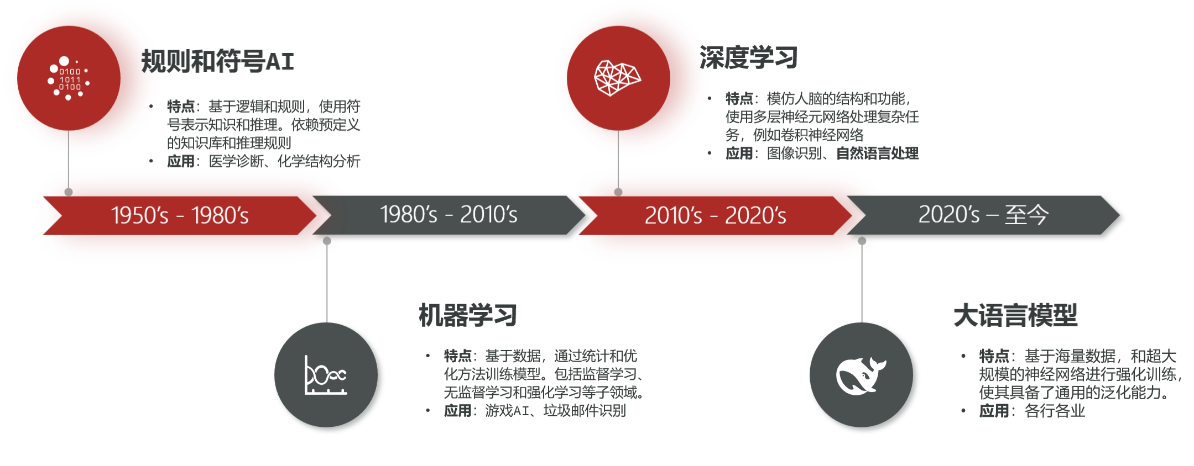

AI发展的四大阶段:

-

第一浪潮:规则与符号的探索 AI的诞生始于"符号主义"学派。在20世纪50至70年代,研究者相信智能可以通过预设的逻辑和符号规则来复刻。这些系统使用形式化的符号来表示知识,并依据严密的推理规则进行推导。然而,现实世界的模糊与复杂远超人工规则的描绘,使得此类AI局限在如象棋对弈、定理证明等封闭的专业领域,难以走向广阔天地。

-

第二浪潮:统计与学习的兴起 至1980年代,AI发展迎来了关键转折,从"符号主义"正式迈入"联结主义",机器学习成为新的引擎。研究者不再试图编写全部规则,而是让机器从数据中自行发现规律、总结模式。这一范式转换,使AI从封闭的规则库走向开放的真实数据,奠定了现代AI的基础,并在垃圾邮件过滤、推荐系统等场景中初露锋芒。

-

第三浪潮:深度神经网络的突破 21世纪初,随着海量数据与强大算力(特别是GPU)的涌现,深度学习------这一基于深层神经网络的机器学习分支------将AI推向了新的高潮。深度网络能够自动提取数据的多层次抽象特征,从而在图像识别、语音理解、自然语言处理等领域取得了远超传统方法的精度。它的成功,标志着AI在处理感知类任务上的能力首次接近乃至超越了人类水平,并催生了诸如人脸识别、智能语音助手等广泛应用。

-

第四浪潮:大模型与生成式AI的革命 真正的普及风暴始于2020年代**大语言模型(简称"大模型")**的崛起。这一次,技术变革的焦点从"专用型"的感知智能,转向了"通用型"的认知智能。通过简单的对话,任何人都能指挥AI完成写作、编程、数据分析等复杂任务,技术壁垒被空前降低。大模型不再仅是实验室的成果或新闻中的概念,它已成为普通人日常工作与生活中触手可及的智能伙伴,从根本上重塑了生产力与创造力模式,标志着AI真正融入了人类社会结构的核心。

智能产生的要素

2022年,GPT3刚刚发布时,AI的智商大约相当于7岁的小朋友,而如今最先进的大模型,其智商已接近20岁的成年人,甚至在某些领域比人类更加智能。

那么,大模型的"智能"为什么发展如此迅速?大模型产生"智慧"的根本原因是什么呢?

影响大模型智能的核心要素有三点:

-

模型算法

-

海量数据

-

超级算力

1、模型算法

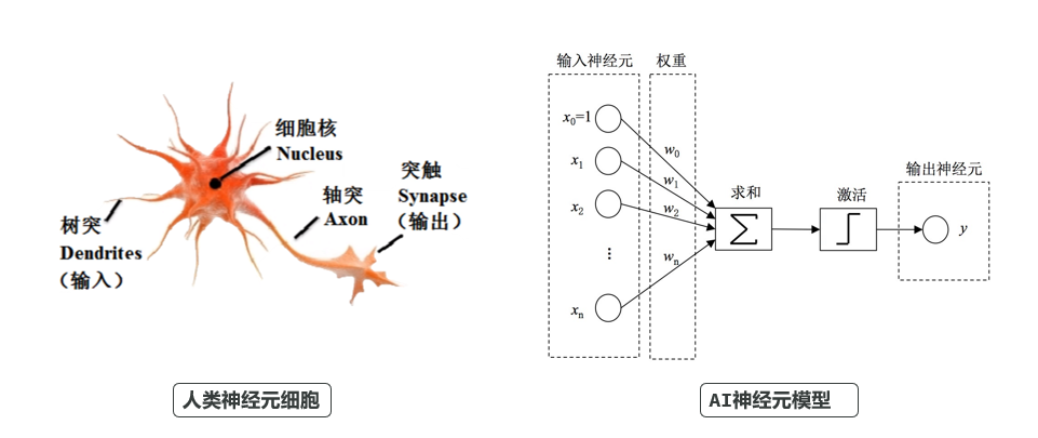

首先是模型算法,现在的AI都是采用神经网络架构,你可以把它看做是AI的大脑,是决定AI是否"聪明"的基础。

人类的大脑是由很多神经元细胞 构成,AI神经网络 的本质就是在模拟人类大脑神经元:

AI的神经元与人类神经元一样,接收多个不同的输入x,经过加权求和得到初步结果,再通过激活函数处理生成最终的输出结果。但由于早期的激活函数比较简单,只能做一些简单的二分类任务,比如判断性别、判断真假。

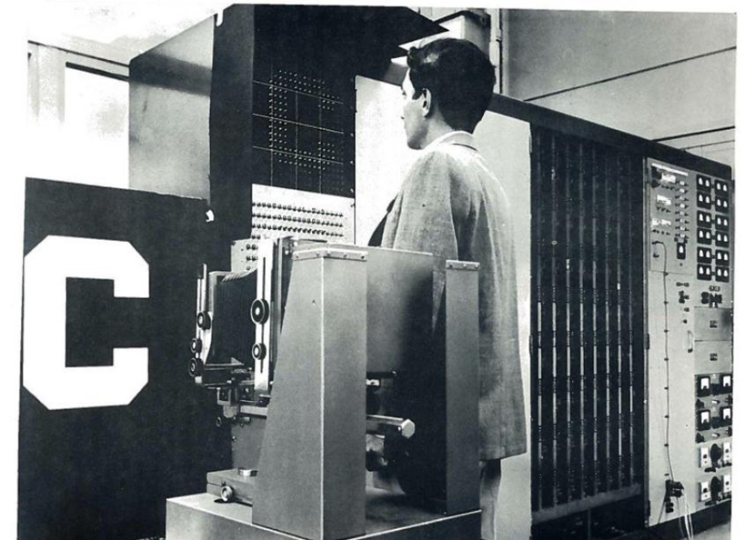

最早的神经网络可以追溯到1958 年,Frank Rosenblatt (弗兰克·罗森布拉特 )发明了人类历史上第一个神经网络机器:感知机 (Perceptrons)。

不过,感知机的神经网络比较简单,只有一个神经元,只能实现简单的二分类判断,例如:根据照片区分 性别。

近20年来,神经网络算法不断迭代、升级、优化。最初的神经网络多采用前馈神经网络,受限于算法,其理解人类语言时的上下文窗口有限,通常只能是5~10个词。

而到了现在,Transformer神经网络模型得益于优良的算法,可以并行处理大量数据,上下文窗口能达到100K级别,才能更好的理解人类的语言中的段落、语境、逻辑关系。

当然,算法只是其中一个原因。除此之外,不得不提到影响AI智能的另外两大核心:数据和算力。

2、海量数据

神经网络算法是AI的大脑,是决定AI是否"聪明"的基础。然而,再聪明的人,如果不学习任何知识,也不会产生智慧。

AI也是一样,要想让AI产生智慧,就必须用海量的数据来训练它。上个世纪,互联网不够发达,可以用来训练的数据也比较少。

到了现代,互联网、移动互联网蓬勃发展,各种数据呈井喷式呈现。AI可以学习整个互联网的精华 :所有的维基百科、无数的新闻文章、海量的书籍、庞大的代码库......这个数据量是以万亿级的词汇来计算的。而这,就给AI的训练提供了庞大的数据基础。

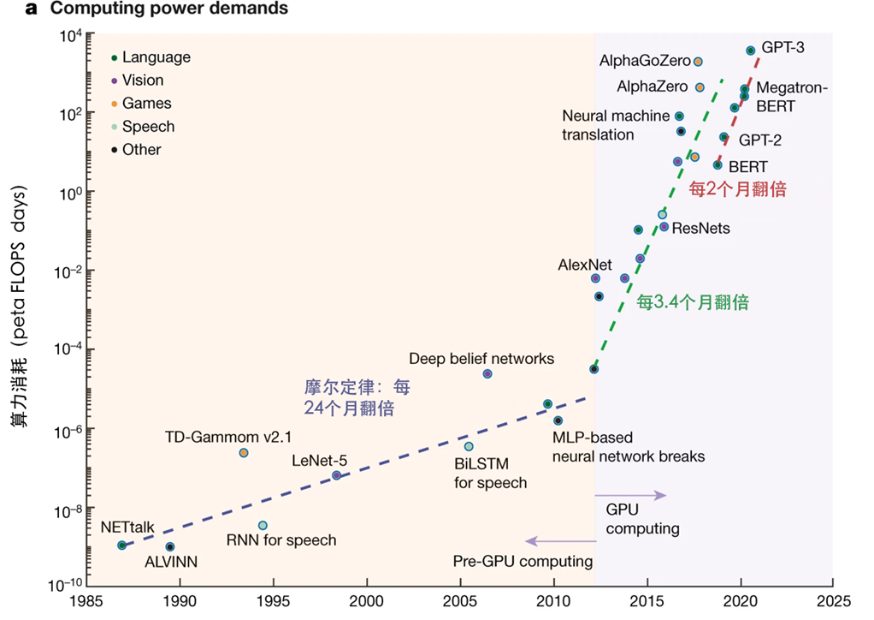

如图,随着AI大模型规模扩大,其训练所需的时长和数据量也呈指数级增长:

3、超级算力

最后是超级算力,大模型训练的数据规模庞大,神经网络架构复杂,因此训练时的计算量都是天文数字。需要成千上万的顶级GPU一起,不间断的工作数周,甚至数月才行,这背后是巨大的电力消耗和硬件成本。

如图:模型训练所需要的算力已经完全超出了摩尔定律的预估,几乎每隔几个月就会翻倍成长:

如此规模的算力消耗,在上个世纪,甚至是本世纪初期都是难以想象的。只有到了近几年,随着GPU的不断进步,算力规模才勉强满足了AI的需要。

以上三点就是大模型具备智能的核心支柱了,也是长期制约AI发展的三座大山。直到近十多年,这三者同时跨过临界点,AI能力才真正显现。