本文来自AI:

假如你当前是一名java后端开发工程师,现在从事无人车调度相关的事情,现在要配合算法团队搭建取消率模型,该模型通过xgboost生成;这是你第一次参与这些工作,对xgboost模型还不了解,现在从简到繁的,按照步骤一步步完成该工作

你好!作为一名Java后端开发工程师,面对算法团队提出的"XGBoost取消率模型"需求,感到陌生是很正常的。别担心,XGBoost虽然是算法模型,但在工程落地环节,Java工程师扮演着至关重要的角色------你是连接算法理论与线上业务的桥梁。

针对你的情况,我将这项工作拆解为5个循序渐进的步骤,帮助你从零开始完成搭建。

🗺️ 第一阶段:认知对齐------XGBoost 是什么?

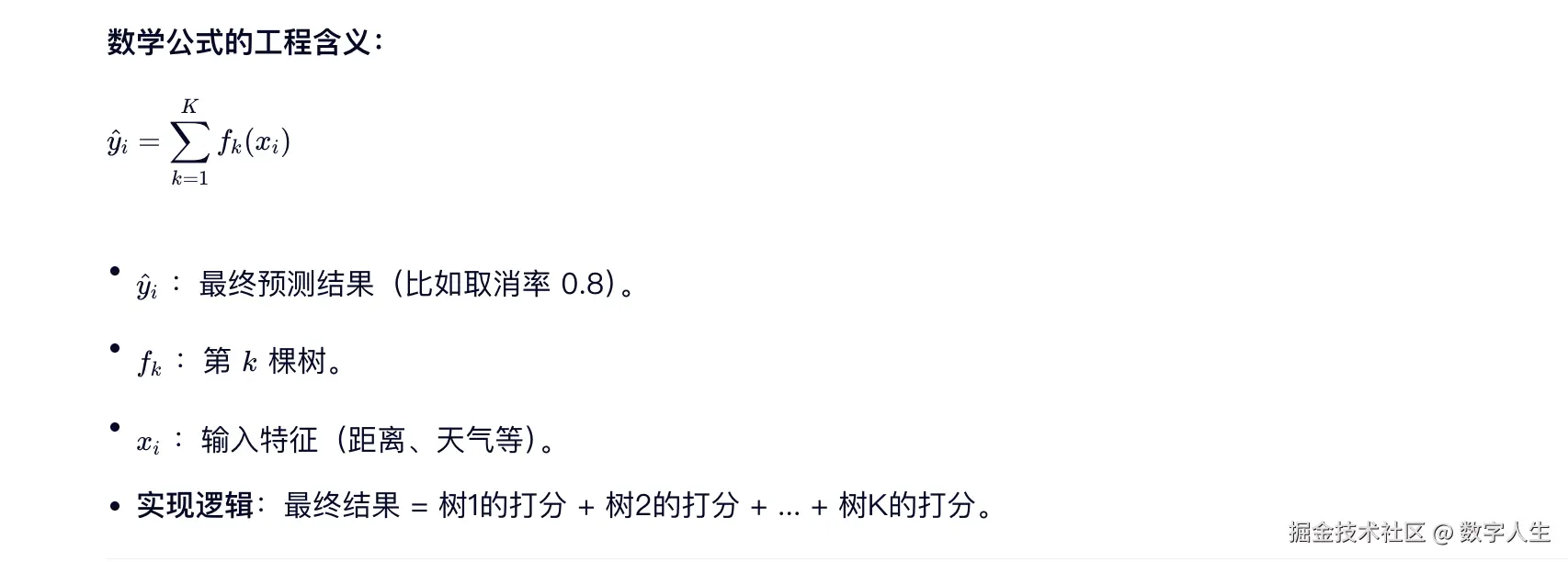

首先,你不需要像算法工程师那样去推导数学公式,你只需要理解它在工程上的意义:

- 核心概念:XGBoost(eXtreme Gradient Boosting)是一个高效的梯度提升框架。通俗点说,它通过组合很多棵"决策树"来做出预测。

- 为什么用它 :在无人车调度场景中,影响"取消率"的因素很多(如天气、距离、时间段、车型等)。XGBoost 擅长处理这种结构化数据,能自动捕捉特征之间的复杂关系,且预测速度快,非常适合线上实时调度系统。

- 你的任务 :你的核心工作不是"训练模型",而是 "特征工程的数据供给" 和 "模型的工程化部署" 。

🛠️ 第二阶段:环境准备------Java 接入 XGBoost

虽然算法团队通常用 Python 训练模型,但你的线上服务是 Java,所以你需要引入 XGBoost 的 Java 接口(XGBoost4J)。

1. 添加 Maven 依赖

在你的 pom.xml 中加入以下依赖,这将允许你的 Java 程序加载和运行 XGBoost 模型:

xml

1<dependency>

2 <groupId>ml.dmlc</groupId>

3 <artifactId>xgboost4j</artifactId>

4 <version>2.0.0</version> <!-- 版本号需与算法团队确认 -->

5</dependency>

6<dependency>

7 <groupId>ml.dmlc</groupId>

8 <artifactId>xgboost4j-spark</artifactId>

9 <version>2.0.0</version>

10</dependency>2. 理解数据格式:DMatrix

XGBoost 在 Java 中主要操作的数据对象是 DMatrix。你需要把业务中的 POJO 对象(如订单信息)转换成二维数组,再封装成 DMatrix 供模型读取。

📊 第三阶段:数据对接------特征工程

这是你工作量最大的一部分。模型准不准,很大程度上取决于你给模型"喂"了什么数据。

1. 确认特征列表

与算法团队开会,拿到一份《特征定义文档》。例如:

- 数值型:预估距离(米)、预估时长(秒)、当前排队人数(人)。

- 类别型 :天气状况(晴/雨/雪)、车型(A/B/C)。注意:类别型通常需要在 Java 层做 One-hot 编码或 Label 编码。

2. 编写数据转换代码

你需要编写一个 FeatureExtractor 类,从数据库或缓存(Redis)中拉取数据并组装。

java

// 伪代码示例:特征提取与组装

public class OrderFeatureBuilder {

public DMatrix buildFeatures(Order order, Vehicle vehicle) {

// 1. 提取特征 (顺序必须与训练时一致!)

float[] features = new float; // 假设有10个特征

features = order.getDistance(); // 距离

features = order.getWaitTime(); // 等待时间

features = vehicle.getStatus(); // 车辆状态编码

// 2. 封装为 DMatrix

float[][] data = new float[][]{features};

return new DMatrix(data);

}

}🚀 第四阶段:模型部署------从文件到服务

算法团队训练好模型后,会给你一个模型文件(通常是 .json 或 .model 格式)你需要把它集成到 Java 服务中。

1. 加载模型 不要每次请求都加载模型,应该在服务启动时(如 Spring Bean 的 @PostConstruct)将模型加载到内存中,作为单例使用。

java

@Service

public class CancelRatePredictor {

private Booster booster;

@PostConstruct

public void loadModel() throws Exception {

// 从本地路径或配置中心读取模型文件

booster = XGBoost.loadModel("classpath:model/cancel_rate_v1.json");

}

// 预测接口

public float predict(Order order) throws Exception {

DMatrix input = featureBuilder.buildFeatures(order);

// 获取预测结果 (0-1之间的概率)

float[][] result = booster.predict(input);

return result;

}

}2. 业务逻辑集成

在调度核心流程中调用该服务。

- 场景 :当用户下单时,调用

predict。 - 决策:如果返回的取消率 > 0.8(阈值),系统可以提前触发"安抚策略"或"优先派单逻辑"。

📈 第五阶段:进阶优化------监控与闭环

模型上线不是结束,而是开始。作为后端开发,你需要建立反馈机制。

1. 性能监控

XGBoost 的预测虽然快,但在高并发下也会消耗 CPU。

- 耗时监控 :记录

predict方法的耗时(P99, P95),确保不影响调度主流程的延迟。 - 异常处理:如果模型文件损坏或输入数据异常(如空指针),要有降级策略(例如:模型挂了,默认返回一个平均取消率,保证业务不中断)。

2. 数据漂移检测

随着时间推移,业务场景会变(比如冬天到了,取消率普遍变高)。

- 你需要定期(如每天)将线上的实际特征数据统计出来,发给算法团队。

- 如果线上数据的分布(均值、方差)与训练数据差异过大,说明模型需要重新训练。

📌 总结:你的行动清单

- 沟通:找算法同事要模型文件和特征定义文档。

- 依赖 :在项目中引入

xgboost4j。 - 开发:编写特征提取代码,确保数据清洗逻辑(空值填充、类型转换)与训练时一致。

- 部署:编写加载器,将模型文件集成到 Spring 容器中。

- 上线:配置开关,先在小流量(如 10% 的订单)中试运行,观察日志无误后全量。

1. XGBoost相关知识

结合你作为Java后端开发工程师的背景,以及你正在参与的无人车调度取消率模型项目,我将跳过复杂的数学推导,重点从工程落地 和业务理解的角度,为你深度解析 XGBoost。

你可以把 XGBoost 理解为一个由许多棵决策树组成的专家委员会,它通过"接力"的方式,一步步修正错误,最终得出一个非常精准的预测结果。

以下是为你定制的知识图谱:

🧠 核心原理:它是怎么工作的?

XGBoost 的全称是 eXtreme Gradient Boosting (极端梯度提升)。虽然名字听起来很学术,但其核心逻辑非常直观,属于 Boosting(提升) 家族。

1. "接力纠错"的思维方式

想象一下无人车调度的场景,我们要预测一个订单是否会取消:

- 第一棵树(初级专家) :只看"距离"。它认为"距离>5公里"容易取消。

- 第二棵树(纠错专家) :发现第一棵树判断错了(比如有的长距离订单用户很忠诚)。于是它专门盯着第一棵树的**"残差"(即预测误差)**看,结合了"等待时间"来修正预测。

- 第三棵树(高级专家) :继续盯着前两棵树的误差,结合"天气"因素再次修正。

- 最终结果:将所有树的预测结果加权相加,得出一个极高的准确率。

工程视角 :XGBoost 本质上是串行训练的(虽然它在特征处理上做了并行优化),每一棵树都在拟合上一棵树没学好的部分。

2. 为什么它比普通的 GBDT 更强?

作为后端开发,你可能听过 GBDT。XGBoost 是在 GBDT 基础上的"工程化极致优化版":

-

二阶导数信息:GBDT 只用一阶导数(梯度)来评估误差下降方向,而 XGBoost 用了二阶导数(海森矩阵)。

- 类比:一阶导数只知道"下坡",二阶导数知道"坡有多陡、弯有多急"。这让 XGBoost 收敛更快、更准。

-

正则化项:它在目标函数里直接加了"惩罚项"(控制树的叶子节点数量和权重)。

- 作用:防止模型"死记硬背"(过拟合),这对线上泛化能力至关重要。

-

自动处理缺失值 :如果数据里某些特征缺失(比如某辆车传感器故障没传数据),XGBoost 会自动学习出一个"默认分裂方向",不需要你写大量

if (value == null)的代码。

⚙️ 系统级优化:为什么它这么快?

在海量订单的调度场景下,速度就是生命。XGBoost 之所以成为工业界标准,是因为它在底层做了大量优化,这些也是你未来排查性能问题时需要知道的:

| 优化技术 | 原理简述 | 对Java后端的影响 |

|---|---|---|

| 特征预排序 | 训练前把数据按特征值排好序,存为 Block 结构。 | 训练时只需扫描一次,极大减少计算量。 |

| 稀疏感知 | 自动学习稀疏数据的默认分裂方向。 | 即使你的上游数据偶尔缺字段,模型也能跑,不用频繁修Bug。 |

| 缓存优化 | 使用"缓存感知预取算法"。 | 在处理十亿级样本时,能充分利用 CPU 缓存,减少 IO 等待。 |

| 并行计算 | 注意 :树与树之间是串行的,但特征维度是并行的。 | 在寻找最佳分裂点时,利用多线程同时计算不同特征,速度飞快。 |

🛠️ Java工程落地关键点

既然你要用 Java 配合算法团队,以下几点是你必须掌握的"工程常识":

1. 模型文件格式

算法团队通常用 Python 训练,生成的模型文件通常是 .json 或 .model 格式。

- 你的任务:将这个文件放入 Java 项目的资源目录或配置中心。

- 加载方式 :使用

XGBoost.loadModel("path/to/model.json")将其加载为Booster对象。

2. DMatrix:数据的"通用语言"

XGBoost 不直接吃 Java 对象,它只认 DMatrix。

- 数据类型 :它只接受

float类型的二维数组。 - 对齐陷阱 :你在 Java 代码中组装特征的顺序 ,必须与算法团队训练时的特征顺序严格一致。如果顺序错了,模型就会把"距离"当成"天气"去计算,导致预测结果完全错误且难以察觉。

3. 预测与部署

- 单例模式 :

Booster对象加载非常耗时,千万不要 在每次请求(如doGet)里加载模型。应该在 Spring 容器启动时(@PostConstruct)加载一次,作为单例注入。 - 线程安全 :XGBoost4J 的

predict方法通常是线程安全的,可以直接在 Controller 中并发调用。

📊 业务场景:无人车取消率模型

结合你的项目,XGBoost 是如何处理"取消率"这个问题的?

-

输入(特征) :

- 用户侧:用户历史取消率、当前是否赶时间(App操作频率)、会员等级。

- 环境侧:下雨(特征值=1)、高峰期(特征值=1)、周边车辆密度。

- 订单侧:预估距离、预估价格。

-

处理:

- XGBoost 会将这些特征输入到成百上千棵树中。

- 每棵树根据特征切分(例如:

距离 > 3km且下雨-> 走左子树)。

-

输出(结果) :

- 输出一个 0 到 1 之间的概率值。

- 例如输出

0.85,意味着该订单有 85% 的概率会取消。

-

决策:

- 你的 Java 代码拿到

0.85后,可以触发策略: "该订单极易取消,建议调度距离最近的空闲车优先去接,或者给用户发一张优惠券挽留。"

- 你的 Java 代码拿到

📌 总结

对于你(Java后端)来说,XGBoost 就是一个高性能的预测黑盒:

- 输入:对齐好的特征数组(DMatrix)。

- 内部:利用二阶导数和正则化进行极致优化的决策树集合。

- 输出:精准的概率值。

你的核心价值在于保证数据流的高质量输入 以及模型服务的高可用部署。理解了这些,你就已经具备了与算法团队高效协作的基础。

2. model.json内容

作为一名 Java 后端工程师,当你拿到 model.json 文件时,不需要把它看作一个完全的黑盒。实际上,它是一个结构非常清晰的文本文件。

在 XGBoost 1.0.0 版本之后,官方推荐使用 JSON 格式来替代旧的二进制格式(.bin),因为它具有可读性 、跨平台兼容性 (Python 训练,Java 加载毫无障碍)以及版本稳定性。

以下我为你拆解 model.json 的核心结构,并提供一个简化的 Demo。

📂 model.json 的核心结构

虽然完整的文件可能很大(取决于树的数量),但它主要由三个核心部分组成:

- version:模型的版本号,确保加载器能识别格式。

- objective:定义了模型的"目标"。比如是回归问题(预测具体数值)还是二分类问题(预测概率)。这对你的 Java 代码理解输出结果很重要。

- gradient_booster (或旧版的

gbtree_model_param):这是最核心的部分,包含了所有决策树的具体参数。它记录了树的拓扑结构(节点怎么连)、分裂条件(怎么切分数据)以及叶子节点的权重(预测值)。

📝 简化版 Demo 示例

假设我们有一个非常简单的模型:预测无人车订单是否会取消。它只包含 1 棵树,且只根据"距离"和"等待时间"进行判断。

场景逻辑:

- 如果

距离 < 5000米且等待时间 < 10分钟-> 取消率低(权重 -0.5)。 - 否则 -> 取消率高(权重 0.8)。

对应的 model.json 内容如下(我做了精简和注释,实际文件中没有注释):

json

{

"version": ,

"objective": {

"name": "binary:logistic",

"reg_loss_param": { "scale_pos_weight": "1" }

},

"gradient_booster": {

"name": "gbtree",

"model": {

"gbtree_model_param": {

"num_trees": "1",

"num_parallel_tree": "1"

},

"trees": [

{

"id": 0,

"tree_param": {

"num_nodes": "3",

"num_feature": "2"

},

"left_children": [1, -1, -1],

"right_children": [2, -1, -1],

"parents": [-1, 0, 0],

"split_indices": [0, -1, -1],

"split_conditions": [5000.0, 0.0, 0.0],

"default_left": ,

"leaf_values": [0.0, -0.5, 0.8]

}

],

"tree_info": []

}

}

}🔍 关键字段深度解读(Java 工程师视角)

当你用 Java 加载这个模型时,底层其实是在解析这些数组。理解它们有助于你排查"特征不匹配"的 Bug。

1. 节点结构(基于数组的存储)

XGBoost 为了性能,没有使用复杂的对象链表,而是用并行数组 来存储树结构。所有数组的索引 i 代表第 i 个节点。

-

split_indices(特征索引) :- 值

0表示使用特征数组中的第 1 个特征(例如distance)。 - 注意 :你在 Java 代码中构造

DMatrix时,特征的顺序必须和这里记录的顺序完全一致!如果训练时distance是第 1 列,预测时你把它放到了第 2 列,模型就会拿time去和5000比较,导致结果完全错误。

- 值

-

split_conditions(分裂阈值) :- 对应上面的

5000.0。 - 逻辑是:

if (feature_value < split_condition)。

- 对应上面的

-

leaf_values(叶子权重) :- 这是树的最终输出。

- 索引

1的值-0.5:表示满足条件(距离近),输出负分,降低取消率概率。 - 索引

2的值0.8:表示不满足条件(距离远),输出正分,提高取消率概率。

2. 目标函数

binary:logistic:表示输出需要经过 Sigmoid 函数转换,最终结果是 0~1 之间的概率。reg:squarederror:如果是回归任务,输出就是原始数值(例如预测具体的取消等待时长)。

💡 给你的建议

-

不要手动修改:虽然它是 JSON,但千万不要手动去改里面的数字。里面的数组索引是严格对应的,改一个数字可能导致树结构断裂。

-

用于调试 :当模型线上效果不对时,你可以把这个文件发给算法同事,或者自己用文本编辑器打开,检查

split_indices对应的特征是否是你预期的业务特征。 -

Java 加载 :

在你的 Java 代码中,你只需要一行代码:

java// XGBoost 会自动解析这个 JSON 结构并构建内存中的树 Booster booster = XGBoost.loadModel("model.json");你不需要自己去解析这个 JSON,了解结构是为了让你更懂"黑盒"里发生了什么。

3.替代方案

除了 XGBoost,在工业界(尤其是推荐、风控、调度领域)还有几位"重量级"选手。作为 Java 后端工程师,了解这些替代方案有助于你理解算法团队的选型逻辑,或者在 XGBoost 遇到瓶颈(如速度不够快、效果不够好)时提供备选思路。

我们可以将这些替代方案分为三大类:同门竞品(GBDT 家族) 、深度学习(DL)和传统/其他机器学习。

以下是详细的对比分析:

1. GBDT 家族的"双子星":LightGBM 与 CatBoost

这两个是 XGBoost 最直接的竞争对手,它们同样基于决策树,但在优化策略上各有侧重。

LightGBM (微软出品)

-

核心特点 :快。

- 直方图算法:XGBoost 是预排序(精确查找分裂点),LightGBM 把连续特征离散化成桶(直方图),大大减少了计算量。

- 单边 梯度采样:只关注"误差大"的样本,忽略"误差小"的样本,加速训练。

-

Java 后端视角:

- 优势:训练速度极快,内存占用极低。如果你的调度系统数据量达到亿级,XGBoost 跑不动时,LightGBM 是首选。

- 劣势:对参数比较敏感,容易过拟合(需要细心调参)。

- Java 支持 :同样有

lightgbm4j,接口和 XGBoost 非常像,迁移成本低。

CatBoost (Yandex 出品)

-

核心特点 :处理类别特征无敌。

- 原生支持类别特征:无人车调度中有很多类别数据(如:车型A/B/C、天气晴/雨、区域ID)。XGBoost 需要你手动做 One-Hot 编码,而 CatBoost 可以直接处理字符串类型的类别特征,且效果通常更好。

-

Java 后端视角:

- 优势 :省去了大量的特征预处理代码(不用写复杂的

Map<String, Integer>来转编码)。 - 劣势:训练速度相对较慢(因为要处理复杂的类别组合),模型文件通常较大。

- 优势 :省去了大量的特征预处理代码(不用写复杂的

2. 深度学习:DeepFM / DIN / Transformer

如果你的调度问题不仅仅是"表格数据",还涉及序列信息 (如用户过去 1 小时的轨迹)或非结构化数据(如文本备注、图像),深度学习是更好的选择。

代表模型:DeepFM, Wide&Deep, DIN

-

核心特点:

- 特征交叉:能自动学习特征之间的高阶组合(例如:"雨天"+"晚高峰"+"商务区"= 极高取消率,这种复杂组合树模型可能学不到,但神经网络可以)。

- 序列建模:利用 LSTM 或 Transformer 结构,可以捕捉用户行为的时间序列模式。

-

Java 后端视角:

- 部署难点:通常需要使用 TensorFlow Serving 或 TorchServe 部署为 RPC 服务,Java 端通过 HTTP/gRPC 调用,而不是像 XGBoost 那样直接加载本地文件。这增加了系统架构的复杂度。

- 解释性差:很难像树模型那样输出"特征重要性",出了问题很难排查。

3. 传统机器学习:逻辑回归 (LR) 与 随机森林 (RF)

逻辑回归 (Logistic Regression)

- 地位:工业界的"基线模型"。

- 特点:极其简单,计算速度最快。

- Java 视角:甚至不需要引入第三方库,写几行矩阵乘法代码就能实现预测。通常用于对实时性要求极高(毫秒级)且精度要求不苛刻的场景。

随机森林 (Random Forest)

- 地位:Bagging 算法的代表。

- 特点 :树与树之间是并行的(互不干扰),不容易过拟合。

- Java 视角 :Java 生态中有非常成熟的库(如

Smile或Weka),不需要依赖 Python 环境。如果你的公司严禁 Python 依赖,随机森林是纯 Java 实现复杂模型的最佳选择。

⚔️ 综合对比表(针对无人车调度场景)

| 维度 | XGBoost (当前方案) | LightGBM (最强竞品) | CatBoost (类别特征专家) | 深度学习 (DeepFM/DIN) | 逻辑回归 (基线) |

|---|---|---|---|---|---|

| 预测精度 | ⭐⭐⭐⭐⭐ (极高) | ⭐⭐⭐⭐⭐ (通常略高于XGBoost) | ⭐⭐⭐⭐⭐ (类别特征多时最强) | ⭐⭐⭐⭐⭐ (数据量大时最强) | ⭐⭐⭐ (一般) |

| 训练速度 | ⭐⭐⭐ (较快) | ⭐⭐⭐⭐⭐ (最快) | ⭐⭐ (较慢) | ⭐ (慢,需GPU) | ⭐⭐⭐⭐⭐ (极快) |

| 内存占用 | ⭐⭐⭐ (较高) | ⭐⭐⭐⭐⭐ (极低) | ⭐⭐⭐ (中等) | ⭐ (高) | ⭐⭐⭐⭐⭐ (极低) |

| Java 部署 | 容易 (本地加载) | 容易 (本地加载) | 中等 (有Java接口但较重) | 困难 (需RPC调用服务) | 极易 (原生代码) |

| 可解释性 | 高 (SHAP值分析) | 高 | 中 | 低 (黑盒) | 高 (权重直观) |

| 适用场景 | 结构化表格数据,追求高精度 | 数据量极大,对训练速度敏感 | 类别特征极多(如ID类特征) | 需要捕捉用户行为序列、非线性极强 | 实时性要求极高,或作为基准 |

💡 给你(Java 后端)的建议

-

首选 XGBoost/LightGBM :

对于"取消率预测"这种典型的表格数据(Tabular Data)任务,XGBoost 和 LightGBM 是目前的"版本答案"。它们在精度和工程落地难度之间取得了最好的平衡。

- 如果算法团队觉得 XGBoost 训练太慢 ,建议他们尝试 LightGBM,你的 Java 代码改动非常小(换个库加载即可)。

-

警惕深度学习 :

除非算法团队明确提出"树模型效果遇到了瓶颈"或者"我们需要利用用户的历史轨迹序列",否则不要轻易引入深度学习模型。因为这意味着你要维护一个 TensorFlow/PyTorch 的推理服务,运维成本会指数级上升。

-

兜底方案 :

在 Java 代码中,永远保留一个逻辑回归(LR)或者规则引擎作为兜底。

- 场景:如果 XGBoost 模型文件加载失败,或者预测耗时超过 50ms,直接降级到 LR 模型或返回一个历史平均取消率,保证调度系统不瘫痪。

总结 :XGBoost 是目前最稳健的选择。如果未来要优化,LightGBM 是提升速度的最佳替代,深度学习 是提升精度的进阶方向(但成本高)。

XGBoost实现原理

结合你 Java 后端开发的背景,我们可以把 XGBoost 的实现过程看作是一个高度优化的"构建-预测"流水线 。它并不是什么魔法,而是一套严密的工程化逻辑。

从代码实现的角度来看,XGBoost 的运行主要分为两个阶段:训练阶段(算法团队做)和预测阶段(你做) 。

下面我用**"搭积木"**的类比,配合工程逻辑,为你简单讲解它是如何一步步实现的。

🏗️ 核心架构:加法模型

XGBoost 的核心思想是**"三个臭皮匠,顶个诸葛亮"**。

它不试图用一棵超级复杂的树解决所有问题,而是生成成百上千棵简单的树(CART 树,即二叉树),然后把它们的结果加起来。

🚂 第一阶段:训练实现(算法团队在做什么?)

这是 XGBoost 最"重"的部分,它通过**"迭代纠错"**来实现。

1. 初始化(打地基)

- 先给所有样本一个初始预测值(比如所有订单的平均取消率 0.5)。

2. 迭代构建树(接力跑)

假设我们要建 100 棵树(n_estimators=100):

-

第 1 棵树:看着原始数据,尽力去预测。预测完发现误差很大(比如实际是 1,预测是 0.5,误差 0.5)。

-

第 2 棵树 :不看原始数据了,只看第 1 棵树的"残差"(误差) 。它的目标是拟合这个误差。

- 实现细节 :XGBoost 使用二阶泰勒展开(利用一阶导数和二阶导数)来寻找下降最快的方向。这比普通的 GBDT(只用一阶导数)更精准,就像下山时不仅知道方向,还知道坡度有多陡。

-

第 3~100 棵树 :每一棵新树都在拟合前面所有树累加后的剩余误差。

3. 寻找最佳分裂点(核心算法)

在构建每一棵树时,算法需要决定: "在哪个特征的哪个值进行切分?" (例如:是按"距离>5km"切,还是按"天气=雨"切?)

XGBoost 通过计算**"增益"**来决定:

- 剪枝 :如果计算出的增益 < γ(正则化参数),说明这个分裂没意义,直接剪掉,不生了。这防止了模型过拟合。

4. 工程优化(为什么它快?)

为了实现上述过程,XGBoost 在底层做了很多 Java 程序员熟悉的优化:

- 预排序:训练前把特征值排好序,存成 Block 结构,不用每次都重排。

- 并行处理 :在寻找最佳分裂点时,不同特征之间是并行计算的(多线程扫描"距离"、"天气"、"时间"等特征),这是它比传统 GBDT 快的主要原因。

- 稀疏感知:遇到缺失值(null),自动学习出一个默认方向(走左边还是右边),不用你手动填充。

🚀 第二阶段:预测实现(Java 后端在做什么?)

当模型训练好变成 model.json 后,实现逻辑就变得非常简单直接,就是一个查表+累加的过程。

1. 加载模型

你的 Java 程序读取 model.json,在内存中还原出那 100 棵树的结构(节点关系、分裂阈值、叶子权重)。

2. 路由(Routing)

对于一个新订单(特征向量 x):

- 进入树 1 :从根节点开始,判断

距离 < 5000?是 -> 走左边;否 -> 走右边。一直走到叶子节点,拿到一个分值 w1(比如 0.2)。 - 进入树 2 :同样的逻辑,拿到分值 w2(比如 -0.1)。

- ...

- 进入树 100 :拿到分值 w100。

3. 累加与转换

- 求和 : Score=w1+w2+...+w100。

📌 总结:XGBoost 的实现流

| 步骤 | 动作 | 角色 | 关键技术点 |

|---|---|---|---|

| 1 | 数据准备 | 算法/后端 | 特征工程,生成 DMatrix。 |

| 2 | 目标定义 | 算法 | 定义损失函数(如LogLoss)+ 正则项(防止过拟合)。 |

| 3 | 迭代训练 | 算法 | 梯度提升:每棵树拟合上一棵树的残差。 |

| 4 | 节点分裂 | 算法 | 贪心算法:遍历所有特征,找增益最大的切分点。 |

| 5 | 模型导出 | 算法 | 将树结构序列化为 JSON/Bin 文件。 |

| 6 | 线上推理 | Java后端 | 查表法:根据特征值在树中游走,累加叶子权重。 |

一句话总结 :

XGBoost 的实现就是用并行的方式快速构建成百上千棵回归树,每棵树都在修正前一棵树的错误,最后把所有树的结果加起来。

扩展:深度学习

既然你已经理解了 XGBoost(基于树的模型),那么理解**深度学习(Deep Learning)**会非常容易。

简单来说,深度学习是机器学习 的一个子集,它的核心灵感来自于人脑的神经结构。

如果说 XGBoost 是一个由许多专家组成的"委员会",通过投票来做决策;那么深度学习就是一个**"多层级的自动化工厂"**,通过流水线层层加工,最终产出结果。

以下我从三个维度为你简单拆解:

🧠 核心概念:什么是"深度"?

深度学习的基础是人工神经网络(ANN) 。

- 浅层(传统机器学习) :比如逻辑回归,只有一个输入层和一个输出层。它只能处理简单的线性关系。

- 深度(Deep Learning) :在输入层和输出层之间,加了很多个"隐藏层" 。这就是"深度"的含义。

形象类比:识别一辆无人车

- 第一层(输入层) :接收图片的原始像素。

- 第二层(浅层隐藏层) :识别出线条、边缘、颜色。

- 第三层(中层隐藏层) :把线条组合成形状,比如"车轮"、"车窗"、"车灯"。

- 第四层(深层隐藏层) :把形状组合成整体,识别出"这是一辆车"。

- 输出层:输出概率(99%是车)。

每一层都在上一层的基础上,提取更抽象、更复杂的特征,这叫特征表示学习。

⚙️ 工作原理:它是怎么"学"的?

和 XGBoost 的"加法模型"不同,深度学习的学习过程是**"误差反向传播"**。

-

前向传播(干活) :

数据从输入层进入,经过层层计算(加权求和、激活函数),最后得出一个预测结果。

-

计算损失(找茬) :

对比预测结果和真实结果(比如预测是车,实际是卡车),计算误差(Loss)。

-

反向传播(背锅与改进) :

这是核心!误差会像涟漪一样从输出层反向传回输入层。

- 系统会计算每一个神经元(节点)对误差的"贡献度"(梯度)。

- 如果是你的责任,就调整你的参数(权重)。

- 通过梯度下降算法,不断微调网络中成千上万个连接点的权重,直到误差最小。

⚖️ 深度学习 vs XGBoost(Java 工程师视角)

在你的无人车调度项目中,区分这两者非常重要:

| 维度 | XGBoost (树模型) | 深度学习 (神经网络) |

|---|---|---|

| 数据偏好 | 结构化数据(Excel表格、数据库字段)。擅长处理"距离、时间、车型"等特征。 | 非结构化数据(图像、语音、文本)。擅长处理"摄像头画面、用户语音指令"。 |

| 特征工程 | 依赖人工。需要你去构造特征(如"早晚高峰标志位")。 | 自动提取。给它原始数据,它自己学特征,不需要太多人工干预。 |

| 可解释性 | 高。可以算出哪个特征最重要(特征重要性)。 | 低(黑盒)。很难解释为什么它认为这张图是卡车。 |

| 数据量需求 | 中小规模数据表现极佳。 | 需要海量数据才能训练好,数据少容易过拟合。 |

| 算力需求 | CPU 即可,速度快。 | 通常需要 GPU 加速(矩阵运算量大)。 |

| 部署方式 | Java 本地加载 (xgboost4j),轻量级。 |

通常需要独立服务 (TensorFlow Serving),Java 通过 RPC 调用,较重。 |

🚀 常见类型(你可能听到的术语)

-

CNN(卷积神经网络) :

- 专长:图像处理。

- 场景 :无人车的视觉感知(识别红绿灯、行人、车道线)。

-

RNN / LSTM / Transformer:

- 专长:序列数据(有时间先后关系的数据)。

- 场景 :自然语言处理 (听懂乘客指令)、轨迹预测(根据过去10秒的位置预测未来轨迹)。

-

DNN(深度神经网络) :

- 专长:通用的多层感知机。

- 场景:复杂的推荐系统、风控模型。

📌 总结

对于你(Java 后端)来说:

- XGBoost 是你处理表格数据(订单、调度、统计)的首选武器,轻便、精准、好解释。

- 深度学习 是算法团队处理复杂感知任务(看路、听音、理解语义)的核武器,强大但笨重、难解释。

在无人车调度系统中,通常是两者结合:深度学习负责"看懂"世界,XGBoost 负责基于这些信息做"决策"和"调度"。