ComfyUI 实战:AnimateDiff + OpenPose Walking 姿态驱动视频生成

摘要

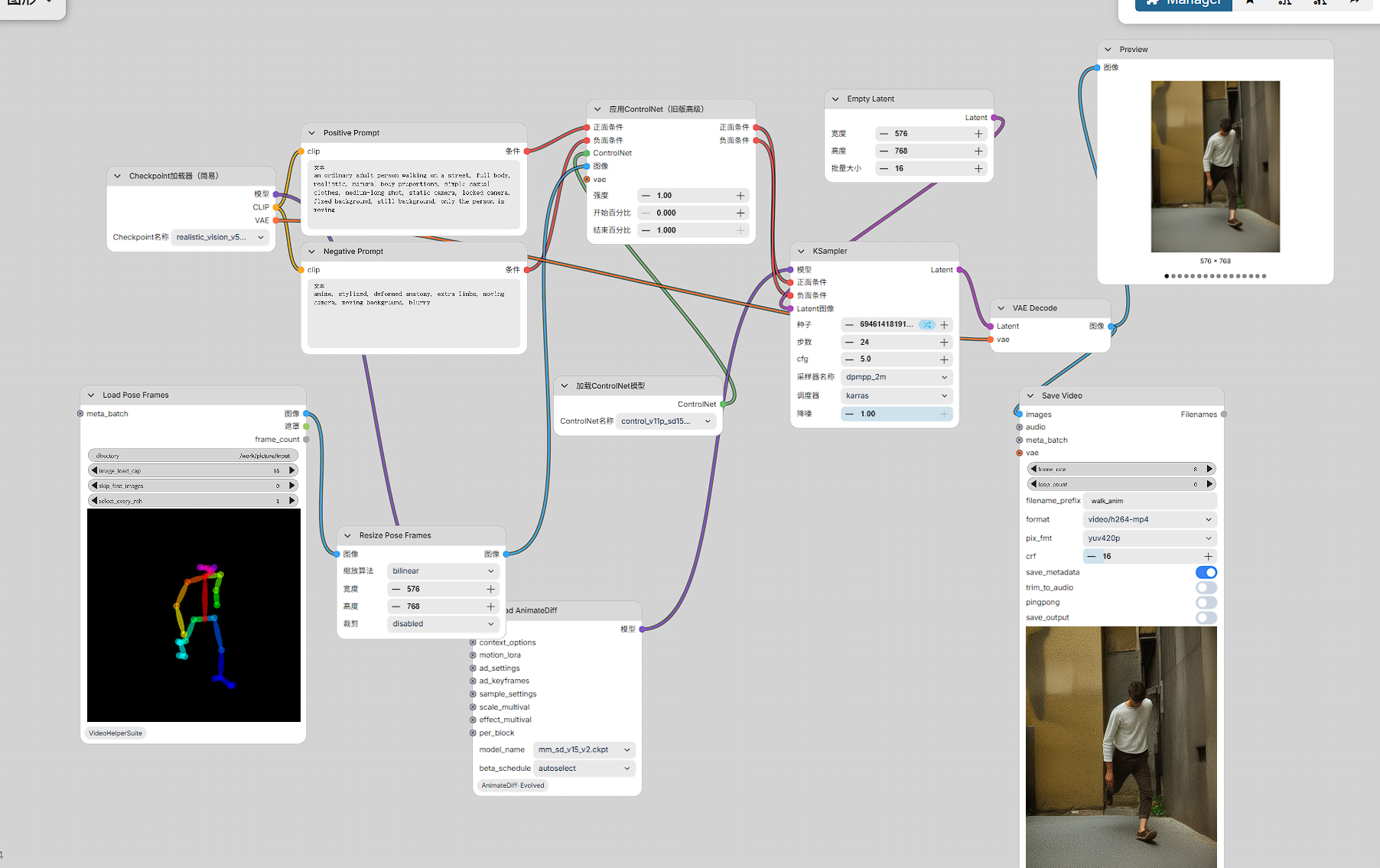

在姿态驱动视频生成任务中,动作控制是否准确,决定了整条生成链路是否具有实际价值。相比人物外观、场景细节和画面风格,动作是否被正确执行更适合作为首要验证目标。本文基于 ComfyUI 搭建了一套 AnimateDiff + ControlNet OpenPose 的 walking 动作验证工作流,通过骨骼序列输入、姿态约束、时序生成和视频输出,验证 walking 动作是否能够被稳定驱动。工作流最终通过 VHS_VideoCombine 输出视频,格式为 video/h264-mp4,帧率为 8,文件名前缀为 walk_anim,像素格式为 yuv420p,CRF 为 16 。本文从动作控制的重要性出发,系统梳理工作流结构、关键参数及参数调整效果,并说明人物准确性不能仅依赖提示词,而需要后续接入额外模型完成更强控制。

关键词: ComfyUI、AnimateDiff、ControlNet、OpenPose、Walking Animation、动作控制、动作验证

效果图

工作流截图

B站视频

https://www.bilibili.com/video/BV1bKovBsEPq/

一、为什么动作控制比画面风格更值得优先验证?

在基于姿态驱动的视频生成任务中,最容易出现的误区之一,就是一开始就同时追求:

- 动作准确

- 人物稳定

- 背景不动

- 画面精致

- 风格统一

- 细节丰富

这样做的问题是,一旦结果不理想,就很难判断问题出在哪里。

例如,一个 walking 视频效果不好,原因可能来自:

- 骨骼序列顺序错误

- ControlNet 约束不足

- AnimateDiff 时序不稳定

- Prompt 干扰过强

- 模型本身自由发挥过多

如果这些因素同时存在,实验结果就无法有效分析。

因此,在姿态驱动任务中,更合理的思路应该是:

先验证动作控制是否准确,再考虑人物一致性和风格优化。

因为只有先确认"动作真的被正确执行",后续所有关于角色、风格和场景的优化才有意义。

二、为什么 walking 动作尤其适合做验证入口?

在所有基础动作中,walking 是一个非常适合作为验证入口的任务,原因主要有三点。

1. 动作目标清晰

walking 本身具有很明确的结构特征,例如:

- 左右腿交替

- 手臂摆动

- 身体重心前移

- 连续行进趋势

这些特征非常适合用来判断动作链路是否正常工作。

2. 结果容易观察

相比复杂打斗动作、跳跃动作或旋转动作,walking 的评价标准更直接:

- 是否像"在走"

- 步态是否连续

- 骨骼变化是否被还原

- 行进节奏是否合理

3. 对工作流问题定位更友好

如果连 walking 都无法稳定跟随骨骼序列,那么问题通常不在"风格",而在更基础的动作控制链路上。

因此,walking 是非常适合用来测试以下问题的:

- 骨骼序列是否被正确读取

- ControlNet 是否有效

- AnimateDiff 是否能把姿态序列组织成连续视频

- 视频输出链路是否完整

三、这套工作流要验证的核心问题是什么?

这套工作流的核心目标很明确:

验证骨骼序列是否能够准确驱动 walking 动作

围绕这个目标,需要重点观察以下几个问题:

- 骨骼序列是否按正确顺序参与生成

- 步态变化是否与输入姿态一致

- 重心移动和四肢摆动是否连续

- AnimateDiff 是否输出了可观察的 walking 视频

- 输出结果是否适合作为动作实验样例

需要特别说明的是,这一阶段的重点是动作准确性验证 ,而不是人物一致性验证。

也就是说,当前工作流首先回答的是:

"这个动作有没有被正确执行?"

而不是:

"这个人是不是始终保持同一个身份和外观?"

四、为什么人物准确性不能主要依赖提示词?

这是很多实战中非常容易混淆的地方。

Prompt 能做什么?

在这个工作流里,提示词主要承担的是基础语义描述,例如:

- 这是一个人

- 这个人在 walking

- 这是全身构图

- 尽量使用静态机位

- 背景尽量稳定

Prompt 不能稳定做什么?

提示词本身并不能强约束:

- 人物身份保持

- 外观连续一致

- 服装稳定

- 角色细节锁定

原因在于,OpenPose 控制的是动作骨架 ,不是人物身份 。

提示词控制的是语义方向 ,不是角色绑定。

因此,如果后续希望进一步提升:

- 人物准确性

- 身份一致性

- 外观稳定性

通常需要接入额外模型,例如:

- 参考图控制模型

- IPAdapter

- 身份保持类模型

- 角色一致性控制方案

所以,本文介绍的工作流更适合定位为:

动作控制验证工作流

而不是完整的人物一致性生成方案。

五、工作流整体结构怎么理解?

整套流程可以拆成五个部分来看。

1. 主模型与文本条件加载

首先加载主模型,并通过 CLIP 编码正向和负向提示词,提供基础生成能力和文本语义约束。

2. 骨骼序列加载与统一尺寸

从文件夹中批量读取 OpenPose 骨骼图,并统一尺寸,例如 512×512,保证后续 ControlNet 输入一致。

3. ControlNet 姿态约束

加载 OpenPose 对应的 ControlNet 模型,并将骨骼图序列作为控制输入。

这一部分决定了人物动作是否能够贴近输入姿态。

4. AnimateDiff 时序生成

将 AnimateDiff 运动模块接入主模型,让生成从单帧扩展为连续帧。

这一部分决定 walking 是否能够形成连贯视频。

5. 解码与视频输出

通过 VAE Decode 将 latent 序列解码为图像,再通过 VHS_VideoCombine 输出为视频。

该工作流中视频输出的关键参数包括:

frame_rate = 8filename_prefix = walk_animformat = video/h264-mp4pix_fmt = yuv420pcrf = 16

这意味着最终输出为标准 H.264 MP4 视频,适合做 walking 动作验证和结果展示 。

六、为什么这套工作流不需要预处理器?

如果输入的是普通人物图像,那么通常需要先经过 OpenPose 预处理,提取出骨架。

但本文工作流输入的已经是骨骼图序列,因此不需要再额外做 OpenPose 预处理。

也就是说,输入素材本身已经具备:

- 关键点信息

- 骨架连线

- 姿态结构

这种情况下,直接将其送入 OpenPose ControlNet 即可。

如果再次加入预处理器,反而可能导致识别重复或结构失真。

七、动作验证阶段,提示词应该如何设计?

既然文章的重点是动作控制验证,那么提示词就应该尽量服务于"观察动作",而不是服务于"堆叠画面效果"。

推荐正向提示词

txt

a person walking, full body, static camera, fixed background这组提示词的优点在于:

a person walking:明确动作语义full body:方便观察完整步态static camera:减少机位运动干扰fixed background:尽量降低背景变化对动作判断的影响

推荐负向提示词

txt

low quality, blurry, bad anatomy, extra limbs, duplicate body, moving camera, moving background这组负向提示词主要用于压制:

- 结构性错误

- 肢体异常

- 背景扰动

- 镜头变化

对于动作验证来说,提示词的原则应该是:

语义足够明确,但不要过度复杂。

因为提示词越复杂,模型自由发挥越多,反而不利于观察骨骼驱动是否准确。

八、关键参数如何调整?调整后会带来什么效果?

动作验证工作流中,有几个参数对结果影响最明显。

1. ControlNet 权重:决定动作贴合度

推荐范围

txt

0.95 ~ 1.0推荐基准值

txt

1.0参数作用

ControlNet 权重决定模型有多大程度遵循骨骼序列。

调整后的效果

- 提高到 1.0:walking 步态更贴近输入骨架,动作验证更清晰

- 降低到 0.7~0.8:模型自由发挥更多,动作可能偏离原始姿态

适用结论

在动作验证阶段,应优先保证姿态约束足够强,因此建议将 ControlNet 权重保持在高位。

2. CFG:决定模型自由发挥程度

推荐范围

txt

4.5 ~ 6推荐基准值

txt

5.0参数作用

CFG 越高,模型越倾向按照文本条件"主动补全画面"。

调整后的效果

- CFG 4.5~5.0:更适合动作验证,背景干扰相对更小,walking 更容易观察

- CFG 7 以上:模型更容易重新诠释画面,动作判断会被风格和环境变化干扰

适用结论

如果目标是验证 walking 动作而非追求画面表现,CFG 建议适当降低。

3. Steps:决定采样充分程度

推荐范围

txt

20 ~ 30推荐基准值

txt

24参数作用

Steps 决定采样迭代次数,对画面稳定性和完成度有影响。

调整后的效果

- 20~24:通常已经足够验证 walking 动作,效率与效果较平衡

- 30 以上:耗时上升,但对动作准确性的提升通常有限

适用结论

在以动作验证为主的实验中,24 左右是比较适合作为基准值的配置。

4. Sampler 与 Scheduler:决定整体采样稳定性

推荐组合

txt

dpmpp_2m + karras参数作用

这组组合在连续帧任务中通常能兼顾:

- 生成效率

- 稳定性

- 连续观察体验

调整后的效果

- 输出结果更适合做 walking 节奏观察

- 帧间表现通常更平滑

- 适合作为姿态驱动实验的默认选择

5. Empty Latent 批量大小:决定总帧数

常用值

txt

16参数作用

批量大小直接决定输出帧数。

调整后的效果

- 16 帧:适合短 walking 片段验证

- 更高帧数:可以拉长演示时间,但生成耗时增加

与时长的关系

由于视频输出节点帧率设置为 8 ,因此:

- 16 帧 / 8 fps = 2 秒

这一长度非常适合用于 walking 动作验证。

九、视频输出参数为什么也值得关注?

虽然动作验证的重点不在视频封装,但输出参数依然决定了结果是否便于观察。

在这套工作流中,视频输出节点 VHS_VideoCombine 的关键配置为:

frame_rate = 8filename_prefix = walk_animformat = video/h264-mp4pix_fmt = yuv420pcrf = 16

这些参数对应的意义是:

frame_rate = 8

每秒播放 8 帧。

对于 16 帧 walking 序列来说,输出约为 2 秒,更适合清晰观察步态节奏 。

format = video/h264-mp4

输出为通用 MP4 格式,适合做实验记录和结果展示 。

pix_fmt = yuv420p

兼容性较好,便于在常见播放器中直接预览 。

crf = 16

压缩质量较高,适合观察 walking 动作细节 。

十、动作验证阶段应该如何判断结果是否有效?

在这类实验中,不应先问"画面美不美",而应先问"动作准不准"。

可以重点观察的指标包括

- 左右腿是否形成明确交替

- 手臂摆动是否与步态同步

- 重心变化是否连贯

- walking 趋势是否稳定

- 整体动作是否与输入骨骼顺序一致

如果这些特征已经能够稳定观察到,就说明这条姿态驱动链路是有效的。

十一、为什么要把"动作验证"和"人物控制"拆开处理?

这是整篇文章最重要的结论之一。

如果动作链路还没有被验证,就直接开始处理:

- 人物身份一致性

- 外观锁定

- 角色稳定

- 精细化质感

那么问题会被混在一起,实验结论也不清晰。

更合理的顺序是:

第一步:先验证动作

确认 OpenPose + ControlNet + AnimateDiff 这条链路本身能否正确执行 walking。

第二步:再增强人物控制

在动作已经成立的基础上,再接入额外模型处理:

- 角色一致性

- 参考图约束

- 身份保持

- 外观稳定

这样每一步的目标都更明确,优化方向也更清楚。

十二、推荐基准配置

为了更稳定地完成 walking 动作验证,可以采用如下配置作为基准:

- 分辨率:512 × 512

- 批量大小:16

- ControlNet weight:1.0

- Steps:24

- CFG:5.0

- Sampler:

dpmpp_2m - Scheduler:

karras - Denoise:1.0

- 输出帧率:8

在这组参数下,通常可以较稳定地观察:

- 骨骼输入是否被执行

- walking 节奏是否清晰

- 动作序列是否连续

- 视频输出是否适合作为实验记录

十三、总结

在姿态驱动视频生成任务中,动作控制的准确性应当优先于画面风格和人物细节。

对于 walking 这类基础动作,最重要的不是一开始就追求人物一致性,而是先验证:

- 骨骼序列是否被正确读取

- ControlNet 是否真正发挥了姿态约束作用

- AnimateDiff 是否生成了连续 walking 动作

- 视频输出是否能够清晰展示步态结果

本文整理的这套工作流,正是围绕这个目标建立的。

其视频输出通过 VHS_VideoCombine 完成,配置中可见输出格式为 video/h264-mp4,帧率为 8,文件名前缀为 walk_anim,像素格式为 yuv420p,CRF 为 16 。

需要强调的是,这套工作流主要解决的是动作验证问题 。

对于更进一步的人物准确性、身份保持和外观一致性,不能主要依赖提示词,而需要接入额外模型来完成更强的人物控制。