参考:https://modelscope.cn/models/deepseek-ai/DeepSeek-V4-Pro/file/view/master/config.json?status=1

一、基础模型标识

"architectures": ["DeepseekV4ForCausalLM"],

"model_type": "deepseek_v4",

"transformers_version": "4.57.1",-

architectures:模型类名,因果语言模型(自回归生成,如续写、对话)

-

model_type:模型官方类型 = DeepSeek V4

-

transformers_version:兼容的 HuggingFace 库版本

二、词表与特殊令牌

"vocab_size": 129280,

"bos_token_id": 0,

"eos_token_id": 1,

"tie_word_embeddings": false,-

vocab_size:词表大小 129280

-

bos/eos_token_id:开始/结束令牌ID

-

tie_word_embeddings:不共享输入/输出词嵌入矩阵(大模型常用,提升效果)

三、模型尺寸(超大规模)

"hidden_size": 7168, # 隐藏层维度

"num_hidden_layers": 61, # 总网络层数

"num_attention_heads": 128, # 注意力头数

"head_dim": 512, # 每个注意力头维度

"max_position_embeddings": 1048576, # 最大上下文长度 = 1048576✅ 核心结论:

-

上下文窗口:1048576 tokens(100K+)

-

超大参数量 + 超长上下文,属于顶尖开源大模型

四、MoE 稀疏专家架构(最核心特性)

DeepSeek V4 是稀疏混合专家模型(MoE),不是稠密模型:

"n_routed_experts": 384, # 总专家数:384个

"n_shared_experts":1, # 共享专家数:1个

"num_experts_per_tok":6, # 每个token 激活6个专家

"moe_intermediate_size":3072, # 专家中间层维度

"routed_scaling_factor":2.5, # 路由激活缩放因子

"norm_topk_prob":true, # 归一化TopK概率

"topk_method":"noaux_tc", # 专家路由算法✅ 通俗解释:

-

模型有 384 个专家网络 ,但每个 token 只调用 6 个

-

推理/训练算力成本远低于同等参数量稠密模型,性能更强

-

业界顶尖的 MoE 设计

五、注意力机制配置

"attention_bias": false,

"attention_dropout": 0.0,

"num_key_value_heads": 1, # GQA 分组查询注意力

"qk_rope_head_dim": 64,

"sliding_window": 128, # 滑动窗口注意力

"use_cache": true, # 推理缓存KV,加速生成-

GQA:1个KV头共享给128个Q头,大幅节省显存

-

sliding_window:局部窗口注意力,优化长文本效率

-

use_cache:开启推理缓存,生成速度更快

六、激活函数与归一化

"hidden_act": "silu",

"rms_norm_eps": 1e-06,

"swiglu_limit": 10.0,-

激活函数:SiLU + SwiGLU(大模型标配)

-

归一化:RMSNorm(LLaMA 系列标准)

七、超长上下文扩展(YaRN)

"rope_theta": 10000,

"rope_scaling":{

"type":"yarn",

"factor":16,

"original_max_position_embeddings":65536,

"beta_fast":32,

"beta_slow":1

}-

位置编码:RoPE + YaRN

-

把上下文从 65536 扩展到 1048576(16倍)

-

业界最先进的长上下文无损扩展技术

八、FP8 量化(显存优化)

"torch_dtype": "bfloat16",

"quantization_config":{

"quant_method":"fp8",

"activation_scheme":"dynamic",

"fmt":"e4m3",

"scale_fmt":"ue8m0",

"weight_block_size":[128,128]

}✅ 关键作用:

-

训练/推理精度:BF16 + FP8

-

显存减少 50%,速度提升,精度几乎无损

-

工业级部署标配

九、LoRA 低秩适配(微调)

"q_lora_rank": 1536,

"o_lora_rank": 1024,

"o_groups": 16,-

支持超大秩 LoRA 微调

-

适合企业/科研做高质量领域微调

十、哈希检索与索引增强(DeepSeek 自研技术)

"hc_eps": 1e-06,

"hc_mult":4,

"hc_sinkhorn_iters":20,

"index_head_dim":128,

"index_n_heads":64,

"index_topk":1024,

"num_hash_layers":3,

"scoring_func":"sqrtsoftplus",这是 DeepSeek 自研的检索增强架构:

-

用哈希检索加速长文本、知识库召回

-

提升长文本理解、事实准确性

-

属于模型核心黑科技

十一、压缩率配置(上下文压缩)

"compress_rope_theta": 160000,

"compress_ratios": [...]-

对不同层使用不同压缩率

-

进一步降低超长上下文的显存/算力消耗

整体总结

这是DeepSeek V4 超大规模稀疏 MoE 大模型的完整配置:

-

384 个专家,每 token 激活 6 个

-

1048576 超长上下文

(YaRN 扩展)

-

FP8 量化 + GQA 注意力

,高效部署

-

支持 LoRA 微调 + 哈希检索增强

-

属于当前开源顶尖的长文本大模型

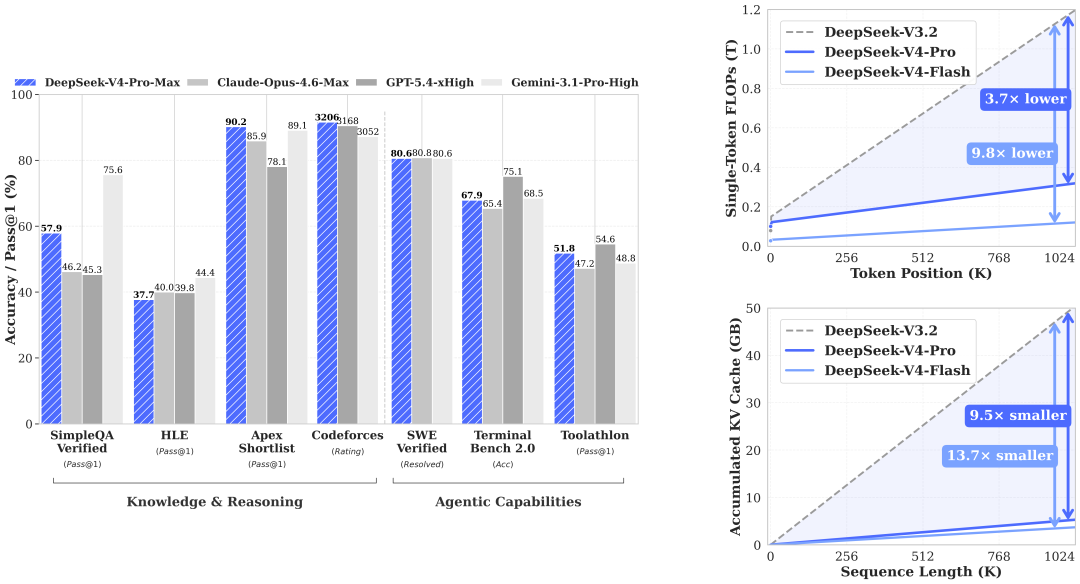

附(flash与pro对比):

| 分类 | 参数项 | 小参数量:DeepSeek-V4-Flash | 大参数量:DeepSeek-V4-Pro | 差异说明 |

|---|---|---|---|---|

| 🏷️ 模型基础 | 模型架构 | DeepseekV4ForCausalLM | DeepseekV4ForCausalLM | 完全一致 |

| hidden_size(隐层维度) | 4096 | 7168 | Pro 容量大幅提升 | |

| num_hidden_layers(总层数) | 43 层 | 61 层 | Pro 更深、学习能力更强 | |

| 🧠 注意力机制 | num_attention_heads(注意力头) | 64 | 128 | Pro 翻倍,细粒度理解更强 |

| head_dim(单头维度) | 512 | 512 | 相同 | |

| num_key_value_heads(KV头) | 1 | 1 | 相同(GQA架构) | |

| sliding_window(滑动窗口) | 128 | 128 | 相同 | |

| 🎯 MoE 混合专家 | n_routed_experts(总专家数) | 256 | 384 | Pro 专家数量多50% |

| n_shared_experts(共享专家) | 1 | 1 | 相同 | |

| num_experts_per_tok(每token激活专家) | 6 | 6 | 相同(稀疏计算) | |

| moe_intermediate_size(专家中间层) | 2048 | 3072 | Pro 单个专家能力更强 | |

| routed_scaling_factor | 1.5 | 2.5 | Pro 适配更大专家规模 | |

| 🔍 哈希检索增强 | index_topk(检索数量) | 512 | 1024 | Pro 长文本匹配更精准 |

| num_hash_layers(哈希层数) | 3 | 3 | 相同 | |

| 🛠️ LoRA 微调 | q_lora_rank | 1024 | 1536 | Pro 微调表达能力更强 |

| o_lora_rank | 1024 | 1024 | 相同 | |

| o_groups | 8 | 16 | Pro 分组更细 | |

| 📜 超长上下文 | max_position_embeddings | 1048576(104万) | 1048576(104万) | 均支持百万上下文 |

| rope_scaling(位置扩展) | YaRN ×16 | YaRN ×16 | 相同 | |

| compress_ratios(压缩策略) | 浅层0压缩,中间4/128 | 首层128倍压缩,全程压缩 | Pro 压缩更强、推理更快 | |

| ⚡ 部署优化 | quantization_config | FP8 动态量化 | FP8 动态量化 | 相同 |

| torch_dtype | bfloat16 | bfloat16 | 相同 | |

| 🔤 词表 | vocab_size | 129280 | 129280 | 完全一致 |