环形缓冲区(Ring Buffer / Circular Buffer)详解:原理、优势、应用与高性能实现

文章目录

- [环形缓冲区(Ring Buffer / Circular Buffer)详解:原理、优势、应用与高性能实现](#环形缓冲区(Ring Buffer / Circular Buffer)详解:原理、优势、应用与高性能实现)

-

- 摘要

- 一、引言

- 二、核心概念与数据结构

-

- [2.1 逻辑模型](#2.1 逻辑模型)

- [2.2 基本结构要素](#2.2 基本结构要素)

- [2.3 核心操作](#2.3 核心操作)

- [2.4 判满的两种主流策略](#2.4 判满的两种主流策略)

- 三、为什么要使用环形缓冲区?

-

- [3.1 避免动态内存分配](#3.1 避免动态内存分配)

- [3.2 极高的缓存友好性](#3.2 极高的缓存友好性)

- [3.3 无需数据搬移](#3.3 无需数据搬移)

- [3.4 天然支持批量和DMA](#3.4 天然支持批量和DMA)

- [3.5 简化并发:SPSC无锁实现](#3.5 简化并发:SPSC无锁实现)

- 四、批量读写的跨边界处理

-

- [4.1 问题的本质](#4.1 问题的本质)

- [4.2 批量读取实现示例](#4.2 批量读取实现示例)

- [4.3 DMA与Scatter-Gather](#4.3 DMA与Scatter-Gather)

- 五、高级主题

-

- [5.1 SPSC无锁环形缓冲区](#5.1 SPSC无锁环形缓冲区)

- [5.2 扩展到MPSC/MPMC](#5.2 扩展到MPSC/MPMC)

- [5.3 缓存行对齐与伪共享](#5.3 缓存行对齐与伪共享)

- [5.4 缓冲区大小选择与位运算优化](#5.4 缓冲区大小选择与位运算优化)

- 六、环形缓冲区在DPDK中的实践

-

- [6.1 DPDK简介](#6.1 DPDK简介)

- [6.2 DPDK的无锁环形队列 `rte_ring`](#6.2 DPDK的无锁环形队列

rte_ring) - [6.3 在DPDK数据通路中的作用](#6.3 在DPDK数据通路中的作用)

- [6.4 性能数据](#6.4 性能数据)

- 七、工程建议与常见陷阱

-

- [7.1 选择合适的判满策略](#7.1 选择合适的判满策略)

- [7.2 注意数据撕裂(Tearing)](#7.2 注意数据撕裂(Tearing))

- [7.3 正确使用内存屏障](#7.3 正确使用内存屏障)

- [7.4 避免"空"与"满"的歧义](#7.4 避免“空”与“满”的歧义)

- [7.5 调试技巧](#7.5 调试技巧)

- 八、总结与展望

- 参考文献

摘要

环形缓冲区(Ring Buffer / Circular Buffer)是计算机系统中最经典也最高效的FIFO数据结构之一。它通过固定大小的连续内存和取模寻址,实现了无需动态内存分配、确定性O(1)时间复杂度的数据传递。本文从底层原理出发,系统性地分析环形缓冲区的数据结构、操作逻辑、设计权衡,并深入探讨其在无锁并发、批量DMA传输以及DPDK等高性能框架中的工程实践。文章旨在为嵌入式开发、网络协议栈、实时系统以及高性能计算领域的工程师提供一份全面的参考。

一、引言

在软件系统中,数据生产者和消费者之间往往存在速度不匹配、突发流量或时序抖动。队列(Queue)是解决这一问题的经典抽象。然而,动态链表队列的内存管理开销、缓存不友好特性在很多场景下成为性能瓶颈。环形缓冲区作为一种特殊的固定大小队列,通过循环复用 一块连续内存,完美平衡了确定性 、效率 和资源占用。

从UART驱动到Linux内核kfifo,从音频缓冲区到LMAX Disruptor,环形缓冲区无处不在。理解其精妙的设计,是构建高性能、低延迟系统的关键一步。

二、核心概念与数据结构

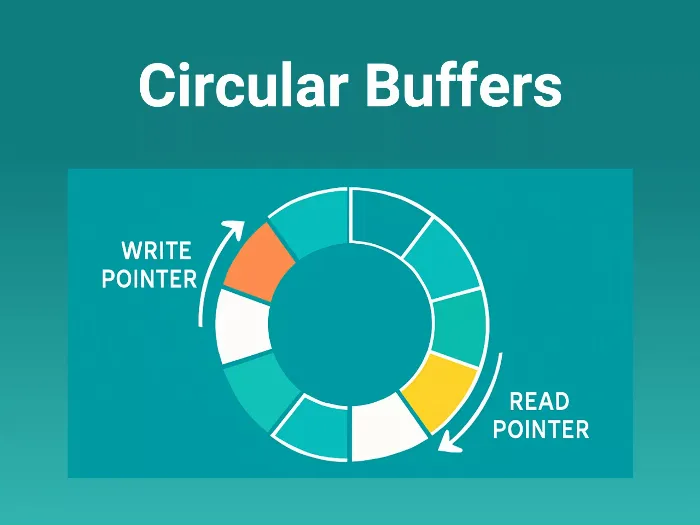

2.1 逻辑模型

环形缓冲区在逻辑上是一个首尾相接的圆环。物理上,它是一段连续的线性内存(通常为数组),通过读指针(head/read) 和写指针(tail/write) 来标识数据位置。当指针到达缓冲区末尾时,会通过取模运算"回绕"到开头。

物理内存视图(数组索引):

[0] [1] [2] [3] [4] [5] [6] [7]

^ ^

| |

read write当写入第8个元素时,write从7变成0,形成环形。

2.2 基本结构要素

一个典型的环形缓冲区包含以下成员:

buffer:指向连续内存的指针(如uint8_t *buffer)。size:缓冲区总长度(单位:字节或元素个数)。read:下一个可读取位置的索引。write:下一个可写入位置的索引。count(可选):当前缓冲区中有效元素个数。

2.3 核心操作

| 操作 | 描述 | 时间复杂度 |

|---|---|---|

| 初始化 | read = write = 0(若使用计数器则count=0) |

O(1) |

| 写入 | buffer[write] = data; write = (write+1) % size |

O(1) |

| 读取 | data = buffer[read]; read = (read+1) % size |

O(1) |

| 判空 | read == write(或count == 0) |

O(1) |

| 判满 | 见下文 | O(1) |

2.4 判满的两种主流策略

| 策略 | 实现方式 | 最大容量 | 优点 | 缺点 |

|---|---|---|---|---|

| 保留一个空位 | (write+1) % size == read |

size-1 |

无需额外变量,简单 | 浪费一个元素位 |

| 显式计数器 | count == size |

size |

完全利用空间 | 需原子维护计数器(多线程) |

在实际工程中,如果缓冲区大小本身较大(例如4096),浪费一个元素通常可以接受;若需要精确容量或易用性,则选择计数器方式。

三、为什么要使用环形缓冲区?

3.1 避免动态内存分配

链表队列每次入队都需要malloc,出队需要free。在实时系统或高频交易中,内存分配的不确定性和内存碎片是不可接受的。环形缓冲区在创建时一次性申请内存,整个生命周期内不再分配/释放,做到确定性延迟。

3.2 极高的缓存友好性

环形缓冲区的数据存储在连续内存中(除了逻辑上的回绕分割),遍历时能充分利用CPU的硬件预取(prefetch)和缓存行(cache line)。相比之下,链表节点在堆上分散分布,每个节点访问都可能触发缓存缺失。

3.3 无需数据搬移

对于一个线性数组实现的队列(例如用memmove模拟),每出队一次可能需要将剩余元素整体前移,复杂度O(n)。环形缓冲区通过指针移动实现FIFO,完全避免了内存搬移。

3.4 天然支持批量和DMA

由于底层内存连续,可以批量复制连续元素块(使用memcpy或DMA)。即使读写跨越缓冲区末尾,也仅需拆分为两次操作,整体效率远高于逐元素处理。

DMA 的全称是 Direct Memory Access(直接存储器访问)

3.5 简化并发:SPSC无锁实现

当只有一个生产者和一个消费者(SPSC,Single Producer, Single Consumer)时,环形缓冲区可以做到完全无锁。生产者只修改write,消费者只修改read,两者没有数据竞争。配合恰当的内存屏障,就能实现线程安全的零锁队列,性能远超基于互斥锁的实现。

SPSC的全称是 Single Producer, Single Consumer(单生产者单消费者)

四、批量读写的跨边界处理

4.1 问题的本质

虽然缓冲区本身是一段连续内存,但逻辑上待读/写的连续数据块可能跨越物理数组的末尾 。例如:read=14,缓冲区大小size=16,需要读取5个字节。此时连续逻辑块实际上是:buffer[14]、buffer[15](第一段),以及buffer[0]、buffer[1]、buffer[2](第二段)。memcpy要求源地址连续,因此必须分两次复制。

4.2 批量读取实现示例

c

/**

* 从环形缓冲区中批量读取数据到目标内存区域。

* @param rb 环形缓冲区结构体指针

* @param dst 目标缓冲区指针,必须至少有 len 字节的有效空间

* @param len 期望读取的最大字节数

* @return 实际读取的字节数(不超过 len,且不超过缓冲区中可读数据量)

*/

size_t ring_read_batch(RingBuffer *rb, uint8_t *dst, size_t len) {

// 1. 获取缓冲区中当前可读的字节数(由 ring_available 实现)

size_t avail = ring_available(rb);

// 2. 限制读取长度:不能超过可用数据量,若无可读数据则直接返回 0

if (len > avail) len = avail;

if (len == 0) return 0;

// 3. 计算从当前读指针到缓冲区末尾的连续字节数(即不绕回时一次能读的最大长度)

// rb->read 是下一次读取的位置,范围 [0, rb->size-1]

// rb->size - rb->read 即为剩余尾部长度

size_t first = min(len, rb->size - rb->read);

// 4. 复制第一段数据(从 rb->read 到缓冲区末尾,或 len 个字节,取较小值)

memcpy(dst, rb->buffer + rb->read, first);

// 5. 如果 len 大于第一段长度,说明需要绕回到缓冲区开头继续读取剩余数据

if (len > first) {

// 复制第二段数据:从缓冲区头部开始的 (len - first) 个字节

memcpy(dst + first, rb->buffer, len - first);

}

// 6. 更新读指针:向前移动 len 个位置,使用取模运算实现环形回绕

// 这样下次读取将从新的位置开始

rb->read = (rb->read + len) % rb->size;

// 7. 返回实际读取的字节数(此时 len 已被截断为 avail,必然 ≤ 原始请求长度)

return len;

}批量写入实现对称。

4.3 DMA与Scatter-Gather

对于DMA传输,如果硬件支持分散-收集(Scatter-Gather) 描述符,可以一次性描述两个不连续的物理片段,从而避免中断拆分。否则,驱动仍需发起两次DMA或一次DMA加一次CPU拷贝。环形缓冲区的这一特性在网络驱动(如DPDK PMD)中至关重要。

五、高级主题

5.1 SPSC无锁环形缓冲区

条件:一个生产者线程,一个消费者线程,且二者访问的指针没有重叠。

设计要点:

- 使用内存屏障保证写操作对消费者可见。

- 禁止编译器和CPU重排序。

- 不使用互斥锁、信号量或原子CAS(仅需原子读写指针本身)。

C11原子实现骨架:

c

// 无锁单生产者单消费者(SPSC)环形缓冲区结构体

// 适用于一个线程写入、另一个线程读取的场景,无需互斥锁(但仍需保证生产者和消费者各自只有一个线程)

struct spsc_ring {

uint8_t *buf; // 数据存储区的起始地址(需由用户分配和管理)

size_t size; // 缓冲区总大小(元素个数),必须大于 0

_Atomic size_t read; // 消费者读取位置索引(原子操作,消费者更新,生产者只读)

_Atomic size_t write; // 生产者写入位置索引(原子操作,生产者更新,消费者只读)

};

/**

* 生产者向环形缓冲区中压入一个字节的数据

* @param r spsc_ring 结构体指针

* @param data 要写入的字节数据

* @return 成功写入返回 true;缓冲区已满则返回 false(数据未写入)

*

* 注:此函数只能由单一生产者线程调用,但可与消费者线程并发执行。

* 缓冲区满的判断利用了"留空一个元素"的方法:当 (write+1) % size == read 时视为满。

* 这样空状态的条件是 write == read,不需要额外标志。

*/

bool spsc_push(struct spsc_ring *r, uint8_t data) {

// 1. 原子加载当前写指针(其他线程可能同时修改?不,只有本生产者线程修改写指针,

// 但消费者可能同时读该值,所以必须用原子操作保证可见性)

size_t w = atomic_load(&r->write);

// 2. 计算下一个写指针位置(环形前进一位)

size_t next = (w + 1) % r->size;

// 3. 检查缓冲区是否已满

// 如果下一个写位置等于当前读指针,说明缓冲区中所有可用元素都被占用了

// (因为读指针指向消费者下一次将读的位置,写指针不能追赶上读指针)

if (next == atomic_load(&r->read)) {

return false; // 已满,放弃写入

}

// 4. 缓冲区未满,将数据写入当前写指针指向的位置

r->buf[w] = data;

// 5. 原子更新写指针为 next(这一步必须放在写入数据之后,否则消费者可能读到未完全写入的数据)

atomic_store(&r->write, next);

return true;

}消费者逻辑类似。实际工程中还需要插入atomic_thread_fence(memory_order_release/acquire)来保证正确顺序。

5.2 扩展到MPSC/MPMC

- MPSC(多生产者单消费者) :需要保护生产者对

write指针的并发修改(通常使用CAS自旋或互斥锁)。 - MPMC(多生产者多消费者) :需要同时保护

read和write,常见实现有:- 细粒度锁 + 批量预留。

- Disruptor的环形屏障(Ring Barrier)序列号方案。

- 无锁算法如

rte_ring(DPDK)使用CAS和加载-链接/存储-条件(LL/SC)实现公平出队/入队。

5.3 缓存行对齐与伪共享

在多核系统中,如果read和write两个变量落在同一个缓存行(通常64字节),不同核心各自的修改会导致缓存行在不同核心间"颠簸"(cache line bouncing),严重降低性能。解决方法是将两个指针分别对齐到不同缓存行:

c

struct alignas(64) ring {

size_t read;

char pad[64 - sizeof(size_t)];

size_t write;

};5.4 缓冲区大小选择与位运算优化

将size设为2的幂(如512、4096),则取模运算x % size可优化为位与运算x & (size-1),极大地提升了操作速度。这也是DPDK、Linux内核kfifo等项目的通用约定。

六、环形缓冲区在DPDK中的实践

6.1 DPDK简介

DPDK(Data Plane Development Kit,数据平面开发套件)是一组用户态库和驱动,用于在通用CPU上实现高性能网络数据包处理。它通过内核旁路、轮询模式驱动(PMD)、大页内存等机制,彻底消除了Linux内核协议栈的瓶颈,达到线速转发(如100Gbps)。

6.2 DPDK的无锁环形队列 rte_ring

DPDK提供了librte_ring,实现了一个多生产者、多消费者的无锁环形队列。其设计特点包括:

- 支持批量入队/出队(一次操作多个指针)。

- 使用CAS原子操作实现无锁并发。

- 固定容量(创建时指定),元素为指针(通常指向

rte_mbuf数据包缓冲)。 - 可通过

rte_ring_enqueue_bulk/dequeue_bulk批量处理,提升吞吐量。

6.3 在DPDK数据通路中的作用

- 内存池管理 :

rte_mempool基于rte_ring管理预分配的数据包缓冲区,避免运行时分配。 - 核间通信 :不同CPU核心通过

rte_ring传递数据包指针,实现无锁流水线处理。 - 配置与统计 :控制平面通过

rte_ring向数据平面下发配置消息。

6.4 性能数据

在典型x86服务器上,rte_ring的单个入队/出队操作仅需数十纳秒,批量模式效率更高。这直接支撑了DPDK每秒数千万包的转发能力。

七、工程建议与常见陷阱

7.1 选择合适的判满策略

- 如果缓冲区大小远大于单次最大突发长度,可以采用"保留一个空位"简化逻辑。

- 若需精确容量或方便调试,使用计数器方式,注意计数器在多线程下的原子性。

7.2 注意数据撕裂(Tearing)

如果元素类型大于CPU的原子访问宽度(例如64位CPU上64位类型是原子的,但结构体不是),多线程无保护地读写同一位置会导致读取到部分旧数据/部分新数据。解决方法:

- 使用原子类型(

stdatomic.h)或显式互斥。 - 确保生产者和消费者访问的位置永远不同(对于SPSC环形缓冲区,每个槽位同一时刻最多只有一个角色访问,因此天然安全)。

7.3 正确使用内存屏障

在SPSC无锁实现中,生产者需要确保数据写入内存后才更新write指针;消费者需要先读取write指针(判断有新数据),再读取数据。缺少屏障可能导致消费者看到新指针却读到旧数据(CPU/编译器重排序)。C11中可使用atomic_thread_fence(memory_order_release/acquire)或直接用带内存序的原子操作。

7.4 避免"空"与"满"的歧义

使用计数器方式时,read == write表示空,count == size表示满,清晰无歧义。使用"保留空位"方式时,read == write依然表示空,而满由(write+1) % size == read表示,不需要额外变量。

7.5 调试技巧

- 在环形缓冲区结构中加入

magic字段和检查函数,检测指针越界或覆盖。 - 使用

assert验证操作前后指针有效范围。

八、总结与展望

环形缓冲区是计算机系统中"小而美"的数据结构代表。它基于固定大小连续内存,通过循环指针和取模运算实现了高效的FIFO队列,消除了动态内存分配和元素搬移的开销。在SPSC场景下,它可以轻松实现无锁并发,达到纳秒级延迟;通过批量操作和对齐优化,又能充分发挥硬件能力。

从嵌入式UART驱动到DPDK这种百G级网络框架,环形缓冲区始终是构建高性能数据通路的基石。理解其设计哲学和工程细节,不仅能帮助开发者写出更高效的代码,也能为设计更复杂的无锁并发数据结构提供启示。

未来,随着持久内存、智能网卡和异构计算的普及,环形缓冲区的变体(如持久化环形日志、跨主机环形缓冲)将会出现,但其核心思想------循环复用、确定性操作、无锁并发------仍将熠熠生辉。

参考文献

- DPDK官方文档:

librte_ring设计说明 - Linux内核源码:

include/linux/kfifo.h - LMAX Disruptor论文:Disruptor: High Performance Alternative to Bounded Queues for Exchanging Data Between Concurrent Threads

- C11标准原子操作与内存模型

- 《深入理解并行编程》------ Paul E. McKenney