最近在完成从仿真训练到实机部署的全流程落地中,踩过了无数行业共性的坑:算法团队在 Isaac Sim 里训出 100% 成功率的策略,只丢过来一个 PyTorch 的.pth权重文件,到了实机端要么框架不兼容、要么推理帧率不达标,甚至因为前后处理逻辑没对齐,实机直接抖成筛子;很多时候仿真和实机的效果鸿沟,根本不是策略本身的问题,而是训练端和部署端之间,缺少一个标准化的交付载体。

而ONNX,就是打通 Sim2Sim 到 Sim2Real 全链路的核心桥梁。

这篇文章依然会完整覆盖从 Sim2Sim 准入标准到 Sim2Real 实机落地的全流程,但会以 ONNX 为核心抓手,讲透它在仿真到实机迁移中的定位、交付标准、对接实操,以及高频踩坑解决方案,所有内容均来自工业级落地的实操经验,代码可直接复现。

一、先厘清认知:Sim2Sim 不是 "换仿真跑一遍",是 Sim2Real 的准入门槛

很多新手开发者会问:我已经在主仿真环境里训好策略了,为什么还要做 Sim2Sim?直接上实机不行吗?

这里先给一个工业界落地的铁律:跳过 Sim2Sim 直接上实机,本质是拿昂贵的硬件当免费的仿真测试平台,你省下来的 1 周仿真时间,会在实机调试里以 10 倍的成本补回来。

Sim2Sim 的核心价值,是在零实机成本、零硬件风险的前提下,提前过滤过拟合策略、对齐软硬件接口、标定模型鲁棒性边界,把 80% 的实机踩坑工作,提前在仿真环境中解决。而最终所有的验证成果,都需要通过一个标准化的载体交付给 Sim2Real 端,这个载体,就是我们后面要重点讲的 ONNX 模型。

什么样的 Sim2Sim 结果,才算合格可上实机?

只有满足以下 4 个核心条件的策略,才算通过了 Sim2Sim 验证,具备进入 Sim2Real 环节的资格:

- 跨仿真泛化性达标:策略在跨引擎 / 跨保真度仿真环境中(如 PyBullet→Isaac Sim、低精度刚体仿真→高保真接触仿真),核心任务指标(成功率、轨迹跟踪精度、稳定性等)下降幅度控制在 15% 以内,无震荡、失控等灾难性失效。

- 软硬件接口 1:1 对齐:彻底剔除仿真特权信息(如仿真独有的全局质心坐标、真实接触力等真实传感器无法获取的内部状态),观测 - 动作空间的维度、采样频率、限幅范围,与真实硬件规范完全匹配。

- 鲁棒性边界完成标定:通过参数扫描与随机化测试,验证策略在真实硬件的合理参数波动范围(摩擦系数、质量惯性、电机阻尼、通信延迟等)内均可稳定运行,明确了参数的安全上下限。

- 部署兼容性验证完成:完成模型的格式转换、轻量化验证,在目标边缘硬件的仿真算力环境中,推理帧率、端到端延迟满足实时控制要求(机器人本体控制通常要求≥100Hz)。

二、开发者视角:Sim2Sim 的核心交付物,是以 ONNX 为核心的工程化文件包

很多团队的协作矛盾,都源于交付物的不规范:Sim2Sim 的算法同学只丢一个.pth权重文件过来,Sim2Real 的嵌入式同学根本无法直接使用,只能反复拉扯、返工。

工业级落地场景下,Sim2Sim 端必须交付一套完整的工程化文件包,而ONNX 模型是整个交付包的核心。

其他所有文件都是为了保障 ONNX 模型能在实机上正确、稳定运行。完整交付清单如下:

表格

| 文件类型 | 典型格式 | 核心作用与交付要求 |

|---|---|---|

| 核心策略模型 | .onnx(必选)+ .pth(可选校验用) |

核心交付物,必须提供.onnx通用格式,它是跨平台部署的唯一标准载体;配套原生.pth文件仅用于精度校验,不做部署使用。 |

| 接口配置文件 | .yaml/.json |

ONNX 模型的 "接口说明书",明确定义模型输入输出规范、预处理 / 后处理参数(如归一化均值 / 方差)、控制频率,要求 Sim2Sim 与 Sim2Real 端必须 1:1 对齐。 |

| 机器人模型文件 | .urdf/.sdf/.usd |

经过系统辨识的机器人数字孪生模型,用于 Sim2Real 端校验硬件参数,保障模型输入的物理意义与仿真一致。 |

| 验证基线文件 | .csv/.md |

包含 ONNX 模型的标准测试输入、预期输出、性能基线,用于 Sim2Real 端做模型一致性校验,确保模型转换无精度损失。 |

| 部署代码示例 | .py/.cpp |

ONNX 模型的最小化推理示例,包含完整的加载、预处理、推理、后处理流程,避免 Sim2Real 端重复造轮子。 |

为什么 Sim2Sim 交付的核心必须是 ONNX,而不是原生框架权重?

这里简单讲透它的核心价值,也是我们踩过无数坑后总结的经验:

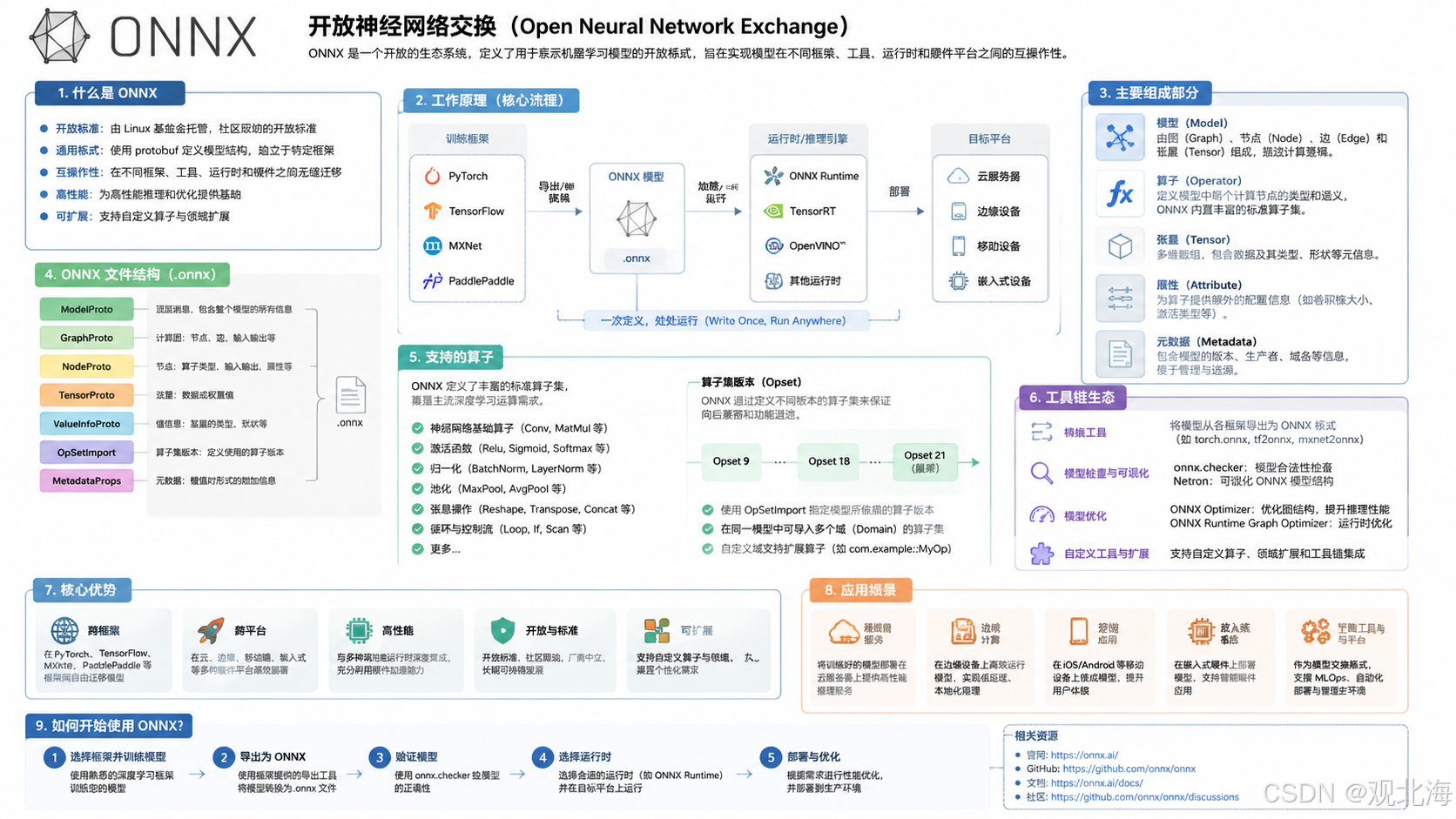

- 跨框架兼容:不管你是用 PyTorch、TensorFlow 还是 JAX 训练的模型,都能导出为统一的 ONNX 格式,Sim2Real 端不用关心训练框架,彻底解决环境兼容问题。

- 硬件无关性:ONNX 模型可以在 X86 工控机、ARM 架构的 Jetson、甚至单片机上部署,适配 CPU、GPU、NPU 等几乎所有推理硬件,完美匹配机器人边缘部署的多样化需求。

- 推理优化友好:主流的推理加速引擎(TensorRT、ONNX Runtime、OpenVINO)都原生支持 ONNX 格式,一行命令就能完成模型量化、加速,轻松满足实机实时控制的帧率要求。

- 可校验、可追溯:ONNX 模型的结构、输入输出规范完全透明,用 Netron 工具就能一键查看,Sim2Sim 和 Sim2Real 端的职责边界清晰,避免了 "模型跑不起来是谁的问题" 的拉扯。

三、核心实操:拿到 ONNX 模型,Sim2Real 端怎么零踩坑对接?

这一部分是整篇文章的核心,我们会围绕机器人 Sim2Real 的落地场景,讲透 ONNX 模型的对接全流程,所有操作都可直接复现。

3.1 先搞懂:对接 ONNX,你只需要知道这些

对于 Sim2Real 端的开发者,你不需要深入了解 ONNX 的底层算子定义、协议规范,只需要搞懂 3 个核心知识点,就能完成 99% 的部署工作:

- ONNX 本质是一个标准化的计算图:它用二进制格式完整存储了模型的网络结构、权重参数,定义了数据从输入到输出的完整流动路径,你可以把它理解成一个 "黑盒函数",给定符合规范的输入,就能输出对应的控制指令。

- 对接的核心是对齐输入输出规范:你必须 100% 匹配 ONNX 模型要求的输入维度、数据类型、预处理逻辑,差一个参数都会导致推理结果错误,这是 90% 的实机部署坑的根源。

- 必备工具:Netron :这是一个免费的 ONNX 可视化工具,有在线网页版,不用安装,直接上传 ONNX 文件就能查看模型的输入输出名称、维度、数据类型,以及完整的网络结构,是对接 ONNX 的必备工具。

在写任何部署代码之前,必须先用 Netron 打开 ONNX 文件,确认以下 4 个核心信息,缺一不可:

- 输入张量的名称 (如

obs/input.1) - 输入张量的维度与数据类型 (如

float32[1, 12],代表 batch_size=1,12 维观测值) - 输出张量的名称 (如

action/output.1) - 输出张量的维度与数据类型 (如

float32[1, 6],代表 batch_size=1,6 个电机的控制指令)

3.2 从零开始的 ONNX 对接全流程(附 ROS2 完整代码)

以下实操基于机器人开发最常用的 ROS2 框架,适配 Python/C++ 环境,所有代码均可直接复制复用。我们以最常见的机器人关节控制场景为例:ONNX 模型输入为 12 维关节观测(6 个关节的位置 + 速度),输出为 6 维电机目标角度。

第一步:环境准备

我们优先使用 ONNX Runtime 作为推理引擎,它轻量、跨平台、兼容性强,是工业级部署的首选:

bash

# Python CPU版(通用工控机/虚拟机环境)

pip install onnxruntime==1.17.0

# Python GPU版(Jetson/带NVIDIA显卡的边缘设备)

pip install onnxruntime-gpu==1.17.0第二步:最小推理示例(先验证模型正确性)

先通过极简代码验证模型可正常推理,确保输入输出逻辑正确,这一步必须在对接 ROS2、上实机之前完成:

python

import onnxruntime as ort

import numpy as np

# 1. 加载ONNX模型,创建推理会话

session = ort.InferenceSession("robot_policy.onnx")

# 2. 获取输入输出名称(也可从Netron中直接查看硬编码,稳定性更高)

input_name = session.get_inputs()[0].name

output_name = session.get_outputs()[0].name

# 3. 准备输入数据(严格匹配ONNX的维度、数据类型要求)

# 重点注意:必须补充batch维度,比如ONNX要求[1,12],就不能传入[12]的一维数组

test_obs = np.random.randn(1, 12).astype(np.float32)

# 4. 执行推理,获取控制指令

action = session.run([output_name], {input_name: test_obs})[0]

# 5. 输出验证结果

print(f"模型输入维度: {test_obs.shape}")

print(f"模型输出结果: {action[0]}")第三步:ROS2 端集成(对接真实硬件的闭环节点)

把推理逻辑封装成标准 ROS2 节点,实现 "传感器数据订阅→预处理→模型推理→控制指令下发" 的全闭环,这就是 Sim2Real 实机部署的核心代码:

python

import rclpy

from rclpy.node import Node

from sensor_msgs.msg import JointState

from std_msgs.msg import Float64MultiArray

import onnxruntime as ort

import numpy as np

class Sim2RealPolicyNode(Node):

def __init__(self):

super().__init__('sim2real_policy_node')

# 1. 初始化ONNX推理会话

self.session = ort.InferenceSession("robot_policy.onnx")

self.input_name = self.session.get_inputs()[0].name

self.output_name = self.session.get_outputs()[0].name

# 2. 配置ROS2订阅与发布

# 订阅真实机器人的关节状态话题(传感器输入)

self.joint_sub = self.create_subscription(

JointState, '/joint_states', self.joint_state_callback, 10

)

# 发布电机控制指令话题(对接真实执行器)

self.cmd_pub = self.create_publisher(

Float64MultiArray, '/motor_target_cmds', 10

)

self.get_logger().info("Sim2Real策略节点已启动,ONNX模型加载完成")

def joint_state_callback(self, msg: JointState):

# 3. 传感器数据预处理:必须和Sim2Sim训练时的逻辑1:1对齐

# 示例:拼接关节位置与速度,组成12维观测向量

obs = np.array(msg.position + msg.velocity, dtype=np.float32)

# 补充batch维度,严格匹配ONNX输入要求

obs = np.expand_dims(obs, axis=0)

# 4. ONNX模型推理,获取控制指令

action = self.session.run([self.output_name], {self.input_name: obs})[0]

# 5. 封装并发布控制指令

cmd_msg = Float64MultiArray()

cmd_msg.data = action[0].tolist()

self.cmd_pub.publish(cmd_msg)

def main(args=None):

rclpy.init(args=args)

node = Sim2RealPolicyNode()

rclpy.spin(node)

node.destroy_node()

rclpy.shutdown()

if __name__ == '__main__':

main()四、Sim2Real 实机部署的黄金法则:以 ONNX 校验为起点,渐进式测试

很多开发者拿到模型,直接全闭环上实机,结果要么炸机损坏硬件,要么策略失控抖成筛子。这里必须强调:实机部署绝对不能跳步,必须以 ONNX 模型一致性校验为起点,严格遵循渐进式测试流程,把安全放在第一位。

完整的实机测试分为 5 个步骤,前一步不通过,绝对不能进入下一步:

- **ONNX 模型一致性校验(第 0 步,必做)**用 Sim2Sim 端提供的标准测试输入,分别运行原生 PyTorch 模型和 ONNX 模型,对比两者的输出误差必须小于 1e-5,确保模型转换过程没有出现精度损失,先保证模型本身的正确性。

- 开环动作复现不加载闭环策略,直接把仿真中的标准动作序列下发给真实硬件,对比仿真与实机的动作轨迹,修正执行器模型偏差,确保开环轨迹偏差控制在 5% 以内,验证硬件执行层的准确性。

- 半闭环安全测试加载完整 ONNX 策略,但严格限制动作幅度、力矩上限与运行速度(比如仅启用 30% 的额定功率),在低动态场景下验证策略的基础稳定性,全程启用硬件急停、软件限位与虚拟墙,避免硬件风险。

- 全闭环零样本测试无异常后,逐步放开约束,运行完整策略,测试核心任务性能,对比 Sim2Sim 提供的性能基线,记录仿真与实机的性能差距,精准定位 "现实鸿沟" 的根因。

- 全场景鲁棒性验证在不同光照、不同环境工况、不同干扰条件下重复测试,验证策略的泛化性,确保在所有预期工作场景中稳定运行。

五、高频踩坑指南:ONNX 对接 Sim2Real 的 90% 问题都在这里

表格

| 常见问题 | 核心原因 | 标准解决方案 |

|---|---|---|

| ONNX 模型推理报错,提示输入维度不匹配 | 忘记补充 batch 维度,比如 ONNX 要求[1,12],却传入了[12]的一维数组 |

用np.expand_dims(obs, axis=0)显式补充 batch 维度,严格匹配输入 shape |

| 推理能正常运行,但输出结果全是乱值 | 输入数据类型不匹配,比如 ONNX 要求float32,却传入了 numpy 默认的float64 |

预处理时显式转换数据类型:obs = obs.astype(np.float32) |

| ONNX 推理结果和 PyTorch 原模型不一致 | 90% 的情况是预处理 / 后处理逻辑未对齐,比如归一化的均值、方差参数不一致 | 直接复制 Sim2Sim 端的预处理代码,不做任何自行修改,确保前后处理逻辑 1:1 对齐 |

| 边缘端推理帧率不足,无法满足实时控制要求 | 用了原生 PyTorch 推理,未做模型加速优化 | 将 ONNX 模型转换为 TensorRT 格式做 GPU 加速,配合模型量化,可提升 5-10 倍推理帧率 |

| 实机运行时策略震荡、失控,性能远低于仿真 | 策略过拟合训练仿真环境,或是物理参数、延迟特性未对齐 | 先回到仿真环境,基于实机参数更新数字孪生模型,扩大域随机化范围重新优化 ONNX 模型,不要直接在实机上微调 |

六、最后给开发者的几点落地建议

- 永远把 ONNX 作为 Sim2Sim 到 Sim2Real 的核心交付标准。原生框架的权重文件只适合训练迭代,ONNX 才是跨平台、跨团队协作的工业级标准,能大幅降低沟通成本和部署踩坑概率。

- Sim2Real 端对接 ONNX,核心是对齐,不是修改。不要随意修改模型的输入输出规范、前后处理逻辑,你的核心工作是把真实硬件的传感器数据,转换成模型要求的输入格式,再把模型输出映射到真实执行器。

- 永远不要跳过 ONNX 一致性校验直接上实机。模型转换的精度损失、前后处理的逻辑偏差,都能在这一步提前发现,避免实机硬件损坏的风险。

- 现实鸿沟的解决,优先靠仿真迭代优化 ONNX 模型,而非实机微调。实机在线训练不仅有硬件风险,数据采集效率也远低于仿真,把实机采集的数据反馈到仿真环境,优化数字孪生模型与策略,重新导出 ONNX 模型,才是可持续的落地飞轮。