RHOS Lab提出 Robot-Human-Object-Scene 四元范式 请详细解释

RHOS(Robot-Human-Object-Scene)四元范式是RHOS Lab提出的具身智能核心研究框架,旨在将机器人研究从"单一本体控制"升级为"多主体交互系统"。以下是基于ViFailback、HAKE及共享控制等系列研究的完整解析:

一、四元要素定义

| 要素 | 英文全称 | 核心内涵 | 在已有研究中的体现 |

|---|---|---|---|

| R | Robot(机器人) | 具身执行主体,不仅是机械臂/人形机器人本体,更包含其策略模型(VLA/VLM) | ViFailback-8B作为外部监督器,诊断并纠正机器人失败 |

| H | Human(人类) | 不仅是遥操作者,更是交互对象、协作伙伴、示范教师、干预源 | HAKE库解析人体部位状态;Shared Autonomy中人机共享控制权 |

| O | Object(物体) | 被操作的物理实体,及其可变形、可组合、状态可变的特性 | ViFailback数据集中的100个任务(抽屉、碗、锅、马克笔等) |

| S | Scene(场景) | 承载交互的物理与语义环境,包含空间关系、功能区域、动态约束 | 厨房桌面、抽屉柜、灶台等环境;基准测试中的多场景分布 |

二、四元交互关系(非简单叠加)

RHOS范式的核心在于:这四个要素不是独立存在的,而是形成6组动态交互关系:

Robot ↔ Human(人机协作/共享控制)

/ \

/ \

Robot ↔ Object(操作学习) Human ↔ Object(人-物交互理解)

\ /

\ /

Object ↔ Scene(物体-环境嵌入)

|

Robot ↔ Scene(导航/定位/上下文感知)

|

Human ↔ Scene(人-环境语义理解)在已有研究中的具体映射:

| 交互对 | 对应研究/技术 | 说明 |

|---|---|---|

| Robot ↔ Object | ViFailback失败诊断 | 机器人抓取方块放入碗中失败 → 诊断"6D姿态偏差" |

| Robot ↔ Human | Shared Autonomy | 人类操作员戴VR,与AI智能体共享控制灵巧手,γ参数调节控制权 |

| Human ↔ Object | HAKE Part State | 人类手部"握持/按压/拧转"等31种部位状态,为机器人提供示范语义 |

| Robot ↔ Scene | 视觉符号中的空间推理 | 机器人识别"抽屉在桌面上""碗在柜子里"的空间约束 |

| Object ↔ Scene | 物体状态与场景耦合 | 锅在灶台上(可加热)、食材在砧板上(可切割)------功能 affordance |

| Human ↔ Scene | 人体-场景交互 | 人坐在摇椅上(HAKE图示)、人站在灶台前(烹饪场景) |

三、范式层级:从感知到认知

RHOS Lab的研究呈现从底层感知到高层认知的递进:

┌─────────────────────────────────────────┐

│ 第四层:认知推理(Cognitive Reasoning) │

│ • 失败原因分析(ViFailback高级指导) │

│ • 任务规划错误诊断(Task Planning) │

│ • 人类意图预测(Intention) │

├─────────────────────────────────────────┤

│ 第三层:交互语义(Interaction Semantics) │

│ • HAKE部位状态库(手-物交互语义) │

│ • 视觉符号(箭头/十字准线/回退图标) │

│ • 共享控制动作混合(a^h + a^s → 混合动作) │

├─────────────────────────────────────────┤

│ 第二层:空间-动力学(Spatial-Dynamics) │

│ • 6D姿态估计与纠正 │

│ • 物体平移/旋转/抓取(红绿蓝箭头) │

│ • 场景中的关键帧定位 │

├─────────────────────────────────────────┤

│ 第一层:像素感知(Pixel Perception) │

│ • 头部/腕部摄像头观测 │

│ • AlphaPose人体骨架检测 │

│ • 物体检测与分割 │

└─────────────────────────────────────────┘四、为什么"四元"而非传统的"三元"?

传统机器人学通常关注 Robot-Object-Environment(任务空间) 三元组。RHOS Lab强调加入 Human 作为独立第四元,基于以下洞察:

1. 人类不再是"干扰项",而是"信息源"

- 传统:Human intervention(人工干预)被视为失败类型之一(ViFailback中的第四类失败)

- RHOS范式:人类是老师------通过HAKE解析人的动作部位状态,通过Shared Autonomy采集人的操作数据

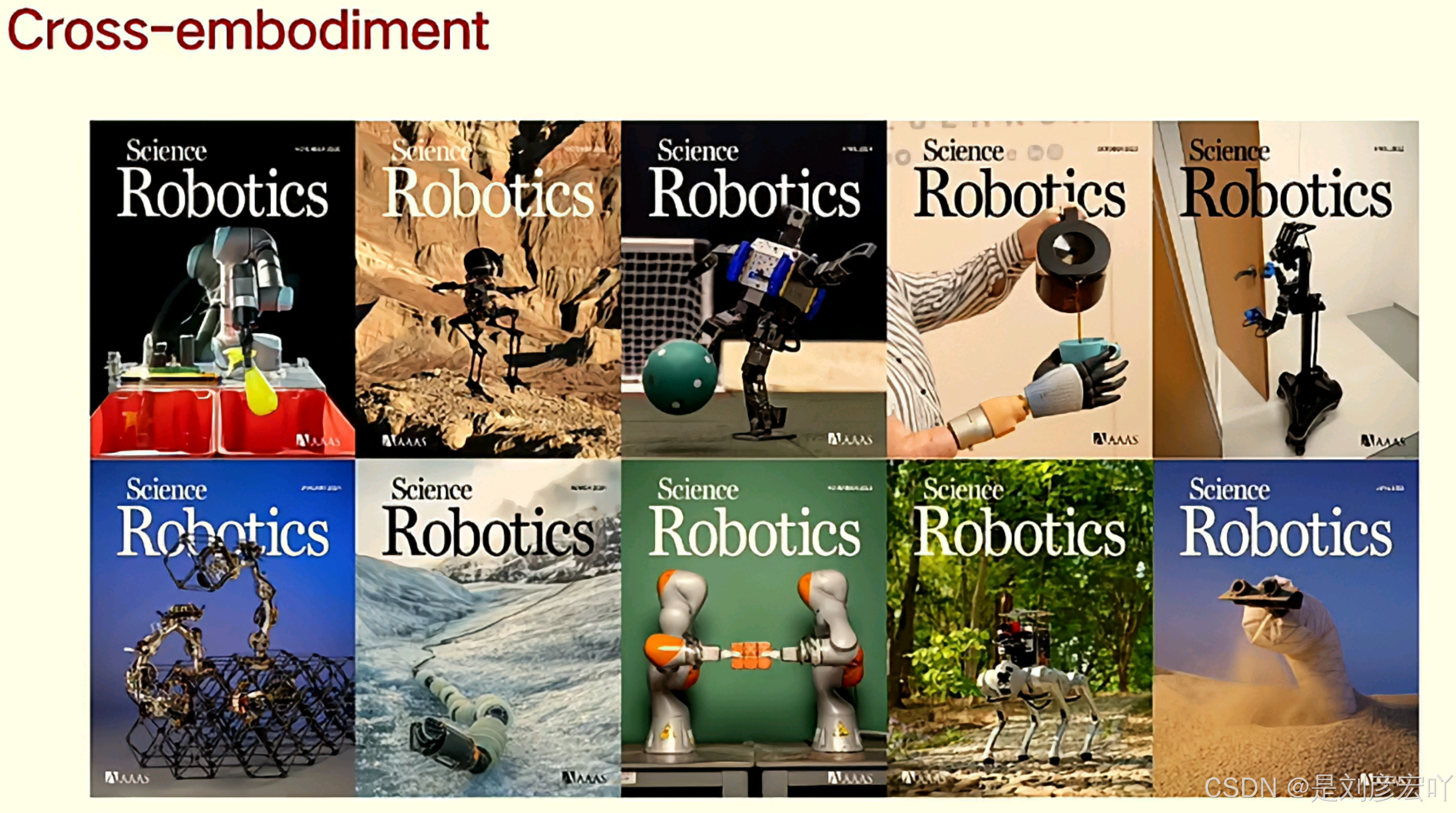

2. 跨具身迁移需要"人类桥梁"

- 不同机器人(机械臂/四足/人形)的本体差异极大

- 人类动作(H) 可以作为跨本体的通用参考系------无论机器人是什么形态,最终都是模仿/协助/替代人类完成任务

3. 真实世界是不确定的,人类是"活的标准"

- Scene中的物体位置可能变、光照可能变

- Human可以作为实时校准源(Shared Autonomy中γ=0.3时,动作严格对齐人类意图)

五、在烹饪场景中的四元映射(商业落地视角)

将RHOS范式映射到您讨论的烹饪机器人场景:

| 要素 | 烹饪场景具象化 | 数据/技术需求 |

|---|---|---|

| Robot | 双臂机械臂/移动复合机器人 | 力控、温控、防溅油轨迹、夹爪状态 |

| Human | 厨师(示范者)、服务员(协作者)、顾客(需求方) | HAKE式手部动作采集、VR遥操作示教 |

| Object | 锅、铲、食材(面团/蔬菜/肉)、调料盒、碗盘 | 物体状态变化(生→熟、硬→软)、可变形体建模 |

| Scene | 灶台区、备料区、出餐区、水槽、储物空间 | 空间布局约束(锅必须在灶上)、温度场、油烟环境 |

四元交互的烹饪实例:

场景:机器人炒菜时油温过高导致食材糊底

Robot(机械臂)↔ Object(锅/食材):翻炒力度不足,食材粘锅

↓

Scene(厨房)→ 温度传感器报警:油温210℃超过阈值

↓

Human(厨师)通过VR遥操作介入:Shared Autonomy模式,γ=0.3

↓

Robot接收人类纠正意图 + ViFailback式诊断:

• 失败类型:Task Planning(未及时调节火力)

• 纠正指令:降低加热功率 + 加快翻炒频率

• 视觉符号:在锅上方显示"红色向下箭头"(降温)+ "绿色旋转箭头"(加速翻炒)六、RHOS范式的战略价值

| 维度 | 价值 |

|---|---|

| 学术 | 统一了"人体理解(HAKE)""失败诊断(ViFailback)""人机协作(Shared Autonomy)"三条研究线 |

| 数据 | 四元交互数据比单纯"机器人轨迹"更值钱------包含人类示范、物体状态、场景上下文 |

| 商业 | 为烹饪/服务/工业场景提供了完整的需求分析框架------缺了哪一元,系统就会失败 |

| 跨域 | 厨房场景训练的四元模型,可迁移至养老护理(Human为老人)、工业装配(Object为零件) |

一句话总结

RHOS四元范式的本质是:机器人不是孤立执行任务的工具,而是嵌入在"人类-物体-场景"构成的动态社会物理系统中的智能体。ViFailback解决"机器人做错了什么",HAKE解决"人类是怎么做的",Shared Autonomy解决"人和机器人如何配合做"------三者合起来,才是完整的具身智能。

RHOS Lab 在具身智能领域的三大支柱方向

这三条研究线是 RHOS Lab 在具身智能领域的三大支柱方向,分别回答"人怎么做""机器人错在哪""人和机器人怎么配合"三个核心问题。以下是详细拆解:

第一条线:人体理解(HAKE)

核心问题:人类在物理世界中是如何与物体交互的?

| 维度 | 内容 |

|---|---|

| 全称 | Human Action understanding via Knowledge of body Elements(或通过部位状态理解人类动作) |

| 代表作 | HAKE: Part State Library(部位状态库) |

| 核心发现 | 人类动作不是笼统的"动词标签"(如pick/place),而是由身体部位的状态变化构成的 |

| 技术路径 | 从视频中检测人体骨架(AlphaPose)→ 提取手部/手臂/躯干的细粒度部位状态(如"拇指与食指捏合""手腕旋转45°")→ 建立可计算的动作语义库 |

HAKE的关键创新

- 31种手部状态 + 多种手臂/躯干状态

- 每个状态对应真实的物理交互(如"Pinch"捏取 vs "Grasp"抓握 vs "Squeeze"挤压)

- 为机器人提供了"人类示范的解剖级标准答案"

对烹饪场景的意义:机器人学炒菜,首先要看懂厨师的手是怎么"颠勺""勾芡""捏饺子褶"的------HAKE把这些动作拆解为可复制的部位状态序列。

第二条线:失败诊断(ViFailback)

核心问题:机器人操作失败时,到底错在哪?怎么纠正?

| 维度 | 内容 |

|---|---|

| 全称 | Visual Failure diagnosis and feedback(视觉失败诊断与反馈) |

| 代表作 | ViFailback: Diagnose, Correct, and Learn from Manipulation Failures via Visual Symbols |

| 核心发现 | 失败数据是宝藏,但文字描述失败是低效的;用"视觉符号"(箭头、十字准线、旋转标记)可以结构化地诊断和纠正失败 |

| 技术路径 | 采集真实失败轨迹 → 人类标注者绘制视觉符号 → VLM自动生成诊断VQA → 微调出ViFailback-8B模型 → 实时生成纠正指令 |

ViFailback的关键创新

- 7种视觉符号:彩色直箭头(红绿蓝对应XYZ三轴)、半圆箭头(旋转)、双十字准线(对齐)、ON/OFF(夹爪状态)、禁止图标(停止)、回退图标(复位)

- 11类VQA任务:从失败检测、关键帧定位、子任务定位、类型识别、原因分析到低级/高级纠正指导

- 真实世界验证:集成到VLA模型后,任务成功率平均提升 22.2%

对烹饪场景的意义:机器人炒糊了菜,ViFailback能诊断是"油温过高(Task Planning失败)"还是"翻炒力度不够(Gripper 6D-pose失败)",并生成"降低火力+加快颠勺"的纠正指令。

第三条线:人机协作(Shared Autonomy)

核心问题:人类和机器人如何共享控制权,实现"1+1>2"?

| 维度 | 内容 |

|---|---|

| 全称 | Shared Autonomy / Shared Control(共享自主/共享控制) |

| 代表作 | ICRA'25 Best Paper on HRI(人机交互最佳论文) |

| 核心发现 | 10%专家数据 + 90%非专家数据 通过扩散策略(Diffusion Policy)训练,能在相似数据ROI下实现数据采集速度翻倍 |

| 技术路径 | 人类操作员(戴VR/遥操作)+ AI智能体同时输出动作 → 通过参数γ混合两者动作(γ=0.3重人类意图,γ=1.0完全自主)→ 数据存入数据库 → 训练出更优策略 |

Shared Autonomy的关键创新

- 前向/反向过程:人类动作与智能体动作不是简单叠加,而是通过概率模型融合

- γ(Gamma)控制比:连续调节人机控制权,而非"要么人控要么机控"的二元切换

- 数据效率:非专家也能贡献高质量训练数据,大幅降低遥操作门槛

对烹饪场景的意义:厨师通过VR教机器人炒菜时,不是完全手把手教(低效),也不是完全让机器人自己试(易失败),而是人机共享控制------厨师把握大方向(火候节奏),AI处理精细动作(防溅油轨迹),同时采集数据用于后续自主学习。

三条线如何被RHOS四元范式统一?

┌─────────────────────────────────────────────────────────┐

│ RHOS 四元范式 │

│ Robot - Human - Object - Scene │

├─────────────────────────────────────────────────────────┤

│ HAKE(人体理解) │

│ • 回答:Human 怎么与 Object 交互? │

│ • 对应关系:Human ↔ Object(部位状态-物体功能) │

├─────────────────────────────────────────────────────────┤

│ ViFailback(失败诊断) │

│ • 回答:Robot 怎么在 Scene 中正确操作 Object? │

│ • 对应关系:Robot ↔ Object/Scene(失败-纠正闭环) │

├─────────────────────────────────────────────────────────┤

│ Shared Autonomy(人机协作) │

│ • 回答:Human 和 Robot 如何共享控制完成 Object 任务? │

│ • 对应关系:Robot ↔ Human(动作融合与数据共生) │

└─────────────────────────────────────────────────────────┘统一后的完整闭环

| 阶段 | 哪条线起作用 | 四元交互 |

|---|---|---|

| 数据采集 | Shared Autonomy | Human通过VR遥操作Robot,在Scene中操作Object,数据实时入库 |

| 动作理解 | HAKE | 解析Human操作Object时的部位状态,建立"人类标准示范" |

| 失败处理 | ViFailback | Robot独立操作Object失败时,诊断原因并纠正,必要时请求Human介入 |

| 持续进化 | 三线融合 | 失败数据回流,Human通过Shared Autonomy示范纠正,HAKE解析新技能,ViFailback更新诊断模型 |

一句话总结

HAKE让机器人"看懂人类示范",ViFailback让机器人"知道自己错在哪并改正",Shared Autonomy让机器人"与人类高效配合并持续学习"------三条线分别对应RHOS范式中的 Human→Object、Robot→Scene/Object、Robot↔Human 三组核心交互关系,合起来构成了完整的具身智能闭环。