模型调好了怎么给老板看?用这玩意儿5分钟出Demo,连前端都不用学:Gradio 6全栈实战指南

对了,分享一个我最近常看的AI人工智能学习渠道,讲得挺有章法的,不端着也不故弄玄虚。不感兴趣划走就行,感兴趣的可以自己去验证一下。

文章目录

- [模型调好了怎么给老板看?用这玩意儿5分钟出Demo,连前端都不用学:Gradio 6全栈实战指南](#模型调好了怎么给老板看?用这玩意儿5分钟出Demo,连前端都不用学:Gradio 6全栈实战指南)

-

- 一、开篇:四个真实翻车现场,你中招了吗?

-

- [场景一:Demo 展示之痛 ------ 模型调好了,怎么给老板看](#场景一:Demo 展示之痛 —— 模型调好了,怎么给老板看)

- [场景二:前端鸿沟之痛 ------ Python 是家,HTML/CSS/JS 是远方](#场景二:前端鸿沟之痛 —— Python 是家,HTML/CSS/JS 是远方)

- [场景三:Streamlit 翻车之痛 ------ 数据看板能做了,但我的模型需要语音上传功能](#场景三:Streamlit 翻车之痛 —— 数据看板能做了,但我的模型需要语音上传功能)

- [场景四:部署分享之痛 ------ Demo 跑在本地 localhost,隔壁组的同事根本访问不到](#场景四:部署分享之痛 —— Demo 跑在本地 localhost,隔壁组的同事根本访问不到)

- 核心矛盾

- 二、一句话抓住核心

- [三、是什么 ------ 极简概念与原理](#三、是什么 —— 极简概念与原理)

-

- [3.1 核心定义:给 Python 函数穿上 Web 的"自动裁缝铺"](#3.1 核心定义:给 Python 函数穿上 Web 的“自动裁缝铺”)

- [3.2 三大核心抽象层级](#3.2 三大核心抽象层级)

- [3.3 底层运作机制](#3.3 底层运作机制)

- [3.4 组件生态系统:30+ 原生 AI 组件](#3.4 组件生态系统:30+ 原生 AI 组件)

- [3.5 2026 年最新架构升级:Gradio 6](#3.5 2026 年最新架构升级:Gradio 6)

- [四、为什么用 ------ 核心优势与对比](#四、为什么用 —— 核心优势与对比)

-

- [4.1 Gradio vs Streamlit ------ 最关键的选型决策](#4.1 Gradio vs Streamlit —— 最关键的选型决策)

- [4.2 Gradio vs FastAPI/Flask ------ 传统 Web 框架对比](#4.2 Gradio vs FastAPI/Flask —— 传统 Web 框架对比)

- [4.3 Gradio 的核心价值总结](#4.3 Gradio 的核心价值总结)

- [4.4 2026 年生态成熟度](#4.4 2026 年生态成熟度)

- [五、怎么用 ------ 保姆级基础教学](#五、怎么用 —— 保姆级基础教学)

-

- [5.1 环境搭建](#5.1 环境搭建)

- [5.2 从"Hello World"到"AI 应用"的完整演进](#5.2 从“Hello World”到“AI 应用”的完整演进)

- [5.3 Blocks 核心架构实战 ------ 构建一个复杂 AI 助手界面](#5.3 Blocks 核心架构实战 —— 构建一个复杂 AI 助手界面)

- [5.4 gr.State 状态管理实战 ------ 实现多轮会话记忆](#5.4 gr.State 状态管理实战 —— 实现多轮会话记忆)

- [5.5 流式输出实战 ------ 将 LLM 推理能力接入到前端展示](#5.5 流式输出实战 —— 将 LLM 推理能力接入到前端展示)

- [5.6 企业级发布和部署实战](#5.6 企业级发布和部署实战)

- 六、常用场景列举

-

- [场景一:AI 模型演示与可视化](#场景一:AI 模型演示与可视化)

- [场景二:内部 AI 工具平台搭建](#场景二:内部 AI 工具平台搭建)

- [场景三:AI 产品 MVP 快速验证](#场景三:AI 产品 MVP 快速验证)

- 场景四:模型对比与评估工具

- 场景五:多智能体系统交互界面

- [场景六:企业知识库问答与 RAG 前端](#场景六:企业知识库问答与 RAG 前端)

- 七、企业级实战指导

-

- [7.1 Gradio 在 AI 产品开发中的定位](#7.1 Gradio 在 AI 产品开发中的定位)

- [7.2 生产环境部署全攻略](#7.2 生产环境部署全攻略)

- [7.3 生产环境高性能配置](#7.3 生产环境高性能配置)

- [7.4 生产环境避坑指南](#7.4 生产环境避坑指南)

- [7.5 企业级鉴权实战](#7.5 企业级鉴权实战)

- [7.6 2026 年前沿趋势与未来展望](#7.6 2026 年前沿趋势与未来展望)

- 八、面试官高频八连问

-

- [Q1:Gradio 和 Streamlit 各有什么优缺点?在实际工作中你应该如何选择?](#Q1:Gradio 和 Streamlit 各有什么优缺点?在实际工作中你应该如何选择?)

- [Q2:Gradio 中的 Interface 和 Blocks 架构有什么区别?](#Q2:Gradio 中的 Interface 和 Blocks 架构有什么区别?)

- Q3:如果要实现多轮对话,并让机器人记住上下文,核心代码应该怎么写?

- [Q4:Gradio 应用要部署到生产环境,有哪些主流方案?各自的成本和安全考量是什么?](#Q4:Gradio 应用要部署到生产环境,有哪些主流方案?各自的成本和安全考量是什么?)

- [Q5:Gradio 应用在高并发场景下性能很差,你是怎么解决的?](#Q5:Gradio 应用在高并发场景下性能很差,你是怎么解决的?)

- [Q6:你在实际工作中用 Gradio 做过哪些事情?有没有遇到过比较棘手的性能问题和布局样式问题?](#Q6:你在实际工作中用 Gradio 做过哪些事情?有没有遇到过比较棘手的性能问题和布局样式问题?)

- [Q7:怎样对 Gradio 应用进行鉴权,确保只有授权用户才能访问?](#Q7:怎样对 Gradio 应用进行鉴权,确保只有授权用户才能访问?)

- [Q8:Gradio 6 相比 Gradio 5 有哪些核心升级?MCP 集成意味着什么?](#Q8:Gradio 6 相比 Gradio 5 有哪些核心升级?MCP 集成意味着什么?)

- 九、总结与展望

一、开篇:四个真实翻车现场,你中招了吗?

场景一:Demo 展示之痛 ------ 模型调好了,怎么给老板看

你在 Jupyter Notebook 里把模型训到了 SOTA,算法指标非常漂亮。产品经理过来拍你肩膀说"让我试一下",你尴尬地指了指 VSCode 终端:"要不......你过来先看看代码跑通后的几张曲线图?"

界面没有,交互没有,老板只能看静态图片,根本无法理解你的模型到底有多强。

场景二:前端鸿沟之痛 ------ Python 是家,HTML/CSS/JS 是远方

你精通 Transformer 架构和反向传播,但让你写个带输入框和上传按钮的网页,你盯着 HTML/CSS/JS 三件套直接崩溃。花一周时间先学前端才能做个 Demo,等你学完了前端,你的模型已经过时了。

场景三:Streamlit 翻车之痛 ------ 数据看板能做了,但我的模型需要语音上传功能

你尝试用 Streamlit 搭建了个 Demo,表格和折线图展示得很好,老板也满意。可下一秒需求来了------"能让用户传张图片做实时风格迁移吗?""能让用户录一段语音做情感分析吗?"你翻了翻 Streamlit 的文档,才发现它对图像、音频、视频等非文本模态的支持并不原生顺滑,每次都要引入各种第三方包打补丁。

场景四:部署分享之痛 ------ Demo 跑在本地 localhost,隔壁组的同事根本访问不到

你终于折腾出一个带前端界面的 Demo,跑在 localhost:7860 上。同事过来说"链接发我",你只能回答"你先配个 VPN 连到我开发机上"。远程演示、内网穿透、服务器部署,每一步都是算法工程师的噩梦。

核心矛盾

AI 领域 90% 的突破发生在 Python 生态和深度学习世界里,但 90% 的非技术决策者只认看得见、摸得着的交互界面。Jupyter Notebook 和命令行跑出来的结果,永远比不上一个能打开浏览器、拖拽上传文件、马上看到反馈的 Demo 更有说服力。Gradio 正是用来填平这道天堑的。

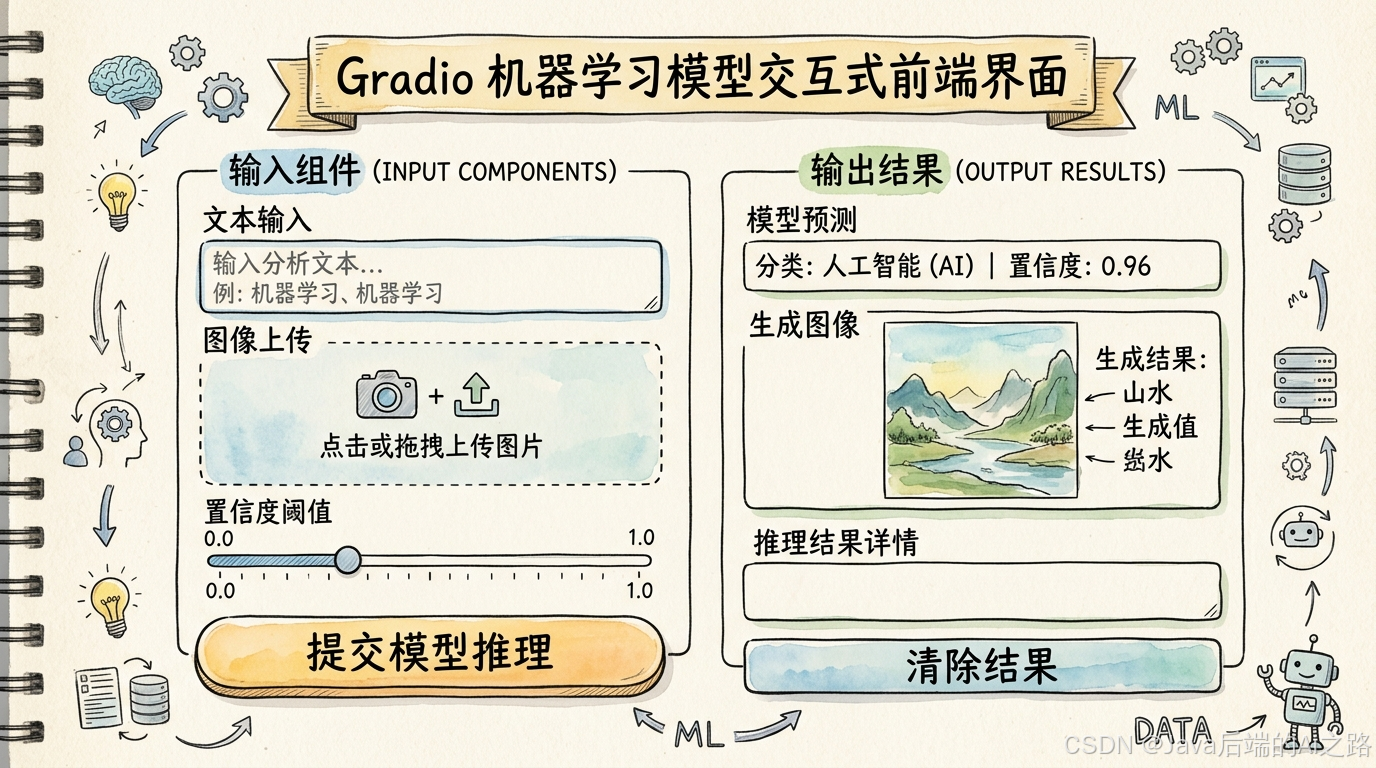

二、一句话抓住核心

Gradio 的核心宗旨,是让 AI 开发者待在最熟悉、最舒适的 Python 世界里,用最少、最干净的代码,一键生成功能强大、外观精致的交互式 Web 应用。

Gradio 已在 GitHub 上获得超 4.2 万星标,每月拥有超过 200 万用户,在 Hugging Face Spaces 上托管了超过 47 万个应用。超过 78% 的算法工程师认为"模型展示环节消耗了 30% 以上的开发时间",而 Gradio 可以将这一时间压缩 90% 以上。

2026 年 Gradio 6 的发布更标志着其从"Demo 构建器"向"AI 应用运行时"的跃迁------一个应用可同时暴露为 Web UI、REST API 和 MCP 工具。

三、是什么 ------ 极简概念与原理

3.1 核心定义:给 Python 函数穿上 Web 的"自动裁缝铺"

Gradio 是一个开源 Python 库,允许开发者无需掌握 JavaScript、CSS 或 Web 部署知识,即可将任何机器学习模型、API 或 Python 函数直接转化为一个拥有现代界面的、可公开访问的 Web 应用。它基于 FastAPI 和 Svelte 构建,兼具高性能后端与现代前端渲染能力。

通俗理解:Gradio 就像给 Python 函数穿上一件"自动生成的漂亮衣服"。你的模型脚本是原材料,Gradio 是一个全自动裁缝铺,它帮你把衣服剪裁、缝制、打包好,别人一打开网页就能看到成品。

3.2 三大核心抽象层级

Gradio 提供了渐进的 API 抽象,满足从"秒级出 Demo"到"精细控制布局"的全场景需求:

- Interface:最高层抽象。用最少代码快速将单个核心函数封装成标准界面。只需指定函数和输入输出组件,Gradio 自动生成完整页面。Interface 是"标准西装"------一个函数对应一个界面,简单直接。

- ChatInterface:专为对话类 AI 模型设计的 Interface 变体,自带聊天 UI 和对话历史管理。ChatInterface 是"定制马甲"------专为对话场景设计。

- Blocks:低层灵活布局系统。可自由组合 30 多种原生组件实现复杂网页布局,每个组件可绑定多个事件。Blocks 是"乐高积木"------你可以用不同组件自由搭出任何你想要的形状。

3.3 底层运作机制

无论采用哪种顶层 API,Gradio 的底层运行机制始终保持一致:

定义 Python 核心函数 → 声明对应的输入输出组件 → Gradio 自动构建交互逻辑与前端页面 → Python 后端与前端 WebSocket 长连接双向同步3.4 组件生态系统:30+ 原生 AI 组件

Gradio 内置了超过 30 个专为 AI 场景深度优化的组件,涵盖文本、结构化数据、多媒体交互四大类。核心组件包括:

- gr.Textbox:多行文本输入输出,支持占位符和行数控制

- gr.Image:图像上传与显示,支持摄像头采集

- gr.Audio:音频输入输出,支持麦克风录音

- gr.Video:视频文件上传与播放

- gr.DataFrame:表格数据交互展示

- gr.Plot:Matplotlib/Plotly 图表嵌入

- gr.State:会话状态持久化组件,跨多次交互保持用户数据

- gr.HTML:Gradio 6 增强版,允许使用基础 HTML/CSS/JS 创建完全自定义 UI 组件,打破了预置组件的"围墙花园"

3.5 2026 年最新架构升级:Gradio 6

Gradio 6 于 2026 年初发布,带来四项核心升级:

- 基于 Svelte 的全新前端引擎:加载速度大幅提升,页面响应更快。

- WASM/Lite 系统:应用可直接在浏览器中运行,无需 Python 服务器。

- MCP 服务器集成:Gradio 函数可直接作为 LLM 工具暴露,一个应用同时是 UI、API 和 MCP 工具。

- 增强版 HTML 组件:允许开发者使用基础 HTML/CSS/JS 创建完全自定义 UI 组件。

四、为什么用 ------ 核心优势与对比

4.1 Gradio vs Streamlit ------ 最关键的选型决策

| 对比维度 | Gradio | Streamlit |

|---|---|---|

| 核心定位 | 模型演示、函数封装、AI 界面 | 数据应用、分析页面、交互式工具 |

| 心智模型 | 给 Python 函数加界面 | 把脚本变成网页 |

| 多模态支持 | 原生支持图像/音频/视频/文件 | 需引入第三方包 |

| 事件机制 | 事件驱动,只执行绑定的回调 | 每次交互重新执行全部脚本 |

| AI 生成友好度 | 极高 | 极高 |

| 最佳场景 | LLM 对话、模型 Demo、快速分享 | 数据看板、BI 工具、内部运营 |

选型口诀:算法演示和模型分享选 Gradio,数据分析看板和内部运营工具选 Streamlit。两者同属"极速原型层",30 分钟出 MVP 是常态。

4.2 Gradio vs FastAPI/Flask ------ 传统 Web 框架对比

FastAPI 是后端接口框架,需要额外搭建前端才能有用户交互界面;Gradio 是开箱即用的 Web UI 框架,无需任何前端依赖。两者不是竞争关系而是互补关系------"FastAPI + Gradio"的组合已成为企业级 AI 服务的典型架构:Gradio 提供交互 UI,FastAPI 通过 mount_gradio_app 将 Gradio 应用挂载到已有 API 服务中。

4.3 Gradio 的核心价值总结

- 极速开发:纯 Python 实现,无需前端技能栈

- 多模态支持:文本、图像、音频、视频、文件一键处理

- 极速分享:一行代码生成公网链接,或部署到 Hugging Face Spaces

- 流式交互:原生支持流式输出,适合聊天、长文本生成等场景

- 自动生成 API:每个 Gradio 应用自动暴露 REST API 端点------UI 和 API 是同一份代码的两面

- 内置队列系统:原生支持高并发请求排队,处理长推理任务

4.4 2026 年生态成熟度

Gradio 已深度融入 Hugging Face 生态,从 Hugging Face Hub 加载模型和在 Hugging Face Spaces 部署应用均可一键完成。SambaNova 等企业级推理服务商已与 Gradio 深度集成,3 行代码即可部署一个运行在云端高性能芯片上的 AI 聊天机器人。在 LLM 对话系统前端框架选型中,对于 Python 开发者,Gradio 被公认为快速搭建交互界面的最佳选择。

五、怎么用 ------ 保姆级基础教学

5.1 环境搭建

Gradio 要求 Python 3.10 或更高版本。

bash

# 安装 Gradio 6

pip install --upgrade gradio验证安装:

python

import gradio as gr

print(gr.__version__)5.2 从"Hello World"到"AI 应用"的完整演进

Level 1:最简单的问候应用

python

import gradio as gr

def greet(name):

return f"你好,{name}!欢迎使用 Gradio。"

demo = gr.Interface(

fn=greet,

inputs=gr.Textbox(label="请输入你的名字"),

outputs=gr.Textbox(label="问候语"),

title="我的第一个 Gradio 应用",

description="这是一个最简单的问候 Demo"

)

demo.launch()运行后在浏览器打开 http://localhost:7860 即可看到界面。

Level 2:多输入多输出 ------ 情感分析模型包装

python

import gradio as gr

from transformers import pipeline

# 加载 Hugging Face 模型

classifier = pipeline("sentiment-analysis",

model="distilbert-base-uncased-finetuned-sst-2-english")

def analyze_sentiment(text):

result = classifier(text)[0]

return result["label"], round(result["score"], 4)

demo = gr.Interface(

fn=analyze_sentiment,

inputs=gr.Textbox(label="请输入待分析文本", lines=3, placeholder="Write something here..."),

outputs=[

gr.Textbox(label="情感标签"),

gr.Number(label="置信度")

],

title="情感分析 Demo",

description="输入一段英文文本,模型将判断其情感倾向",

examples=[["I love this product!"], ["This is terrible."], ["It's okay, not great."]]

)

demo.launch()Level 3:多模态模型 ------ 图像分类

python

import gradio as gr

import torch

from transformers import AutoImageProcessor, AutoModelForImageClassification

from PIL import Image

processor = AutoImageProcessor.from_pretrained("google/vit-base-patch16-224")

model = AutoModelForImageClassification.from_pretrained("google/vit-base-patch16-224")

def classify_image(image):

inputs = processor(images=image, return_tensors="pt")

with torch.no_grad():

outputs = model(**inputs)

probs = torch.nn.functional.softmax(outputs.logits, dim=-1)

top5 = torch.topk(probs, 5)

return {

model.config.id2label[idx.item()]: float(score.item())

for idx, score in zip(top5.indices[0], top5.values[0])

}

demo = gr.Interface(

fn=classify_image,

inputs=gr.Image(type="pil", label="上传图片"),

outputs=gr.Label(num_top_class=5, label="分类结果"),

title="图像分类 Demo",

description="上传一张图片,模型将识别其中的物体"

)

demo.launch()5.3 Blocks 核心架构实战 ------ 构建一个复杂 AI 助手界面

使用 Blocks API 构建一个包含模型选择、文本输入、图像上传、流式输出和历史记录的完整 AI 助手:

python

import gradio as gr

import time

def respond(message, chat_history, model_choice, image):

"""核心响应函数"""

# 构建对话历史

bot_message = f"[模型: {model_choice}] 收到你的消息: {message}"

if image is not None:

bot_message += f"\n图片尺寸: {image.size}"

# 流式输出模拟

full_response = ""

for char in bot_message:

full_response += char

time.sleep(0.02)

yield full_response, chat_history + [[message, full_response]]

with gr.Blocks(title="AI 助手", theme=gr.themes.Soft()) as demo:

gr.Markdown("# AI 智能助手")

with gr.Row():

with gr.Column(scale=1):

model_choice = gr.Dropdown(

choices=["GPT-4o", "Claude-4", "Gemini-2.5", "Llama-4"],

value="GPT-4o",

label="选择模型"

)

image_input = gr.Image(type="pil", label="上传图片 (可选)")

with gr.Column(scale=3):

chatbot = gr.Chatbot(label="对话历史", height=400)

msg = gr.Textbox(

label="输入消息",

placeholder="输入你想问的问题...",

lines=2

)

with gr.Row():

submit_btn = gr.Button("发送", variant="primary")

clear_btn = gr.Button("清空对话")

# 事件绑定

submit_event = submit_btn.click(

fn=respond,

inputs=[msg, chatbot, model_choice, image_input],

outputs=[msg, chatbot],

queue=True

)

msg.submit(

fn=respond,

inputs=[msg, chatbot, model_choice, image_input],

outputs=[msg, chatbot],

queue=True

)

submit_event.then(

fn=lambda: "",

inputs=None,

outputs=[msg]

)

clear_btn.click(

fn=lambda: (None, None),

inputs=None,

outputs=[chatbot, msg]

)

demo.launch()5.4 gr.State 状态管理实战 ------ 实现多轮会话记忆

gr.State 就像一个"前台小本本"------用户第一次登录留下了偏好,你记在小本本上;等用户下次再来,翻开小本本一看,直接展示对应内容。

python

import gradio as gr

def user_register(name, state):

"""用户首次注册时保存信息"""

state["user_name"] = name

state["login_count"] = state.get("login_count", 0) + 1

return state, f"欢迎你,{name}!这是你第 {state['login_count']} 次登录。"

def ask_question(question, state):

"""回答用户问题,并记住上下文"""

if "history" not in state:

state["history"] = []

state["history"].append({"role": "user", "content": question})

# 模拟基于历史上下文的回答

response = f"根据我们的对话历史(共{len(state['history'])}轮),我来回答:{question[:20]}..."

state["history"].append({"role": "assistant", "content": response})

return state, response

with gr.Blocks() as demo:

gr.Markdown("# 多轮对话助手 (带状态记忆)")

state = gr.State({}) # 初始化空状态字典

with gr.Tab("注册"):

name_input = gr.Textbox(label="你的名字")

welcome_output = gr.Textbox(label="欢迎信息")

register_btn = gr.Button("注册")

register_btn.click(

fn=user_register,

inputs=[name_input, state],

outputs=[state, welcome_output]

)

with gr.Tab("对话"):

question_input = gr.Textbox(label="你的问题")

answer_output = gr.Textbox(label="助手回答")

ask_btn = gr.Button("提问")

ask_btn.click(

fn=ask_question,

inputs=[question_input, state],

outputs=[state, answer_output]

)

demo.launch()5.5 流式输出实战 ------ 将 LLM 推理能力接入到前端展示

Gradio 的流式输出依赖 Python 的生成器机制。当你的核心函数使用 yield 而非 return 时,Gradio 会逐步接收生成器的输出并将其实时推送至前端。

python

import gradio as gr

import time

import random

def stream_llm_response(prompt, history):

"""模拟 LLM 流式输出"""

response = history or []

response.append({"role": "user", "content": prompt})

# 模拟 LLM 逐 token 生成

full_answer = (

f"关于「{prompt}」这个问题,我来为你详细分析。"

f"首先,从技术角度来看,这涉及到多个层面的考量。"

f"其次,在实际应用中,我们还需要关注性能和可靠性。"

f"最后,建议根据你的具体场景选择最合适的方案。"

)

answer_so_far = ""

bot_message = {"role": "assistant", "content": ""}

for char in full_answer:

answer_so_far += char

bot_message["content"] = answer_so_far

time.sleep(0.03) # 模拟推理延迟

yield response + [bot_message]

demo = gr.ChatInterface(

fn=stream_llm_response,

title="流式聊天机器人",

description="体验逐字输出的打字机效果",

examples=["介绍一下 Python", "什么是机器学习?", "Gradio 怎么用?"]

)

demo.launch()5.6 企业级发布和部署实战

方案一:临时公网分享(一行代码)

python

demo.launch(share=True)这会在 Gradio 的公共服务器上创建一个临时隧道链接,72 小时后自动过期。

方案二:Hugging Face Spaces 免费托管

将 app.py 和 requirements.txt 上传到新建的 Hugging Face Space(免费配置:2 vCPU、16GB RAM、50GB 磁盘),选择 SDK 为 Gradio,系统自动构建并分配 HTTPS 域名。适合演示与协作场景。

方案三:Docker 化部署

dockerfile

FROM python:3.11-slim

WORKDIR /app

COPY requirements.txt .

RUN pip install --no-cache-dir -r requirements.txt

COPY . .

EXPOSE 7860

ENV GRADIO_SERVER_NAME="0.0.0.0"

CMD ["python", "app.py"]

bash

docker build -t gradio-app .

docker run -p 7860:7860 gradio-appDocker 部署时必须设置 server_name="0.0.0.0",否则容器外无法访问。

方案四:FastAPI + Gradio 混合部署(企业级推荐)

python

# main.py

from fastapi import FastAPI

import gradio as gr

app = FastAPI(title="AI Service")

def predict(text):

return f"处理结果: {text}"

gradio_app = gr.Interface(fn=predict, inputs="text", outputs="text")

# 将 Gradio 挂载到 FastAPI

app = gr.mount_gradio_app(app, gradio_app, path="/chat")

# 至此,你的服务同时拥有:

# - Web UI: http://your-server/chat

# - REST API: http://your-server/chat/api/predict这种架构让你可以在 FastAPI 层添加 OAuth 2.0 认证、请求限流、日志审计等生产级中间件,同时保留 Gradio 的 UI 能力。Gradio 的独立运行模式会拦截 OAuth 回调流程,导致身份令牌无法正确传递,因此"FastAPI 挂载"是企业在 B2B 场景下实现 SSO 的正确路径。

六、常用场景列举

场景一:AI 模型演示与可视化

算法工程师训练好模型后,通过 Gradio 快速构建演示界面,让非技术人员直接体验模型效果。典型应用包括图像分类、目标检测、图像风格迁移、语音合成等。

场景二:内部 AI 工具平台搭建

使用 Gradio 构建大模型对话界面、自动化标注工具、代码解释器。Gradio 6.9.0 版本新增动态代码解释器,支持在界面中直接执行 Python 代码。

场景三:AI 产品 MVP 快速验证

在 AI 产品 MVP 和原型验证阶段,Gradio 能以最快的速度将想法落地为可交互产品。适合快速验证市场反应、收集用户反馈的早期阶段。2026 年 Python UI 框架选型指南将其列为"极速原型层"首选------30 分钟出 MVP。

场景四:模型对比与评估工具

搭建多模型对比测试平台,同时展示多个模型的推理结果,方便进行 A/B 测试和效果评估。

场景五:多智能体系统交互界面

为多 Agent 协作系统构建统一交互界面,用户通过 Gradio 界面下达任务,Agent 团队协作执行并返回结果。Gradio 6 的 MCP 服务器集成使一个 Gradio 函数可以同时作为 Web UI 和 LLM 可调用的 MCP 工具。

场景六:企业知识库问答与 RAG 前端

构建 LLM 对话系统前端,结合 RAG 技术实现企业知识库问答。Gradio 的 ChatInterface 提供开箱即用的对话历史管理和流式输出,是 LLM 对话系统前端框架的最佳选择。

七、企业级实战指导

7.1 Gradio 在 AI 产品开发中的定位

2026 年 Python UI 开发已分化为四层体系:

| 层级 | 代表框架 | 定位 | Gradio 的位置 |

|---|---|---|---|

| 极速原型层 | Gradio, Streamlit | 30 分钟出 MVP,AI 生成极友好 | Gradio 的核心战场 |

| 轻量产品层 | NiceGUI, Flet | UI 可控,可给客户用,不用写前端 | 可从 Gradio 迁移至此 |

| 工程化 Web 层 | Reflex, React | 前后端分离,可扛流量 | 通过 FastAPI 挂载 Gradio 实现 |

| 本地重型层 | PySide6 | 离线高性能工业软件 | 不适用 |

指导原则:Gradio 适合在 30 分钟内出 MVP。随着产品复杂度增长,可通过 FastAPI 挂载实现"Gradio 做 UI + FastAPI 做工程化"的混合架构。

7.2 生产环境部署全攻略

| 方案 | 适用场景 | 成本 | 复杂度 |

|---|---|---|---|

launch(share=True) |

临时分享、内部评审 | 免费 | 零 |

| Hugging Face Spaces | Demo 托管、小团队协作 | 免费 | 低 |

| Docker + 云服务器 | 生产级 Web 服务 | 按量付费 | 中 |

| FastAPI + Gradio 挂载 | 企业级 API + UI | 按量付费 | 中高 |

| K8s 多实例 + 负载均衡 | 高并发生产集群 | 按量付费 | 高 |

Hugging Face Spaces 提供永久免费的托管方案:2 vCPU、16GB RAM、50GB 磁盘,自动分配 HTTPS 域名,无需备案。需注意休眠策略:连续 48 小时无访问会自动休眠,可通过 UptimeRobot 定期访问保持活跃。

7.3 生产环境高性能配置

高并发场景下,必须启用内置队列系统:

python

demo.queue(

default_concurrency_limit=3, # 全局并发限制

max_size=100, # 最大排队容量

).launch(

server_name="0.0.0.0",

server_port=7860,

max_threads=40 # 线程池大小

)对于长推理任务(如 LLM 生成),queue() 是避免请求超时的必需品。你还可以编写支持批处理的函数,让模型一次性处理多个请求以获得更高吞吐量。

7.4 生产环境避坑指南

| 坑 | 表现 | 根本原因 | 解决方案 |

|---|---|---|---|

| share=True 当生产方案 | 72 小时后链接失效 | share 生成的是临时隧道 | 使用 Hugging Face Spaces 或 Docker 部署 |

| 长推理任务不启用队列 | 请求超时、连接中断 | 无队列管理,并发堆积 | 必须调用 .queue() 并设置合理并发限制 |

| Docker 部署访问 404 | 容器外无法访问 Gradio | 默认监听 localhost | 设置 server_name="0.0.0.0" |

| 多用户数据串台 | 用户 A 看到用户 B 的数据 | 使用了全局 Python 变量 | 必须使用 gr.State 为每个用户维护独立状态 |

| OAuth 认证接入失败 | 令牌无法正确传递 | Gradio 独立运行拦截回调流程 | 通过 FastAPI mount_gradio_app 挂载,借中间件完成认证 |

| 模型加载阻塞启动 | 启动时间过长 | 模型在 __main__ 中同步加载 |

使用 .load() 延迟加载或在 Blocks 启动后异步加载 |

| 文件上传大小限制 | 大文件上传失败 | Gradio 默认上传限制 | 设置 gr.File(max_size="500MB") 或在 Nginx 配置 client_max_body_size |

7.5 企业级鉴权实战

Gradio 原生支持基础的用户名密码鉴权:

python

demo.launch(auth=[("admin", "password123")])但对于企业级场景(SSO、OAuth 2.0、JWT),需要借助 FastAPI 挂载方案。生产实践中,通过 FastAPI 中间件添加 JWT 鉴权、请求限流和日志审计:JWT 鉴权像给服务加了一把锁和钥匙,只有持有有效 Token 的用户才能进门;请求限流像给每个用户发一个"限速卡",防止单个用户过度使用;日志审计像安装了一个"监控摄像头",详细记录每一次访问的来龙去脉。

7.6 2026 年前沿趋势与未来展望

-

MCP 协议原生支持:Gradio 6 的标志性特性。一个应用同时作为 UI、API 和 MCP 工具------这意味着你的 Gradio 模型可以被 Claude、Cursor 等 AI 自然语言调用,打开了"AI 调用 AI"的新范式。

-

WASM 全浏览器端运行:Gradio-Lite 通过 Pyodide 将 Python 运行时编译为 WebAssembly,应用可在浏览器中直接运行,无需任何后端服务器。

-

Agentic UI:AI 助手直接操控页面组件。用户不再需要手动填写表单、选择参数,而是用自然语言描述需求,AI 自动操作界面。

-

AI 生成 Gradio 代码:Gradio 的语法固定、模式清晰,对于 ChatGPT 或 Claude 来说,写一段 Gradio 代码就像写顺口溜一样简单。在 2026 年,让 AI 帮你写 Gradio Demo 是最高效的方式。

-

从"生成静态 UI"到"AI 与人类共同操作的交互式画布":Gradio 6 的战略跃迁使其不再只是一个 Demo 构建器,而是 AI 应用的核心运行时层。

八、面试官高频八连问

Q1:Gradio 和 Streamlit 各有什么优缺点?在实际工作中你应该如何选择?

答题要点:采用"定位差异 → 场景匹配 → 实际选择"的回答结构。Gradio 偏模型演示、函数封装、多模态支持(图像/音频/视频);Streamlit 偏数据应用、分析页面、交互式工具。两者同属 2026 年 Python UI 四层体系中的"极速原型层",在 AI 生成友好度上均为 T0 级。算法演示和模型分享选 Gradio,数据分析看板和内部运营工具选 Streamlit。Gradio 6 的 MCP 集成使其在 AI Agent 场景中具有独特优势。

Q2:Gradio 中的 Interface 和 Blocks 架构有什么区别?

答题要点:Interface 是最高层抽象,适合快速封装单个功能函数,一个函数对应一个界面,Gradio 自动处理布局。Blocks 是低层灵活布局系统,适合构建多组件、多事件的复杂网页。关键区别在于事件机制:Interface 的交互模型是"输入 → 运行 → 输出"的固定流程;Blocks 引入了显式事件绑定机制,每个事件监听器独立绑定,执行完回调函数后只更新受影响的组件,无需全量重新渲染。性能上,Blocks 远优于 Streamlit 的全量重新执行。

Q3:如果要实现多轮对话,并让机器人记住上下文,核心代码应该怎么写?

答题要点 :核心是 gr.State 组件及消息追加模式。对于 ChatInterface,历史管理由框架自动处理,开发者只需在函数中处理历史参数。对于 Blocks,需要手动创建 gr.State,在每次对话时将新的用户消息和助手回复追加到历史列表中,并作为 State 的输出传回。两种方式的核心差异:ChatInterface 适合标准对话场景,开箱即用;Blocks 适合需要多组件联动、侧边栏配置项等复杂场景。

Q4:Gradio 应用要部署到生产环境,有哪些主流方案?各自的成本和安全考量是什么?

答题要点 :四种方案逐级递进。Hugging Face Spaces:零成本,自动 HTTPS,但资源受限,适合 Demo 和小团队;Docker 化部署到云服务器:成本可控,适合中等规模生产;FastAPI + Gradio 挂载:企业级方案,可在 FastAPI 层添加 JWT/OAuth 鉴权、限流和审计,适合 B2B 场景;K8s 多实例 + 负载均衡:高并发生产集群。需特别注意:launch(share=True) 生成的是临时公网链接,72 小时后自动过期,不应用于任何生产场景。

Q5:Gradio 应用在高并发场景下性能很差,你是怎么解决的?

答题要点 :第一步,启动 Gradio 内置队列系统 .queue(),设置合理的 default_concurrency_limit 和 max_size。第二步,对于可批处理的函数(如深度学习模型推理),改写为批量处理模式,一次处理多个样本。第三步,使用 Nginx 反向代理将请求分发到多个 Gradio 实例,实现水平扩展。第四步,对于资源密集型推理,将模型推理服务独立部署(如 vLLM、TGI),Gradio 只做前端代理,通过 API 调用后端推理服务。

Q6:你在实际工作中用 Gradio 做过哪些事情?有没有遇到过比较棘手的性能问题和布局样式问题?

答题要点 :实际应用如 LLM 对话系统、模型效果演示平台、数据标注工具。布局样式方面,Gradio 6 的增强版 HTML 组件允许直接用 HTML/CSS/JS 创建完全自定义 UI 组件,打破了预置组件的"围墙花园"。性能方面,对于需要实时更新的组件数据,通过 gr.State 传递流式生成器产生的实时数据,而非频繁触发全局刷新。复杂产品层需求可考虑集成到 FastAPI 中,使用 mount_gradio_app 挂载核心 Gradio 应用,在 FastAPI 层处理复杂路由和鉴权。

Q7:怎样对 Gradio 应用进行鉴权,确保只有授权用户才能访问?

答题要点 :三层方案。第一层------基础认证:demo.launch(auth=[("user1", "pass1"), ("user2", "pass2")]),适合快速内部使用。第二层------FastAPI 挂载(推荐):将 Gradio 通过 mount_gradio_app 挂载到 FastAPI,在 FastAPI 层使用中间件添加 JWT 或 OAuth 2.0 认证。第三层------反向代理鉴权:使用 Nginx 的 auth_request 模块或 OAuth2 Proxy 在流量进入 Gradio 之前完成身份验证,适合已有统一认证网关的企业。

Q8:Gradio 6 相比 Gradio 5 有哪些核心升级?MCP 集成意味着什么?

答题要点:Gradio 6 四大核心升级:基于 Svelte 的全新前端引擎(加载速度大幅提升);WASM/Lite 系统(应用可直接在浏览器运行);MCP 服务器集成(Gradio 函数直接作为 LLM 工具暴露);增强版 HTML 组件(支持自定义 UI)。MCP 集成的意义:一个 Gradio 函数同时是一个浏览器里能把玩的 UI,也是一个发送 curl 请求就能调用的 REST API,更是一个可以被 Claude 或 Cursor 自然语言调用的 MCP 工具。这标志着 Gradio 从"Demo 构建器"向"AI 应用运行时"的战略跃迁------未来你的 Gradio 应用不仅服务人类用户,也服务 AI Agent。

九、总结与展望

回顾全文,我们从"模型调好了怎么给老板看"的翻车现场出发,系统建立了从"快速上手"到"工程化落地"的完整认知框架:

- Gradio 是什么:给 Python 函数穿上 Web 界面的"自动裁缝铺",30+ 原生 AI 组件覆盖全模态

- 为什么用 Gradio:纯 Python 开发,多模态原生支持,一次编码同时获得 UI + API + MCP 工具

- 怎么用 Gradio:Interface 秒出 Demo,Blocks 精细布局,ChatInterface 对话开箱即用

- 怎么落地:Hugging Face Spaces 免费托管,Docker 容器化部署,FastAPI 挂载企业级架构

2026 年,Gradio 6 的发布标志着它从"Demo 构建器"向"AI 应用运行时"的跃迁。MCP 协议的原生支持、WASM 全浏览器端运行、Agentic UI 的兴起------这些趋势共同指向一个未来:AI 应用的交互方式不再是"人点击按钮,机器被动响应",而是"人和 AI 在同一块画布上共同操作"。

最后送大家一句话:Gradio 就是给 Python 函数穿上漂亮衣服的那个裁缝------你不用学 HTML/CSS/JS,只需要专注写好你的模型逻辑,剩下的事交给它。界面有了,API 有了,连 AI Agent 都能调用了。

本文为原创文章,如需转载,请联系作者获得授权,并注明出处。