- Data-driven: 调了几个月的算法不如别人两天用模型训的效果好

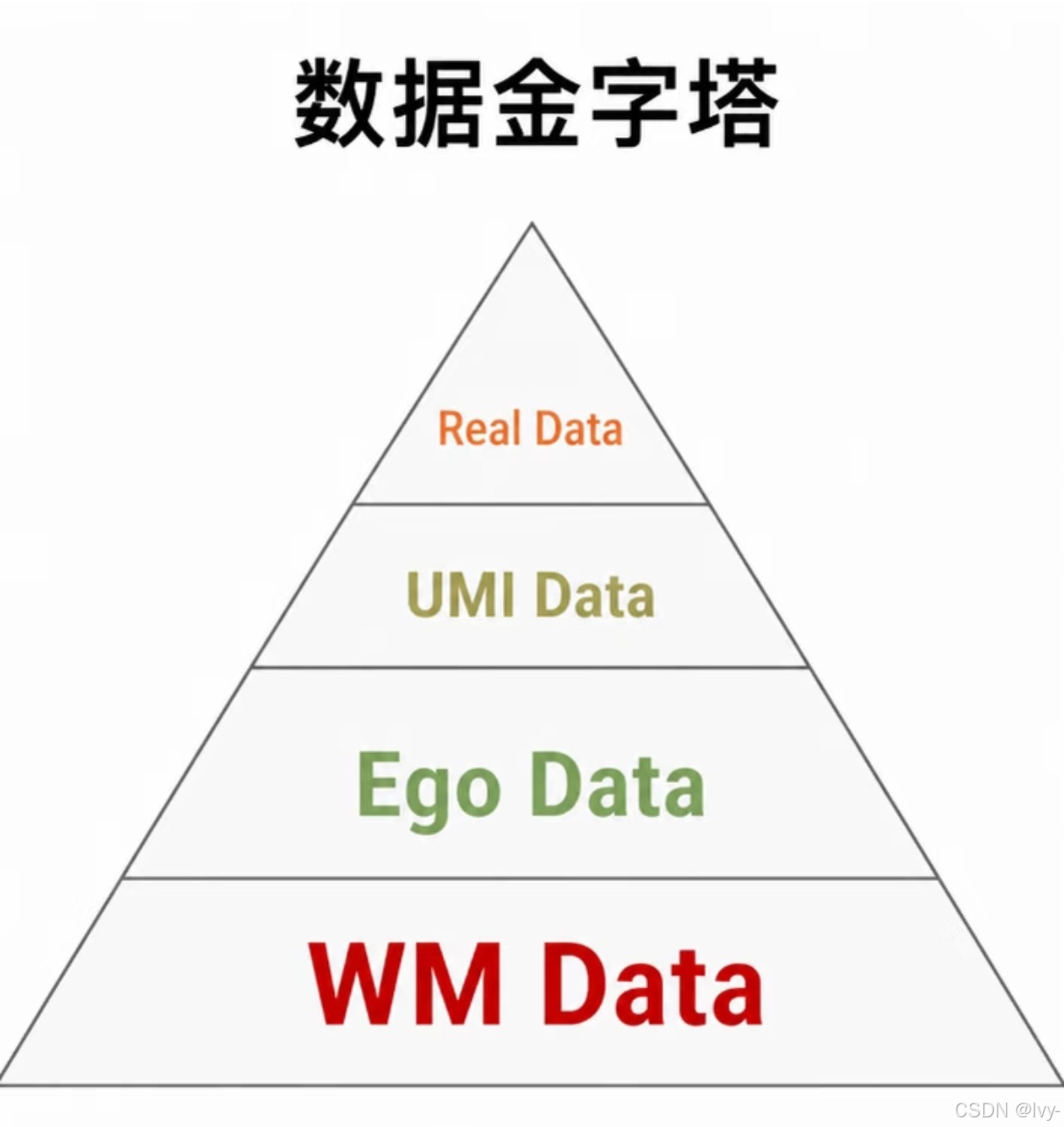

Behavior cloningworks:只要数据足够好,BC 可以作为很强的 baseline,不需要追求 RLHuman data是机器人的 GPT moment 基础,类似 LLM 依赖互联网人类语言数据,机器人需要人类在物理世界留下的操作数据- 三层数据模态 :

- 第一层(世界改变):人和机器人没有区别

- 第二层(交互):人和机器人有一定差距但可以学习

- 第三层(控制):差距最大,需要

硬件配合

第一人称数据是 scalable 的关键,通过设备(Meta 眼镜等)可以采集大量高质量数据- 硬件瓶颈大于算法,大部分人卡在机器人硬件而不是数据采集

- Full stack 是唯一出路,硬件、算法、数据整个系统都要抓

- 数据需要 1 亿小时量级,现在最大约 10-20 万小时,还差 100 倍

- 非刻意数据价值高但难采集,需要证明非刻意数据有用后,才能形成生态

- 学术界需要更多基础研究,不能只追着工业界跑,需要搞清楚什么样的数据有用、怎么用

Danfei Xu - roboticist

从早年折腾单片机小车,到在斯坦福从零搭建 robot learning 系统,再到如今思考 human data 如何成为机器人学习的底层燃料,他始终认为这是一个完整全栈问题,而非单点算法

- interest driven: 不想干的事只投入 0% 精力,想干的事投入 50%-100%

从 Vision 到 Robotics

当时有两种主流方向:

- Vision-centric:GraspNet 等工作,把 robotics 当成 vision problem 来做

- RL(强化学习):AlphaGo 之后 RL 变得很 work,大家觉得只要 scale up 就能成功

两种思维模式:

- Prior is a great thing:需要给系统输入尽可能多的 prior(structures、neuro symbolic、program dynamics)

- Supervised learning is not scalable:认为机器人需要自己学,不能让人教

从 Task and Motion Planning 到 Behavior Cloning

- 早期做 TAMP(Task and Motion Planning):想做 demonstration in, action out,一条 episode 做 end-to-end learning。后来发现 OpenAI 做了类似的工作,他加入更多 structure prior,变成了 TAMP

- TPMP :对无法搜索的巨大空间做 decomposition,把 local problems 分解后再连接

- 局限性 :人的 structure 会变成解决能力的上限天花板,就像 Bitter Lesson------你加的 structure 迟早会被 learning 追上

转折点:DeepMind

- 2019 年夏天去 DeepMind 做 generative imitation learning 的 intern

- 看到了 behavior cloning 真的 works:他们有很好的数据采集系统(用 space mouse 做 teleoperation),数据质量很高。如果把 suboptimal 数据都过滤掉,直接做 BC,它可以做大部分任务,是一个 competitive baseline

- 为什么 DeepMind 没有大力做 BC :他们的 flagship product 或 flagship research 都在

RL,所以强行把 BC 压下去。BC 在当时整个 community 看来是 not political correct------"机器人需要自己学,不能让人教"

"看了这些以后觉得 BC 这么 work,为什么不干 BC?"

Behavior Cloning

什么是机器人行为克隆(Behavior Cloning)

把机器人当作一个强监督学习问题:直接给他 demo 数据------用 iPhone 或 VR controller 控制机器人,同时记录:

- 看到的图像(所有 camera image)

- 控制指令(control command)

把这些作为 (x, y) 输入给大模型或小模型,学习一个 control policy

为什么当时社区看不上 BC

- Efficiency error(复合误差):BC 会错误累积

- Supervise learning is not scalable:需要自己学,不能让人教

- RL 的狂热:AlphaGo 让大家觉得 RL 可以解决一切问题

Danfei 和 Jia 的 BC 工作

- 2019 年:和 Jia 在 Franka Panda 上做了 BC

- 搭了一套完整的 teleoperation 系统 :做了很多拍脑袋的决定

- 给机器人装了一个 wrist camera(当时没人做)

- 用 ResNet 18-1 8 当 encoder

- 用了 Spatial Softmax

- 加上 RNN 保留 history

- 结果:能学习 30 秒的复杂任务(比如把烤箱里的盘子拿出来关上烤箱再放回去),这是当时没人见过的水平

- 为了发 paper 不得不加别的 novelty:他们虽然坚信 BC works,但为了 paper 能中,必须加其他东西

"每一个博士生听到'为了让 paper 能中,我们想一些其他的 novelty'都能共情。"

当时学术界的困境

- 大家都在做 RL、offline RL、generative RL,BC 被忽视

- 即使他们做了 BC,也没有太大影响,因为 COVID 爆发,robot access 没了,只能做 DAgger

- 他们距离 ALOHA 不太远:Danfei 认为他们的系统更好,只是当时只有两个人,没有时间完成系统性实验

人类数据(Human Data)

从遥操作数据到人类数据

- 遥操作数据(Teleoperation data) 是现在主流的机器人数据

- 人类数据有多种模态 :

- 第一人称视角:GoPro、Meta Glasses 等

- 第三人称视角:从旁边看

- 多视角

- 带 IMU/VIO 的第一人称

- 触觉(tactile)

- 音频、语言、嗅觉等

EgoMimic 项目

- 背景:2022 年中开始,2023 年中完成

- 最初:一个博士生 Simmer 想做第一人称视角数据,认为这是最可扩展的(most scalable)

- 数据采集 :

- 最初用 VR + Leap Motion(和 2015 年做的一模一样),但 calibration 非常不稳定,效果很差

- 恰好 Meta 做 E4D 项目有个眼镜(完美的第一人称设备),有 hand tracking、定位、RGN 数据,才搞定数据采集

- 数据采集花了 4-5 个月才搞通

- 机器人 :因为没有机器人符合人类的身体结构(需要像人一样的双手、肩、躯体关节,相机放在头部位置),Danfei 自己设计并搭了一个双臂机器人------买了各种铝部件,自己焊接组装

- Danfei 负责机器人硬件,另一个做数据采集

为什么转向人类数据

-

遥操作数据本身也不完美:每台机器人的底层控制器不同(比如改了一点 gain),整个控制行为完全不一样,存在很大的 gap

-

核心:

"人和机器人和机器人之间的差距真的有那么大吗?如果我们能把人的动作转换成可用的 action,把 perception 转换成可用的 policy input,

直接把人类数据当机器人数据用------这件事不是不可能的。" -

观点:

"Human 只是 another robot,或者说 robot 只是 another human。

如果你在人身上挂足够多的 sensor,其实你可以把一个人变成一个机器人。"

从``人类视频数据中学习什么

将人机交互问题分解为三个子问题:

- 想让世界怎么改变(how the world should change):这个人和机器人没有任何区别,只要机器人足够有能力做这件事

- 本体怎么让世界产生这些改变:比如推哪里、拿杯子哪里可以把它拎起来

- 本体怎么产生这些动作:比如扔球,需要每个关节产生足够的力把球扔成特定轨迹

- 第三层最难:从视频数据里学不出来,因为人的驱动是肌肉电信号,无法和电机关节一一对应

- 边界取决于第三层 :

机器人本体控制能力能多接近人类展现的状态

第一人称 vs 第三人称视频

- 第三人称数据 (YouTube)非常 scalable,但极难处理:

- 数据分布需要和机器人数据尽可能一样

- 人和机器人的 camera layout 不同

- 提取有用的数据部分非常困难

- 第一人称数据:有设备(Meta 眼镜等)和人愿意配合的话,反而没有那么难

"0 到 1 这件事如果有一个人能做出来,1 到 99 发展速度会非常快。但大家都会选择做不确定性更低的事情。"

数据模态分析

为什么 SLAM/VIO 对人类数据很重要

两种理解人类数据的方式:

- Event modeling:只需要视频数据

- 把人当机器人:human as another robot,需要 capture 所有 input/output,包括 action label

- Action 是什么:手在空间中的位置(kinematic)

- 怎么取:hand estimation 从第一人称看手的位置

- 还需要知道手在哪:通过 VIO 和 IMU 做 self-localization

- SLAM 是把人当机器人这条技术路线的关键:需要 capture 尽可能多的 action label

为什么 SLAM 很难

- Sub-centimeter level 的 SLAM 只在 VR/AR 公司存在(Meta、Apple 等)和少数 driving 公司

- 眼镜面临的挑战:6 个 camera 之间关系会变化(温度导致镜头形变),需要做 online calibration 考虑热效应

- Apple Vision Pro 的例子:Danfei 戴着它在大街上走,走了两个 block 回来定位还在

"这是一个纯工程问题,没有需要 invent nextGPT 的东西。有钱有资源、愿意花时间磨细节,绝对可以做出来。"

触觉数据(Tactile)

- 问题:触觉传感器太不统一了------光学、压感、电阻、磁场...太多不同传感器,每种属性都不一样

- 现状:没有 RGB camera 那样标准化的表示

- 重要性:人是 friction engine,给世界产生力来改变世界状态,触觉是最直接的(虽然 imperfect)力测量

- 可能的发展:用 RGB camera 替代------比如 wrist camera 可以看到手和物体的交互

数据模态排序(从最不重要到最重要)

Danfei 给出了一个排序:

- 嗅觉:最不重要,not there yet

- 音频:第三要放弃的,因为采集设备太粗糙,定位 audio 来源很难

- 语言和 whole-body pose:取决于你相信什么,不知道怎么用

- Tactile 和 whole-body pose:倒数第二重要

- Language annotation:第三重要(给数据加标注)

- Hand pose:第二重要

- Video:第一重要

UMI(Universal Manipulation Interface)

- 什么是 UMI:把你的手换成机械臂的 gripper,gripper 有自己的状态估计(camera、定位),知道自己开合状态,你用人手来操作这个 gripper

- 本质:把人的手退化成一个爪,但有非常好的状态估计

- 好处 :

- 有精确的状态工具(camera、定位)

- 直接被装在机器人上,没有 sim-to-real gap(deployment 和 data collection 之间没有 gap)

- 和纯人类数据的区别 :

- 操作空间不同(人的手有很多 DOF,机器人有限制)

- transfer gap 取决于机器人手有多像人手

数据类型融合趋势

- UMI、teleoperation、纯人类数据会变得 indistinguishable

- General Robotics 的例子:他们的 gripper 跟人手很像,就是在手部挂了两个 fingertips,上面有 camera。如果把 fingertips 拿掉就变成纯人类数据

- 关键:需要 controller 速度跟人差不多,才能做 zero-shot transfer

"如果要做 human data 到 robot 的 transfer,中间的 gap 没有那么大。我需要一个比现有夹爪自由度稍多(22 DOF)、执行速度更快的机械臂,配合好的 controller,就能做到 5 米级别的 transfer。"

硬件瓶颈

- Transfer 卡在硬件上:大部分人卡在机器人硬件,不是数据采集

- 机械臂+灵巧手+执行器速度需要达到接近人类水平

- 需要把东西串起来 :

硬件整合是关键

Human Data 与 Humanoid

Hardware Lottery vs Data Lottery

- Hardware Lottery:如果没有 GPU deep learning,deep learning 可能永远不会 work

- 问题:机器人未来的突破是 hardware lottery 还是 data lottery?

- 答案 :互相成就

- 没有 human data,humanoid 的价值有限

- 没有 humanoid(足够像人的身体),human to robot transfer 会更难

- 至少需要上半身像人:双臂 + 五指机器人,有移动能力(至少 omnidirectional)

是否会被锁死在人类水平?

- 不会 :

- 精细操作只是 human data 的一部分

- 另一部分是 HRI(human-robot interaction)------人和人交互,这是遥操作无法采集的数据

- 可以 upscale:如果机器人有更多 DOF,可以模拟少 DOF 的人类

- 长期愿景:cross GPT-2/3 moment 之后,可能可以 tackle super-human 任务

"我们今天还是以人为中心的 data。如果我们要造乌鸦、松鼠、章鱼的智能,可能也需要给他们带 sensor。但如果我们能达到人类的 physical intelligence,肯定是一个好的 start。"

愿景:从 Human Data 能学到什么级别智能

上限:无法判断是人还是机器人

"上限是 human life robot indistinguishable from humans。无法判别它是人还是机器人------human level Turing test。可以像人一样在物理世界交互,在任务规划层面做到这些。"

- 不只是精细操作 ,还有 HRI:和他人交互

- 本质上是想 behavior clone a human

类比 LLM

今天的 LLM 其实也是 behavior clone human 的语言数据。所以:

"你要做的是 human level behavior cloning。我们还没有达到第一步。"

数据量估计

- 目标 :约 1 亿小时的人类数据

- 现在最大的数据集:10-20 万小时

- 差距:还有 100 倍

- 成本:如果一小时几十刀,对学术界是天文数字

- 关键:需要数据供应商和 research 机构紧密合作

数据基础设施的挑战

- 语言模型、视频模型有成熟的 infrastructure(MP4 等)

- 人类数据现在连什么模态、什么 sensor 都没有 converge

- 如果直接 push 到 1 亿小时数据,可能最后变成浪费

- 当前状态:高速前行的火车,前面几个人在疯狂搭铁轨,后面资本开始往车里加油加柴

非刻意数据的价值

为什么需要不经意采集的数据

- 人类的 physical intelligence 很implicit:我们不会刻意想这件事

- 做任务时不会完整展示物理常识:比如用脚开门、用肘关抽屉

- 刻意采集会丢失这些 implicit knowledge:数据采集公司让你完成任务时,你可能不会做这些 in-between 的动作

需要的平衡

- 刻意数据 :证明

something is possible - 大量非刻意数据:真实生活数据

- 最终类似 Tesla 的 data filtering:知道什么样的数据是重要的

挑战

- 数据供应商不知道怎么采集非刻意数据

- 需要先证明非刻意数据有用,才能让更多人参与采集

Full Stack 的重要性

为什么社区低估 STEM

- robot learning 还在发展阶段:整个 ecosystem 不成熟

- 大家没有对系统有足够深的认知

- 导致 progress 比较慢

Full Stack 是什么

- 不是什么都自己造,是知道什么东西对最终 outcome 有影响

- 对整个 pipeline 的每个细节有足够深的理解

Buy vs Build:- 可以买所有东西

- 但你的 integration 要足够深

- 对系统有足够理解后,才能选择买还是自己造

必须 in-house 的部分

- 整个 evaluation/train loop:post training、pretraining data filtering、close loop

- 数据质量理解:如果数据来自 vendor,对你来说是黑箱------怎么采的、synchronization 做得好不好

"你需要 care about whole thing。你需要 know everything。No work is beneath anyone

Modeling 的偏好

Long Context

- 如果你要

用 context 来解释 action,没有足够 context 就没法解释为什么做这件事 - 只能把 action 当做 very broad distribution,可以做 A 也可以做 B

System One vs System Two

- 不会说话的人(婴儿)和物理世界交互,不会用 system one/two 解释自己行为

- 规划(planning)和操作可能在一个另外的空间里做

- STEM one vs STEM two 现在被 taking quite literally:LM grounding 到 action 距离太远

- 如果有足够数据,可以 learn from scratch 那个 space

当前智能差距

- 现在

离人类的 planning 能力差得远 - Bezier 的乌鸦实验:会用工具通过多层管道获取食物,这是 zero-shot 规划能力

- 现在机器人能做到:不同颜色杯子可以倒水等,但 Bezier 级别的任务还做不到

建议

PhD

- 尽早培养自己的 taste:觉得什么是对的、什么是自己相信的

- 把对整个系统的理解做出来:不要只 care about one thing

- 最开始做比较 full stack 的东西:到第二年再选择做 open-ended 问题还是解决具体问题

如何判断方向

- 看一些好的 research 的轨迹 :理解他们

为什么做这件事,而不是他们做了什么 - 学习的是

grading,不是具体技术 - 想清楚很多不同的路,大家为什么做它或者不做它

- 需要耐心:现在业界有 winner(具体指代未明确),大家可能没那么多耐心培养 taste

当前读 PhD 的难度

- 更难:因为 fomo 太高,不跟主流就会被拉 out

- 但资源变多了:工具(clone code 等)让研究更容易

- 专注变难了:如果选择正确,做事容易很多

对 10 年前的自己说什么

"勇敢地做自己想做的事------

what's the loose?"

逻辑顺畅,收获很多的一个访谈

附录

| 术语 | 解释 |

|---|---|

| Behavior Cloning (BC) | 行为克隆,把机器人当作强监督学习问题,直接用人类演示数据训练控制策略 |

| Human Data | 人类数据,用于机器人学习的人类操作数据,模态包括第一人称视频、hand pose、触觉等 |

| EgoMimic | 一个用第一人称视频数据做 robot learning 的项目 |

| UMI (Universal Manipulation Interface) | 通用操作接口,用人手操作类似 gripper 的设备采集数据 |

| SLAM | 即时定位与地图构建,用于捕捉手部在空间中的位置 |

| VIO | Visual-Inertial Odometry,视觉惯性里程计 |

| Tactile | 触觉数据 |

| Full Stack | 全栈,对机器人硬件、算法、数据整个 pipeline 都要有深入理解 |

| Task and Motion Planning (TAMP) | 任务与运动规划 |

| Teleoperation | 遥操作,用控制设备远程操作机器人 |

| Sim-to-Real | 仿真到现实的迁移 |

| DAgger | Dataset Aggregation,强化学习中的策略迭代方法 |

论文整理

强化学习与模仿学习

- Real-Time Iteration Scheme for Diffusion Policy

扩散策略的实时迭代优化方案 - ASkDAgger: Active Skill-level Data Aggregation for Interactive Imitation Learning

ASkDAgger:面向交互式模仿学习的主动技能级数据聚合方法 - Analyzing the Impact of Multimodal Perception on Sample Complexity and Optimization Landscapes in Imitation Learning

多模态感知对模仿学习样本复杂度与优化曲面的影响分析 - TrajEvo: Trajectory Prediction Heuristics Design via LLM-driven Evolution

TrajEvo:基于大模型进化算法的轨迹预测启发式策略设计 - BTPG-max: Achieving Local Maximal Bidirectional Pairs for Bidirectional Temporal Plan Graphs

BTPG-max:双向时序规划图的局部最优双向配对算法

机器人操控与具身智能

- Genie Envisioner: A Unified World Foundation Platform for Robotic Manipulation

Genie:面向机器人操控的统一世界基础平台 - Robust adaptive fuzzy sliding mode control for trajectory tracking for of cylindrical manipulator

圆柱机械臂轨迹跟踪的鲁棒自适应模糊滑模控制 - CleanUpBench: Embodied Sweeping and Grasping Benchmark

CleanUpBench:具身清扫与抓取任务基准数据集 - Learning to See and Act: Task-Aware View Planning for Robotic Manipulation

学会感知与行动:面向机器人操控的任务感知视角规划 - FCBV-Net: Category-Level Robotic Garment Smoothing via Feature-Conditioned Bimanual Value Prediction

FCBV-Net:基于特征条件双手价值预测的类别级机器人衣物抚平算法 - A Vision-Based Collision Sensing Method for Stable Circular Object Grasping with A Soft Gripper System

面向柔性夹爪稳定抓取圆形物体的视觉碰撞检测方法 - Benchmarking Shortcutting Techniques for Multi-Robot-Arm Motion Planning

多机械臂运动规划捷径优化技术基准评测 - Towards Embodied Agentic AI: Review and Classification of LLM- and VLM-Driven Robot Autonomy and Interaction

迈向具身智能体AI:大语言/视觉语言模型驱动的机器人自主交互综述与分类 - GhostShell: Streaming LLM Function Calls for Concurrent Embodied Programming

GhostShell:面向并发具身编程的流式大模型函数调用框架

感知、定位与状态估计

- A Multi-view Landmark Representation Approach with Application to GNSS-Visual-Inertial Odometry

适用于GNSS视觉惯性里程计的多视角地标表征方法 - Information-Theoretic Graph Fusion with Vision-Language-Action Model for Policy Reasoning and Dual Robotic Control

融合视觉-语言-动作模型的信息论图融合算法,用于策略推理与双机器人协同控制 - Robots can defuse high-intensity conflict situations

机器人在高强度冲突场景中的缓和应用研究

导航与运动规划

- Towards Generalizable Safety in Crowd Navigation via Conformal Uncertainty Handling

基于共形不确定性处理的人群导航通用安全策略研究 - MAG-Nav: Language-Driven Object Navigation Leveraging Memory-Reserved Active Grounding

MAG-Nav:结合记忆留存主动定位的语言驱动物体导航算法 - Hierarchical Deep Deterministic Policy Gradient for Autonomous Maze Navigation of Mobile Robots

面向移动机器人自主迷宫导航的分层深度确定性策略梯度算法 - Optimal Planning for Multi-Robot Simultaneous Area and Line Coverage Using Hierarchical Cyclic Merging Regulation

基于分层循环合并策略的多机器人区域与线路协同覆盖最优规划 - DistillDrive: End-to-End Multi-Mode Autonomous Driving Distillation by Isomorphic Hetero-Source Planning Model

DistillDrive:基于同构异源规划模型的端到端多模态自动驾驶知识蒸馏 - Towards Human-Centric Evaluation of Interaction-Aware Automated Vehicle Controllers: A Framework and Case Study

面向交互感知自动驾驶控制器的人本评估框架与实例研究

人机交互与协作

- Mixed-Initiative Dialog for Human-Robot Collaborative Manipulation

人机协同操控场景下的混合主动式对话交互 - Do Robots Really Need Anthropomorphic Hands?

机器人真的需要拟人化机械手吗? - Dancing with a Robot: An Experimental Study of Child-Robot Interaction in a Performative Art Setting

与机器人共舞:艺术表演场景中的儿童机器人交互实验研究 - From Canada to Japan: How 10,000 km Affect User Perception in Robot Teleoperation

跨越万里:一万公里距离对机器人遥操作用户感知的影响研究 - Examining the legibility of humanoid robot arm movements in a pointing task

指向任务中人形机械臂运动轨迹的可辨识度研究 - On the causality between affective impact and coordinated human-robot reactions

情感影响与人机协同行为反应的因果关系探究 - Affecta-Context: The Context-Guided Behavior Adaptation Framework

Affecta-Context:上下文引导的机器人行为自适应框架 - INTENTION: Inferring Tendencies of Humanoid Robot Motion Through Interactive Intuition and Grounded VLM

INTENTION:结合交互直觉与视觉语言模型的人形机器人运动意图推理