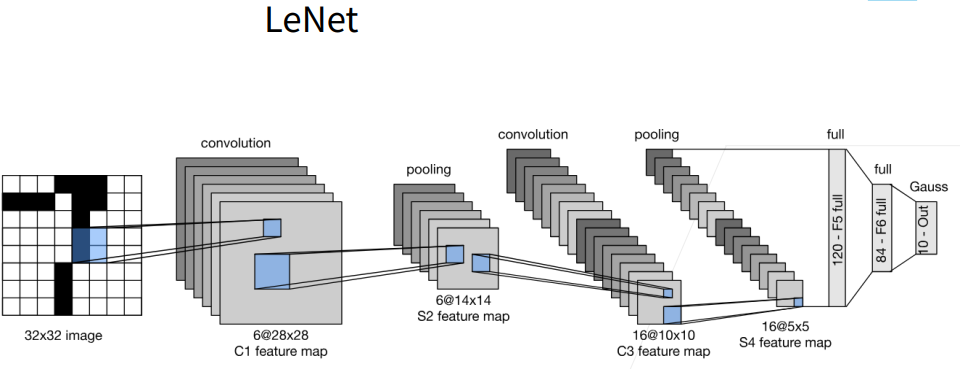

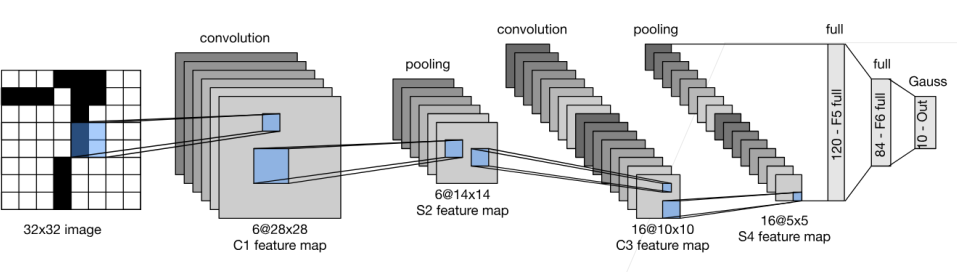

1. LeNet网络

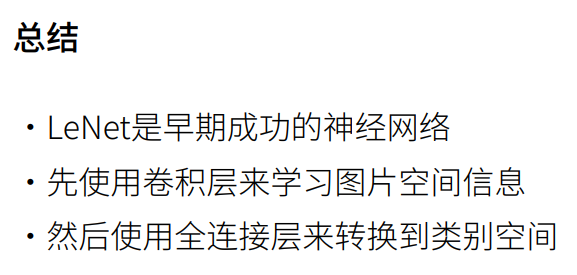

2. 总结

1. LeNet网络(使用自定义)

python

# LeNet(LeNet-5) 由两个部分组成:卷积编码器和全连接层密集块

import torch

from torch import nn

from d2l import torch as d2l

class Reshape(torch.nn.Module):

def forward(self,x):

return x.view(-1,1,28,28) # 批量数自适应得到,通道数为1,图片为28X28

net = torch.nn.Sequential(

#两次卷积两次池化

Reshape(), nn.Conv2d(1,6,kernel_size=5,padding=2),nn.Sigmoid(),

nn.AvgPool2d(2,stride=2),

nn.Conv2d(6,16,kernel_size=5),nn.Sigmoid(),

nn.AvgPool2d(kernel_size=2,stride=2),nn.Flatten(),

nn.Linear(16 * 5 * 5, 120), nn.Sigmoid(),

nn.Linear(120, 84), nn.Sigmoid(),

nn.Linear(84,10))

X = torch.rand(size=(1,1,28,28),dtype=torch.float32)

#每一层做一次迭代

for layer in net:

X = layer(X)

print(layer.__class__.__name__,'output shape:\t',X.shape) # 上一层的输出为这一层的输入Reshape output shape: torch.Size([1, 1, 28, 28])

Conv2d output shape: torch.Size([1, 6, 28, 28])#第一次卷积层,让通道数变为6

Sigmoid output shape: torch.Size([1, 6, 28, 28])

AvgPool2d output shape: torch.Size([1, 6, 14, 14])#压缩了,高宽减半

Conv2d output shape: torch.Size([1, 16, 10, 10])

Sigmoid output shape: torch.Size([1, 16, 10, 10])

AvgPool2d output shape: torch.Size([1, 16, 5, 5])

Flatten output shape: torch.Size([1, 400])

Linear output shape: torch.Size([1, 120])

Sigmoid output shape: torch.Size([1, 120])

Linear output shape: torch.Size([1, 84])

Sigmoid output shape: torch.Size([1, 84])

Linear output shape: torch.Size([1, 10])

python

help(d2l.load_data_fashion_mnist)Help on function load_data_fashion_mnist in module d2l.torch:

load_data_fashion_mnist(batch_size, resize=None) Download the Fashion-MNIST dataset and then load it into memory.

python

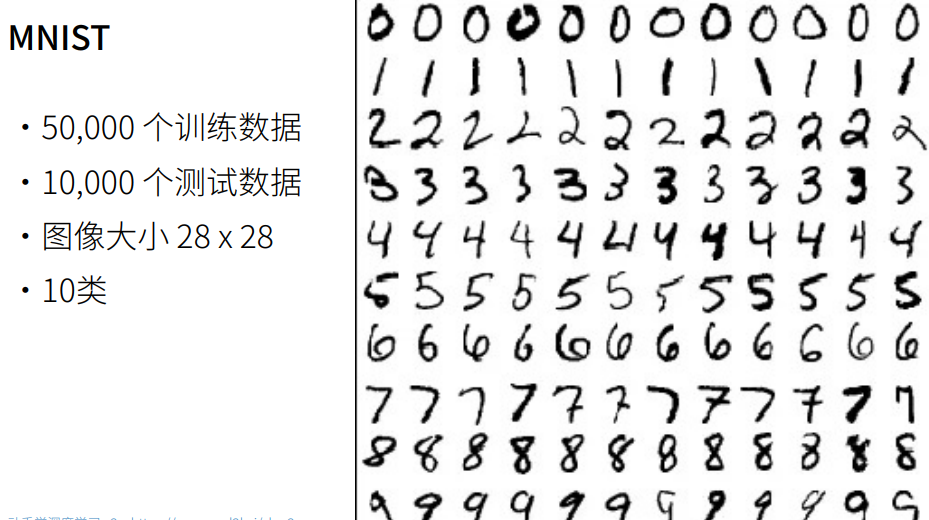

# LeNet在Fashion-MNIST数据集上的表现

batch_size = 256

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size=batch_size) 这段函数本质是在做一件事:在GPU(或指定设备)上评估模型分类准确率。

python

# 对evaluate_accuracy函数进行轻微的修改

#这个函数用来计算准确率

#data_iter:数据迭代器device:用CPU还是GPU

def evaluate_accuracy_gpu(net, data_iter, device=None):

"""使用GPU计算模型在数据集上的精度"""

#判断模型类型 + 切换模式

#判断 net 是不是 PyTorch 模型;net.eval():切换到评估模式

if isinstance(net, torch.nn.Module):

net.eval() # net.eval()开启验证模式,不用计算梯度和更新梯度

#确定设备(CPU/GPU)next(...) → 取第一个参数

#.device → 看这个参数在哪个设备上

if not device:

device = next(iter(net.parameters())).device # 看net.parameters()中第一个元素的device为哪里

#初始化统计器,存两个东西:正确预测数和总样本数

metric = d2l.Accumulator(2)

#遍历数据

for X, y in data_iter:

#把数据搬到GPU:把数据放到和模型同一个设备

if isinstance(X,list):#有的模型是多输入

X = [x.to(device) for x in X] # 如果X是个List,则把每个元素都移到device上

else:

X = X.to(device) # 如果X是一个Tensor,则只用移动一次,直接把X移动到device上

y = y.to(device)

#计算准确率并累加

metric.add(d2l.accuracy(net(X),y),y.numel()) # y.numel() 为y元素个数

return metric[0]/metric[1]用GPU训练模型 + 实时记录训练损失、训练准确率、测试准确率

python

# 为了使用GPU,还需要一点小改动

def train_ch6(net, train_iter, test_iter, num_epochs, lr, device):

"""Train a model with a GPU"""

def init_weights(m):

#对模型中的:全连接层(Linear)卷积层(Conv2d)进行初始化

if type(m) == nn.Linear or type(m) == nn.Conv2d:

nn.init.xavier_uniform_(m.weight) # 根据输入、输出大小,使得随即初始化后,输入和输出的的方差是差不多的

#应用初始化

net.apply(init_weights)

#把模型放到GPU

print('training on',device)

net.to(device)

#定义优化器,用 随机梯度下降(SGD) 更新参数

optimizer = torch.optim.SGD(net.parameters(),lr=lr)

#定义损失函数;用于分类问题

loss = nn.CrossEntropyLoss()

#可视化工具

animator = d2l.Animator(xlabel='epoch',xlim=[1,num_epochs],

legend=['train loss', 'train acc', 'test acc'])

#计时器 & batch数:用来计算训练速度

timer, num_batches = d2l.Timer(), len(train_iter)

for epoch in range(num_epochs):

#初始化统计量

metric = d2l.Accumulator(3)

net.train()#切换训练模式

for i, (X,y) in enumerate(train_iter):

timer.start()#开始计时

optimizer.zero_grad()#梯度清零

#数据放到GPU

X, y = X.to(device), y.to(device)

y_hat = net(X)#前向传播

l = loss(y_hat, y)#计算损失

l.backward()#反向传播计算梯度

#根据梯度更新模型

optimizer.step()

#不计算梯度的统计

with torch.no_grad():

metric.add(l * X.shape[0], d2l.accuracy(y_hat,y),X.shape[0])

timer.stop()

train_l = metric[0] / metric[2]

train_acc = metric[1] / metric[2]

#每隔一段画图

if(i+1) % (num_batches//5) == 0 or i == num_batches - 1:

animator.add(epoch + (i+1) / num_batches,

(train_l, train_acc, None))

test_acc = evaluate_accuracy_gpu(net, test_iter)

animator.add(epoch + 1, (None, None, test_acc))

print(f'loss {train_l:.3f},train acc {train_acc:.3f},'

f'test acc {test_acc:.3f}')

print(f'{metric[2] * num_epochs / timer.sum():.1f} examples/sec'

f'on{str(device)}')

python

help(nn.init.xavier_uniform_)Help on function xavier_uniform_ in module torch.nn.init:

xavier_uniform_(tensor:torch.Tensor, gain:float=1.0) -> torch.Tensor

Fills the input `Tensor` with values according to the method

described in `Understanding the difficulty of training deep feedforward

neural networks` - Glorot, X. & Bengio, Y. (2010), using a uniform

distribution. The resulting tensor will have values sampled from

:math:`\mathcal{U}(-a, a)` where

.. math::

a = \text{gain} \times \sqrt{\frac{6}{\text{fan\_in} + \text{fan\_out}}}

Also known as Glorot initialization.

Args:

tensor: an n-dimensional `torch.Tensor`

gain: an optional scaling factor

Examples:

>>> w = torch.empty(3, 5)

>>> nn.init.xavier_uniform_(w, gain=nn.init.calculate_gain('relu'))

python

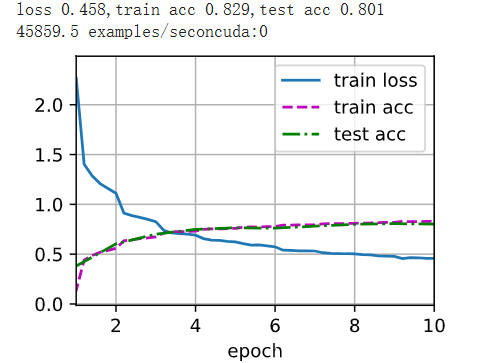

# 训练和评估LeNet-5模型

lr, num_epochs = 0.9, 10

train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())loss 0.458,train acc 0.829,test acc 0.801

45859.5 examples/seconcuda:0