前言

在安装ollama的时候,大家有没有下载了几个AI大模型后,惊讶地发现系统盘空间所剩无几?或者想要将模型文件集中管理,却不知道如何改变默认存储路径?本文,我将手把手教你如何完全掌控Ollama的安装和模型存储位置,让大模型"住"进你指定的文件夹!

一、自定义ollama安装路径

首先,访问 Ollama 官网下载对应操作系统的安装程序。

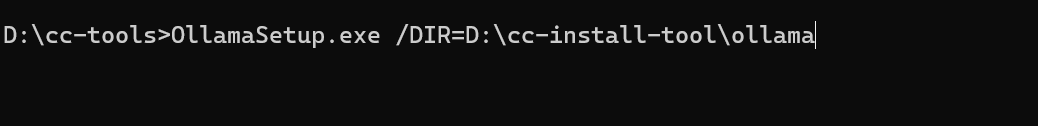

ollama默认安装在系统盘,当AI模型文件几十GB时,系统盘很快就会被塞满。Ollama虽然安装包不大,但下载的模型文件却相当庞大,所以需要通过自定义安装和存储路径,在ollama安装目录打开cmd,在执行安装得时候制定目录:

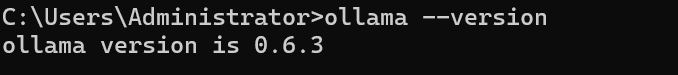

等到安装之后,验证是否安装成功

ollama --version如果出现ollama对应版本说明安装成功。

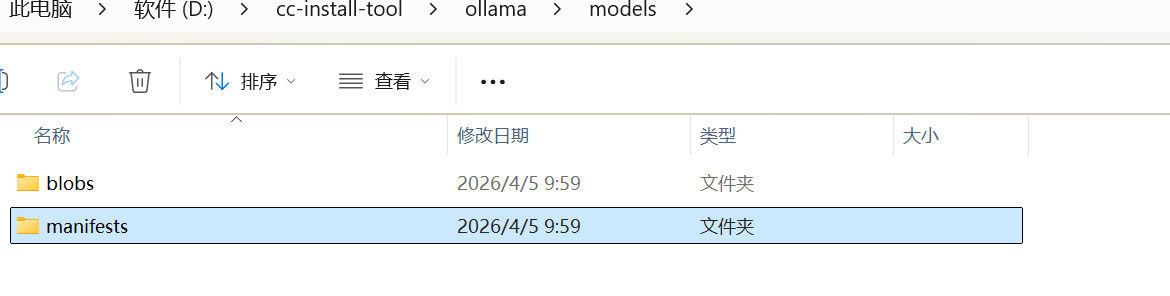

二、创建大模型存储目录

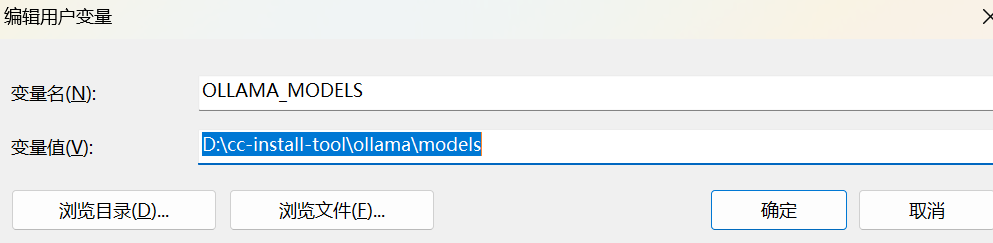

ollama安装完成之后,需要设置大模型环境变量,也就是制定大模型存储得目录。

需要注意的是,设置环境变量之后需要重启ollama,否则不会生效。

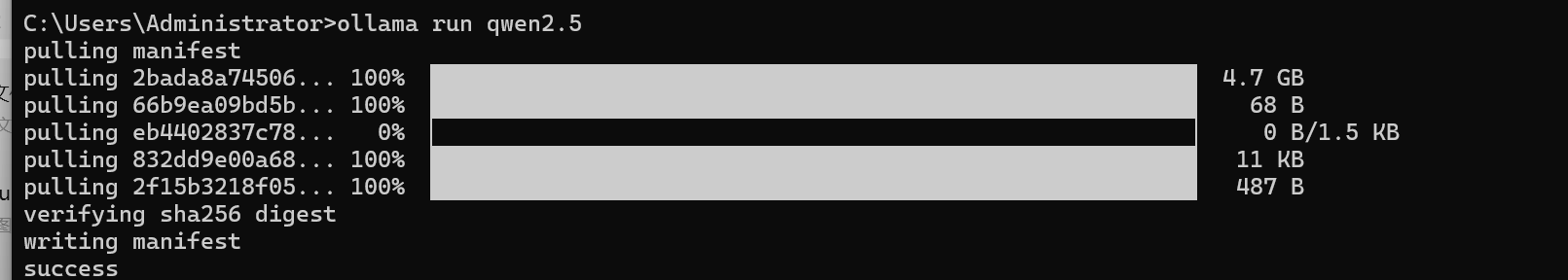

接下来就是,安装千问大模型,执行ollama run qwen2.5,如果ollama没有该模型就会去下载,这个需要科学上网。

三、测试大模型

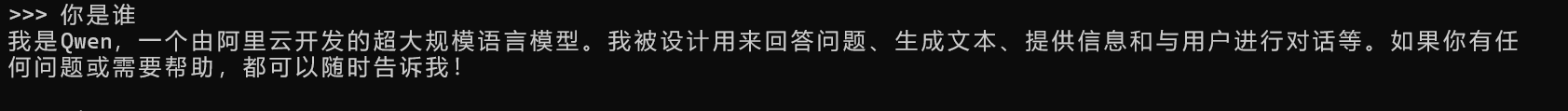

安装完成之后,再次执行ollama run qwen2.5 进入聊天模式,比如输入:你是谁?

至此,自定义ollama安装就已经完成,后面下载的ollama大模型也会存储在我们指定的目录中。

总结

通过自定义Ollama安装路径与模型存储目录,成功解决了大模型占满系统盘空间的痛点。只需设置OLLAMA_MODELS环境变量并重启服务,就能将模型文件定向存储至指定位置,并安装测试千问大模型验证了方案的可行性。这套方法一劳永逸,让本地AI模型管理变得井井有条,为后续探索更多开源模型奠定了清爽、可控的基础。